# 최적화[[optimization]]

`.optimization` 모듈은 다음을 제공합니다:

- 미세 조정된 모델에 사용할 수 있는 가중치 감쇠가 적용된 옵티마이저

- `_LRSchedule`을 상속받는 스케줄 객체 형태의 여러 스케줄

- 여러 배치의 그래디언트를 누적하는 그래디언트 누적 클래스

## AdaFactor (PyTorch)[[transformers.Adafactor]]

[[autodoc]] Adafactor

## 스케줄[[schedules]]

### 학습률 스케줄 (PyTorch)[[transformers.SchedulerType]]

[[autodoc]] SchedulerType

[[autodoc]] get_scheduler

[[autodoc]] get_constant_schedule

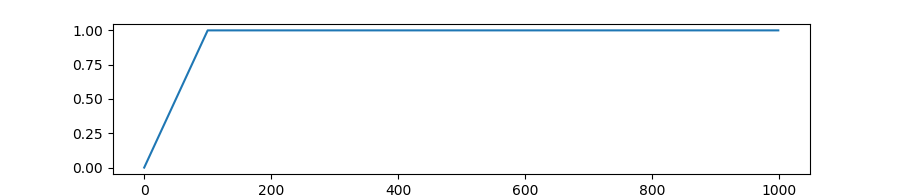

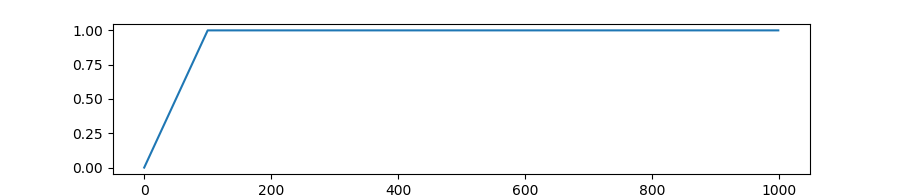

[[autodoc]] get_constant_schedule_with_warmup

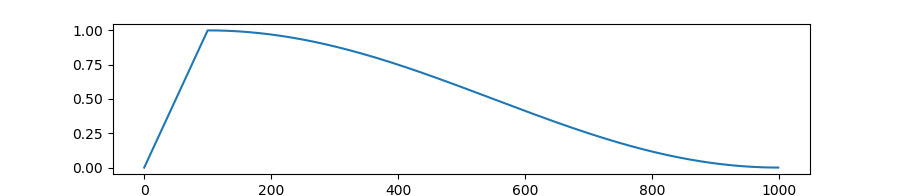

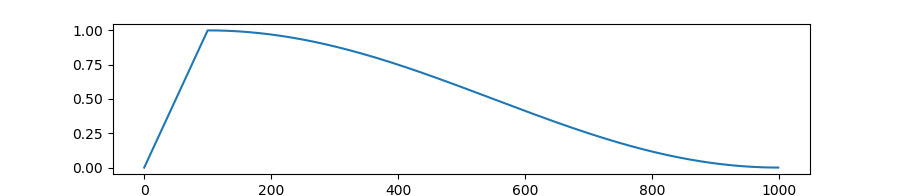

[[autodoc]] get_cosine_schedule_with_warmup

[[autodoc]] get_cosine_schedule_with_warmup

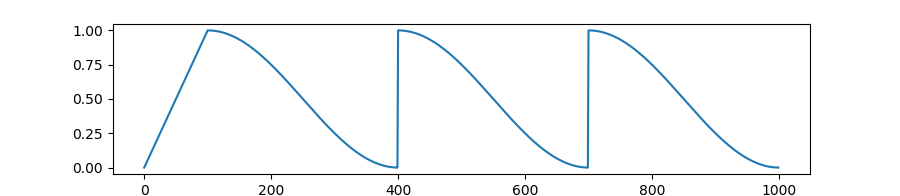

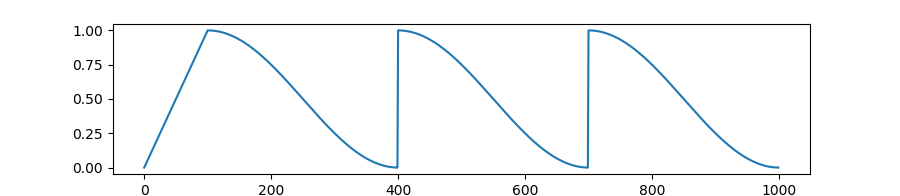

[[autodoc]] get_cosine_with_hard_restarts_schedule_with_warmup

[[autodoc]] get_cosine_with_hard_restarts_schedule_with_warmup

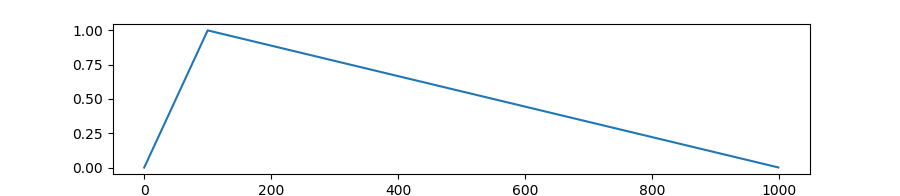

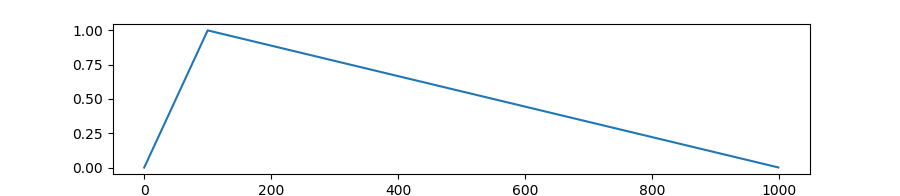

[[autodoc]] get_linear_schedule_with_warmup

[[autodoc]] get_linear_schedule_with_warmup

[[autodoc]] get_polynomial_decay_schedule_with_warmup

[[autodoc]] get_inverse_sqrt_schedule

[[autodoc]] get_wsd_schedule

[[autodoc]] get_polynomial_decay_schedule_with_warmup

[[autodoc]] get_inverse_sqrt_schedule

[[autodoc]] get_wsd_schedule

[[autodoc]] get_cosine_schedule_with_warmup

[[autodoc]] get_cosine_schedule_with_warmup

[[autodoc]] get_cosine_with_hard_restarts_schedule_with_warmup

[[autodoc]] get_cosine_with_hard_restarts_schedule_with_warmup

[[autodoc]] get_linear_schedule_with_warmup

[[autodoc]] get_linear_schedule_with_warmup

[[autodoc]] get_polynomial_decay_schedule_with_warmup

[[autodoc]] get_inverse_sqrt_schedule

[[autodoc]] get_wsd_schedule

[[autodoc]] get_polynomial_decay_schedule_with_warmup

[[autodoc]] get_inverse_sqrt_schedule

[[autodoc]] get_wsd_schedule