+

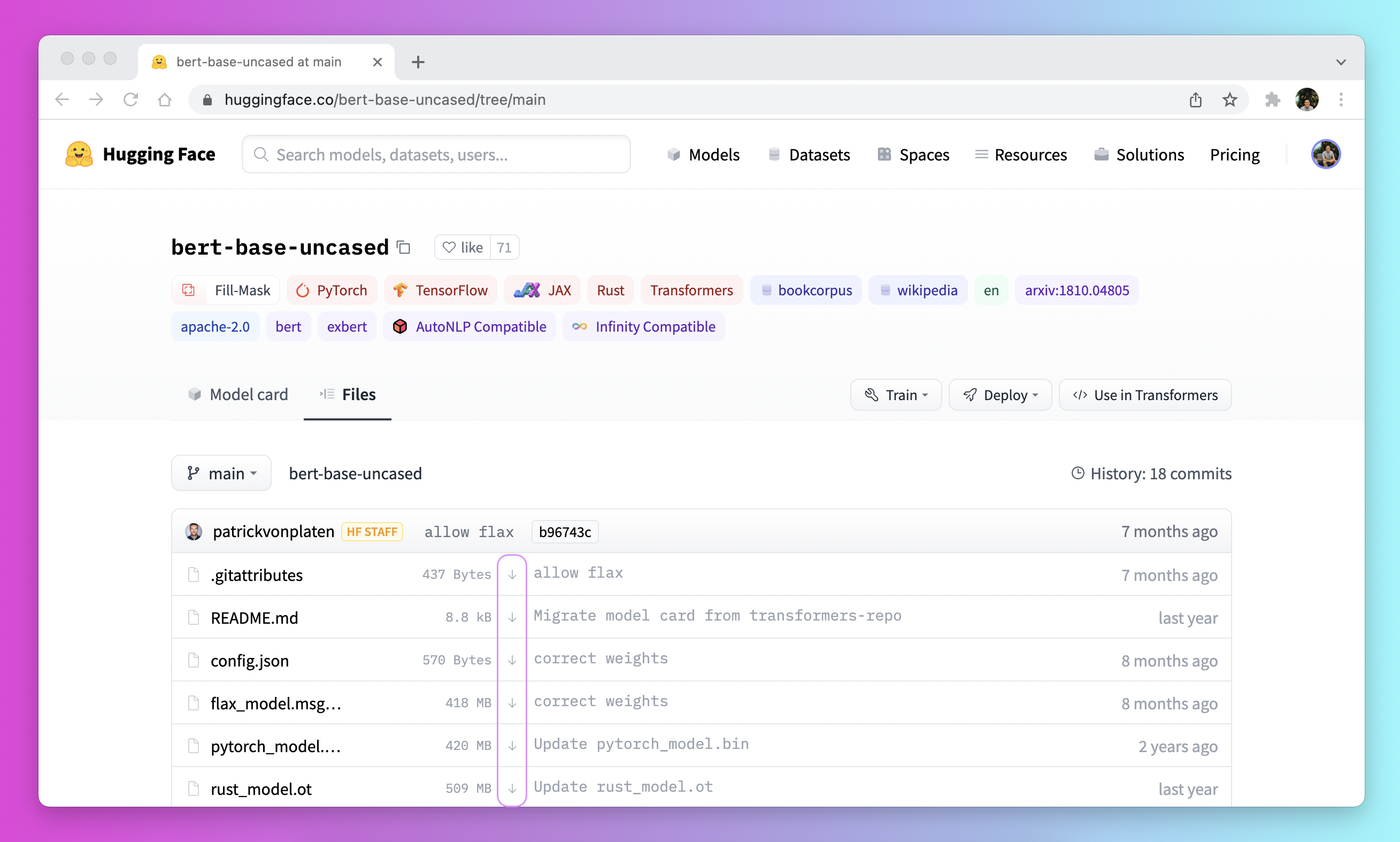

+写真提供:[Denys Nevozhai](https://unsplash.com/@dnevozhai)。

+

+テキストおよび画像のプロンプトを単一のリストとしてモデルのプロセッサに渡し、適切な入力を作成できます。

+

+```py

+>>> prompt = [

+... "https://images.unsplash.com/photo-1543349689-9a4d426bee8e?ixlib=rb-4.0.3&ixid=M3wxMjA3fDB8MHxwaG90by1wYWdlfHx8fGVufDB8fHx8fA%3D%3D&auto=format&fit=crop&w=3501&q=80",

+... "This is an image of ",

+... ]

+

+>>> inputs = processor(prompt, return_tensors="pt").to("cuda")

+>>> bad_words_ids = processor.tokenizer(["", ""], add_special_tokens=False).input_ids

+

+>>> generated_ids = model.generate(**inputs, max_new_tokens=10, bad_words_ids=bad_words_ids)

+>>> generated_text = processor.batch_decode(generated_ids, skip_special_tokens=True)

+>>> print(generated_text[0])

+This is an image of the Eiffel Tower in Paris, France.

+```

+

+## Few-shot prompting

+

+IDEFICS はゼロショットで優れた結果を示しますが、タスクによっては特定の形式のキャプションが必要になる場合や、キャプションが付属する場合があります。

+タスクの複雑さを増大させるその他の制限または要件。少数のショットのプロンプトを使用して、コンテキスト内の学習を有効にすることができます。

+プロンプトに例を指定することで、指定された例の形式を模倣した結果を生成するようにモデルを操作できます。

+

+前のエッフェル塔の画像をモデルの例として使用し、モデルにデモンストレーションするプロンプトを作成してみましょう。

+画像内のオブジェクトが何であるかを知ることに加えて、それに関する興味深い情報も取得したいと考えています。

+次に、自由の女神の画像に対して同じ応答形式を取得できるかどうかを見てみましょう。

+

+

+

+

+

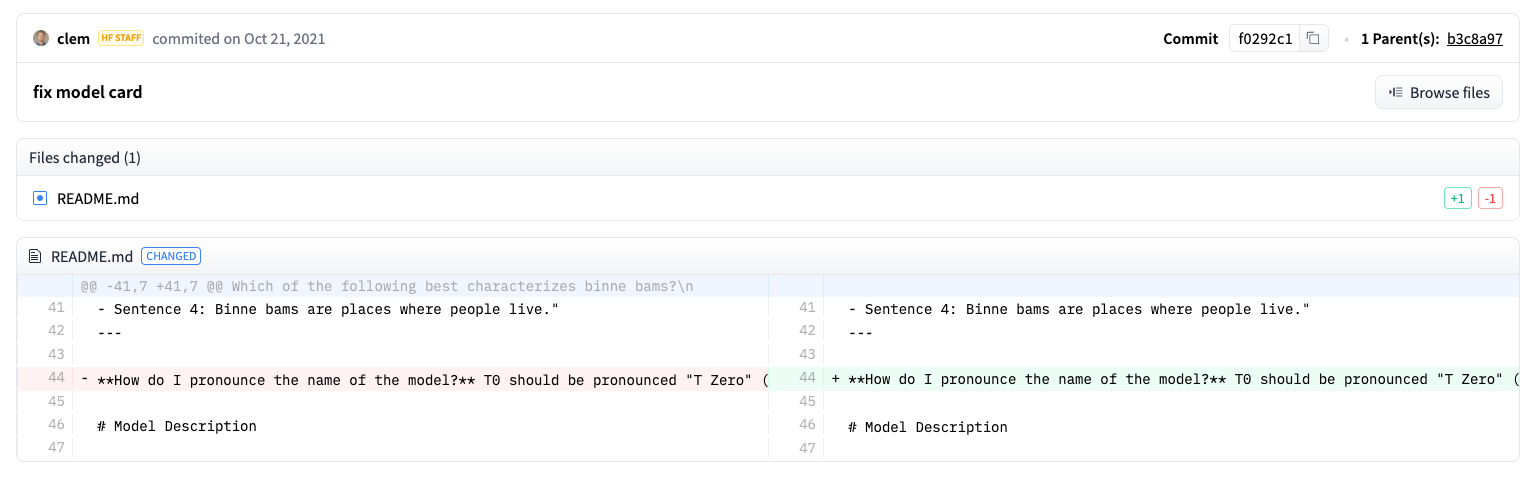

+写真提供:[Juan Mayobre](https://unsplash.com/@jmayobres)。

+

+```py

+>>> prompt = ["User:",

+... "https://images.unsplash.com/photo-1543349689-9a4d426bee8e?ixlib=rb-4.0.3&ixid=M3wxMjA3fDB8MHxwaG90by1wYWdlfHx8fGVufDB8fHx8fA%3D%3D&auto=format&fit=crop&w=3501&q=80",

+... "Describe this image.\nAssistant: An image of the Eiffel Tower at night. Fun fact: the Eiffel Tower is the same height as an 81-storey building.\n",

+... "User:",

+... "https://images.unsplash.com/photo-1524099163253-32b7f0256868?ixlib=rb-4.0.3&ixid=M3wxMjA3fDB8MHxwaG90by1wYWdlfHx8fGVufDB8fHx8fA%3D%3D&auto=format&fit=crop&w=3387&q=80",

+... "Describe this image.\nAssistant:"

+... ]

+

+>>> inputs = processor(prompt, return_tensors="pt").to("cuda")

+>>> bad_words_ids = processor.tokenizer(["", ""], add_special_tokens=False).input_ids

+

+>>> generated_ids = model.generate(**inputs, max_new_tokens=30, bad_words_ids=bad_words_ids)

+>>> generated_text = processor.batch_decode(generated_ids, skip_special_tokens=True)

+>>> print(generated_text[0])

+User: Describe this image.

+Assistant: An image of the Eiffel Tower at night. Fun fact: the Eiffel Tower is the same height as an 81-storey building.

+User: Describe this image.

+Assistant: An image of the Statue of Liberty. Fun fact: the Statue of Liberty is 151 feet tall.

+```

+

+モデルは 1 つの例 (つまり、1 ショット) だけからタスクの実行方法を学習していることに注目してください。より複雑なタスクの場合は、

+より多くの例 (3 ショット、5 ショットなど) を自由に試してみてください。

+

+## Visual question answering

+

+Visual Question Answering (VQA) は、画像に基づいて自由形式の質問に答えるタスクです。画像に似ている

+キャプションは、アクセシビリティ アプリケーションだけでなく、教育 (視覚資料についての推論) にも使用できます。

+サービス(画像を基にした商品に関する質問)、画像検索など。

+

+このタスク用に新しい画像を取得しましょう。

+

+

+

+

+

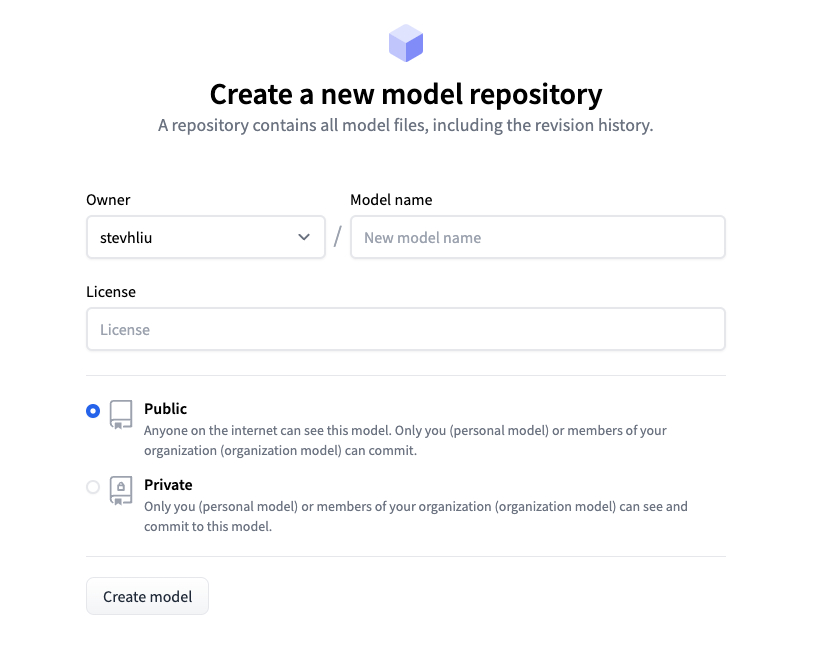

+写真提供 [Jarritos Mexican Soda](https://unsplash.com/@jarritos).

+

+適切な指示をプロンプトすることで、モデルを画像キャプションから視覚的な質問への応答に導くことができます。

+

+```py

+>>> prompt = [

+... "Instruction: Provide an answer to the question. Use the image to answer.\n",

+... "https://images.unsplash.com/photo-1623944889288-cd147dbb517c?ixlib=rb-4.0.3&ixid=M3wxMjA3fDB8MHxwaG90by1wYWdlfHx8fGVufDB8fHx8fA%3D%3D&auto=format&fit=crop&w=3540&q=80",

+... "Question: Where are these people and what's the weather like? Answer:"

+... ]

+

+>>> inputs = processor(prompt, return_tensors="pt").to("cuda")

+>>> bad_words_ids = processor.tokenizer(["", ""], add_special_tokens=False).input_ids

+

+>>> generated_ids = model.generate(**inputs, max_new_tokens=20, bad_words_ids=bad_words_ids)

+>>> generated_text = processor.batch_decode(generated_ids, skip_special_tokens=True)

+>>> print(generated_text[0])

+Instruction: Provide an answer to the question. Use the image to answer.

+ Question: Where are these people and what's the weather like? Answer: They're in a park in New York City, and it's a beautiful day.

+```

+

+## Image classification

+

+IDEFICS は、次のデータを含むデータについて明示的にトレーニングしなくても、画像をさまざまなカテゴリに分類できます。

+これらの特定のカテゴリからのラベル付きの例。カテゴリのリストを指定し、その画像とテキストを使用して理解する

+機能を利用すると、モデルは画像がどのカテゴリに属する可能性が高いかを推測できます。

+

+たとえば、次のような野菜スタンドの画像があるとします。

+

+

+

+

+

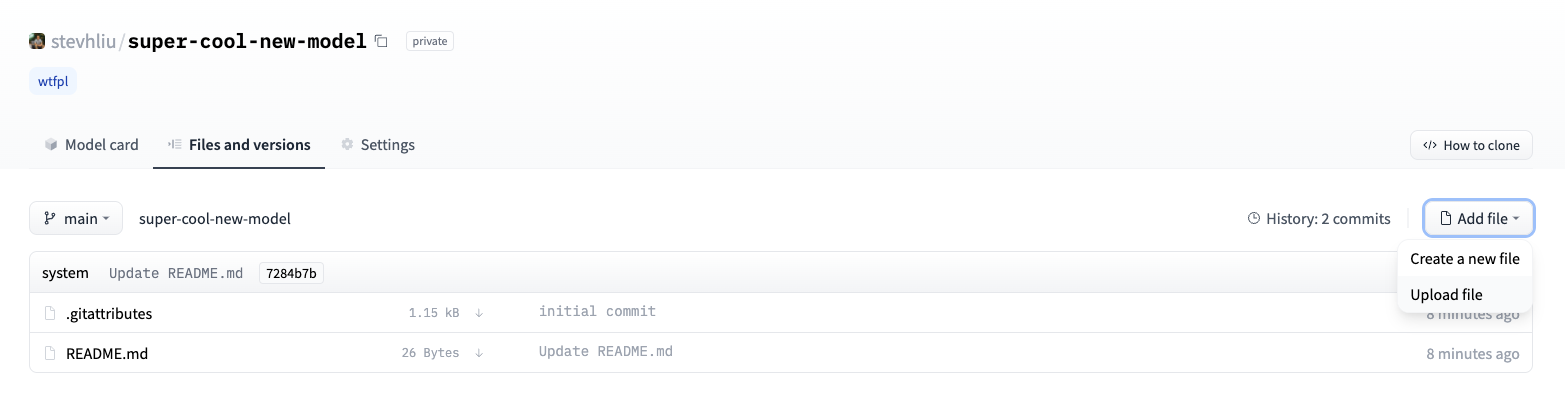

+写真提供:[Peter Wendt](https://unsplash.com/@peterwendt)。

+

+画像を次のいずれかのカテゴリに分類するようにモデルに指示できます。

+

+```py

+>>> categories = ['animals','vegetables', 'city landscape', 'cars', 'office']

+>>> prompt = [f"Instruction: Classify the following image into a single category from the following list: {categories}.\n",

+... "https://images.unsplash.com/photo-1471193945509-9ad0617afabf?ixlib=rb-4.0.3&ixid=M3wxMjA3fDB8MHxwaG90by1wYWdlfHx8fGVufDB8fHx8fA%3D%3D&auto=format&fit=crop&w=3540&q=80",

+... "Category: "

+... ]

+

+>>> inputs = processor(prompt, return_tensors="pt").to("cuda")

+>>> bad_words_ids = processor.tokenizer(["", ""], add_special_tokens=False).input_ids

+

+>>> generated_ids = model.generate(**inputs, max_new_tokens=6, bad_words_ids=bad_words_ids)

+>>> generated_text = processor.batch_decode(generated_ids, skip_special_tokens=True)

+>>> print(generated_text[0])

+Instruction: Classify the following image into a single category from the following list: ['animals', 'vegetables', 'city landscape', 'cars', 'office'].

+Category: Vegetables

+```

+

+上の例では、画像を 1 つのカテゴリに分類するようにモデルに指示していますが、ランク分類を行うようにモデルに指示することもできます。

+

+## Image-guided text generation

+

+よりクリエイティブなアプリケーションの場合は、画像ガイド付きテキスト生成を使用して、画像に基づいてテキストを生成できます。これは可能です

+製品、広告、シーンの説明などを作成するのに役立ちます。

+

+IDEFICS に、赤いドアの単純な画像に基づいてストーリーを書くように促してみましょう。

+

+

+

+

+

+写真提供:[Craig Tidball](https://unsplash.com/@devonshiremedia)。

+

+```py

+>>> prompt = ["Instruction: Use the image to write a story. \n",

+... "https://images.unsplash.com/photo-1517086822157-2b0358e7684a?ixlib=rb-4.0.3&ixid=M3wxMjA3fDB8MHxwaG90by1wYWdlfHx8fGVufDB8fHx8fA%3D%3D&auto=format&fit=crop&w=2203&q=80",

+... "Story: \n"]

+

+>>> inputs = processor(prompt, return_tensors="pt").to("cuda")

+>>> bad_words_ids = processor.tokenizer(["", ""], add_special_tokens=False).input_ids

+

+>>> generated_ids = model.generate(**inputs, num_beams=2, max_new_tokens=200, bad_words_ids=bad_words_ids)

+>>> generated_text = processor.batch_decode(generated_ids, skip_special_tokens=True)

+>>> print(generated_text[0])

+Instruction: Use the image to write a story.

+ Story:

+Once upon a time, there was a little girl who lived in a house with a red door. She loved her red door. It was the prettiest door in the whole world.

+

+One day, the little girl was playing in her yard when she noticed a man standing on her doorstep. He was wearing a long black coat and a top hat.

+

+The little girl ran inside and told her mother about the man.

+

+Her mother said, “Don’t worry, honey. He’s just a friendly ghost.”

+

+The little girl wasn’t sure if she believed her mother, but she went outside anyway.

+

+When she got to the door, the man was gone.

+

+The next day, the little girl was playing in her yard again when she noticed the man standing on her doorstep.

+

+He was wearing a long black coat and a top hat.

+

+The little girl ran

+```

+

+IDEFICS は玄関先にあるカボチャに気づき、幽霊に関する不気味なハロウィーンの話をしたようです。

+

+

+

+このような長い出力の場合、テキスト生成戦略を微調整すると大きなメリットが得られます。これは役に立ちます

+生成される出力の品質が大幅に向上します。 [テキスト生成戦略](../generation_strategies) を確認してください。

+詳しく知ることができ。

+

+

+

+## Running inference in batch mode

+

+これまでのすべてのセクションでは、IDEFICS を 1 つの例として説明しました。非常に似た方法で、推論を実行できます。

+プロンプトのリストを渡すことにより、サンプルのバッチを取得します。

+

+```py

+>>> prompts = [

+... [ "https://images.unsplash.com/photo-1543349689-9a4d426bee8e?ixlib=rb-4.0.3&ixid=M3wxMjA3fDB8MHxwaG90by1wYWdlfHx8fGVufDB8fHx8fA%3D%3D&auto=format&fit=crop&w=3501&q=80",

+... "This is an image of ",

+... ],

+... [ "https://images.unsplash.com/photo-1623944889288-cd147dbb517c?ixlib=rb-4.0.3&ixid=M3wxMjA3fDB8MHxwaG90by1wYWdlfHx8fGVufDB8fHx8fA%3D%3D&auto=format&fit=crop&w=3540&q=80",

+... "This is an image of ",

+... ],

+... [ "https://images.unsplash.com/photo-1471193945509-9ad0617afabf?ixlib=rb-4.0.3&ixid=M3wxMjA3fDB8MHxwaG90by1wYWdlfHx8fGVufDB8fHx8fA%3D%3D&auto=format&fit=crop&w=3540&q=80",

+... "This is an image of ",

+... ],

+... ]

+

+>>> inputs = processor(prompts, return_tensors="pt").to("cuda")

+>>> bad_words_ids = processor.tokenizer(["", ""], add_special_tokens=False).input_ids

+

+>>> generated_ids = model.generate(**inputs, max_new_tokens=10, bad_words_ids=bad_words_ids)

+>>> generated_text = processor.batch_decode(generated_ids, skip_special_tokens=True)

+>>> for i,t in enumerate(generated_text):

+... print(f"{i}:\n{t}\n")

+0:

+This is an image of the Eiffel Tower in Paris, France.

+

+1:

+This is an image of a couple on a picnic blanket.

+

+2:

+This is an image of a vegetable stand.

+```

+

+## IDEFICS instruct for conversational use

+

+会話型のユースケースの場合は、🤗 ハブでモデルの微調整された指示されたバージョンを見つけることができます。

+`HuggingFaceM4/idefics-80b-instruct` および `HuggingFaceM4/idefics-9b-instruct`。

+

+これらのチェックポイントは、教師ありモデルと命令モデルを組み合わせたそれぞれの基本モデルを微調整した結果です。

+データセットを微調整することで、ダウンストリームのパフォーマンスを向上させながら、会話設定でモデルをより使いやすくします。

+

+会話での使用とプロンプトは、基本モデルの使用と非常に似ています。

+

+```py

+>>> import torch

+>>> from transformers import IdeficsForVisionText2Text, AutoProcessor

+

+>>> device = "cuda" if torch.cuda.is_available() else "cpu"

+

+>>> checkpoint = "HuggingFaceM4/idefics-9b-instruct"

+>>> model = IdeficsForVisionText2Text.from_pretrained(checkpoint, torch_dtype=torch.bfloat16).to(device)

+>>> processor = AutoProcessor.from_pretrained(checkpoint)

+

+>>> prompts = [

+... [

+... "User: What is in this image?",

+... "https://upload.wikimedia.org/wikipedia/commons/8/86/Id%C3%A9fix.JPG",

+... "",

+

+... "\nAssistant: This picture depicts Idefix, the dog of Obelix in Asterix and Obelix. Idefix is running on the ground.",

+

+... "\nUser:",

+... "https://static.wikia.nocookie.net/asterix/images/2/25/R22b.gif/revision/latest?cb=20110815073052",

+... "And who is that?",

+

+... "\nAssistant:",

+... ],

+... ]

+

+>>> # --batched mode

+>>> inputs = processor(prompts, add_end_of_utterance_token=False, return_tensors="pt").to(device)

+>>> # --single sample mode

+>>> # inputs = processor(prompts[0], return_tensors="pt").to(device)

+

+>>> # Generation args

+>>> exit_condition = processor.tokenizer("", add_special_tokens=False).input_ids

+>>> bad_words_ids = processor.tokenizer(["", ""], add_special_tokens=False).input_ids

+

+>>> generated_ids = model.generate(**inputs, eos_token_id=exit_condition, bad_words_ids=bad_words_ids, max_length=100)

+>>> generated_text = processor.batch_decode(generated_ids, skip_special_tokens=True)

+>>> for i, t in enumerate(generated_text):

+... print(f"{i}:\n{t}\n")

+```

diff --git a/docs/transformers/docs/source/ja/tasks/image_captioning.md b/docs/transformers/docs/source/ja/tasks/image_captioning.md

new file mode 100644

index 0000000000000000000000000000000000000000..7649947b2c6450110c60ad6f6d7f4a5ad2a9d49d

--- /dev/null

+++ b/docs/transformers/docs/source/ja/tasks/image_captioning.md

@@ -0,0 +1,276 @@

+

+

+# Image captioning

+

+[[open-in-colab]]

+

+画像のキャプション付けは、特定の画像のキャプションを予測するタスクです。一般的な現実世界のアプリケーションには次のものがあります。

+視覚障害者がさまざまな状況を乗り越えられるよう支援します。したがって、画像のキャプション

+画像を説明することで人々のコンテンツへのアクセシビリティを向上させるのに役立ちます。

+

+このガイドでは、次の方法を説明します。

+

+* 画像キャプション モデルを微調整します。

+* 微調整されたモデルを推論に使用します。

+

+始める前に、必要なライブラリがすべてインストールされていることを確認してください。

+

+```bash

+pip install transformers datasets evaluate -q

+pip install jiwer -q

+```

+

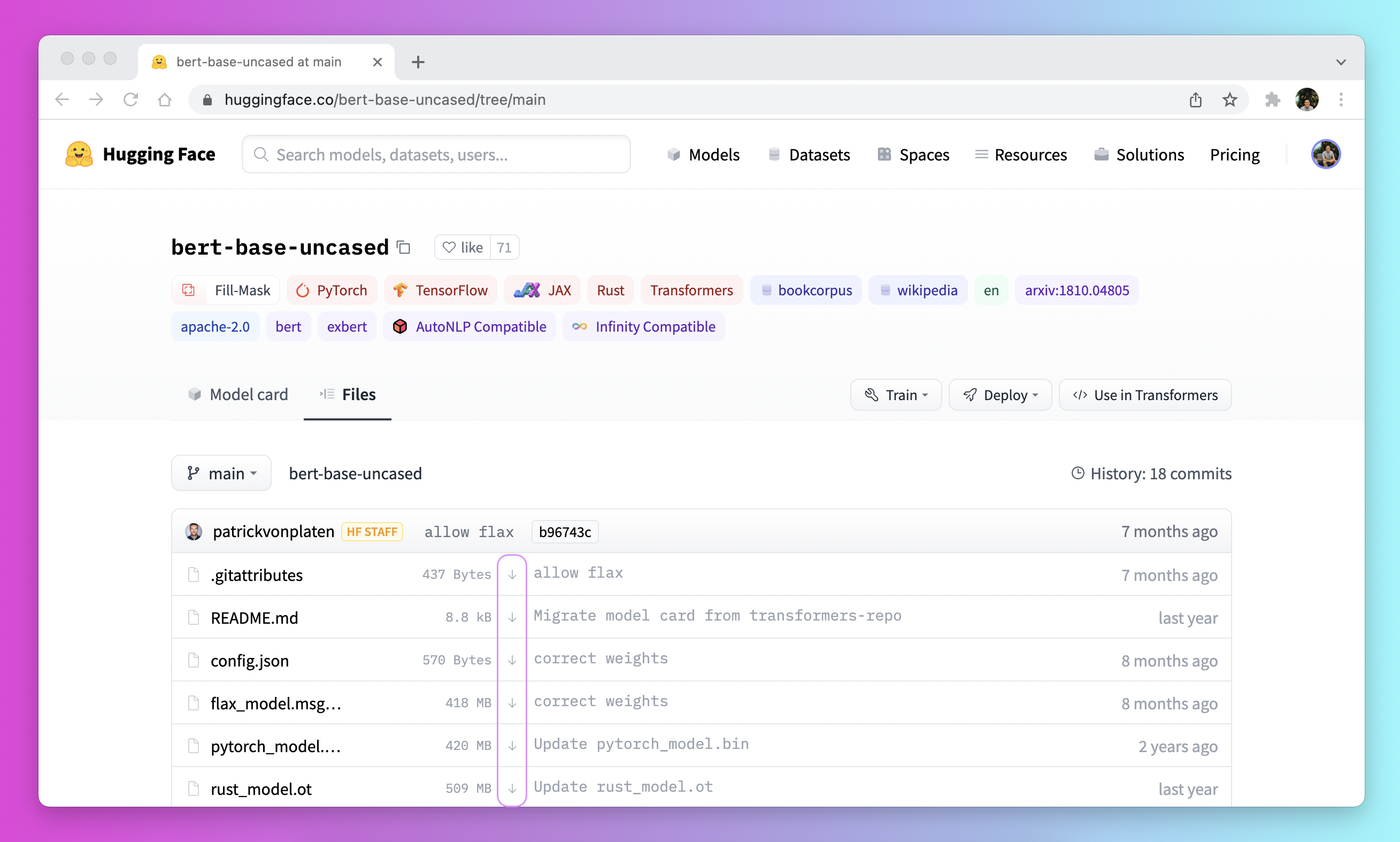

+モデルをアップロードしてコミュニティと共有できるように、Hugging Face アカウントにログインすることをお勧めします。プロンプトが表示されたら、トークンを入力してログインします。

+

+

+```python

+from huggingface_hub import notebook_login

+

+notebook_login()

+```

+

+## Load the Pokémon BLIP captions dataset

+

+🤗 データセット ライブラリを使用して、{image-caption} ペアで構成されるデータセットを読み込みます。独自の画像キャプション データセットを作成するには

+PyTorch では、[このノートブック](https://github.com/NielsRogge/Transformers-Tutorials/blob/master/GIT/Fine_tune_GIT_on_an_image_captioning_dataset.ipynb) を参照できます。

+

+```py

+ds = load_dataset("lambdalabs/pokemon-blip-captions")

+ds

+```

+

+```bash

+DatasetDict({

+ train: Dataset({

+ features: ['image', 'text'],

+ num_rows: 833

+ })

+})

+```

+

+データセットには `image`と`text`の 2 つの機能があります。

+

+

+

+多くの画像キャプション データセットには、画像ごとに複数のキャプションが含まれています。このような場合、一般的な戦略は、トレーニング中に利用可能なキャプションの中からランダムにキャプションをサンプリングすることです。

+

+

+

+[`~datasets.Dataset.train_test_split`] メソッドを使用して、データセットのトレイン スプリットをトレイン セットとテスト セットに分割します。

+

+```python

+ds = ds["train"].train_test_split(test_size=0.1)

+train_ds = ds["train"]

+test_ds = ds["test"]

+```

+

+トレーニング セットからのいくつかのサンプルを視覚化してみましょう。

+

+```python

+from textwrap import wrap

+import matplotlib.pyplot as plt

+import numpy as np

+

+

+def plot_images(images, captions):

+ plt.figure(figsize=(20, 20))

+ for i in range(len(images)):

+ ax = plt.subplot(1, len(images), i + 1)

+ caption = captions[i]

+ caption = "\n".join(wrap(caption, 12))

+ plt.title(caption)

+ plt.imshow(images[i])

+ plt.axis("off")

+

+

+sample_images_to_visualize = [np.array(train_ds[i]["image"]) for i in range(5)]

+sample_captions = [train_ds[i]["text"] for i in range(5)]

+plot_images(sample_images_to_visualize, sample_captions)

+```

+

+

\ No newline at end of file

diff --git a/docs/transformers/docs/source/ja/tasks/knowledge_distillation_for_image_classification.md b/docs/transformers/docs/source/ja/tasks/knowledge_distillation_for_image_classification.md

new file mode 100644

index 0000000000000000000000000000000000000000..1079121c6062bceb7b53e1e71625f6744c49f6eb

--- /dev/null

+++ b/docs/transformers/docs/source/ja/tasks/knowledge_distillation_for_image_classification.md

@@ -0,0 +1,188 @@

+

+# Knowledge Distillation for Computer Vision

+

+[[open-in-colab]]

+

+知識の蒸留は、より大規模で複雑なモデル (教師) からより小規模で単純なモデル (生徒) に知識を伝達するために使用される手法です。あるモデルから別のモデルに知識を抽出するには、特定のタスク (この場合は画像分類) でトレーニングされた事前トレーニング済み教師モデルを取得し、画像分類でトレーニングされる生徒モデルをランダムに初期化します。次に、学生モデルをトレーニングして、その出力と教師の出力の差を最小限に抑え、動作を模倣します。これは [Distilling the Knowledge in a Neural Network by Hinton et al](https://arxiv.org/abs/1503.02531) で最初に導入されました。このガイドでは、タスク固有の知識の蒸留を行います。これには [Beans データセット](https://huggingface.co/datasets/beans) を使用します。

+

+このガイドでは、[微調整された ViT モデル](https://huggingface.co/merve/vit-mobilenet-beans-224) (教師モデル) を抽出して [MobileNet](https://huggingface.co/google/mobilenet_v2_1.4_224) (学生モデル) 🤗 Transformers の [Trainer API](https://huggingface.co/docs/transformers/en/main_classes/trainer#trainer) を使用します。

+

+蒸留とプロセスの評価に必要なライブラリをインストールしましょう。

+

+```bash

+pip install transformers datasets accelerate tensorboard evaluate --upgrade

+```

+

+この例では、教師モデルとして`merve/beans-vit-224`モデルを使用しています。これは、Bean データセットに基づいて微調整された`google/vit-base-patch16-224-in21k`に基づく画像分類モデルです。このモデルをランダムに初期化された MobileNetV2 に抽出します。

+

+次に、データセットをロードします。

+

+```python

+from datasets import load_dataset

+

+dataset = load_dataset("beans")

+```

+

+この場合、同じ解像度で同じ出力が返されるため、どちらのモデルの画像プロセッサも使用できます。 `dataset`の`map()`メソッドを使用して、データセットのすべての分割に前処理を適用します。

+

+```python

+from transformers import AutoImageProcessor

+teacher_processor = AutoImageProcessor.from_pretrained("merve/beans-vit-224")

+

+def process(examples):

+ processed_inputs = teacher_processor(examples["image"])

+ return processed_inputs

+

+processed_datasets = dataset.map(process, batched=True)

+```

+

+基本的に、我々は生徒モデル(ランダムに初期化されたMobileNet)が教師モデル(微調整されたビジョン変換器)を模倣することを望む。これを実現するために、まず教師と生徒からロジット出力を得る。次に、それぞれのソフトターゲットの重要度を制御するパラメータ`temperature`で分割する。`lambda`と呼ばれるパラメータは蒸留ロスの重要度を量る。この例では、`temperature=5`、`lambda=0.5`とする。生徒と教師の間の発散を計算するために、Kullback-Leibler発散損失を使用します。2つのデータPとQが与えられたとき、KLダイバージェンスはQを使ってPを表現するためにどれだけの余分な情報が必要かを説明します。もし2つが同じであれば、QからPを説明するために必要な他の情報はないので、それらのKLダイバージェンスはゼロになります。

+

+

+```python

+from transformers import TrainingArguments, Trainer

+import torch

+import torch.nn as nn

+import torch.nn.functional as F

+

+

+class ImageDistilTrainer(Trainer):

+ def __init__(self, *args, teacher_model=None, **kwargs):

+ super().__init__(*args, **kwargs)

+ self.teacher = teacher_model

+ self.student = student_model

+ self.loss_function = nn.KLDivLoss(reduction="batchmean")

+ device = torch.device('cuda' if torch.cuda.is_available() else 'cpu')

+ self.teacher.to(device)

+ self.teacher.eval()

+ self.temperature = temperature

+ self.lambda_param = lambda_param

+

+ def compute_loss(self, student, inputs, return_outputs=False):

+ student_output = self.student(**inputs)

+

+ with torch.no_grad():

+ teacher_output = self.teacher(**inputs)

+

+ # Compute soft targets for teacher and student

+ soft_teacher = F.softmax(teacher_output.logits / self.temperature, dim=-1)

+ soft_student = F.log_softmax(student_output.logits / self.temperature, dim=-1)

+

+ # Compute the loss

+ distillation_loss = self.loss_function(soft_student, soft_teacher) * (self.temperature ** 2)

+

+ # Compute the true label loss

+ student_target_loss = student_output.loss

+

+ # Calculate final loss

+ loss = (1. - self.lambda_param) * student_target_loss + self.lambda_param * distillation_loss

+ return (loss, student_output) if return_outputs else loss

+```

+

+次に、Hugging Face Hub にログインして、`trainer`を通じてモデルを Hugging Face Hub にプッシュできるようにします。

+

+```python

+from huggingface_hub import notebook_login

+

+notebook_login()

+```

+

+教師モデルと生徒モデルである`TrainingArguments`を設定しましょう。

+

+```python

+from transformers import AutoModelForImageClassification, MobileNetV2Config, MobileNetV2ForImageClassification

+

+training_args = TrainingArguments(

+ output_dir="my-awesome-model",

+ num_train_epochs=30,

+ fp16=True,

+ logging_dir=f"{repo_name}/logs",

+ logging_strategy="epoch",

+ eval_strategy="epoch",

+ save_strategy="epoch",

+ load_best_model_at_end=True,

+ metric_for_best_model="accuracy",

+ report_to="tensorboard",

+ push_to_hub=True,

+ hub_strategy="every_save",

+ hub_model_id=repo_name,

+ )

+

+num_labels = len(processed_datasets["train"].features["labels"].names)

+

+# initialize models

+teacher_model = AutoModelForImageClassification.from_pretrained(

+ "merve/beans-vit-224",

+ num_labels=num_labels,

+ ignore_mismatched_sizes=True

+)

+

+# training MobileNetV2 from scratch

+student_config = MobileNetV2Config()

+student_config.num_labels = num_labels

+student_model = MobileNetV2ForImageClassification(student_config)

+```

+

+`compute_metrics` 関数を使用して、テスト セットでモデルを評価できます。この関数は、トレーニング プロセス中にモデルの`accuracy`と`f1`を計算するために使用されます。

+

+```python

+import evaluate

+import numpy as np

+

+accuracy = evaluate.load("accuracy")

+

+def compute_metrics(eval_pred):

+ predictions, labels = eval_pred

+ acc = accuracy.compute(references=labels, predictions=np.argmax(predictions, axis=1))

+ return {"accuracy": acc["accuracy"]}

+```

+

+定義したトレーニング引数を使用して`Trainer`を初期化しましょう。データ照合装置も初期化します。

+

+

+```python

+from transformers import DefaultDataCollator

+

+data_collator = DefaultDataCollator()

+trainer = ImageDistilTrainer(

+ student_model=student_model,

+ teacher_model=teacher_model,

+ training_args=training_args,

+ train_dataset=processed_datasets["train"],

+ eval_dataset=processed_datasets["validation"],

+ data_collator=data_collator,

+ processing_class=teacher_extractor,

+ compute_metrics=compute_metrics,

+ temperature=5,

+ lambda_param=0.5

+)

+```

+

+これでモデルをトレーニングできるようになりました。

+

+```python

+trainer.train()

+```

+

+テスト セットでモデルを評価できます。

+

+

+```python

+trainer.evaluate(processed_datasets["test"])

+```

+

+テスト セットでは、モデルの精度は 72% に達します。蒸留効率の健全性チェックを行うために、同じハイパーパラメータを使用して Bean データセットで MobileNet を最初からトレーニングし、テスト セットで 63% の精度を観察しました。読者の皆様には、さまざまな事前トレーニング済み教師モデル、学生アーキテクチャ、蒸留パラメータを試していただき、その結果を報告していただくようお勧めします。抽出されたモデルのトレーニング ログとチェックポイントは [このリポジトリ](https://huggingface.co/merve/vit-mobilenet-beans-224) にあり、最初からトレーニングされた MobileNetV2 はこの [リポジトリ](https://huggingface.co/merve/resnet-mobilenet-beans-5)。

diff --git a/docs/transformers/docs/source/ja/tasks/language_modeling.md b/docs/transformers/docs/source/ja/tasks/language_modeling.md

new file mode 100644

index 0000000000000000000000000000000000000000..1cadc0af0ac0a559dd3b332c742dffa503b4fe64

--- /dev/null

+++ b/docs/transformers/docs/source/ja/tasks/language_modeling.md

@@ -0,0 +1,437 @@

+

+

+# Causal language modeling

+

+

+[[open-in-colab]]

+

+

+言語モデリングには、因果的モデリングとマスクされた言語モデリングの 2 つのタイプがあります。このガイドでは、因果関係のある言語モデリングについて説明します。

+因果言語モデルはテキスト生成によく使用されます。これらのモデルは、次のようなクリエイティブなアプリケーションに使用できます。

+独自のテキスト アドベンチャーを選択するか、Copilot や CodeParrot などのインテリジェントなコーディング アシスタントを選択します。

+

+

+

+

+因果言語モデリングは、一連のトークン内の次のトークンを予測します。モデルは、次のトークンにのみ対応できます。

+左。これは、モデルが将来のトークンを認識できないことを意味します。 GPT-2 は因果的言語モデルの一例です。

+

+このガイドでは、次の方法を説明します。

+

+1. [ELI5](https:/) の [r/askscience](https://www.reddit.com/r/askscience/) サブセットで [DistilGPT2](https://huggingface.co/distilbert/distilgpt2) を微調整します。 /huggingface.co/datasets/eli5) データセット。

+2. 微調整したモデルを推論に使用します。

+

+

+

+このタスクと互換性のあるすべてのアーキテクチャとチェックポイントを確認するには、[タスクページ](https://huggingface.co/tasks/text-generation) を確認することをお勧めします。u

+

+

+

+始める前に、必要なライブラリがすべてインストールされていることを確認してください。

+

+```bash

+pip install transformers datasets evaluate

+```

+

+モデルをアップロードしてコミュニティと共有できるように、Hugging Face アカウントにログインすることをお勧めします。プロンプトが表示されたら、トークンを入力してログインします。

+

+```py

+>>> from huggingface_hub import notebook_login

+

+>>> notebook_login()

+```

+

+## Load ELI5 dataset

+

+

+まず、ELI5 データセットの r/askscience サブセットの小さいサブセットを 🤗 データセット ライブラリからロードします。

+ これにより、完全なデータセットのトレーニングにさらに時間を費やす前に、実験してすべてが機能することを確認する機会が得られます。

+

+```py

+>>> from datasets import load_dataset

+

+>>> eli5 = load_dataset("eli5", split="train_asks[:5000]")

+```

+

+[`~datasets.Dataset.train_test_split`] メソッドを使用して、データセットの `train_asks` をトレイン セットとテスト セットに分割します。

+

+```py

+>>> eli5 = eli5.train_test_split(test_size=0.2)

+```

+

+次に、例を見てみましょう。

+

+```py

+>>> eli5["train"][0]

+{'answers': {'a_id': ['c3d1aib', 'c3d4lya'],

+ 'score': [6, 3],

+ 'text': ["The velocity needed to remain in orbit is equal to the square root of Newton's constant times the mass of earth divided by the distance from the center of the earth. I don't know the altitude of that specific mission, but they're usually around 300 km. That means he's going 7-8 km/s.\n\nIn space there are no other forces acting on either the shuttle or the guy, so they stay in the same position relative to each other. If he were to become unable to return to the ship, he would presumably run out of oxygen, or slowly fall into the atmosphere and burn up.",

+ "Hope you don't mind me asking another question, but why aren't there any stars visible in this photo?"]},

+ 'answers_urls': {'url': []},

+ 'document': '',

+ 'q_id': 'nyxfp',

+ 'selftext': '_URL_0_\n\nThis was on the front page earlier and I have a few questions about it. Is it possible to calculate how fast the astronaut would be orbiting the earth? Also how does he stay close to the shuttle so that he can return safely, i.e is he orbiting at the same speed and can therefore stay next to it? And finally if his propulsion system failed, would he eventually re-enter the atmosphere and presumably die?',

+ 'selftext_urls': {'url': ['http://apod.nasa.gov/apod/image/1201/freeflyer_nasa_3000.jpg']},

+ 'subreddit': 'askscience',

+ 'title': 'Few questions about this space walk photograph.',

+ 'title_urls': {'url': []}}

+```

+

+これは多くのことのように見えるかもしれませんが、実際に関心があるのは`text`フィールドだけです。言語モデリングの優れている点

+タスクでは、次の単語がラベル * であるため、ラベル (教師なしタスクとも呼ばれます) は必要ありません。

+

+

+## Preprocess

+

+

+

+

+次のステップは、`text`サブフィールドを処理するために DistilGPT2 トークナイザーをロードすることです。

+

+```py

+>>> from transformers import AutoTokenizer

+

+>>> tokenizer = AutoTokenizer.from_pretrained("distilbert/distilgpt2")

+```

+

+上の例からわかるように、`text`フィールドは実際には`answers`内にネストされています。つまり、次のことが必要になります。

+[` flatten`](https://huggingface.co/docs/datasets/process.html#flatten) メソッドを使用して、ネストされた構造から `text` サブフィールドを抽出します。

+

+```py

+>>> eli5 = eli5.flatten()

+>>> eli5["train"][0]

+{'answers.a_id': ['c3d1aib', 'c3d4lya'],

+ 'answers.score': [6, 3],

+ 'answers.text': ["The velocity needed to remain in orbit is equal to the square root of Newton's constant times the mass of earth divided by the distance from the center of the earth. I don't know the altitude of that specific mission, but they're usually around 300 km. That means he's going 7-8 km/s.\n\nIn space there are no other forces acting on either the shuttle or the guy, so they stay in the same position relative to each other. If he were to become unable to return to the ship, he would presumably run out of oxygen, or slowly fall into the atmosphere and burn up.",

+ "Hope you don't mind me asking another question, but why aren't there any stars visible in this photo?"],

+ 'answers_urls.url': [],

+ 'document': '',

+ 'q_id': 'nyxfp',

+ 'selftext': '_URL_0_\n\nThis was on the front page earlier and I have a few questions about it. Is it possible to calculate how fast the astronaut would be orbiting the earth? Also how does he stay close to the shuttle so that he can return safely, i.e is he orbiting at the same speed and can therefore stay next to it? And finally if his propulsion system failed, would he eventually re-enter the atmosphere and presumably die?',

+ 'selftext_urls.url': ['http://apod.nasa.gov/apod/image/1201/freeflyer_nasa_3000.jpg'],

+ 'subreddit': 'askscience',

+ 'title': 'Few questions about this space walk photograph.',

+ 'title_urls.url': []}

+```

+

+`answers`接頭辞で示されるように、各サブフィールドは個別の列になり、`text`フィールドはリストになりました。その代わり

+各文を個別にトークン化する場合は、リストを文字列に変換して、それらをまとめてトークン化できるようにします。

+

+以下は、各例の文字列のリストを結合し、結果をトークン化する最初の前処理関数です。

+

+```py

+>>> def preprocess_function(examples):

+... return tokenizer([" ".join(x) for x in examples["answers.text"]])

+```

+

+この前処理関数をデータセット全体に適用するには、🤗 Datasets [`~datasets.Dataset.map`] メソッドを使用します。 `map` 関数を高速化するには、`batched=True` を設定してデータセットの複数の要素を一度に処理し、`num_proc` でプロセスの数を増やします。不要な列を削除します。

+

+```py

+>>> tokenized_eli5 = eli5.map(

+... preprocess_function,

+... batched=True,

+... num_proc=4,

+... remove_columns=eli5["train"].column_names,

+... )

+```

+

+このデータセットにはトークン シーケンスが含まれていますが、その一部はモデルの最大入力長よりも長くなります。

+

+2 番目の前処理関数を使用して、

+- すべてのシーケンスを連結します

+- 連結されたシーケンスを`block_size`で定義された短いチャンクに分割します。これは、最大入力長より短く、GPU RAM に十分な長さである必要があります。

+

+```py

+>>> block_size = 128

+

+

+>>> def group_texts(examples):

+... # Concatenate all texts.

+... concatenated_examples = {k: sum(examples[k], []) for k in examples.keys()}

+... total_length = len(concatenated_examples[list(examples.keys())[0]])

+... # We drop the small remainder, we could add padding if the model supported it instead of this drop, you can

+... # customize this part to your needs.

+... if total_length >= block_size:

+... total_length = (total_length // block_size) * block_size

+... # Split by chunks of block_size.

+... result = {

+... k: [t[i : i + block_size] for i in range(0, total_length, block_size)]

+... for k, t in concatenated_examples.items()

+... }

+... result["labels"] = result["input_ids"].copy()

+... return result

+```

+

+Apply the `group_texts` function over the entire dataset:

+

+```py

+>>> lm_dataset = tokenized_eli5.map(group_texts, batched=True, num_proc=4)

+```

+

+次に、[`DataCollatorForLanguageModeling`] を使用してサンプルのバッチを作成します。 *動的にパディング*する方が効率的です。

+データセット全体を最大長までパディングするのではなく、照合中にバッチ内の文を最長の長さにします。

+

+

+

+

+シーケンス終了トークンをパディング トークンとして使用し、`mlm=False` を設定します。これは、入力を 1 要素分右にシフトしたラベルとして使用します。

+

+```py

+>>> from transformers import DataCollatorForLanguageModeling

+

+>>> tokenizer.pad_token = tokenizer.eos_token

+>>> data_collator = DataCollatorForLanguageModeling(tokenizer=tokenizer, mlm=False)

+```

+

+

+

+シーケンス終了トークンをパディング トークンとして使用し、`mlm=False` を設定します。これは、入力を 1 要素分右にシフトしたラベルとして使用します。

+

+```py

+>>> from transformers import DataCollatorForLanguageModeling

+

+>>> data_collator = DataCollatorForLanguageModeling(tokenizer=tokenizer, mlm=False, return_tensors="tf")

+```

+

+

+

+

+

+## Train

+

+

+

+

+

+[`Trainer`] を使用したモデルの微調整に慣れていない場合は、[基本チュートリアル](../training#train-with-pytorch-trainer) を参照してください。

+

+

+

+これでモデルのトレーニングを開始する準備が整いました。 [`AutoModelForCausalLM`] を使用して DistilGPT2 をロードします。

+

+

+```py

+>>> from transformers import AutoModelForCausalLM, TrainingArguments, Trainer

+

+>>> model = AutoModelForCausalLM.from_pretrained("distilbert/distilgpt2")

+```

+

+この時点で残っている手順は次の 3 つだけです。

+

+1. [`TrainingArguments`] でトレーニング ハイパーパラメータを定義します。唯一の必須パラメータは、モデルの保存場所を指定する `output_dir` です。 `push_to_hub=True`を設定して、このモデルをハブにプッシュします (モデルをアップロードするには、Hugging Face にサインインする必要があります)。

+2. トレーニング引数をモデル、データセット、データ照合器とともに [`Trainer`] に渡します。

+3. [`~Trainer.train`] を呼び出してモデルを微調整します。

+

+```py

+>>> training_args = TrainingArguments(

+... output_dir="my_awesome_eli5_clm-model",

+... eval_strategy="epoch",

+... learning_rate=2e-5,

+... weight_decay=0.01,

+... push_to_hub=True,

+... )

+

+>>> trainer = Trainer(

+... model=model,

+... args=training_args,

+... train_dataset=lm_dataset["train"],

+... eval_dataset=lm_dataset["test"],

+... data_collator=data_collator,

+... )

+

+>>> trainer.train()

+```

+

+トレーニングが完了したら、 [`~transformers.Trainer.evaluate`] メソッドを使用してモデルを評価し、その複雑さを取得します。

+

+```py

+>>> import math

+

+>>> eval_results = trainer.evaluate()

+>>> print(f"Perplexity: {math.exp(eval_results['eval_loss']):.2f}")

+Perplexity: 49.61

+```

+

+次に、 [`~transformers.Trainer.push_to_hub`] メソッドを使用してモデルをハブに共有し、誰もがモデルを使用できるようにします。

+

+```py

+>>> trainer.push_to_hub()

+```

+

+

+

+

+Keras を使用したモデルの微調整に慣れていない場合は、[基本チュートリアル](../training#train-a-tensorflow-model-with-keras) をご覧ください。

+

+

+TensorFlow でモデルを微調整するには、オプティマイザー関数、学習率スケジュール、およびいくつかのトレーニング ハイパーパラメーターをセットアップすることから始めます。

+

+```py

+>>> from transformers import create_optimizer, AdamWeightDecay

+

+>>> optimizer = AdamWeightDecay(learning_rate=2e-5, weight_decay_rate=0.01)

+```

+

+次に、[`TFAutoModelForCausalLM`] を使用して DistilGPT2 をロードできます。

+

+```py

+>>> from transformers import TFAutoModelForCausalLM

+

+>>> model = TFAutoModelForCausalLM.from_pretrained("distilbert/distilgpt2")

+```

+

+[`~transformers.TFPreTrainedModel.prepare_tf_dataset`] を使用して、データセットを `tf.data.Dataset` 形式に変換します。

+

+```py

+>>> tf_train_set = model.prepare_tf_dataset(

+... lm_dataset["train"],

+... shuffle=True,

+... batch_size=16,

+... collate_fn=data_collator,

+... )

+

+>>> tf_test_set = model.prepare_tf_dataset(

+... lm_dataset["test"],

+... shuffle=False,

+... batch_size=16,

+... collate_fn=data_collator,

+... )

+```

+

+[`compile`](https://keras.io/api/models/model_training_apis/#compile-method) を使用してトレーニング用のモデルを設定します。 Transformers モデルにはすべてデフォルトのタスク関連の損失関数があるため、次の場合を除き、損失関数を指定する必要はないことに注意してください。

+

+```py

+>>> import tensorflow as tf

+

+>>> model.compile(optimizer=optimizer) # No loss argument!

+```

+

+これは、モデルとトークナイザーを [`~transformers.PushToHubCallback`] でプッシュする場所を指定することで実行できます。

+

+

+

+```py

+>>> from transformers.keras_callbacks import PushToHubCallback

+

+>>> callback = PushToHubCallback(

+... output_dir="my_awesome_eli5_clm-model",

+... tokenizer=tokenizer,

+... )

+```

+

+ついに、モデルのトレーニングを開始する準備が整いました。トレーニングおよび検証データセット、エポック数、コールバックを指定して [`fit`](https://keras.io/api/models/model_training_apis/#fit-method) を呼び出し、モデルを微調整します。

+

+

+

+```py

+>>> model.fit(x=tf_train_set, validation_data=tf_test_set, epochs=3, callbacks=[callback])

+```

+

+トレーニングが完了すると、モデルは自動的にハブにアップロードされ、誰でも使用できるようになります。

+

+

+

+

+

+

+因果言語モデリング用にモデルを微調整する方法のより詳細な例については、対応するドキュメントを参照してください。

+[PyTorch ノートブック](https://colab.research.google.com/github/huggingface/notebooks/blob/main/examples/language_modeling.ipynb)

+または [TensorFlow ノートブック](https://colab.research.google.com/github/huggingface/notebooks/blob/main/examples/language_modeling-tf.ipynb)。

+

+

+

+## Inference

+

+モデルを微調整したので、それを推論に使用できるようになりました。

+

+テキストを生成するプロンプトを考え出します。

+

+```py

+>>> prompt = "Somatic hypermutation allows the immune system to"

+```

+

+推論用に微調整されたモデルを試す最も簡単な方法は、それを [`pipeline`] で使用することです。モデルを使用してテキスト生成用の`pipeline`をインスタンス化し、それにテキストを渡します。

+

+

+```py

+>>> from transformers import pipeline

+

+>>> generator = pipeline("text-generation", model="my_awesome_eli5_clm-model")

+>>> generator(prompt)

+[{'generated_text': "Somatic hypermutation allows the immune system to be able to effectively reverse the damage caused by an infection.\n\n\nThe damage caused by an infection is caused by the immune system's ability to perform its own self-correcting tasks."}]

+```

+

+

+

+

+

+テキストをトークン化し、「input_ids」を PyTorch テンソルとして返します。

+

+```py

+>>> from transformers import AutoTokenizer

+

+>>> tokenizer = AutoTokenizer.from_pretrained("my_awesome_eli5_clm-model")

+>>> inputs = tokenizer(prompt, return_tensors="pt").input_ids

+```

+

+[`~generation.GenerationMixin.generate`] メソッドを使用してテキストを生成します。

+さまざまなテキスト生成戦略と生成を制御するためのパラメーターの詳細については、[テキスト生成戦略](../generation_strategies) ページを参照してください。

+

+```py

+>>> from transformers import AutoModelForCausalLM

+

+>>> model = AutoModelForCausalLM.from_pretrained("my_awesome_eli5_clm-model")

+>>> outputs = model.generate(inputs, max_new_tokens=100, do_sample=True, top_k=50, top_p=0.95)

+```

+

+生成されたトークン ID をデコードしてテキストに戻します。

+

+```py

+>>> tokenizer.batch_decode(outputs, skip_special_tokens=True)

+["Somatic hypermutation allows the immune system to react to drugs with the ability to adapt to a different environmental situation. In other words, a system of 'hypermutation' can help the immune system to adapt to a different environmental situation or in some cases even a single life. In contrast, researchers at the University of Massachusetts-Boston have found that 'hypermutation' is much stronger in mice than in humans but can be found in humans, and that it's not completely unknown to the immune system. A study on how the immune system"]

+```

+

+

+

+

+テキストをトークン化し、`input_ids`を TensorFlow テンソルとして返します。

+

+```py

+>>> from transformers import AutoTokenizer

+

+>>> tokenizer = AutoTokenizer.from_pretrained("my_awesome_eli5_clm-model")

+>>> inputs = tokenizer(prompt, return_tensors="tf").input_ids

+```

+

+[`~transformers.generation_tf_utils.TFGenerationMixin.generate`] メソッドを使用して要約を作成します。さまざまなテキスト生成戦略と生成を制御するためのパラメーターの詳細については、[テキスト生成戦略](../generation_strategies) ページを参照してください。

+

+```py

+>>> from transformers import TFAutoModelForCausalLM

+

+>>> model = TFAutoModelForCausalLM.from_pretrained("my_awesome_eli5_clm-model")

+>>> outputs = model.generate(input_ids=inputs, max_new_tokens=100, do_sample=True, top_k=50, top_p=0.95)

+```

+

+生成されたトークン ID をデコードしてテキストに戻します。

+

+```py

+>>> tokenizer.batch_decode(outputs, skip_special_tokens=True)

+['Somatic hypermutation allows the immune system to detect the presence of other viruses as they become more prevalent. Therefore, researchers have identified a high proportion of human viruses. The proportion of virus-associated viruses in our study increases with age. Therefore, we propose a simple algorithm to detect the presence of these new viruses in our samples as a sign of improved immunity. A first study based on this algorithm, which will be published in Science on Friday, aims to show that this finding could translate into the development of a better vaccine that is more effective for']

+```

+

+

+

diff --git a/docs/transformers/docs/source/ja/tasks/masked_language_modeling.md b/docs/transformers/docs/source/ja/tasks/masked_language_modeling.md

new file mode 100644

index 0000000000000000000000000000000000000000..29d7b73ae5d026f210de5c9d82401224a4a94bda

--- /dev/null

+++ b/docs/transformers/docs/source/ja/tasks/masked_language_modeling.md

@@ -0,0 +1,449 @@

+

+

+# Masked language modeling

+

+[[open-in-colab]]

+

+

+

+マスクされた言語モデリングはシーケンス内のマスクされたトークンを予測し、モデルはトークンを双方向に処理できます。これ

+これは、モデルが左右のトークンに完全にアクセスできることを意味します。マスクされた言語モデリングは、次のようなタスクに最適です。

+シーケンス全体の文脈をよく理解する必要があります。 BERT はマスクされた言語モデルの一例です。

+

+このガイドでは、次の方法を説明します。

+

+1. [ELI5](https://huggingface.co/distilbert/distilroberta-base) の [r/askscience](https://www.reddit.com/r/askscience/) サブセットで [DistilRoBERTa](https://huggingface.co/distilbert/distilroberta-base) を微調整します。 ://huggingface.co/datasets/eli5) データセット。

+2. 微調整したモデルを推論に使用します。

+

+

+

+このタスクと互換性のあるすべてのアーキテクチャとチェックポイントを確認するには、[タスクページ](https://huggingface.co/tasks/fill-mask) を確認することをお勧めします。

+

+

+

+始める前に、必要なライブラリがすべてインストールされていることを確認してください。

+

+```bash

+pip install transformers datasets evaluate

+```

+

+モデルをアップロードしてコミュニティと共有できるように、Hugging Face アカウントにログインすることをお勧めします。プロンプトが表示されたら、トークンを入力してログインします。

+

+```py

+>>> from huggingface_hub import notebook_login

+

+>>> notebook_login()

+```

+

+## Load ELI5 dataset

+

+まず、ELI5 データセットの r/askscience サブセットの小さいサブセットを 🤗 データセット ライブラリからロードします。これで

+データセット全体のトレーニングにさらに時間を費やす前に、実験してすべてが機能することを確認する機会が与えられます。

+

+```py

+>>> from datasets import load_dataset

+

+>>> eli5 = load_dataset("eli5", split="train_asks[:5000]")

+```

+

+[`~datasets.Dataset.train_test_split`] メソッドを使用して、データセットの `train_asks` をトレイン セットとテスト セットに分割します。

+

+```py

+>>> eli5 = eli5.train_test_split(test_size=0.2)

+```

+

+次に、例を見てみましょう。

+

+```py

+>>> eli5["train"][0]

+{'answers': {'a_id': ['c3d1aib', 'c3d4lya'],

+ 'score': [6, 3],

+ 'text': ["The velocity needed to remain in orbit is equal to the square root of Newton's constant times the mass of earth divided by the distance from the center of the earth. I don't know the altitude of that specific mission, but they're usually around 300 km. That means he's going 7-8 km/s.\n\nIn space there are no other forces acting on either the shuttle or the guy, so they stay in the same position relative to each other. If he were to become unable to return to the ship, he would presumably run out of oxygen, or slowly fall into the atmosphere and burn up.",

+ "Hope you don't mind me asking another question, but why aren't there any stars visible in this photo?"]},

+ 'answers_urls': {'url': []},

+ 'document': '',

+ 'q_id': 'nyxfp',

+ 'selftext': '_URL_0_\n\nThis was on the front page earlier and I have a few questions about it. Is it possible to calculate how fast the astronaut would be orbiting the earth? Also how does he stay close to the shuttle so that he can return safely, i.e is he orbiting at the same speed and can therefore stay next to it? And finally if his propulsion system failed, would he eventually re-enter the atmosphere and presumably die?',

+ 'selftext_urls': {'url': ['http://apod.nasa.gov/apod/image/1201/freeflyer_nasa_3000.jpg']},

+ 'subreddit': 'askscience',

+ 'title': 'Few questions about this space walk photograph.',

+ 'title_urls': {'url': []}}

+```

+

+これは多くのことのように見えるかもしれませんが、実際に関心があるのは`text`フィールドだけです。言語モデリング タスクの優れた点は、次の単語がラベル * であるため、ラベル (教師なしタスクとも呼ばれます) が必要ないことです。

+

+## Preprocess

+

+

+

+マスクされた言語モデリングの場合、次のステップは、`text`サブフィールドを処理するために DistilRoBERTa トークナイザーをロードすることです。

+

+```py

+>>> from transformers import AutoTokenizer

+

+>>> tokenizer = AutoTokenizer.from_pretrained("distilbert/distilroberta-base")

+```

+

+上の例からわかるように、`text`フィールドは実際には`answers`内にネストされています。これは、次のことを行う必要があることを意味します

+[` flatten`](https://huggingface.co/docs/datasets/process.html#flatten) メソッドを使用して、ネストされた構造から `text` サブフィールドを抽出します。

+

+```py

+>>> eli5 = eli5.flatten()

+>>> eli5["train"][0]

+{'answers.a_id': ['c3d1aib', 'c3d4lya'],

+ 'answers.score': [6, 3],

+ 'answers.text': ["The velocity needed to remain in orbit is equal to the square root of Newton's constant times the mass of earth divided by the distance from the center of the earth. I don't know the altitude of that specific mission, but they're usually around 300 km. That means he's going 7-8 km/s.\n\nIn space there are no other forces acting on either the shuttle or the guy, so they stay in the same position relative to each other. If he were to become unable to return to the ship, he would presumably run out of oxygen, or slowly fall into the atmosphere and burn up.",

+ "Hope you don't mind me asking another question, but why aren't there any stars visible in this photo?"],

+ 'answers_urls.url': [],

+ 'document': '',

+ 'q_id': 'nyxfp',

+ 'selftext': '_URL_0_\n\nThis was on the front page earlier and I have a few questions about it. Is it possible to calculate how fast the astronaut would be orbiting the earth? Also how does he stay close to the shuttle so that he can return safely, i.e is he orbiting at the same speed and can therefore stay next to it? And finally if his propulsion system failed, would he eventually re-enter the atmosphere and presumably die?',

+ 'selftext_urls.url': ['http://apod.nasa.gov/apod/image/1201/freeflyer_nasa_3000.jpg'],

+ 'subreddit': 'askscience',

+ 'title': 'Few questions about this space walk photograph.',

+ 'title_urls.url': []}

+```

+

+`answers`接頭辞で示されるように、各サブフィールドは個別の列になり、`text`フィールドはリストになりました。その代わり

+各文を個別にトークン化する場合は、リストを文字列に変換して、それらをまとめてトークン化できるようにします。

+

+以下は、各例の文字列のリストを結合し、結果をトークン化する最初の前処理関数です。

+

+```py

+>>> def preprocess_function(examples):

+... return tokenizer([" ".join(x) for x in examples["answers.text"]])

+```

+

+この前処理関数をデータセット全体に適用するには、🤗 Datasets [`~datasets.Dataset.map`] メソッドを使用します。 `map` 関数を高速化するには、`batched=True` を設定してデータセットの複数の要素を一度に処理し、`num_proc` でプロセスの数を増やします。不要な列を削除します。

+

+```py

+>>> tokenized_eli5 = eli5.map(

+... preprocess_function,

+... batched=True,

+... num_proc=4,

+... remove_columns=eli5["train"].column_names,

+... )

+```

+

+このデータセットにはトークン シーケンスが含まれていますが、その一部はモデルの最大入力長よりも長くなります。

+

+2 番目の前処理関数を使用して、

+- すべてのシーケンスを連結します

+- 連結されたシーケンスを`block_size`で定義された短いチャンクに分割します。これは、最大入力長より短く、GPU RAM に十分な長さである必要があります。

+

+```py

+>>> block_size = 128

+

+

+>>> def group_texts(examples):

+... # Concatenate all texts.

+... concatenated_examples = {k: sum(examples[k], []) for k in examples.keys()}

+... total_length = len(concatenated_examples[list(examples.keys())[0]])

+... # We drop the small remainder, we could add padding if the model supported it instead of this drop, you can

+... # customize this part to your needs.

+... if total_length >= block_size:

+... total_length = (total_length // block_size) * block_size

+... # Split by chunks of block_size.

+... result = {

+... k: [t[i : i + block_size] for i in range(0, total_length, block_size)]

+... for k, t in concatenated_examples.items()

+... }

+... return result

+```

+

+データセット全体に`group_texts`関数を適用します。

+

+```py

+>>> lm_dataset = tokenized_eli5.map(group_texts, batched=True, num_proc=4)

+```

+

+次に、[`DataCollatorForLanguageModeling`] を使用してサンプルのバッチを作成します。データセット全体を最大長までパディングするのではなく、照合中にバッチ内の最長の長さまで文を *動的にパディング* する方が効率的です。

+

+

+

+

+シーケンス終了トークンをパディング トークンとして使用し、データを反復するたびにランダムにトークンをマスクするために `mlm_probability` を指定します。

+

+```py

+>>> from transformers import DataCollatorForLanguageModeling

+

+>>> tokenizer.pad_token = tokenizer.eos_token

+>>> data_collator = DataCollatorForLanguageModeling(tokenizer=tokenizer, mlm_probability=0.15)

+```

+

+

+

+シーケンス終了トークンをパディング トークンとして使用し、データを反復するたびにランダムにトークンをマスクするために `mlm_probability` を指定します。

+

+

+```py

+>>> from transformers import DataCollatorForLanguageModeling

+

+>>> data_collator = DataCollatorForLanguageModeling(tokenizer=tokenizer, mlm_probability=0.15, return_tensors="tf")

+```

+

+

+

+## Train

+

+

+

+

+

+[`Trainer`] を使用したモデルの微調整に慣れていない場合は、[ここ](../training#train-with-pytorch-trainer) の基本的なチュートリアルをご覧ください。

+

+

+

+これでモデルのトレーニングを開始する準備が整いました。 [`AutoModelForMaskedLM`] を使用して DistilRoBERTa をロードします。

+

+```py

+>>> from transformers import AutoModelForMaskedLM

+

+>>> model = AutoModelForMaskedLM.from_pretrained("distilbert/distilroberta-base")

+```

+

+この時点で残っている手順は次の 3 つだけです。

+

+1. [`TrainingArguments`] でトレーニング ハイパーパラメータを定義します。唯一の必須パラメータは、モデルの保存場所を指定する `output_dir` です。 `push_to_hub=True`を設定して、このモデルをハブにプッシュします (モデルをアップロードするには、Hugging Face にサインインする必要があります)。

+2. トレーニング引数をモデル、データセット、データ照合器とともに [`Trainer`] に渡します。

+3. [`~Trainer.train`] を呼び出してモデルを微調整します。

+

+```py

+>>> training_args = TrainingArguments(

+... output_dir="my_awesome_eli5_mlm_model",

+... eval_strategy="epoch",

+... learning_rate=2e-5,

+... num_train_epochs=3,

+... weight_decay=0.01,

+... push_to_hub=True,

+... )

+

+>>> trainer = Trainer(

+... model=model,

+... args=training_args,

+... train_dataset=lm_dataset["train"],

+... eval_dataset=lm_dataset["test"],

+... data_collator=data_collator,

+... )

+

+>>> trainer.train()

+```

+

+トレーニングが完了したら、 [`~transformers.Trainer.evaluate`] メソッドを使用してモデルを評価し、その複雑さを取得します。

+

+

+```py

+>>> import math

+

+>>> eval_results = trainer.evaluate()

+>>> print(f"Perplexity: {math.exp(eval_results['eval_loss']):.2f}")

+Perplexity: 8.76

+```

+

+次に、 [`~transformers.Trainer.push_to_hub`] メソッドを使用してモデルをハブに共有し、誰もがモデルを使用できるようにします。

+

+```py

+>>> trainer.push_to_hub()

+```

+

+

+

+

+

+Keras を使用したモデルの微調整に慣れていない場合は、[こちら](../training#train-a-tensorflow-model-with-keras) の基本的なチュートリアルをご覧ください。

+

+

+

+TensorFlow でモデルを微調整するには、オプティマイザー関数、学習率スケジュール、およびいくつかのトレーニング ハイパーパラメーターをセットアップすることから始めます。

+

+```py

+>>> from transformers import create_optimizer, AdamWeightDecay

+

+>>> optimizer = AdamWeightDecay(learning_rate=2e-5, weight_decay_rate=0.01)

+```

+

+次に、[`TFAutoModelForMaskedLM`] を使用して DistilRoBERTa をロードできます。

+

+```py

+>>> from transformers import TFAutoModelForMaskedLM

+

+>>> model = TFAutoModelForMaskedLM.from_pretrained("distilbert/distilroberta-base")

+```

+

+[`~transformers.TFPreTrainedModel.prepare_tf_dataset`] を使用して、データセットを `tf.data.Dataset` 形式に変換します。

+

+```py

+>>> tf_train_set = model.prepare_tf_dataset(

+... lm_dataset["train"],

+... shuffle=True,

+... batch_size=16,

+... collate_fn=data_collator,

+... )

+

+>>> tf_test_set = model.prepare_tf_dataset(

+... lm_dataset["test"],

+... shuffle=False,

+... batch_size=16,

+... collate_fn=data_collator,

+... )

+```

+

+[`compile`](https://keras.io/api/models/model_training_apis/#compile-method) を使用してトレーニング用のモデルを設定します。 Transformers モデルにはすべてデフォルトのタスク関連の損失関数があるため、次の場合を除き、損失関数を指定する必要はないことに注意してください。

+

+

+```py

+>>> import tensorflow as tf

+

+>>> model.compile(optimizer=optimizer) # No loss argument!

+```

+

+This can be done by specifying where to push your model and tokenizer in the [`~transformers.PushToHubCallback`]:

+

+```py

+>>> from transformers.keras_callbacks import PushToHubCallback

+

+>>> callback = PushToHubCallback(

+... output_dir="my_awesome_eli5_mlm_model",

+... tokenizer=tokenizer,

+... )

+```

+

+ついに、モデルのトレーニングを開始する準備が整いました。トレーニングおよび検証データセット、エポック数、コールバックを指定して [`fit`](https://keras.io/api/models/model_training_apis/#fit-method) を呼び出し、モデルを微調整します。

+

+

+

+```py

+>>> model.fit(x=tf_train_set, validation_data=tf_test_set, epochs=3, callbacks=[callback])

+```

+

+トレーニングが完了すると、モデルは自動的にハブにアップロードされ、誰でも使用できるようになります。

+

+

+

+

+

+

+マスクされた言語モデリング用にモデルを微調整する方法のより詳細な例については、対応するドキュメントを参照してください。

+[PyTorch ノートブック](https://colab.research.google.com/github/huggingface/notebooks/blob/main/examples/language_modeling.ipynb)

+または [TensorFlow ノートブック](https://colab.research.google.com/github/huggingface/notebooks/blob/main/examples/language_modeling-tf.ipynb)。

+

+

+

+## Inference

+

+モデルを微調整したので、それを推論に使用できるようになりました。

+

+モデルに空白を埋めるテキストを考え出し、特別な `` トークンを使用して空白を示します。

+

+```py

+>>> text = "The Milky Way is a galaxy."

+```

+

+推論用に微調整されたモデルを試す最も簡単な方法は、それを [`pipeline`] で使用することです。モデルを使用してフィルマスクの`pipeline`をインスタンス化し、テキストをそれに渡します。必要に応じて、`top_k`パラメータを使用して、返す予測の数を指定できます。

+

+```py

+>>> from transformers import pipeline

+

+>>> mask_filler = pipeline("fill-mask", "stevhliu/my_awesome_eli5_mlm_model")

+>>> mask_filler(text, top_k=3)

+[{'score': 0.5150994658470154,

+ 'token': 21300,

+ 'token_str': ' spiral',

+ 'sequence': 'The Milky Way is a spiral galaxy.'},

+ {'score': 0.07087188959121704,

+ 'token': 2232,

+ 'token_str': ' massive',

+ 'sequence': 'The Milky Way is a massive galaxy.'},

+ {'score': 0.06434620916843414,

+ 'token': 650,

+ 'token_str': ' small',

+ 'sequence': 'The Milky Way is a small galaxy.'}]

+```

+

+

+

+

+テキストをトークン化し、`input_ids`を PyTorch テンソルとして返します。 `` トークンの位置も指定する必要があります。

+

+```py

+>>> from transformers import AutoTokenizer

+

+>>> tokenizer = AutoTokenizer.from_pretrained("stevhliu/my_awesome_eli5_mlm_model")

+>>> inputs = tokenizer(text, return_tensors="pt")

+>>> mask_token_index = torch.where(inputs["input_ids"] == tokenizer.mask_token_id)[1]

+```

+

+入力をモデルに渡し、マスクされたトークンの`logits`を返します。

+

+```py

+>>> from transformers import AutoModelForMaskedLM

+

+>>> model = AutoModelForMaskedLM.from_pretrained("stevhliu/my_awesome_eli5_mlm_model")

+>>> logits = model(**inputs).logits

+>>> mask_token_logits = logits[0, mask_token_index, :]

+```

+

+次に、マスクされた 3 つのトークンを最も高い確率で返し、出力します。

+

+```py

+>>> top_3_tokens = torch.topk(mask_token_logits, 3, dim=1).indices[0].tolist()

+

+>>> for token in top_3_tokens:

+... print(text.replace(tokenizer.mask_token, tokenizer.decode([token])))

+The Milky Way is a spiral galaxy.

+The Milky Way is a massive galaxy.

+The Milky Way is a small galaxy.

+```

+

+

+

+

+テキストをトークン化し、`input_ids`を TensorFlow テンソルとして返します。 `` トークンの位置も指定する必要があります。

+

+```py

+>>> from transformers import AutoTokenizer

+

+>>> tokenizer = AutoTokenizer.from_pretrained("stevhliu/my_awesome_eli5_mlm_model")

+>>> inputs = tokenizer(text, return_tensors="tf")

+>>> mask_token_index = tf.where(inputs["input_ids"] == tokenizer.mask_token_id)[0, 1]

+```

+

+入力をモデルに渡し、マスクされたトークンの`logits`を返します。

+

+

+```py

+>>> from transformers import TFAutoModelForMaskedLM

+

+>>> model = TFAutoModelForMaskedLM.from_pretrained("stevhliu/my_awesome_eli5_mlm_model")

+>>> logits = model(**inputs).logits

+>>> mask_token_logits = logits[0, mask_token_index, :]

+```

+

+次に、マスクされた 3 つのトークンを最も高い確率で返し、出力します。

+

+

+```py

+>>> top_3_tokens = tf.math.top_k(mask_token_logits, 3).indices.numpy()

+

+>>> for token in top_3_tokens:

+... print(text.replace(tokenizer.mask_token, tokenizer.decode([token])))

+The Milky Way is a spiral galaxy.

+The Milky Way is a massive galaxy.

+The Milky Way is a small galaxy.

+```

+

+

diff --git a/docs/transformers/docs/source/ja/tasks/monocular_depth_estimation.md b/docs/transformers/docs/source/ja/tasks/monocular_depth_estimation.md

new file mode 100644

index 0000000000000000000000000000000000000000..e7a3a994a60ebc3ee752cfd0461bb7436c7b8406

--- /dev/null

+++ b/docs/transformers/docs/source/ja/tasks/monocular_depth_estimation.md

@@ -0,0 +1,149 @@

+

+

+# Monocular depth estimation

+

+単眼奥行き推定は、シーンの奥行き情報を画像から予測することを含むコンピューター ビジョン タスクです。

+単一の画像。言い換えれば、シーン内のオブジェクトの距離を距離から推定するプロセスです。

+単一カメラの視点。

+

+単眼奥行き推定には、3D 再構築、拡張現実、自動運転、

+そしてロボット工学。モデルがオブジェクト間の複雑な関係を理解する必要があるため、これは困難な作業です。

+シーンとそれに対応する深度情報(照明条件などの要因の影響を受ける可能性があります)

+オクルージョンとテクスチャ。

+

+

+

+このタスクと互換性のあるすべてのアーキテクチャとチェックポイントを確認するには、[タスクページ](https://huggingface.co/tasks/depth-estimation) を確認することをお勧めします。

+

+

+

+このガイドでは、次の方法を学びます。

+

+* 深度推定パイプラインを作成する

+* 手動で深度推定推論を実行します

+

+始める前に、必要なライブラリがすべてインストールされていることを確認してください。

+

+```bash

+pip install -q transformers

+```

+

+## Depth estimation pipeline

+

+深度推定をサポートするモデルで推論を試す最も簡単な方法は、対応する [`pipeline`] を使用することです。

+[Hugging Face Hub のチェックポイント](https://huggingface.co/models?pipeline_tag=Depth-estimation&sort=downloads) からパイプラインをインスタンス化します。

+

+

+```py

+>>> from transformers import pipeline

+

+>>> checkpoint = "vinvino02/glpn-nyu"

+>>> depth_estimator = pipeline("depth-estimation", model=checkpoint)

+```

+

+次に、分析する画像を選択します。

+

+```py

+>>> from PIL import Image

+>>> import requests

+

+>>> url = "https://unsplash.com/photos/HwBAsSbPBDU/download?ixid=MnwxMjA3fDB8MXxzZWFyY2h8MzR8fGNhciUyMGluJTIwdGhlJTIwc3RyZWV0fGVufDB8MHx8fDE2Nzg5MDEwODg&force=true&w=640"

+>>> image = Image.open(requests.get(url, stream=True).raw)

+>>> image

+```

+

+

diff --git a/docs/transformers/docs/source/ja/tasks/summarization.md b/docs/transformers/docs/source/ja/tasks/summarization.md

new file mode 100644

index 0000000000000000000000000000000000000000..6784696e6c95a3bdc3abe661236ad540b3304bfc

--- /dev/null

+++ b/docs/transformers/docs/source/ja/tasks/summarization.md

@@ -0,0 +1,404 @@

+

+

+# Summarization

+

+[[open-in-colab]]

+

+

+

+要約により、すべての重要な情報をまとめた短いバージョンの文書または記事が作成されます。これは、翻訳と並んで、シーケンス間のタスクとして定式化できるタスクのもう 1 つの例です。要約は次のようになります。

+

+- 抽出: 文書から最も関連性の高い情報を抽出します。

+- 抽象的: 最も関連性の高い情報を捉えた新しいテキストを生成します。

+

+このガイドでは、次の方法を説明します。

+

+1. 抽象的な要約のために、[BillSum](https://huggingface.co/datasets/billsum) データセットのカリフォルニア州請求書サブセットで [T5](https://huggingface.co/google-t5/t5-small) を微調整します。

+2. 微調整したモデルを推論に使用します。

+

+

+

+このタスクと互換性のあるすべてのアーキテクチャとチェックポイントを確認するには、[タスクページ](https://huggingface.co/tasks/summarization) を確認することをお勧めします。

+

+

+

+始める前に、必要なライブラリがすべてインストールされていることを確認してください。

+

+```bash

+pip install transformers datasets evaluate rouge_score

+```

+

+モデルをアップロードしてコミュニティと共有できるように、Hugging Face アカウントにログインすることをお勧めします。プロンプトが表示されたら、トークンを入力してログインします。

+

+```py

+>>> from huggingface_hub import notebook_login

+

+>>> notebook_login()

+```

+

+## Load BillSum dataset

+

+まず、🤗 データセット ライブラリから BillSum データセットの小さいカリフォルニア州請求書サブセットを読み込みます。

+

+```py

+>>> from datasets import load_dataset

+

+>>> billsum = load_dataset("billsum", split="ca_test")

+```

+

+[`~datasets.Dataset.train_test_split`] メソッドを使用して、データセットをトレイン セットとテスト セットに分割します。

+

+```py

+>>> billsum = billsum.train_test_split(test_size=0.2)

+```

+

+次に、例を見てみましょう。

+

+```py

+>>> billsum["train"][0]

+{'summary': 'Existing law authorizes state agencies to enter into contracts for the acquisition of goods or services upon approval by the Department of General Services. Existing law sets forth various requirements and prohibitions for those contracts, including, but not limited to, a prohibition on entering into contracts for the acquisition of goods or services of $100,000 or more with a contractor that discriminates between spouses and domestic partners or same-sex and different-sex couples in the provision of benefits. Existing law provides that a contract entered into in violation of those requirements and prohibitions is void and authorizes the state or any person acting on behalf of the state to bring a civil action seeking a determination that a contract is in violation and therefore void. Under existing law, a willful violation of those requirements and prohibitions is a misdemeanor.\nThis bill would also prohibit a state agency from entering into contracts for the acquisition of goods or services of $100,000 or more with a contractor that discriminates between employees on the basis of gender identity in the provision of benefits, as specified. By expanding the scope of a crime, this bill would impose a state-mandated local program.\nThe California Constitution requires the state to reimburse local agencies and school districts for certain costs mandated by the state. Statutory provisions establish procedures for making that reimbursement.\nThis bill would provide that no reimbursement is required by this act for a specified reason.',

+ 'text': 'The people of the State of California do enact as follows:\n\n\nSECTION 1.\nSection 10295.35 is added to the Public Contract Code, to read:\n10295.35.\n(a) (1) Notwithstanding any other law, a state agency shall not enter into any contract for the acquisition of goods or services in the amount of one hundred thousand dollars ($100,000) or more with a contractor that, in the provision of benefits, discriminates between employees on the basis of an employee’s or dependent’s actual or perceived gender identity, including, but not limited to, the employee’s or dependent’s identification as transgender.\n(2) For purposes of this section, “contract” includes contracts with a cumulative amount of one hundred thousand dollars ($100,000) or more per contractor in each fiscal year.\n(3) For purposes of this section, an employee health plan is discriminatory if the plan is not consistent with Section 1365.5 of the Health and Safety Code and Section 10140 of the Insurance Code.\n(4) The requirements of this section shall apply only to those portions of a contractor’s operations that occur under any of the following conditions:\n(A) Within the state.\n(B) On real property outside the state if the property is owned by the state or if the state has a right to occupy the property, and if the contractor’s presence at that location is connected to a contract with the state.\n(C) Elsewhere in the United States where work related to a state contract is being performed.\n(b) Contractors shall treat as confidential, to the maximum extent allowed by law or by the requirement of the contractor’s insurance provider, any request by an employee or applicant for employment benefits or any documentation of eligibility for benefits submitted by an employee or applicant for employment.\n(c) After taking all reasonable measures to find a contractor that complies with this section, as determined by the state agency, the requirements of this section may be waived under any of the following circumstances:\n(1) There is only one prospective contractor willing to enter into a specific contract with the state agency.\n(2) The contract is necessary to respond to an emergency, as determined by the state agency, that endangers the public health, welfare, or safety, or the contract is necessary for the provision of essential services, and no entity that complies with the requirements of this section capable of responding to the emergency is immediately available.\n(3) The requirements of this section violate, or are inconsistent with, the terms or conditions of a grant, subvention, or agreement, if the agency has made a good faith attempt to change the terms or conditions of any grant, subvention, or agreement to authorize application of this section.\n(4) The contractor is providing wholesale or bulk water, power, or natural gas, the conveyance or transmission of the same, or ancillary services, as required for ensuring reliable services in accordance with good utility practice, if the purchase of the same cannot practically be accomplished through the standard competitive bidding procedures and the contractor is not providing direct retail services to end users.\n(d) (1) A contractor shall not be deemed to discriminate in the provision of benefits if the contractor, in providing the benefits, pays the actual costs incurred in obtaining the benefit.\n(2) If a contractor is unable to provide a certain benefit, despite taking reasonable measures to do so, the contractor shall not be deemed to discriminate in the provision of benefits.\n(e) (1) Every contract subject to this chapter shall contain a statement by which the contractor certifies that the contractor is in compliance with this section.\n(2) The department or other contracting agency shall enforce this section pursuant to its existing enforcement powers.\n(3) (A) If a contractor falsely certifies that it is in compliance with this section, the contract with that contractor shall be subject to Article 9 (commencing with Section 10420), unless, within a time period specified by the department or other contracting agency, the contractor provides to the department or agency proof that it has complied, or is in the process of complying, with this section.\n(B) The application of the remedies or penalties contained in Article 9 (commencing with Section 10420) to a contract subject to this chapter shall not preclude the application of any existing remedies otherwise available to the department or other contracting agency under its existing enforcement powers.\n(f) Nothing in this section is intended to regulate the contracting practices of any local jurisdiction.\n(g) This section shall be construed so as not to conflict with applicable federal laws, rules, or regulations. In the event that a court or agency of competent jurisdiction holds that federal law, rule, or regulation invalidates any clause, sentence, paragraph, or section of this code or the application thereof to any person or circumstances, it is the intent of the state that the court or agency sever that clause, sentence, paragraph, or section so that the remainder of this section shall remain in effect.\nSEC. 2.\nSection 10295.35 of the Public Contract Code shall not be construed to create any new enforcement authority or responsibility in the Department of General Services or any other contracting agency.\nSEC. 3.\nNo reimbursement is required by this act pursuant to Section 6 of Article XIII\u2009B of the California Constitution because the only costs that may be incurred by a local agency or school district will be incurred because this act creates a new crime or infraction, eliminates a crime or infraction, or changes the penalty for a crime or infraction, within the meaning of Section 17556 of the Government Code, or changes the definition of a crime within the meaning of Section 6 of Article XIII\u2009B of the California Constitution.',

+ 'title': 'An act to add Section 10295.35 to the Public Contract Code, relating to public contracts.'}

+```

+

+使用するフィールドが 2 つあります。

+

+- `text`: モデルへの入力となる請求書のテキスト。

+- `summary`: モデルのターゲットとなる `text` の要約版。

+

+## Preprocess

+

+次のステップでは、T5 トークナイザーをロードして「text」と`summary`を処理します。

+

+```py

+>>> from transformers import AutoTokenizer

+

+>>> checkpoint = "google-t5/t5-small"

+>>> tokenizer = AutoTokenizer.from_pretrained(checkpoint)

+```

+

+作成する前処理関数は次のことを行う必要があります。

+

+1. T5 がこれが要約タスクであることを認識できるように、入力の前にプロンプトを付けます。複数の NLP タスクが可能な一部のモデルでは、特定のタスクのプロンプトが必要です。

+2. ラベルをトークン化するときにキーワード `text_target` 引数を使用します。

+3. `max_length`パラメータで設定された最大長を超えないようにシーケンスを切り詰めます。

+

+```py

+>>> prefix = "summarize: "

+

+

+>>> def preprocess_function(examples):

+... inputs = [prefix + doc for doc in examples["text"]]

+... model_inputs = tokenizer(inputs, max_length=1024, truncation=True)

+

+... labels = tokenizer(text_target=examples["summary"], max_length=128, truncation=True)

+

+... model_inputs["labels"] = labels["input_ids"]

+... return model_inputs

+```

+

+データセット全体に前処理関数を適用するには、🤗 Datasets [`~datasets.Dataset.map`] メソッドを使用します。 `batched=True` を設定してデータセットの複数の要素を一度に処理することで、`map` 関数を高速化できます。

+

+```py

+>>> tokenized_billsum = billsum.map(preprocess_function, batched=True)

+```

+

+次に、[`DataCollatorForSeq2Seq`] を使用してサンプルのバッチを作成します。データセット全体を最大長までパディングするのではなく、照合中にバッチ内の最長の長さまで文を *動的にパディング* する方が効率的です。

+

+

+

+

+```py

+>>> from transformers import DataCollatorForSeq2Seq

+

+>>> data_collator = DataCollatorForSeq2Seq(tokenizer=tokenizer, model=checkpoint)

+```

+

+

+

+```py

+>>> from transformers import DataCollatorForSeq2Seq

+

+>>> data_collator = DataCollatorForSeq2Seq(tokenizer=tokenizer, model=checkpoint, return_tensors="tf")

+```

+

+

+

+## Evaluate

+

+トレーニング中にメトリクスを含めると、多くの場合、モデルのパフォーマンスを評価するのに役立ちます。 🤗 [Evaluate](https://huggingface.co/docs/evaluate/index) ライブラリを使用して、評価メソッドをすばやくロードできます。このタスクでは、[ROUGE](https://huggingface.co/spaces/evaluate-metric/rouge) メトリックを読み込みます (🤗 Evaluate [クイック ツアー](https://huggingface.co/docs/evaluate/a_quick_tour) を参照してください) ) メトリクスをロードして計算する方法の詳細については、次を参照してください)。

+

+```py

+>>> import evaluate

+

+>>> rouge = evaluate.load("rouge")

+```

+

+次に、予測とラベルを [`~evaluate.EvaluationModule.compute`] に渡して ROUGE メトリクスを計算する関数を作成します。

+

+```py

+>>> import numpy as np

+

+

+>>> def compute_metrics(eval_pred):

+... predictions, labels = eval_pred

+... decoded_preds = tokenizer.batch_decode(predictions, skip_special_tokens=True)

+... labels = np.where(labels != -100, labels, tokenizer.pad_token_id)

+... decoded_labels = tokenizer.batch_decode(labels, skip_special_tokens=True)

+

+... result = rouge.compute(predictions=decoded_preds, references=decoded_labels, use_stemmer=True)

+

+... prediction_lens = [np.count_nonzero(pred != tokenizer.pad_token_id) for pred in predictions]

+... result["gen_len"] = np.mean(prediction_lens)

+

+... return {k: round(v, 4) for k, v in result.items()}

+```

+

+これで`compute_metrics`関数の準備が整いました。トレーニングをセットアップするときにこの関数に戻ります。

+

+## Train

+

+

+

+

+

+

+[`Trainer`] を使用したモデルの微調整に慣れていない場合は、[こちら](../training#train-with-pytorch-trainer) の基本的なチュートリアルをご覧ください。

+

+

+

+これでモデルのトレーニングを開始する準備が整いました。 [`AutoModelForSeq2SeqLM`] を使用して T5 をロードします。

+

+

+```py

+>>> from transformers import AutoModelForSeq2SeqLM, Seq2SeqTrainingArguments, Seq2SeqTrainer

+

+>>> model = AutoModelForSeq2SeqLM.from_pretrained(checkpoint)

+```

+

+この時点で残っている手順は次の 3 つだけです。

+

+1. [`Seq2SeqTrainingArguments`] でトレーニング ハイパーパラメータを定義します。唯一の必須パラメータは、モデルの保存場所を指定する `output_dir` です。 `push_to_hub=True`を設定して、このモデルをハブにプッシュします (モデルをアップロードするには、Hugging Face にサインインする必要があります)。各エポックの終了時に、[`Trainer`] は ROUGE メトリクスを評価し、トレーニング チェックポイントを保存します。

+2. トレーニング引数をモデル、データセット、トークナイザー、データ照合器、および `compute_metrics` 関数とともに [`Seq2SeqTrainer`] に渡します。

+3. [`~Trainer.train`] を呼び出してモデルを微調整します。

+

+```py

+>>> training_args = Seq2SeqTrainingArguments(

+... output_dir="my_awesome_billsum_model",

+... eval_strategy="epoch",

+... learning_rate=2e-5,

+... per_device_train_batch_size=16,

+... per_device_eval_batch_size=16,

+... weight_decay=0.01,

+... save_total_limit=3,

+... num_train_epochs=4,

+... predict_with_generate=True,

+... fp16=True,

+... push_to_hub=True,

+... )

+

+>>> trainer = Seq2SeqTrainer(

+... model=model,

+... args=training_args,

+... train_dataset=tokenized_billsum["train"],

+... eval_dataset=tokenized_billsum["test"],

+... processing_class=tokenizer,

+... data_collator=data_collator,

+... compute_metrics=compute_metrics,

+... )

+

+>>> trainer.train()

+```

+

+トレーニングが完了したら、 [`~transformers.Trainer.push_to_hub`] メソッドを使用してモデルをハブに共有し、誰もがモデルを使用できるようにします。

+

+```py

+>>> trainer.push_to_hub()

+```

+

+

+

+

+Keras を使用したモデルの微調整に慣れていない場合は、[こちら](../training#train-a-tensorflow-model-with-keras) の基本的なチュートリアルをご覧ください。

+

+

+TensorFlow でモデルを微調整するには、オプティマイザー関数、学習率スケジュール、およびいくつかのトレーニング ハイパーパラメーターをセットアップすることから始めます。

+

+```py

+>>> from transformers import create_optimizer, AdamWeightDecay

+

+>>> optimizer = AdamWeightDecay(learning_rate=2e-5, weight_decay_rate=0.01)

+```

+

+次に、[`TFAutoModelForSeq2SeqLM`] を使用して T5 をロードできます。

+

+

+```py

+>>> from transformers import TFAutoModelForSeq2SeqLM

+

+>>> model = TFAutoModelForSeq2SeqLM.from_pretrained(checkpoint)

+```

+

+[`~transformers.TFPreTrainedModel.prepare_tf_dataset`] を使用して、データセットを `tf.data.Dataset` 形式に変換します。

+

+```py

+>>> tf_train_set = model.prepare_tf_dataset(

+... tokenized_billsum["train"],

+... shuffle=True,

+... batch_size=16,

+... collate_fn=data_collator,

+... )

+

+>>> tf_test_set = model.prepare_tf_dataset(

+... tokenized_billsum["test"],

+... shuffle=False,

+... batch_size=16,

+... collate_fn=data_collator,

+... )

+```

+

+[`compile`](https://keras.io/api/models/model_training_apis/#compile-method) を使用してトレーニング用のモデルを設定します。 Transformers モデルにはすべてデフォルトのタスク関連の損失関数があるため、次の場合を除き、損失関数を指定する必要はないことに注意してください。

+

+```py

+>>> import tensorflow as tf

+

+>>> model.compile(optimizer=optimizer) # No loss argument!

+```

+

+トレーニングを開始する前にセットアップする最後の 2 つのことは、予測から ROUGE スコアを計算し、モデルをハブにプッシュする方法を提供することです。どちらも [Keras コールバック](../main_classes/keras_callbacks) を使用して行われます。

+

+`compute_metrics` 関数を [`~transformers.KerasMetricCallback`] に渡します。

+

+```py

+>>> from transformers.keras_callbacks import KerasMetricCallback

+

+>>> metric_callback = KerasMetricCallback(metric_fn=compute_metrics, eval_dataset=tf_validation_set)

+```

+

+Specify where to push your model and tokenizer in the [`~transformers.PushToHubCallback`]:

+

+```py

+>>> from transformers.keras_callbacks import PushToHubCallback

+

+>>> push_to_hub_callback = PushToHubCallback(

+... output_dir="my_awesome_billsum_model",

+... tokenizer=tokenizer,

+... )

+```

+

+次に、コールバックをまとめてバンドルします。

+

+```py

+>>> callbacks = [metric_callback, push_to_hub_callback]

+```

+

+ついに、モデルのトレーニングを開始する準備が整いました。トレーニングおよび検証データセット、エポック数、コールバックを指定して [`fit`](https://keras.io/api/models/model_training_apis/#fit-method) を呼び出し、モデルを微調整します。

+

+```py

+>>> model.fit(x=tf_train_set, validation_data=tf_test_set, epochs=3, callbacks=callbacks)

+```

+

+トレーニングが完了すると、モデルは自動的にハブにアップロードされ、誰でも使用できるようになります。

+

+

+

+

+

+

+要約用にモデルを微調整する方法のより詳細な例については、対応するセクションを参照してください。

+[PyTorch ノートブック](https://colab.research.google.com/github/huggingface/notebooks/blob/main/examples/summarization.ipynb)

+または [TensorFlow ノートブック](https://colab.research.google.com/github/huggingface/notebooks/blob/main/examples/summarization-tf.ipynb)。

+

+

+

+## Inference

+

+モデルを微調整したので、それを推論に使用できるようになりました。

+

+要約したいテキストを考え出します。 T5 の場合、作業中のタスクに応じて入力に接頭辞を付ける必要があります。要約するには、以下に示すように入力にプレフィックスを付ける必要があります。

+

+```py

+>>> text = "summarize: The Inflation Reduction Act lowers prescription drug costs, health care costs, and energy costs. It's the most aggressive action on tackling the climate crisis in American history, which will lift up American workers and create good-paying, union jobs across the country. It'll lower the deficit and ask the ultra-wealthy and corporations to pay their fair share. And no one making under $400,000 per year will pay a penny more in taxes."

+```

+

+推論用に微調整されたモデルを試す最も簡単な方法は、それを [`pipeline`] で使用することです。モデルを使用して要約用の `pipeline` をインスタンス化し、テキストをそれに渡します。

+

+```py

+>>> from transformers import pipeline

+

+>>> summarizer = pipeline("summarization", model="stevhliu/my_awesome_billsum_model")

+>>> summarizer(text)

+[{"summary_text": "The Inflation Reduction Act lowers prescription drug costs, health care costs, and energy costs. It's the most aggressive action on tackling the climate crisis in American history, which will lift up American workers and create good-paying, union jobs across the country."}]

+```

+

+必要に応じて、`pipeline`」の結果を手動で複製することもできます。

+

+

+

+Tokenize the text and return the `input_ids` as PyTorch tensors:

+

+```py

+>>> from transformers import AutoTokenizer

+

+>>> tokenizer = AutoTokenizer.from_pretrained("stevhliu/my_awesome_billsum_model")

+>>> inputs = tokenizer(text, return_tensors="pt").input_ids

+```

+

+[`~generation.GenerationMixin.generate`] メソッドを使用して要約を作成します。さまざまなテキスト生成戦略と生成を制御するためのパラメーターの詳細については、[Text Generation](../main_classes/text_generation) API を確認してください。

+

+```py

+>>> from transformers import AutoModelForSeq2SeqLM

+

+>>> model = AutoModelForSeq2SeqLM.from_pretrained("stevhliu/my_awesome_billsum_model")