Western Armenian - Wikilangs Models

Comprehensive Research Report & Full Ablation Study

This repository contains NLP models trained and evaluated by Wikilangs, specifically on Western Armenian Wikipedia data. We analyze tokenizers, n-gram models, Markov chains, vocabulary statistics, and word embeddings.

📋 Repository Contents

Models & Assets

- Tokenizers (8k, 16k, 32k, 64k)

- N-gram models (2, 3, 4, 5-gram)

- Markov chains (context of 1, 2, 3, 4 and 5)

- Subword N-gram and Markov chains

- Embeddings in various sizes and dimensions (aligned and unaligned)

- Language Vocabulary

- Language Statistics

Analysis and Evaluation

- 1. Tokenizer Evaluation

- 2. N-gram Model Evaluation

- 3. Markov Chain Evaluation

- 4. Vocabulary Analysis

- 5. Word Embeddings Evaluation

- 6. Morphological Analysis (Experimental)

- 7. Summary & Recommendations

- Metrics Glossary

- Visualizations Index

1. Tokenizer Evaluation

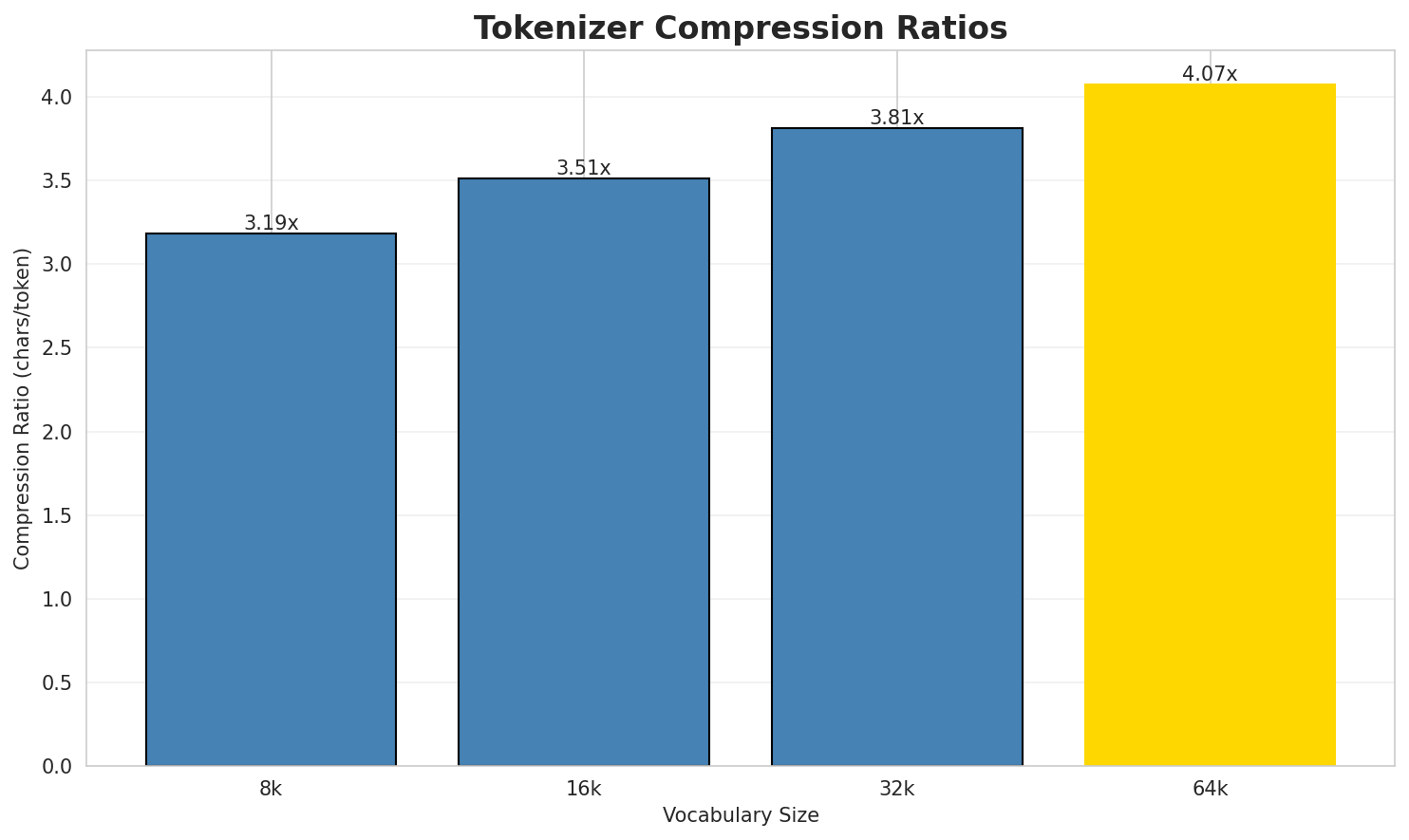

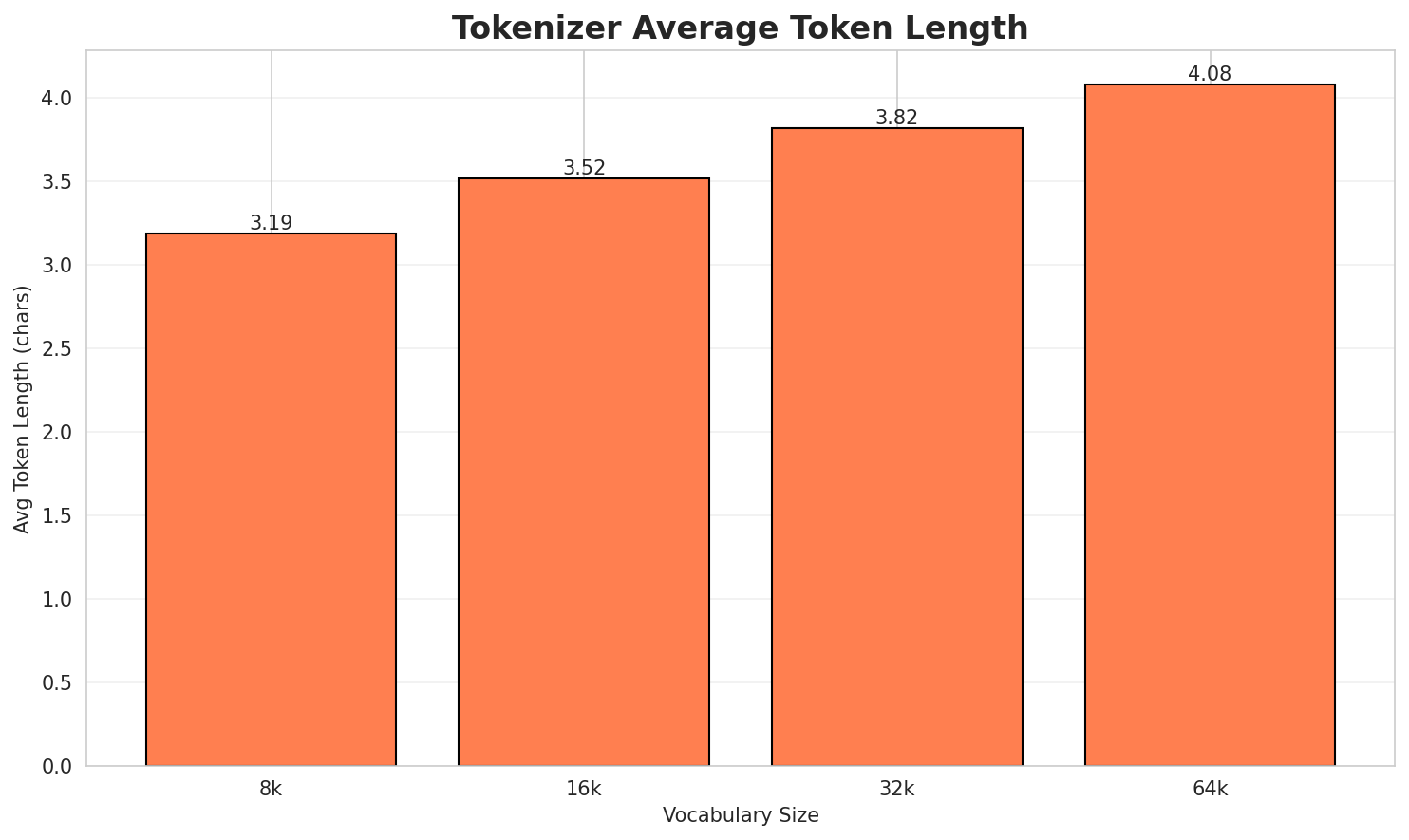

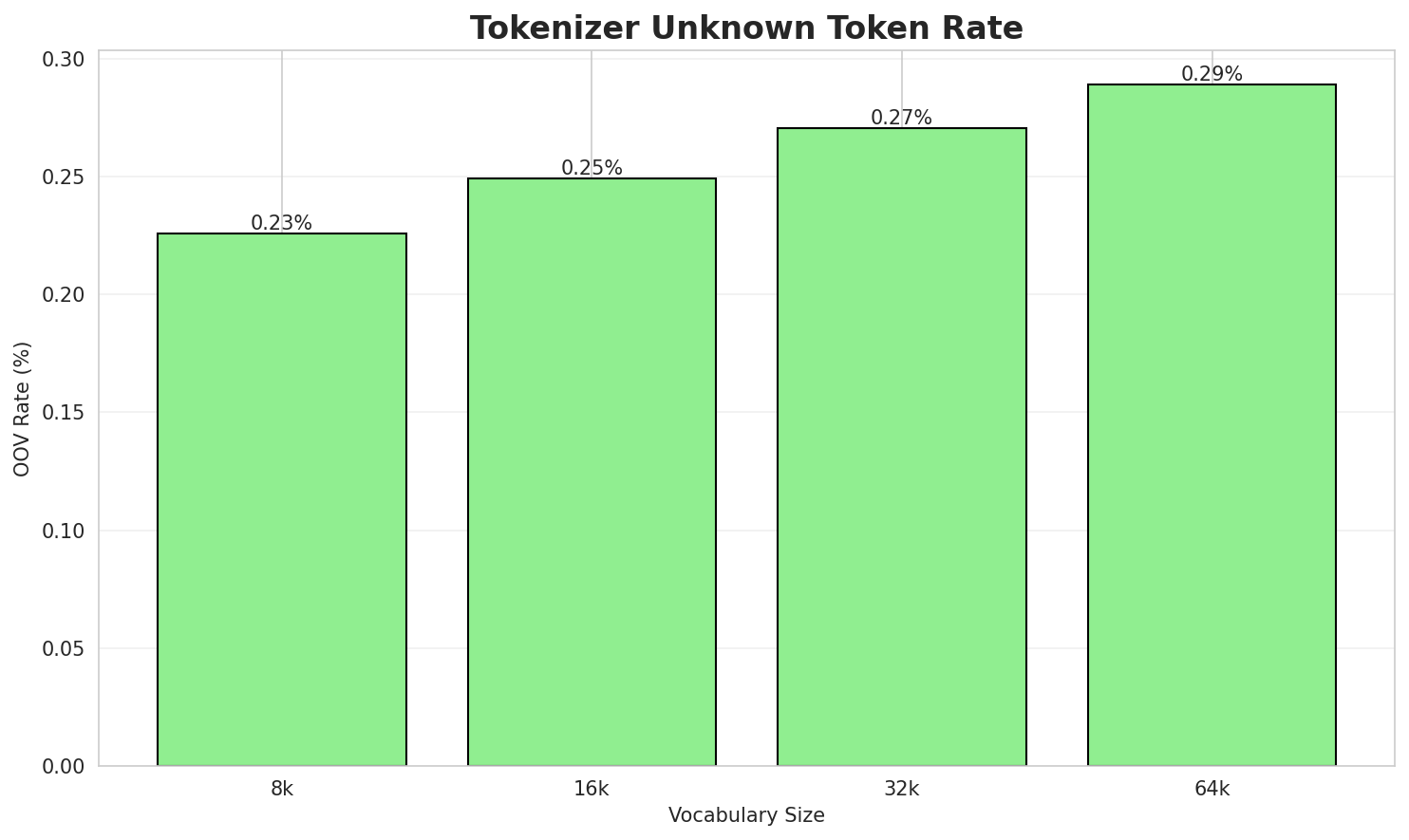

Results

| Vocab Size | Compression | Avg Token Len | UNK Rate | Total Tokens |

|---|---|---|---|---|

| 8k | 3.186x | 3.19 | 0.2260% | 265,032 |

| 16k | 3.511x | 3.52 | 0.2491% | 240,461 |

| 32k | 3.812x | 3.82 | 0.2705% | 221,471 |

| 64k | 4.072x 🏆 | 4.08 | 0.2889% | 207,332 |

Tokenization Examples

Below are sample sentences tokenized with each vocabulary size:

Sample 1: թուական, ոչ նահանջ տարի, 17րդ դարու 89րդ տարին է Դէպքեր Ծնունդներ 16px 120px Մոն...

| Vocab | Tokens | Count |

|---|---|---|

| 8k | ▁թուական , ▁ոչ ▁նահանջ ▁տարի , ▁ 1 7 րդ ... (+28 more) |

38 |

| 16k | ▁թուական , ▁ոչ ▁նահանջ ▁տարի , ▁ 1 7 րդ ... (+27 more) |

37 |

| 32k | ▁թուական , ▁ոչ ▁նահանջ ▁տարի , ▁ 1 7 րդ ... (+26 more) |

36 |

| 64k | ▁թուական , ▁ոչ ▁նահանջ ▁տարի , ▁ 1 7 րդ ... (+26 more) |

36 |

Sample 2: թուական, ոչ նահանջ տարի, 17րդ դարու 69րդ տարին է Դէպքեր Անծանօթ ամսաթիւով՝ Օսման...

| Vocab | Tokens | Count |

|---|---|---|

| 8k | ▁թուական , ▁ոչ ▁նահանջ ▁տարի , ▁ 1 7 րդ ... (+30 more) |

40 |

| 16k | ▁թուական , ▁ոչ ▁նահանջ ▁տարի , ▁ 1 7 րդ ... (+27 more) |

37 |

| 32k | ▁թուական , ▁ոչ ▁նահանջ ▁տարի , ▁ 1 7 րդ ... (+27 more) |

37 |

| 64k | ▁թուական , ▁ոչ ▁նահանջ ▁տարի , ▁ 1 7 րդ ... (+26 more) |

36 |

Sample 3: թուական, ոչ նահանջ տարի, 16րդ դարու 70րդ տարին է Դէպքեր Ծնունդներ 16px 120px Սեպ...

| Vocab | Tokens | Count |

|---|---|---|

| 8k | ▁թուական , ▁ոչ ▁նահանջ ▁տարի , ▁ 1 6 րդ ... (+33 more) |

43 |

| 16k | ▁թուական , ▁ոչ ▁նահանջ ▁տարի , ▁ 1 6 րդ ... (+33 more) |

43 |

| 32k | ▁թուական , ▁ոչ ▁նահանջ ▁տարի , ▁ 1 6 րդ ... (+32 more) |

42 |

| 64k | ▁թուական , ▁ոչ ▁նահանջ ▁տարի , ▁ 1 6 րդ ... (+30 more) |

40 |

Key Findings

- Best Compression: 64k achieves 4.072x compression

- Lowest UNK Rate: 8k with 0.2260% unknown tokens

- Trade-off: Larger vocabularies improve compression but increase model size

- Recommendation: 32k vocabulary provides optimal balance for production use

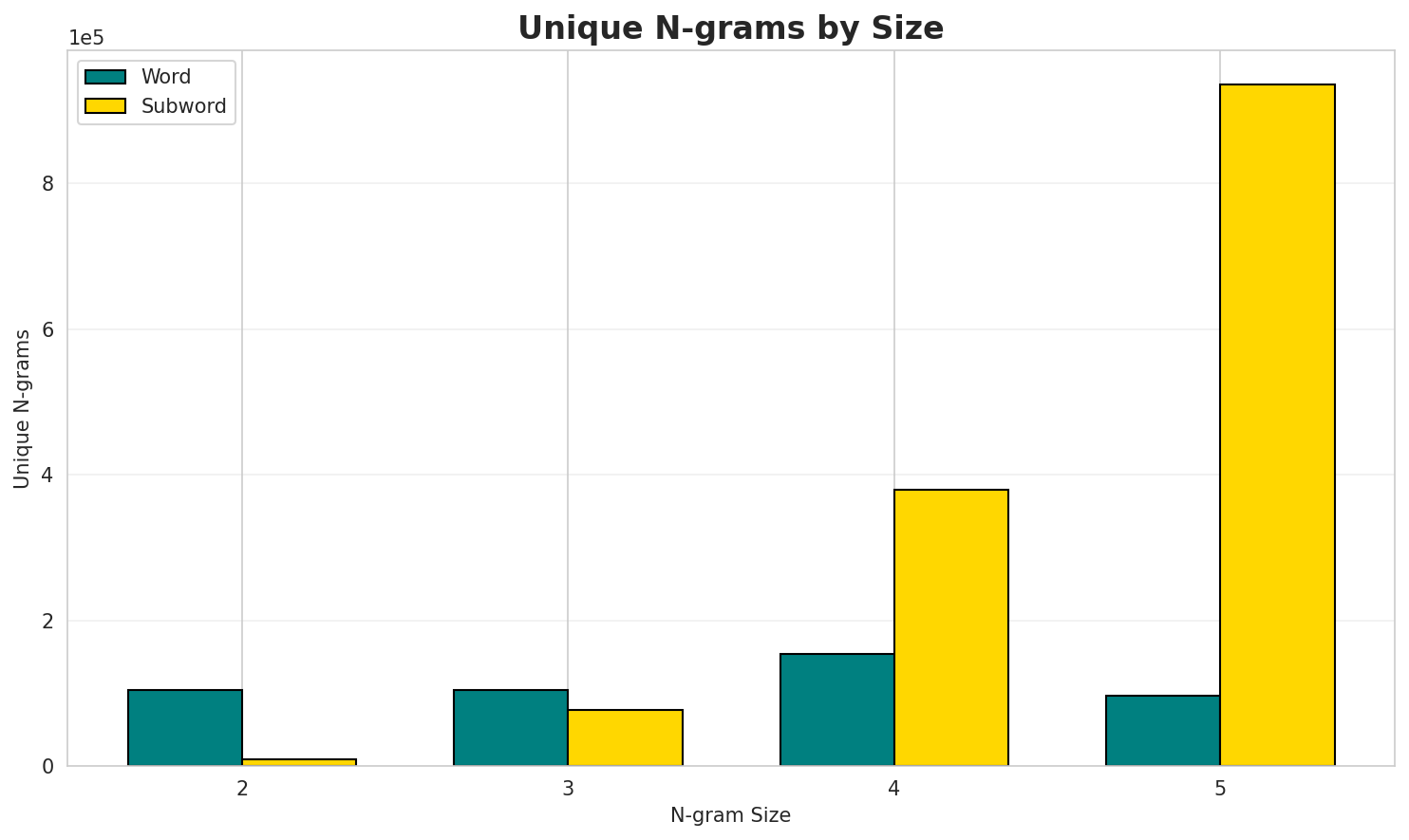

2. N-gram Model Evaluation

Results

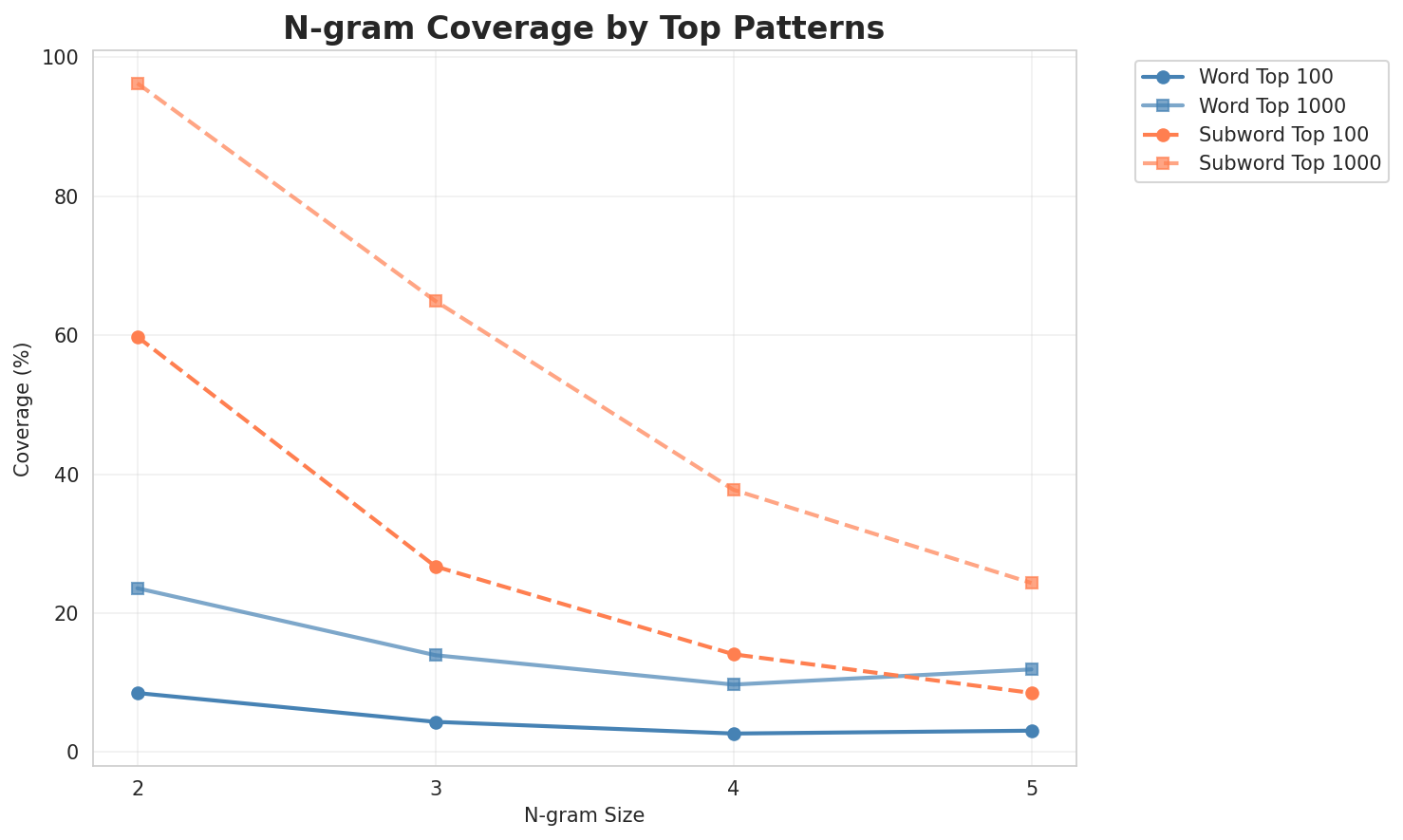

| N-gram | Variant | Perplexity | Entropy | Unique N-grams | Top-100 Coverage | Top-1000 Coverage |

|---|---|---|---|---|---|---|

| 2-gram | Word | 39,006 | 15.25 | 104,315 | 8.5% | 23.6% |

| 2-gram | Subword | 392 🏆 | 8.61 | 9,402 | 59.8% | 96.3% |

| 3-gram | Word | 62,599 | 15.93 | 104,125 | 4.4% | 14.0% |

| 3-gram | Subword | 3,216 | 11.65 | 76,613 | 26.7% | 64.9% |

| 4-gram | Word | 113,012 | 16.79 | 154,212 | 2.7% | 9.7% |

| 4-gram | Subword | 17,012 | 14.05 | 379,918 | 14.1% | 37.8% |

| 5-gram | Word | 73,099 | 16.16 | 96,541 | 3.1% | 11.9% |

| 5-gram | Subword | 58,403 | 15.83 | 935,209 | 8.5% | 24.3% |

Top 5 N-grams by Size

2-grams (Word):

| Rank | N-gram | Count |

|---|---|---|

| 1 | եղած է |

5,851 |

| 2 | մէջ կը |

5,372 |

| 3 | եւ կը |

4,686 |

| 4 | որ կը |

4,419 |

| 5 | ինչպէս նաեւ |

3,890 |

3-grams (Word):

| Rank | N-gram | Count |

|---|---|---|

| 1 | ծանօթագրութիւններ արտաքին յղումներ |

1,448 |

| 2 | տեղի կ ունենայ |

1,025 |

| 3 | տե ս նաեւ |

875 |

| 4 | լոյս տեսած է |

799 |

| 5 | կենսագրութիւն ծնած է |

685 |

4-grams (Word):

| Rank | N-gram | Count |

|---|---|---|

| 1 | հ մ ը մ |

449 |

| 2 | կենսագրական գիծեր ծնած է |

395 |

| 3 | թուական ոչ նահանջ տարի |

330 |

| 4 | մ ը մ ի |

326 |

| 5 | նախնական կրթութիւնը ստացած է |

273 |

5-grams (Word):

| Rank | N-gram | Count |

|---|---|---|

| 1 | հ մ ը մ ի |

320 |

| 2 | տարին է դէպքեր ծնունդներ 16px |

223 |

| 3 | աղբիւրներ հայ հանրագիտակ հ մկրտիչ |

148 |

| 4 | է դէպքեր ծնունդներ 16px մահեր |

147 |

| 5 | դէպքեր ծնունդներ 16px մահեր 16px |

147 |

2-grams (Subword):

| Rank | N-gram | Count |

|---|---|---|

| 1 | ո ւ |

1,154,928 |

| 2 | ա ն |

1,111,749 |

| 3 | ն _ |

917,764 |

| 4 | ե ր |

685,736 |

| 5 | ա ր |

622,298 |

3-grams (Subword):

| Rank | N-gram | Count |

|---|---|---|

| 1 | ա ն _ |

382,604 |

| 2 | ն ե ր |

314,903 |

| 3 | ր ո ւ |

295,790 |

| 4 | ա կ ա |

277,056 |

| 5 | ո ւ թ |

265,013 |

4-grams (Subword):

| Rank | N-gram | Count |

|---|---|---|

| 1 | ա կ ա ն |

217,395 |

| 2 | կ ա ն _ |

159,498 |

| 3 | ե ր ո ւ |

152,660 |

| 4 | ո ւ թ ի |

140,761 |

| 5 | թ ի ւ ն |

139,607 |

5-grams (Subword):

| Rank | N-gram | Count |

|---|---|---|

| 1 | ա կ ա ն _ |

153,426 |

| 2 | ո ւ թ ի ւ |

138,505 |

| 3 | ւ թ ի ւ ն |

138,493 |

| 4 | ո ւ թ ե ա |

106,369 |

| 5 | ն ե ր ո ւ |

105,374 |

Key Findings

- Best Perplexity: 2-gram (subword) with 392

- Entropy Trend: Decreases with larger n-grams (more predictable)

- Coverage: Top-1000 patterns cover ~24% of corpus

- Recommendation: 4-gram or 5-gram for best predictive performance

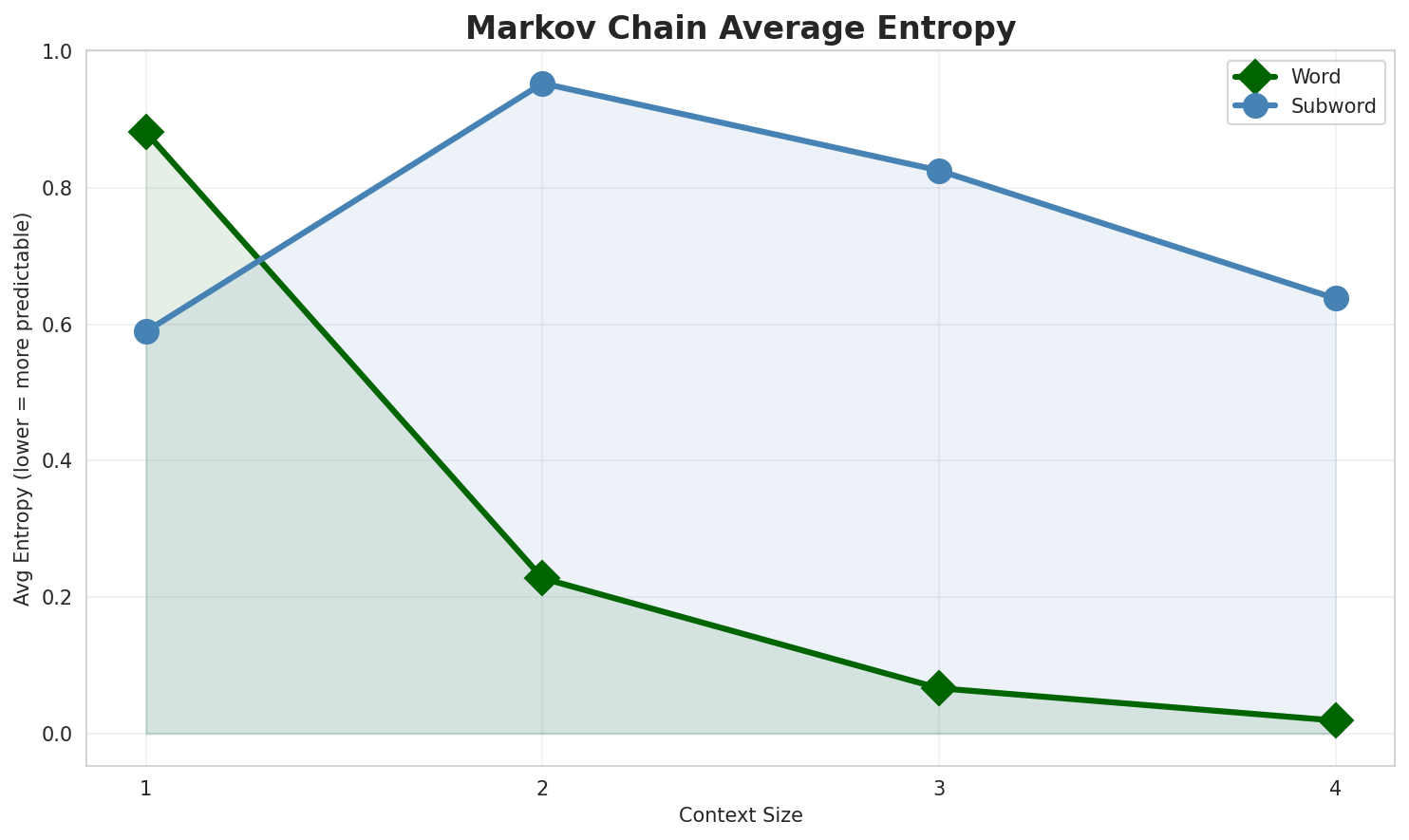

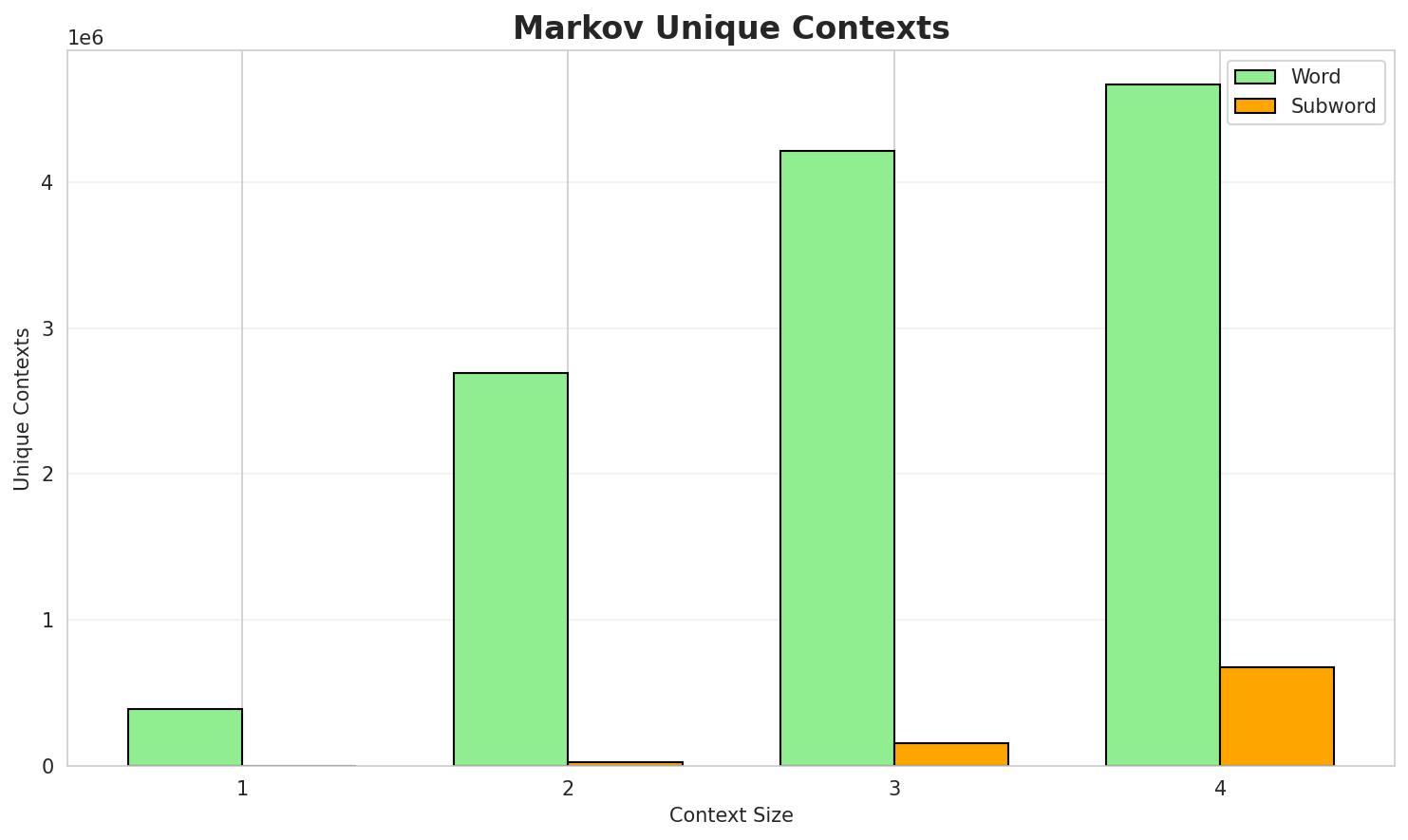

3. Markov Chain Evaluation

Results

| Context | Variant | Avg Entropy | Perplexity | Branching Factor | Unique Contexts | Predictability |

|---|---|---|---|---|---|---|

| 1 | Word | 0.8813 | 1.842 | 6.94 | 388,915 | 11.9% |

| 1 | Subword | 0.5894 | 1.505 | 6.80 | 3,661 | 41.1% |

| 2 | Word | 0.2276 | 1.171 | 1.57 | 2,695,260 | 77.2% |

| 2 | Subword | 0.9532 | 1.936 | 6.36 | 24,911 | 4.7% |

| 3 | Word | 0.0665 | 1.047 | 1.11 | 4,212,072 | 93.4% |

| 3 | Subword | 0.8254 | 1.772 | 4.29 | 158,342 | 17.5% |

| 4 | Word | 0.0190 🏆 | 1.013 | 1.03 | 4,666,447 | 98.1% |

| 4 | Subword | 0.6377 | 1.556 | 2.87 | 679,042 | 36.2% |

Generated Text Samples (Word-based)

Below are text samples generated from each word-based Markov chain model:

Context Size 1:

եւ ճոն չիփ ինք արդէն այդ քայլը շրջանը տասը գիրքերը գրուած հայերէն անգլերէն որ կ առնէէ թուականներուն ըստ ժողովրդական արդիստի կոչման հայաստանի հանրապետութեան կառավարութեան սակայն ան իր մ...կը պատսպարէ քանատական կողմէն երգը ձայնագրուած է պաքուի 1 րդ կաթողիկոս խորէն տէր կիւրեղեան տայանա 8

Context Size 2:

եղած է հայ արշակունիներու արքայատոհմէն եղած է 100 հազարէն աւելի հայ պատանիներ ժամանակագրութիւն 15 փե...մէջ կը գտնուին քիմքին ամբողջ տարածքին մեծ կաղնիի անտառները արգելոցին զարդը կը կազմեն իր աշխատութիւնն...եւ կը վերադառնայ երուսաղէմ կ երթան գերեզման անուշաբոյր իւղերով օծելու քրիստոսի մարմինը իր մտահոգութի...

Context Size 3:

ծանօթագրութիւններ արտաքին յղումներ այսօր երջանկության միջազգային օրն է ըստ վիճակագրութեան գիւղացի կա...տեղի կ ունենայ վիզի վիրաբուժական գործողութիւններու ընթացքին եւ յատկապէս քնանալէ առաջ ստորեւ կը ներկա...տե ս նաեւ արեւմտահայաստանի եւ արեւմտահայութեան հարցերու ուսումնասիրութեան կեդրոն ռատիօ եան անկախ հայ...

Context Size 4:

հ մ ը մ ի արժանեաց շքանշանով խօսքեր հ մ ը մ ի կեդրոնական վարչութիւնը գնահատելով բազմավաստակ եղբօր եր...կենսագրական գիծեր ծնած է կիրովականի մէջ այժմ վանաձոր կը լուսաբանէր շրջանի արդիւնաբերական եւ գիւղատնտ...թուական ոչ նահանջ տարի 19րդ դարու վերջին 100րդ տարին է դէպքեր անստոյգ ամսաթիւով արթուր էվանս քնոսոսի...

Generated Text Samples (Subword-based)

Below are text samples generated from each subword-based Markov chain model:

Context Size 1:

_մէջութեմն_կակ՛աան_արհան_կաւորը_նց։_գոքիսուրուրժ

Context Size 2:

ութեանցնել_ան)_հաանները_պատրուածանն_պարին_մէտ_հաւար

Context Size 3:

ան_տարբերոս,_17-րդները:_ան_կատարապետրութիւններով։_հօրը

Context Size 4:

ականուազակ»_(«returկան_կրթակայն_համար։երու_գուստեղծագործո

Key Findings

- Best Predictability: Context-4 (word) with 98.1% predictability

- Branching Factor: Decreases with context size (more deterministic)

- Memory Trade-off: Larger contexts require more storage (679,042 contexts)

- Recommendation: Context-3 or Context-4 for text generation

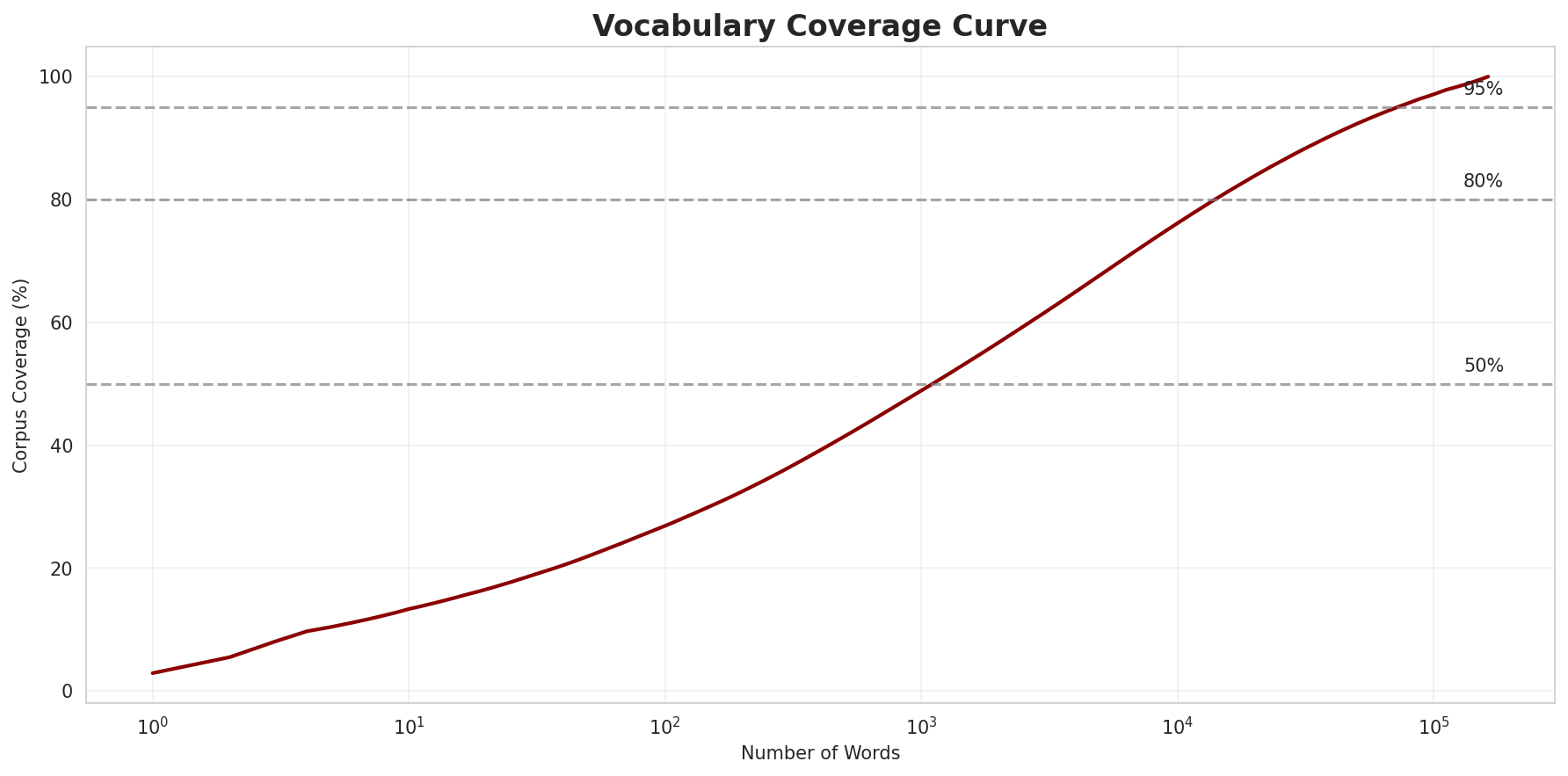

4. Vocabulary Analysis

Statistics

| Metric | Value |

|---|---|

| Vocabulary Size | 163,300 |

| Total Tokens | 4,777,649 |

| Mean Frequency | 29.26 |

| Median Frequency | 4 |

| Frequency Std Dev | 646.35 |

Most Common Words

| Rank | Word | Frequency |

|---|---|---|

| 1 | եւ | 137,926 |

| 2 | է | 124,125 |

| 3 | կը | 121,199 |

| 4 | մէջ | 80,008 |

| 5 | կ | 34,717 |

| 6 | որ | 32,222 |

| 7 | են | 28,873 |

| 8 | իր | 27,391 |

| 9 | մը | 25,115 |

| 10 | ու | 24,951 |

Least Common Words (from vocabulary)

| Rank | Word | Frequency |

|---|---|---|

| 1 | հաւատուի | 2 |

| 2 | ricœur | 2 |

| 3 | ցամաքամերձ | 2 |

| 4 | մունք | 2 |

| 5 | munch | 2 |

| 6 | համաժամեցուած | 2 |

| 7 | measurable | 2 |

| 8 | թհ | 2 |

| 9 | indelible | 2 |

| 10 | պրոդիուսր | 2 |

Zipf's Law Analysis

| Metric | Value |

|---|---|

| Zipf Coefficient | 0.9253 |

| R² (Goodness of Fit) | 0.997096 |

| Adherence Quality | excellent |

Coverage Analysis

| Top N Words | Coverage |

|---|---|

| Top 100 | 26.8% |

| Top 1,000 | 48.9% |

| Top 5,000 | 67.7% |

| Top 10,000 | 76.1% |

Key Findings

- Zipf Compliance: R²=0.9971 indicates excellent adherence to Zipf's law

- High Frequency Dominance: Top 100 words cover 26.8% of corpus

- Long Tail: 153,300 words needed for remaining 23.9% coverage

5. Word Embeddings Evaluation

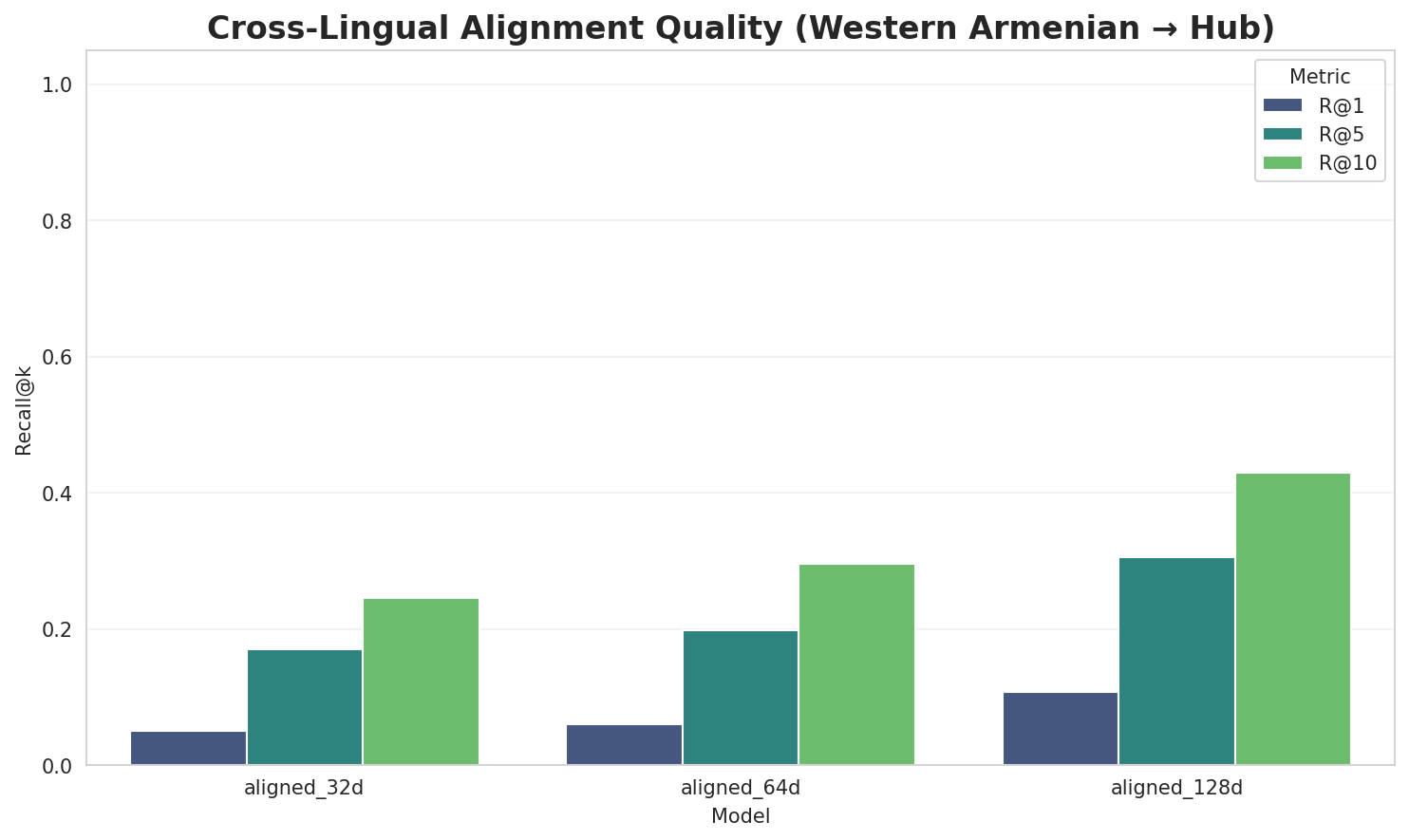

5.1 Cross-Lingual Alignment

5.2 Model Comparison

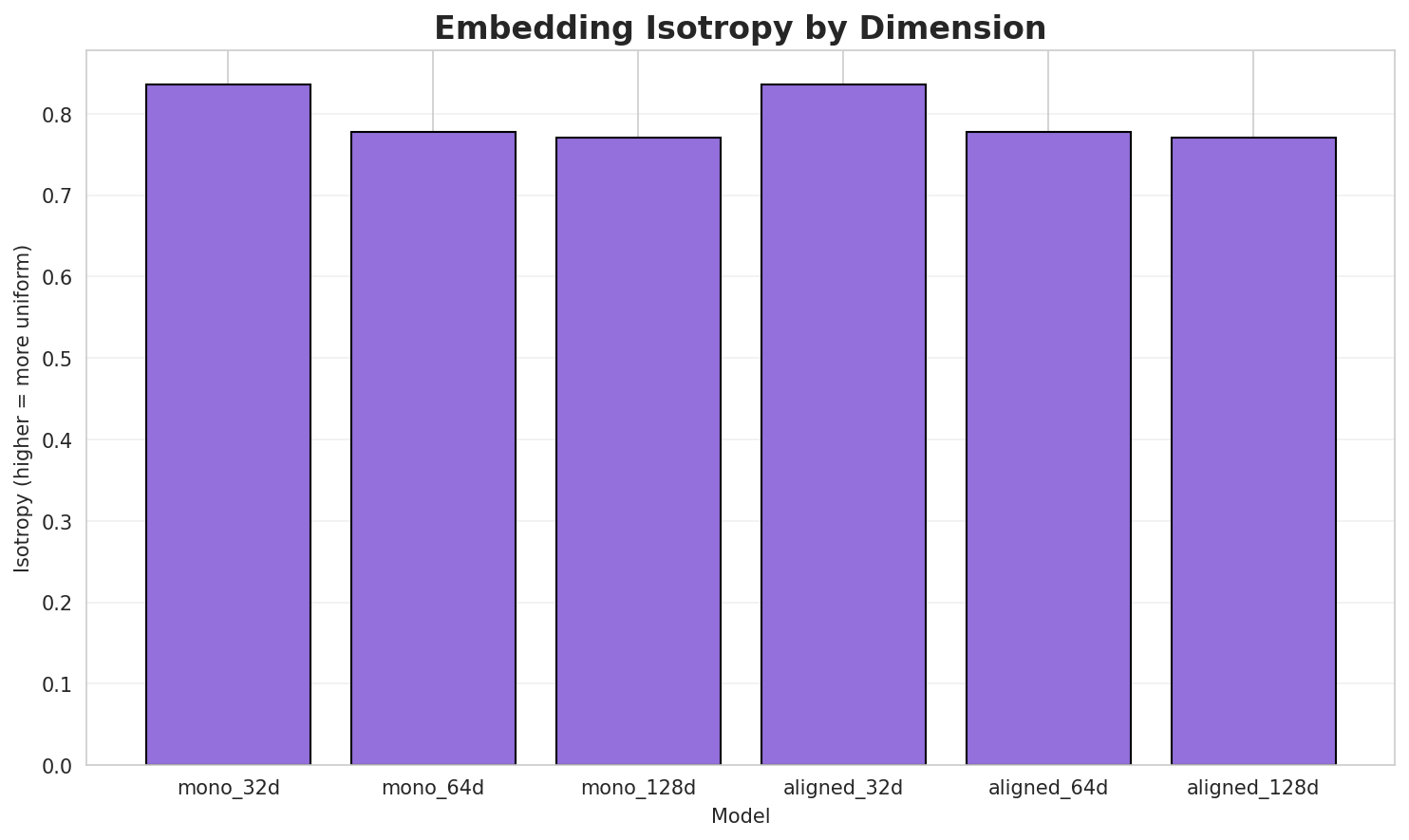

| Model | Dimension | Isotropy | Semantic Density | Alignment R@1 | Alignment R@10 |

|---|---|---|---|---|---|

| mono_32d | 32 | 0.8364 | 0.3396 | N/A | N/A |

| mono_64d | 64 | 0.7779 | 0.2555 | N/A | N/A |

| mono_128d | 128 | 0.7701 | 0.1665 | N/A | N/A |

| aligned_32d | 32 | 0.8364 🏆 | 0.3355 | 0.0500 | 0.2460 |

| aligned_64d | 64 | 0.7779 | 0.2492 | 0.0600 | 0.2960 |

| aligned_128d | 128 | 0.7701 | 0.1670 | 0.1080 | 0.4300 |

Key Findings

- Best Isotropy: aligned_32d with 0.8364 (more uniform distribution)

- Semantic Density: Average pairwise similarity of 0.2522. Lower values indicate better semantic separation.

- Alignment Quality: Aligned models achieve up to 10.8% R@1 in cross-lingual retrieval.

- Recommendation: 128d aligned for best cross-lingual performance

6. Morphological Analysis (Experimental)

This section presents an automated morphological analysis derived from the statistical divergence between word-level and subword-level models. By analyzing where subword predictability spikes and where word-level coverage fails, we can infer linguistic structures without supervised data.

6.1 Productivity & Complexity

| Metric | Value | Interpretation | Recommendation |

|---|---|---|---|

| Productivity Index | 5.000 | High morphological productivity | Reliable analysis |

| Idiomaticity Gap | -0.511 | Low formulaic content | - |

6.2 Affix Inventory (Productive Units)

These are the most productive prefixes and suffixes identified by sampling the vocabulary for global substitutability patterns. A unit is considered an affix if stripping it leaves a valid stem that appears in other contexts.

Productive Prefixes

| Prefix | Examples |

|---|---|

-ա |

ասեղնագործէին, ապականիչ, անդամակցութիւնը |

-մ |

մոնկոլիան, մտերիմը, մազմզուկներու |

-մա |

մազմզուկներու, մաֆին, մատնութիւն |

-հա |

հաւաքուածները, հաւնած, հակազգային |

-ս |

սթեմֆորտ, սարոս, սարուխանեանը |

-կ |

կայազորի, կայքէջի, կատուն |

-հ |

հաւաքուածները, հաւնած, հակազգային |

-պ |

պոգոդինի, պեշավար, պատսպարուի |

Productive Suffixes

| Suffix | Examples |

|---|---|

-ն |

բառարանագիտական, բակերն, հակազգային |

-ան |

բառարանագիտական, քառորդական, տուրիստական |

-ը |

գուլպաները, զգայարանքը, հաւաքուածները |

-ի |

կայազորի, ռատիօհեռասփռումի, կայքէջի |

-ին |

հակազգային, օրֆէասին, ասեղնագործէին |

-ու |

նոյնականացնելու, փրոֆեսորներու, ուսուցանելու |

-ւն |

կատուն, եկամուտներուն, գնողներուն |

-ւ |

ինտերակտիւ, նոյնականացնելու, փրոֆեսորներու |

6.3 Bound Stems (Lexical Roots)

Bound stems are high-frequency subword units that are semantically cohesive but rarely appear as standalone words. These often correspond to the 'core' of a word that requires inflection or derivation to be valid.

| Stem | Cohesion | Substitutability | Examples |

|---|---|---|---|

ներո |

1.91x | 133 contexts | ներով, ներող, ներու |

ութե |

1.66x | 232 contexts | լութեր, ութեան, հութեն |

աստա |

1.66x | 159 contexts | հաստա, փաստա, դաստա |

աննե |

1.51x | 178 contexts | բաններ, մկաններ, սպաններ |

րակա |

1.48x | 146 contexts | րական, փրակա, պրական |

ուակ |

1.95x | 43 contexts | առուակ, սրուակի, առուակի |

ակու |

1.42x | 179 contexts | մակու, ակուլ, կակուղ |

ւթեա |

1.97x | 41 contexts | ութեան, ծութեան, րութեան |

ամար |

1.47x | 135 contexts | քամար, ամարը, համար |

ագրո |

1.55x | 84 contexts | ծրագրով, զագրոսի, բնագրով |

ւթիւ |

1.70x | 48 contexts | ութիւն, ութիւնը, էութիւն |

ններ |

1.47x | 88 contexts | ֆիններ, իոններ, բաններ |

6.4 Affix Compatibility (Co-occurrence)

This table shows which prefixes and suffixes most frequently co-occur on the same stems, revealing the 'stacking' rules of the language's morphology.

| Prefix | Suffix | Frequency | Examples |

|---|---|---|---|

-ա |

-ն |

244 words | արածեցման, ամուսնանան |

-մ |

-ն |

158 words | մտերիմներէն, մեծերին |

-կ |

-ն |

109 words | կիսաքոչուորական, կրետացիին |

-ա |

-ը |

95 words | առաջնութիւնները, արականը |

-ա |

-ի |

89 words | արիացի, արամանի |

-ս |

-ն |

88 words | ստեղներուն, սաթամեանին |

-պ |

-ն |

88 words | պարթոն, պատմալեզուագրական |

-ա |

-ան |

85 words | արածեցման, ամուսնանան |

-մ |

-ի |

84 words | մահտեսեանի, մաղրեպի |

-հա |

-ն |

80 words | համաստեղութիւն, հաւաքականին |

6.5 Recursive Morpheme Segmentation

Using Recursive Hierarchical Substitutability, we decompose complex words into their constituent morphemes. This approach handles nested affixes (e.g., prefix-prefix-root-suffix).

| Word | Suggested Split | Confidence | Stem |

|---|---|---|---|

| ծանօթացնել | ծանօթաց-ն-ել |

7.5 | ն |

| երկրաչափութիւնը | երկրաչափութիւ-ն-ը |

7.5 | ն |

| ախտապատճառներն | ախտապատճառն-եր-ն |

7.5 | եր |

| հովիտներով | հովիտն-եր-ով |

7.5 | եր |

| քէհեայեանը | քէհեայեա-ն-ը |

7.5 | ն |

| ճէպէճեանի | ճէպէճե-ան-ի |

7.5 | ան |

| ձգաններուն | ձգաններ-ու-ն |

7.5 | ու |

| միաբանութիւններ | միաբանութիւն-ն-եր |

7.5 | ն |

| հանրապետութենէն | հանրապետութե-ն-էն |

7.5 | ն |

| իմաստասիրութենէն | իմաստասիրութե-ն-էն |

7.5 | ն |

| տեղանունների | տեղանունն-եր-ի |

7.5 | եր |

| հարեւաններ | հարեւան-ն-եր |

7.5 | ն |

| բերբերյանի | բերբերյ-ան-ի |

7.5 | ան |

| աջակիցներ | աջակից-ն-եր |

7.5 | ն |

| մթութիւնը | մթութիւ-ն-ը |

7.5 | ն |

6.6 Linguistic Interpretation

Automated Insight: The language Western Armenian shows high morphological productivity. The subword models are significantly more efficient than word models, suggesting a rich system of affixation or compounding.

7. Summary & Recommendations

Production Recommendations

| Component | Recommended | Rationale |

|---|---|---|

| Tokenizer | 64k BPE | Best compression (4.07x) |

| N-gram | 2-gram | Lowest perplexity (392) |

| Markov | Context-4 | Highest predictability (98.1%) |

| Embeddings | 100d | Balanced semantic capture and isotropy |

Appendix: Metrics Glossary & Interpretation Guide

This section provides definitions, intuitions, and guidance for interpreting the metrics used throughout this report.

Tokenizer Metrics

Compression Ratio

Definition: The ratio of characters to tokens (chars/token). Measures how efficiently the tokenizer represents text.

Intuition: Higher compression means fewer tokens needed to represent the same text, reducing sequence lengths for downstream models. A 3x compression means ~3 characters per token on average.

What to seek: Higher is generally better for efficiency, but extremely high compression may indicate overly aggressive merging that loses morphological information.

Average Token Length (Fertility)

Definition: Mean number of characters per token produced by the tokenizer.

Intuition: Reflects the granularity of tokenization. Longer tokens capture more context but may struggle with rare words; shorter tokens are more flexible but increase sequence length.

What to seek: Balance between 2-5 characters for most languages. Arabic/morphologically-rich languages may benefit from slightly longer tokens.

Unknown Token Rate (OOV Rate)

Definition: Percentage of tokens that map to the unknown/UNK token, indicating words the tokenizer cannot represent.

Intuition: Lower OOV means better vocabulary coverage. High OOV indicates the tokenizer encounters many unseen character sequences.

What to seek: Below 1% is excellent; below 5% is acceptable. BPE tokenizers typically achieve very low OOV due to subword fallback.

N-gram Model Metrics

Perplexity

Definition: Measures how "surprised" the model is by test data. Mathematically: 2^(cross-entropy). Lower values indicate better prediction.

Intuition: If perplexity is 100, the model is as uncertain as if choosing uniformly among 100 options at each step. A perplexity of 10 means effectively choosing among 10 equally likely options.

What to seek: Lower is better. Perplexity decreases with larger n-grams (more context). Values vary widely by language and corpus size.

Entropy

Definition: Average information content (in bits) needed to encode the next token given the context. Related to perplexity: perplexity = 2^entropy.

Intuition: High entropy means high uncertainty/randomness; low entropy means predictable patterns. Natural language typically has entropy between 1-4 bits per character.

What to seek: Lower entropy indicates more predictable text patterns. Entropy should decrease as n-gram size increases.

Coverage (Top-K)

Definition: Percentage of corpus occurrences explained by the top K most frequent n-grams.

Intuition: High coverage with few patterns indicates repetitive/formulaic text; low coverage suggests diverse vocabulary usage.

What to seek: Depends on use case. For language modeling, moderate coverage (40-60% with top-1000) is typical for natural text.

Markov Chain Metrics

Average Entropy

Definition: Mean entropy across all contexts, measuring average uncertainty in next-word prediction.

Intuition: Lower entropy means the model is more confident about what comes next. Context-1 has high entropy (many possible next words); Context-4 has low entropy (few likely continuations).

What to seek: Decreasing entropy with larger context sizes. Very low entropy (<0.1) indicates highly deterministic transitions.

Branching Factor

Definition: Average number of unique next tokens observed for each context.

Intuition: High branching = many possible continuations (flexible but uncertain); low branching = few options (predictable but potentially repetitive).

What to seek: Branching factor should decrease with context size. Values near 1.0 indicate nearly deterministic chains.

Predictability

Definition: Derived metric: (1 - normalized_entropy) × 100%. Indicates how deterministic the model's predictions are.

Intuition: 100% predictability means the next word is always certain; 0% means completely random. Real text falls between these extremes.

What to seek: Higher predictability for text generation quality, but too high (>98%) may produce repetitive output.

Vocabulary & Zipf's Law Metrics

Zipf's Coefficient

Definition: The slope of the log-log plot of word frequency vs. rank. Zipf's law predicts this should be approximately -1.

Intuition: A coefficient near -1 indicates the corpus follows natural language patterns where a few words are very common and most words are rare.

What to seek: Values between -0.8 and -1.2 indicate healthy natural language distribution. Deviations may suggest domain-specific or artificial text.

R² (Coefficient of Determination)

Definition: Measures how well the linear fit explains the frequency-rank relationship. Ranges from 0 to 1.

Intuition: R² near 1.0 means the data closely follows Zipf's law; lower values indicate deviation from expected word frequency patterns.

What to seek: R² > 0.95 is excellent; > 0.99 indicates near-perfect Zipf adherence typical of large natural corpora.

Vocabulary Coverage

Definition: Cumulative percentage of corpus tokens accounted for by the top N words.

Intuition: Shows how concentrated word usage is. If top-100 words cover 50% of text, the corpus relies heavily on common words.

What to seek: Top-100 covering 30-50% is typical. Higher coverage indicates more repetitive text; lower suggests richer vocabulary.

Word Embedding Metrics

Isotropy

Definition: Measures how uniformly distributed vectors are in the embedding space. Computed as the ratio of minimum to maximum singular values.

Intuition: High isotropy (near 1.0) means vectors spread evenly in all directions; low isotropy means vectors cluster in certain directions, reducing expressiveness.

What to seek: Higher isotropy generally indicates better-quality embeddings. Values > 0.1 are reasonable; > 0.3 is good. Lower-dimensional embeddings tend to have higher isotropy.

Average Norm

Definition: Mean magnitude (L2 norm) of word vectors in the embedding space.

Intuition: Indicates the typical "length" of vectors. Consistent norms suggest stable training; high variance may indicate some words are undertrained.

What to seek: Relatively consistent norms across models. The absolute value matters less than consistency (low std deviation).

Cosine Similarity

Definition: Measures angular similarity between vectors, ranging from -1 (opposite) to 1 (identical direction).

Intuition: Words with similar meanings should have high cosine similarity. This is the standard metric for semantic relatedness in embeddings.

What to seek: Semantically related words should score > 0.5; unrelated words should be near 0. Synonyms often score > 0.7.

t-SNE Visualization

Definition: t-Distributed Stochastic Neighbor Embedding - a dimensionality reduction technique that preserves local structure for visualization.

Intuition: Clusters in t-SNE plots indicate groups of semantically related words. Spread indicates vocabulary diversity; tight clusters suggest semantic coherence.

What to seek: Meaningful clusters (e.g., numbers together, verbs together). Avoid over-interpreting distances - t-SNE preserves local, not global, structure.

General Interpretation Guidelines

- Compare within model families: Metrics are most meaningful when comparing models of the same type (e.g., 8k vs 64k tokenizer).

- Consider trade-offs: Better performance on one metric often comes at the cost of another (e.g., compression vs. OOV rate).

- Context matters: Optimal values depend on downstream tasks. Text generation may prioritize different metrics than classification.

- Corpus influence: All metrics are influenced by corpus characteristics. Wikipedia text differs from social media or literature.

- Language-specific patterns: Morphologically rich languages (like Arabic) may show different optimal ranges than analytic languages.

Visualizations Index

| Visualization | Description |

|---|---|

| Tokenizer Compression | Compression ratios by vocabulary size |

| Tokenizer Fertility | Average token length by vocabulary |

| Tokenizer OOV | Unknown token rates |

| Tokenizer Total Tokens | Total tokens by vocabulary |

| N-gram Perplexity | Perplexity by n-gram size |

| N-gram Entropy | Entropy by n-gram size |

| N-gram Coverage | Top pattern coverage |

| N-gram Unique | Unique n-gram counts |

| Markov Entropy | Entropy by context size |

| Markov Branching | Branching factor by context |

| Markov Contexts | Unique context counts |

| Zipf's Law | Frequency-rank distribution with fit |

| Vocab Frequency | Word frequency distribution |

| Top 20 Words | Most frequent words |

| Vocab Coverage | Cumulative coverage curve |

| Embedding Isotropy | Vector space uniformity |

| Embedding Norms | Vector magnitude distribution |

| Embedding Similarity | Word similarity heatmap |

| Nearest Neighbors | Similar words for key terms |

| t-SNE Words | 2D word embedding visualization |

| t-SNE Sentences | 2D sentence embedding visualization |

| Position Encoding | Encoding method comparison |

| Model Sizes | Storage requirements |

| Performance Dashboard | Comprehensive performance overview |

About This Project

Data Source

Models trained on wikipedia-monthly - a monthly snapshot of Wikipedia articles across 300+ languages.

Project

A project by Wikilangs - Open-source NLP models for every Wikipedia language.

Maintainer

Citation

If you use these models in your research, please cite:

@misc{wikilangs2025,

author = {Kamali, Omar},

title = {Wikilangs: Open NLP Models for Wikipedia Languages},

year = {2025},

doi = {10.5281/zenodo.18073153},

publisher = {Zenodo},

url = {https://huggingface.co/wikilangs}

institution = {Omneity Labs}

}

License

MIT License - Free for academic and commercial use.

Links

- 🌐 Website: wikilangs.org

- 🤗 Models: huggingface.co/wikilangs

- 📊 Data: wikipedia-monthly

- 👤 Author: Omar Kamali

- 🤝 Sponsor: Featherless AI

Generated by Wikilangs Models Pipeline

Report Date: 2026-01-10 03:56:09