language: syl

language_name: Sylheti

language_family: indoaryan_eastern

tags:

- wikilangs

- nlp

- tokenizer

- embeddings

- n-gram

- markov

- wikipedia

- feature-extraction

- sentence-similarity

- tokenization

- n-grams

- markov-chain

- text-mining

- fasttext

- babelvec

- vocabulous

- vocabulary

- monolingual

- family-indoaryan_eastern

license: mit

library_name: wikilangs

pipeline_tag: text-generation

datasets:

- omarkamali/wikipedia-monthly

dataset_info:

name: wikipedia-monthly

description: Monthly snapshots of Wikipedia articles across 300+ languages

metrics:

- name: best_compression_ratio

type: compression

value: 4.022

- name: best_isotropy

type: isotropy

value: 0.2602

- name: vocabulary_size

type: vocab

value: 0

generated: 2026-01-10T00:00:00.000Z

Sylheti - Wikilangs Models

Comprehensive Research Report & Full Ablation Study

This repository contains NLP models trained and evaluated by Wikilangs, specifically on Sylheti Wikipedia data. We analyze tokenizers, n-gram models, Markov chains, vocabulary statistics, and word embeddings.

📋 Repository Contents

Models & Assets

- Tokenizers (8k, 16k, 32k, 64k)

- N-gram models (2, 3, 4, 5-gram)

- Markov chains (context of 1, 2, 3, 4 and 5)

- Subword N-gram and Markov chains

- Embeddings in various sizes and dimensions (aligned and unaligned)

- Language Vocabulary

- Language Statistics

Analysis and Evaluation

- 1. Tokenizer Evaluation

- 2. N-gram Model Evaluation

- 3. Markov Chain Evaluation

- 4. Vocabulary Analysis

- 5. Word Embeddings Evaluation

- 6. Morphological Analysis (Experimental)

- 7. Summary & Recommendations

- Metrics Glossary

- Visualizations Index

1. Tokenizer Evaluation

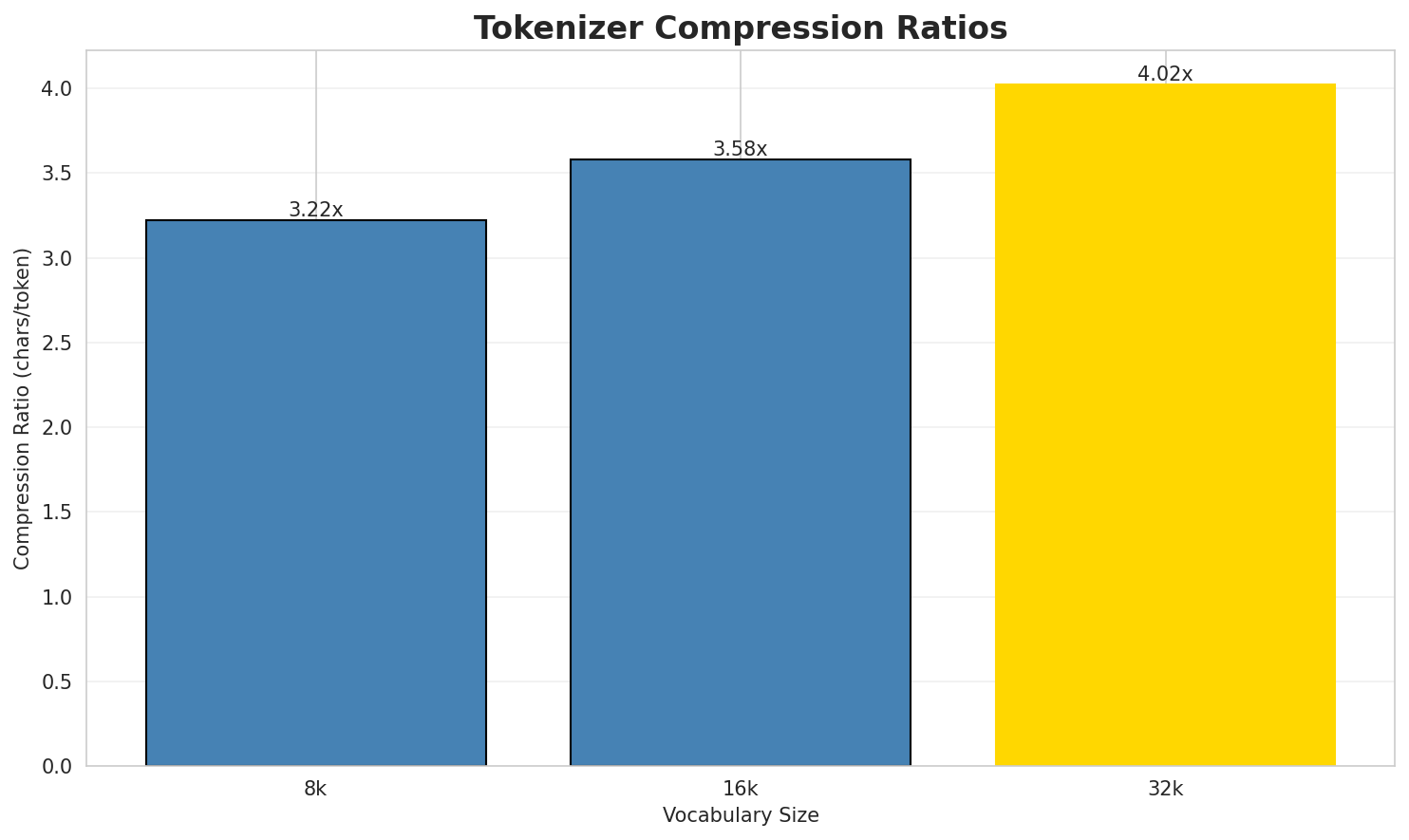

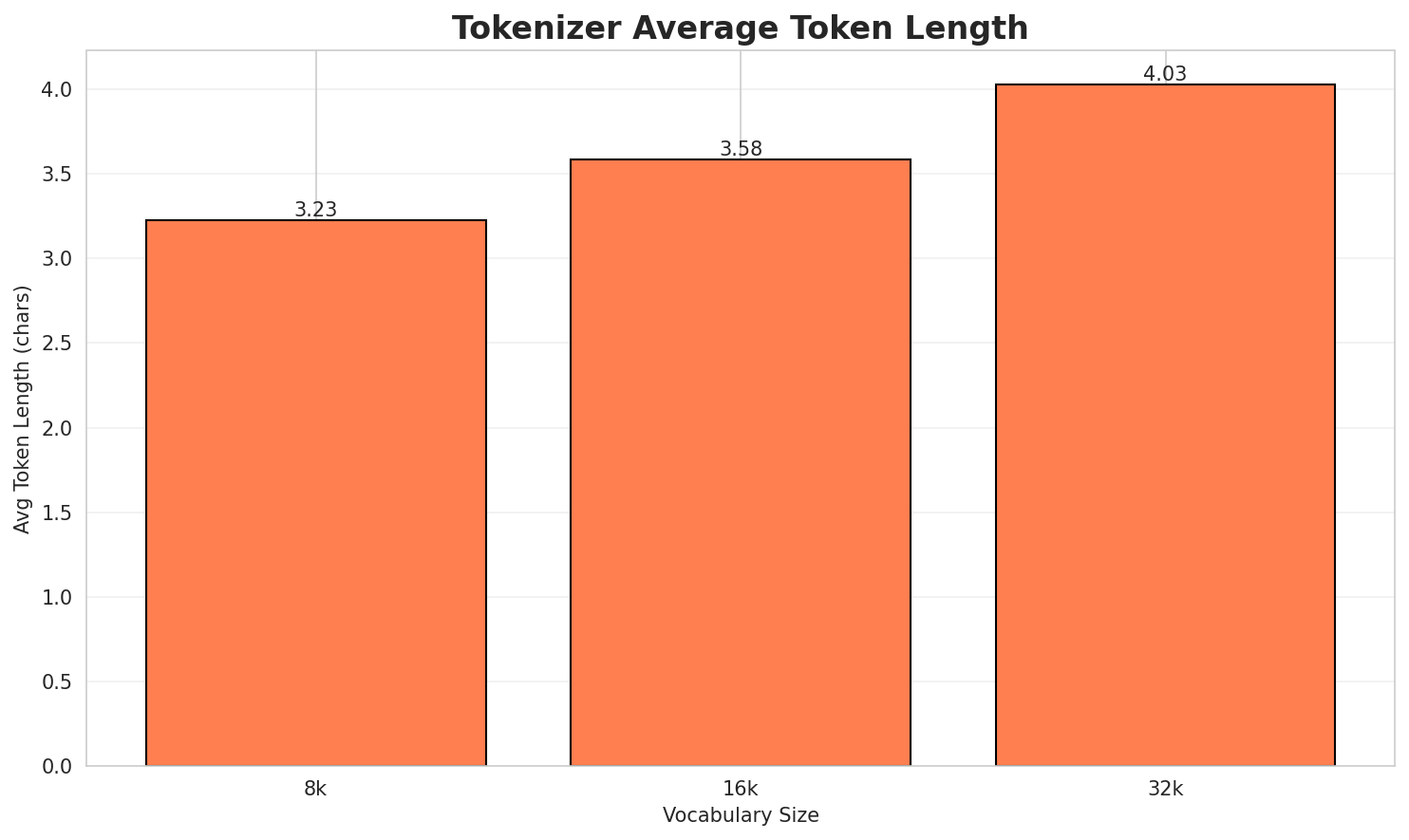

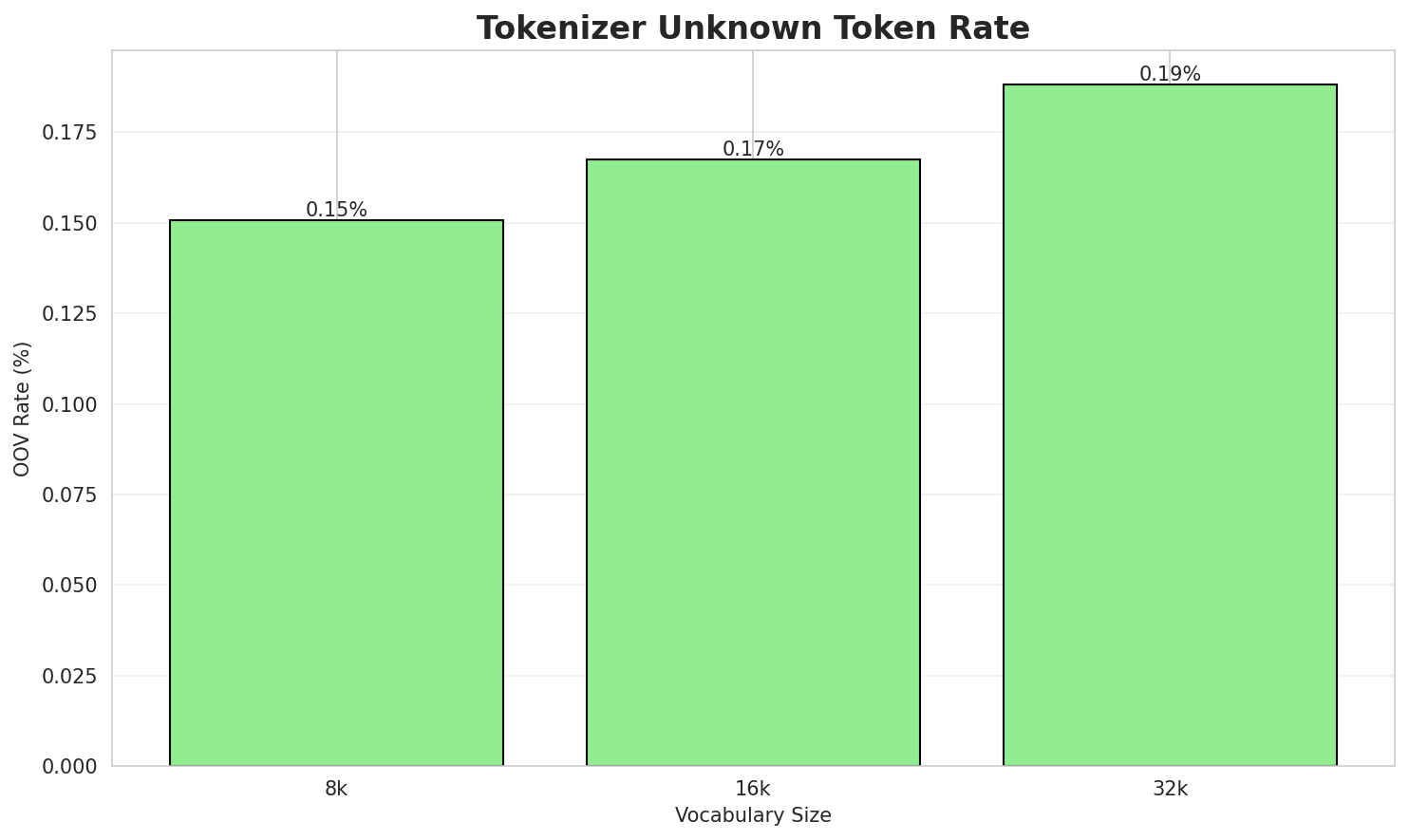

Results

| Vocab Size | Compression | Avg Token Len | UNK Rate | Total Tokens |

|---|---|---|---|---|

| 8k | 3.222x | 3.23 | 0.1507% | 158,587 |

| 16k | 3.579x | 3.58 | 0.1674% | 142,736 |

| 32k | 4.022x 🏆 | 4.03 | 0.1881% | 127,036 |

Tokenization Examples

Below are sample sentences tokenized with each vocabulary size:

Sample 1: ꠀꠝ꠆ꠞꠣ ꠢꠇ꠆ꠇꠟ ꠍꠤꠟꠐꠤ ꠄꠉꠥ ꠍꠥꠟꠥꠉꠣꠘ ꠨ ꠗꠣꠞꠘꠣ ꠇꠞꠣ ꠅꠄ ꠁꠈꠣꠘ ꠎꠘꠙꠤꠞꠤꠅ ꠟꠥꠇ ꠝꠥꠈꠦ ꠢꠥꠘꠣ ꠉꠤꠔ ꠕꠘꠦ ...

| Vocab | Tokens | Count |

|---|---|---|

| 8k | ▁ꠀꠝ꠆ ꠞꠣ ▁ꠢꠇ꠆ꠇꠟ ▁ꠍꠤꠟꠐꠤ ▁ꠄꠉꠥ ▁ꠍꠥꠟ ꠥ ꠉꠣꠘ ▁꠨ ▁ꠗꠣꠞꠘꠣ ... (+26 more) |

36 |

| 16k | ▁ꠀꠝ꠆ꠞꠣ ▁ꠢꠇ꠆ꠇꠟ ▁ꠍꠤꠟꠐꠤ ▁ꠄꠉꠥ ▁ꠍꠥꠟ ꠥ ꠉꠣꠘ ▁꠨ ▁ꠗꠣꠞꠘꠣ ▁ꠇꠞꠣ ... (+18 more) |

28 |

| 32k | ▁ꠀꠝ꠆ꠞꠣ ▁ꠢꠇ꠆ꠇꠟ ▁ꠍꠤꠟꠐꠤ ▁ꠄꠉꠥ ▁ꠍꠥꠟꠥꠉꠣꠘ ▁꠨ ▁ꠗꠣꠞꠘꠣ ▁ꠇꠞꠣ ▁ꠅꠄ ▁ꠁꠈꠣꠘ ... (+14 more) |

24 |

Sample 2: ꠘꠣꠢꠤꠖ ꠁꠍꠟꠣꠝ ꠅ ꠛꠣꠋꠟꠣꠖꠦꠡꠞ ꠇꠥꠐꠣ ꠀꠘ꠆ꠖꠥꠟꠘꠞ ꠄꠇ ꠡꠝꠘ꠆ꠘꠄꠇꠞꠞꠣ ⁕ ꠉꠦꠟꠣꠞꠤꠔ

| Vocab | Tokens | Count |

|---|---|---|

| 8k | ▁ꠘꠣ ꠢꠤꠖ ▁ꠁꠍꠟꠣꠝ ▁ꠅ ▁ꠛꠣꠋꠟꠣꠖꠦꠡꠞ ▁ꠇꠥꠐꠣ ▁ꠀꠘ꠆ꠖꠥꠟꠘꠞ ▁ꠄꠇ ▁ꠡꠝꠘ꠆ꠘꠄꠇꠞꠞꠣ ▁⁕ ... (+1 more) |

11 |

| 16k | ▁ꠘꠣꠢꠤꠖ ▁ꠁꠍꠟꠣꠝ ▁ꠅ ▁ꠛꠣꠋꠟꠣꠖꠦꠡꠞ ▁ꠇꠥꠐꠣ ▁ꠀꠘ꠆ꠖꠥꠟꠘꠞ ▁ꠄꠇ ▁ꠡꠝꠘ꠆ꠘꠄꠇꠞꠞꠣ ▁⁕ ▁ꠉꠦꠟꠣꠞꠤꠔ |

10 |

| 32k | ▁ꠘꠣꠢꠤꠖ ▁ꠁꠍꠟꠣꠝ ▁ꠅ ▁ꠛꠣꠋꠟꠣꠖꠦꠡꠞ ▁ꠇꠥꠐꠣ ▁ꠀꠘ꠆ꠖꠥꠟꠘꠞ ▁ꠄꠇ ▁ꠡꠝꠘ꠆ꠘꠄꠇꠞꠞꠣ ▁⁕ ▁ꠉꠦꠟꠣꠞꠤꠔ |

10 |

Sample 3: ꠇꠠꠤ ꠘꠣꠝꠣꠞ ꠙꠥꠕꠤ ꠍ꠆ꠞꠤꠢꠐ꠆ꠐ ꠕꠘꠦ ꠛꠣꠞꠅꠁꠍꠤꠟ ꠍ꠆ꠞꠤꠝꠢꠝ꠆ꠝꠖ ꠀꠛ꠆ꠖꠥꠟ ꠉꠘꠤ ꠄ ꠛꠣꠞ ꠇꠞ꠆ꠍꠤꠟꠣ ꠡꠘꠞ ꠛꠣꠄ...

| Vocab | Tokens | Count |

|---|---|---|

| 8k | ▁ꠇ ꠠꠤ ▁ꠘꠣꠝ ꠣꠞ ▁ꠙꠥꠕꠤ ▁ꠍ꠆ꠞꠤꠢꠐ꠆ꠐ ▁ꠕꠘꠦ ▁ꠛꠣꠞ ꠅꠁ ꠍꠤꠟ ... (+16 more) |

26 |

| 16k | ▁ꠇ ꠠꠤ ▁ꠘꠣꠝ ꠣꠞ ▁ꠙꠥꠕꠤ ▁ꠍ꠆ꠞꠤꠢꠐ꠆ꠐ ▁ꠕꠘꠦ ▁ꠛꠣꠞ ꠅꠁꠍꠤꠟ ▁ꠍ꠆ꠞꠤ ... (+12 more) |

22 |

| 32k | ▁ꠇꠠꠤ ▁ꠘꠣꠝꠣꠞ ▁ꠙꠥꠕꠤ ▁ꠍ꠆ꠞꠤꠢꠐ꠆ꠐ ▁ꠕꠘꠦ ▁ꠛꠣꠞꠅꠁꠍꠤꠟ ▁ꠍ꠆ꠞꠤꠝꠢꠝ꠆ꠝꠖ ▁ꠀꠛ꠆ꠖꠥꠟ ▁ꠉꠘꠤ ▁ꠄ ... (+6 more) |

16 |

Key Findings

- Best Compression: 32k achieves 4.022x compression

- Lowest UNK Rate: 8k with 0.1507% unknown tokens

- Trade-off: Larger vocabularies improve compression but increase model size

- Recommendation: 32k vocabulary provides optimal balance for production use

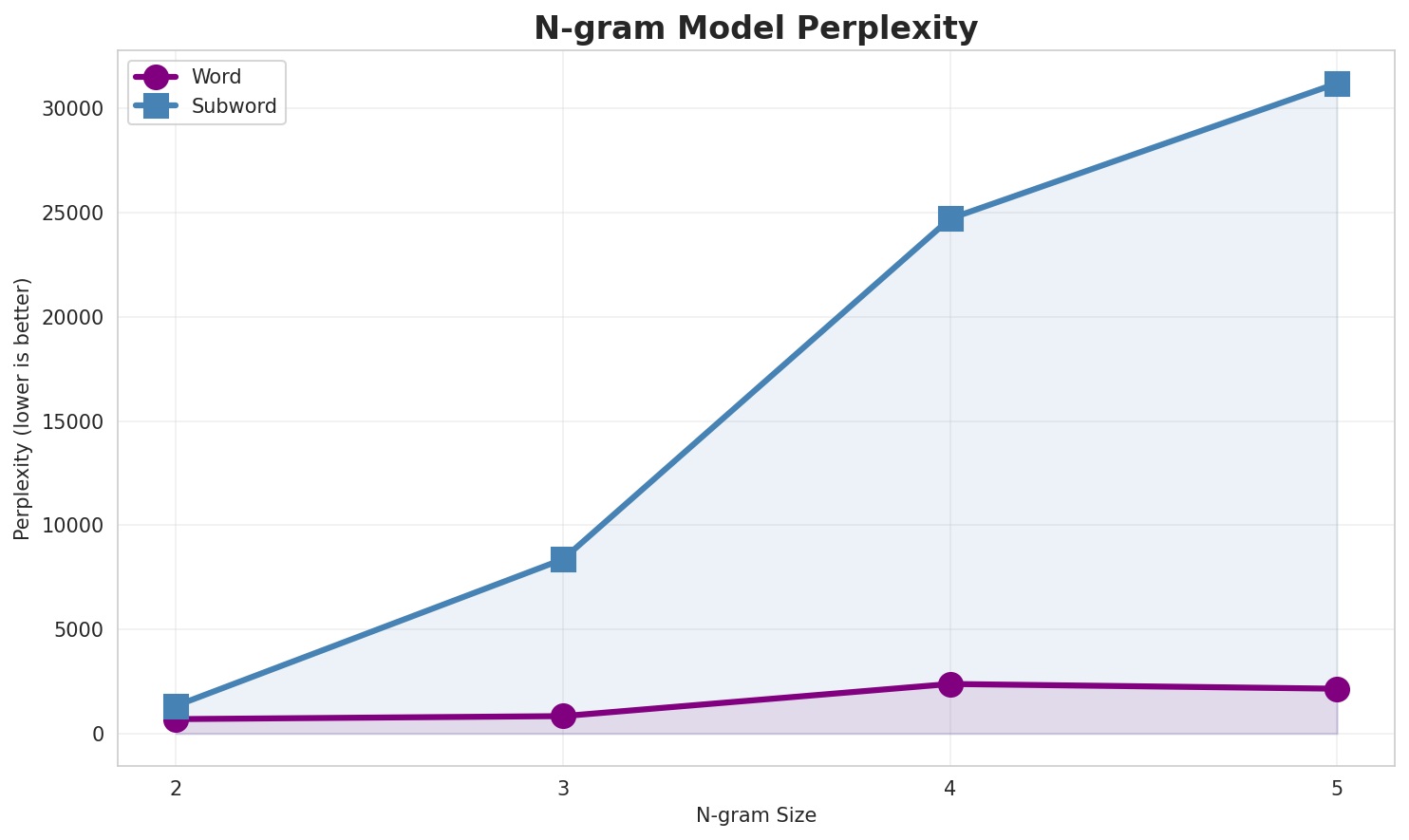

2. N-gram Model Evaluation

Results

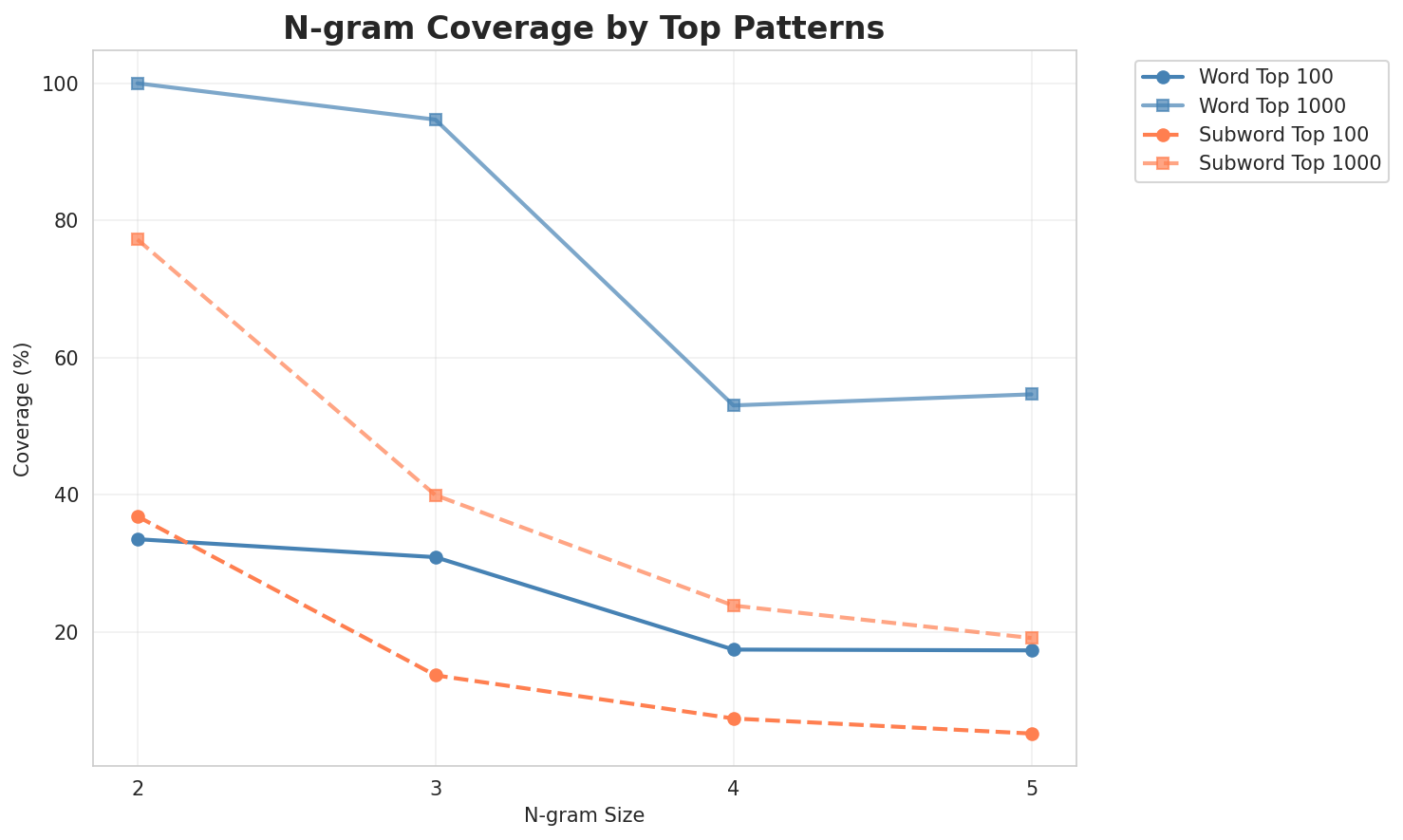

| N-gram | Variant | Perplexity | Entropy | Unique N-grams | Top-100 Coverage | Top-1000 Coverage |

|---|---|---|---|---|---|---|

| 2-gram | Word | 691 🏆 | 9.43 | 884 | 33.5% | 100.0% |

| 2-gram | Subword | 1,332 | 10.38 | 5,973 | 36.8% | 77.2% |

| 3-gram | Word | 836 | 9.71 | 1,105 | 30.9% | 94.7% |

| 3-gram | Subword | 8,364 | 13.03 | 21,498 | 13.7% | 39.9% |

| 4-gram | Word | 2,379 | 11.22 | 3,031 | 17.4% | 53.0% |

| 4-gram | Subword | 24,708 | 14.59 | 50,570 | 7.4% | 23.8% |

| 5-gram | Word | 2,151 | 11.07 | 2,640 | 17.3% | 54.6% |

| 5-gram | Subword | 31,205 | 14.93 | 51,776 | 5.2% | 19.1% |

Top 5 N-grams by Size

2-grams (Word):

| Rank | N-gram | Count |

|---|---|---|

| 1 | ꠔꠂꠔ꠆ꠔ ꠘꠣꠄ |

73 |

| 2 | ꠟꠂꠀ ꠛꠦꠡ |

73 |

| 3 | ꠇꠦꠟꠣꠡꠤꠚꠤꠇꠦꠡꠘ ꠟꠂꠀ |

73 |

| 4 | ꠛꠦꠡ ꠔꠂꠔ꠆ꠔ |

73 |

| 5 | of the |

65 |

3-grams (Word):

| Rank | N-gram | Count |

|---|---|---|

| 1 | ꠛꠦꠡ ꠔꠂꠔ꠆ꠔ ꠘꠣꠄ |

73 |

| 2 | ꠇꠦꠟꠣꠡꠤꠚꠤꠇꠦꠡꠘ ꠟꠂꠀ ꠛꠦꠡ |

73 |

| 3 | ꠟꠂꠀ ꠛꠦꠡ ꠔꠂꠔ꠆ꠔ |

73 |

| 4 | ꠘꠤꠞꠖꠤꠡ꠆ꠐ ꠇꠥꠘ꠆ꠔꠣ ꠛꠣꠔꠣꠁꠟ |

51 |

| 5 | ꠇꠥꠘꠥ ꠘꠤꠞꠖꠤꠡ꠆ꠐ ꠇꠥꠘ꠆ꠔꠣ |

51 |

4-grams (Word):

| Rank | N-gram | Count |

|---|---|---|

| 1 | ꠟꠂꠀ ꠛꠦꠡ ꠔꠂꠔ꠆ꠔ ꠘꠣꠄ |

73 |

| 2 | ꠇꠦꠟꠣꠡꠤꠚꠤꠇꠦꠡꠘ ꠟꠂꠀ ꠛꠦꠡ ꠔꠂꠔ꠆ꠔ |

73 |

| 3 | ꠘꠤꠞꠖꠤꠡ꠆ꠐ ꠇꠥꠘ꠆ꠔꠣ ꠛꠣꠔꠣꠁꠟ ꠘꠣꠄ |

51 |

| 4 | ꠇꠥꠘꠥ ꠘꠤꠞꠖꠤꠡ꠆ꠐ ꠇꠥꠘ꠆ꠔꠣ ꠛꠣꠔꠣꠁꠟ |

51 |

| 5 | ꠀꠝꠦꠞꠤꠇꠣ ꠇꠦꠟꠣꠡꠤꠚꠤꠇꠦꠡꠘ ꠟꠂꠀ ꠛꠦꠡ |

31 |

5-grams (Word):

| Rank | N-gram | Count |

|---|---|---|

| 1 | ꠇꠦꠟꠣꠡꠤꠚꠤꠇꠦꠡꠘ ꠟꠂꠀ ꠛꠦꠡ ꠔꠂꠔ꠆ꠔ ꠘꠣꠄ |

73 |

| 2 | ꠇꠥꠘꠥ ꠘꠤꠞꠖꠤꠡ꠆ꠐ ꠇꠥꠘ꠆ꠔꠣ ꠛꠣꠔꠣꠁꠟ ꠘꠣꠄ |

51 |

| 3 | ꠀꠝꠦꠞꠤꠇꠣ ꠇꠦꠟꠣꠡꠤꠚꠤꠇꠦꠡꠘ ꠟꠂꠀ ꠛꠦꠡ ꠔꠂꠔ꠆ꠔ |

31 |

| 4 | ꠜꠣꠡꠣꠛꠤꠉ꠆ꠉꠣꠘꠅ ꠢꠣꠟ ꠇꠅꠀ ꠎꠣꠄ ꠘꠣ |

30 |

| 5 | ꠢꠣꠟ ꠇꠅꠀ ꠎꠣꠄ ꠘꠣ ꠇꠤꠔꠣ |

30 |

2-grams (Subword):

| Rank | N-gram | Count |

|---|---|---|

| 1 | ꠞ _ |

12,277 |

| 2 | _ ꠀ |

6,142 |

| 3 | ꠘ _ |

5,686 |

| 4 | _ ꠅ |

4,509 |

| 5 | ⁕ _ |

3,764 |

3-grams (Subword):

| Rank | N-gram | Count |

|---|---|---|

| 1 | _ ⁕ _ |

2,981 |

| 2 | ꠀ ꠞ _ |

2,292 |

| 3 | _ ꠨ _ |

2,256 |

| 4 | _ ꠀ ꠞ |

2,193 |

| 5 | _ ꠅ ꠁ |

1,323 |

4-grams (Subword):

| Rank | N-gram | Count |

|---|---|---|

| 1 | _ ꠀ ꠞ _ |

1,762 |

| 2 | _ ꠅ ꠄ _ |

505 |

| 3 | _ ꠍꠤ ꠟ ꠐ |

445 |

| 4 | ꠄ _ ⁕ _ |

441 |

| 5 | _ ꠝꠣ ꠔ _ |

432 |

5-grams (Subword):

| Rank | N-gram | Count |

|---|---|---|

| 1 | _ ꠍꠤ ꠟ ꠐꠤ _ |

332 |

| 2 | _ ꠛꠣꠋ ꠟꠣ ꠖꠦ ꠡ |

328 |

| 3 | _ t h e _ |

326 |

| 4 | _ ꠍꠤ ꠟ ꠐ _ |

284 |

| 5 | _ ꠅ ꠄ _ ⁕ |

272 |

Key Findings

- Best Perplexity: 2-gram (word) with 691

- Entropy Trend: Decreases with larger n-grams (more predictable)

- Coverage: Top-1000 patterns cover ~19% of corpus

- Recommendation: 4-gram or 5-gram for best predictive performance

3. Markov Chain Evaluation

Results

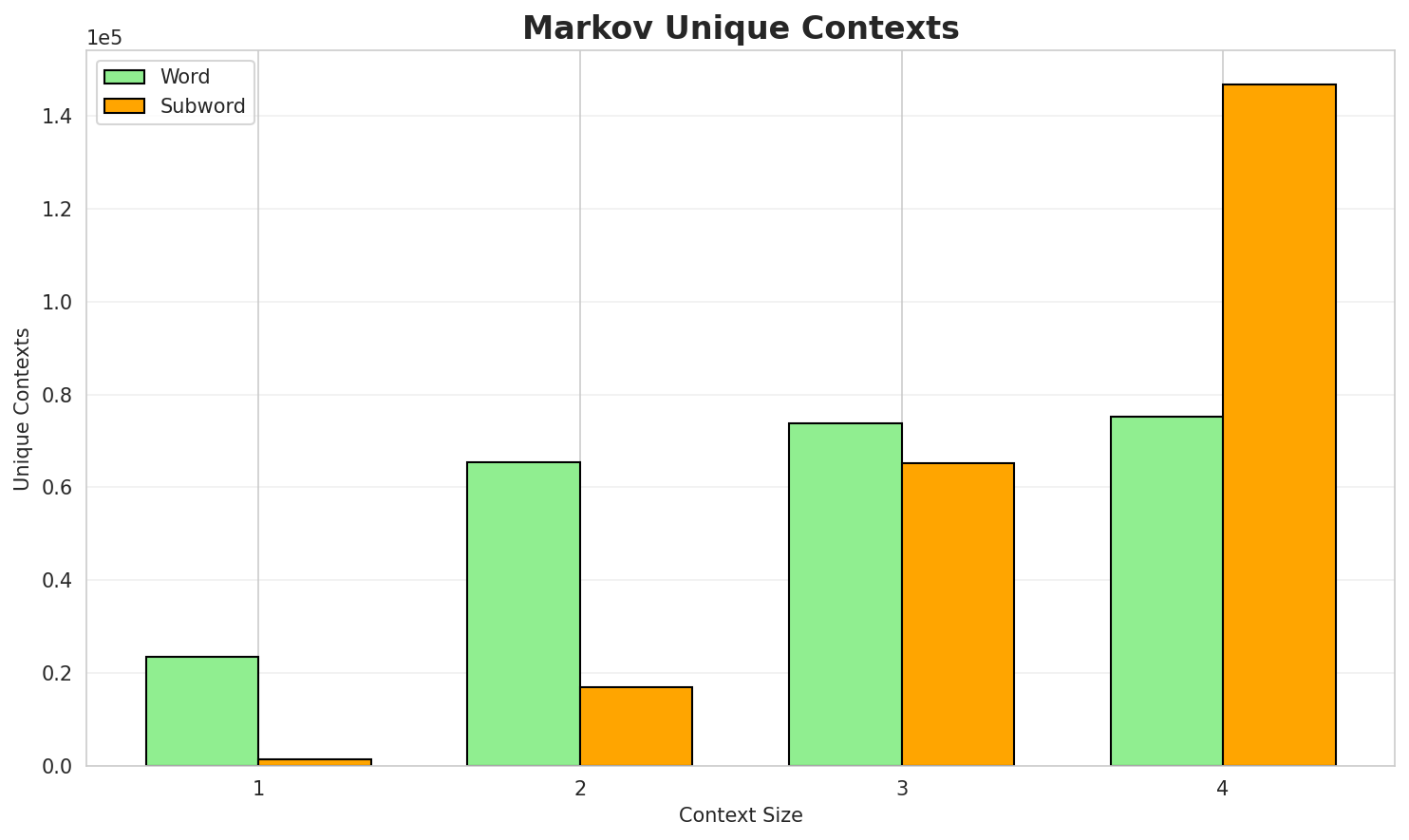

| Context | Variant | Avg Entropy | Perplexity | Branching Factor | Unique Contexts | Predictability |

|---|---|---|---|---|---|---|

| 1 | Word | 0.5935 | 1.509 | 2.79 | 23,596 | 40.6% |

| 1 | Subword | 1.2552 | 2.387 | 11.97 | 1,427 | 0.0% |

| 2 | Word | 0.0932 | 1.067 | 1.13 | 65,510 | 90.7% |

| 2 | Subword | 0.7555 | 1.688 | 3.82 | 17,071 | 24.4% |

| 3 | Word | 0.0199 | 1.014 | 1.03 | 73,767 | 98.0% |

| 3 | Subword | 0.4929 | 1.407 | 2.25 | 65,171 | 50.7% |

| 4 | Word | 0.0085 🏆 | 1.006 | 1.01 | 75,181 | 99.2% |

| 4 | Subword | 0.2650 | 1.202 | 1.49 | 146,673 | 73.5% |

Generated Text Samples (Word-based)

Below are text samples generated from each word-based Markov chain model:

Context Size 1:

ꠀꠞ ꠄꠡꠤꠀ ꠄꠘ꠆ꠒꠤꠀ ꠘꠞꠅꠦ ꠄꠘ꠆ꠒꠤꠀꠞꠦ ꠅꠞ꠆ꠕꠘꠤꠔꠤꠇ ꠃꠘ꠆ꠘꠔꠤꠞ ꠟꠣꠉꠤ ꠄꠇꠐꠣ ꠖꠤꠙꠇ꠆ꠇꠤ ꠟꠄ ꠘꠞꠅꠦꠞ ꠡꠣꠋꠡ꠆ꠇ꠆ꠞꠤꠔꠤꠇ ꠅꠂꠔꠤꠎ꠆ꠎꠎꠞ ꠄꠉꠥ...ꠅꠄ ꠀꠞ ꠇꠥꠟꠡꠤ ꠀ ꠇꠣꠞ ꠟꠣꠉꠣꠁꠟ ꠎꠦꠇꠥꠘꠥ ꠡꠤꠇ꠆ꠞꠤꠔ ꠌꠣꠞ꠆ꠐꠤꠚꠤꠇꠦꠡꠘ ꠅꠒꠤꠐ ꠡꠚꠟꠇꠞꠤ ꠢꠦꠡ july ꠡꠦꠙ꠆ꠐꠦꠝ꠆ꠛꠞ γ0l9 ꠝꠣꠔꠁ ꠡꠣꠋꠡ꠆ꠇ꠆ꠞꠤꠔꠤꠇ ꠅꠂꠔꠤꠎ꠆ꠎꠎꠞ ꠄꠉꠥ ꠚꠥꠞꠣꠝ ꠎꠣ ꠀꠞ꠆ꠎꠣꠔ ꠟꠦꠈꠣꠞ ꠖꠣꠄ ꠈꠁꠘ ꠄꠈꠡꠝꠄ ꠛꠤꠀꠘꠤꠛꠣꠎꠣꠞꠞ ꠘꠣꠝ ꠔꠣꠞꠣꠞ ꠡꠣꠁꠎ꠆ꠎ ꠡꠢꠎꠥꠉꠤ...

Context Size 2:

ꠇꠦꠟꠣꠡꠤꠚꠤꠇꠦꠡꠘ ꠟꠂꠀ ꠛꠦꠡ ꠔꠂꠔ꠆ꠔ ꠘꠣꠄ vishavan ꠝꠣꠔ ꠄꠡꠤꠀ ꠇꠦꠟꠣꠡꠤꠚꠤꠇꠦꠡꠘ ꠟꠂꠀ ꠛꠦꠡ ꠔꠂꠔ꠆ꠔ ꠘꠣꠄ haitian vodoun cultu...ꠟꠂꠀ ꠛꠦꠡ ꠔꠂꠔ꠆ꠔ ꠘꠣꠄ guaicaro ꠝꠣꠔ ꠖꠇ꠆ꠘꠞ ꠀꠝꠦꠞꠤꠇꠣ ꠜꠣꠡꠣꠛꠤꠉ꠆ꠉꠣꠘꠅ ꠢꠣꠟ ꠇꠅꠀ ꠎꠣꠄ ꠘꠣ ꠇꠤꠔꠣ gaya ꠝꠣꠔ ꠄꠡꠤꠀꠔꠂꠔ꠆ꠔ ꠘꠣꠄ kwʼadza ꠝꠣꠔ ꠀꠚ꠆ꠞꠤꠇꠣ ꠇꠥꠘꠥ ꠘꠤꠞꠖꠤꠡ꠆ꠐ ꠇꠥꠘ꠆ꠔꠣ ꠛꠣꠔꠣꠁꠟ ꠘꠣꠄ yugul ꠝꠣꠔ ꠅꠍꠤꠀꠘꠤꠀ ꠇꠥꠘꠥ ꠘꠤꠞꠖꠤꠡ꠆ꠐ ꠇꠥꠘ꠆ꠔꠣ...

Context Size 3:

ꠇꠦꠟꠣꠡꠤꠚꠤꠇꠦꠡꠘ ꠟꠂꠀ ꠛꠦꠡ ꠔꠂꠔ꠆ꠔ ꠘꠣꠄ north picene ꠝꠣꠔ ꠁꠃꠞꠥꠙ ꠇꠥꠘꠥ ꠘꠤꠞꠖꠤꠡ꠆ꠐ ꠇꠥꠘ꠆ꠔꠣ ꠛꠣꠔꠣꠁꠟ ꠘꠣꠄ jiamao ꠝꠣꠔ ꠄꠡꠤ...ꠟꠂꠀ ꠛꠦꠡ ꠔꠂꠔ꠆ꠔ ꠘꠣꠄ mangree ꠝꠣꠔ ꠀꠚ꠆ꠞꠤꠇꠣ ꠜꠣꠡꠣꠛꠤꠉ꠆ꠉꠣꠘꠅ ꠢꠣꠟ ꠇꠅꠀ ꠎꠣꠄ ꠘꠣ ꠇꠤꠔꠣ paleo european ꠝꠣꠔ ꠁꠃꠞꠥꠙ ling...ꠛꠦꠡ ꠔꠂꠔ꠆ꠔ ꠘꠣꠄ kwʼadza ꠝꠣꠔ ꠀꠚ꠆ꠞꠤꠇꠣ ꠜꠣꠡꠣꠛꠤꠉ꠆ꠉꠣꠘꠞ ꠢꠣꠟ ꠍꠣꠚ ꠘꠣꠄ karami ꠝꠣꠔ ꠅꠍꠤꠀꠘꠤꠀ ꠜꠣꠡꠣꠛꠤꠉ꠆ꠉꠣꠘꠅ ꠇꠦꠟꠣꠡꠤꠚꠤꠇ...

Context Size 4:

ꠟꠂꠀ ꠛꠦꠡ ꠔꠂꠔ꠆ꠔ ꠘꠣꠄ mangree ꠝꠣꠔ ꠀꠚ꠆ꠞꠤꠇꠣ ꠜꠣꠡꠣꠛꠤꠉ꠆ꠉꠣꠘꠅ ꠢꠣꠟ ꠇꠅꠀ ꠎꠣꠄ ꠘꠣ ꠇꠤꠔꠣ oblo ꠝꠣꠔ ꠀꠚ꠆ꠞꠤꠇꠣ ꠇꠦꠟꠣꠡꠤꠚꠤꠇꠦꠡꠘ...ꠇꠦꠟꠣꠡꠤꠚꠤꠇꠦꠡꠘ ꠟꠂꠀ ꠛꠦꠡ ꠔꠂꠔ꠆ꠔ ꠘꠣꠄ pre arawakan ꠝꠣꠔ of the greater antilles ꠃꠔ꠆ꠞꠞ ꠀꠝꠦꠞꠤꠇꠣ linguistic ꠇꠦꠟ...ꠇꠥꠘꠥ ꠘꠤꠞꠖꠤꠡ꠆ꠐ ꠇꠥꠘ꠆ꠔꠣ ꠛꠣꠔꠣꠁꠟ ꠘꠣꠄ cayuse ꠝꠣꠔ ꠃꠔ꠆ꠞꠞ ꠀꠝꠦꠞꠤꠇꠣ ꠇꠦꠟꠣꠡꠤꠚꠤꠇꠦꠡꠘ ꠟꠂꠀ ꠛꠦꠡ ꠔꠂꠔ꠆ꠔ ꠘꠣꠄ bhariati ꠄꠡꠤ...

Generated Text Samples (Subword-based)

Below are text samples generated from each subword-based Markov chain model:

Context Size 1:

_ꠎ_ꠝꠞꠣꠈꠣꠝ।"_ꠀꠍꠦꠞꠦ_(মেꠞ_ꠀꠁꠢꠣꠍꠣꠠꠣ_⁕_ꠒꠥꠎꠞꠥ_ꠔꠣ_ꠀꠎꠣꠔ_ꠀꠞ_lasher/ꠡꠦꠡ

Context Size 2:

ꠞ_(bood_iporly,_ꠛꠦ_ꠀꠟꠣꠖꠣ_ꠉꠣꠘꠞꠅꠦꠞ_ꠀꠞ_ꠀꠟ_ꠘ_ꠎꠣꠔꠘ꠆ꠔ꠆ꠞ-ꠇꠕꠣ_॥_ꠔꠣꠞꠣꠞ_

Context Size 3:

_⁕_'ꠛꠁꠅ_ꠁꠋꠟꠤꠡ:_provkꠀꠞ_ꠍꠤꠟꠐ_ꠛ꠆ꠞꠤꠐꠤꠡ_ꠎꠣꠔꠤ_ꠍꠤꠟꠐꠤ_꠨_ꠀꠘꠣꠙꠣꠄꠖꠣꠞ_(ꠙꠥꠛ_ꠜꠣꠟꠣ_ꠔꠥ

Context Size 4:

_ꠀꠞ_ꠍꠤꠟꠐ_ꠙ꠆ꠞꠌꠥꠞ_ꠙꠞꠤꠛꠦꠡꠅ__ꠅꠄ_ꠘꠣ_ꠇꠤꠔꠣ_vazimba_=__ꠍꠤꠟꠐ_ꠅꠘ꠆ꠌꠟ_ꠛꠤꠐꠤꠡ_ꠞꠣꠎ_ꠀꠍꠤ

Key Findings

- Best Predictability: Context-4 (word) with 99.2% predictability

- Branching Factor: Decreases with context size (more deterministic)

- Memory Trade-off: Larger contexts require more storage (146,673 contexts)

- Recommendation: Context-3 or Context-4 for text generation

4. Vocabulary Analysis

Statistics

| Metric | Value |

|---|---|

| Vocabulary Size | 8,518 |

| Total Tokens | 68,093 |

| Mean Frequency | 7.99 |

| Median Frequency | 3 |

| Frequency Std Dev | 28.79 |

Most Common Words

| Rank | Word | Frequency |

|---|---|---|

| 1 | ꠀꠞ | 1,780 |

| 2 | ꠅꠄ | 671 |

| 3 | ꠁ | 569 |

| 4 | ꠝꠣꠔ | 478 |

| 5 | ꠅ | 408 |

| 6 | ꠍꠤꠟꠐꠤ | 361 |

| 7 | the | 354 |

| 8 | ꠍꠤꠟꠐ | 347 |

| 9 | ꠅꠞ | 303 |

| 10 | ꠄꠉꠥ | 283 |

Least Common Words (from vocabulary)

| Rank | Word | Frequency |

|---|---|---|

| 1 | ꠟꠤꠍ꠆ꠐ | 2 |

| 2 | ꠔꠝꠤꠎ | 2 |

| 3 | ꠇꠤꠞꠘ | 2 |

| 4 | ꠍꠐꠇꠥ | 2 |

| 5 | ꠞꠢꠡ꠆ꠡ | 2 |

| 6 | ꠀꠍꠣꠝꠤ | 2 |

| 7 | ꠢꠔ꠆ꠔꠣ | 2 |

| 8 | ꠘꠤꠞ꠆ꠖꠦꠡ | 2 |

| 9 | ꠅꠎ | 2 |

| 10 | ꠌꠟꠌ꠆ꠌꠤꠔ꠆ꠞ | 2 |

Zipf's Law Analysis

| Metric | Value |

|---|---|

| Zipf Coefficient | 0.8800 |

| R² (Goodness of Fit) | 0.982770 |

| Adherence Quality | excellent |

Coverage Analysis

| Top N Words | Coverage |

|---|---|

| Top 100 | 25.5% |

| Top 1,000 | 59.3% |

| Top 5,000 | 89.5% |

| Top 10,000 | 0.0% |

Key Findings

- Zipf Compliance: R²=0.9828 indicates excellent adherence to Zipf's law

- High Frequency Dominance: Top 100 words cover 25.5% of corpus

- Long Tail: -1,482 words needed for remaining 100.0% coverage

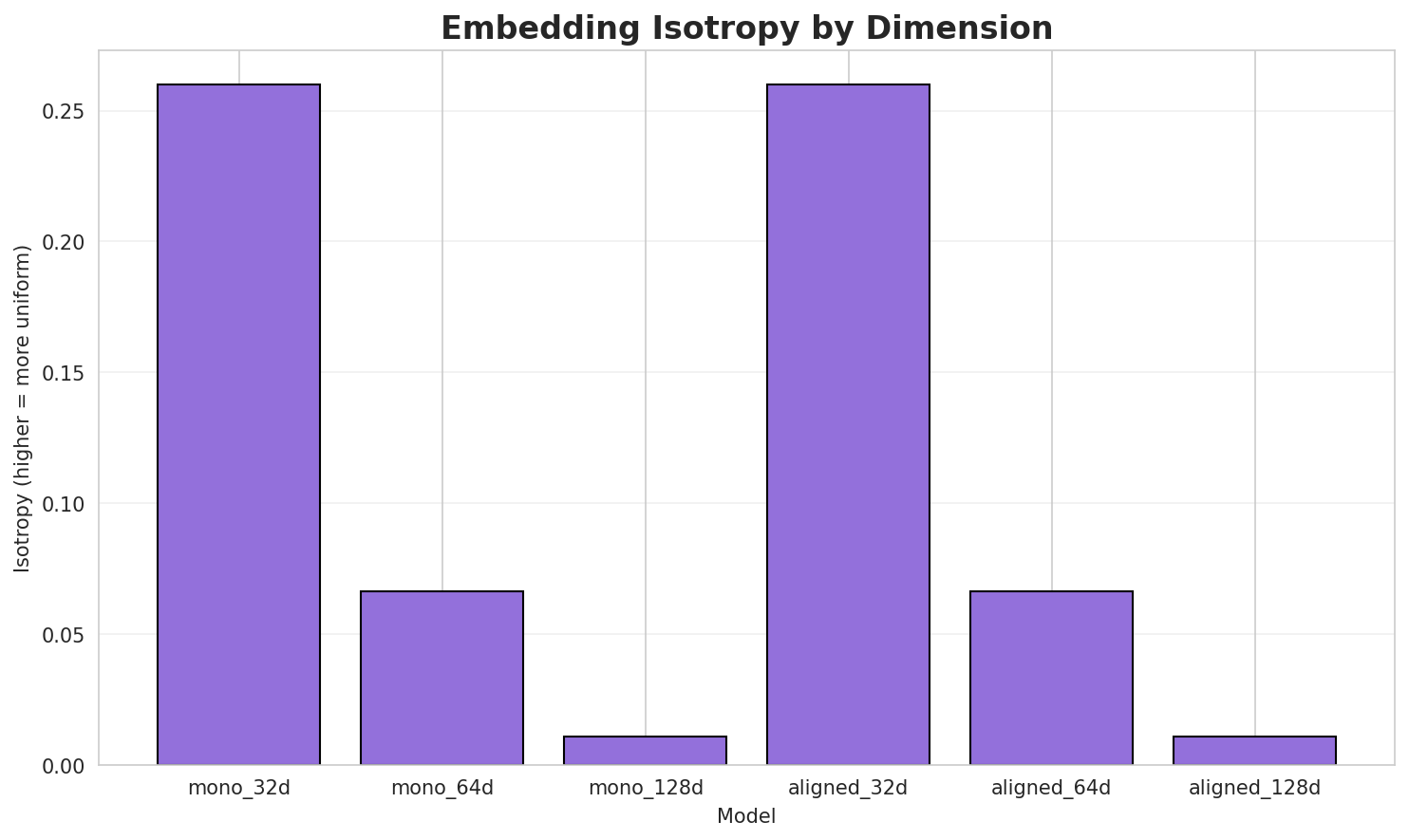

5. Word Embeddings Evaluation

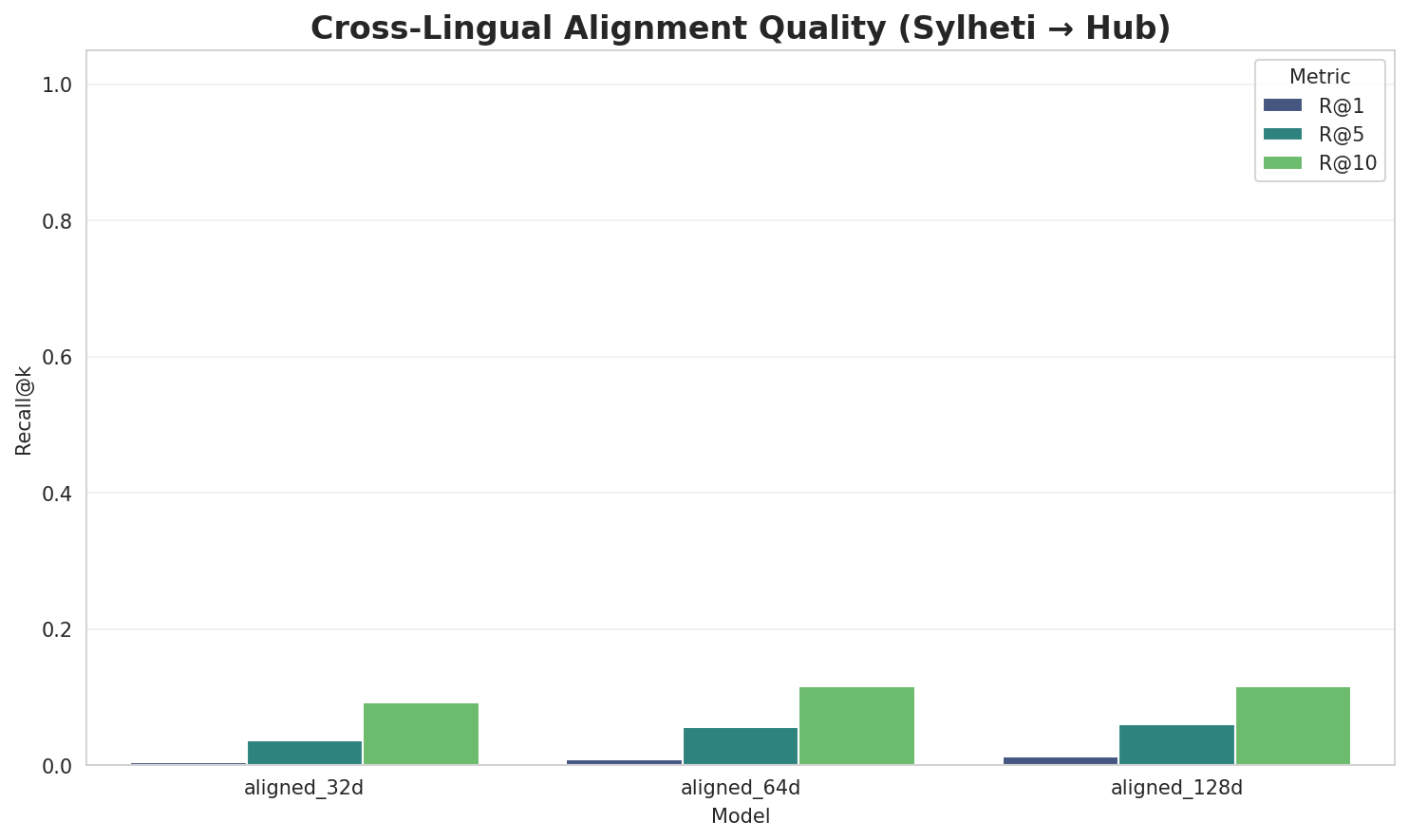

5.1 Cross-Lingual Alignment

5.2 Model Comparison

| Model | Dimension | Isotropy | Semantic Density | Alignment R@1 | Alignment R@10 |

|---|---|---|---|---|---|

| mono_32d | 32 | 0.2602 | 0.4837 | N/A | N/A |

| mono_64d | 64 | 0.0664 | 0.4652 | N/A | N/A |

| mono_128d | 128 | 0.0110 | 0.4986 | N/A | N/A |

| aligned_32d | 32 | 0.2602 🏆 | 0.4847 | 0.0040 | 0.0920 |

| aligned_64d | 64 | 0.0664 | 0.4845 | 0.0080 | 0.1160 |

| aligned_128d | 128 | 0.0110 | 0.5055 | 0.0120 | 0.1160 |

Key Findings

- Best Isotropy: aligned_32d with 0.2602 (more uniform distribution)

- Semantic Density: Average pairwise similarity of 0.4870. Lower values indicate better semantic separation.

- Alignment Quality: Aligned models achieve up to 1.2% R@1 in cross-lingual retrieval.

- Recommendation: 128d aligned for best cross-lingual performance

6. Morphological Analysis (Experimental)

This section presents an automated morphological analysis derived from the statistical divergence between word-level and subword-level models. By analyzing where subword predictability spikes and where word-level coverage fails, we can infer linguistic structures without supervised data.

6.1 Productivity & Complexity

| Metric | Value | Interpretation | Recommendation |

|---|---|---|---|

| Productivity Index | 5.000 | High morphological productivity | Reliable analysis |

| Idiomaticity Gap | 1.860 | High formulaic/idiomatic content | - |

6.2 Affix Inventory (Productive Units)

These are the most productive prefixes and suffixes identified by sampling the vocabulary for global substitutability patterns. A unit is considered an affix if stripping it leaves a valid stem that appears in other contexts.

Productive Prefixes

| Prefix | Examples |

|---|---|

-ꠛ |

ꠛꠣꠅꠝꠙꠥꠞꠤ, ꠛꠣꠠꠣꠞ, ꠛꠞ꠆ꠝꠤ |

-ꠡ |

ꠡꠤꠡꠐꠝ, ꠡꠢꠤꠖ, ꠡꠥꠛꠤꠗꠣ |

-ꠀ |

ꠀꠝꠞꠣꠞꠦ, ꠀꠡꠟ, ꠀꠞꠣꠝꠞ |

-ꠝ |

ꠝꠘꠞ, ꠝꠤꠟꠣꠁꠀ, ꠝꠤꠟ |

-ꠇ |

ꠇꠦ, ꠇꠘ꠆ꠐꠞꠟ, ꠇꠘ꠆ꠘꠣꠖꠣꠘ |

-ꠙ |

ꠙꠥꠞꠣꠘ, ꠙ꠆ꠞꠡꠣꠡꠘꠤꠇꠜꠣꠛꠦ, ꠙꠣꠁꠟꠐꠣꠁꠘ꠆ꠔꠞ |

-ꠎ |

ꠎꠂꠘ꠆ꠔꠣ, ꠎꠦꠝꠟꠣ, ꠎꠣꠖꠛꠙꠥꠞ |

-ꠚ |

ꠚꠤꠚꠣꠞ, ꠚꠥꠞꠣꠘꠣ, ꠚꠦꠍꠛꠥꠇ |

Productive Suffixes

| Suffix | Examples |

|---|---|

-ꠞ |

ꠚꠤꠚꠣꠞ, ꠝꠘꠞ, ꠗꠞꠝꠞ |

-ꠘ |

ꠙꠥꠞꠣꠘ, ꠃꠖꠎꠣꠙꠘ, ꠢꠤꠘ꠆ꠖꠥꠡ꠆ꠔꠣꠘ |

-ꠔ |

ꠙꠤꠔꠤꠛꠤꠔ, ꠎꠣꠇꠣꠔ, ꠖꠞꠉꠣꠔ |

-ꠟ |

ꠀꠡꠟ, ꠛꠟ, ꠛꠣꠟꠥꠟ |

-ꠇ |

ꠚꠦꠍꠛꠥꠇ, ꠡꠝ꠆ꠙꠞ꠆ꠇ, ꠄꠇꠣꠗꠤꠇ |

-ꠔꠞ |

ꠙꠣꠁꠟꠐꠣꠁꠘ꠆ꠔꠞ, ꠎꠦꠉꠣꠁꠘ꠆ꠔꠞ, ꠡꠢꠞꠣꠁꠘ꠆ꠔꠞ |

-ꠁꠘ |

ꠛꠤꠡ꠆ꠡꠣꠍꠤꠘꠔꠣꠁꠘ, ꠁꠍ꠆ꠙꠦꠁꠘ, ꠖꠤꠍꠁꠘ |

-ꠘꠞ |

ꠝꠘꠞ, ꠅꠛꠖꠣꠘꠞ, ꠡꠋꠉꠑꠘꠞ |

6.3 Bound Stems (Lexical Roots)

Bound stems are high-frequency subword units that are semantically cohesive but rarely appear as standalone words. These often correspond to the 'core' of a word that requires inflection or derivation to be valid.

No significant bound stems detected.

6.4 Affix Compatibility (Co-occurrence)

This table shows which prefixes and suffixes most frequently co-occur on the same stems, revealing the 'stacking' rules of the language's morphology.

| Prefix | Suffix | Frequency | Examples |

|---|---|---|---|

-ꠛ |

-ꠞ |

52 words | ꠛꠣꠠꠣꠞ, ꠛꠣꠋꠉꠟꠣꠖꠦꠡꠞ |

-ꠝ |

-ꠞ |

51 words | ꠝꠘꠞ, ꠝꠘ꠆ꠒꠟꠞ |

-ꠡ |

-ꠞ |

35 words | ꠡꠣꠢꠞꠤꠀꠞ, ꠡꠣꠢꠎꠣꠟꠣꠟꠦꠞ |

-ꠇ |

-ꠞ |

35 words | ꠇꠝ꠆ꠙꠤꠃꠐꠣꠞ, ꠇꠣꠃꠘ꠆ꠡꠤꠟꠞ |

-ꠙ |

-ꠞ |

33 words | ꠙꠣꠁꠟꠐꠣꠁꠘ꠆ꠔꠞ, ꠙꠥꠞꠥꠡ꠆ꠇꠣꠞ |

-ꠎ |

-ꠞ |

31 words | ꠎꠣꠖꠛꠙꠥꠞ, ꠎꠤꠀꠃꠞ |

-ꠀ |

-ꠞ |

23 words | ꠀꠞꠣꠝꠞ, ꠀꠝꠤꠞ |

-ꠛ |

-ꠘ |

20 words | ꠛꠤꠡ꠆ꠡꠣꠍꠤꠘꠔꠣꠁꠘ, ꠛꠣꠉꠣꠘ |

-ꠙ |

-ꠘ |

19 words | ꠙꠥꠞꠣꠘ, ꠙ꠆ꠞꠍ꠆ꠘ |

-ꠚ |

-ꠞ |

19 words | ꠚꠤꠚꠣꠞ, ꠚꠟꠣꠘꠤꠞ |

6.5 Recursive Morpheme Segmentation

Using Recursive Hierarchical Substitutability, we decompose complex words into their constituent morphemes. This approach handles nested affixes (e.g., prefix-prefix-root-suffix).

| Word | Suggested Split | Confidence | Stem |

|---|---|---|---|

| ꠚꠣꠃꠘ꠆ꠒꠦꠡꠘꠞ | ꠚꠣꠃꠘ꠆ꠒꠦꠡ-ꠘ-ꠞ |

7.5 | ꠘ |

| ꠅꠡ꠆ꠐꠦꠟꠤꠀꠘ | ꠅꠡ꠆ꠐꠦꠟꠤꠀ-ꠘ |

4.5 | ꠅꠡ꠆ꠐꠦꠟꠤꠀ |

| ꠛꠣꠋꠟꠣꠖꠦꠡꠅꠞ | ꠛꠣꠋꠟꠣꠖꠦꠡꠅ-ꠞ |

4.5 | ꠛꠣꠋꠟꠣꠖꠦꠡꠅ |

| ꠝꠣꠐ꠆ꠐꠥꠝꠣꠞ | ꠝꠣꠐ꠆ꠐꠥꠝꠣ-ꠞ |

4.5 | ꠝꠣꠐ꠆ꠐꠥꠝꠣ |

| ꠝꠥꠢꠣꠝ꠆ꠝꠣꠖꠞ | ꠝꠥꠢꠣꠝ꠆ꠝꠣꠖ-ꠞ |

4.5 | ꠝꠥꠢꠣꠝ꠆ꠝꠣꠖ |

| ꠖꠤꠙꠙꠥꠘ꠆ꠎꠔ | ꠖꠤꠙꠙꠥꠘ꠆ꠎ-ꠔ |

4.5 | ꠖꠤꠙꠙꠥꠘ꠆ꠎ |

| ꠞꠛꠤꠘ꠆ꠖ꠆ꠞꠘꠣꠕꠞ | ꠞꠛꠤꠘ꠆ꠖ꠆ꠞꠘꠣꠕ-ꠞ |

4.5 | ꠞꠛꠤꠘ꠆ꠖ꠆ꠞꠘꠣꠕ |

| ꠎꠘꠡꠋꠈ꠆ꠎꠣꠞ | ꠎꠘꠡꠋꠈ꠆ꠎꠣ-ꠞ |

4.5 | ꠎꠘꠡꠋꠈ꠆ꠎꠣ |

| ꠀꠝꠥꠀꠔꠤꠢꠞꠚ | ꠀ-ꠝꠥꠀꠔꠤꠢꠞꠚ |

4.5 | ꠝꠥꠀꠔꠤꠢꠞꠚ |

| ꠚꠤꠘꠟꠦꠘ꠆ꠒꠞ | ꠚꠤꠘꠟꠦꠘ꠆ꠒ-ꠞ |

4.5 | ꠚꠤꠘꠟꠦꠘ꠆ꠒ |

| ꠌꠘ꠆ꠖꠞꠝꠥꠈꠤꠞ | ꠌꠘ꠆ꠖꠞꠝꠥꠈꠤ-ꠞ |

4.5 | ꠌꠘ꠆ꠖꠞꠝꠥꠈꠤ |

| ꠙ꠆ꠞꠔꠤꠡ꠆ꠑꠣꠘ | ꠙ꠆ꠞꠔꠤꠡ꠆ꠑꠣ-ꠘ |

4.5 | ꠙ꠆ꠞꠔꠤꠡ꠆ꠑꠣ |

| ꠙꠣꠘ꠆ꠒꠥꠟꠤꠙꠤꠞ | ꠙꠣꠘ꠆ꠒꠥꠟꠤꠙꠤ-ꠞ |

4.5 | ꠙꠣꠘ꠆ꠒꠥꠟꠤꠙꠤ |

| ꠡꠛ꠆ꠖꠣꠁꠘ꠆ꠔꠞ | ꠡꠛ꠆ꠖꠣꠁꠘ꠆ꠔ-ꠞ |

4.5 | ꠡꠛ꠆ꠖꠣꠁꠘ꠆ꠔ |

| ꠙ꠆ꠞꠔꠤꠡ꠆ꠑꠣꠞ | ꠙ꠆ꠞꠔꠤꠡ꠆ꠑꠣ-ꠞ |

4.5 | ꠙ꠆ꠞꠔꠤꠡ꠆ꠑꠣ |

6.6 Linguistic Interpretation

Automated Insight: The language Sylheti shows high morphological productivity. The subword models are significantly more efficient than word models, suggesting a rich system of affixation or compounding.

Note on Idiomaticity: The high Idiomaticity Gap suggests a large number of frequent multi-word expressions or formulaic sequences that are statistically distinct from their component parts.

7. Summary & Recommendations

Production Recommendations

| Component | Recommended | Rationale |

|---|---|---|

| Tokenizer | 32k BPE | Best compression (4.02x) |

| N-gram | 2-gram | Lowest perplexity (691) |

| Markov | Context-4 | Highest predictability (99.2%) |

| Embeddings | 100d | Balanced semantic capture and isotropy |

Appendix: Metrics Glossary & Interpretation Guide

This section provides definitions, intuitions, and guidance for interpreting the metrics used throughout this report.

Tokenizer Metrics

Compression Ratio

Definition: The ratio of characters to tokens (chars/token). Measures how efficiently the tokenizer represents text.

Intuition: Higher compression means fewer tokens needed to represent the same text, reducing sequence lengths for downstream models. A 3x compression means ~3 characters per token on average.

What to seek: Higher is generally better for efficiency, but extremely high compression may indicate overly aggressive merging that loses morphological information.

Average Token Length (Fertility)

Definition: Mean number of characters per token produced by the tokenizer.

Intuition: Reflects the granularity of tokenization. Longer tokens capture more context but may struggle with rare words; shorter tokens are more flexible but increase sequence length.

What to seek: Balance between 2-5 characters for most languages. Arabic/morphologically-rich languages may benefit from slightly longer tokens.

Unknown Token Rate (OOV Rate)

Definition: Percentage of tokens that map to the unknown/UNK token, indicating words the tokenizer cannot represent.

Intuition: Lower OOV means better vocabulary coverage. High OOV indicates the tokenizer encounters many unseen character sequences.

What to seek: Below 1% is excellent; below 5% is acceptable. BPE tokenizers typically achieve very low OOV due to subword fallback.

N-gram Model Metrics

Perplexity

Definition: Measures how "surprised" the model is by test data. Mathematically: 2^(cross-entropy). Lower values indicate better prediction.

Intuition: If perplexity is 100, the model is as uncertain as if choosing uniformly among 100 options at each step. A perplexity of 10 means effectively choosing among 10 equally likely options.

What to seek: Lower is better. Perplexity decreases with larger n-grams (more context). Values vary widely by language and corpus size.

Entropy

Definition: Average information content (in bits) needed to encode the next token given the context. Related to perplexity: perplexity = 2^entropy.

Intuition: High entropy means high uncertainty/randomness; low entropy means predictable patterns. Natural language typically has entropy between 1-4 bits per character.

What to seek: Lower entropy indicates more predictable text patterns. Entropy should decrease as n-gram size increases.

Coverage (Top-K)

Definition: Percentage of corpus occurrences explained by the top K most frequent n-grams.

Intuition: High coverage with few patterns indicates repetitive/formulaic text; low coverage suggests diverse vocabulary usage.

What to seek: Depends on use case. For language modeling, moderate coverage (40-60% with top-1000) is typical for natural text.

Markov Chain Metrics

Average Entropy

Definition: Mean entropy across all contexts, measuring average uncertainty in next-word prediction.

Intuition: Lower entropy means the model is more confident about what comes next. Context-1 has high entropy (many possible next words); Context-4 has low entropy (few likely continuations).

What to seek: Decreasing entropy with larger context sizes. Very low entropy (<0.1) indicates highly deterministic transitions.

Branching Factor

Definition: Average number of unique next tokens observed for each context.

Intuition: High branching = many possible continuations (flexible but uncertain); low branching = few options (predictable but potentially repetitive).

What to seek: Branching factor should decrease with context size. Values near 1.0 indicate nearly deterministic chains.

Predictability

Definition: Derived metric: (1 - normalized_entropy) × 100%. Indicates how deterministic the model's predictions are.

Intuition: 100% predictability means the next word is always certain; 0% means completely random. Real text falls between these extremes.

What to seek: Higher predictability for text generation quality, but too high (>98%) may produce repetitive output.

Vocabulary & Zipf's Law Metrics

Zipf's Coefficient

Definition: The slope of the log-log plot of word frequency vs. rank. Zipf's law predicts this should be approximately -1.

Intuition: A coefficient near -1 indicates the corpus follows natural language patterns where a few words are very common and most words are rare.

What to seek: Values between -0.8 and -1.2 indicate healthy natural language distribution. Deviations may suggest domain-specific or artificial text.

R² (Coefficient of Determination)

Definition: Measures how well the linear fit explains the frequency-rank relationship. Ranges from 0 to 1.

Intuition: R² near 1.0 means the data closely follows Zipf's law; lower values indicate deviation from expected word frequency patterns.

What to seek: R² > 0.95 is excellent; > 0.99 indicates near-perfect Zipf adherence typical of large natural corpora.

Vocabulary Coverage

Definition: Cumulative percentage of corpus tokens accounted for by the top N words.

Intuition: Shows how concentrated word usage is. If top-100 words cover 50% of text, the corpus relies heavily on common words.

What to seek: Top-100 covering 30-50% is typical. Higher coverage indicates more repetitive text; lower suggests richer vocabulary.

Word Embedding Metrics

Isotropy

Definition: Measures how uniformly distributed vectors are in the embedding space. Computed as the ratio of minimum to maximum singular values.

Intuition: High isotropy (near 1.0) means vectors spread evenly in all directions; low isotropy means vectors cluster in certain directions, reducing expressiveness.

What to seek: Higher isotropy generally indicates better-quality embeddings. Values > 0.1 are reasonable; > 0.3 is good. Lower-dimensional embeddings tend to have higher isotropy.

Average Norm

Definition: Mean magnitude (L2 norm) of word vectors in the embedding space.

Intuition: Indicates the typical "length" of vectors. Consistent norms suggest stable training; high variance may indicate some words are undertrained.

What to seek: Relatively consistent norms across models. The absolute value matters less than consistency (low std deviation).

Cosine Similarity

Definition: Measures angular similarity between vectors, ranging from -1 (opposite) to 1 (identical direction).

Intuition: Words with similar meanings should have high cosine similarity. This is the standard metric for semantic relatedness in embeddings.

What to seek: Semantically related words should score > 0.5; unrelated words should be near 0. Synonyms often score > 0.7.

t-SNE Visualization

Definition: t-Distributed Stochastic Neighbor Embedding - a dimensionality reduction technique that preserves local structure for visualization.

Intuition: Clusters in t-SNE plots indicate groups of semantically related words. Spread indicates vocabulary diversity; tight clusters suggest semantic coherence.

What to seek: Meaningful clusters (e.g., numbers together, verbs together). Avoid over-interpreting distances - t-SNE preserves local, not global, structure.

General Interpretation Guidelines

- Compare within model families: Metrics are most meaningful when comparing models of the same type (e.g., 8k vs 64k tokenizer).

- Consider trade-offs: Better performance on one metric often comes at the cost of another (e.g., compression vs. OOV rate).

- Context matters: Optimal values depend on downstream tasks. Text generation may prioritize different metrics than classification.

- Corpus influence: All metrics are influenced by corpus characteristics. Wikipedia text differs from social media or literature.

- Language-specific patterns: Morphologically rich languages (like Arabic) may show different optimal ranges than analytic languages.

Visualizations Index

| Visualization | Description |

|---|---|

| Tokenizer Compression | Compression ratios by vocabulary size |

| Tokenizer Fertility | Average token length by vocabulary |

| Tokenizer OOV | Unknown token rates |

| Tokenizer Total Tokens | Total tokens by vocabulary |

| N-gram Perplexity | Perplexity by n-gram size |

| N-gram Entropy | Entropy by n-gram size |

| N-gram Coverage | Top pattern coverage |

| N-gram Unique | Unique n-gram counts |

| Markov Entropy | Entropy by context size |

| Markov Branching | Branching factor by context |

| Markov Contexts | Unique context counts |

| Zipf's Law | Frequency-rank distribution with fit |

| Vocab Frequency | Word frequency distribution |

| Top 20 Words | Most frequent words |

| Vocab Coverage | Cumulative coverage curve |

| Embedding Isotropy | Vector space uniformity |

| Embedding Norms | Vector magnitude distribution |

| Embedding Similarity | Word similarity heatmap |

| Nearest Neighbors | Similar words for key terms |

| t-SNE Words | 2D word embedding visualization |

| t-SNE Sentences | 2D sentence embedding visualization |

| Position Encoding | Encoding method comparison |

| Model Sizes | Storage requirements |

| Performance Dashboard | Comprehensive performance overview |

About This Project

Data Source

Models trained on wikipedia-monthly - a monthly snapshot of Wikipedia articles across 300+ languages.

Project

A project by Wikilangs - Open-source NLP models for every Wikipedia language.

Maintainer

Citation

If you use these models in your research, please cite:

@misc{wikilangs2025,

author = {Kamali, Omar},

title = {Wikilangs: Open NLP Models for Wikipedia Languages},

year = {2025},

doi = {10.5281/zenodo.18073153},

publisher = {Zenodo},

url = {https://huggingface.co/wikilangs}

institution = {Omneity Labs}

}

License

MIT License - Free for academic and commercial use.

Links

- 🌐 Website: wikilangs.org

- 🤗 Models: huggingface.co/wikilangs

- 📊 Data: wikipedia-monthly

- 👤 Author: Omar Kamali

- 🤝 Sponsor: Featherless AI

Generated by Wikilangs Models Pipeline

Report Date: 2026-01-10 23:59:58