_id stringlengths 1 6 | text stringlengths 0 7.5k | title stringlengths 0 167 |

|---|---|---|

50270 | من پیشنهاد مطالعه برای پایان نامه دارم. مقاله دارای 1 متغیر وابسته و 4 متغیر مستقل است. متغیرها همه در یک دوره 4 ساله اندازه گیری می شوند. داده ها کمی، داده های نسبتی هستند. چه تجزیه و تحلیل آماری را می توان اجرا کرد که از چنین نمونه کوچکی استفاده می کند. من چندین پاسخ متفاوت از مربیانم دریافت کرده ام، اما نه یکسان، و با استدلال های متفاوت برای هر کدام. هر گونه توصیه در اینجا بسیار قدردانی خواهد شد. | همبستگی یا تحلیل رگرسیون |

24380 | من داده هایی دارم که به نظر می رسد:  سعی کردم توزیع نرمال را اعمال کنم (تخمین چگالی هسته بهتر کار می کند، اما من به چنین دقت بالایی نیاز ندارم ) روی آن و کاملاً خوب کار می کند. نمودار چگالی یک بیضی ایجاد می کند. من باید تابع بیضی را بگیرم تا تصمیم بگیرم آیا نقطه ای در ناحیه بیضی قرار دارد یا نه. چگونه این کار را انجام دهیم؟ کد R یا Mathematica استقبال می شود. | چگونه می توان ناحیه بیضی را از داده های توزیع شده نرمال دو متغیره بدست آورد؟ |

77350 | یک روش خوب رایج در یادگیری ماشینی این است که نرمال سازی ویژگی ها یا استانداردسازی داده های متغیرهای پیش بینی کننده را انجام دهیم، همین است، داده ها را با تفریق میانگین در مرکز قرار می دهیم و آن را با تقسیم بر واریانس (یا انحراف استاندارد نیز) عادی می کنیم. برای مهار خود و درک من، ما این کار را برای دستیابی به دو چیز اصلی انجام می دهیم: 1. از وزنه های اضافی کوچک مدل به منظور ثبات عددی خودداری کنید. 2. اطمینان از همگرایی سریع الگوریتم های بهینه سازی مانند به عنوان مثال. گرادیان مزدوج به طوری که قدر بزرگ یک بعد پیش بینی کننده w.r.t. بقیه منجر به همگرایی آهسته نمی شود. ما معمولا داده ها را به مجموعه های آموزشی، اعتبار سنجی و آزمایش تقسیم می کنیم. در ادبیات معمولاً می بینیم که برای انجام عادی سازی ویژگی، میانگین و واریانس (یا انحراف معیار) را روی کل مجموعه متغیرهای پیش بینی می گیرند. نقص بزرگی که من در اینجا می بینم این است که اگر این کار را انجام دهید، در واقع اطلاعات آینده را به متغیرهای پیش بینی کننده آموزشی، یعنی اطلاعات آینده موجود در میانگین و واریانس، وارد می کنید. بنابراین، من ویژگی عادی سازی را روی داده های آموزشی انجام می دهم و میانگین و واریانس را ذخیره می کنم. سپس نرمالسازی ویژگی را با استفاده از میانگین و واریانس آموزشی به متغیرهای پیشبین مجموعه دادههای اعتبارسنجی و آزمون اعمال میکنم. آیا این ایراد اساسی دارد؟ آیا کسی می تواند جایگزین بهتری را معرفی کند؟ | نرمال سازی ویژگی را قبل یا در اعتبار مدل انجام دهید؟ |

50272 | داده شده: 1. یک سکه با تعصب **ناشناخته** $p$ (سر). 2. یک **واقعی** کاملاً مثبت $a > 0$. مشکل: یک متغیر تصادفی برنولی با بایاس $p^{a}$ ایجاد کنید. کسی میدونه چطوری میشه اینکارو کرد؟ به عنوان مثال، وقتی $a$ یک عدد صحیح مثبت است، می توان سکه $a$ را بارها ورق زد و دید که آیا تمام نتایج Heads هستند یا خیر: اگر آنها 0 هستند، در غیر این صورت 1 صادر می شوند. مشکل در این واقعیت نهفته است که $a$ لزوما یک عدد صحیح نیست. همچنین، اگر من تعصب $p$ را می دانستم، می توانستم سکه دیگری با بایاس مورد نظر بسازم. پیشاپیش متشکرم | چگونه می توان تعداد غیرصحیح موفقیت های متوالی برنولی را تولید کرد؟ |

50186 | از ص. 277 از _R Cookbook_ : > فرض کنید من یک مدل R دارم `lm(فرمول = y ~ u + v + w)` و `Summary()` > نشان می دهد: > > > R-squared چندگانه: 0.4981، R- را تنظیم کنید مربع: 0.4402 F-statistic: > 8.603 در 3 و 26 DF، p-value: 0.0003915 > > > با استفاده از Adjusted `r-Squared` می توانم بگویم که مدل من 44.02٪ از > واریانس `y` را با 55.98 باقی مانده توضیح داده نشده توضیح می دهد. سوال: **آمار F مرتبط (با مقدار p < 0.05) به من می گوید:** 1. مدل، به طور کلی، معنی دار است (بدون در نظر گرفتن مقادیر دیگر از خلاصه) 2. مدل در توضیح واریانس 44.02% (r-squared تعدیل شده) معنی دار است. | تفسیر $R^2$، F-آمار و p-value یک مدل |

50276 | من اخیراً با اختلافی بین توابع طبقهبندی و طبقهبندی متلب برخورد کردم. بهطور پیشفرض، هر دو باید Linear DiscriminantAnalysis را انجام دهند، اما وقتی کلاسهای نامتعادل داده میشوند، نتایج بسیار متفاوتی به دست میدهند. من یک اسکریپت آزمایشی کوچک در اینجا در Gist ایجاد کرده ام که داده هایی را ایجاد می کند که نامتعادل هستند اما به راحتی قابل تفکیک هستند. من طبقه بندی کننده های خود را بر روی داده های آموزشی برای نتایج بهینه آزمایش می کنم. برای یک طبقهبندی خطی، نتیجه باید منحصربهفرد باشد، اما به نظر میرسد که اینطور نیست. | تفاوت بین Matlabs طبقه بندی و طبقه بندی توابع متمایز |

111362 | من از مجموعه دادههای زیر در برخی از مدلهای امتیازدهی اعتباری استفاده میکنم: https://archive.ics.uci.edu/ml/datasets/Statlog+(German+Credit+Data) معلمم به من گفت که بهتر است از همان دادهها استفاده کنم. برای تمام تکنیک های مختلف تنظیم کنید، اما چگونه می توانید محدودیت های مختلف را کنترل کنید؟ مجموعه داده ها از 7 متغیر عددی و 13 متغیر طبقه ای تشکیل شده است، چگونه از آن متغیرهای طبقه بندی برای جمع استفاده می کنید؟ آیا ماشین بردار پشتیبانی فقط 1 یا 0 را به عنوان ورودی قبول نمی کند؟ یا مقادیر آن بین 0 و 1 است؟ | داده های اعتباری آلمانی: شبکه عصبی، svm، رگرسیون لجستیک: متغیرهای ورودی |

50189 | من یک رگرسیون چندگانه سلسله مراتبی را برای درک ارزش پیشبینیکننده منحصربهفرد سه متغیر مادری مختلف (اختلال استرس پس از سانحه، افسردگی مادر، و کیفیت رابطه والد-کودک) در رفتار کودک پس از مواجهه با تروما (که توسط دو خرده مقیاس متفاوت رفتار برونسازی اندازهگیری میشود) اجرا کردهام. مشکلات و مشکلات رفتاری درونی). بر اساس تئوری، تصمیم گرفتم متغیرها را به ترتیب زیر وارد کنم و رگرسیون را دوبار اجرا کردم (یک بار با رفتار بیرونی به عنوان DV و یک بار با رفتار درونی به عنوان DV): 1. سن و جنس کودک 2. تعداد رویدادهای آسیب زا. تجربه کودک 3. نمره علائم PTSD مادر 4. نمره علائم افسردگی مادر 5. کیفیت رابطه والد-کودک من همچنین برخی از اصطلاحات تعاملی را در مرحله ششم وارد کردم اما آنها قابل توجه نبودند، بنابراین آنها را از مدل حذف کردم. در مدل نهایی، هم افسردگی مادر و هم کیفیت رابطه والد-کودک دارای ضرایب بتای استاندارد شده معنیداری بودند و تغییر در مجذور R نیز برای خرده مقیاسهای برونیسازی و درونیسازی معنادار بود. این به من اجازه می دهد نتیجه بگیرم که کیفیت رابطه والد-کودک به طور منحصر به فردی رفتار کودک را پس از مواجهه با تروما، کنترل سن کودک، جنس، سابقه تروما، PTSD مادر و علائم افسردگی مادر پیش بینی می کند. اما چگونه می توانم این واقعیت را تفسیر کنم که علائم افسردگی مادر پس از اضافه شدن آخرین مرحله (رابطه والد-کودک) قابل توجه است؟ (چگونه آن را به زبان انگلیسی ساده توضیح دهم؟) | تفسیر اهمیت در رگرسیون سلسله مراتبی |

50187 | من جمعیت محدودی از داده های تراکنش دارم. داده ها به زیر مجموعه های مختلفی تقسیم می شوند. زیرمجموعه ای از این تراکنش ها حسابرسی شده و مشخص شده است که یا قبول می شوند یا شکست می خورند. من می خواهم یک رگرسیون لاجیت (و سعی خواهم کرد پروبیت) انجام دهم تا در مورد تراکنش های حسابرسی نشده پیش بینی کنم. چگونه می توانم فاصله پیش بینی کل جمعیت در سطح دسته جمعی و کلی را محاسبه کنم؟ و به طور جداگانه، چگونه باید بدانم که آیا فرآیند و تعداد نمونه های انتخاب شده مناسب بوده است؟ | پیش بینی نمونه ممیزی |

64659 | در چند روز گذشته، من در حال انجام تحقیقاتی در مورد نقشه های خودسازماندهی برای یک پروژه در مدرسه بودم. من متوجه شده ام که نقشه های خود سازماندهی می توانند برای کاهش ابعاد داده های شما استفاده شوند. با این حال، من نمی دانم که چگونه این کار می کند. به عنوان مثال، فرض کنید یک شبکه 10x10 از نورون ها در یک SOM دارید و ورودی شما 25 بعدی است. بنابراین، با درک من، شما یک بردار ویژگی برای هر نورون ایجاد می کنید که 25 بعدی نیز باشد. زمانی که آموزش انجام می شود، در نهایت با 100 بردار 25 بعدی مواجه می شوید. این دقیقاً چگونه ابعاد داده ها را کاهش می دهد؟ آیا قرار است در مورد مکان نورون ها نگران باشم؟ با تشکر ویرایش: من قبلاً سؤال مربوط به کاهش ابعاد را با استفاده از نقشه خودسازماندهی خوانده ام، اما احساس نمی کنم به سؤالی که من دارم پاسخ دهد. | استفاده از نقشه های خود سازماندهی برای کاهش ابعاد |

68935 | با دانستن توزیع، \begin{array}{c c c c} & \quad &X=1\quad &X=-1\quad &X=2 \\\ &Y=1\quad &0.25\quad &0.25\quad &0 \\ \ &Y=2\quad &0\quad &0\quad &0.5 \end{array} چگونه می توان E(XY) را محاسبه کرد؟ | مقدار مورد انتظار حاصل ضرب متغیرهای تصادفی |

94582 | فرض کنید من یک مدل ترکیبی مانند این دارم: set.seed(123) require(lme4) df<-data.frame(id=rep(LETTERS[1:3],each=4), days=as.integer(rnorm( 12,100,10))، رویداد=rbinom(12,1,0.3)) df<-df[with(df,order(id,days)),] df$event[sample(1:12,3,T)]<-NA id روز رویداد 1 A 94 0 2 A 97 1 4 A 100 NA 3 A 115 NA 8 B 87 1 5 B 101 0 7 B 104 1 6 B 117 0 9 C 93 0 10 C 95 NA 12 C 103 0 11 C 112 0 fit<-glmer(event~days+(1|id), data=df, family=binomial) mm<-model.matrix(fit) (رهگیری) روزهای 1 1 94 2 1 97 8 1 87 5 1 101 7 1 104 6 1 117 9 1 93 12 1 103 11 1 112 attr(assign) [1] 0 1 آنچه که من می خواهم ماتریس مدل کامل است که شامل آنهایی است که پاسخ های گمشده دارند، یعنی dim(mm) برابر است با (12, 2). من mm<-model.matrix(fit, na.action=na.pass) را امتحان کردم، اما همچنان همان چیزی را برمی گرداند. آیا کسی اینجا می داند که چگونه آن را درک کند؟ | ماتریس مدل یک مدل ترکیبی |

28729 | من یک آمارگیر نیستم، بنابراین امیدوارم این سوال منطقی باشد. من یک EMT هستم و بیمارانی داریم که به عنوان فراموشکن شناخته می شوند. به عنوان مثال، ما یک دیابتی داریم که بیش از 100 بار در 3 سال دیده ایم. من الگوی تماس های او را بررسی کرده ام و به نظر می رسد که آنها از توزیع نمایی پیروی می کنند که برای من منطقی است. با این حال، برخی مواقع او را به صورت خوشه ای خواهیم دید. از نظر پزشکی، این نیز منطقی است. اگر تب داشته باشد، گلوکز خود را سریعتر می سوزاند و ممکن است از لامبدا پایه خود منحرف شود. من میخواهم این فرضیه را آزمایش کنم که 1) شناسایی یک بیمار جدید بهعنوان «فراموشگر» زمانی که N یک توزیع نمایی تقریبی را فراخوانی میکند، امکانپذیر است. و 2) شناسایی زمانی که یک FF ایجاد شده از خط پایه منحرف می شود (که نشان دهنده تغییراتی در وضعیت بیمار است). اساساً فکر میکنم دارم میپرسم برای گرفتن مجموعهای از دادهها و نشان دادن توزیع نمایی آن به چه آزمون آماری نیاز دارم؟ من به Fisher Exact، Chi Square و K-S نگاه کردهام. همچنین آیا راهی برای تعیین مقدار خوب برای N وجود دارد؟ در مورد من N تعداد دفعاتی است که بیمار را می بینم، بنابراین می خواهم در صورت امکان کوچک باشد، مانند کمتر از 10 تا بتوانم آنها را برای مداخلات غیر EMS در اسرع وقت علامت گذاری کنم. | اندازه نمونه برای تشخیص توزیع نمایی |

72655 | در مورد تجزیه و تحلیل های آماری خود با SPSS به راهنمایی نیاز دارم. من مجموعه داده ای از دماها را دارم که هر 30 دقیقه به صورت خودکار در سه نوع زیستگاه مختلف برای یک بازه زمانی ثبت می شوند. من می خواهم: الف) تفاوت بین این 3 نوع زیستگاه را ارزیابی کنم. ب) این 3 نوع زیستگاه را با مجموعه داده دیگری که شامل دماهای ثبت شده با دیتالوگرهایی است که برای مطالعه 9 حیوان برای یک بازه زمانی متصل شده بودند، مقایسه کنید. میشه لطفا راهنماییم کنید که چه آزمایشاتی باید انجام بدم؟ | نحوه تجزیه و تحلیل مجموعه داده های دمای محیطی |

83396 | من یک دانشمند کامپیوتر هستم، بنابراین سابقه ای در ریاضیات دارم (هر چند محدود). من در مورد توزیع پسین از اینجا http://en.wikipedia.org/wiki/Posterior_distribution می خوانم. در آنجا می گوید: احتمال پسین احتمال پارامترهای θ با توجه به شواهد X است: p(θ|x). با تابع احتمال، که احتمال شواهد با توجه به پارامترهای p(x| θ) است، در تضاد است. سوال من این است که ابتدا می توانید یک مثال بسیار ساده برای درک بهتر این مفاهیم به من ارائه دهید؟ و علاوه بر این در یادگیری ماشین، چیزی که ما می خواهیم احتمال p(Class|x) نیست؟ خیلی ممنون | معنی احتمالات پسین و احتمال |

77355 | a <- c(10,11) b <- c(2,3) کوواریانس (`C`) بین`a` و `b` = جمع ( (a-mean(a)) * (b-mean( b)) ) # برابر با cov(a,b) در این مورد به صورت n=2 کوواریانس نمونه (`Csamp`) بین`a` و `b` = sum ( (a-mean(a)) * (b-mean(b)) ) / n-1 # برابر با cov(a,b) حالا مجموع تفاوت های مربع را برای `a` = `SSa` بگوییم. این به این معنی است که واریانس (V) برای a = SSa/n و واریانس نمونه (Vsamp) SSa/n-1 است. انحراف استاندارد نمونه ('SDsamp') برای 'a' خواهد بود 'sqrt(SSa/n-1)' معادلات ضریب همبستگی همانطور که من پیدا کردم عبارتند از: (1) C / sqrt (SSa) * sqrt (SSb) # یا (2) C / SDsamp_a * SDsamp_b # (1) از sqrt(SSa) استفاده می کند، نه از V یا V samp و (2) استفاده می کند SDsamp V نیست و از Csamp استفاده نمی کند من در مورد نحوه محاسبه ضریب همبستگی («CF») و ضریب همبستگی نمونه («CFsamp») سردرگم هستم. دو فرمول بالا به نظر من یکسان نیست. آیا کسی می تواند نحوه محاسبه CF و CFsamp را توضیح دهد؟ | محاسبه ضریب همبستگی |

93754 | من اخیراً آزمایشی را با دو متغیر مستقل انجام دادهام: نوع موسیقی و نوع کلمه، که با زمان پاسخ اندازهگیری میشوند. 20 شرکت کننده من یک ANOVA اندازه گیری های مکرر یک طرفه را به همراه تست های معمولی نرمال بودن، میانگین ها و غیره انجام داده ام. آیا تست های مهم دیگری را از دست داده ام؟ پیشاپیش سپاس فراوان! | تست های مورد نیاز برای اقدامات مکرر در طرح گروه های 2*2؟ |

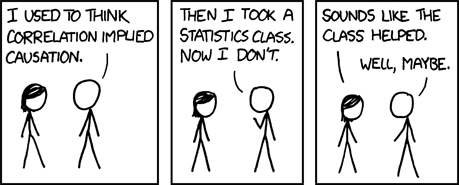

423 | این یکی از موارد مورد علاقه من است:  یک ورودی در هر پاسخ. این در رگه سوال Stack Overflow است _کارتون برنامه نویس مورد علاقه شما چیست؟_. P.S. لطفا بدون اجازه سایت کارتون را لینک نکنید. | کارتون تحلیل داده مورد علاقه شما چیست؟ |

77351 | من سعی می کنم کنتراست های متعامد سفارشی را برای طراحی با اندازه گیری های مکرر با استفاده از R تنظیم کنم. آیا می توان کنتراست ها را فقط برای یک عامل تنظیم کرد؟ مدل به این شکل است: lme(percent.diff.mean ~ factor1*factor2*factor3, random = ~ 1|id/factor1/factor2/factor3, data=data, method=ML) Factor2 و factor3 هر دو دارای 2 سطح هستند. . فاکتور 1 دارای 4 سطح است و منطقی است که آن را به دو تضاد تقسیم کنیم: اول، سطوح 1 و 2 با 3 و 4 مقایسه می شوند. <- c(-1، -1، 1، 1) Level1Vs2 <- c(-1، 1، 0، 0) کنتراست (data$factor1) <- cbind(Level1and2Vs3and4, Level1Vs2) cbind(Level1and2Vs3and4, Level1Vs2) # Level1and2Vs3and4 Level1Vs2 # [1,] -1 -1 # [2,] -1 1 # [0 #4, ,] 1 0 آیا باید برای آن تضاد ایجاد کرد عوامل دیگر نیز؟ اگر چنین است، چگونه می توان آنها را متعامد کرد، در حالی که فاکتور 1 و 2 فقط دو سطح دارند؟ با تشکر فراوان | کنتراست برای یک عامل در ANOVA با اندازه گیری های مکرر |

83703 | من تعدادی مجموعه داده سری زمانی دارم. به طور خاص هر مجموعه از سری های زمانی با یک موضوع مطالعه مرتبط است. هر سری مساحت بین آکوردهای صوتی را در یک دوره تنفس (به طور متوسط بیش از 10 تنفس) اندازه گیری می کند. سری ها برای هر بیمار تحت دوزهای مختلف یک دارو ثبت می شود. من میخواهم برای هر موضوع، منحنیهای تولید شده تحت هر دوز دارو را به صورت کمی مقایسه کنم تا ببینم چقدر شبیه هستند. با بازرسی بصری به نظر می رسد که نمودارها بسیار شبیه هستند، با این حال مقیاس تا حدودی متفاوت است، بنابراین من می خواهم در صورت امکان مقیاس را نادیده بگیرم. من تاکنون آمار خود را در R و Ruby انجام داده ام، با این حال پایتون نیز خوب است. | مقایسه شکل دادههای سری زمانی با نادیده گرفتن مقیاس |

35467 | اگر این پاسخ قبلاً در جایی در این سایت وجود دارد، مرا ببخشید، اما پس از جستجوی گسترده چیزی برای کمک به من پیدا نکردم. در اینجا مروری کوتاه بر این آزمایش است: * من 18 مخزن دارم که هر کدام به 4 قسمت تقسیم شده اند، هر بخش دارای گونه های متفاوتی از گیاهان تالاب است. تانک کل فاکتور طرح من است. تنوع، یا گونه (spp)، عامل تقسیم من است. * من 2 درمان دارم، هر کدام در سه سطح. افزودن ماده مغذی (مهره) و برش (گیره) * من انتشار متان (ch4) را به عنوان متغیر پاسخ خود اندازه میگیرم. من متان را در 2 نوبت اندازهگیری کردم که با متغیر t برای زمان نشان داده شد. **ساختار داده** >str(ch4data) 'data.frame': 144 obs. از 6 متغیر: مخزن $: فاکتور w/ 18 سطح 1، 2، 3، 4،...: 1 1 1 1 2 2 2 3 3 ... $ spp : Factor w/ 4 سطح Emac،Ewal،..: 4 2 3 1 3 4 1 2 1 4 ... $ nut : Factor w/ 3 level 1، 2، 3: 2 2 2 2 1 1 1 1 3 3 ... $ کلیپ: فاکتور w/ 3 سطح a، b، c: 3 3 3 3 2 2 2 2 2 2 ... $ t: فاکتور w/ 2 سطح 1،2: 1 1 1 1 1 1 1 1 1 1 ... $ ch4 : num 0.382 1.642 1.529 0.245 11.482 ... **Model** ch4.model=lme(fixed = ch4 ~ spp + nut + clip + t + spp*nut + spp*clip + spp*t + nut*clip + nut* t + clip*t + spp*nut*clip + spp*nut*clip*t + (nut*clip)%in%tank, random= ~1|tank, data=ch4data) این خطای زیر را خطا در MEEM(object, conLin, control$niterEM) می دهد: تکینگی در backsolve در سطح 0، بلاک 1 به طور خاص ، سوال من این است: ** چه مشکلی در تناسب مدل من وجود دارد و این خطا به چه معناست؟ ** کمک اضافی برای نصب این مدل به درستی بسیار قدردانی خواهد شد. من با R جدید هستم، بنابراین پاسخ شما باید این را در نظر بگیرد. | طرح اسپلیت پلات با اندازه گیری های مکرر در بسته (nlme) - خطاهای مدل |

93757 | من یک آزمون ضریب همبستگی را اجرا می کنم و نتایج این بود: $r = 0.382، p = 2.76 \times 10^{-13}$. بنابراین مقدار $r$ چندان چشمگیر نیست (معمولاً $r>.5$ را می بینیم)، اما مقدار $p$-value همچنان قابل توجه است. معمولاً من فکر میکنم که مقدار r$ پایین به معنای مقدار p$-p$ بالا (بدون همبستگی معنیدار) است یا برعکس ($-p$-value پایین به معنای مقدار r$ بالا است). کسی میتونه توضیح بده که این یعنی چی؟ | آزمون ضریب همبستگی پیرسون: r کم و p پایین |

2641 | صفحه ویکیپدیا ادعا میکند که احتمال و احتمال مفاهیم متفاوتی هستند. در اصطلاح غیر فنی، احتمال معمولاً مترادف احتمال است، اما در کاربرد آماری تمایز واضحی در دیدگاه وجود دارد: عددی که احتمال برخی از نتایج مشاهده شده است > با توجه به مجموعه ای از مقادیر پارامترها. به عنوان احتمال مجموعه ای از مقادیر پارامتر با توجه به نتایج مشاهده شده در نظر گرفته می شود. آیا کسی می تواند توضیح دقیق تری از معنای این موضوع بدهد؟ بهعلاوه، چند مثال از اختلاف «احتمال» و «احتمال» خوب است. | تفاوت بین احتمال و احتمال چیست؟ |

51583 | من یک رگرسیون گام به گام اجرا کردم و متوجه شدم که برخی از متغیرهای انتخاب شده هنوز در یک رگرسیون چندگانه معنادار نیستند و همه متغیرهای موجود در مدل آن متغیرها معنادار بودند. علت این امر چه می تواند باشد و شما استفاده از کدام نتایج را توصیه می کنید؟ | آیا می توان متغیری در رگرسیون چندگانه معنی دار داشت اما در رگرسیون گام به گام معنی دار نبود؟ |

79608 | من مشکل بار در مقابل ظرفیت دارم و سعی می کنم احتمال شکست را تعیین کنم. در اینجا یک مثال ساده از آنچه منظور من است. من پی دی اف های گسسته بار و ظرفیت دارم که از طریق یک سری محاسبات کامپیوتری که مقادیر ورودی مختلف را تجزیه و تحلیل می کردند (شبیه سازی های مونت کارلو برای رفع عدم قطعیت ها) تعیین شدند. شکل های زیر یک نسخه ساده شده از خروجی است:   همانطور که می بینید، مقداری همپوشانی بین این دو وجود دارد. من سعی می کنم احتمال خرابی سیستم را تعیین کنم (یعنی بار بیش از ظرفیت). آیا این به سادگی ادغام ناحیه همپوشانی سی دی اف های تجربی و ضرب کردن است، یا من به دنبال چیزی پیچیده تر، مانند ضریب Bhattacharyya هستم؟ پیشاپیش از هر راهنمایی متشکرم! | احتمال همپوشانی توزیع های تجربی |

113388 | من یک مدل لجستیک سلسله مراتبی بیزی را با یک رهگیری تصادفی منطبق میکنم، دارای دادهها در دو سطح: افراد و بیمارستان، logit$(p_{ij})=a_{j}+\beta_{0}+\beta_{1}X_ {1i}+\cdots+\beta_{k}X_{ki}+\epsilon_{ij}$ $a_{j}\sim\text{Normal}(\hat{a}_{j},\sigma_{a})$\hat{a}_{j}=\gamma_{0}+\gamma_{ 1}G_{1j}+\cdots+\gamma_{m}G_{mj}+\epsilon_{j}$ برای معادله موضوعات من 3-5 دارم متغیرها و برای گروهی 5-8 متغیر. من 6 مدل شامل یا نه برخی از متغیرها، اضافه کردن یا عدم اضافه کردن افکت تصادفی و اضافه کردن یا عدم اضافه کردن یک مدل برای رهگیری نصب کرده ام. سوال من در مورد بررسی پیش بینی پسین است:  برای هر مدل (در تصویر، فقط مدل 6)، در رنگ مشکی نسبت 1 وجود دارد. در متغیر پاسخ y (یک متغیر وضعیت با تنها 2 مقدار ممکن 0 یا 1) برای هر مرکز است. نقاط قرمز از این موارد می آیند: 1. نمونه از $p(\beta's,a's,\sigma_{a}|y)$ پسین 2. شبیه سازی از پیشگویی خلفی $p(y^{rep}|\beta's,a's، \sigma_{a},y)$. 3. از پیشگویی پسین، من $y^{rep}_{ij}\in[0,1]$ دریافت میکنم، اما دادههای من $y$ فقط شامل 0 و 1 است. 4. اگر $y^{rep}_{ij}\geq 0.5 \rightarrow y^{rep}_{ij}=1$ other $y^{rep}_{ij}=0$. سپس برای هر مرکز $j$ بردار 0 و 1 دارم (مانند داده های اصلی $y$) و نسبت 1 ها را محاسبه می کنم و 1 نقطه قرمز به دست می آوریم، سپس 30 بار تکرار می کنم تا برای هر کدام 30 نقطه قرمز به دست بیاورم. مرکز آیا مرحله چهارم از نظر آماری صحیح است؟ اگر نه، راهی برای مقایسه از $p_{ij}$ به داده $y$ وجود دارد؟ پیشاپیش از شما متشکرم. | بررسی پیش بینی پسین در مدل لجستیک سلسله مراتبی |

83704 | من آزمایشی را برای آزمایش عملکرد یک سیستم انجام داده ام. در این آزمایش من پاسخ هایی را از مردم جمع آوری کردم. این پاسخ ها دسته بندی هستند (آنها توانستند در مقیاس 5 امتیازی انتخاب کنند). هر آزمودنی در 2 شرط شرکت کرد: در یکی برای مشاهدات در یک موقعیت ایده آل ارزیابی می کنند و در دیگری برای مشاهدات حاصل از نتایج واقعی سیستم من ارزیابی می کنند. فرضیه من این است که توزیع شرایط ایده آل به خوبی با توزیع تحت شرایط واقعی مطابقت دارد، بنابراین می خواهم نشان دهم که نتایج سیستم من به همان اندازه که در شرایط ایده آل توسط کاربران خوب درک می شود. نتایج من برای 5 امتیاز مقیاس به شرح زیر است: فرکانس های مشاهده شده (شرایط واقعی): {16، 112، 42، 308، 100} فرکانس های مورد انتظار (شرایط ایده آل): {9، 81، 53، 340، 95} من دیدم که اکثر اوقات از آزمون مجذور کای برازش با فرکانس مورد انتظار استفاده می شود که از قوانین ناشی می شود نه از مشاهدات تجربی، من در این فکر بودم که آیا: 1. رویکرد من در استفاده از آزمون مجذور کای میتواند برای هدف من خوب باشد یا ابزار بهتر دیگری وجود دارد. 2. اگر استفاده از بسامدهای تجربی داده شده توسط مشاهده همان جمعیت در شرایط دیگری اشکالی ندارد. | تست مجذور کای با فرکانس های مورد انتظار که از مشاهدات دیگری می آید |

28724 | من در حال گذراندن دوره ای در مورد استنتاج حداکثر آنتروپی (MEI) هستم، که در آن کاربرد آن برای k-Means مورد بحث قرار گرفت. من در مورد تنظیم مشکل سردرگم هستم. تا آنجا که من میدانم، هدف ما یافتن راهحلهای خوشهبندی $c(\cdot)$ با هزینه مورد انتظار کوچک $\mathbb{E}[R^{km}(c)] \le R_{max}$ است. بنابراین ما علاقه مند به نمونه برداری از توزیع $p^*(c)$ روی این راه حل ها هستیم که در آن راه حل های خوب احتمال زیاد و راه حل های بد احتمال کم دارند. برای اینکه تا حد امکان «آگنوستیک» باشیم، توزیعی را درخواست میکنیم که آنتروپی را به حداکثر میرساند، و بنابراین دریافت میکنیم: $$ p^*(c) = \arg \max_{p(c)} {H(c) } \quad \text{ s.t. } \mathbb{E}_p[R^{km}(c)] \le R_{max} $$ بدیهی است که $c(\cdot)$ متغیرهای تصادفی در این سناریو هستند. اما فضای احتمالی زیربنایی چیست؟ اگر $p^*(c')$ بزرگ باشد، نشان میدهد که $c$ راهحل خوشهبندی خوبی است، اما... **برای چه مشکلی؟** آیا این برای مجموعه داده خاصی $\mathcal{X}$ است. یا برای انواع زیادی از این مجموعه داده ها؟ در هر صورت، این یا این مجموعه داده ها در معادلات فوق کجا نقش دارند؟ **ویرایش:** امیدوارم اینجا خیلی مبهم نباشم. متأسفانه نمی توانم خودم را خیلی واضح بیان کنم زیرا موضوع را به خوبی درک نمی کنم. با این حال، ممکن است بتوانم به سوالات خاص با ابهام کمتری پاسخ دهم. | حداکثر استنتاج آنتروپی برای خوشهبندی k-means |

94583 | من یک مجموعه داده دارم که بسیار بزرگ است. صفات (ستون ها) چند هزار است. برخی پراکنده هستند برخی دیگر نیستند. برخی ترتیبی، برخی دیگر فاصله ای، اسمی یا نسبتی هستند. اندازه ردیف 10 ثانیه از میلیون ها ردیف است. مجموعه داده در حال تکامل است -- یعنی کسب و کار مطمئن نیست که در نهایت کدام ردیف ها باید در مجموعه قرار گیرند -- بنابراین آنها در حال توسعه معیارهای خود هستند -- به این معنی که یک رکورد می تواند امروز در داده ها باشد -- نه در فردا و روز بعد دوباره -- این یک کار در حال پیشرفت است. من به داده ها از طریق یک اتصال محدود دسترسی دارم -- محدود به عنوان ابزارهای محدودی که می توانم استفاده کنم، قدرت محاسباتی محدود، زمان محدود و غیره. اولین مشکل من این است که می خواهم بتوانم برای هر ستون تخمین بزنم: 1. چند عدد رکوردها فیلد را پر کرده یا نه (بنابراین خالی یا پر شده) 2. و سپس سعی کنید مقدار فیلد را تخمین بزنید. چیزی که من به آن فکر می کنم استخراج زیر مجموعه های داده با استفاده از نمونه گیری مجدد و سپس تخمین تعداد است (مورد 1). آیا فرمولی وجود دارد که به من کمک کند بفهمم چند نمونه باید بگیرم و شمارش ها چه اطمینانی خواهند داشت؟ با تشکر | استفاده از Resampling برای درک یک جدول بزرگ |

32805 | در مقاله هانسن و سئو در مورد آزمایش هم انباشتگی آستانه دو رژیم در VECM (J. Econometrics، 2002؛ 110:293)، نویسندگان آزمونی را بر اساس ضریب لاگرانژ برای آزمایش آستانه در مدل پیشنهاد کردند. با این حال، به طور ناگهانی مدل نشان دهنده هتروسکداستیکی است. چرا مدل ناهمگونی را نشان می دهد؟ | آزمایش هم انباشتگی آستانه در مدل های تصحیح خطای برداری |

28726 | این مقاله از فرم زیر آزمون مجذور کای استفاده میکند: $\chi^2=\sum\limits_{i}\frac{(m_i-n_i)^2}{m_i+n_i}$ که $m_i$ عدد است تعداد bin $i$ در **هیستوگرام مدلسازیشده** و $n_i$ معادل برای **هیستوگرام مشاهدهشده**. 1. چگونه می توان این فرم از آزمون $\chi^2$ را بدست آورد؟ 2. آیا این یک آمار ناپارامتریک است یا من توزیع گاوسی داده ها را فرض می کنم؟ * * * **ویرایش**: بنابراین، بر اساس پاسخ @Michael، آیا من فرض میکنم که آمار استفاده شده در آن مقاله در واقع **اشتباه** است؟ | فرم تست $\chi^2$ |

35466 | من ANOVA اندازهگیریهای مکرری را با 2 عامل انجام دادهام: یکی درون فاکتور (زمان، قبل از مداخله) و دیگری بین فاکتور («درمان»، دو گروه). من متغیرهای وابسته مختلفی را اندازه گیری کرده ام. من در همه موارد اثر عامل درونی، اثر عامل بین، و فقط در برخی موارد تعامل بین هر دو را میبینم. من می خواهم بدانم چگونه این نتایج را تفسیر کنم. * تعامل به چه معناست؟ * آیا اهمیت عامل «درمان» (بین) کافی است تا بتوان گفت یک گروه بر گروه دیگر برتری دارد و یک درمان بهتر است؟ ویرایش: اقداماتی که من در سه لحظه انجام دادم عبارتند از: زمان صرف شده برای استفاده از فناوری ها، فراوانی استفاده، سوء استفاده.. تعامل قابل توجه برای درون عامل (لحظه) X بین عامل (گروه) است، اما فقط برای زمان صرف شده برای استفاده از فناوری ها مهم است. . معنی بین فاکتور چیست؟ چرا تعامل مهم است؟ با تشکر * * * اقداماتی که در سه لحظه انجام دادم عبارتند از: زمان صرف شده برای استفاده از فناوری ها، فراوانی استفاده، سوء استفاده. با استفاده از فناوری ها معنی بین فاکتور چیست؟ چرا تعامل مهم است؟ با تشکر | ANOVA اندازه گیری های مکرر در داخل و بین عوامل |

72653 | سلام من با R و آمار تازه کار هستم و به مدل های خطی عادت دارم. میشه لطفا در مورد خروجی توضیح بدید؟ من از آن برای ایجاد منحنی رشد استفاده کردم. فرمول: طول ~ a * (1 - exp(-c * est_age)) پارامترها: Estimate Std. خطای t مقدار Pr(>|t|) a 1.097e+03 1.026e+01 106.966 < 2e-16 *** c 1.539e-01 1.982e-02 7.765 2.33e-09 *** --- Signif. کدها: 0 «***» 0.001 «**» 0.01 «*» 0.05 «.» 0.1 «» 1 خطای استاندارد باقیمانده: 41.74 در 38 درجه آزادی تعداد تکرار برای همگرایی: 6 تحمل همگرایی به دست آمده: 7.32e-7.32e | خطای استاندارد باقیمانده ها برای یک مدل غیر خطی |

72654 | من سعی می کنم یک متغیر پاسخ را در رگرسیون خطی پیش بینی کنم که باید همیشه مثبت باشد (هزینه هر کلیک). یک مقدار پولی است. در ادوردز، شما برای کلیک روی تبلیغات خود به گوگل پول پرداخت می کنید، و عدد منفی به این معنی است که گوگل زمانی که مردم کلیک می کنند به شما پول می دهد :P پیش بینی ها همه مقادیر پیوسته هستند. Rsquared و RMSE در مقایسه با مدلهای دیگر مناسب هستند، حتی خارج از نمونه: RMSE Rsquared 1.4141477 0.8207303 من نمیتوانم پیشبینیها را تغییر مقیاس دهم، زیرا پول است، بنابراین حتی یک فاکتور تغییر مقیاس کوچک میتواند هزینهها را به طور قابل توجهی تغییر دهد. تا آنجا که من متوجه شدم، برای مدل رگرسیون هیچ چیز خاصی در مورد اعداد صفر و منفی وجود ندارد، بنابراین بدون توجه به اینکه خروجی تا حدی منفی باشد، بهترین ابر صفحه رگرسیون را پیدا می کند. این اولین تلاش است، با استفاده از همه متغیرهایی که دارم. بنابراین جا برای اصلاح وجود دارد. آیا راهی وجود دارد که به مدل بگوییم خروجی نمی تواند منفی باشد؟ | مقادیر منفی در پیش بینی یک متغیر پاسخ همیشه مثبت در رگرسیون خطی |

93752 | اجازه دهید $X_1$ و $X_2$ دو متغیر عادی مستقل با میانگین $\theta$ و واریانس $1$ باشند. اجازه دهید $S=X_1+X_2$ و احتمال شرطی زیر را در نظر بگیرید: $$P \left[ X_1 \leq x_1; X_2 \leq x_2 |S=s \right]$$ اگر فرض کنیم که $x_1 \leq x_2$ و $x_2 \leq s$، پس چرا این احتمال شرطی برابر با صفر است؟ من به سختی متوجه عدم امکان اینجا شده ام. با تشکر | احتمال شرطی برابر با صفر است |

32809 | من یک مدل لاجیت ایجاد کرده ام تا در شش مجموعه مختلف از داده های مقطعی اعمال شود. همه مدل ها دارای متغیرهای مستقل یکسانی هستند اما حجم نمونه برای هر مدل متفاوت است. چیزی که من سعی می کنم آن را آزمایش کنم تأثیر هر متغیر مستقل بر متغیر وابسته در تمام مدل ها است، مثلاً درآمد در مدل 1 در مقابل درآمد در مدل 2 در مقابل درآمد مدل 3 و غیره. من از نسبت شانس مشاهده کرده ام. که این متغیرها برای دسته ها و مناطق مختلف خانوار تأثیر متفاوتی بر متغیر وابسته دارند. سوال من این است: چگونه از نظر آماری این تغییر را آزمایش کنم؟ **به روز رسانی:** اطلاعات بیشتر در مورد سوال من: من سعی می کنم به اثرات IV ها بر DV در سطوح مختلف تفکیک شده نگاه کنم. مدلها عبارتند از: $$ y_1 = \beta_{01} + \beta_{11}x_1 + \beta_{21}x_2 + \beta_{31}x_3 + ... \\\ y_2 = \beta_{02} + \ beta_{12}x_1 + \beta_{22}x_2 + \beta_{32}x_3 + ... \\\ y_3 = \beta_{03} + \beta_{13}x_1 + \beta_{23}x_2 + \beta_{33}x_3 + ... \\\ y_4 = \beta_{04} + \beta_{14}x_1 + \beta_ {24}x_2 + \beta_{34}x_3 + ... \\\ y_5 = \beta_{05} + \beta_{15}x_1 + \beta_{25}x_2 + \beta_{35}x_3 + ... \\\ y_6 = \beta_{06} + \beta_{16}x_1 + \beta_{26}x_2 + \beta_{36}x_3 + ... $$ سؤال این است که آیا می توانم آزمایش کنم که آیا $\beta_{11}$ از نظر آماری با $\beta_{12}، \beta_{13} متفاوت است، \beta_{14}، \beta_{15}، \text{ و }\beta_{16}$ و غیره؟ | مقایسه ضرایب لجستیک در مدل های مختلف لاجیت؟ |

100808 | من در حال ساخت یک مدل غیر خطی با هدف توصیف فرآیند مکانیکی تخصیص منابع هستم. چندین اصطلاح وجود دارد و چیزی که مدل را غیر خطی می کند رقابت بین خطوطی است که جفت به جفت روبروی یکدیگر قرار دارند. من اهمیت عبارات را از طریق مقایسه AIC آزمایش کردم، اصطلاحات غیر مهم را حذف کردم (این واقعاً سلسله مراتبی نیست، من مجموعه بزرگی از مسیرها را بررسی کردم). من این احساس را دارم که گاهی اوقات، حذف یک عبارت می تواند مقدار پارامترها را برای سایر عبارات تغییر زیادی دهد، به طوری که به نظر می رسد مقادیر پارامترها کاملاً به یکدیگر وابسته هستند. من 2 سوال دارم: 1. چگونه می توانم به طور رسمی ارزیابی کنم که آیا این درست است (که مقادیر پارامتر هنگام حذف عبارت ها بسیار تغییر می کند)؟ لطفا توجه داشته باشید که من تعداد زیادی پارامتر دارم، بنابراین مقایسه یک به یک آنها بسیار دشوار است. 2-اگر درست است به دلیل ذاتی بودن مدل غیرخطی است یا به تعبیر من به نوعی همخطی بودن آن است؟ خطای استاندارد بسیار کوچک است، اما هنگام مقایسه فواصل اطمینان پارامترها برای دو مدل که تنها با یک جمله متفاوت هستند، این CI اصلاً همپوشانی ندارند. با تشکر | استحکام مدل غیر خطی |

16390 | مدتی است که با خوشحالی از مدل های جلوه های ترکیبی با داده های طولی استفاده می کنم. ای کاش میتوانستم روابط AR را در lmer جا بدهم (فکر میکنم درست میگویم که نمیتوانم این کار را انجام دهم؟) اما فکر نمیکنم که خیلی مهم باشد، بنابراین زیاد نگران نباشم. من به تازگی با معادلات برآورد تعمیم یافته (GEE) مواجه شده ام و به نظر می رسد که آنها انعطاف پذیری بسیار بیشتری نسبت به مدل های ME ارائه می دهند. در خطر پرسیدن یک سوال بیش از حد کلی، آیا توصیه ای وجود دارد که کدام یک برای وظایف مختلف بهتر است؟ من برخی از مقالات را دیده ام که آنها را با هم مقایسه می کنند، و آنها به این شکل هستند: در این زمینه بسیار تخصصی، از GEE برای X استفاده نکنید، از مدل های ME برای Y استفاده نکنید. من هیچ توصیه کلی بیشتری پیدا نکردم. کسی میتونه منو روشن کنه؟ متشکرم! | چه زمانی از معادلات تخمین تعمیم یافته در مقابل مدل های اثرات مختلط استفاده کنیم؟ |

23811 | من به دنبال یک سیستم نرم افزاری خوب برای آموزش طراحی سطوح پاسخ به دانش آموزان هستم. چیزهایی که می توانم به آن فکر کنم SAS Proc RSReg یا SAS ADX هستند. نرم افزار دیگه ای هست؟ | سیستم نرم افزاری آماری خوب برای آموزش طراحی سطح پاسخ؟ |

35461 | من توزیع اندازه درختان را در شش جفت کرت با هم مقایسه میکنم که در آن یک قطعه تیمار و دیگری شاهد بود. با استفاده از آزمون کولموگروف-اسمیرنوف در هر جفت نمودار، متوجه شدم که $p$ از 0.0003707$ تا 0.75$ متغیر است. آیا روشهای مناسبی برای مقابله با همه تکرارها وجود دارد، مانند توسعه چند نمونهای از آزمون KS، یا یک آزمایش پیگیری مناسب وجود دارد؟ یا باید چیزی شبیه به این نتیجه بگیرم که توزیع اندازه به طور قابل توجهی متفاوت است $(p < 0.05$) در 2 جفت نمودار و در حاشیه ($p = 0.59$) در یک جفت نمودار. | آیا نسخه چند نمونه ای یا جایگزینی برای آزمون کولموگروف-اسمیرنوف وجود دارد؟ |

51588 | ** من یک سوال در مورد یک مشکل طبقه بندی بسیار اساسی دارم. ** هدف تمایز قائل شدن بین ویژگی A و B است. جایی که A یک نمونه بیولوژیکی خاص است و B همه موارد دیگر. و هدف طبقه بندی نمونه های ناشناخته جدید است. برای انجام این کار، من 12 متغیر با داده های باینری دارم که نشان دهنده وجود یا عدم وجود صفات خاص است. به عنوان مثال: 6 (3 شناخته شده A و 3 شناخته شده B) نمونه با 4 متغیر. ویژگی Var1. Var2. Var3. Var4. Sample1 *A* 1 1 1 1 Sample2 *A* 1 0 1 1 Sample3 *A* 0 1 1 0 Sample4 *B* 1 0 0 0 Sample5 *B* 0 0 1 0 sample6 *B* 0 1 1 0 چه نوع آیا می توانم از الگوریتم طبقه بندی برای پیش بینی یک نمونه ناشناخته جدید استفاده کنم؟ | طبقه بندی نمونه های بیولوژیکی با متغیرهای دوتایی |

28721 | من نمی توانم $X$ را در یک توزیع معمولی قرار دهم، بنابراین در حال حاضر فقط $X \sim \text{ecdf(sample_data)}$ دارم. چگونه توزیع تجربی $\sum(X_1 + ... + X_n)$ را با توجه به $n$ محاسبه کنم؟ $X_1$ تا $X_n$ iid هستند. اندازه نمونه من در حدود 6 دلار \ بار 10 ^ 7 دلار است. $n$ باید حدود 10-20 باشد. برای مثالی از کاری که انجام میدهم: فرض کنید $X$ سن یک فرد باشد. اگر من 10-20 نفر را در یک اتاق قرار دهم، توزیع مجموع ges در اتاق چگونه است؟ من سن افراد زیادی دارم و دلیلی ندارم که توزیع یک سن را با هیچ یک از توزیعهای رایج تطبیق دهم. (قبلاً در StackOverflow - پیشنهاد شده است که به اینجا منتقل شوید). | با توجه به نمونه ای از متغیرهای تصادفی و n، چگونه می توانم ecdf مجموع n Xs را پیدا کنم؟ |

107857 | من در حال ساخت مدل های رگرسیون بر روی چهار مجموعه داده متفاوت اما مرتبط هستم و در پایان، می خواهم اهمیت مدل ها را آزمایش کنم. از آنجایی که مدل های من در یک مجموعه داده متفاوت ساخته شده اند، قابل مقایسه نیستند. اما سلسله مراتبی در مجموعه داده من وجود دارد. 1) خروجی در مجموعه داده اصلی من مجموع خروجی های مجموعه داده A، B و C است. 2) مقدار ویژگی در همه مجموعه داده ها یکسان است، اما همه ویژگی ها در همه مجموعه داده ها و برخی از مجموعه داده ها وجود ندارند. فقط داشتن زیرمجموعه ای از ویژگی های مجموعه داده اصلی. 3) اتحاد ویژگی های مجموعه داده A، B، C ویژگی های مجموعه داده اصلی هستند. بنابراین، من میخواهم یک مدل رگرسیونی بر روی این مجموعه دادهها به طور جداگانه بسازم و عملکرد و اهمیت مدلها را با هم مقایسه کنم. از آنجایی که مجموعه دادهها برای هر چهار مدل دقیقاً یکسان نیستند، نمیتوانم از آمارهای استاندارد برای آزمایش اهمیت استفاده کنم. مدل هایی مانند AIC، CP-statstics،..... آیا به هر حال می توان عملکرد مدل را با هم مقایسه کرد؟ این مجموعه داده من است (من فقط دو نقطه داده اول را برای توضیح بیشتر اضافه کردم:  | چگونه می توان مدل ها را از مجموعه داده های مختلف اما مرتبط مقایسه کرد؟ |

28727 | من برخی از داده های تجربی دارم و می خواهم از یک آزمون ناپارامتریک برای تأیید نتایج خود استفاده کنم. من در حال بررسی پیش بینی پیوند در شبکه های پیچیده هستم. من یک شبکه پیچیده $N$ و یک الگوریتم/مدل $A$ دارم که ساختار را در $N$ پیدا می کند. سپس برخی از لبهها را در $N$، ابتدا $10\%$، سپس $30\%$ تا $90\%$ حذف میکنم. برای هر یک از این حالت های $N$، من از $A$ برای استنتاج ساختار، و سپس محاسبه و AUC-score استفاده می کنم. من این روش را 3 بار تکرار می کنم، بنابراین در مجموع 15 امتیاز می گیرم. حالا من یک الگوریتم جدید $A'$ را انتخاب میکنم که تغییری از $A$ است، و همان تستها را برای $A'$ انجام میدهم. من اکنون 30 امتیاز دارم، 15 برای $A$ و 15 برای $A'$. 10% 30% 50% 70% 90% A1 x x x x x A2 x x x x x A3 x x x x A'1 x x x x x A'2 x x x x x A'3 x x x x x x حالا میخواهم از یک آزمون ناپارامتریک (احتمالاً یک آزمون مجموع رتبه) برای تأیید آن استفاده کنم. $A$ در استنتاج ساختار در شبکه ها بهتر است. چگونه می توانم این کار را انجام دهم؟ من از MATLAB برای آزمایشهایم استفاده میکنم، بنابراین فراخوانی به «ranksum($x,y$)» راهحلی برای «نحوه انجام آزمایش» است. چیزی که من در اینجا به دنبال آن هستم، آرگومان های $x,y$ است و آیا مواردی وجود دارد که باید در مورد استقلال در نظر بگیرم؟ به نظر می رسد دو احتمال واضح برای ورودی وجود دارد: $$x = [A_1 (10\%)، A_2 (10\%)، A_3 (10\%)، A_1 (30\%)، \ldots، A_3 (90 \%)]$$ $$y = [A'_1 (10\%)، A'_2 (10\%)، A'_3 (10\%)، A'_1 (30\%)، \ldots، A'_3 (90\%)]$$ یا $$x = [A_1 (10\%)، A_1 (30\%)، \ldots، A_1 (90\%)، A_2 (10\%)، \ldots، A_3 (90\%)]$$$$y = [A'_1 (10\%)، A'_1 (30\%)، \ldots، A'_1 (90\%)، A'_2 (10\%)، \ldots، A'_3 (90\%)]$$ آیا هر یک از اینها درست است، و اگر فقط یکی از آنها باشد، چرا؟ | تست ناپارامتریک برای مقایسه الگوریتم های پیش بینی لینک |

64656 | من تخمین Kaplan-Meier را برای تابع بقا دارم که با استفاده از بسته بقای R به دست آوردم: data.surv <- Surv(data$days_to_event, data$event_flag) data.fit <- survfit(data.surv ~ 1, data = data ) داده ها 90 روز پس از سیگنال اولیه سانسور می شوند، بنابراین تابع بقا 90 نقطه دارد و مقدار آن در آخرین نقطه برابر است. نسبت تعداد کل غیر رویدادها در 90 روز پس از سیگنال به تعداد کل مشاهدات در مجموعه داده. این مقدار از 0 فاصله زیادی دارد زیرا سیگنال باعث می شود که رویداد به ندرت اتفاق بیفتد. آیا چنین چیزی قابل انتظار است؟ اکنون من مجموعه داده دیگری دارم که در آن هر مشاهده در گذشته سیگنال داشته است (در عرض 90 روز) اما تاکنون هیچ رویدادی وجود نداشته است. راه مناسب برای اعمال تخمین تابع بقا در داده ها برای به دست آوردن تعداد مورد انتظار رویدادها برای برخی از افق ها چیست؟ من فکر کردم $1-S(t_{current} + t_{horizon})/S(t_{current})$ برای هر مشاهده قرار است به من احتمال بدهد، سپس با جمع کردن آنها تعداد کل رویدادهای مورد انتظار از در حال حاضر به افق، اما حتی اعمال این به مجموعه داده های اصلی نتیجه بسیار کم است. به نظر می رسد اشتباهی وجود دارد اما من نمی توانم آن را پیدا کنم. آیا ممکن است به دلیل سانسور باشد (اکثر مشاهدات سانسور می شوند - اگر رویداد در 90 روز رخ ندهد، تصور می شود سیگنال توانایی خود را برای ایجاد رویداد از دست داده است)؟ با تشکر | استفاده از تخمین تابع بقای Kaplan-Meier برای بدست آوردن تعداد مورد انتظار رویدادها |

55001 | من دو بدنه آبی دارم که در طول زمان برای یک متغیر کیفیت آب نمونه برداری شدند. هر دو بدنه آبی در پاییز هر سال از 2009-2012 نمونه برداری شدند. در هر سال نمونه برداری، 5 نمونه تکراری گرفته شد (بنابراین من در مجموع 20 نمونه برای هر بدنه آبی خواهم داشت). من می خواهم این دو آب را در طول زمان مقایسه کنم تا ببینم آیا متغیر کیفیت آب در هر آب از روند مشابهی پیروی می کند یا خیر. من احساس می کنم این شبیه به یک مشکل ANCOVA است که در آن فرد می تواند شیب های مساوی را آزمایش کند. اما این مشکل کمی متفاوت است زیرا من به جای داشتن دو سری زمانی پیوسته، در هر سال 5 تکرار نمونه برای هر آب دارم. به هر حال من میپرسم اگر ANCOVA منطقی نیست، بهترین روش برای ادامه چیست؟ یکی از همکاران پیشنهاد کرد که تضادهای خطی برنامه ریزی شده ممکن است به شما کمک کند، اما من نمی دانم که چگونه می تواند برای مقایسه 2 بدنه آبی مختلف قابل استفاده باشد. | بررسی تفاوت در روندهای زمانی |

35469 | با توجه به یک هسته p.s.d $Q$، آیا می توان به حداقل رساندن/بیشینه سازی $Tr(X^TQX)$ بیش از X در چارچوب فضای بازتولید هسته هیلبرت (RKHS) نمایش داد؟ اگر نگرانی اولیه در مورد نامحدود بودن تابع ردیابی (برای بیشینه سازی) یا حل بی اهمیت صفر (به حداقل رساندن) وجود دارد. شما ممکن است محدودیت های بیش از X$ را در نظر بگیرید. به عنوان مثال، بگویید X$$ متعامد است. سعی می کنم ببینم آیا می توانم این را در چارچوب RKHS قرار دهم یا خیر. همچنین، چند تفکر پیرامون این تابع با استفاده از هنجارهای هیلبرت اشمیت به شرح زیر است: من می بینم که $TrX^TQX$ را می توان به صورت $Tr[(SX)^T(SX)]=||SX||^2_ نشان داد. {HS}$، با استفاده از هنجار هیلبرت اشمیت که در آن $S$، p.s.d جذر Q است (مثلاً: $S=U\lambda^{1/2}$، که در آن $Q=U\lambda U^T$ تجزیه ویژه $Q$ است). | نمایندگی در چارچوب RKHS |

65846 | من با مشکلی روبرو هستم که در آن موقعیتی دارم که می تواند با یک مدل رگرسیون چند متغیره خطی مناسب باشد. اما، دو نوع خطای باقیمانده وجود دارد که از عدم تناسب رخ می دهد. در حال حاضر، اطلاعات $\mathbf{Y}$ من توسط منبع نویز $\mathbf{R}_{2}$ خراب نشده است، اما در آینده خواهد بود. بنابراین، من باید عدم قطعیت اضافی را در آمار آزمون خود وارد کنم. آیا این یک مدل اثرات تصادفی چند متغیره است؟ چگونه با این دو منبع واریانس برخورد کنم؟ کاری که من تا اینجا انجام دادم به شرح زیر است. من می توانم بنویسم: $\mathbf{Y} = \mathbf{X}\mathbf{B} + \mathbf{R}_{1} + \mathbf{R}_{2}$، جایی که $\mathbf{R }$ها ماتریسی از باقیمانده ها هستند، به طوری که البته $\mathbf{Y} - \mathbf{X}\mathbf{B} = \mathbf{R}_{1} + \mathbf{R}_{2} = 0$ اگر یک مدل کاملا مناسب داشته باشم. بنابراین، فرض توزیع در هر $\mathbf{R}$ $\mathbf{R} \sim N(\mathbf{0},\mathbf{I} \otimes \mathbf{\Sigma_{R}}) $ است. به جز $\mathbf{\Sigma_{R_{1}}}$ ناشناخته است در حالی که $\mathbf{\Sigma_{R_{2}}}$ شناخته شده است. با محاسبه $\mathbf{\hat{\Sigma}_{R_{1}}} = \frac{1}{n-p} میتوانم تخمینی بیطرفانه از $\mathbf{\Sigma_{R_{1}}}$ بدست بیاورم. \mathbf{Y} [\mathbf{I} - \mathbf{X}(\mathbf{X}^{'}\mathbf{X})^{-1}\mathbf{X}^{'}]\mathbf{Y}^{'}$. این عجیب به نظر می رسد، اما به این دلیل است که $\mathbf{Y}$ هنوز توسط نویز ناشی از $\mathbf{R}_{2}$ شناخته شده خراب نشده است. با این حال، وقتی آمار آزمون را بر اساس این مدل محاسبه میکنم (مثلاً فرضیه صفر: $\mathbf{B}_{1,2} = 0$ و غیره)، میخواهم این نویز آینده در نظر گرفته شود. که در آن ساختار کوواریانس آن مشخص است. آکا، من در حال حاضر ماتریس $\mathbf{\Sigma_{R_{2}}}$ را در دست دارم. بنابراین، چگونه می توانم یک ماتریس کوواریانس شناخته شده و ناشناخته را ترکیب کنم، یکی که می دانم و دیگری که به راحتی می توانم تخمین بزنم؟ ممنون از وقتی که گذاشتید | نحوه ترکیب کوواریانس شناخته شده و مجهول در یک مدل خطی |

65844 | من نتایجی از همان آزمایش دارم که روی دو نمونه مستقل اعمال شده است: x <- c(17، 12، 13، 16، 9، 19، 21، 12، 18، 17) y <- c(10، 6، 15، 9 ، 8، 11، 8، 16، 13، 7، 5، 14) و من می خواهم رتبه Wilcoxon را محاسبه کنم آزمون مجموع وقتی آمار $T_{W}$ را به صورت دستی محاسبه میکنم، وقتی به R اجازه میدهم یک «ویلکاکس» انجام دهد، به: $$ T_{W}=\sum\text{rank}(X_{i}) = 156.5 $ میرسم. test(x، y، صحیح = F)`، دریافت می کنم: W = 101.5 چرا اینطور است؟ آیا نباید آمار $W^{+}$ فقط زمانی برگردانده شود که من یک تست رتبه _signed_ با paired = T انجام دهم؟ یا من از آزمون مجموع رتبه اشتباه متوجه شدم؟ **چگونه می توانم به R بگویم خروجی $T_{W}$** * * * به عنوان بخشی از نتایج آزمایش، نه از طریق چیزی مانند: dat <- data.frame(v = c(x, y), s = factor(rep(c(x, y), c(10, 12)))) dat$r <- rank(dat$v) T.W <- sum(dat$r[dat$s == x]) * * * _من یک سوال بعدی در مورد معنی روشهای مختلف برای محاسبه آمار آزمون برای آزمون مجموع رتبه ویلکاکسون پرسیدم. | آزمون مجموع رتبه ویلکاکسون در R |

27124 | من در حال تجزیه و تحلیل آزمایشی هستم که طرح زیر را دارد: Factor1 Factor2 Level1 Level1 Level2 Level2 Level1.1 Level1.2 Level2 به عبارت دیگر، Factor2 دارای تعداد سطوح مختلف در Factor1 است. من می خواهم از رگرسیون لجستیک استفاده کنم، اما چگونه باید آن را تنظیم کنم؟ آیا اجرای دو رگرسیون با نادیده گرفتن یکی از سطوح در هر یک (مثلاً Level1.1 یا Level1.2) مشروع است؟ | چگونه می توان رگرسیون لجستیک را زمانی که یکی از عوامل دارای تعداد سطوح نابرابر در عامل دیگر است انجام داد؟ |

27120 | این یک سوال نرم است: من تکنیک های رگرسیون مختلف را بر روی مجموعه داده رگرسیونی که دارم ارزیابی کرده ام. من از این واقعیت متعجبم که RMSE اعتبار متقابل Lasso بهتر از SVM و Random Forest در مورد من است. آیا این اتفاق میافتد؟ منظورم این است که من معتقد بودم که تکنیک مدلسازی غیرخطی مانند جنگل تصادفی یا SVM بهتر از مدل خطی مانند کمند است. آیا واقعا چنین چیزی ممکن است!؟ | چرا Lasso بهتر از SVM عمل می کند؟ |

25416 | به نظر من در ادبیات این اصطلاحات مترادف به کار می روند. آیا خودهمبستگی فضایی به شدت به وابستگی خطی اشاره دارد یا خود همبستگی فضایی به مجموعه معیارهای وابستگی مکانی (i موران،...) اشاره دارد؟ آیا تعریف دقیقی از هر دو اصطلاح می دانید؟ خیلی ممنون | تفاوت بین وابستگی فضایی و همبستگی فضایی (خودکار) چیست؟ |

27127 | من یک سری مجموعه داده مرتبط دارم. همبستگی پیرسون بین جفت آنها معمولاً به طور معمول بزرگتر از همبستگی های اسپیرمن است. این نشان می دهد که هر همبستگی خطی است، اما می توان انتظار داشت که حتی اگر پیرسون و اسپیرمن یکسان باشند. وقتی شکاف مشخصی بین همبستگی پیرسون و اسپیرمن وجود دارد و پیرسون بزرگتر است به چه معناست؟ به نظر می رسد این یک ویژگی ثابت در مجموعه داده های من است. | وقتی همبستگی اسپیرمن مقدار معینی کمتر از پیرسون باشد، چه چیزی را نشان میدهد؟ |

51589 | از طریق تجزیه و تحلیل خطا متوجه شدم که یک ویژگی کاملاً مؤثر در واقع دارای اشکالاتی در اجرای آن است. تصحیح اشکالات در واقع عملکرد طبقه بندی کننده را کاهش داد. چه کار می کنی؟ اشکالات را تصحیح کنید یا آنها را رها کنید؟ | یک ویژگی باگ اما موثر؟ |

73291 | آیا انجام آزمون t غیر جفتی تنها با میانگین خلاصه از هر دو گروه مناسب است؟ به عنوان مثال، فرض کنید می خواهید مقایسه کنید: الف. نمرات استاد الف در ارزیابی دانشجویان **وی** از یک ترم تحصیلی. با ب. میانگین نمرات ارزشیابی در بین تمامی اساتید دانشگاه که توسط **همه** دانشجویان یک ترم تکمیل شده است. ارزشیابی معلم دارای 15 سوال لیکرت (مقیاس 6 درجه ای) می باشد. محدودیت ها: 1. شما نمی دانید چند دانش آموز ارزشیابی را در هر دو گروه تکمیل کردند. 2. تمام چیزی که دارید 15 میانگین نمرات برای استاد الف و 15 نمره میانگین برای نمونه کلی دانشگاه است. بی خطر است که فرض کنیم ارزیابی از نظر روانسنجی درست است. یک آزمون t غیر زوجی برای مقایسه میانگینها از گروه 1 (15 میانگین از دانشجویان پروفسور A) و گروه 2 (میانگین 15 برای همه اساتید دانشگاه) انجام میشود. بنابراین $N = 30 $. آیا این مناسب است؟ | آزمون t بدون جفت فقط با میانگین خلاصه |

51633 | من خواندم که در تجزیه و تحلیل بقا، زمانی که تابع خطر $$\lambda(t)=\underset { dt\rightarrow 0 }{lim } \frac { Pr(t\le T<t+dt|T\ge t)} { dt } =c$$ سپس وقوع رویداد **تصادفی** و مستقل (بدون حافظه) است. من می توانم مفهوم و پیامدهای افزایش یکنواخت عملکرد خطر را درک کنم. با این حال آیا نظریه یا مدرکی وجود دارد که نشان دهد وقتی $\lambda(t)=c$، رخداد تصادفی و مستقل است؟ | خطر ثابت در تجزیه و تحلیل بقا و وقوع رویداد تصادفی |

32802 | این تکلیف نیست. من یک کاربر مکرر در math.stackexchange هستم، اما کمی در مورد مدلهای سری زمانی یاد میگیرم و به این مثال برخوردم. هر ایده ای بسیار قدردانی می شود. یک مدل رگرسیون خطی با حداقل مربعات معمولی برای برخی از داده های سری زمانی برازش داشت. سپس از باقیماندههای برازش برای ایجاد دو متغیر جدید، یعنی $E$ با مقادیر $\hat{e}_2،...،\hat{e}_n$ و $E_1$ با مقادیر $\ استفاده شد. کلاه{e}_1،...،\hat{e}_{n-1}$. سپس یک رگرسیون از طریق مبدا خطی با E به عنوان متغیر وابسته و $E_1$ به عنوان پیش بینی اجرا شد. برآورد شیب 0.412 با خطای استاندارد 0.133 بود. فرض کنید $e_t$ از یک مدل استاندارد AR(1) پیروی می کند. 1. خودهمبستگی مرتبه اول $\rho$ مدل AR را تخمین بزنید. 2. آیا می توان از خروجی برای به دست آوردن یک خطای استاندارد معتبر برای برآورد در 1 استفاده کرد؟ آیا پاسخ شماره 1 در بالا فقط شیب رگرسیون 'E~E_1' است؟ | رگرسیون برای به دست آوردن اندازه گیری خود همبستگی (AR(1)) |

51584 | من در تفسیر خروجی رویه مدل مختلط در 'SPSS' مشکل دارم. من چند تاپیک پیدا کردم که با مشکلات مشابه سروکار دارد، اما هیچ کدام به من در حل آن کمک نکرد. من یک طرح متقاطع اندازه گیری مکرر 2x2 با دو عامل ثابت (دارو (A/B) و ژنوتیپ (A/B)) و یک عامل تصادفی (نقطه زمانی (1/2)) دارم. همانطور که من درک می کنم، خروجی برای اثرات ثابت تأثیر کلی عوامل بر همه زیر گروه ها است و تخمین پارامترها تفاوت بین سطوح را آزمایش می کند. از آنجایی که من فقط دو سطح برای همه عوامل مورد علاقه خود دارم، خروجی باید اطلاعاتی در مورد تفاوت بین تمام سطوح از سطحی که به عنوان خط پایه استفاده می شود، ارائه دهد. این خروجی است: اثرات ثابت نوع IIIa منبع df df F p Const 1 2,798 1753 0,000 gen*med 1 30,945 0,988 0,328 ژنوتیپ 1 31,329 4,564 0,041,041,049 دارو 0,001 a. متغیر وابسته: RT. تخمین پارامتر پارامتر est sd df t p conf. بین المللی 95 ٪ ثابت 385,695463 10,256203 4,450 37,606 0,000 358,320557 413,070370 [med=B] * [gen=A] -6,220872 8,462104 - 8,46210 -23,323140 10,881395 [med=A] * [gen=A] -19,875937 8,460116 39,989 -2,349 0,024 -36,974613 -2,777261 - [med=B] *,gen= 742406 4,340784 30,949 1,784 0,084 -1,111266 16,596079 [med=A] * [gen=B] 0b 0 . . . . . [gen=A] 0b 0 . . . . . [gen=B] 0b 0 . . . . . [med=B] 0b 0 . . . . . [med=A] 0b 0 . . . . . **سوالات این است**: آیا تفسیر این خروجی به این صورت درست است که بین دارو (A) در ژنوتیپ (A) در مقایسه با دارو (A) در ژنوتیپ (B) تفاوت وجود دارد؟ اگر چنین باشد، من نمیدانم چگونه میتوان اثر دارو را در ژنوتیپ (A) مقایسه کرد. آیا من کار اشتباهی انجام می دهم؟ من فرض می کنم این خروجی برای مقایسه های چندگانه صحیح است. آیا این درست است؟ کد این است: MIXED RT BY داروی ژنوتیپ نقطه زمانی /FIXED=ژنوتیپ*دارو ژنوتیپ دارو | SSTYPE(3) /METHOD=ML /PRINT=SOLUTION /RANDOM=نقطه زمانی | COVTYPE(VC) /REPEATED=دارو*نقطه زمانی | SUBJECT(id) COVTYPE(CS). واقعا ممنون میشم اگه کسی بتونه اینجا کمک کنه :) | تفسیر خروجی مدل خطی مختلط SPSS |

99892 | «مبتنی بر مدل» برای آمار چند متغیره به چه معناست؟ به عنوان مثال mvabund – یک بسته R برای تحلیل مبتنی بر مدل دادههای فراوانی چند متغیره. آمار چند متغیره غیر مبتنی بر مدل چگونه است؟ با تشکر | «مبتنی بر مدل» برای آمار چند متغیره به چه معناست؟ |

99895 | توضیحات مختلف در مورد انتخاب مدل بر روی اثرات تصادفی مدل های مختلط خطی دستور استفاده از REML را می دهد. من تفاوت بین REML و ML را در برخی سطوح می دانم، اما نمی دانم چرا REML باید استفاده شود زیرا ML مغرضانه است. به عنوان مثال، آیا انجام LRT بر روی پارامتر واریانس یک مدل توزیع عادی با استفاده از ML اشتباه است (کد زیر را ببینید)؟ من نمی فهمم که چرا در انتخاب مدل، بی طرف بودن از ML بودن مهم تر است. من فکر می کنم پاسخ نهایی باید این باشد که زیرا انتخاب مدل با REML بهتر از ML کار می کند اما من می خواهم کمی بیشتر از آن بدانم. من مشتقات LRT و AIC را نخواندم (به اندازه کافی خوب نیستم که آنها را به طور کامل درک کنم)، اما اگر REML به صراحت در مشتقات استفاده شود، فقط دانستن آن در واقع کافی خواهد بود (به عنوان مثال، تقریب Chi-square آمار آزمون در LRT اگر MLE بایاس باشد کار نمی کند). n <- 100 a <- 10 b <- 1 آلفا <- 5 بتا <- 1 x <- runif(n,0,10) y <- rnorm(n,a+b*x,alpha+beta*x) loglik1 <- تابع(p,x,y){ a <- p[1] b <- p[2] alpha <- p[3] -sum(dnorm(y,a+b*x,alpha,log=T)) } loglik2 <- تابع(p,x,y){ a <- p[1] b <- p[2] alpha <- p[3] بتا <- p[4] -sum(dnorm(y,a+b*x,alpha+beta*x,log=T)) } m1 <- optim(c(a,b,alpha),loglik1,x=x,y=y)$value m2 <- optim(c(a,b,alpha,beta),loglik2,x=x,y=y)$ مقدار D <- 2*(m1-m2) 1-pchisq(D,df=1) # p-value | انتخاب مدل بر روی پارامترهای واریانس (و در مورد REML) |

100801 | **بازی** مجموعه ای از کارت های $n$ وجود دارد که با A یا B مشخص شده اند. نسبت $p$ کارتهایی که با A مشخص شده اند و نسبت 1-p$$ از کارتهایی که با B مشخص شده اند وجود دارد. بازی به شرح زیر است. من به طور تصادفی یک کارت می کشم و دوباره آن را در استخر می گذارم. سپس به طور تصادفی کارت دوم را می کشم. این دو کارت اول یک جفت کارت را تشکیل می دهند. یک جفت می تواند «AA»، «AB» یا «BB» باشد. من این جفت را در صفحه گسترده خود یادداشت می کنم و کارت دوم را نیز در استخر جایگزین می کنم. قرعه کشی ها را تا زمانی که جفت کارت های $n$ کشیدم تکرار می کنم تا ورودی های $n$ را در صفحه گسترده خود دریافت کنم. احتمال AA، AB یا BB هر جفت به ترتیب $p^2$، $2p(1-p)$ و $(1-p)^2$ است. بنابراین، احتمال اینکه من در پایان بازی $x$ `AA` را بکشم، $p^{2x} + (1-p)^{n-x}$ است. احتمال اینکه در پایان بازی $y$ `AB` را کشیدم $2p(1-p)^y + (1-2p(1-p))^{n-y}$ است. احتمال اینکه در پایان بازی $z$ `BB` را کشیدم $(1-p)^{2x} + p^{n-x}$ است. تا اینجا همه چیز درست به نظر می رسد؟ **سوال** من از برادر کوچکم می خواهم که این بازی را انجام دهد و او اساساً دو کار می تواند انجام دهد. او یا منصفانه بازی میکند و انتخاب میکند که کارتها را بهطور تصادفی بکشد یا میتواند ناعادلانه بازی کند و انتخاب کرده است که کارت اول را بهطور تصادفی بکشد و سپس کارت دوم را غیرتصادفی بکشد تا ممکن است تعداد زیادی «AA» و «BB» داشته باشد. برای مثال با تعداد زیادی «AB». برای مثال، اگر او ناعادلانه بازی کند، ممکن است انتخاب کند که هر بار که در دست اول «A» میکشد، احتمال ترسیم «A» دیگر برای تکمیل جفت، تبدیل به $p+\Delta p$ میشود که در نتیجه به مقدار «AA» اضافه میشود. و فقدان AB. بنابراین او بازی میکند و $x$ `AA`، $y$ `AB` و $z$ `BB` را مشاهده میکند، که طبق تعریف $x+y+z=n$ است. مقادیر $x$، $y$، $z$ با انتظارات $p^2$، $2p(1-p)$ و $(1-p)^2$ متفاوت است. ** چگونه می توانم با فاصله اطمینان 95% (با استفاده از توزیع های پاراگراف دوم خود) تشخیص دهم که برادرم منصفانه بازی کرده است یا ناعادلانه؟** | کشیدن یک جفت کارت. برادرم منصفانه بازی کرد یا ناعادلانه؟ |

110199 | من در حال ساخت یک مدل رگرسیون چند متغیره هستم و سعی می کنم از این مدل برای پیش بینی نتیجه تخمینی بالا، متوسط و پایین برای هر فرد در یک گروه از افراد استفاده کنم. من از فاصله اطمینان 95% برای بدست آوردن تخمین های بالا/متوسط/پایین استفاده می کنم. این به این معنی است که برای هر متغیر در پروفایل فرد یک تخمین بالا، متوسط و پایین ایجاد کنید و سپس تخمین ها را با هم در دسته مناسب جمع کنید تا یک تخمین کلی بالا، متوسط و پایین به دست آورید. برای صریح بودن، در اینجا نحوه نگاشت زیاد/متوسط/کم به فاصله اطمینان 95% را می بینم، جایی که B ضریب و SE خطای استاندارد است: High = (B*X)+(1.96*SE) متوسط = (B) *X) Low = (B*X)-(1.96*SE) باز هم، نتیجه تخمینی بالا مجموع تمام پیش بینی های بالا برای ورودی است. متغیرها، نتیجه Medium مجموع تمام پیشبینیهای Medium است و غیره. ** مشکل:** برخی از متغیرهای ورودی من نشانگرهای باینری هستند (با مقادیر 0 یا 1). من مطمئن نیستم که چگونه می توان با شاخص های باینری با مقادیر 0 در هنگام جمع کردن متغیرهای ورودی برای ایجاد پیش بینی های بالا و پایین رفتار کرد. **سوال من:** وقتی یک متغیر شاخص باینری برابر با 0 باشد، آیا می توانم تخمین های High و Low آنها را به سادگی 0 بگذارم یا باید از فرمول های High/Low فهرست شده در بالا استفاده کنم [به عنوان مثال، (B*0)+( 1.96*SE)]؟ به عبارت دیگر، آیا پیشبینی یک متغیر شاخص صفر، صرفنظر از بالا/متوسط/پایین، همیشه صفر است؟ **چرا مهم است:** اگر فرض کنم که پیشبینیهای شاخصهای باینری 0-مقدار همیشه برابر با 0 باشد، دامنه نتایج تخمینی زیاد/متوسط/پایین بسیار دقیقتری دریافت میکنم. اگر بدون توجه به مقدار اندیکاتور باینری به فرمول های فهرست شده در بالا پایبند باشم، طیف وسیع تری از پیش بینی ها را دریافت می کنم. (احتمالاً به این دلیل است که مورد اول اساساً فرض می کند که SE=0 برای اندیکاتورهای باینری 0-مقدار). این مشکل من را متحیر کرده است، بنابراین از هرگونه بینش بسیار سپاسگزار خواهم بود. خوشحالم که با مثال توضیح می دهم. | محاسبه فواصل اطمینان زمانی که متغیر ورودی باینری برابر با صفر باشد |

73293 | من هیچ پیشینه آماری ندارم، اما در تلاش برای تکمیل اولین نظرسنجی تحقیقات کمی خود برای محققم در کلاس آموزش هستم و امیدوارم کسی بتواند مرا راهنمایی کند. من یک نظرسنجی از 62 معلم ایجاد کردم و سعی می کنم 4 سوال زیر را تجزیه و تحلیل کنم. در آینده در کلاس درس (بله/خیر) 4. در چه نوع دبیرستانی کار می کنید (دولتی/خصوصی) من در مورد چگونگی تکمیل یک آزمون اهمیت آماری برای این موضوع با چالش روبرو هستم. دادهها پروفسور پیشنهاد استفاده از آزمون t یا ANOVA را داد و پیوندهایی را ارائه کرد، اما به نظر میرسد دادههایی که من در اختیار دارم با فرمولها مطابقت ندارند. آیا کسی می تواند راهنمایی هایی در مورد نحوه آزمایش این نوع نظرسنجی ارائه دهد؟ آیا روش دیگری برای تجزیه و تحلیل داده ها وجود دارد؟ | اهمیت آماری در سوال نظرسنجی بله/خیر |

51637 | به نظر می رسد این یک سؤال معمولی از قانون بیز باشد، اما من در فرمول صحیح آن مشکل دارم. بگویید من سخنران یک تور کنفرانس هستم که از شهری به شهر دیگر حرکت می کند. من سعی می کنم تخمین بزنم که با توجه به تعداد شرکت کنندگان در شهرهای قبلی، چند نفر در شهر بعدی در سخنرانی من شرکت خواهند کرد. به عنوان مثال، بگوییم تعداد کل شرکت کنندگان در هر شهر 100 نفر است، و پنج آهنگ به طور همزمان وجود دارد که احتمال یکسانی دارند، بنابراین من با فرض اینکه 20 نفر در شهر اول حضور دارند شروع می کنم (یعنی اولویت اول من 0.2 است). در واقع 30 نفر شرکت می کنند. چگونه می توانم از آن شواهد برای پیش بینی تعداد شرکت کنندگان در شهر بعدی استفاده کنم؟ بعد از آن چطور؟ به نظر می رسد که باید بتوانم یک عبارت ساده از قانون بیز برای این موضوع بنویسم، اما هر کاری که امتحان می کنم اشتباه به نظر می رسد. هر گونه کمکی قدردانی خواهد شد. | قانون بیز برای حضور در سخنرانی در کنفرانس |

25415 | دو سوال مرتبط از من من یک چارچوب داده دارم که شامل تعداد بیماران در یک ستون (محدوده 10 تا 17 بیمار) و 0 و 1 است که نشان می دهد آیا حادثه ای در آن روز اتفاق افتاده است یا خیر. من از یک مدل دوجمله ای برای رگرسیون احتمال وقوع در تعداد بیماران استفاده می کنم. با این حال، من می خواهم این واقعیت را تنظیم کنم که وقتی تعداد بیماران بیشتر باشد، ناگزیر حوادث بیشتری رخ می دهد زیرا کل مدت زمان حضور بیمار در بخش در آن روز بیشتر است. بنابراین من از یک مدل دوجملهای افست مانند این (کد R) استفاده میکنم: glm(Incident~Numbers, offset=Numbers, family=binomial, data=threatdata) سؤالات من این است: 1. آیا اشکالی ندارد که متغیرهای دقیقاً یکسان باشند پیش بینی و در جبران؟ من میخواهم افزایش تونیک در احتمال حادثه را جزئی کنم و ببینم اساساً چیزی باقی مانده است یا خیر. برای من منطقی است اما اگر اشتباه کنم کمی محتاط هستم. 2. آیا افست به درستی مشخص شده است؟ میدانم که در مدلهای پواسون، offset=log (اعداد) را میخواند، نمیدانم که آیا معادلی در اینجا وجود دارد یا نه و به نظر نمیرسد که هیچ آفست دوجملهای با Google پیدا نکنم (مشکل اصلی این است که من مدام دوجملهای منفی دریافت میکنم که کدام یک از آنها دوره خوب نیست). | استفاده از افست در مدل دوجمله ای برای محاسبه افزایش تعداد بیماران |

103546 | من در تلاشم تا بفهمم برای پاسخ به این نوع سوال به چه نوع تحلیلی نیاز است: > **آیا داشتن تشخیص مثبت در D تعداد رویدادهای E را تغییر میدهد > بعد از تشخیص؟** میخواهم پیدا کنم. نسبت بین تعداد رویدادهای بعد و قبل از تشخیص ($R_{ab}$) و دریابید که آیا آنهایی که تشخیص مثبت داشتند، R_{ab}$ بیشتر از مواردی که منفی تشخیص داده شد، داشتند یا خیر. یک مثال می تواند این باشد که $D \equiv \text{cancer}$ و $E \equiv\text{تعداد مراجعه به بیمارستان در 2 سال}$. سپس من افراد مبتلا به سرطان (مثبت) یا نه (منفی) را طبقه بندی می کنم. برای یک مورد مثبت $i$ میتوانیم به دنبال موارد منفی در شرایط مشابه (سن، تشخیص تاریخ، منطقه) باشیم. فرض کنید $C_i$ مثبت و منفی های مشابه $C_{Ni}$ داریم. تعداد رویدادها را در دو سال پس از تشخیص ($N_{ai}$) و تعداد رویدادها را در دو سال قبل از تشخیص ($N_{bi}$) اندازهگیری میکنیم. ما به $R_{abi} = N_{ai}/N_{bi}$ علاقهمندیم و برای تشخیصهای منفی با $R_{ab}$ مقایسه میکنیم: $$ RR_i = \frac{R_{abi} (\text{مثبت diagnostik})}{ R_{abi} (\text{تشخیص منفی مشابه}) } $$ تعداد زیادی $C_{Ni}$ برای هر $C_{i}$ ممکن است، بنابراین میتوانیم بهطور تصادفی چند مورد را انتخاب کنیم یا همه آنها را انتخاب کنیم. یکی از روشها انجام یک _مطالعه مورد شاهدی_، ایجاد _معرض_و_تشخیص_و $\text{بیماری} = R_{ab} > 1$ است. سپس میتوانیم دادهها را به عنوان یک مطالعه موردی شاهدی در نظر بگیریم. اما من مطمئن نیستم که آیا این رویکرد درستی است، زیرا برای مثال، زمان تشخیص هم بر تعریف مورد شاهدی و هم در مواجهه و غیره تأثیر می گذارد. آیا پیشنهاد یا اشاره ای به تحلیل مشابه دارید؟ | از کدام تحلیل برای نسبت رویدادهای بعد از/قبل از تشخیص، بین تشخیص مثبت و منفی استفاده کنیم؟ |

23810 | اخیراً متوجه شدم که رویه «PROC GLIMMIX» در SAS عبارت «اثر» را اضافه کرده است که میتواند B-spline را در مدلها مدیریت کند. من آن را امتحان کردم، و برنامه به نظر می رسد: proc glimmix data=temp; اثر t = spline(time); مدل y = x1 x2 t / محلول. رهگیری تصادفی / موضوع = شناسه نوع = un; اجرا؛ گرفتن خروجی مشکلی ندارد، اما چیزی که من واقعاً به آن علاقه دارم، طرح B-spline است. کل دفترچه راهنما رو گشتم ولی اطلاعاتی پیدا نکردم. تابع 'ODS GRAPH' آن نمی تواند به طور خودکار نمودارهای B-spline ایجاد کند. همچنین، تابع 'ODS OUTPUT' آن هیچ خروجی برای ترسیم نمودارهای B-spline در خارج ارائه نمی دهد. من نمی دانم که آیا کسی از روش PROC GLIMMIX برای ترسیم نمودار B-spline استفاده کرده است؟ هر گونه اطلاعات بسیار قدردانی می شود! | چگونه نمودارهای B-spline را از طریق روش PROC GLIMMIX در SAS ترسیم کنیم؟ |

35465 | فرض کنید یک ناظر به دانش آموزی مشکوک شود که در طول یک امتحان چند گزینه ای، پاسخ ها را از روی کاغذ دانش آموز دیگر کپی کرده است. او بعداً پاسخهای آنها را بررسی میکند و شباهتهایی پیدا میکند - اما از طرف دیگر، با توجه به ماهیت امتحان، حتماً شباهتهایی وجود دارد. او چگونه باید تعیین کند که آیا سوء ظن او وجود دارد یا خیر؟ به عبارت دیگر، او مطمئناً باید امتحانات را با امتحانات سایر دانش آموزان (که فرض کنیم تقلب نمی کردند) مقایسه کند. اما اگر اندازه کلاس بسیار بزرگ باشد، آیا منطقی است که نمونه گیری تصادفی برای مقایسه انجام شود؟ سپس او چند خواهد گرفت؟ اگر سؤالات زیادی در آزمون وجود داشت، آیا نمونه برداری از سؤالات برای مقایسه نیز منطقی است؟ آیا تفاوت قابل توجهی دارد که هر سؤال 2 پاسخ ممکن (درست/نادرست) داشته باشد یا مثلاً 4 پاسخ؟ من اعداد خاصی ندارم زیرا به طور کلی میپرسم چگونه این کار میکند. من سابقه ریاضی دارم اما آموزش کمی در آمار دارم. چگونه این تحلیل را از نظر آماری توصیف می کنید؟ متشکرم. | تشخیص سرقت ادبی در آزمون چند گزینه ای |

27126 | به عنوان مثال، در یک توزیع گسسته A P(X) = 0.999 زمانی که x = 0 P(X) = 0.001 زمانی که x = 1000 E(X) = 1 Var(X) = 1000-1=999 در مقایسه با B P(X) = 0.6 وقتی x = 0 P(X) = 0.2 وقتی x = 1 P(X) = 0.2/2 وقتی x = 2 P(X) = 0.2/4 هنگامی که x = 4 P(X) = 0.2/4 زمانی که x = 8 E(X) = 1 =A Var(X) = 0.2+0.4+0.8+3.2-1=3.6 << A با این حال B فرار (ناپایدار)تر از A به نظر می رسد. آمار صحیح رایج برای اندازه گیری این نوع چیزها چیست؟ به روز رسانی: آنتروپی ممکن است کاندیدای خوبی باشد، اما به خود اطلاعات نگاه نمی کند (فقط به شانس اهمیت می دهد). من احساس می کنم نمودار سری زمانی یک سکه منصفانه که می تواند امتیاز (0 یا 1) داشته باشد نسبت به یک سکه منصفانه که می تواند امتیاز (0 یا 100) داشته باشد، فرار کمتر / پایدارتر است. | روش رایج برای اندازه گیری پایداری یا نوسان یک توزیع چیست؟ واریانس ناکافی به نظر می رسد |

56065 | آیا کسی تابع یا بسته R را می شناسد که بتواند به من کمک کند تا نمرات z را به امتیازات صدک تبدیل کنم؟ هدف نهایی طبقه بندی یا رتبه بندی گروهی از پاسخ دهندگان بر اساس ارتفاع نمره z آنها به چهار دسته است (20٪ کمترین امتیاز، 30٪، 30٪، 20٪ بالاترین امتیاز). هر ایده ای؟ پیشاپیش سپاس فراوان! | آیا راهی سریع برای تبدیل امتیاز z به امتیاز صدک وجود دارد؟ |

25417 | تصویر زیر یک نمودار Matlab از یادگیری پرسپترون 3 لایه با 2 گره پنهان در هر دو لایه پنهان است. آیا تکنیک ساده یا کدنویسی ساده برای حذف یا تشخیص این نوسانات در طول تمرین وجود دارد؟ چیزی که من فقط سعی کردم این است که اندازه گام را کاهش دهم اما مجبور شدم آن را با افزایش تعداد تکرارها جبران کنم. لطفا راهنمایی کنید  | آیا تکنیک های ساده ای برای حذف/تشخیص نوسانات در حین آموزش در طرح متلب وجود دارد؟ |

99899 | آیا هنگام پیشبینی، استفاده از $R^2$ بهعنوان اندازهگیری میزان هموارسازی نمایی متناسب با مجموعه دادهها به منظور پیشبینی سریهای زمانی مناسب است؟ من درک می کنم که برای تحلیل رگرسیون مناسب است. آیا می توانم مقادیر R^2$ را بین رگرسیون خطی، رگرسیون لگاریتمی و هموارسازی نمایی به عنوان روشی برای ارزیابی بهترین تکنیک برای پیش بینی مقایسه کنم؟ | R-squared برای مقایسه تکنیک های پیش بینی |

99896 | من 2 نمونه A و B دارم. هر دو نمونه را در معرض استخراج قرار دادم و مقدار بازده (متغیر وابسته) را بدست آوردم. من فقط می خواهم ببینم که آیا تفاوت معنی داری بین بازده برای A و B وجود دارد یا خیر. هر نمونه 3 تکرار داشت. نمونه A: 0.003،0.0029، 0.003 نمونه B: 4.832، 4.828، 4.662 از آنجایی که فقط 2 نمونه است، من برای تست t دو نمونه رفتم. من برای نرمال بودن تست کردم که نشان داد داده ها نرمال نبودند. من یک تبدیل log انجام دادم، اما هنوز نرمال نبود. به هر حال من بازده log را تحت آزمون t قرار دادم و واریانس برابر و مقدار p را 0.00 گرفتم و آزمون ناپارامتریک (من ویتنی) را امتحان کردم و مقدار p 0.046 را گرفتم. من متوجه نمی شوم که چرا مقدار p Mann-Whitney به 0.05 نزدیک است. آیا وقتی مقادیر بسیار دور از هم به نظر می رسند، میانگین نمونه های A و B تفاوت قابل توجهی ندارند؟ من چه غلطی می کنم؟ | من نمی فهمم چه اتفاقی با آزمون تی و نتایج من ویتنی من می افتد |

56066 | من می دانم که آزمون والد برای ضرایب رگرسیون بر اساس ویژگی زیر است که به صورت مجانبی برقرار است (به عنوان مثال، Wasserman (2006): همه آمار، صفحات 153، 214-215): $$ \frac{(\hat{\beta}- \beta_{0})}{\widehat{\operatorname{se}}(\hat{\beta})}\sim \mathcal{N}(0,1) $$ جایی که $\hat{\beta}$ نشان دهنده ضریب رگرسیون تخمینی است، $\widehat{\operatorname{se}}(\hat{\beta})$ نشان دهنده خطای استاندارد است. از ضریب رگرسیون و $\beta_{0}$ مقدار بهره است ($\beta_{0}$ معمولاً 0 برای آزمایش اینکه آیا ضریب تفاوت قابل توجهی با 0 دارد یا خیر). بنابراین اندازه $\alpha$ تست Wald این است: $H_{0}$ را رد کنید وقتی $|W|> z_{\alpha/2}$ where $$ W=\frac{\hat{\beta}}{\widehat {\operatorname{se}}(\hat{\beta})}. $$ اما هنگامی که یک رگرسیون خطی با lm در R انجام می دهید، از یک $t$-value به جای $z$-value برای آزمایش اینکه آیا ضرایب رگرسیون به طور قابل توجهی با 0 متفاوت است (با `summary.lm`) استفاده می شود. . علاوه بر این، خروجی «glm» در R گاهی اوقات بهعنوان آمار آزمایشی، مقادیر $z$- و گاهی اوقات $t$-مقادیر میدهد. ظاهراً زمانی که پارامتر پراکندگی شناخته شده است، از-z$-values استفاده می شود و زمانی که پارامتر پراکندگی تخمین زده می شود، از -t$-values استفاده می شود (این پیوند را ببینید). آیا کسی می تواند توضیح دهد که چرا گاهی اوقات از توزیع $t$ برای تست والد استفاده می شود، حتی اگر نسبت ضریب و خطای استاندارد آن به عنوان نرمال استاندارد توزیع شده باشد؟ **بعد از پاسخ به سوال ویرایش کنید** این پست اطلاعات مفیدی را نیز در اختیار سوال قرار می دهد. | آزمون والد در رگرسیون (OLS و GLMs): توزیع t- در مقابل z |

73297 | سوال من به شرح زیر است: نمونه تصادفی $Y_1،\dots، Y_n$ از $N(\mu،\sigma^2)$. اجازه دهید $\bar{y}=\frac{1}{n}\sum Y_i$. (1) $(\bar{y}-\,\mu)/\sigma=a'x$ که در آن $x\در R^n$، $x\sim N(0,1)$. (2) $\sum(y_i-\bar{y})^2=\sigma^2 X'AX$ جایی که $X \sim N(0,1)$. (3) $\frac{n(\bar{y}-\mu)^2}{\sigma^2}=X'BX$ جایی که $X \sim N(0,1)$. (4) $Aa=0$,$AB=0$. من قبلاً سؤالات (1)-(4) را حل کرده ام و می دانم که $A،B$ و $a$ چیست. آخرین سوال داده شده است چگونه می توانیم از این نتایج برای یافتن آزمونی برای فرضیه $\mu=0$ استفاده کنیم؟ درک اینکه سوال چه می خواهد و چگونه آن را حل کند واقعا سخت است. | ساخت آزمون فرضیه $\mu=0$ |

74110 | اجازه دهید $X$ و $X_{i}$, $i=1,...,n$ متغیرهای تصادفی در فضای احتمال $(\Omega , \mathcal F,P)$ باشند. نشان دهید که بهترین برآوردگر میانگین مربع $X$ با توجه به $(X_{1},...,X_{n})$ است $\hat X =E[X|\sigma(X_{1}،... ,X_{n})]$ | نشان دهید که بهترین برآوردگر میانگین مربع $X$ با توجه به $(X_{1},...,X_{n})$ است $\hat X =E[X|\sigma(X_{1}،... ,X_{n})]$ |

113185 | در R، من باقیمانده های نیمه نرمال را برای چند مدل مختلف ترسیم کرده ام، یعنی halfnorm(residuals(model_object))) متوجه می شوم که یک نمودار یک شکل S متمایز به خود می گیرد (یعنی سیگموئیدی است) و دارای ناحیه ناپیوستگی است ( یک شکاف) در مرکز. من کنجکاو هستم که چنین نتیجه ای به چه معناست. درک من از نمودار باقیمانده نیمه نرمال این است که باقیمانده های مرتب شده از داده ها را با مقادیر مورد انتظار مشاهدات مرتب شده از یک توزیع نرمال مقایسه می کند. در حالی که نمودارهای کاملا نرمال از باقیمانده های علامت دار استفاده می کنند، نمودارهای نیمه نرمال از مقادیر مطلق باقیمانده ها استفاده می کنند. نقاط پرت در سمت راست بالای طرح به عنوان نقاط متمایز ظاهر می شوند و انحراف از یک خط مستقیم به این معنی است که مدل رضایت بخش نیست. آیا این بدان معناست که خط با یک تابع سیگموئید به سادگی نشان دهنده یک مدل ضعیف و شاید بیش از حد پراکنده است؟ یا چیز بیشتری برای آن وجود دارد؟ آیا خط باید یک خط مستقیم باشد تا نشان دهد که مدل رضایت بخش است (صرف نظر از وجود موارد پرت، زیرا در این مورد هیچ کدام وجود ندارد)؟ | خط با تابع سیگموئید ناپیوسته در نمودار باقیمانده نیمه نرمال |

74112 | من یک سری ورودی از نوع 0/1 دارم (این یک سری زمانی مداخله است) و چند سری پاسخ متریک. من باید نگاهی به همبستگی های متقابل بیندازم. به طور معمول من از تکنیک Box-Jenkins استفاده می کنم. اما اکنون باید یک سری ورودی که باینری است را از قبل سفید کنم. آیا می توانم آن را مانند یک متریک اداره کنم؟ آیا منطقی است که به خودهمبستگی ها نگاه کنیم و یک مدل ARMA را به روش عادی تطبیق دهیم؟ یا آیا میتوان مدلهای ARMA را برای متغیرهای پاسخ متریک برازش داد و سپس همان مدل را با متغیر ورودی متناسب کرد و سپس به همبستگیهای متقابل نگاه کرد؟ تقریباً تمام سریهای پاسخ من نویز سفید هستند - اما همانطور که میدانم باید یک مدل ARMA را در ورودی قرار دهم اگر به هر حال این نویز سفید نیست. آیا این درست است یا کافی است که پاسخ نویز سفید باشد؟ خیلی خوشحال میشم اگه کسی بتونه کمکم کنه! خیلی ممنون. | همبستگی یک سری ورودی باینری و سری پاسخ پیوسته |

99894 | تابع چگالی یک متغیر تصادفی x $f(x)=ke^{-2x^{2}+10x}$ است. نقطه 5 درصد بالای توزیع میانگین های نمونه تصادفی 25 از جامعه فوق را بیابید. برای پیگیری این موضوع به راهنمایی نیاز دارم. افکار من: 1. جمعیت عادی را فرض کنید. مقدار k را با ادغام $\displaystyle \int_{-\infty}^{\infty} ke^{-2x^{2}+10x}dx=1$ 2. $\mu$ را با ادغام $\displaystyle بیابید. \int_{-\infty}^{\infty} xke^{-2x^{2}+10x}dx$ 3. $\sigma^2$ را پیدا کنید ادغام $\displaystyle \frac{1}{24}\int_{-\infty}^{\infty} (x-\mu)^2ke^{-2x^{2}+10x}dx$ 4. بالای 5 نقطه درصد توزیع میانگین نمونه تصادفی با $\displaystyle z_{0.95}=\frac{(x-\mu)}{\sigma}$ مطابقت دارد. آیا z_{0.95}$ باید 1.96 دلار (دو طرفه) باشد یا 1.645 دلار (یک طرفه)؟ در نهایت، مقادیر $z_{0.95}$، $\mu$ و $\sigma$ را جایگزین کنید تا مقدار x را بدست آورید که پاسخ لازم است. آیا این مراحل صحیح است؟ | 5 درصد بالای مقدار توزیع میانگین |

3782 | من یک آزمایش میدانی با 4 عامل مستقل طراحی کردم اما داده ها نرمال و ناهمسان نیستند. تست فریدمن (بسته agricolae) از R فقط برای rbd مناسب است. آیا کسی می تواند راهنمایی کند که چگونه داده های من را تجزیه و تحلیل کنم؟ با تشکر فراوان. | چگونه تجزیه و تحلیل فاکتوریل برای داده های غیر عادی و ناهمسان انجام دهیم؟ |

84005 | فرض کنید من یک طراحی فاکتوریل دو طرفه دارم و یک تحلیل مدل خطی مانند (با استفاده از _R_) انجام می دهم: `utils::data(npk,pack = MASS)` lm(بازده ~ بلوک*P, npk) در اینجا، intercept میانگین بازده سطح اول عوامل _block_ (با سطوح 1-6) و _P_ (با سطوح 0 و 1) است، یعنی. اولین فیلد (_block_ = 1 & _p_ = 0) در جدول فاکتوریل که تمام ترکیبات سطوح عامل را نشان می دهد. `mean(npk$yield[npk$P==0 & npk$block==1])` به نظر می رسد آزمون t مربوطه، آزمونی در برابر صفر باشد که این میانگین با صفر متفاوت است. حالا فرض کنید من یک اصطلاح تعاملی را مدل نمیکنم: lm(بازده ~ block+P، npk) در اینجا، من نمیدانم رهگیری از کجا میآید. من فکر کردم می تواند این باشد: (mean(npk$yield[npk$block==1] + mean(npk$yield[npk$P==0]))/2 یعنی در یک جدول فاکتوریل، میانگین سطر اول و ستون اول، اما به نظر نمی رسد که اینطور باشد. چگونه وقفه در یک مدل خطی یک طرح فاکتوریل دو طرفه بدون عبارت اندرکنش محاسبه می شود؟ چگونه تفسیر می شود و کدام null با آزمون t تست می شود؟ | تفسیر رهگیری در رگرسیون خطی داده های فاکتوریل دو طرفه بدون ترم تعامل |

113188 | این اولین سوال من است! شرکت من جعبه های اسناد را می گیرد، آنها را آماده می کند (درآوردن منگنه ها، چسباندن نوار اسناد پاره شده)، و سپس اسناد را اسکن می کند. من می خواهم محاسبه کنم که منگنه ها و اسناد پاره شده چه تاثیری بر زمان لازم برای آماده سازی یک جعبه اسناد دارند. ما مجموعهای از جعبهها را برای: تعداد کل اسناد، درصد منگنهها (# منگنه / # کاغذ)، درصد اسناد پاره شده (# اسناد پاره شده / # از کل اسناد) و مدت زمانی که طول کشید اندازهگیری کردیم. برای آماده کردن جعبه مشکلی که من دارم این است که چگونه با درصدها رفتار می کنید؟ (Staples%, TornDoc%) من سعی کردم Staples% * #ofDocuments را برای بدست آوردن تعداد staples محاسبه کنم، اما این منجر به همبستگی بالایی با / #ofDocuments (چند خطی) می شود. با این حال، اگر از آن به عنوان درصد استفاده کنید، زیرا هر جعبه دارای تعداد اسناد کاملاً متفاوتی است، به نظر من ابتدا باید همه % را به یک متغیر مشترک / اسمی تبدیل کنید. لطفا راهنمایی کنید! | نیاز به استفاده از درصد به عنوان var مستقل در رگرسیون |

57334 | من در حال انجام ارزیابی افسردگی قبل از زایمان (قبل از زایمان) و پس از زایمان (پس از زایمان) (2 نقطه زمانی) هستم. متغیر وابسته مادر افسرده/غیر افسرده بر اساس معیار افسردگی است. هنگامی که تعدادی از متغیرهای پیشبینیکننده وجود دارد که هم ماهیتشان ادامه دارد و هم مقولهای. واضح است که من از 2 پرسشنامه در 2 نقطه زمانی استفاده می کنم: 1) متغیر وابسته دوقطبی است، 2) متغیر وابسته دارای پیش بینی کننده های پیوسته است. آیا می توانم از معادله تخمین تعمیم یافته استفاده کنم؟ دقیقاً رگرسیون لجستیک اقدامات مکرر چیست؟ | اندازه گیری های مکرر قبل تا بعد برای متغیر وابسته طبقه ای و بیش از یک متغیر مستقل هم ادامه دارد و هم طبقه بندی |

57332 | خوشه بندی همبستگی: با توجه به یک گراف علامت دار که در آن برچسب لبه نشان می دهد که دو گره مشابه (+) یا متفاوت (-) هستند، وظیفه این است که راس ها را خوشه بندی کنیم تا اشیاء مشابه با هم گروه بندی شوند. مقالات گزارش می دهند که کار NP-Complete است و الگوریتم های تقریبی را پیشنهاد می کنند. آیا کسی می تواند به من یک پیاده سازی سریع یک الگوریتم ساده لوح را برای انجام کار توصیه کند؟ | خوشه بندی همبستگی |

84009 | من یک نمونه 20 ساله دارم، می خواهم تحلیل رگرسیون چندگانه را برای تخمین رشد اقتصادی انجام دهم. من 9 متغیر مستقل دارم، اما چون نمونه من کوچک است، نتایج ناچیز دریافت می کنم. من اطلاعاتی ندارم که آن را نمونه ای 100 ساله یا چیزی نزدیک به آن کنم. چه کاری می توانم انجام دهم؟ آیا می توانم حجم نمونه را در مشکل خود وارد کنم؟ چگونه می توانم حجم نمونه را در SPSS وارد کنم؟ | چگونه می توان تحلیل رگرسیون چندگانه را با حجم نمونه کوچک انجام داد؟ (n=20) |

74113 | من در حال نوشتن مقاله ای در مورد تخمین های احتمال هستم، و به من گفته شده است که به جای میانگین، باید میانگین تخمین های ارائه شده توسط شرکت کنندگانم را در نظر بگیرم. به من گفته شده است که باید این کار را انجام دهم زیرا میانگین بیشتر تحت تأثیر خطای نمونه گیری قرار می گیرد تا میانه. چرا این است؟ آیا این چیزی است که همیشه درست است، یا فقط در شرایط خاصی صادق است؟ | چه زمانی میانه بیشتر از میانگین تحت تأثیر خطای نمونه گیری قرار می گیرد؟ |

56062 | آیا می توان یک شبکه عصبی را N بار با استفاده از پس انتشار و سپس میانگین وزن های آموخته شده برای تولید یک طبقه بندی دقیق تر آموزش داد؟ تستهای من نشان میدهد که خیر، اما مطمئن نیستم که آیا خطای پیادهسازی است؟ متشکرم | میانگین وزنهای آموختهشده در حین پسپولیشن |

113183 | من مجموعهای از سریهای زمانی $\mathcal{Y}$ و یک سری زمانی آزمایشی $T$ دارم که برای آن باید نزدیکترین سری زمانی تطبیق $Y_i \in \mathcal{Y}$ را پیدا کنم. این باید به صورت آنلاین انجام شود، به عنوان مثال، $T$ جریانی از اندازه گیری ها است و شناسایی باید با انجام هر اندازه گیری از $T$ انجام شود. سریهای زمانی در $\mathcal{Y}$ دارای طولهای متفاوتی هستند، و از آنجایی که $T$ یک جریان است، طول $T$ پیشینی ناشناخته است. علاوه بر این، $T$ میتواند با ${Y_i}^{1+}$ مطابقت داشته باشد، یعنی وقتی بهترین تطابق پیدا شد، نمیتواند به سریهای دیگر پرش کند، اما میتواند خود را تکرار کند. من میپرسم کدام متریک فاصله یا مجموعهای از الگوریتمها برای این نوع برنامهها مناسبتر است؟ همچنین اگر بتوانید من را به هر مرجع یا مقاله ای در مورد آن موضوع معرفی کنید، خوشحال می شوم. | طبقه بندی جریان سری های زمانی |

4999 | من اخیراً با مقاله زیر مواجه شدم: روش های تصادفی برای حداقل کردن تلفات منظم شده $\ell_1$ توسط Shai Shalev-Shwartz و Ambuj Tewari، ICML 2009. در مقاله، نویسندگان اصلاحی در الگوریتم نزول مختصات برای LASSO در که مختصات ($\beta$s) به ترتیب تصادفی به روز می شوند. به نظر می رسد این اصلاح عملکرد زمان اجرا بهتری نسبت به نزول مختصات قطعی دارد. آیا می توانید شهودی ارائه دهید که چرا چنین اصلاحی الگوریتم را در عمل سریعتر می کند؟ | نزول مختصات تصادفی برای تنظیم $\ell_1$ |

56067 | (1) هنگام انجام PCA، آیا متغیرها را به شکل زنگ فرض می کنید؟ بگویید اگر دسته ای از متغیرها دارم، برخی به شکل زنگ هستند، اما برخی دارای دم های بلند (راست) مشخص هستند (بسیار اریب و نامتقارن با میانه نزدیک به حداقل و چند مقدار بسیار بزرگ). آیا باید تغییر log را روی آن متغیرهای دم بلند انجام دهم یا آنها را همینطور رها کنم؟ پیامدهای نتایج PCA با و بدون تبدیل چیست؟ (2) سوال دوم این است که وقتی من رگرسیون مولفه اصلی (PCR) را انجام میدهم، متغیر پاسخ دارای دم بلند و یکی از نمرات PC نیز دارای دم بلند است. آیا باید تبدیل هر دو یا هر دو را وارد کنم؟ نکته: دم در این سوال همه یک طرفه هستند. | تجزیه و تحلیل مؤلفه اصلی (PCA) بر روی داده های بلندمدت |

57331 | بیایید تصور کنیم که من مدل رگرسیون خطی ساده زیر را تخمین زدهام: $y_{i} = 10 + 0.5x_{i} + \varepsilon_{i} $، و میخواهم خلاف واقع را بررسی کنم، یا اینکه $ y_{i چیست؟ }$ در غیاب $ x_{i}$ باشد. ساده ترین مثال این یک مورد کنترل درمان ساده است. بنابراین $x_{i} = T_{i}$ و $T در \\{0,1\\}$. در این مورد دو نتیجه خلاف واقع وجود دارد: 1: درمان را دریافت کنید، بنابراین $ T=1$ و خلاف واقع $y_{i}-0.5T_{i}=y_{i}-0.5$ است، 2: نکن، بنابراین $ T=0$ و خلاف واقع به سادگی $y_{i}-0.5T_{i}=y_{i}$ است. درک این موضوع به اندازه کافی آسان است. با این حال، در موردی که $ x_{i}$ مقادیر منفی می گیرد، در محاسبه چنین خلاف واقع با مشکل زیادی مواجه هستم. در مورد من، من یک رگرسیور پیوسته $ x_{i}$ دارم که دارای مقادیر تقریباً از $-8$ تا $+1$ است. برای مشاهده مشکل من، بیایید همان مدل رگرسیون را در بالا فرض کنیم و سعی کنیم مقادیر خلاف واقع $ y_{i}$ را برای دو مقدار بالقوه $ x_{i} \in \\{-2 محاسبه کنیم. , -1\\}$. برای $x_{1}=-2$، مقدار پایینتر، تأثیر پیشبینیشده آن بر نتیجه این است: 0.5$(-2)=-1$. برای $x_{2}=-1$، ارزش بیشتر، تأثیر پیشبینیشده این روی نتیجه این است: 0.5$(-1)=-0.5$. بدیهی است که مقدار کمتر x$ تاثیر کمتری بر نتیجه دارد به عنوان $-1<-0.5$. با این حال، این نقطه ای است که مغز من می میرد. چگونه این را به یک نتیجه خلاف واقع ترجمه می کنید؟ از قبل، ما یک فرمول داشتیم: $y_{i}-0.5x_{i}$. اگرچه، در این مورد استفاده از این فرمول خلاف آن را پیش بینی می کند. $y_{1}-0.5(-1)=y_{1}+0.5$ $y_{2}-0.5(-2)=y_{2}+1$ بنابراین در صورت عدم وجود $x_{i}$ هر دو مقادیر $y$ بیشتر خواهد بود حتی اگر ضریب تخمینی مثبت باشد. من واقعا با این مشکل دارم. آیا نوعی تغییر شکل وجود دارد که بتوانم انجام دهم که به مقادیر خلاف واقع مقادیر بالاتر $x_{i}$ اجازه می دهد تا کوچک شوند در حالی که مقادیر پایین تر از $x_{i} $ کمتر (یا اصلاً) کوچک می شوند. مورد $x_{i}=T_{i}\in\\{0,1\\}$؟ برای توضیح بیشتر، میخواهم بتوانم بسیاری از مقادیر خلاف واقع را برای اثر درمان مداوم پیشبینی کنم، اما میخواهم بتوانم از این مقادیر خلاف واقع برای تعیین میزان تغییرات در $y$ استفاده کنم. ناشی از x$. بیایید تصور کنیم که در مورد نتیجه آن رشد اقتصادی صحبت می کنیم. ما می خواهیم بفهمیم که چقدر نهادهای سیاسی خوب (x$) از رشد اقتصادی ($y$) توضیح می دهند. کاری که من میخواهم انجام دهم این است که ببینم اگر نهادها اهمیتی نداشتند، این نرخهای رشد چگونه بود. به عنوان مثال، تصور کنید ما مدل رگرسیون ارائه شده در بالا را برای 2 کشور برآورد کرده ایم: A و B. در A، موسسات خوبی وجود دارد، بنابراین $x_{A}=4$، و B بد است، بنابراین $x_{B}= 1 دلار حال اجازه دهید بگوییم که رشد اقتصادی در A $y_{A}=4$ و $y_{B}=2$ است. بنابراین در این مورد، خلاف واقع (اگر $x$ مهم نبود چه رشدی خواهد داشت) به ترتیب $4-0.5(4)=2$ و $2-0.5(1)=1.5$ برای A و B خواهد بود. در سناریوی خلاف واقع، مجموع نرخهای رشد 3.5 است، در مقابل 6 مشاهده شده. این بدان معناست که در صورت عدم وجود مؤسسات، ما میداشتیم ($\frac{3.5}{6} \حدود 58\%$) از رشد بنابراین مؤسسات 42\% دلار از تفاوت رشد بین این دو کشور را توضیح می دهند. با مقادیر منفی $x$ من مطمئن نیستم که چگونه چنین محاسبه ای را انجام دهم. | عوامل متقابل برای متغیرهای دارای مقادیر منفی |

74116 | فرض کنید من میخواهم همبستگی بین $X\sim N(0,1)$ و $Y$ را تخمین بزنم، که در آن $Y\in \\{-1,0,1\\}$ و برابر با صفر برای 99 در هر است. درصد از نمونه حجم نمونه 10 میلیون است. خواص همبستگی پیرسون در این مورد (سوگیری، سودمندی و غیره) چیست؟ آیا یک برآوردگر همبستگی جایگزین بهتر است (مثلاً همبستگی رتبه ای)؟ | همبستگی پیرسون بین متغیر گسسته که عمدتاً 0 است و یک متغیر نرمال استاندارد |

84007 | من با R جدید هستم و از اسکریپتی استفاده می کنم که کاملاً درک نمی کنم. یک مجموعه داده را برای داده کاوی از قبل پردازش می کند. در یک نقطه، داده ها (ذخیره شده در fil) باید مرکز و مقیاس شوند و مقادیر NA با مقادیر محاسبه شده با knnImpute جایگزین شوند. preProcValues <- preProcess(fil, method = c(center, scale,knnImpute)) filpred <- predict(preProcValues, fil) خطای زیر را دریافت می کنم: خطا در nn2(old[, cols, drop = FALSE]، new[، cols، drop = FALSE]، k = k): NA/NaN/Inf در فراخوانی تابع خارجی (arg 1) به نظر من این خطا مربوط به نحوه عملکرد knnImpute است. آیا این امکان وجود دارد که `knnImpute` از ستون های اطراف برای القای مقادیر NA استفاده کند؟ زیرا در ستونی که این کار متوقف می شود مقادیر NA زیادی در یک ردیف از چندین ستون وجود دارد. آیا کسی می تواند توضیح دهد که آیا ممکن است علت این خطا باشد؟ آیا کسی میتواند توضیح دهد که «knnImpute» چگونه کار میکند یا دلیل دیگری ممکن است چیست؟ | knnimput تابع پیش پردازش چگونه کار می کند؟ |

3787 | برای توزیع تکوجهی که دارای انحراف متوسط است، رابطه تجربی زیر را بین میانگین، میانه و حالت داریم: $$ \text{(Mean - Mode)}\sim \text{3(Mean - Median)} $$ چگونه بود این رابطه حاصل شده است؟ آیا کارل پیرسون هزاران مورد از این روابط را قبل از این نتیجه گیری ترسیم کرد یا اینکه یک خط استدلال منطقی پشت این رابطه وجود دارد؟ | رابطه تجربی بین میانگین، میانه و حالت |

82807 | من در مورد نقل قولی در Groves & Lyberg (2010، ص 859) آمده ام که (...) هر دو طرح نفوذ متقابل و مصاحبه مجدد برای تخمین این شرایط مورد نیاز است (اشاره به تخمین انحرافات پاسخ، که جزء واریانس هستند. در کل واریانس یک میانگین که ناشی از واریانس نمونه نیست). من سعی کردم ادبیاتی را در مورد معنای طراحی نفوذ متقابل بیابم. جستجو در CrossValidated هیچ یافتهای را به دست نمیدهد و ارجاع به یک کلاسیک در طراحی آزمایشی، به عنوان مثال، «نظریه طراحی آزمایشها» (توسط کاکس و رید، 2000) نیز هیچ مرجعی ارائه نمیکند. طراحی نفوذ متقابل چیست؟ کاربردهای آن چیست؟ آیا به نام های مختلف نیز می رود؟ مرجع: Groves, R. M., & Lyberg, L. (2010). کل خطای نظرسنجی: گذشته، حال و آینده. _فصلنامه افکار عمومی، 74_ (5)، 849-879. doi:10.1093/poq/nfq065 | طراحی نفوذ متقابل چیست؟ |

37569 | من آدم آماری نیستم بانک جهانی داده هایی دارد که PPP (برابری خرید شخصی یا چیزی شبیه به آن) را برای پنجک ها (در واقع اول 10٪، دوم 10٪، دوم، سوم، چهارم 20٪، نهم 10٪ و دهم 10٪) از جمعیت یک کشور ارائه می دهد. من مطالب خوبی در مورد شاخص جینی مطالعه کرده ام و همچنین منحنی های توزیع درآمد را برای جمعیت ها مدل کرده ام، و می خواهم این داده های پنجک را به یک توزیع لگ نرمال تبدیل کنم که نمایانگر همان ویژگی ها است (به عنوان مثال اگر چین برای اولین بار 1300 دلار PPP داشته باشد. 10 درصد که پس از مدل سازی آن، میانگین وزنی PPP (ادغام در زیر منحنی؟) برای 10 درصد ضعیف ترین توزیع لگ نرمال بدست می آید. به 1300). آیا فکری در مورد چگونگی انجام این کار، از نظر تاکتیکی دارید؟ من نمی توانم به این راه فکر کنم - اما من یک برنامه نویس معقول از اسکریپت های ساده هستم و از scipy و numpy پایتون برای جا دادن منحنی ها استفاده می کنم. در مورد چگونگی ادامه دادن کمک می کند. * * * @mpiktas حق با شماست حداکثر درآمد را نمی دهند. اطلاعات پنجک/دهک باید متوسط باشد. فکر نمیکنم بتوانید این دادهها را بهراحتی بهگونهای که گویی دادههای خام است، در یک توزیع قرار دهید، اگر اینطور بود من این سؤال را نمیپرسیدم! @Michael، با توجه به اینکه نقاط داده پنجک/دهک مقادیر متوسطی برای کل براکت پنجک/دهک هستند، آیا هنوز هم میتوان بهترین تناسب را به دست آورد؟ آیا منظور شما از برازش حداقل مربعات این است؟ | توزیع Lognormal از داده های PPP پنجک بانک جهانی |

106072 | من 2 بردار جمعیت روستایی و شهری یک کشور دارم. (سالهای 1975 تا 2020) با تنها سه مقدار (سالهای 1980، 1990 و 2001) در هر کدام. و من باید داده های از دست رفته را پیش بینی کنم. اولین رویکرد من این بود که دادهها را بین سالهای شناختهشده درون یابی کنم (با استفاده از na.approx در R) و سپس از make a model ARIMA استفاده کنم، با این حال مطمئن نیستم که ایده خوبی است یا خیر، زیرا گرافیک یک جورهایی ناجور به نظر میرسد. همچنین مقادیر موجدار هستند، به عنوان مثال، جمعیت شهری - 4000 در سال 1980، 3800 در سال 1990 و 3950 در سال 2001. هر گونه ایده در مورد چگونگی پیش بینی بهتر واقعا مفید خواهد بود. | پیش بینی داده های از دست رفته از سه مقدار در هر یک از دو بردار |