_id stringlengths 1 6 | text stringlengths 0 7.5k | title stringlengths 0 167 |

|---|---|---|

82940 | من در حال حاضر خودم در حال مطالعه آمار هستم و در مورد مدل صفر در رگرسیون لجستیک باینری سردرگم هستم. من متوجه شدم که مدل نول برای مقایسه با مدلی که شما طراحی کرده اید استفاده می شود، اما مدل نول دقیقا چیست؟ فقط ln(x)=y؟ | آیا مدل صفر برای رگرسیون لجستیک باینری فقط تابع log طبیعی است؟ |

89450 | من سعی می کنم مشخصات کاربر را از داده های توییتر درک کنم. چگونه می توانم علاقه کاربر را از وضعیت ها درک کنم؟ از تحقیقات من، LDA (تخصیص دیریکله نهفته) برای استخراج موضوع مناسب است. دادهها را جمعآوری کردهام، کلمات توقف را حذف کردهام، پانک. تا کنون اما من هیچ داده قطار یا هیچ موضوع نمونه ای نداشتم. آیا باید به لیست موضوعات خاصی برای lda نیاز داشته باشم؟ و در آخر بهترین کتابخانه جاوا برای من کدام است؟ پیشاپیش ممنون آیسو | استفاده از LDA در دادههای غیر همدرنگ توییتر |

11012 | من میدانم که SPSS میتواند یک جدول احتمالی ایجاد کند، و در همان زمان تست خی دو را انجام دهد. با این حال، آیا این امکان وجود دارد که وقتی جدول احتمالی را داریم، برای داشتن SPSS تست خی دو را انجام دهیم؟ | آیا SPSS می تواند تست chi-square را روی یک جدول احتمالی موجود انجام دهد؟ |

114536 | من در تفسیر یک اصطلاح تعاملی در یک رگرسیون خطی با توجه به فرضیهام مشکل دارم. این مثال اساسی را در نظر بگیرید: > H0: نمرات بهتر مدرسه منجر به درآمد بالاتر می شود و این رابطه برای مردان و زنان یکسان است. DV: درآمد IV: نمره مدرسه، جنسیت چگونه می توانم یک اصطلاح تعامل مثبت غیر قابل توجه درجه * جنسیت را تفسیر کنم؟ آیا پذیرش H0 صحیح است؟ | چگونه عبارت تعامل غیر معنی دار را در رگرسیون خطی تفسیر کنیم؟ |

91834 | من 100 نمونه از یک توزیع نرمال با واریانس برابر 1 و میانگین برابر 0 دارم. من 90 نمونه را به طور تصادفی از 100 نمونه انتخاب کردم و میانگین آنها را (میانگین 90 نمونه) بر اساس این فرض برآورد کردم که واریانس مشابه نمونه اصلی است. سوال من این است که چگونه احتمال 10 نمونه باقیمانده را تحت تناسب محاسبه کنم؟ آیا باید میانگین 10 باقیمانده را تخمین بزنم و آن را با میانگین 90 انتخاب شده مقایسه کنم؟ من به تازگی مطالعه آمار را شروع کرده ام و از هر ورودی قدردانی می کنم. | اعتبارسنجی متقابل، نحوه اجرای واقعی مفهوم |

28850 | > **موضوع تکراری:** > تست خوب بودن تناسب برای یک مخلوط در R من فقط پارامترهای مخلوطی از دو گاوسی را با میانگینهای مختلف و سیگماهای مختلف تخمین زدم، میخواهم آزمایش کنم که آیا دادهها به خوبی با شکل صریح تنظیم میشوند یا خیر. مخلوط، آیا لزوماً نیاز به شبیه سازی داده ها از مخلوط دارم یا چگونه می توانم خوب بودن تناسب را با استفاده از یک دست داده ها و در دست دیگر مخلوط صریح با تخمین زده شده آزمایش کنم پارامترها؟ من از پکیج mixtools استفاده میکنم. | تست خوب بودن تناسب برای مخلوطی در R |

28870 | من می خواهم بدانم که چگونه متغیرهای تصادفی در یک مکان جغرافیایی خاص از نظر مکانی همبستگی دارند. فرض کنید من تابع z را بسته به موقعیت مکانی نقاط دارم. اگر این مقادیر z را به صورت مکانی رسم کنم، پس از نمودار چگونه می توانم همبستگی فضایی آنها را تجزیه و تحلیل کنم. چگونه طرح به نظر می رسد یا قرار است شبیه باشد | تجزیه و تحلیل همبستگی فضایی از طرح |

25162 | استفاده از اشیاء ماتریس پراکنده در آموزش svm در e1071 نتایج متفاوتی را نسبت به اجرای روی همان دادههای ارائه شده به عنوان ماتریس استاندارد برمیگرداند: library(e1071) library(Matrix) library(SparseM) m=10 n=800 #means <- colMeans(myData) # stdDevs <- application(myData, 2, sd) به معنی <- c(0.042154664, 0.010474473, 0.106408354, 0.002237226, 0.089791084, 0.072792224, 0.001884146, 0.001884142, 0.001824146, 0.00184149, 0.00184149, 0.00237226, 0.00237226, 0.00154664 0.151466160) stdDevs <- c(0.017026132، 0.012720986، 0.026721416، 0.004810966، 0.026454962، 0.026454962، 0.025134987، 0.025134987 0.005573776، 0.009063219، 0.036368062) clss = rep(0,n) clss[sample(1:n,n/2)] <- 1 clss <- factor(clss) ftrs <- matrix(nrow=n) برای (من در seq(m)){ftrs[,i] <- rnorm(n,means[i],stdDevs[i])} ftrs[ftrs<0] <- 0 for (i در seq(m)){ftrs[نمونه (1:n,(n/10)),i]<-0} ftrs.csr <- as.matrix.csr(ftrs) ftrs.Mtrx <- ماتریس(ftrs,sparse=TRUE) mod1 <- svm(ftrs,clss, kernel='linear') mod2 <- svm(ftrs.csr,clss, kernel='linear') mod3 <- svm(ftrs.Mtrx,clss , kernel='linear') prf(data.frame(fitted(mod1),clss)) prf(data.frame(fitted(mod2),clss)) prf(data.frame(fitted(mod3),clss)) کد بالا زیر مجموعه ای از یک را شبیه سازی می کند ویژگی های من بسیار نزدیک تنظیم می شود، و اگر آن را به طور مکرر اجرا کنید، نتایج prf گاهی بسیار نزدیک و گاهی بسیار متفاوت خواهند بود، یعنی هرگز مطابقت ندارند: > prf(data.frame(fitted(mod1)،clss)) Acc P_0 R_0 F_0 P_1 R_1 F_1 [1,] 0.52125 0.675 0.5162524 0.5850488 0.3675 0.5304685 > 0.530685 prf(data.frame(fitted(mod2)،clss)) Acc P_0 R_0 F_0 P_1 R_1 F_1 [1،] 0.5025 0.775 0.5016181 0.6090373 0.23 0.5054916151513 0.23 > prf(data.frame(fitted(mod3)،clss)) Acc P_0 R_0 F_0 P_1 R_1 F_1 [1،] 0.5025 0.775 0.5016181 0.6090373 0.23 0.5054916151513 > 0.23. prf(data.frame(fitted(mod1)،clss)) Acc P_0 R_0 F_0 P_1 R_1 F_1 [1,] 0.545 0.61 0.539823 0.57277 0.48 0.5517241 0.513369 prf(data.frame(fited(mod2)،clss)) Acc P_0 R_0 F_0 P_1 R_1 F_1 [1,] 0.50375 0.2225 0.5085714 0.3095652 0.785 0.50124 > 0.50124 > 0.785 prf(data.frame(fitted(mod3),clss)) Acc P_0 R_0 F_0 P_1 R_1 F_1 [1,] 0.50375 0.2225 0.5085714 0.3095652 0.785 0.50124 این چیزی است که این کار را انجام نمی دهم؟ یا آموزش روی نمایشهای ماتریس پراکنده نادقیقتر است؟ با تشکر، Rob prf تابع: prf <- function(predAct){ ## predAct دو قاب داده از pred است، act preds = predAct[,1] trues = predAct[,2] xTab <- جدول(preds، trues) clss < - as.character(sort(unique(preds))) r <- matrix(NA, ncol = 7, nrow = 1, dimnames = list(c(),c('Acc', paste(P,clss[1],sep='_'), paste(R,clss[1],sep=' _')، چسباندن (F، clss[1]، sep='_')، چسباندن (P، clss[2]، sep='_')، paste(R,clss[2],sep='_'), paste(F,clss[2],sep='_')))) r[1,1] <- sum(xTab[ 1,1],xTab[2,2])/sum(xTab) # دقت r[1,2] <- xTab[1,1]/sum(xTab[,1]) # Miss Precision r[1,3] <- xTab[1,1]/sum(xTab[1,]) # Miss Recall r[1,4] <- (2*r[1,2]*r[1,3] )/sum(r[1,2],r[1,3]) # Miss F r[1,5] <- xTab[2,2]/sum(xTab[,2]) # ضربه دقیق r[1 ,6] <- xTab[2,2]/sum(xTab[2,]) # ضربه Recall r[1,7] <- (2*r[1,5]*r[1,6])/sum(r[ 1,5],r[1,6]) # ضربه F r} | استفاده از SparseM/Matrix Sparse Matrix در آموزش SVM از e1071 که نتایج متفاوتی را از داده های مشابه در ماتریس استاندارد برمی گرداند. |

110349 | من سعی می کنم یک مدل رگرسیونی برای یک سیستم قیمت گذاری پویا ایجاد کنم که به دنبال به حداکثر رساندن درآمد باشد. مشکلی که من دارم این است که سیستمی که قبلاً وجود داشت (که منبع داده های من است) مالک را درگیر تصمیم گیری در مورد قیمت گذاری چیزها بر اساس انتظارات شخصی خود از تقاضا می کرد. بنابراین، وقتی سعی میکنم هر نوع رابطهای بین قیمت و تقاضا را از بین ببرم، در نهایت به این میرسم که قیمت بالاتر = تقاضای بیشتر است، که بدیهی است که اینطور نیست. آیا راهی برای اصلاح این موضوع وجود دارد یا اساساً داده ها برای من بی فایده هستند؟ تا کنون متغیرهای ابزاری را بررسی کردهام، اما مطمئن نیستم که چیزی داشته باشم که برای شرایطم کار کند. ویرایش: در اینجا پیوندی به برخی داده ها وجود دارد | مشکل داده با رگرسیون قیمت گذاری پویا |

61308 | من یک پرسشنامه مقیاس لیکرت با 9 ویژگی یک سیستم دارم (مانند ثبات، امنیت، هزینه و غیره) برای هر یک از ویژگی ها، پاسخ دهندگان می توانند پاسخ دهند که این ویژگی در مقیاس چقدر برای آنها مهم است کاملاً موافقم. اکثرا موافق، نه موافق و نه مخالف، اکثرا مخالف و کاملا مخالف. من می خواهم داده ها را تجزیه و تحلیل کنم تا ویژگی ها را بر اساس اهمیت درک شده آنها مرتب کنم. منظورم پاسخها در مقیاس (2، 1، 0، -1، -2) بود، اما به نظرم اشتباه بود. آیا یک کاملاً موافق واقعاً با دو کاملاً مخالف مطابقت دارد؟ اگر میانه را بگیرم، می توانم برخی از الگوهای ارزشمند را از دست بدهم، و داشتن میانه روی تنها پنج مقدار نیز اشتباه به نظر می رسد. آیا راهنمایی در مورد نحوه انجام تجزیه و تحلیل دارید؟ | نحوه تجزیه و تحلیل داده های مقیاس لیکرت |

110342 | مثلاً بگویید من یک گراف وزن دار داشتم به طوری که هر گره یک مقدار مرتبط داشت. مقادیر گره ها توسط برخی از تابع های وزن یال و تعداد یال ها و همچنین مختصات گره داده می شود. هیچ محدودیت بالایی برای تعداد یال های بالقوه هر گره وجود ندارد. روابط می تواند خطی/منطقی/هرچی باشد. آیا تکنیکهای سبک شبکه عصبی (از نظر استفاده به جای اجرا) وجود دارد که بتوان در این نوع سناریوها به کار برد که بتواند دادههای آموزشی را پیشبینی کند؟ چه می شود اگر من دو مقدار جداگانه مرتبط با هر گره داشته باشم؟ یکی از ایدههای من این بود که از یک شبکه عصبی مکرر استفاده کنم و لبههای آن را یکی یکی تغذیه کنم، اما به نظر میرسد برای راهحلی که احتمالاً یک راهحل نسبتاً کند و متزلزل است، کار زیادی است. توجه: این تلاشی برای حل یک مشکل خاص نیست، بلکه یک کنجکاوی عمومی است. | تشخیص الگوی سبک شبکه عصبی با تعداد ورودی ناشناخته/متفاوت؟ |

110347 | من با مدل های خطی استفاده می کنم. من می توانم افزایش استفاده از روش مبتنی بر هسته را به ویژه در یادگیری ماشین ببینم. در زیر نمونه ای از هسته گاوسی با استفاده از تابع 'gausspr' از بسته R 'kernlab' آورده شده است. تابع اجرای فرآیندهای گاوسی برای طبقه بندی و رگرسیون است. نیاز(kernlab) x <- seq(-20,20,0.1) y <- sin(x)/x + rnorm(401,sd=0.03) # رگرسیون با فرآیندهای گاوسی foo <- gausspr(x, y) foo # پیش بینی و رسم ytest <- predict(foo, x) plot(x, y, type=l) خطوط (x, ytest, col=red) روشهای هسته موجود در این بسته عبارتند از: تابع هسته پایه شعاعی `rbfdot` Gaussian polydot تابع هسته چند جملهای `vanilladot` تابع هسته خطی `tanhdot` تابع هسته مماس هیپربولیک` laplacedot` Laplacian تابع هسته besseldot تابع هسته بسل 'anovadot' تابع هسته ANOVA RBF 'splinedot' هسته Spline اولین سوال من چگونه می توانم بدانم که بهتر است از نسخه های هسته استفاده کنم؟ سوال دوم این است که چگونه انتخاب کنیم از کدام هسته استفاده کنیم؟ | چه زمانی روش مبتنی بر هسته عملکرد بهتری نسبت به معمول دارد |

21587 | من سعی می کنم تفاوت های میانگین بین دو جمعیت $x_1$ و $x_2$ را توصیف کنم که غیر صفر و مثبت هستند. توزیع آنها تقریباً بتا با یک انحراف مثبت است. برای مثال، با R: # x1 <- round(rbeta(10, 1, 100)*1000, 1) # x2 <- x1 + round(rbeta(10, 1, 100)*100, 1) x1 <- c (1.7، 12.6، 22.3، 37.3، 15.2، 7.1، 31، 4.4، 9.5، 1.9) x2 <- c(1.9، 14.2، 25.6، 39.2، 15.9، 8.7، 32.2، 7، 9.7، 1.9) دو روشی که می توانم برای تعیین میانگین تفاوت های نسبی در نظر بگیرم اعداد متفاوتی را به دست می دهند: mean((x2 - x1)/x1) # 0.1365628 (mean(x2) - mean(x1))/mean(x1) # 0.09300699 چرا آنها متفاوت هستند، و کدام روش بیشتر توصیف کننده چیزی است که من به دنبال آن هستم؟ یعنی $x_2$ 13.6% یا 9.3% بزرگتر از $x_1$ است؟ | چگونه تفاوت های نسبی میانگین را پیدا کنیم؟ |

25169 | پس از کمک های شگفت انگیز، به خصوص از @jbowman، من آماده بودم تا وارد مدل های خود شوم اما به مشکلی برخورد کردم که نمی فهمم. من تصمیم گرفتم بسته MuMIN را امتحان کنم زیرا با lme4 کار می کند تا بتوانم همه مدل ها را به جای اجرای هر یک در یک بار در یک بار انجام دهم. با این حال جدا از بارگیری آن و سپس بارگیری lme4، من فرصتی برای استفاده از آن نداشتم زیرا با خطا مواجه می شوم و نمی دانم چرا. کسی میتونه لطفا به کد نگاه کنه و ببینه من چه اشتباهی میکنم؟ پست اصلی من اینجاست معادلات مدل اثرات مختلط. اساساً به من می گوید که نمی تواند تغذیه را پیدا کند اما وقتی نام df را تایپ می کنم همه ستون ها را لیست می کند. بنابراین من سعی کردم آن را به عنوان یک factor (نه as.factor) وارد کنم، همانطور که می بینید بدون تاثیر. من می خواهم فایل csv. خود را پیوست کنم اما گزینه ای برای انجام این کار نمی بینم. :( این چیزی است که من دریافت می کنم > local({pkg <- select.list( sort(.packages(all.available = TRUE))،graphics=TRUE) + if(nchar(pkg)) library(pkg، نویسه. only=TRUE)}) پیام هشدار: بسته MuMIN تحت نسخه R 2.14.1 ساخته شده است > local({pkg <- select.list(sort(.packages(all.available = TRUE)),graphics=TRUE) + if(nchar(pkg)) library(pkg, character.only=TRUE)}) بارگیری بسته مورد نیاز: ماتریس بارگیری بسته مورد نیاز: lattice در حال پیوست کردن بسته: ماتریس شی(های) زیر از package:base پوشانده شده اند: det در حال پیوست کردن بسته: lme4 شی(های) زیر از package:stats پوشانده شده اند: AIC, BIC > ABMtest.df<-read.csv(file.choose(), header=T) > ABMtest.df$Brood<-as.factor(ABMtest .df$Brood) > ABMtest.df$Site<-as.factor(ABMtest.df$Site) > ABMtest.df$Age.class<-as.factor(ABMtest.df$Age.class) > ABMtest.df$MF.vs.OF<-as.factor(ABMtest.df$MF.vs.OF) > ABMtest. df$tide.h.l<-as.factor(ABMtest.df$tide.h.l) > fm2test<-lmer(Feeding~MF.vs.OF+Age.class+tide.h.l+Site+HDp+(1|Brood)) خطا در eval(expr، envir، enclos): شیء «تغذیه» یافت نشد > ABMtest.df$Feeding<-factor(ABMtest.df$Feeding) > fm2test<-lmer(Feeding~MF.vs.OF+Age.class+tide.h.l+Site+HDp+(1|Brood)) خطا در eval(expr، envir، enclos): شیء «تغذیه» یافت نشد > آخرین بار پس از فهرست کردن همه چیز، سرانجام آن را به اجرا رساندم (اما مطمئن نیستم که چگونه زیرا نمی توانم این را تکرار کنم. اما آخرین باری که کد را تایپ کردم: ms2test<-dredge(fm2test, trace=TRUE, rank=AICc, REML=FALSE) که قرار است رتبه تمام مدل هایی که از AICc استفاده می کنند را به من بدهد و به من امکان می دهد مدلها و غیره اما چیزی شبیه به عدم یافتن کلاس mer با فیکس میگوید. من هیچ نظری ندارم. اگر کسی می تواند ببیند که چرا Feeding به رسمیت شناخته نمی شود، یا این به این دلیل است که من اول لیست نکردم؟ و سپس هر کسی که با دستور dredge آشنا باشد در این مورد کمک کند، بسیار قدردانی خواهد کرد. | مدلها را مشخص کرد، اما در مورد یافت نشدن شی و دستور لایروبی مشکل داشت |

21889 | من 2 گروه دارم: N=350 (G1) و N=1500 (G2). G1 به 1 شرکت و G2 یک گروه 4 شرکتی است. آیا آزمون z برای آزمایش تفاوتهای معنیدار بین توزیع درصد مناسب است؟، بهعنوان مثال، اگر 51/49% مرد/مونث در G1 تفاوت معنیداری با 46/54% مرد/مونث در G2 دارد؟ با تشکر | آزمون آماری برای حجم نمونه نابرابر بزرگ |

46800 | من داده های زیر را دارم، نمی دانم چگونه آن را به درستی توصیف کنم. محدودیت غلظت قابل تشخیص 0.375 است، بنابراین، نمونه 3، غلظت در d0 و d6 شناسایی نشد. چگونه می توانم غلظت را در d0، d6 توصیف کنم وقتی می خواهم تکامل غلظت را بر اساس زمان منعکس کنم؟ برخی استفاده از 0.375 را پیشنهاد کردند در حالی که برخی دیگر استفاده از 0.375/2 را پیشنهاد کردند. کدام صحیح است * نمونه - زمان(د) - غلظت * 3 - 0 - BLQ<(0.375) * 3 - 6 - BLQ<(0.375) * 3 - 12 - 0.401 * 3 - 18 - 0.667 * 4 - 0 - BLQ<(0.375 ) * 4 - 6 - 0.394 * 4 - 12 - 0.388 * 4 - 18 - 0.402 * 4 - 24 - 2.02 * 4 - 30 - 7.70 * 5 - 0 - BLQ<(0.375) * 5 - 6 - 0.512 * 5 - 12 - 0.557 * 5 -4 - 4. 24 - 9.63 | چگونه داده های سریال را با برخی مقادیر تحت محدودیت شناسایی شده توصیف کنیم؟ |

51033 | من در حال تست تفاوت چندین گروه مختلف هستم، یعنی > **A** در مقابل **B** > > **C** در مقابل **D** آیا اجرای چند t-test، یکی برای هر زوج، مشکلی ندارد؟ چون هیچ گروهی دوبار تست نمیشه؟ خیلی خیلی ممنون، [ویرایش] A، B، C، D شرایط مختلف یک آزمایش هستند، یعنی A - عملکرد کاربران با دستگاه A B - عملکرد کاربران با دستگاه B C - عملکرد کاربران با دستگاه C D - عملکرد کاربران با دستگاه D و من میخواهم A را در مقابل B، و C در مقابل D را آزمایش کنیم. این آزمایش شامل استفاده از چهار دستگاه مختلف برای انجام یک وظیفه عملیات دور مشخص است. هر کاربر (20) آزمایشی را با تمام شرایط (دستگاهها) A، B، C، D و غیره انجام میدهد. بنابراین من ماتریسی از عملکردهای 20 (کاربران) x 4 (شرایط) دارم و میخواهم A (ستون 1) را آزمایش کنم. در مقابل B (ستون 2) و C (ستون 3) در مقابل D (ستون 4). | اجتناب از خطای نوع I در آزمونهای t چندگانه گروههای مختلف دادهها |

17882 | من یک لیست حقیقت پایه دارم، آن را A می نامم، و روش های مختلفی برای تولید لیست ها دارم که باید تا حدودی شبیه به هم باشند. رشته ها.. من با این چیزها تازه کار هستم، دقت متوسط را امتحان کردم و نتایج منطقی بود، سپس سعی کردم از همبستگی رتبه اسپیرمن استفاده کنم، اما در نهایت چیزی شبیه A = [abd را با هم مقایسه کردم. abc، cad] و B = [abd، decf، hhj، cad، .. ] بنابراین اندازههای لیست متفاوت بود، آیا حتی میتوان از Spearman در اینجا استفاده کرد؟ و از چه روش های دیگری می توانم استفاده کنم؟ | راه های خوب دیگری برای یافتن میزان شباهت بین لیست ها چیست؟ |

10822 | من نمی توانم یک نام موجود برای تابع مقایسه ای که نوشتم پیدا کنم. من دو لیست از مقادیر دارم که می خواهم آنها را با هم مقایسه کنم. در ابتدا از jaccard استفاده کردم، اما بعد متوجه شدم که باید طول لیست دوم را حذف کنم زیرا به نظر نمی رسد در مورد استفاده من چیزی برای گفتن داشته باشد. بنابراین من jaccard را به: $$ sim(L1,L2) = \frac{|L1 \cap L2|}{|L1|} $$ تغییر دادم یک مثال ممکن است این باشد: L1 = {name, test, somevalue} L2 = {name , foo , bar , baz , some , تصادفی , other , مقادیری که , , flood , jaccard , مقایسه , به عنوان , آنها نیز بسیار } $$ sim(L1,L2) = \frac{|L1 \cap L2|}{|L1|} = \frac{|\\{name\\}|}{|\\{نام، آزمایش، مقداری\\}| } = \frac{1}{3} $$ برای کوتاه کردن داستان، فقط میخواهم محاسبه کنم که چند درصد از مقادیر L1 در L2 هستند. آیا کسی می داند که آیا نامی برای چنین تابعی وجود دارد تا بتوانم در کد منبع خود نام خوبی برای آن بگذارم؟ | آیا نامی برای تابع | وجود دارد فرقه L1 L2 | / | L1 | |

46804 | من می خواهم از صاف کردن Good-Turing استفاده کنم تا احتمال صید نوع بعدی را بیابم. اگر قبلاً موارد زیر را صید کرده باشم: 1 ماهی کپور، 1 ماهی سوف، 1 ماهی سفید، 1 قزل آلا سپس N1 = 4، زیرا یک بار چهار نوع ماهی دیده ام. من میدانم که با Good-Turing، احتمال اینکه ماهی بعدی که قبلاً ندیدهام باشد، «P=N1/N» باشد، پس آیا این به این معنی است که «P(unseen) = 4/4 = 1.0»؟ این درست به نظر نمی رسد، زیرا احتمال اینکه ماهی بعدی قزل آلا باشد «p(trout)=0.0» است. آیا این درست است، یا زمانی که تنها «Nc» من «N1» است، باید کار دیگری انجام دهم؟ | صاف کردن با تورینگ خوب زمانی که همه چیز یک بار ظاهر شود |

10821 | من سعی می کنم تأثیر یک مداخله را ارزیابی کنم. من یک طرح rct تصادفی گروهی دارم و ثابت کردهام که یک اثر طراحی دارم و بنابراین باید برای مدرسه کنترل کنم. تا کنون موفق شده ام داده های خود را به گونه ای بازسازی کنم که اکنون عمودی هستند و متغیری به نام time دارم که نشان دهنده نقاط زمانی قبل و بعد من است. اگرچه من به طور موثری از نظر SES تصادفیسازی کردهام، روش استخدام من (دعوت از والدین برای شرکت در برنامه فرزندپروری در مقابل مطالعه پرسشنامه) منجر به یک گروه مداخله به طور قابلتوجهی پریشانتر در صورت گزارش توسط والدین (اما نه زمانی که کودک گزارش میکند) شده است. . من از کتاب _Multilele and longitudinal Modeling with IBM SPSS_ Heck, Thomas & Tabata, 2010 استفاده کرده ام که عالی است، اما نمی توانم بفهمم که چگونه یک مدل اندازه گیری تکراری دو سطحی ساده را اجرا کنم. آیا کسی مرجعی را می شناسد یا می تواند در مورد نحو به من کمک کند؟ به نظر می رسد با آنچه استفاده کرده ام یک پیام خطا دریافت می کنم و نمی دانم مدرسه، متغیر گروهم را کجا قرار دهم، بنابراین می توانم آن را کنترل کنم. SDQPT مختلط با زمان Int_Cont /CRITERIA=CIN(95) MXITER(100) MXSTEP(5) SCORING(1) SINGULAR(0.000000000001) HCONVERGE(0،ABSOLUTE) LCONVERGE(0، PCONVERGE0ABSOLUTE0) /FIXED=Time Int_Cont Time*Int_Cont | SSTYPE(3) /METHOD=REML /PRINT=G SOLUTION TESTCOV /RANDOM=INTERCEPT Time | SUBJECT(CodeNumb) COVTYPE(UN) /REPEATED=زمان | SUBJECT(CodeNumb) COVTYPE(DIAG). با تشکر از کمک شما!!! آیا این است؟ من ثابت کردهام که خودرگرسیون بهترین مدل را دارد (SCASPT معیار من برای سنجش اضطراب است؛ Int_Cont متغیر گروهبندی من است و زمان 0=زمان 1 و 1=زمان 2 است): SCASPT MIXED BY Int_Cont Time /CRITERIA=CIN(95) MXITER (100) MXSTEP (5) امتیاز (1) SINGULAR(0.000000000001) HCONVERGE(0، ABSOLUTE) LCONVERGE(0، ABSOLUTE) PCONVERGE(0.000001، ABSOLUTE) /FIXED=Int_Cont Time Int_Cont*Time | SSTYPE(3) /METHOD=REML /PRINT=G R SOLUTION TESTCOV /REPEATED=زمان | SUBJECT(School*CodeNumb) COVTYPE(AR1). اگر مرجعی را بشناسید که این موضوع را به روشی واقعاً ساده برای کسی که دانش آماری بسیار محدودی دارد، توضیح دهد، واقعا متشکر می شوم. دنبال کردن مرجع هک برای من کمی سخت است. با تشکر | چگونه می توانم یک تحلیل اندازه گیری های مکرر مدل ترکیبی را در SPSS برای ارزیابی اثر مداخله در حین کنترل مدرسه اجرا کنم؟ |

82567 | ماتریس همبستگی من همبستگی های خیلی بالایی را نشان نمی دهد (کمتر از 0.5)، اما با این حال، وقتی مدل های جلوه های ثابت پانل را رگرسیون می کنم، همه متغیرهای من حذف می شوند و نشان می دهد که به دلیل هم خطی بودن بین متغیرها است. راه برون رفت از آن چیست؟ | هم خطی بین متغیرهای توضیحی |

93956 | فرض کنید که دمای $T_{ij}$ را برای سوژههای $i =1، \dots،4$ و $j= 1، \dots،4$ نقاط زمانی اندازهگیری میکنید. برای موضوع 1، فرض کنید $T_{12}$ و $T_{14}$ موجود نبودند. اگر یک مدل ترکیبی خطی را اجرا می کنید، آیا کل رکورد برای موضوع 1 را حذف می کنید؟ | مشاهدات گمشده در یک مدل مختلط خطی |

93955 | من میخواهم همزمان نقشههای خطی $k$$\\{\phi_0, \dots,\phi_{k-1} \\}$ را همزمان یاد بگیرم: $min \sum_{i=0}^{k- 1} \sum_{j=i+1}^{k-1}||X_i \phi_i - X_j \phi_j||_2^{2}$، به طوری که $||X_{ij} \phi_i||_2^2 = 1$ (بردار ردیف چرخشی) با توجه به دادههای ${X_i, X_j} \in \mathbb{R}^{m\times n}$, ${\ phi_i، \phi_j} \in \mathbb{R}^{n\times n}$، و ردیفها قبلاً عادی شدهاند $||X_{ij}||_2^2 = 1$ این ما را مجبور میکند تا ماتریسهای چرخشی را یاد بگیریم که ورودی k-spheres را در یک کره مشترک ترسیم میکنند. اگر این مشکل قبلاً مطالعه شده باشد، نظری دارید. من دوست دارم پیشنهادات شما را بشنوم. | رگرسیون خطی k مشترک |

110344 | هنگام انجام یک تجزیه و تحلیل مداخله با داده های سری زمانی (معروف به سری های زمانی منقطع) همانطور که در اینجا بحث شد، برای مثال یکی از الزامات من این است که کل سود (یا ضرر) ناشی از مداخله را تخمین بزنم - یعنی تعداد واحدهای به دست آمده یا از دست رفته (متغیر Y) ). کاملاً درک نکردم که چگونه می توان تابع مداخله را با استفاده از یک تابع فیلتر در R تخمین زد، به روشی بی رحمانه به آن پرداختم، امیدوارم این به اندازه کافی کلی باشد که در هر موقعیتی کار کند. اجازه دهید بگوییم که با توجه به ساختار cds<- (c(2580L, 2263L, 3679L, 3461L, 3645L, 3716L, 3955L, 3362L, 2637L, 2524L, 2084L, 2084L, 2031,2031L 3253L, 2881L, 2555L, 2585L, 3015L, 2608L, 3676L, 5763L, 4626L, 3848L, 4523L, 4186L, 4070L, 4349L, 4186L, 4070L, 4090L 1L)، .Dimnames = list(NULL, CD), .Tsp = c(2012, 2014.33333333333, 12), class = ts) تصمیم می گیریم که بهترین مدل برازش به شرح زیر است، با تابع مداخله به عنوان $ m_t= \frac{\omega_0}{(1-\delta B)}X_t$ که در آن $X_t$ یک پالس است در اکتبر 2013. fit4 <- arimax(log(cds)، order = c(1،1،0)، include.mean=FALSE، xtransf = data.frame(Oct13 = 1*(seq_along(cds)==22) ), انتقال = لیست(c(1,0)) ,xreg=1*(seq_along(cds)==3)) fit4 # ARIMA(1،1،0) # ضرایب: # ar1 xreg Oct13-AR1 Oct13-MA0 # -0.0184 0.2718 0.4295 0.4392 # s.e. 0.2124 0.1072 0.3589 0.1485 # sigma^2 به صورت 0.02176 تخمین زده شده است: log likelihood=13.85 # AIC=-19.71 AICc=-16.98 BIC=-13.05 من دو سوال دارم: 1) اگر چه ما تابع ARI را ارزیابی می کنیم. که در آن زمان بود از نظر فنی با استفاده از سری متفاوت $\bigtriangledown X_t $ مناسب است آیا برای تغییر برآورد $\omega_0$ یا $\delta$ از استفاده از $\bigtriangledown X_t $ به $ X_t $، باید کاری انجام دهیم؟ 2) آیا این درست است: برای تعیین سود مداخله، مداخله $m_t$ را از پارامترها ساختم. هنگامی که $m_t$ داشته باشم، مقادیر برازش را از مدل fit4 (exp() برای معکوس کردن گزارش) با exp (مقادیر برازش منهای $m_t$) مقایسه می کنم و مشخص می کنم که در طول دوره مشاهده شده، مداخله منجر به 3342.37 واحد اضافی شده است. . **آیا این فرآیند برای تعیین سود عموماً از تجزیه و تحلیل مداخله صحیح است؟** int_vect1<-1*(seq_along(cds)==22) wo<- 0.4392 delta<-0.4295 mt<-rep(0,length (int_vect1)) برای (i در 1:length(int_vect1)) { if (i>1) { mt[i]<-wo*int_vect1[i]+delta*mt[i-1] } } mt sum(exp(fitted(fit4)) - (exp(fitted(fit4) - mt))) | مداخله با تفاوت |

91832 | در یک مدل گرافیکی، دو متغیر تصادفی با توجه به اجداد مشترکشان، مستقل شرطی هستند. آیا مدل های گرافیکی می توانند علاوه بر استقلال شرطی، استقلال را نیز نشان دهند؟ | آیا مدل های گرافیکی می توانند علاوه بر استقلال شرطی، استقلال را نیز نشان دهند؟ |

10827 | من در حال بررسی تعامل بین دو متغیر هستم ($x_1$ و $x_2$). همبستگی خطی زیادی بین این متغیرها با $r>0.9$ وجود دارد. از نظر ماهیت مشکل نمی توانم چیزی در مورد علیت بگویم (اینکه $x_1$ باعث $x_2$ می شود یا برعکس). من می خواهم انحرافات از خط رگرسیون را مطالعه کنم تا نقاط پرت را تشخیص دهم. برای انجام این کار، می توانم یک رگرسیون خطی $x_1$ به عنوان تابعی از $x_2$ بسازم یا برعکس. آیا انتخاب ترتیب متغیر من می تواند بر نتایج من تأثیر بگذارد؟ | آیا ترتیب متغیر در رگرسیون خطی اهمیت دارد؟ |

96709 | یک نمونه تصادفی ساده با اندازه $n=n_1 + n_2$ بدون جایگزینی از یک جمعیت محدود به اندازه $N$ ترسیم می شود. بعلاوه یک نمونه تصادفی ساده به اندازه $n_1$ بدون جایگزینی از نمونه اول ترسیم می شود. اجازه دهید $\bar y$ و $\bar {y_1}$ میانگین نمونه مربوطه باشند. V($\bar {y_1}$) و V ($\bar {y_2}$) را پیدا کنید، جایی که $\bar {y_2}$ میانگین واحدهای باقیمانده $n_2$ در اولین نمونه است. Cov($\bar {y_1}$,$\bar {y_2}$) را نیز پیدا کنید. فرض کنید $S^2$ واریانس جمعیت است. * * * این کاری است که من تاکنون توانسته ام انجام دهم: توجه داشته باشید که $\bar {y_2}$ = $\frac{(n\bar y) - n_1\bar {y_1}}{n_2}$. همچنین، V($\bar {y_1}$) = $E_1[V_2(\bar {y_1})] + V_1[E_2(\bar {y_1})]$. پس از سادهسازی، معلوم شد که $(\frac1{n_1} - \frac1N)S^2$ است. حالا من در مسیر درستی هستم؟ همچنین، مقداری کمک در یافتن $V(\bar y_2)$ و کوواریانس قدردانی خواهد شد. | برای یافتن واریانس و کوواریانس برای مسئله نمونه گیری دوگانه |

96700 | این دپارتمان دارای یک سیستم آنلاین است که به موجب آن دانشجویان می توانند داوطلبانه برای شرکت در مطالعات آزمایشگاهی ثبت نام کنند تا برای درس خود امتیاز کسب کنند. دانش آموزان باید این سیستم آنلاین را مرتباً بررسی کنند تا ببینند آیا علاقه مند به شرکت در هر یک از مطالعات ذکر شده هستند یا خیر. همچنین آنها برای ثبت نام برای شرکت در مطالعات در صورت نیاز به اعتبار اضافی به آن سامانه آنلاین مراجعه می کنند. من به عنوان یک محقق، وقتی وارد پایگاه داده سیستم آنلاین می شوم، با تمام دانشجویانی که ابراز علاقه کرده اند تماس می گیرم تا آنها را به آزمایشگاه خود دعوت کنم. از 400 دانش آموز، تنها 50 دانش آموز برای مطالعه حاضر می شوند. آیا این به عنوان یک نمونه تصادفی در نظر گرفته می شود؟ با تشکر | آیا این یک نمونه تصادفی محسوب می شود؟ |

16375 | سوال من از این پست الهام گرفته شده است. با این حال، توضیح کمی پیچیده تر از آن است. امیدوارم موفق بشم من با داده های RNA-Seq در مورد پیوند جایگزین در گیاهان کار می کنم. برای این بحث، بیایید **رویدادهای پرش اگزون** را در نظر بگیریم. اجازه دهید $g_{1}، g_{2}، ...، g_{n}$ نمایانگر همه ژنهایی باشند که _expressed_ میشوند. یک ژن بیان میشود به این معنی که وقتی دادههای RNA-Seq خود را که معمولاً خواندههای کوتاه هستند (در مورد من به طول 80 جفت باز) به ژنوم بازمیگردم، مقدار مشخصی از خواندهها به آن ژن (محل) نگاشت میشوند. . مقدار _مشخص_ بر اساس یک _آستانه_ دلخواه است، در صورت نیاز، مثلاً 20 خواندن کوتاه. استفاده نشده است، اما برای وضوح، اجازه دهید $m >= n$ تعداد کل ژن های ژنوم باشد. > 1. مجموع تعداد قرائت هایی که به ژنوم نگاشت می شوند $R$، مثلا > (معمولاً به ترتیب میلیون ها) است. > 2. فرض کنید $r_{i}$ قرائتهای نگاشت شده به ژن بیان شده $g_{i}$ باشد (معمولاً > صدها تا هزاران). > 3. فرض کنید، در ژن $g_{i}$، یک اگزون $j$ = $e_{ij}$ $r1_{ij}$ > بار خوانده است و $r2_{ij}$ بار skipped_ می شود. > اکنون، من میخواهم احتمال این را پیدا کنم که این رویدادهای پرش اگزون $r2_{ij}$ به طور تصادفی رخ میدهند. سوال من این است که آیا می توانم از یک توزیع ابر هندسی دو متغیره استفاده کنم که به این سوال پاسخ می دهد (اصلاح شده از پاسخ کارل از پست لینک شده در بالا): > احتمال بدست آوردن $r2_{ij}$ یا بیشتر توپ های سفید در یک نمونه > با اندازه چقدر است. $(r1_{ij}+r2_{ij})$ از کوزهای با $r_{i}$ توپهای سفید و $(R - > r_{i})$ سیاه توپ ها؟ من گیج شده ام زیرا، 1. خوانش هایی که به ژن $g_{i}$ نشان می دهد به میزان بیان ژن بستگی دارد. در حالت ایدهآل (یا از نظر بیولوژیکی)، نمیتوانم مطمئن باشم که بیان ژن این ژن (= نقشهبرداری شده) مستقل از (ژن) دیگری است، زیرا ممکن است ژن دیگری بر بیان آن تأثیر گذاشته باشد، اما راهی برای دانستن این موضوع وجود ندارد. از اطلاعاتی که دارم 2. من ژن های دیگری دارم که در آن رویدادهای پرش اگزون رخ می دهد و ژن هایی که در آنها بیش از 1 رویداد پرش اگزون رخ می دهد. آیا می توانم مقادیر p را از توزیع ابر هندسی بدست بیاورم و سپس یک تصحیح آزمایش چندگانه انجام دهم؟ یا تبدیل به یک مشکل _چند متغیری می شود؟ یا این طرز فکر برای این مشکل صدق نمی کند، شاید رویکرد کاملا متفاوتی وجود داشته باشد. | استفاده از توزیع فراهندسی برای پرش از رویدادها در توالی رونوشت |

110346 | من در حال مطالعه مقاله ای در مورد تحلیل توان و محاسبات اندازه نمونه برای دسته ای از مدل ها بودم که به عنوان مدل های بقای طولی مشترک شناخته می شوند. این مقاله یک فرمول فرم بسته را برای محاسبه توان و اندازه نمونه استخراج می کند. مقاله یک مقاله مکرر است به این معنا که مفروضات پارامتریک را فرض می کند و بر اساس آن فرضیات احتمال، تابع امتیاز و ... را می گیرد و در نهایت فرمول را می گیرد. می خواستم بدانم که چگونه آنالیز توان و محاسبات اندازه نمونه در چارچوب بیزی انجام می شود؟ احتمالاً سؤال من یک سؤال ساده لوحانه است، مخصوصاً که من در تجزیه و تحلیل قدرت متخصص نیستم، اما فکر می کنم مهم نیست که چگونه به یک مسئله برخورد کنیم، زمانی که یک فرضیه داریم، تجزیه و تحلیل توان ضروری است. بنابراین، ابتدا می خواستم بپرسم: 1) آیا تحلیل توان در چارچوب بیزی نیز انجام می شود؟ 2) آیا کسی می تواند با مهربانی به برخی از مقالات در مورد تحلیل قدرت از دیدگاه بیزی ارجاع دهد؟ اگر بتوانم یک تحلیل توان برای مشکلات حل شده با رویکردهای غیر پارامتری بیزی پیدا کنم، عالی خواهد بود. خیلی ممنون، | تحلیل قدرت از دیدگاه بیزی |

21885 | من در حال ایجاد برنامه ای برای جمع آوری و تجزیه و تحلیل قیمت کالاها هستم و به کاربر در صورت کاهش قیمت هشدار می دهم تا بتواند آن را در فروش خریداری کند. من آمار کمی را می دانم (مثلاً انحراف معیار) اما به دنبال بهترین راه برای تعیین اینکه آیا کاهش قیمت در مقایسه با قیمت های تاریخی قابل توجه است یا خیر - به عنوان مثال، آیا من باید به خود زحمت بدهم که کاربر را در مورد کاهش قیمت هشدار دهم. مثلاً بگوییم که برنامه من جمع آوری قیمت کتاب است. مثلاً به صورت روزانه یا هفتگی برای قیمت کتاب (چه استفاده شده و چه جدید) وب را جستجو می کند و این داده ها را در یک پایگاه داده ذخیره می کند. من میتوانم نموداری از قیمتها در طول زمان (هر دو پایینترین قیمت، میانگین قیمت، و غیره) تهیه کنم و به صورت بصری تعیین کنم که چه زمانی قیمت به میزان قابل توجهی کاهش مییابد - انجام این کار برای یک فرد آسان است. اما بهترین الگوریتم آماری برای تعیین این چیست؟ من میتوانم به چند مورد فکر کنم که در آن یک فرد وقتی قیمت کاهش مییابد، یک محصول را میخرد: 1. اگر قیمت به زیر یک مانع ثابت خاص کاهش یابد. به عنوان مثال، اگر مشتری تشخیص دهد که محصول را با قیمت کمتر از 15 خریداری می کند، هر زمان که قیمت به کمتر از آن مقدار رسید، باید به او هشدار داده شود. این سناریو مبتنی بر این ایده است که مشتری بر این باور است که قیمت در نهایت در مقطعی در آینده به آن پایین خواهد رسید. 2. اگر قیمت به میزان قابل توجهی از قیمت فعلی افت کرد. این در برخی سناریوها واقعی تر است. به عنوان مثال، اگر کتاب کمیاب و نسبتاً گران قیمتی وجود داشته باشد (مثلاً توسط یک ناشر دانشگاهی فقط با چند هزار نسخه چاپ شده است، همه با جلد گالینگور، که در زمان جدید به قیمت 150 فروخته می شود و فقط چند نسخه در بازار وجود دارد. ) - کتاب ممکن است در زمان فعلی با قیمت متوسط 85 در دسترس (استفاده شده) باشد. قیمت ممکن است هرگز به 15 کاهش پیدا نکند، زیرا عرضه بسیار کم است. با این حال، ممکن است به قیمت بسیار پایینتری (40 یا 50) کاهش یابد، اما مشتری قیمت خاصی ندارد که کتاب را از کجا بخرد. 3. اگر قیمت کتاب بسیار پایین بیاید. یک کتاب ممکن است امروز با قیمت 20 به فروش برسد، اما مشتری ممکن است بخواهد صبر کند و ببیند آیا یک کتابفروش قرار است آن را به قیمت 5 تا 8 به فروش برساند، زیرا آنها در حال حاضر به این کتاب نیاز ندارند - اما این کتاب در لیست آرزوهای آنها است. من به این سناریوی دوم و سوم علاقه دارم. اساساً من میخواهم بتوانم تعیین کنم چه زمانی یک کالا با قیمتی قابل توجه در دسترس است. من تمام قیمت های تاریخی را در یک پایگاه داده ذخیره می کنم و می توانم قیمت های این هفته را با قیمت های تاریخی مقایسه کنم. پیشنهاد شما برای ابزارهای تجزیه و تحلیل آماری که می توان از آنها برای مطالعه این نوع داده ها و ارائه توصیه های خودکار استفاده کرد، چیست؟ | چگونه تعیین کنیم که آیا کاهش قیمت از نظر تاریخی قابل توجه است؟ |

56269 | این یک سؤال کاملاً کلی در مورد مشاهدات در مقابل مدلسازی و چگونگی به دست آوردن مجموعه مدلسازیشدهای است که بهترین تناسب/بازتولید مجموعهای از اشیاء مشاهدهشده را دارد. من مجموعه ای از اشیاء مشاهده شده/اندازه گیری شده دارم که مجموعه $O$ را می نامم. اشیاء $N$ در $O$ ($n_1$، $n_2$، ...، $n_N$) هستند و هر یک با مقادیر پارامترهای $k$ مرتبط خود مشخص میشوند: $O = \\{ n_1 (x_{11},x_{12},...,x_{1k})\,;\, n_2(x_{21},x_{22},...,x_{2k})\,;\, ... \,;\, n_N(x_{N1},x_{N2},..., x_{Nk})\\}$ من یک مدل $M$ دارم که به متغیری ($a$) بستگی دارد که تلاش میکند این مجموعه مشاهدهشده را با تولید اشیاء مصنوعی با همان $k$ بازتولید کند. پارامترها هر بار که مقدار $a$ متفاوتی به مدل می دهم مجموعه جدیدی $M(a)$ متشکل از تعداد معینی شیء مصنوعی/شبیه سازی شده تولید می کنم. من این کار را برای مقادیر $q$ از $a$ انجام میدهم و مجموعههای $q$ را بدست میآورم: $M(a_1) = \\{ m_1(y_{11},y_{12},...,y_{1k}) \,;\, m_2(y_{21},y_{22},...,y_{2k})\,;\, ... \,;\, m_{M_1}(y_{M_11}، y_{M_12}،...، y_{M_1k})\\}$ . . . $M(a_q) = \\{ m_1(y_{11},y_{12},...,y_{1k})\,;\, m_2(y_{21},y_{22},... ,y_{2k})\,;\, ... \,;\, m_{M_q}(y_{M_q1},y_{M_q2},...,y_{M_qk})\\}$ هشدارها: 1- تعداد کل اشیاء تولید شده توسط هر تکرار مدل با مقدار متفاوت $ a$ (یعنی: $M_1$، $M_2$، ...، $M_q$) لزوماً برابر نیستند و حتی بیشتر لزوماً برابر با $N$ نیستند. تعداد اشیاء_مشاهده شده). 2- هیچ مطابقت یک به یک بین اشیاء مشاهده شده و مدل شده در $k-space$ پارامترهای آن وجود ندارد (یعنی: $m_1$ شبیه سازی $n_1$ نیست). این مدل سعی میکند کل مجموعه مشاهدات ($O$) را بازتولید کند، نه هر شی را یک به یک. بنابراین چیزی که من دنبال آن هستم روشی برای به دست آوردن مجموعه _modelled_ $M(a)$ است که **بهترین مناسبت** با مجموعه _observed_ $O$ است. | مدل در مقابل مشاهده، به دست آوردن تناسب بهینه |

96702 | من دو کتاب درسی را در مورد EFA بررسی کرده ام، یکی کار اصلی گورسوچ (1974، تحلیل عاملی) و دیگری تحلیل عاملی اکتشافی و تاییدی نوشته تامپسون (2004). هر دو قبل از انتخاب **روش استخراج عامل** در توالی تصمیم گیری EFA، **تعیین تعداد عوامل** را که باید استخراج شوند به عنوان مرحله ای توصیف کردند. اما من تعجب می کنم که همه معیارها برای تعیین تعداد عوامل (مثلاً معیار قیصر، آزمون Scree و غیره) نیاز به نوعی استخراج عامل دارند که قبلاً انجام شود. پس آیا این نویسندگان اشتباه می کنند؟ یا چیزی را از دست داده ام؟ | محل تعیین تعداد عوامل در توالی تصمیم گیری EFA |

97252 | من برای استنباط آزمونهای فرضیههای آماری انجامشده در زانتلاسماتا، آرکوس قرنیه و بیماری عروقی ایسکمیک و مرگ در جمعیت عمومی به کمک نیاز دارم: مطالعه کوهورت آیندهنگر، BMJ. 2011 (اینجا را ببینید). مشکل مقاله این است که بخشی از **تحلیل آماری** در مورد برخی آزمون ها و فرضیه هایی صحبت می کند که محققان از آنها استفاده می کنند، اما از طرف دیگر آنها به هیچ وجه آن ها را تجزیه و تحلیل نکرده اند. من سعی می کنم بفهمم چرا آنها از این روش ها استفاده می کنند و این روند چگونه پیش می رود. ممکن است لطفاً نکاتی را به من ارائه دهید؟ به نظر شما تحقیق فوق چگونه سازماندهی شده است؟ به عنوان مثال: محققان از چه روشهایی برای آزمون فرضیه استفاده میکنند؟ _(پاسخ خود را توجیه کنید)_ چه نوع داده هایی باید در هر مطالعه بالا جمع آوری و استفاده شود؟ به نظر شما نتیجه ای که از اعمال هر یک از این روش ها به دست می آید چیست؟ | استنباط آزمون های آماری انجام شده در یک مقاله |

61878 | من دانش کمی از آمار دارم و به این فکر می کردم که از چه آزمایش هایی برای یک پروژه مبتنی بر شواهد (نه تحقیق، بنابراین از گروه کنترل استفاده نمی کنم) که دارم استفاده کنم. * پس از مداخله آموزشی دانشآموز، از چه آزمون آماری برای آزمونهای قبل و بعد دانش استفاده کنم؟ * همچنین، آیا نتایج آزمون عددی داده های بازه ای در نظر گرفته می شود و آیا من به دنبال تفاوت میانگین بین آزمون های قبل و بعد از دانش هستم؟ من همچنین نمرات قبل و بعد از اطمینان دارم که یک مقدار منفی دارد: 0: موافق نیستم و دو مقدار مثبت: 1: تا حدودی موافقم و 2: کاملاً موافقم. از چه آزمون آماری برای بررسی اطمینان استفاده کنم؟ آیا این دادههای ترتیبی است و آیا من دوباره به دنبال تفاوت میانگین بین نظرسنجیهای قبل و بعد از اطمینان هستم؟ | تجزیه و تحلیل اندازه گیری های قبل و بعد از مداخله بدون گروه کنترل |

61301 | من در حال انجام تجزیه و تحلیل نرخ بستری مجدد برای یک واحد بیمارستانی بین سالهای 2009 و 2012 هستم. فهرستی از دادههای «تاریخی» دارم که در آن بیماران مداخله انجام ندادهاند. سپس من مجموعه متفاوتی از بیماران دارم که مداخله را انجام دادند. سوال من این است که آیا در نظر گرفتن مجموعه داده های تاریخی به عنوان یک گروه مقایسه در تحلیل کافی است؟ در حالت ایدهآل، من یک گروه مقایسه مشابه (غیر معادل) میخواهم که مداخله را دریافت نکرده و پس از شروع مداخله دنبال شود، اما من معتقدم که این در دسترس نیست (از صحبت با مدیران دادهها). همچنین داشتن چندین گروه پایه، اعتماد من به مداخله را افزایش می دهد که بر تغییر در بستری مجدد تأثیر می گذارد. اگر این داده ها را نداشته باشم، آیا استفاده از گروه پایه تکی هنوز مشکلی ندارد؟ با تشکر از کمک شما. | گروه کنترل سری زمانی منقطع |

25165 | من یک مجموعه داده پانل نامتعادل از 40 شهر و 20 سال دارم. نامتعادل است زیرا داده ها برای شهرهای خاصی برای هر سال جمع آوری نمی شوند. سپس داده ها پس از این 20 سال متعادل می شوند. فرض کنید دورههای زمانی 1960 تا 1979 و سپس 1980 تا 1999 باشد. من میخواهم دادههای سال 1979 را با دادههای سال 1980 مقایسه کنم، اما انجام این کار تا حدودی دشوار است زیرا دادههای سال 1979 مشاهدات گمشدهای دارند. چگونه این کار را انجام دهم؟ آیا باید پیش بینی کنم که اگر داده ها با استفاده از داده های نامتعادل متعادل شده بودند، داده های سال های 1960 تا 1979 چه می شد؟ سپس پیشبینی دادهها، دادههای 1979 را متعادل میکند تا بتوانم دادههای سال 1979 را با سال 1980 مقایسه کنم. نگرانی من این است که پیشبینی دادههای سال 1979 با استفاده از دادههای 1960-1979 ممکن است باعث شود که این سری ذاتاً با دادههای 1980 پیوسته نباشد. | تنظیم داده ها برای مشاهدات گمشده |

28879 | من به دنبال چند کتابخانه در R هستم که می توانند یادگیری افزایشی (که به آن یادگیری آنلاین یا متوالی نیز گفته می شود) انجام دهند. مورد استفاده از چنین یادگیری در مقایسه با روش های دسته ای سنتی، پردازش مقادیر زیادی از داده ها خواهد بود. چنین شیوههایی شامل جریانها و دادههای حسگرها میشود، که در آنها نمیتوان همیشه از همان مدل استفاده کرد یا هر بار مدل را از ابتدا بازسازی کرد. هر الگوریتم یادگیری ماشینی که بتواند تنها از یک مثال جدید برای تغییر مدل استفاده کند، کافی است. با این حال، خود مدل نباید روی دادههای قدیمی نگه داشته شود (همانطور که میتوانید تصور کنید به زودی خیلی بزرگ میشود)، در عوض فقط مقداری آمار در مورد دادهها را محاسبه میکند. برای رگرسیون چند متغیره، رویکرد آنلاین مانند نزول گرادیان استوکاستیک گزینه خوبی خواهد بود. برای درختان رگرسیون / مدل چیزی شبیه به این مقاله به ذهن می رسد. من به دنبال چنین کتابخانهای هستم که در آن دقت **پیشبینی** نسبتاً خوبی (با توجه به روشهای دستهای سنتی) بر اساس مدل در حال تکامل قابل دستیابی باشد. | روش های یادگیری افزایشی در ر |

57132 | من از «glm» برای پیدا کردن مدلی با استفاده از دادههای آموزشی استفاده میکنم و سپس از دادههای آزمایشی استفاده میکنم تا ببینم مدل چقدر خوب رفتار میکند. متغیر پاسخ من عددی است. در زیر یک نمونه اسباب بازی است که مراحل انجام شده توسط من را نشان می دهد: خلاصه کتابخانه(ماشین)(Prestige) head(Prestige) testidx <- which(1:nrow(Prestige)%%4==0) prestige_train <- Prestige[- testidx,] prestige_test <- Prestige[testidx,] model <- glm(prestige~., data=prestige_train) # از مدل برای پیشبینی خروجی پیشبینی دادههای آزمون استفاده کنید <- predict(model, newdata=prestige_test) # همبستگی را با نتیجه واقعی بررسی کنید cor(prediction, prestige_test$prestige) سؤال من این است: 1. غیر از «cor»، از چه آمار دیگری (توابع R) می توانم برای دانستن خوبی تناسب استفاده کنم؟ 2. چگونه می توانم این تناسب را به صورت گرافیکی در R نشان دهم؟ با تشکر | چگونه ببینم مدل من چقدر خوب است؟ |

68508 | من سعی می کنم از شبکه عصبی برای یادگیری یک تابع غیر خطی ورودی نگاشت به خروجی ها استفاده کنم. با این حال، من مشکلاتی با آن دارم. من از تابع فعال سازی tansig برای لایه های مخفی و برای خروجی از logsig استفاده کردم. من متغیرهای خروجی را در محدوده [0 1] مقیاس کردم. متغیرهای ورودی با میانگین صفر و واحد std استاندارد شدند. من شبکه عصبی را یاد می گیرم. اکنون وقتی مدل NN خود را بر روی مجموعه قطار یا مجموعه آزمایش دیگری آزمایش می کنم، خروجی ها همیشه بزرگتر از 0.5 هستند. چرا اینطور است؟ اهداف من می تواند از 0 تا 1 باشد. با این حال، خروجی های من از مدل حداقل 0.5 است. پیشنهادی دارید که چه اتفاقی می توانست بیفتد؟ من حدود 600 ویژگی با 5000 نمونه آموزشی و 10 نورون در لایه پنهان و یک خروجی دارم! برای لایه های پنهان و یک تابع فعال سازی خطی برای لایه های خروجی و من موارد زیر را دریافت کردم. این تا حدودی بهتر از قبل است. با این حال، من کمی تعجب کردم که چرا سوگیری معرفی شده است | مشکلات پیاده سازی شبکه عصبی |

93953 | برخی تحقیقات نشان می دهد که سیاستمداران زن نسبت به سیاستمداران مرد پلتفرم موضوعی متنوع تری را مطرح می کنند - به این معنی که آنها در مورد موضوعات متنوع تری نسبت به مردان بحث می کنند. من می خواهم ببینم آیا این در مطالعه من رخ می دهد یا خیر. من تجزیه و تحلیل محتوای توییتهای نامزدها را انجام دادم و از این درصدها برای ایجاد نمودارهای نواری 100% انباشته استفاده کردم که در اینجا پیوند دارند. بخش نسبتاً برجستهتر سیاهپوست میله مردان جمهوریخواه نشان میدهد که آنها اکثریت قریب به اتفاق بحثهای زنانه خود را به یک موضوع اختصاص دادهاند: مراقبتهای بهداشتی. بنابراین بحث در مورد مسائل زنانه آنها نسبتاً متمرکزتر بود. متناوبا، بحث در مورد مسائل زنانه حزبی زنان به ظاهر متنوعتر بود. مسئله من این است که نمی دانم چگونه به صورت استاتیک آزمایش کنم که آیا این تفاوت ها در نمودار میله ای قابل توجه هستند یا خیر. من به دنبال آزمونی هستم که توزیع نسبتها را با هم مقایسه کند تا بتوانم از نظر آماری بگویم که آیا زنان نسبت به مردان جمهوریخواه بحثهای متنوعتری را مطرح میکنند. پیشاپیش متشکرم | مقایسه توزیع نسبت ها |

61875 | من می خواهم چندین رابطه احتمالی هم انباشتگی را با آزمون همجمعی یوهانسن آزمایش کنم. من در حال حاضر از بسته urca در R با تست ca.jo استفاده می کنم. من قصد داشتم از تصحیح Bonferroni برای اصلاح میزان خطای خانوادگی استفاده کنم. با این حال، ca.jo مقادیر p را گزارش نمی کند. این فقط آمار تست و مقادیر بحرانی را گزارش می دهد: ###################### # Johansen-Procedure # ################ ######## نوع آزمون: آماره مقدار ویژه حداکثر (لامبدا حداکثر)، با روند خطی مقادیر ویژه (لامبدا): [1] 0.335639191 0.001256000 مقادیر آزمون آماری و مقادیر بحرانی آزمون: تست 10pct 5pct 1pct r <= 1 | 1.26 6.50 8.18 11.65 r = 0 | 408.52 12.91 14.90 19.19 [خروجی ca.jo بیشتر برداشته شد] چگونه می توانم هنگام انجام آزمایش های چندگانه هم انباشتگی، رد نادرست null را تصحیح کنم؟ | چگونه می توانم یک تصحیح میزان خطای خانوادگی برای آزمون های همجمعی جوهانسن انجام دهم؟ |

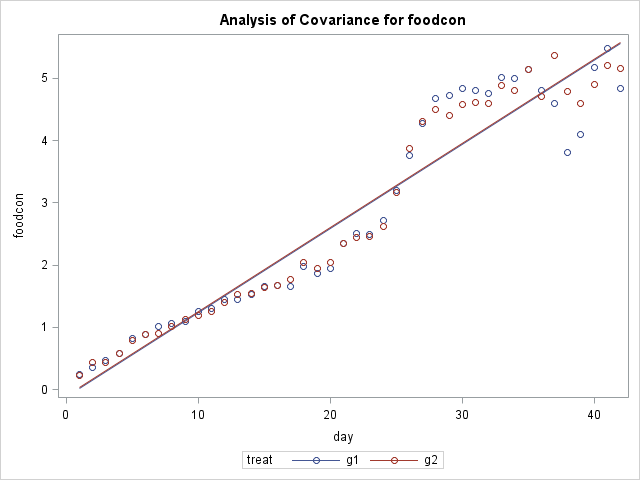

38995 | من یک طرح بلوک کاملا تصادفی با سه تیمار و چهار تکرار دریافت کردم. تنوع زیستی در چهار سال متوالی اندازه گیری شد. من فکر کردم که یک مدل ترکیبی با اندازهگیریهای مکرر به عنوان عبارتهای تصادفی باید برای تحلیل این طرح مناسب باشد. فرضیه من این است که با در نظر گرفتن همه سال ها، تنوع زیستی بین تیمارها متفاوت است. این تحلیل من است: library(nlme) library(multcomp) # Mydata مجموعه داده تصادفی ساخته شده <- data.frame( Treatment=rep(c(Control, Irrigation, Fertailization), 16), Block= rep(1:4، 12)، Year=rep(2000:2003، 12)، Value=runif(48، 0.5، 1.5) ) # درمان مدل یک اثر ثابت است، سال یک اثر تصادفی مناسب است <- lme(Value ~ Treatment, random = ~1|Year, data = mydata) # خلاصه مقایسه پس از آن (glht(fit,linfct=mcp (Treatment=Tukey))) سوالات من: 1. آیا مدل من درست است؟ 2. آیا مقایسه پس از آن مناسب است؟ 3. چگونه می توانم افکت bock را در آن لحاظ کنم؟ * * * اگر درست متوجه شدم، سال باید در Block تودرتو باشد - بنابراین مدل صحیح به این صورت کدگذاری می شود: fit <- lme(Value ~ Treatment, random = ~1|Block/Year, data = mydata) به نظر می رسد یک روند زمانی خطی در داده ها وجود دارد. چگونه می توانم این را در مدل حساب کنم؟ | استفاده از lme برای تجزیه و تحلیل یک طرح بلوک تصادفی کامل با اندازه گیری های مکرر: آیا مدل من درست است؟ |

25163 | اگر $n$ نمونه وجود دارد $X_1 \leq X_2 \leq ... \leq X_n$ از توزیع یکنواخت پیوسته با pdf $f(x)=\frac{1}{\theta},0\leq x \leq \theta$، پس به خوبی شناخته شده است که MLE برای $\theta$ $\hat{\theta}=X_n$ است. با این حال، اگر از bootstrap برای تخمین فاصله اطمینان $\hat{\theta}=X_n$ استفاده شود، می بینیم که فاصله اطمینان چیزی شبیه $[aX_n,X_n]، 0<a <1$ خواهد بود. من نمیپرسم آیا روش مونت کارلو وجود دارد که بتواند فاصله اطمینان معقولتری را ارائه دهد، شاید چیزی شبیه به $[X_n, bX_n]، b>1$؟ | یک روش فاصله اطمینان مونت کارلو برای حداکثر توزیع یکنواخت؟ |

96708 | من در مورد تخمین چگالی هسته مطالعه می کنم و از ویکی پدیا این فرمول را دریافت می کنم: $$\hat{f}_h(x, h) = \frac{1}{n}\sum^{n}_{i=1} K_h(x-x_i) = \frac{1}{nh}\sum_{i=1}^nK(\frac{x-x_i}{h}).$$ فکر میکنم این مقدار را دارم ایده اصلی این فرمول، اما عبارت هموارسازی $h$ چیزی است که من را آزار می دهد. اگر تابع هسته من گاوسی بود: $$K(u)=\frac{1}{\sqrt{2\pi}}e^{-\frac{1}{2}u^2}$$ میگرفتم برآوردگر من باشد: $$\hat{f}_h(x, h) = \frac{1}{nh\sqrt{2\pi}}\sum_{i=1}^n e^{-\frac{1}{2}u^2},$$ where $\displaystyle u = \frac{x-x_i}{h}.$ چرا عبارت $h$ در این فرمول است؟ کارکرد آن چیست؟ چرا مجموع را بر $h$ و غیره تقسیم می کنیم. کسی می تواند این را کمی توضیح دهد؟ | توضیح تابع برآوردگر چگالی هسته مورد نیاز است |

109789 | من یک رگرسیون گام به گام روی R انجام داده ام. با این حال، خلاصه مدل نهایی شامل عواملی است که معنی دار نیستند. چرا این عوامل حذف نشده اند؟ آیا باید اینها را از مدل خود حذف کنم؟ VIF این فاکتورها همگی زیر 5 است. | عوامل غیر معنادار پس از رگرسیون گام به گام |

69658 | مشکل من شبیه این است اما به دنبال راه حل متفاوتی هستم: (پس اگر باید ادغام شود فقط به من اطلاع دهید). اندازه گیری آنچه در کاهش ابعاد PCA از دست رفته است؟ در برنامه من یک ماتریس همبستگی با بعد 30 داریم که بر اساس آن یک تجزیه و تحلیل PCA انجام می دهیم و سه بردار ویژه اول را بر این اساس حفظ می کنیم که معمولاً 90+٪ از تغییرات را شامل می شوند. با این حال این موضوع همیشه به نظر من کمی دلبخواهانه بوده است، میخواهم آزمایش کنم که آیا این بردارهای ویژه کوچکتر واقعاً حاوی یک سیگنال هستند نه نویز سفید. گمان میکنم یک روش بسیار ساده این است که دادهها را تقسیم کنیم و ببینیم آیا این بردارهای ویژه کوچکتر شکل مشابهی دارند یا خیر، اما من میخواهم روش علمی قویتری برای آزمایش این فرضیه پیدا کنم. | آزمایش اینکه آیا مقادیر ویژه کوچک سیگنال تولید می کنند یا خیر |

69654 | من یک مدل «GLS» چندگانه را با سری های زمانی به عنوان پاسخ و متغیرهای توضیحی برازش می کنم. من قبلاً فصلی بودن و روندها را با استفاده از `` حذف کردم. من متوجه شدم که ساختار همبستگی باقیمانده ها AR(3) است، بنابراین همبستگی خودکار را به طور کامل از باقیمانده ها حذف کردم. ضریب متغیرهای توضیحی که در نهایت در مدل باقی ماندند، همگی با صفر متفاوت هستند (p-values <0.01). سوال من این است که چگونه باید ضریب را با توجه به اینکه مدل را با متغیرهای تبدیل شده برازش می کنم تفسیر کنم؟ چگونه باید ضرایب مثبت و منفی را تفسیر کنم؟ متغیرهای من در مرکز صفر با مقادیر مثبت و منفی هستند، بنابراین، برای مثال، اگر ضریب من منفی و مقدار متغیر توضیحی من منفی باشد، متغیر پاسخ مثبت خواهد بود. آیا باید این را به عنوان یک اثر مثبت تفسیر کنم؟ یا اگر ضریب من مثبت باشد باید آن را برعکس تفسیر کنم؟ آیا راهی برای ترجمه تفسیر بر حسب مقیاس واقعی متغیرها وجود دارد؟ هر گونه کمکی قدردانی خواهد شد | تفسیر ضرایب منفی GLS (فصلی حذف شد) |

63436 | من گاهی مجبور می شوم وزنه های هوبر را از یک رگرسیون قوی بردارم و از آنها در یک lm استفاده کنم. اخیراً مجبور شده ام کاری مشابه برای یک مدل لجستیک انجام دهم، اما کمی نگران هستم، زیرا نتایج بسیار مشابه کتابخانه (robustbase) داده (vaso) ROB <- glmrob (Y ~Volume+Rate, Family=Ditomial) (logit)، data=vaso) ROB glm(Y ~Volume+Rate,data=vaso,family=binomial(logit)) glm(Y ~Volume+Rate,data=vaso,weights=ROB$w.r,family=binomial(logit)) ضرایب از وزن شده glm شباهت بیشتری به رگرسیون قوی دارد تا glm بدون وزن، اما آیا راهی وجود دارد که آنها را همان؟ من می توانم همان نتایج را با یک lm قوی (rlm) و وزن دار بدست بیاورم، اما به نظر می رسد این مورد در مورد glm نیست. من به رگرسیون glm robust با جزئیات نگاه نکرده ام، بنابراین ممکن است چیزی که می خواهم غیرممکن باشد... از کمک شما متشکرم | همپوشانی بین glm قوی و glm وزنی در R |

97258 | من سعی می کنم یک نمودار ROC ایده آل را همانطور که توسط نظریه تشخیص سیگنال پیش بینی شده است ترسیم کنم. در اینجا فرمول هایی که من سعی می کنم ترسیم کنم وجود دارد: hi = Φ((d′−ci)/σ) (3) fi = Φ(-ci) (4)  که d′ و σ میانگین و انحراف استاندارد قدرت برای آیتم های قدیمی، و ci معیاری برای شرط i است. تابع Φ توزیع تجمعی است. با جایگزینی (4) به (3) 'hi = Φ([d' + Φ^−1(fi)]/σ می شود.' **توضیح:** فرمول های بالا از مقاله زیر هستند http://pcl .missouri.edu/sites/default/files/p_6.pdf در صفحه 6. من انتظار دارم که یک نمودار ROC مانند شکل 1D (صفحه 39 از pdf) دریافت کنم. کد R من تا آنجا که به نظر می رسد به صورت زیر است: c_i <- seq(0, 1, 0.001) sigma <- 1.2 d <- 3 f_i <- pnorm(-c_i) h_i <- pnorm((d+qnorm(f_i))/ sigma) plot(c_i، h_i، xlim=c(0،1)، ylim=c(0,1)) متأسفانه این نتایج درستی نمی دهد. چه چیزی را از دست داده ام؟ خیلی ممنونم! | رسم نمودار ROC برای SDT در R |

61873 | چگونه می توانم از اطلاعاتی که اطمینان آن نمونه آموزشی را نشان می دهد استفاده کنم؟ یعنی ما یک اطلاعات اضافی برای مجموعه آموزشی در مورد اطمینان برچسب های کلاس داریم. | چگونه می توانم در پس انتشار MLP آموزش ببینم اگر برچسب های کلاس آموزشی با نرخ اطمینان آنها ارائه شود؟ |

61874 | دو بردار مختلط تصادفی مستقل (با قسمتهای واقعی و خیالی) را فرض کنید: $$ \vec{\dot{Z}}=(\dot{z}_1,\dot{z}_2,\ldots,\dot{z}_n )~~~~~~~~~~~ \begin{cases} \Re(\dot{z}_i)&=x_i \\\ \Im(\dot{z}_i)&=y_i \end{cases}\\\ \text{and} \\\ \vec{\dot{\zeta}}=(\dot{\zeta}_1,\ نقطه{\zeta}_2،\ldots،\dot{\zeta}_n)~~~~~~~~~~ \begin{موارد} \Re(\dot{\zeta}_i)&=\xi_i \\\ \Im(\dot{\zeta}_i)&=\eta_i \end{cases} $$ را میتوان بهعنوان مؤلفههای مربعی برخی از سیگنالهای واقعی مشاهده کرد. . اجازه دهید آنها توسط توزیعهای نرمال پیچیده چند متغیره کنترل شوند. },\, C_{z})$, $\vec{\dot{\zeta}}\sim\ \mathcal{CN}(\vec{\dot{\mu}}_{\zeta},\, \Gamma_{\zeta},\, C_{\zeta})$ با میانگین بردار $\vec{\dot{ \mu}}$، ماتریس کوواریانس $\Gamma$، و ماتریس رابطه $C$. اجازه دهید متغیر $\varphi$ را به عنوان آرگومان حاصلضرب اسکالر بین $\vec{\dot{Z}}$ و مزدوج پیچیده $\vec{\dot{\zeta}}$، یعنی $$\varphi تشکیل دهم. =\arg(\vec{\dot{Z}}\\!.\\!\vec{\dot{\zeta^*}})$$ کجا $\cdot^*$ یک عملگر انتقال مزدوج است. **می خواهم بدانم آیا راهی برای یافتن توزیع $\varphi$ وجود دارد؟ یا حتی قدر مطلق آن $|\varphi|$?** تا به حال راه حل آن مشکل را در کتاب های درسی یا مقالات علمی در دسترسم ندیده ام. سعی کردم به آن به عنوان بخشی از فرم دوخطی نگاه کنم و A.M. متای و اس.بی. اشکال درجه دوم در متغیرهای تصادفی: تئوری و کاربردها را ارائه کرد، اما شکست خورد زیرا 1. عمدتاً با اشکال درجه دوم سروکار دارد، 2. صادقانه بگویم من در آن نوع تبدیل آنقدرها خوب نیستم. با این حال، مقالات علمی مشابهی وجود دارد، اما همه آنها دوباره به اشکال درجه دوم می پردازند و معمولا مسئله را ساده می کنند (میانگین صفر یا ماتریس رابطه صفر و غیره). بنابراین هر کمکی بسیار قدردانی خواهد شد. | توزیع حاصل ضرب اسکالر بردارهای نرمال پیچیده چند متغیره |

107456 | ماتریس همبستگی نشان میدهد که برخی از پیشبینیکنندههای من همبستگی دارند (پیرسون، 0،288 0،492 و 0،360). آیا می توانم به سادگی یک رگرسیون خطی برای همه افراد مستقل اجرا کنم و از R2 برای محاسبه VIF استفاده کنم؟ (VIF = 1/(1-R2). برخی از این پیش بینی ها عواملی هستند که اسمی هستند. استفاده از آنها در رگرسیون خطی به عنوان وابسته اشتباه به نظر می رسد. | چگونه می توان مقادیر VIF را برای پیش بینی کننده های مستقل مورد استفاده در یک مدل خطی تعمیم یافته پواسون لاگ خطی به دست آورد؟ |

21265 | من در حال حاضر مشغول ساخت یک مدل با استفاده از رگرسیون خطی چندگانه هستم. پس از سر و کله زدن با مدل خود، مطمئن نیستم که چگونه می توانم به بهترین نحو تعیین کنم که کدام متغیرها را نگه دارم و کدام را حذف کنم. مدل من با 10 پیش بینی کننده برای DV شروع شد. هنگام استفاده از هر 10 پیش بینی، چهار پیش بینی معنی دار در نظر گرفته شدند. اگر فقط برخی از پیشبینیکنندههای بدیهی نادرست را حذف کنم، برخی از پیشبینیکنندههای من که در ابتدا مهم نبودند، مهم میشوند. که من را به سوال من سوق می دهد: ** چگونه می توان تعیین کرد که کدام پیش بینی کننده ها را در مدل خود بگنجانند؟ ** به نظر من باید مدل را یک بار با همه پیش بینی کننده ها اجرا کنید، آنهایی را که مهم نیستند حذف کنید و سپس دوباره اجرا کنید. اما اگر حذف تنها برخی از آن پیشبینیکنندهها باعث مهم شدن برخی دیگر شود، در این فکر میمانم که آیا رویکرد اشتباهی برای همه این موارد اتخاذ میکنم. من معتقدم که این تاپیک مشابه سوال من است، اما مطمئن نیستم که بحث را درست تفسیر کنم. شاید این بیشتر یک موضوع طراحی آزمایشی باشد، اما شاید کسی تجربه ای داشته باشد که بتواند به اشتراک بگذارد. | انتخاب متغیرها برای گنجاندن در یک مدل رگرسیون خطی چندگانه |

105745 | حداکثر X_1 $،\dots،X_n. \sim$ i.i.d. طبق نظریه ارزش افراطی، استانداردهای نرمال به توزیع استاندارد گامبل همگرا می شوند. _چگونه می توانیم آن را نشان دهیم؟_ ما داریم $$P(\max X_i \leq x) = P(X_1 \leq x, \dots, X_n \leq x) = P(X_1 \leq x) \cdots P(X_n \ leq x) = F(x)^n $$ ما باید دنبالههایی از ثابتها را پیدا کنیم/انتخاب کنیم: $$\Phi\left(a_n x+b_n\right)^n\rightarrow^{n\rightarrow\infty} G(x) = e^{-\exp(-x)}$$ آیا می توانید آن را حل کنید یا پیدا کنید آن را در ادبیات؟ چند نمونه pg.6/71 وجود دارد، اما نه برای مورد عادی. $$\Phi\left(a_n x+b_n\right)^n=\left(\frac{1}{\sqrt{2\pi}}\int_{-\infty}^{a_n x+b_n} e^ {-\frac{y^2}{2}}dy\right)^n\rightarrow e^{-\exp(-x)}$$ | نظریه ارزش افراطی - نمایش: نرمال تا گامبل |

61876 | معمولاً در درختهای تصمیم چند متغیره، میتوانیم از تمام ویژگیها در یک گره داخلی استفاده کنیم. درخت دو متغیره موردی است که ما مجاز به استفاده از هر دو ویژگی در یک گره داخلی هستیم. شکاف ها در چنین درختی چگونه به نظر می رسند؟ چگونه می توان به تقسیم دست یافت؟ | شکاف ها در درخت های تصمیم دو متغیره چگونه به نظر می رسند؟ |

56268 | من معمولاً دقت و فراخوانی را برای اطلاعات استخراج شده از متن محاسبه می کنم، اما مطمئن نیستم که چگونه حاشیه خطا را برای آن مقادیر دقت و یادآوری محاسبه کنم. به عنوان مثال، اگر من یک نمونه از 1000 نام داده شده از یک مقدار ناشناخته داده داشته باشم. هدف من این است که جنسیت هر نام را مشخص کنم. سیستم من جادوی خود را انجام می دهد و می توانم تعیین کنم که جنسیت را با دقت 90 درصد و یادآوری 90 درصد تعیین می کنم. چگونه می توانم حاشیه خطا را برای دقت و فراخوانی محاسبه کنم، با توجه به اینکه مقادیری که محاسبه کرده ام بیش از نمونه ای از داده ها هستند؟ من فرمولی برای حداکثر حاشیه خطا در http://www.had2know.com/business/compute-margin-of-error.html پیدا کرده ام، اما به نظر نمی رسد که واقعاً در چنین شرایطی کاربرد داشته باشد. . (توجه: من همچنین این سوال را در Linguists Stack Exchange پرسیده ام و به اینجا هدایت شده است. محاسبه حاشیه خطا برای دقت و یادآوری) | محاسبه حاشیه خطا برای دقت و فراخوانی |

53304 | پاسخ به احتمال P(X > Y) داده شده X ~ Be(a1, b1) و Y~ Be(a2, b2) و X و Y مستقل هستند؟ یک راه حل تحلیلی برای این موضوع ارائه می دهد، اما اگر کسی بخواهد کمی دقت را از دست بدهد، آیا بیان محاسباتی کمتری وجود دارد؟ اگر کمک می کند عدد صحیح a و b را فرض کنید. | تقریب تحلیلی احتمال بزرگتر بودن یک متغیر بتا از دیگری؟ |

69655 | در تلاش برای پیاده سازی Mixture Markov Model، (به سوال اینجا مراجعه کنید)، من موارد شدید دارم (به عنوان مثال 0 در ماتریس احتمال انتقال). من این را با جایگزین کردن 0 با 1e-17 نزدیک کردم. با این حال، من معتقدم که چنین تقریبی ممکن است الگوریتم را به هم بزند، زیرا در مراحل بعدی من شروع به دیدن مقادیر حتی کوچکتر با قدر زیاد میکنم (مثلاً پشتیهای شرطی در مرحله E گاهی اوقات قدر 1e-321 هستند). این از فرمول احتمال حاصل می شود، که احتمالات گرفته شده به توان تعداد وقوع چنین انتقال هایی را در هر دنباله ضرب می کند. با مدل مخلوط مارکوف، من سعی می کنم تعدادی از دنباله ها را خوشه بندی کنم، که برخی از آنها ممکن است بسیار طولانی باشند (تا چند صد انتقال). این همچنین برخی موارد افراطی را ایجاد می کند (مانند احتمالات انتقال بسیار کوچک برای برخی از حالت ها برای برخی دنباله ها، اگر 0 نباشد، 1e-20 یا چیزی مشابه). از آنجایی که من قبلاً فرض می کنم که 1e-17 تقریبی 0 است، هر مقداری که کمتر از این باشد، بی معنی خواهد بود. با این حال، کار با 0 غیرممکن است، زیرا مقدار احتمال ورود به سیستم MAP -Inf (=log(0)) خواهد بود. آیا تکنیک تقریبی وجود دارد که برای چنین مواردی استفاده شود؟ بهترین راه برای تقریبی 0 چیست؟ من در R کار می کنم و برای دقت R محدودیتی وجود دارد (حدوداً 1e-400..). من واقعا در ضرر هستم. | چگونه 0 را در ماتریس احتمال انتقال بدون از دست دادن کلیت تقریب کنیم؟ |

21263 | من با آمار بیزی تازه کار هستم، و بنابراین برای یافتن راه حلی برای مشکل زیر مشکل دارم: با استفاده از محاسبات بیزی تقریبی (ABC)، یک توزیع پسینی از یک مجموعه آمار خلاصه مشاهده شده و مجموعه ای از حدود یک میلیون ایجاد می کنم. آمار خلاصه شبیه سازی شده توزیع قبلی مقدار متغیر پارامتر مدل مورد استفاده در شبیه سازی است. توزیع پسین برای به دست آوردن تخمین نقطه ای (به عنوان مثال، حالت، میانگین و غیره) پارامتر مدل اساسی استفاده می شود. مشکل بیولوژیکی که من روی آن کار می کنم این است که مقدار واقعی پارامتر را نمی توان تنها با یک مشاهده تخمین زد. از این رو، من N مجموعه دادههای مشاهدهشده دارم و N توزیع پسین را به دست میآورم. در ABC، من از همان داده های شبیه سازی شده برای هر مجموعه داده مشاهده استفاده می کنم. اکنون، مشکل من این است که N توزیع های پسین را به گونه ای ترکیب کنم تا مقدار پارامتر واقعی را تخمین بزنم، بنابراین اطلاعات موجود در تمام N تراکم ها را به دست آوریم. هر ایده ای؟ | ترکیب چند توزیع خلفی |

63431 | فرض کنید من یک مجموعه ثابت از داده ها حاوی یک متغیر دارم. من علاقه مندم که آیا متغیر تفاوت بین دو شرط را نشان می دهد یا خیر. اکنون یک آزمایش انجام می دهم و مقدار p را در جایی بالاتر از آلفای مورد نظر خود تعیین می کنم. از آنجا که ناامید شدهام، چندین گزینه مختلف از آزمونها را برای یک فرضیه تکرار میکنم و متوجه میشوم که یک آزمون مقدار p زیر آلفای من را نشان میدهد. به نظر می رسد که این نوعی اکسپدیشن ماهیگیری است، اما نه از آن نوعی که تصحیح بونفرونی قرار است رفع کند: من همیشه در حال آزمایش همان فرضیه هستم. با این حال، به نوعی احساس درونی من به من می گوید که این حالت ماهی است. چه چیزی در اینجا به طور کلی مناسب در نظر گرفته می شود؟ آیا ماهیگیری و گزارش آن در کاغذ؟ با اولین p-value بروید؟ میانگین p را محاسبه کنید؟ | پیامدهای آزمایش چندگانه برای تجزیه و تحلیل |

105742 | به من یک مجموعه داده داده شد تا با دو عامل زمان و درمان و یک متغیر وابسته پیوسته تجزیه و تحلیل کنم. از آنجایی که افراد یکسان چندین بار اندازهگیری شدند، از نظر فنی احتمالاً میتوان آن را بهعنوان اندازهگیریهای مکرر انجام داد، اما مقادیر اندازهگیری شده به من قبلاً میانگین اندازهگیریهای متعدد را نشان میدهد، و مطمئن نیستم که آیا پیچیدگی اضافی رویکرد اندازهگیریهای مکرر وجود دارد یا خیر. ارزش پیگیری دارد داده ها نامتعادل هستند، بنابراین من یک ANOVA دو طرفه را با استفاده از type II که در Anova() در Car for R پیاده سازی شده است، انجام داده ام. برای هر مقایسه درمان ها، در هر نقطه زمانی. Graphpad Prism این را به عنوان مقایسه ای از درمان ها به عنوان سرفصل جدول (درمان 1 در مقابل درمان 2) به همراه فهرستی از نقاط زمانی با آمار t و مقادیر p نشان می دهد، بنابراین واضح است که چندین آزمون t را انجام می دهد. من این را با آزمایش یک سری ANOVA یک طرفه برای مقادیر در یک نقطه زمانی معین، و همچنین تلاش pairwise.t.test() پیادهسازی کردهام. با کمال تعجب، من نمیتوانستم مقادیر p را که Prism برای این «پسآزمونها» خروجی داشت، تکرار کنم، حتی وقتی از همان روش تنظیم p-value (بونفرونی) استفاده میکردم، و اگرچه همان p-value را برای اصلی دریافت کرده بودم. اثرات ANOVA دو طرفه توافق با Prism به کنار، در اینجا سؤالات من وجود دارد - آیا دلیل قانع کننده ای برای استفاده از رویکرد اندازه گیری های مکرر با این داده ها وجود دارد؟ * راه مناسبی برای یافتن اهمیت نقاط زمانی برای هر مقایسه درمان ها چیست؟ * آیا مدل من برای این داده ها مناسب است؟ (به مدل در کد زیر مراجعه کنید) یک مجموعه داده نمونه کوچک در زیر گنجانده شده است- داده های واقعی دارای سطوح بیشتری برای هر عامل و تکرارهای بیشتری در هر ترکیب از عوامل هستند. testData <- data.frame(time = c(rep(2 ماه، 10)، تکرار (4 ماه، 8))، treat = rep(c(rep(treat1، 3)، rep(treat2 ، 2)، rep(treat3، 2)، rep(notreat2))، 2)، مقدار = نمونه (1:12، 18، جایگزین = TRUE) ) خلاصه (aov(مقدار ~ درمان*زمان، داده = دادههای آزمایش)) # اگر تعامل معنیدار نباشد Anova(lm(مقدار ~ درمان + زمان، داده = آزمون داده، تضادها = فهرست (درمان = مجموع، زمان = کنترل. مجموع))، نوع = II) من R را به عنوان یک زبان خوب می دانم، اما با فرضیات بی شماری که در انواع آزمون ها و رویکردهای مدل سازی وجود دارد به اندازه کافی آشنا نیستم... با تشکر از کمک شما | ANOVA و یافتن تفاوت بین چندین گروه در طول زمان |

82564 | هنگام استفاده از یک مدل ترکیبی برای تجزیه و تحلیل برخی داده ها، آیا گزارش تخمین های واریانس اثرات تصادفی در یک نشریه، به عنوان مثال برای یک مجله پزشکی، معمول است؟ نمیدانم چگونه این اطلاعات برای خواننده جالب باشد و بنابراین مطمئن نبودم که آیا باید آن را درج کنیم. اگر بله، آیا باید معیار عدم قطعیت را نیز لحاظ کنیم؟ | گزارش تخمین واریانس برای مدل های مختلط |

51039 | من می خواستم تأثیر برنامه های حمایت از مشاغل کوچک را بر رشد مشاغل کوچک ببینم. من رشد آنها (که با تعداد کارمندان نشان داده میشود) را فقط در آن 5 نوع برنامه حمایتی (به عنوان پسرونده) کاهش دادم. و من R مربع = 0.35، R مربع تعدیل شده = 0.03-، برخی از ضرایب مثبت و برخی دیگر منفی هستند، و تمام مقادیر p > سطح معنی داری (10٪) است (ضرایب ناچیز هستند). 1) آیا می توانم نتیجه بگیرم که برنامه های حمایتی تأثیر مثبت اما ناچیز دارند؟ 2) آیا باید متغیرهای کنترلی را برای تکمیل مدل اضافه کنم (به طوری که r مربع > 0.5 شود). | رگرسیون با یا بدون متغیرهای کنترل شده؟ |

97250 | چگونه روش رگرسیون گام به گام برای هر دو جهت در R با تابع step() کار می کند. من فکر می کنم که یک متغیر در مدل قرار می گیرد و سپس متغیر دیگری که معیارهای اندازه گیری را بهبود می بخشد و اهمیت متغیر قدیمی تر ارزیابی می شود. اگر ضریب متغیر قدیمیتر معنیدار نباشد، متغیر حذف میشود و متغیر بعدی در مدل قرار میگیرد و غیره. من 100% مطمئن نیستم که عملکرد گام با هر دو اینگونه است، اما آیا کسی می تواند به من اطلاع دهد که آیا این درست است، اگر نه، معیارهای هر دو چگونه رگرسیون گام به گام را در R با پیاده سازی می کنند. step()`. | رگرسیون گام به گام در R با هر دو جهت |

113618 | من در هنگام استفاده از بسته caret در R با دو مشکل مواجه هستم. مثالی را در زیر بازتولید می کنم: library(mlbench) library(caret) set.seed(998) data(Sonar) #داده های تصادفی، فقط برای مصور بودن Sonar= Sonar [, 1:6] #6 ستون اول را فقط برای نشان دادن یک مثال انتخاب کرد. من فرض می کنم V6 پاسخ است. head(Sonar) inTraining <- createDataPartition(Sonar$V6, p = 0.75, list = FALSE) آموزش <- Sonar[inTraining, ] testing <- Sonar[-inTraining, ] modelFit <- train( V6~.,data=training , method=rpart ) varImp(modelFit) a. چگونه سه (3) متغیر برتر را از خروجی VarImp استخراج کنیم؟ من سعی کردم متغیرها را سفارش دهم اما به هر دلیلی برای من کار نمی کند. ب همچنین، چرا کد زیر برای randomForest کار نمی کند؟ modelFit <- train( V6~.,data=training, method=rf ) varImp(modelFit) > varImp(modelFit) اجرا مجدد با خطای اشکال زدایی در varImp[, %IncMSE] : اشتراک خارج از محدوده | بسته Caret در R - متغیر مهم را دریافت کنید |

16373 | من یک سوال دارم که برای انجام این کار باید از کدام آزمون آماری استفاده کنم. من جمعیتی 80 نفری دارم: * 37 مورد عمل A را انجام دادند * 43 مورد عمل B را داشتند از 80 بیمار، 19 بیمار بیماری عود کننده داشتند: * 13 بیمار عمل A را انجام دادند * 6 روش B را انجام دادند چگونه تشخیص دهم که آیا انجام روش A خطر را افزایش می دهد یا خیر. وجود بیماری عود کننده با توجه به تفاوت در تعداد روش A و B از نظر آماری معنی دار است؟ | برای ارزیابی ارتباط یک روش پزشکی با بیماری عود کننده از چه آزمایش آماری استفاده کنیم؟ |

63430 | فقط یک مقدمه، من ریاضیدان نیستم یا از نظر آماری ماهر نیستم. من روشم را برای محاسبه انحرافات استاندارد می دانم، اما همه اینها خودآموز است. من یک برنامه نویس با دانش آماری محدود هستم. * * * اکنون، فرض کنید که یک وب سایت اجاره ویجت را اجرا می کنید، و در برنامه خود به صاحبان ویجت ها اجازه می دهید آنها را اجاره کنند. شما به صاحبان ویجت اجازه میدهید فصلهایی را ایجاد کنند (مانند مه - ژوئن، و آگوست - سپتامبر)، و سپس قیمتی را انتخاب کنید که برای اجاره ویجت در آن دوره زمانی هزینه داشته باشد. با قیمتهایی که وارد شدهاند، میخواهم بتوانم: * همه ویجتها را بر اساس «پایینترین قیمت» موجود مرتبسازی کنم، بنابراین در فهرست نتایج همه ویجتها کم به بالا. * یک از قیمت برای یک ویجت ارائه دهید. به این معنا که شما می توانید این ویجت را به قیمت XXX دلار در روز اجاره کنید. هر ویجت بر اساس زمان سال می تواند قیمت متفاوتی داشته باشد. برخی از ویجت ها بسته به فصل، ده ها قیمت متفاوت خواهند داشت، زیرا فصل های بالا و فصل های پایین را دریافت می کنید. با این حال، فروشندگان ویجت ها **به خصوص بداخلاق** هستند و متوجه شده اند که اگر ویجت خود را برای یک روز از سال واقعاً گران باشد و همچنین یک روز از سال واقعاً ارزان باشد، می توانند به راحتی در محدوده مرتب سازی پایین و بالا ظاهر می شود. و آنها همچنین از این برای دستکاری از قیمت خود استفاده می کنند. در حال حاضر، برای محاسبه «پایینترین قیمت» برای یک ویجت، راهحل بسیار سادهای را انتخاب کردم، که فقط مقدار «کمترین (N)» را از یک مجموعه داده میگیرد. چیزی که من میخواهم دریافت کمترین قیمت برای ویجت است، که قیمتی را که میتوان از آن اجاره کرد را به دقت نشان میدهد. به این نمودار نگاهی بیندازید... با مقادیر...  > محور X - زمان (هر بازه مهم یک روز است) > > محور Y - قیمت محور X زمان است و محور Y قیمت است. در حال حاضر، این شامل یک توزیع نرمال است، و هیچ گونه پرت آماری واقعی در آن مجموعه داده وجود ندارد. معمولاً مشاهده میشود که قیمت بین کمترین مقدار و مقدار بالا تا 200 درصد یا چند انحراف استاندارد در نوسان است. با این حال به این نمودار دوم نگاهی بیندازید... شامل تعرفه یک روزه است که فقط 20 یورو است...  من با استفاده از تست Grubbs بازی کرده ام و به نظر می رسد که اگر مجموعه داده کوچکی داشته باشید و مدت زمان محدوده تاریخ را در نظر نگیرید، بسیار خوب کار می کند. با این حال، هنگامی که شما شروع به تلاش برای پرتاب در 3 روز برای یک ویجت که 1 دلار است، برای حذف 3 نقطه پرت واضح خوب کار نمی کند... نکته مهم این است که من می خواهم یک از قیمت دریافت کنم. یعنی میخواهم بتوانم بگویم «میتوانید این ویجت را از XXXX اجاره کنید». بنابراین باید منعکس کننده قیمت گذاری کلی در نظر گرفته شده به عنوان یک کل باشد و نکات پرت واضح را نادیده بگیرد. من قصد دارم این را در PHP پیاده سازی کنم، بنابراین هیچ ابزار آماری شگفت انگیزی به جز کتابخانه های ریاضی هسته ای در اختیار ندارم. | حذف اقلام پرت و محاسبه پایین ترین قیمت قابل دستیابی از یک سری زمانی از پیش تعیین شده/ثابت شده قیمت ها |

81285 | در کتاب درسی که می خوانم از قطعیت مثبت (تعیین نیمه مثبت) برای مقایسه دو ماتریس کوواریانس استفاده می کنند. این ایده که A-B است pd است، سپس B کوچکتر از A است. اما من برای به دست آوردن شهود این رابطه تلاش می کنم؟ یک موضوع مشابه در اینجا وجود دارد: http://math.stackexchange.com/questions/239166/what-is-the-intuition-for- using-definiteness-to-compare-matrices شهود استفاده از قطعیت برای مقایسه ماتریس ها چیست؟ ? اگرچه پاسخ ها خوب هستند، اما واقعاً به شهود پاسخ نمی دهند. این مثالی است که به نظر من گیج کننده است: \begin{equation} \begin{bmatrix} 16 & 12 \\\ 12 & 9 \end{bmatrix} - \begin{bmatrix} 1 & 2 \\\ 2 & 4 \end{ bmatrix} \end{equation} اکنون در اینجا تعیین کننده تفاوت 25- است، بنابراین رابطه pd یا حتی psd نیست و پس ماتریس اول بزرگتر از ماتریس اول نیست؟ من فقط می خواهم دو ماتریس کوواریانس 3*3 را با هم مقایسه کنم تا ببینم کدام کوچکترین است؟ استفاده از چیزی شبیه به هنجار اقلیدسی برای مقایسه آنها برای من شهودی تر به نظر می رسد؟ اما این بدان معناست که ماتریس اول در بالا بزرگتر از ماتریس دوم است. علاوه بر این، من فقط معیار pd/psd را می بینم که برای مقایسه ماتریس های کوواریانس استفاده می شود. آیا کسی می تواند توضیح دهد که چرا pd/psd بهتر از استفاده از معیار دیگری مانند هنجار اقلیدسی است؟ با تشکر من همچنین این سوال را در انجمن ریاضی ارسال کردم (مطمئن نبودم که بهترین است) امیدوارم این با هیچ قانونی مغایرت نداشته باشد. http://math.stackexchange.com/questions/628135/comparing-two-covariance- matrices | اندازه گیری مناسب برای یافتن کوچکترین ماتریس کوواریانس |

107453 | من آزمایشی انجام دادم که به بررسی آسیب موجودات دریایی در نتیجه ماهیگیری پرداختم. من در سه کشتی A، B و C نمونه برداری کردم. در هر کشتی، از صید قبل از جابجایی روی عرشه (پیش) توسط ماهیگیران و بعد از (پست) جابجایی روی عرشه توسط ماهیگیران نمونه برداری کردم و تعداد افراد آسیب دیده در نمونه را شمارش کردم. داده های من داده های متناسب هستند (نسبت افراد آسیب دیده در نمونه). میخواهم بدانم که آیا تفاوتهایی در 1) نسبت حیوانات آسیبدیده در کشتیها و 2) سطح آسیب در حملونقل روی عرشه وجود دارد یا خیر. تست مناسب چیست؟ مطالعه پیشینه نشان داد که مدلسازی خطی تعمیم یافته راه مناسبی برای تجزیه و تحلیل داده های متناسب خواهد بود. یا می توانم از ANOVA دو طرفه استفاده کنم (با فرض اینکه داده ها شرایط را داشته باشند؟) افکار؟ پیشاپیش ممنون | تجزیه و تحلیل داده های متناسب (طراحی دو عاملی) |

107458 | فرض کنید یک مدل رگرسیون عمومی دارید که برای شما مانند یک جعبه سیاه رفتار می کند. تنها چیزی که دارید یک تابع $\ \ \text{train}(X,Y) \\ $ است که در آن ماتریس پیشبینیکننده $X \in \mathbb R^{N\times M}$ و بردار هدف $Y \ را وارد میکنید. در \mathbb R^N$، و همچنین یک تابع $\ \ \text{predict}(x) \ \ $ که یک بردار ردیف $x \in \mathbb R^{1\times می گیرد M}$ و پیشبینی $y \in \mathbb R$ را تولید میکند. وظیفه پیشبینی سریهای زمانی را بیشتر در نظر بگیرید، یعنی یک سری زمانی چند متغیره $\\{\mathbf x_0, \mathbf x_1,\ldots\, \mathbf x_t\\}$ وجود دارد که $\mathbf x_k \in \mathbb R^{1\times M}$، و میخواهید نتیجه $y_{t+n} \in را پیشبینی کنید \mathbb R\ \ $(در اینجا $n>0$، و اغلب $n=1$). دو روش متداول برای دستیابی به این هدف عبارتند از * رویکرد خود رگرسیون: یک سفارش $q$ را انتخاب کنید و چندین نمونه بگیرید $\big\\{(\mathbf x_{t-q+1},\ldots, \mathbf x_t),y_{t +n} \big\\}$ و آن را به مدل رگرسیونی خود وارد کنید. * رویکرد اتورگرسیو-متوسط متحرک: نتایج پیشبینی قبلی را بیشتر اضافه کنید، به عنوان مثال از دادههای $\big\\{(\mathbf x_{t-q+1},\ldots, \mathbf x_t), (y_{t-r},\) استفاده کنید. ldots، y_{t+s})، y_{t+n} \big\\}$، جایی که $s<n$ (--نه لزوما، اما من آن را منطقی فرض می کنم). **علاوه بر این رویکردهای واضح، آیا پیشنهاد/مرجع دیگری برای استفاده از روش رگرسیون عمومی برای پیشبینی سریهای زمانی دارید؟** نظرات بیشتر در مورد روشهای فوق نیز پذیرفته میشود. | تبدیل رگرسیون عمومی به پیشبینی سریهای زمانی |

49194 | این یک نسخه مبهم از یک مشکل واقعی است: هر روز با تعدادی از دختران (متمایز) صحبت می کنم. من شاخص شباهت جاکارد را بین دو روز متوالی محاسبه می کنم: J(t)=J(t,t-1)=تقاطع(دختران(t)،دختران(t-1))/اتحاد(دختران(t)،دختران(t) -1)) می خواهم J(t+n+1) را با J(t)...J(t+n) مقایسه کنم تا ببینم از نظر آماری غیرعادی است یا خیر. برای این منظور باید مدل احتمالی را فرض کنم که توزیع J(t) روزانه را توصیف می کند. پشتیبانی توزیع باید روی [0،1] محدود شود. همچنین ممکن است فرض کنیم که توزیع یک وجهی است، در مرزها کاهش می یابد، اما کاملاً مثبت می ماند. یک توزیع احتمال معقول برای استفاده چه خواهد بود؟ ترجیحاً این باید از یک مدل اساسی منطقی که تغییرات روزانه در دختران متمایز را توصیف می کند، مشتق شود. | یک مدل توزیع احتمال برای شباهت جاکارد |

16151 | من فهرستی از اعداد دارم که وقتی روی یک نمودار رسم میشوند، به وضوح روندهایی مانند صعود به سمت بالا، سقوط، تکرار و غیره را نشان میدهند. وقتی یک انسان نمودار را میبیند، به راحتی میتواند تشخیص دهد که چه اتفاقی میافتد. کاری که من سعی می کنم انجام دهم این است که از نظر عددی به همان چیزی برسم و سیستم تشخیص دهد که چه روندهایی در نمودار رخ می دهد. ایده اولیه من این است که پنجره ای داشته باشیم که در امتداد داده ها جابه جا شود و فقط مقادیر درون این پنجره برای محاسبه روند استفاده شود. یک پنجره خیلی کوچک منجر به اغراقآمیز شدن تغییرات کوچک میشود و یک پنجره خیلی بزرگ تغییرات بزرگ را تضعیف میکند، بنابراین یافتن اندازه پنجره مناسب که ممکن است این رویکرد را نامناسب کند ممکن است دشوار باشد. به عنوان مثال، اگر من این مجموعه را داشته باشم (برای مطابقت با توضیحات زیر کروشه ها را اضافه کرده ام، اما آنها کاملاً گویا هستند؛ داده ها هنوز فقط یک مجموعه هستند): {[0,1,0,1,0, 0]، [1،1،1،1،1،1،1]، [2،2،4،6،7،8،9،10،9،0]، [0،1،1،0، 1]} ما به راحتی می توانیم ببینیم (مخصوصاً اگر روی نمودار کشیده شود) که نسبتاً پایدار شروع می شود، سپس پایدار می شود، شروع به بالا رفتن می کند، ناگهان افت می کند، سپس دوباره نسبتاً پایدار می شود. چه تکنیکها و موضوعاتی را باید مطالعه کنم تا راههایی برای شناسایی کارآمد آن نوع الگوها توسط سیستم پیدا کنم؟ یک رویکرد، داشتن قوانین خواهد بود. به عنوان مثال، شمارنده ای که هر بار که تعداد افزایش می یابد و با کاهش تعداد کاهش می یابد. سپس، اگر شمارنده یک آستانه بالا را پشت سر بگذارد، سیستم باید بالا برگردد. آیا این رویکرد مبتنی بر قانون راه خوبی است یا رویکردهای بهتری وجود دارد؟ (با توجه به معاوضه، کارایی را به دقت ترجیح می دهم). | تشخیص روندهای عددی |

2419 | آیا یک کتابخانه پایتون خوب برای آموزش درختان تصمیم تقویت شده وجود دارد؟ | درختان تصمیم در پایتون تقویت شده است؟ |

56881 | می خواستم بدانم آیا رابطه ای بین $R^2$ و F-Test وجود دارد یا خیر. معمولا $$R^2=\frac {\sum (\hat Y_t - \bar Y)^2 / T-1} { Y_t - \bar Y)^2 / T-1}$$ و قدرت رابطه خطی در رگرسیون یک تست F فقط یک فرضیه را ثابت می کند. آیا رابطه ای بین $R^2$ و F-Test وجود دارد؟ | رابطه بین $R^2$ و F-Test چیست؟ |

49196 | من سیستمی دارم که از دو مکان بازدید می کند و سیگنال ها را هر 10 ثانیه جمع آوری می کند. به خوبی شناخته شده است که A باعث می شود B رخ دهد اما نه همیشه. بنابراین، من سعی می کنم توزیع احتمال شرطی B را با داده A پیدا کنم. داده ها به شکل زیر هستند: A B ---------- 1 0 1 1 1 0 1 0 ......... 10000 ردیف وجود دارد. عدم قطعیت در محاسبه آرتورز، چگونه می توانم به آن برسم. آیا توزیع دوجمله ای 4 موردی را در اینجا برازش می کنیم؟ 4 مورد توسط آرتور ذکر شده است. این تغییر چگونه است که من به جای آن دارم: A B C ------------ 1 0 1 1 0 1 0 1 1 0 1 ............ حالا می خواهم P(B,C|A) را درک کنید. @Corone من واقعاً روشی را که ریاضی را توصیف کردید دوست دارم و فقط علاقه من را به این موضوع جلب کرد که اکنون چه اتفاقی می افتد؟ باز هم من تقریباً در این زمینه مبتدی هستم. بنابراین، اکنون درک من این است که در اینجا 8 مورد مانند موارد زیر دارم: P(B=1,C=1|A=1), P(B=1,C=1|A=0), P(B) =1,C=0|A=1) و غیره و من معادله رویکرد فراوان گرا را برای در نظر گرفتن 8 مورد بالا اصلاح می کنم؟ اما آیا این امر به هر گونه همبستگی بین B و C نیز توجه می کند، یعنی اینکه چگونه B بر روی C علاوه بر A تأثیر می گذارد؟ یا باید در اینجا به توزیع دیریکله فکر کنم زیرا این یک توزیع احتمال مشترک است. | ایجاد توزیع احتمال شرطی |

56883 | من بیش از 4000 فایل متنی را خوشه بندی کرده ام و اکنون می خواهم خوشه ها را بررسی و ارزیابی کنم. من می خواهم از F-measure (ترکیبی از یادآوری و دقت) استفاده کنم. تعریف رسمی F1_score این است: $$ \text{F-measure} = 2 * \frac{\text{precision} * \text{recall}}{\text{precision} + \text{recall}} $$ به محاسبه دقت و فراخوانی، باید از قبل تعداد صحیح اسناد بازیابی شده و صحیح بازیابی نشده را بدانم. این بدان معناست که باید همه اسناد را مرور کنم و ببینم چه چیزی در آنها وجود دارد. اما مشکل اینجاست که چگونه می توانم از دقت و فراخوانی بیش از 4000 فایل متنی مطلع شوم؟ | استفاده از F1_score برای اندازه گیری اعتبار خوشه |

61877 | من یک سوال در مورد تفسیر ماتریس های مختلف تولید شده توسط تجزیه مقدار منفرد دارم. فرض کنید یک ماتریس mxn $A$ حاوی n تصویر از m پیکسل است. بنابراین هر ستون از این ماتریس در صورت تغییر شکل یک تصویر است. تصاویر در واقع تبدیل موجک هستند، اما هیچ ارتباطی با این سوال ندارد. علاوه بر این، اولین k ستون $A$ تصاویر سگ ها و ستون های باقی مانده تصاویر گربه ها هستند. بنابراین من چیزی شبیه به این دارم: wavelet_dc = np.hstack((wavelet_dogs، wavelet_cats)) U، S، V = svd(wavelet_dc، full_matrices=False) تعبیر U، S و V چیست؟ میدانم که میتوانیم تصویر اصلی را بر اساس مجموعی مانند $A = \sum_{i} u_{i}s_{i}v^{T}_{i}$ بسازیم که در آن $u_{i}$ و $ v_{i}$ به ترتیب بردارهای ستونی U و V هستند. همچنین میدانم که $S$ مهمترین حالتهای ماتریس اصلی را تعیین میکند و ستونهای U ویژگیهای مرتبط با آن حالتها هستند. با این حال، V چه نقشی در این ماتریس دارد؟ من می خواهم بدانم که چگونه در مورد V در کاربردهای عملی فکر کنم (یعنی بیشتر از یک چرخش در تفسیر هندسی SVD) علاوه بر این، فرض کنید V را به شکل زیر رسم کنم: plot(V[0:40, 0 ]، 'o-'، markersize=3)  از آنجایی که V یک nxn است ماتریس، من نمیدانم چگونه آن را تفسیر کنم، اما فکر میکنم این کد در واقع 40 سطر اول و ستون اول V را میگیرد. همانطور که V را میدانم: $$V = \begin{pmatrix}v_{1} ^{T} \\\v_{2}^{T} \\\\\vdots \\\v_{n}^{T}\end{pmatrix}$$ فکر میکنم طرح به مؤلفه اول اشاره دارد از 40 بردار $v_{1} ... v_{40}$ اما به چه معناست؟ در کلاس Coursera روشهای محاسباتی برای تجزیه و تحلیل دادهها، این به عنوان سگ برای حالت اول و 'V[0:40, 1]' سگهای حالت دوم و غیره توصیف میشود. شما می توانید یادداشت ها را اینجا ببینید، شکل 159، صفحه 388. البته با این فرض که حداقل 40 ستون اول $A$ حاوی تصاویری از سگ ها باشد. در کلاس، «V[80:120, 0]» را نیز ترسیم می کنند، زیرا ماتریس $A$ آنها در واقع 80 ستون اول را نشان دهنده تصاویر سگ ها و 80 ستون آخر را نشان دهنده تصاویر گربه ها دارد، بنابراین «V[80:120 , 0]` در حال ترسیم 40 تصویر اول از گربه ها است. به روز رسانی: با توجه به سخنرانی های ویدئویی، W8_L21_P3-ویژگی ها: https://class.coursera.org/compmethods-002/lecture/76، به نظر می رسد که آنها V[0:40, x] را به عنوان طرح اول تفسیر می کنند. 40 سگ روی حالت ها. خوب، V ابعاد nxn دارد که تعداد تصاویر است، اما من آن را به عنوان سگ تعبیر نمی کنم. در هر صورت، فکر میکنم چنین پیشبینیهایی نباید «V[0:40, 0]» باشند، بلکه «V[0، 0:40]» باشند زیرا اینها 40 جزء اول بردار $v_{1}^{ هستند. T}$ که حالت اول $s_{0}$ را ضرب میکند. با این حال لطفا اگر اشتباه کردم به من اطلاع دهید. | تفسیر ماتریس های SVD در کاربردهای عملی |

49192 | من یک نمودار بسیار بزرگ و تابعی از رئوس آن دارم و می خواهم میانگین مقدار این تابع را تخمین بزنم. در این مسئله نمی توان از رئوس به طور یکنواخت نمونه برداری کرد، بنابراین یک انتخاب معقول برای تخمین، پیاده روی تصادفی ساده است. مشکل این است که برای هر رأسی فقط می توانم همسایه تصادفی آن را انتخاب کنم. یافتن کل همسایگی یک راس بسیار سخت است. بنابراین من درجاتی از رئوس نمونهبرداری شده را نمیدانم، نمیتوانم احتمالات ثابت را بیابم و نمیتوانم از برآوردگرهای استاندارد پیادهروی تصادفی استفاده کنم. آیا هنوز راهی برای بدست آوردن تخمین بی طرفانه از مقدار میانگین تابع وجود دارد؟ | پیاده روی تصادفی با دانش محدود نمودار |

68012 | فرض کنید می خواهیم 400 مراقب را به صورت تصادفی در یک مداخله والدین یا یک گروه کنترل لیست انتظار قرار دهیم. اما ما همچنین میخواهیم به یک تغییر برنامه برای یک نمونه فرعی از مراقبین کودکان با مشکلات رفتاری مشخص نگاه کنیم (به عنوان مثال، نسخه شدیدتر برنامه بازدید از خانه را به اجزای برنامه استاندارد اضافه میکند). ما میتوانیم از طرح فاکتوریل، کسری فاکتوریل یا طرح افزودنی استفاده کنیم، اما نمیخواهیم از منابع برای اجرای نسخه شدیدتر برنامه با همه، از جمله مراقبین کودکانی که دارای مشکلات رفتاری _بدون_ شناسایی شدهاند، استفاده کنیم. اساساً، ما میخواهیم به تأثیر مداخله والدین پیشگیرانه انتخابی خود برای همه مراقبان و تأثیر یک مداخله والدین پیشگیرانه برای مراقبین کودکان با مشکلات رفتاری شناخته شده نگاه کنیم. بنابراین، ما یک نظرسنجی پایه انجام می دهیم، کودکانی را شناسایی می کنیم که از محدوده رفتاری فراتر رفته اند، و سپس به صورت تصادفی با هر گروه (رفتار کم و زیاد) به درمان یا کنترل لیست انتظار بلوک می کنیم. سپس در گروه درمان (200=n)، دومین تصادفی سازی را در بین 80 مراقب کودکانی که از نمره برش رفتار فراتر رفته بودند، انجام دادیم. ما این 80 مراقب را بهطور تصادفی انتخاب میکنیم تا درمان استانداردی را که قرار است دریافت کنند یا نسخه پیشرفتهای از برنامه را دریافت کنند که شامل همه چیز در نسخه استاندارد بهعلاوه بازدید از خانه برای تقویت مهارتها است. تا اینجای کار خیلی خوبه. این کار شدنی به نظر می رسد. حال بیایید فرض کنیم که باید جوامع را تصادفی کنیم، نه مراقبان فردی را برای درمان یا کنترل. اما برای تشخیص اثر درمانی مورد نظر خود، به جوامع (خوشهها) بیشتری نسبت به توان مالی یا مدیریت نیاز داریم. بنابراین ما به طراحی پلکانی گوه ای (pdf) نگاه می کنیم. به دلیل اندازه گیری های مکرر، تعداد جوامع مورد نیاز برای تشخیص اثر درمانی مورد نظر ما قابل کنترل تر می شود، اگرچه ما نگران تعداد مشاهدات هستیم. [به عنوان مثال، انجام 5 دور مداخله با 15 جامعه (14 مراقب در هر جامعه) به این معنی است که ما 6 دور مشاهده یا 15 * 6 * 14 = 1260 نظرسنجی داریم.] این مشکلی ندارد، اما ما همچنین می خواهیم تأثیر افزایش یافته را تخمین بزنیم. برنامه (استاندارد + ویزیت در منزل) در میان مراقبین کودکانی که معیارهای ما را برای مشکلات رفتاری برآورده می کنند. در اینجا روش پیشنهادی من است: 1. دو برابر کردن تعداد مراقبین در هر جامعه از 14 به 28. 2. نیمی از جایگاه های هر جامعه (14) را برای مراقبین کودکانی که از نظر مشکلات رفتاری مثبت ارزیابی می کنند، ذخیره کنید. 3. مراقبین کودکانی را که از نظر مشکلات رفتاری مثبت غربالگری می کنند (14) به برنامه استاندارد (7) یا برنامه تقویت شده (7؛ استاندارد + بازدید از منزل) تصادفی سازی کنید. اگر محاسبه توان من درست باشد، و من باید برنامه را به 15 جامعه در 5 دور با 14 مراقب در هر جامعه تحویل دهم تا اثر درمانی مورد نظر خود را تشخیص دهم، آیا این درست است که فرض کنیم میتوانم تعداد مراقبان در هر جامعه را دو برابر کنم. به تأثیر برنامه پیشرفته (در مقابل برنامه استاندارد) نگاه کنید؟ | اثرات مداخله گوه پلکانی و افزایشی |

98966 | من سعی می کنم یک سیستم نظارتی بسازم که به طور خودکار هشداری را در صورت ایجاد تغییر چشمگیر در برخی از پارامترهای مشاهده شده ایجاد کند. مشکل من به این صورت است: ما برای تعداد زیادی از گیرندگان ایمیل ارسال می کنیم. برای هر انبوهی از ایمیلها، چند پارامتر مانند تعداد ایمیلهای ارسال شده و همچنین شمارندههای تعامل مانند باز کردن و کلیکها و همچنین برگشتها و لغو اشتراکها داریم. به طور معمول، تعداد ایمیل های ارسال شده در هر پست در طول زمان کمی تغییر می کند. نسبتهای تعامل ممکن است کم و بیش ثابت بمانند (البته با توجه به واریانس)، یا در طول زمان به آرامی افزایش یا کاهش پیدا کنند. هر زمان که تغییر چشمگیری در یکی از این معیارها وجود داشته باشد (مانند نرخ پرش از 1% به 3% در حالی که قبلاً کم و بیش ثابت بوده است یا نرخ باز کاهش از 30% به 20% در حالی که قبلاً به آرامی افزایش مییابد). ، من می خواهم بتوانم این تغییر روند را تشخیص دهم. من در حال حاضر از آستانه های ایستا استفاده می کنم، اما می خواهم نقاط پرت را شناسایی کنم که ممکن است نشان دهنده تغییر روند چشمگیر باشد. کدام روش های آماری برای حل این نوع مسائل مناسب هستند؟ | چگونه می توانم تغییرات چشمگیر را در مجموعه ای از مشاهدات تشخیص دهم؟ |

53308 | متأسفانه، مدت زیادی است که آمار را انجام نداده ام و علیرغم مطالعه و تحقیق، درباره نحوه محاسبه صحیح آن مطمئن نیستم. مایلم کوچکترین حجم نمونه مورد نیاز را بدانم تا سطح اطمینان معینی داشته باشیم که میانگین نمونه با درصد معینی از میانگین جامعه باشد. در حالی که دلخواه است، موارد زیر مشخص است (قابل محاسبه است): * اندازه جمعیت * میانگین جمعیت * انحراف استاندارد جمعیت نمونه گیری بدون جایگزینی خواهد بود. توزیع نرمال است. به عنوان مثال، برای یک جمعیت 1,000,000 با میانگین 0.90 و انحراف معیار جمعیت 1.32، من به یک نمونه n نیاز دارم تا 99٪ مطمئن باشم که میانگین نمونه در 1٪ از میانگین جامعه است. من علاقه مند به درک فرمول هستم زیرا باید چندین بار برای جمعیت های مختلف، سطوح اطمینان مختلف و حاشیه های مختلف خطا حل کنم. متشکرم. | چگونه می توانم حجم نمونه را محاسبه کنم تا بتوانم مطمئن باشم که میانگین نمونه تقریبی با میانگین جامعه است؟ |

53305 | ظاهراً برای خوشهبندی K-means، مرز تصمیم برای اینکه آیا یک نقطه داده در خوشه $A$ قرار دارد یا در خوشه $A'$ خطی است. من این جمله را کاملا متوجه نمی شوم. چرا خطی است؟ هر بار تکرار خوشهبندی K-means، نقاط داده را دوباره به خوشهها اختصاص میدهم تا خطای مربعی را به حداقل برسانم. سپس، نمونههای اولیه (مراکز خوشهها) را دوباره اختصاص میدهم تا دوباره خطا را به حداقل برسانم. چگونه این فرآیندها یک مرز تصمیم گیری خطی ایجاد می کنند؟ | چرا مرز تصمیم برای خوشه بندی K-means خطی است؟ |