text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

values | source stringclasses 4

values |

|---|---|---|---|---|

# Эксперты обнаружили критическую уязвимость в sudo, баг в утилите был с 2011 года

Эксперты компании Qualys [обнаружили](https://blog.qualys.com/vulnerabilities-research/2021/01/26/cve-2021-3156-heap-based-buffer-overflow-in-sudo-... | https://habr.com/ru/post/539526/ | null | ru | null |

# Кунг-фу стиля Linux: делиться — это плохо

В детском саду вы узнали о том, что делиться — это хорошо. Но, если речь заходит о компьютерной безопасности, часто оказывается, что не всё так однозначно. Концепция пространств имён (namespaces) появилась в ядре Linux начиная с версии 2.6.24. Это случилось много лет назад, ... | https://habr.com/ru/post/599109/ | null | ru | null |

# Пример использования Google AdWords API

Многие рекламодатели знают о преимуществах использования API в контекстной рекламе. Допустим, вам нужно запустить рекламную кампанию с большим количеством однотипных объявлений, но для раз... | https://habr.com/ru/post/112603/ | null | ru | null |

# On recursive queries

This article deals with writing recursive queries. This topic was brought up routinely, but the discussion was usually limited to simple cases related to trees: to descend from a vertex to the leaves and to ascend from a vertex to the root. We will address a more complicated case of an arbitrary... | https://habr.com/ru/post/490228/ | null | en | null |

# Инверсия зависимости и System.Data.Common.DbDataReader

Если мы не используем EF (такое случается), то нам нужно как-то устроить загрузку объектов из базы данных. Вариант: берём `DataSet`, делаем ему `SomeDa... | https://habr.com/ru/post/662976/ | null | ru | null |

# Zend_Form, русификация сообщений об ошибках

Публикую не свою статью. Вот ссылка на оригинал — <http://web-blog.org.ua/articles/uchim-zend-form-russkomu-yazuky> Но эта ссылка нерабочая.

Поэтому во избежание пропадания такой ценной, на мой взгляд, информации, я решила ее перепостить еще и сюда. Надеюсь автор не буд... | https://habr.com/ru/post/70386/ | null | ru | null |

# Скрещиваем WebWorker и Promise

Если уж есть необходимость скрещивать WebWorker с [XMLHttpRequest](http://habrahabr.ru/post/218989/), то пора бы скрестить его с любой функцией, а заодно разобраться с [обещаниями ES6](http://www.html5rocks.com/en/tutorials/es6/promises/).

Цель — научиться делать вот так:

`new P... | https://habr.com/ru/post/219037/ | null | ru | null |

# Еще к вопросу о множествах

#### Алиса: А почему это место ОЧЕНЬ странное место?

Додо: А потому, что все остальные места — очень уж не странные. Должно же быть хоть одно ОЧЕНЬ странное место.

Итак, рассмотрим текст шаблонного к... | https://habr.com/ru/post/450176/ | null | ru | null |

# Структурная модель СКУД предприятия с арендаторами и их клиентами

На одном предприятии, основным видом деятельности которого является предоставление офисов и складских услуг, возникла необходимость установить СКУД. Клиентами предприятия являются организации и индивидуальные предприниматели, занимающиеся торгово-заку... | https://habr.com/ru/post/283586/ | null | ru | null |

# Как завести драйвера для старых карт Mobility Radeon на Windows 8

Относительно недавно AMD выпустила специальный пакет драйверов для Windows 8, [AMD Catalyst Legacy 12.6](http://www2.ati.com/drivers/legacy/amd_catalyst_12.6_legacy_win8.exe) ([ссылка на новость на сайте AMD](http://support.amd.com/us/kbarticles/Pages... | https://habr.com/ru/post/156339/ | null | ru | null |

# 2048 на Erlang

Наверное на неделю игры 2048 на хабре уже не успеваю, но статья не столько о игре сколько о websocket сервере на Erlang. Небольшая предыстория. Когда начал играть в 2048, то просто не мог... | https://habr.com/ru/post/216517/ | null | ru | null |

# Разработка Tic-Tac-Toe на нативном JavaScript

Всем привет, и доброго времени суток, Хабравчане! Будучи в отпуске, дабы отвлечься от рутинных и рабочих процессов, решил чем-нибудь развлечь себя, и написать что-нибудь эдакое.

На чём писать? Решил выбрать нативный JavaScript, дабы подтянуть свой скилл, в одном из са... | https://habr.com/ru/post/347670/ | null | ru | null |

# Как написать игру для компьютера, в котором нет устройств ввода и вывода

Что можно сделать с [компьютером на электромагнитных реле](https://habr.com/post/331208/) у которого нет никаких устройств ввода, а из устройств вывода — только дамп восьми регистров?

Поиграть в игры, конечно! Играли же [древние люди](https:... | https://habr.com/ru/post/421491/ | null | ru | null |

# Система BBR: регулирование заторов непосредственно по заторам

### Измерение пропускной способности узких мест по времени двойного прохода пакета

По всем параметрам, сегодняшний интернет не может перемещать данные так быстро, как должен. Большинство пользователей сотовой связи в мире испытывают задержки от нескольки... | https://habr.com/ru/post/322430/ | null | ru | null |

# Установка в Alt Linux специализированного ПО, защищенного ключами Guardant, на примере ГосСтройСмета

В своей предыдущей статье ([Настройка Linux для инженера-ПТО/инженера-сметчика ч.2](https://habr.com/ru/post/663726/)), ко... | https://habr.com/ru/post/704686/ | null | ru | null |

# Великолепные стикеры с помощью CSS3

Доброго времени суток!

#### Введение

В своё время было необходимо сделать заметки в форме стикеров для веб-сайта. Как вы понимаете, выбора большого особо не было и мой выбор пал на всеми нам любимый CSS3. С его появлением осуществление задуманного стало возможным без какого-ли... | https://habr.com/ru/post/136238/ | null | ru | null |

# Чистая архитектура с Typescript: DDD и слоистая архитектура

Привет, Хабр! В последнее время уделяю много внимание архитектуре и решил поделиться с сообществом переводом статьи [Clean Architecture with Typescript: DDD, Onion](https://bazaglia.com/clean-architecture-with-typescript-ddd-onion/) автора [André Bazaglia](... | https://habr.com/ru/post/486734/ | null | ru | null |

# Вычислительные Графы, Спекулятивные Замки и Арены для Задач в Intel® Threading Building Blocks

Данный пост является переводом статьи «Flow Graphs, Speculative Locks, and Task Arenas in Intel Threading Building Blocks» из Parallel Universe Magazine, выпуск 18, 2014. Если вас интересует библиотека Intel TBB в частност... | https://habr.com/ru/post/228433/ | null | ru | null |

# Pixel Bender. Спецификация языка в контексте программирования под Flash Player

Эта статья является вольным переводом [официальной документации](http://www.adobe.com/devnet/pixelbender/pdfs... | https://habr.com/ru/post/84396/ | null | ru | null |

# Rust crashcourse. Итераторы

> Ниже представлен перевод одной из частей серии статей Rust Crash Course от Майкла Сноймана, которая посвящена итераторам. Мне материал показался удачным в плане доступности изложения, поэтому перевод, сделанный для себя, решил опубликовать. Надеюсь, что это кому-то пригодится. Если данн... | https://habr.com/ru/post/533204/ | null | ru | null |

# Эволюция веб-фреймворков Microsoft. ASP.NET vNext

#### Предпосылки к переменам

Новость о выходе ASP.NET vNext в сети распространилась достаточно быстро вместе с анонсом наиболее интересных новшеств, пре... | https://habr.com/ru/post/226427/ | null | ru | null |

# Dark Launch в Istio: секретные службы

«Опасность – мое второе имя», – говаривал Остин Пауэрс, человек-загадка международного масштаба. Но то, что в почете у суперагентов и спецслужб, совсем не годится для служб компьютерных, где скукотища гораздо лучше опасностей.

Друзья, если честно устал чистить СПАМ комментариях, которые даже несмотря на защиту **Akismet** они пробиваются. Пришлось поставить более крутую **... | https://habr.com/ru/post/43016/ | null | ru | null |

# Полезный тэг <label>

Тэг позволяет при щелчке по тексту передававать фокус ввода элементу типа :

`Имя:` | https://habr.com/ru/post/10639/ | null | ru | null |

# Vim по полной: Менеджер плагинов без фатальных недостатков

Оглавление

==========

1. [Введение](http://habrahabr.ru/post/259701/) (vim\_lib)

2. **Менеджер плагинов без фатальных недостатков** (vim\_lib, vim\_plugmanager)

3. [Уровень проекта и файловая система](http://habrahabr.ru/post/259995/) (vim\_prj, nerdtree)

4... | https://habr.com/ru/post/259725/ | null | ru | null |

# Колокол — система событий в Go или очередная event-system библиотека

В работе над одним проектом в компании NUT.Tech нам понадобилась система событий, работа которой не влияла бы на основной поток выполнения программы.

Требования к системе были довольно простыми:

* Возможность подписываться на события,

* Возможно... | https://habr.com/ru/post/651453/ | null | ru | null |

# Я перешел на Ubuntu и не… жалею?

Пост ненависти. К мирозданию в целом и к своей карме что ли.

В общем, достался мне компик. Dell PowerEdge 400SC (Service Tag: 2KF6641). И решил я его подключить к телевизору, потому что мне казалось, что это единственный способ посмотреть флеш-контент на телеке.

*Кстати, отличн... | https://habr.com/ru/post/202056/ | null | ru | null |

# Генерация PDF из WPF-приложения «для всех, даром, и пусть никто не уйдет обиженный»

Пару недель назад на проекте появилась задача генерации PDF.

Разумеется, я, как разработчик WPF UI, сразу был против сурового подхода кодирования отрисовки всех примитивов PDF в коде C#.

И заказчик был непротив покупки некоег... | https://habr.com/ru/post/201836/ | null | ru | null |

# RxConnect — когда React встречает RxJS

Данный перевод является русскоязычной интерпретацией документации, которую я сам и написал, поэтому не стесняйтесь задавать вопросы.

Введение

========

Обрабатывать пользовательский ввод может быть не так просто, как кажется. Мы же не хотим отправлять запросы на сервер пока по... | https://habr.com/ru/post/309226/ | null | ru | null |

# Foobnix — новый музыкальный плеер

Думаю ни для кого не секрет что в линуксе великое множество разнообразных музыкальных плееров на любой вкус — Rhytmbox, Exaile, Banshee, DeadBeef, Decibel, Clementine, Amarok, XNoise, QMMP, Audacious, Minitunes, gMusicbrowser, MPD(Sonata...) итд. Все они имеют как преимущества так и... | https://habr.com/ru/post/102450/ | null | ru | null |

# Новшества JavaScript: итоги Google I/O 2019. Часть 1

Материал, первую часть перевода которого мы сегодня публикуем, посвящён новым стандартным возможностям JavaScript, о которых шла речь на конференции [Google I/O 2019](https://www.youtube.com/watch?v=c0oy0vQKEZE). В частности, здесь мы поговорим о регулярных выраже... | https://habr.com/ru/post/464129/ | null | ru | null |

# PHPUnit: простой синтаксис для создания mock-объектов

1. почему не mockery

2. основное преимущество — синтаксис

3. моки — нативные

4. создание stub-объектов

5. мокирование свойств класса

6. mock injection

7. удобны... | https://habr.com/ru/post/183010/ | null | ru | null |

# Задача на сортировку

Возможно, кому-то эта задача покажется пустяковой, но лично я потратил на неё несколько часов, израсходовав подсказки «мнение зала» и «звонок другу». Зачем я это решал? Ответ прост: мне действительно нужно было реализовать такой подход для моего небольшого сайтика [Одио.ру](http://www.odio.ru/).... | https://habr.com/ru/post/85945/ | null | ru | null |

# Борьба с TOAST или будущее JSONB в PostgreSQL

В PostgreSQL есть два типа данных: JSON и JSONB. Первый формат является текстовым хранилищем, в котором json хранится "as is", второй — бинарным, в нем ключи... | https://habr.com/ru/post/646987/ | null | ru | null |

# SSL-сертификаты от Let's Encrypt с cert-manager в Kubernetes

В этой статье я расскажу о том, как автоматизировать заказ и продление сертификатов от Let’s Encrypt (и не только) для Ingress’а в Kubernetes с помощью дополнения cert-m... | https://habr.com/ru/post/496936/ | null | ru | null |

# Быстрый, мощный интерфейс на Python

### И минимум зависимостей

DearPyGuiDear PyGui принципиально отличается от других фреймворков GUI Python. Рендеринг на GPU, более 70 виджетов, встро... | https://habr.com/ru/post/576912/ | null | ru | null |

# journald вместо syslog

Давным-давно, когда были дебаты о том, стоит ли принимать в качестве init-системы systemd (с одной стороны удобно, с другой стороны, довольно токсичный автор...), вместе с systemd приехал и journald. В целом, он ощущался как аппендикс к systemd, и вместе с `ForwardToSyslog`, он мирно жил на се... | https://habr.com/ru/post/546368/ | null | ru | null |

# (Микро)фронтенды и микросервисы с помощью Webpack

Привет! Меня зовут Максим, я фронтенд-разработчик компании Тинькофф, лид команды фронтендов, которые пилят международные проекты. Я работал как фронтом, так... | https://habr.com/ru/post/701152/ | null | ru | null |

# Использование типов TypeScript вместо Swagger

Сегодня я расскажу о том, как мы можем с помощью типов написать простое расширение для ExpressJS.

А если вы в своём приложении/приложениях используете только решения на TypeScript(JavaScript), то у вас отпадёт необходимость в Swagger.

Вообще, одно из главных преимущест... | https://habr.com/ru/post/571240/ | null | ru | null |

# Упрощенный синтаксис для jsonb в PostgreSQL 14

Как сообщает telegram-канал [Cross Join](https://t.me/crossjoin), в репозиторий Postgres упал [комит](https://github.com/postgres/postgres/commit/676887a3b0b8e3c0348ac3f82ab0d16e9a24bd43), упрощающий работу с jsonb. Теперь можно обращаться к частям jsonb с помощью квадр... | https://habr.com/ru/post/540428/ | null | ru | null |

# HTML-минимизация в Web Essentials 2013

Одним из наиболее существенных нововведений для веб-разработчиков в Visual Studio 2013 стал новый HTML-редактор. В отличие от ... | https://habr.com/ru/post/199206/ | null | ru | null |

# Правда ли, что Go быстрее Ruby?

Последние несколько лет я занимаюсь созданием игр для социальных сетей. В качестве back-end применяю связку Ruby + Sinatra + Redis. Redis используется в качестве единственной базы данных. Производительности одной базы Redis часто не хватает, поэтому используется кластер из нескольких ... | https://habr.com/ru/post/260033/ | null | ru | null |

# Программный поиск общего кода с помощью oEmbed

Всем доброго времени суток! Хочу поделиться переводом статьи ""[Programmatically Discovering Sharing Code With oEmbed](https://www.smashingmagazine.com/2019/11/programmatically-discovering-sharing-code-oembed/)" автора Drew McLellan.

Введение

--------

*На многих сай... | https://habr.com/ru/post/477904/ | null | ru | null |

# Масштабируемый отказоустойчивый файловый сервис на базе CTDB, GlusterFS

Статья является пошаговым руководством по построению масштабируемого отказоустойчивого файлового хранилища, доступ к которому будет осуществлен по протоколам Samba, NFS. В качестве файловой системы, которая будет непосредственно отвечать за сохр... | https://habr.com/ru/post/194970/ | null | ru | null |

# Автоматизация аппаратного тестирования Embedded Систем

Продолжим цикл статей об автоматизации тестирования Embedded систем. В этой статье будет рассказано как можно быстро и относительно просто интегрировать возможность управления питанием тестируемого устройства из тестового скрипта а так же получить возможность им... | https://habr.com/ru/post/477514/ | null | ru | null |

# Наш пятничный квест для сисадминов и не только

Мы в компании «Флант» любим IT-квесты — те, кто устраивался к нам на работу, прекрасно об этом знают. И так замечательно сложилось, что в свободное от основной занятости время мне посчастливилось придумать ещё одну головоломку.

Решение опубликовать её в хабе системно... | https://habr.com/ru/post/352226/ | null | ru | null |

# Разработка нового статического анализатора: PVS-Studio Java

Статический анализатор PVS-Studio известен в мире C, C++ и C# как инструмент для выявления ошибок и потенциальных уязвимостей. Однако... | https://habr.com/ru/post/414669/ | null | ru | null |

# C++ и дружба

Открыл для себя забавный факт: оказывается, у классов в C++ могут быть воображаемые друзья. Пример:

`**class** Fred {`

Заметьте, что в программе нет объявления класса Joe, однако программа компилируется без ошибок (и без предупреждений). То есть Джо не существует, его можно назвать воображаемым д... | https://habr.com/ru/post/63559/ | null | ru | null |

# О декораторах, сквозной функциональности, CQRS и слоеной архитектуре

Разработчик SimpleInjector [очень любит «декораторы»](http://simpleinjector.readthedocs.io/en/latest/aop.html#decoration), особенно в сочетании с дженериками вида... | https://habr.com/ru/post/353258/ | null | ru | null |

# DSW Reports — генератор отчетов DeepSeeWeb

DSW Reports — генератор отчетов DeepSeeWeb

==========================================

Часто в аналитических приложениях пользователям нужно периодически формировать и рассылать PDF-отчёты, состоящие из элементов аналитической панели. В разработках на технологиях InterSyste... | https://habr.com/ru/post/419433/ | null | ru | null |

# Вникаем в include и extend

*Примечание переводчика: перед прочтением этого поста рекомендую сначала ознакомиться с постом [Вникаем в метаклассы Ruby](http://habrahabr.ru/post/143990/).*

Все рубисты знакомы с формал... | https://habr.com/ru/post/143483/ | null | ru | null |

# Соединяем блог и Livejournal через XML-RPC

XML remote procedure call на самом деле очень простая процедура, при помощи которой я теперь могу писать в своём блоге и копировать статью в livejournal. С виду, самым... | https://habr.com/ru/post/12217/ | null | ru | null |

# Разработка OS на Go+asm Part 0x00

Доброго времени суток %username%.

Захотелось мне пописать что-то ненормальное. Выбор пал на ОС, в конце-концов каждый программист должен написать свою ОС, пусть хотя бы учебную.

Как некоторым известно, я очень люблю язык Go ну, и решил попробовать написать на нем. Что из этого... | https://habr.com/ru/post/259719/ | null | ru | null |

# 3D-графика в Go

В большинстве случаев, когда речь заходит об использовании Go, вспоминается backend или DevOps и в самую последнюю очередь можно подумать об использовании Go для создания [мобильных](https:/... | https://habr.com/ru/post/708170/ | null | ru | null |

# Типичные ошибки начинающих работать с изображениями

Цифровая обработка изображений — весьма интересная область, но она таит в себе множество подводных камней, на которые постоянно натыкаются новички. Мы активно привлекаем сту... | https://habr.com/ru/post/319606/ | null | ru | null |

# Dagaz: Эпизоды (часть 1)

***Мы расшатали ваши умственные фильтры, и в результате появился ответ. Метод сработал, он будет действенным всегда. Все, что необходимо сделать — это избавиться от лишнего груза предрассудков…

Раймонд Джоу... | https://habr.com/ru/post/459456/ | null | ru | null |

# Автоматизация веб-сервера FreeBSD8 Apache2+Mysql5 Часть 1

Так уж сложилось, что я жутко ленивый. Два года назад когда я приобрел себе VDS и встретился с FreeBSD 7.1 первый раз, убил две недели на настройку всего, что мне нужно было. Сейчас у меня 2\*Pentium III 1GHz / RAM 1Гб / 2\*SCSI 17Гб, под мои задачи он вполне... | https://habr.com/ru/post/96933/ | null | ru | null |

# R и Информационная безопасность. Как устранить противоречие интересов и запустить R на Linux в оффлайн-режиме

Является продолжением [предыдущих публикаций](https://habrahabr.ru/post/342254/).

Очень часто попытки применить инструменты DataScience в корпоративной среде встают в полное противоречие с требованиями Служ... | https://habr.com/ru/post/345000/ | null | ru | null |

# 50+ сочных запоминающихся современных концепций инфографики на каждый день

В ответ на недавний топик о [MindMap](http://habrahabr.ru/blogs/lifehack/61254/#habracut) предлагаю вашему вниманию современные концепции визуализации и представления данных. Подробно разбирать каждую инфографику считаю излишним. Смотрим, вдо... | https://habr.com/ru/post/61503/ | null | ru | null |

# Phoenix Framework – Webpack вместо Brunch, деплой с помощью Distillery и немного systemd

Эта статья является попыткой автора свести воедино в виде небольшого руководства несколько тем, с которыми, так или иначе, сталкиваю... | https://habr.com/ru/post/331598/ | null | ru | null |

# QML: анимированная иконка-«бутерброд» в стиле Material Design за 20 минут

Привет, Хабр.

Многие разработчики, интересующиеся разработкой пользовательских интерфейсов (да и просто пользователи Android) уже успели ознакомиться с новой концепцией интерфейса Material Design, активно продвигаемой Google в рамках выпуск... | https://habr.com/ru/post/243355/ | null | ru | null |

# Новости из мира OpenStreetMap № 503 (03.03.2020-09.03.2020)

Картатон в университете Сент-Луиса в городе Багио на Филиппинах [1](#wn503_22091) | Photo GOwin

Картографирование

-----------------

... | https://habr.com/ru/post/493584/ | null | ru | null |

# Собираем систему потоковой аналитики из логов приложений

Приветствую, коллеги.

В этой статье хочу поделиться с вами опытом построения **системы мониторинга бизнес показателей в режиме реального времени,** которая построена на основе сбора логов.

Перед тем, как погрузиться в технические детали, немного расскажу о ... | https://habr.com/ru/post/697970/ | null | ru | null |

# Создание библиотеки компонентов с использованием Storybook

### Введение

В наши дни разработка интерфейса является достаточно затратным процессом который требует усилий от множества людей, разработчиков, дизайнеров, тестировщиков продукт ... | https://habr.com/ru/post/340384/ | null | ru | null |

# PostgreSQL Antipatterns: насколько глубока кроличья нора? пробежимся по иерархии

В сложных ERP-системах **многие сущности имеют иерархическую природу**, когда однородные объекты выстраиваются в **дерево отношений «предок — потомок»** — это и организационная структура предприятия (все эти филиалы, отделы и рабочие гр... | https://habr.com/ru/post/501614/ | null | ru | null |

# QEMU-KVM под LXC

**Как обычно — обстоятельства диктуют правила.** На этот раз мы ставим Proxmox и Libvirt на один тот же сервер.

Столкнулись с очередной задачей — заказчик поставил условие разве... | https://habr.com/ru/post/330016/ | null | ru | null |

# Построение множества Жюлиа

Привет. Кипят страсти, конец года, сессии, дедлайны, новый год, а так же цензура проникает во все слои интернетов, что не может не печалить. [Хабр уже не торт](http://tjournal.ru... | https://habr.com/ru/post/206516/ | null | ru | null |

# Уроки компьютерного зрения на Python + OpenCV с самых азов

[**Оглавление.**](https://habr.com/ru/post/688316/)

В этом цикле уроков я расскажу о том, как использовать библиотеку OpenCV в языке Python. Но для начала несколько слов о самом компьютерном зрении. Как компьютер вообще видит? Если подключить к нему видео... | https://habr.com/ru/post/540166/ | null | ru | null |

# React Native с колокольни Android разработки часть 2

Свою прошлую [статью](https://habrahabr.ru/post/329380/) я написал спустя несколько дней, после того, как я вообще начал ковыряться в react native, до этого имея опыт только в нативной разработке под android и iOS. Спустя это время я уже успел поработать над реаль... | https://habr.com/ru/post/333518/ | null | ru | null |

# Wix toolset: не так страшен черт, как Windows installer

В статье я хотел бы поделиться своим опытом написания инсталлятора для Windows с использованием инструмента **Windows Installer XML Toolset** (далее -... | https://habr.com/ru/post/668082/ | null | ru | null |

# Hilt+Retrofit+Coroutine

В данной статье хочется показать подробный пример использования Hilt совместно с Retrofit, запросы к бд будут ассинхронно выполнять с помощью Coroutines.

* Hilt - это библиотека для внедрения зависимостей для Android, которая сокращает количество шаблонов для ручного внедрения зависимостей в... | https://habr.com/ru/post/568792/ | null | ru | null |

# Приложение для конвертирования jpg файлов в pdf файл

Здравствуйте, читатели моего блога. Сегодня я расскажу про программы, которые помогут при конвертации большого числа рисунков или фотографий формата jpg ... | https://habr.com/ru/post/536926/ | null | ru | null |

# Разработка REST-серверов на Go. Часть 2: применение маршрутизатора gorilla/mux

Перед вами второй материал из серии статей, посвящённой разработке REST-серверов на Go. В [первом](https://habr.com/ru/company/ruvds/blog/559816/) материале этой серии мы создали простой сервер, пользуясь стандартными средствами Go, а пос... | https://habr.com/ru/post/561108/ | null | ru | null |

# Цикличность и временное отключение приемников событий в SharePoint

Как Вы можете знать, в SharePoint существует множество приемников событий (EventReceiver), которые позволяют вызывать пользовательский код при выполнении стандартных операций с объектами SharePoint, например добавление/удаление/изменение элементов сп... | https://habr.com/ru/post/220177/ | null | ru | null |

# Бесшовная (почти) миграция между мажорными релизами PostgreSQL с помощью логической репликации

У нас в True Engineering на одном проекте назрела необходимость в смене версии PostgreSQL с 9.6 на 11.1.

Зачем? База данных на проекте уже объемом 1,5 Tb и растет. Перформанс – одно из основных требований к системе. А с... | https://habr.com/ru/post/437318/ | null | ru | null |

# Создание арта с помощью DCGAN на Keras

Доброго времени суток. Полгода назад я начал изучать машинное обучение, прошел пару курсов и получил некоторый опыт в этом. Затем, видя самые разные новости о том, какие нейронные сети крутые и много могут делать, я решил попробовать изучить их. Начал читать книгу Николенко про... | https://habr.com/ru/post/431614/ | null | ru | null |

# Проблемы работы модулей в Joomla 1.5 с использованием двух и более шаблонов и компонента Joomfish

В моей практике часто случалось использовать два и более шаблона для Жумла сайтов. В Joomla 1.5 это вполне удобно реализовано, один шаблон выбирается default (применяемый ко всем новосозданным пунктам меню), а второй «в... | https://habr.com/ru/post/123874/ | null | ru | null |

# Решение проблемы с созданием нового скрипта

Суть её такова: Если в имени пользователя Windows используется кириллица, то при создании нового скрипта(из меню Greasemonkey) его файл не открывается в редакторе из-за неверного пути.

Покопавшись в исходниках Greasemonkey, было найдено решение.

1. Идём в папку с доп... | https://habr.com/ru/post/73908/ | null | ru | null |

# Анализ тональности в социальных медиа на русском языке при помощи RussianSentimentAnalyzer API

В этом посте я покажу, как воспользоваться [API](https://www.mashape.com/dmitrykey/russiansentimentanalyzer) анализа тональности в социальных медиа на русском языке. Одной из отличительных фич системы является возможность ... | https://habr.com/ru/post/262213/ | null | ru | null |

# «Идеальный» кластер. Часть 3.1 Внедрение MySQL Multi-Master кластера

#### В продолжение цикла статей об «Идеальном» кластере хочу поделиться моим опытом развертывания и настройки Multi-Master кластеров MySQL.

**Другие м... | https://habr.com/ru/post/253869/ | null | ru | null |

# Устанавливаем бесплатный SSL–сертификат StartSSL на облачный VPS от Infobox

В этой статье мы рассмотрим, как заказать бесплатный SSL–сертификат и установить его на [облачный VPS от Infobox](http://infobox.ru/vps/cloud). Базовые SSL–сертификаты бесплатно выдает центр сертификации [StartCom](https://www.startssl.com/?... | https://habr.com/ru/post/256283/ | null | ru | null |

# MrRobotQR сканируем QR-коды из поисковых систем в поисках приватных ключей Биткоин Кошельков

Всем нам известна фраза: *"Все что попадает в интернет, остается в нем навсегда и становится общедоступным".*

##... | https://habr.com/ru/post/684362/ | null | ru | null |

# Делаем станцию мониторинга загрязнённости воздуха в домашних условиях

В этой статье я расскажу о том, как собрать датчик загрязнённости воздуха в домашних условиях и зачем это нужно.

В последнее время всё... | https://habr.com/ru/post/525140/ | null | ru | null |

# От идеи к разработке: что нужно знать о создании стратегий для торговли на бирже. Часть III

[](https://habrahabr.ru/company/itinvest/blog/281148/)

На Хабре и в [аналитическом разделе нашего сайта](http://www.itinvest.ru/a... | https://habr.com/ru/post/281148/ | null | ru | null |

# Django multiple database support — теперь поддерживает множественные соединения с базами данных

Весь твиттер буквально кипит от это новости – django теперь поддерживает множественные соединения с базами данных. Фича [влита в транк](http://s3.amazonaws.com/bycoffe.baconfile.com/multidb.diff.txt) и [описана в документ... | https://habr.com/ru/post/79062/ | null | ru | null |

# «А давайте выйдем на рынок СНГ»: как масштабировать сайт, если он к этому не готов

Рано или поздно у крупных проектов наступает такой этап, когда достигнут потолок по аудитории или финансовым показателям и нужно как-то расти дальше. И вот в один прекрасный день сияющие коллеги приходят к тебе со словами «Мы тут реши... | https://habr.com/ru/post/701872/ | null | ru | null |

# Компиляция. 1: лексер

Меня всегда завораживало таинство рождения программой программы. К сожалению, российские вузы уделяют мало внимания сей интереснейшей теме. Рассчитываю написать серию постов, в которых поэтапно создадим маленький работоспособный компилятор.

Первые посты серии уже подготовлены, и бета-тестиро... | https://habr.com/ru/post/99162/ | null | ru | null |

# Рисуем интерактивный линейный график на iOS с помощью Charts

Однажды бизнес попросил меня создать минималистичный график, который будет отображать сглаженную кривую с градиентом под ней. По этому графику можно перемещаться между значениями, водя пальцем. При этом за пальцем должна следовать вертикальная линия, а тек... | https://habr.com/ru/post/669854/ | null | ru | null |

# Как NodeJS обрабатывает множественные запросы?

Существует много путаницы по поводу конкурентности и параллелизма. Некоторые люди используют эти термины как взаимозаменяемые, но на самом деле они означают две разные вещи.

***Всем привет. В преддверии старта курса [«Python QA Engineer»](https://otus.pw/HfQy/) подготовили перевод еще одного интересного материала.***

---

... | https://habr.com/ru/post/493796/ | null | ru | null |

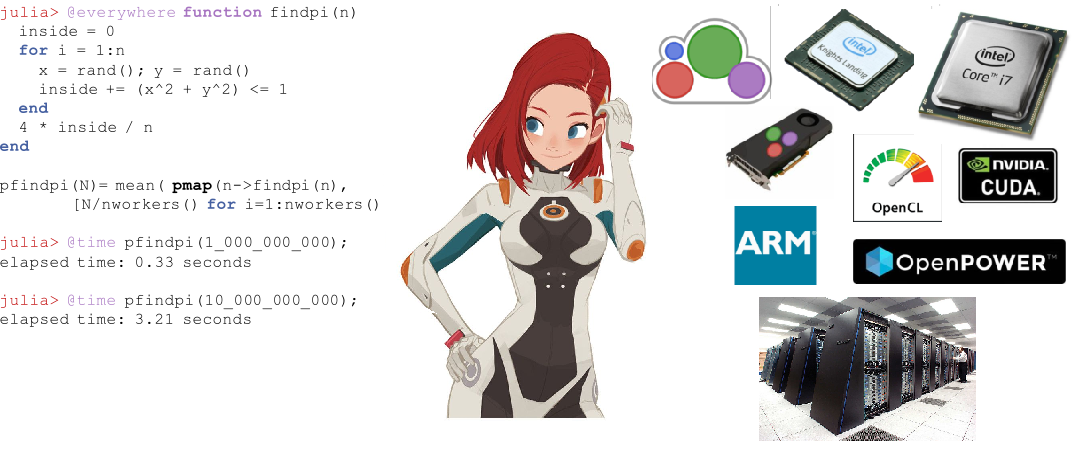

# Джулия и параллельные вычисления

С момента выхода в августе 2018, язык Julia активно набирает популярность, войдя в [топ 10 языков на Github](https://newsletter.juliacomputing.com/sendy/l/yUUX892w0QURpRZe20zeKxUw/CTWGjHMV892tWp6pxaM... | https://habr.com/ru/post/454998/ | null | ru | null |

# Openstack. Детективная история или куда пропадает связь? Часть первая

Эта история про OpenStack + KVM. Всё началось, когда работало всё хорошо. «Старая» платформа всех удовлетворяла. Её поднимали без нас, и она слегка устарела. Это была Juno. При этом она работала.

В принципе она была тестовой, пока в один прекра... | https://habr.com/ru/post/321442/ | null | ru | null |

# Proof of Concept: Как проверить, что внедрение ML стоит свеч

Недавно в уютном чатике дата сатанистов подняли вопрос, как правильно "продавать" внутренние проекты по машинному обучению. Оказалось, что многие из нас весьма брезгливо относятся к экономическому обоснованию своей деятельности. Меж тем, чтобы провести мин... | https://habr.com/ru/post/438212/ | null | ru | null |

# Меши с Python & Blender: двумерная сетка

Привет! Понадобилось процедурно генерировать сложную модель, и пока я копал, как это делается, нашёл несколько статей от Diego Gangl, cg артиста и разработчика Блендера. Они славные для новичка, понимающего в моделировании, и не умеющего в код. Это перевод одной из них. Неточ... | https://habr.com/ru/post/646527/ | null | ru | null |

# Обобщаем анимацию таблиц в iOS приложениях

#### Пользователи хотят видеть изменения

Анимированное обновление списков всегда было непростой задачей в iOS. Что неприятно, это всегда было рутинной задачей.

Приложения крупных компан... | https://habr.com/ru/post/350230/ | null | ru | null |

# Мультиклеточный процессор — это что?

Многие слышали о мультиклеточной архитектуре, процессорах и даже первых устройствах на них. Особенно продвинутые пользователи опробовали свои алгоритмы. Были проведены первые простые тесты производительности, а также пользователь [Barsmonster](http://habrahabr.ru/users/barsmonste... | https://habr.com/ru/post/226773/ | null | ru | null |

# Управление компьютером без рук (гироскоп мне в темя!)

В [предыдущей статье](/post/208108/) я рассказал, как можно управлять компьютером при помощи глаз. Несмотря на то, что в ряде случаев отслеживание положения ... | https://habr.com/ru/post/213715/ | null | ru | null |

# О C++ и объектно-ориентированном программировании

Привет, Хабр!

Вашему вниманию предлагается статья, автор которой не одобряет сугубо объектно-ориентированного подхода при работе с языком С++. Просим вас по возможности оценить не только авторскую аргументацию, но и логику, и стиль.

В последнее время много [пиш... | https://habr.com/ru/post/528176/ | null | ru | null |

# uLogin на ASP.Net сайте

Потребовалось на днях прикрутить uLogin к asp.net сайту, но с ходу найти готовый код как-то не получилось. Определенно кто-то столкнется с данным вопросом…

На мой выбор использовать ли uLogin ([обзор на хабре](http://habrahabr.ru/post/130893/)) в своих проектах повлияли [некоторые цифры](h... | https://habr.com/ru/post/142631/ | null | ru | null |

Subsets and Splits

No community queries yet

The top public SQL queries from the community will appear here once available.