text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

values | source stringclasses 4

values |

|---|---|---|---|---|

# Core Data для iOS. Глава №2. Практическая часть

Хабралюди, добрый день!

Сегодня хочу начать написание ряда лекций с практическими заданиями по книге Михаеля Привата и Роберта Варнера «Pro Core Data for iOS», которую можете купить по [этой](http://www.apress.com/9781430236566) ссылке. Каждая глава будет содержать ... | https://habr.com/ru/post/192090/ | null | ru | null |

# Начало работы с серверными приложениями Blazor в Visual Studio for Mac

В Visual Studio 2019 for Mac [v8.4](https://devblogs.microsoft.com/visualstudio/visual-studio-2019-for-mac-version-8-4-is-now-available/) мы добавили поддержку разработки [серверных приложений Blazor](https://docs.microsoft.com/en-us/aspnet/core/... | https://habr.com/ru/post/485572/ | null | ru | null |

# Обработка и классификация запросов. Часть третья: Исправление опечаток

Опечатки бывают иногда полезны тем, что веселят читателя. Поисковые системы оценить юмора пока не в состоянии, и слова, набранные с ошибками, приводят их в замешательство, что в результате огорчает пользователя. Для предотвращения этих явлений су... | https://habr.com/ru/post/178401/ | null | ru | null |

# Webiny Framework. Первый взгляд

Есть шутка о типичной карьере разработчика:

1. Не использует фреймворки

2. Обнаруживает фреймворки

3. Пишет свои фреймворки

4. Не использует фреймворки

Пункт 4, конечно же, ссылается на новоприобретенные способности использовать Composer [для построения собственных фреймворков](ht... | https://habr.com/ru/post/256309/ | null | ru | null |

# Blazor 0.9.0 experimental release now available

Blazor 0.9.0 is now available! This release updates Blazor with the Razor Components improvements in .NET Core 3.0 Preview 3.

New Razor Component improvements now available to Blazor apps:

* Improved event handling

* Forms & validation

Не каждый бобер способен разглядеть в себе единорогаВсем п... | https://habr.com/ru/post/693722/ | null | ru | null |

# Как напечатать бейджи для компании и не умереть

Людям сложнее начать общаться, когда они не знают, как друг к другу обратиться. Незнакомца не спросишь, сколько в его продукте страниц осталось перевести на webpack и кто у него скрам-мастер. За последние пару лет у нас стало слишком много людей, чтобы все могли познак... | https://habr.com/ru/post/359164/ | null | ru | null |

# Расчёт параметров предделителя для 8250-совместимых USART

Сегодняшним вечером я расскажу ~~сказку~~ о том, как можно эффективно вычислить параметры предделителя, который обычно используется для задания тактовой частоты USART портов, в частности 8250-совместимых, применяемых в Intel SoC.

На текущий момент существ... | https://habr.com/ru/post/252833/ | null | ru | null |

# AP Failover и AP Fallback в реализации Cisco Unified Wireless

Когда точка доступа уже подключилась к контроллеру (AP Join), есть два механизма, которые влияют на выбор контроллера:

* Если точка доступа теряет связь с существующим контроллером, то запускается механизм AP Failover.

* Если точке доступа, не теряя связ... | https://habr.com/ru/post/325354/ | null | ru | null |

# Контейнеризация Caché

В этой статье я хочу рассказать про то как можно получить свой образ [Docker](https://docs.docker.com/engine/getstarted/) с InterSystems Caché/Ensemble.

Начнем с самого начала, т.е. с Dockerfile. [Dockerfile](https://docs.docker.com/engine/reference/builder/) это простой текстовый файл в фо... | https://habr.com/ru/post/323746/ | null | ru | null |

# PostgreSQL Antipatterns: «где-то я тебя уже видел...»

Иногда при анализе производительности запроса на предмет "куда ушло все время" возникает стойкое ощущение deja vu, что вот **ровно этот же кусок плана** ты уже где-то раньше видел...

Пролистываешь выше - и таки-да, вот он рядом - но почему он там оказался, и как... | https://habr.com/ru/post/574330/ | null | ru | null |

# Arista. Знакомство

На Хабре нет ни одного поста про коммутаторы компании [Arista Networks](http://www.aristanetworks.com/). При этом [есть несколько комментариев](http://habrahabr.ru/search/?target_type... | https://habr.com/ru/post/211869/ | null | ru | null |

# Неправильно именуйте непеременные

Все началось лет 8 назад. Я тогда писал одну программу для математических расчетов, и мой преподаватель указал, что я неверно именую переменные. Он бы... | https://habr.com/ru/post/328278/ | null | ru | null |

# Релиз Phalcon 2.0.3

В рамках нашего расписания регулярных релизов, мы рады сообщить, что Phalcon 2.0.3 был выпущен!

Эта версия содержит множество исправлений, а также новые возможности, основанные на фидбеке сообщества.

#### Изменения

* Реализованы псевдонимы для namespace в PHQL

* Возможность определять долж... | https://habr.com/ru/post/260141/ | null | ru | null |

# Unit тестирование в js. YATS — поделка для написания юнит тестов

Добрый день!

Начать свою статью я хочу с небольшого вступления. Вы помните, какими были сайты лет 10 назад? а пять? Если сайты и содержали какую-то js логику, то она была проста и наивна. На сегодняшний день каждый второй — это не просто статические... | https://habr.com/ru/post/232911/ | null | ru | null |

# Расширение возможностей Spark с помощью MLflow

***Привет, хабровчане. Как мы уже писали, в этом месяце OTUS запускает сразу два курса по машинному обучению, а именно [базовый](https://otus.pw/h8IZ/) и [продвинутый](https://otus.pw/jut8/). В связи с этим продолжаем делиться полезным материалом.***

Ряд СМИ [сообщили 5 апреля](https://russian.rt.com/article/157211) о запуске системы добровольной регистра... | https://habr.com/ru/post/392579/ | null | ru | null |

# Cisco 1812 как домашний роутер

Решил я найти замену своему D-Link DIR-300, т.к. держать качественное соединение с моим новым провайдером по L2TP он упорно отказывался, да и вообще железка морально устарела. Перечитав кучу обзоров домашних маршрутизаторов я понял, что, в принципе, они все одинаковые: с одинаковыми во... | https://habr.com/ru/post/136342/ | null | ru | null |

# Alternate of Packed-Binary Time Format

The Real-Time Clock (RTC) Calendar Registers in STM32 microcontrollers implemented in Binary Code Decimal format (BCD) i. e., every two digits are represented by one byte (low digit in 0-3 bits and high digit 4-7 bits). At least there are 5 bytes required to store date and time... | https://habr.com/ru/post/653335/ | null | en | null |

# Программируем Arduino Uno на Rust: настраиваем среду и моргаем светодиодом

Кто-то из вас наверняка задавался вопросом: а нельзя ли программировать Arduino на чём-то более современном и удобном? Вот и я задавался. И нашёл Rust (не то, чтобы я о нём не знал). И на нём можно программировать микроконтроллеры AVR и платы... | https://habr.com/ru/post/686168/ | null | ru | null |

# Уход инженера-электронщика из Apple вызвал волнение среди биржевых спекулянтов. Как стать таким как он?

29 марта инженер по имени Жерард Вильямс Третий ушел из компании Apple. Это известие сразу опубликовал CNET и еще три десятка изданий во всем мире, не только технических, но и финансовых. Что же такого делал этот ... | https://habr.com/ru/post/446798/ | null | ru | null |

# Руководство по созданию собственных шейдеров в Unreal Engine

Благодаря системе нодов редактор материалов является отличным инструментом для создания шейдеров. Однако у него есть свои ограничения. Например, ... | https://habr.com/ru/post/353722/ | null | ru | null |

# Отключайте autocomplete

В 1999-м году в браузере IE 5 Микрософт впервые реализовал автозаполнение текстовых полей форм, что позволило вам не вводить текст, который вы уже вводили ранее в поле с данным именем (в том числе на другом сайте). Тогда же появилось нестандартное расширение тега : атрибут autocomplete, устан... | https://habr.com/ru/post/80341/ | null | ru | null |

# Высокодоступный FTP-сервер с хранением данных в AWS S3

Добрый день, уважаемые читатели.

Снова хочу поделиться с вами приобретенным опытом.На одном из проектов была поставлена цель организовать FTP-сервер повышенной надёжности. Под повышенной надёжностью подразумевалось следующее:* Данные хранятся в AWS S3

* Сам F... | https://habr.com/ru/post/173699/ | null | ru | null |

# Итоги конкурса JS1k

Подведены [итоги](http://js1k.com/home) конкурса скриптов размером 1024 байт или меньше. Ниже список победителей.

1. [Legend Of The Bouncing Beholder](http://js1k.com/demo/635) (автор: [@marijnjh](http://twitter.com/marijnjh))

2. [Миниатюрные шахматы](http://js1k.com/demo/750) ([Oscar Tole... | https://habr.com/ru/post/105190/ | null | ru | null |

# Извлечение данных из БД 1С: проблемы с перечислениями

Решил написать статью о том, как вытягивать данные из 1С путем SQL запросов. Все нижесказанное касается 1С версии 8.2, оно также должно работать и в 1С версии 8.1. Особое внимание уделено проблеме с извлечением заголовков перечислений.

Культурный способ

======... | https://habr.com/ru/post/220863/ | null | ru | null |

# Трюки с SQL от DBA. Небанальные советы для разработчиков БД

Когда я начинал свою карьеру разработчика, моей первой работой стала DBA (администратор базы данных, АБД). В те годы, ещё до AWS RDS, Azure, Google Cloud и других облач... | https://habr.com/ru/post/513968/ | null | ru | null |

# Первые шаги с STM32 и компилятором mikroC для ARM архитектуры — Часть 2, начало…

Разобравшись с азами и поморгав светодиодом, можно переходить к реализации более сложных задач. Благо компилятор microC имеет множество полезных функций, значительно упрощающих жизнь программисту, в особенности начинающему.

В прошлой ч... | https://habr.com/ru/post/318352/ | null | ru | null |

# Контроль качества кода в перспективе развития проекта

Наверняка всем знакома ситуация, когда развитием проекта упирается в какую-то стену, внедрение новых функций становится все более затратным по времени и финансам. И, к сожалению, нередки такие моменты, когда чаша весов с ценой, начинает значительно перевешивать в... | https://habr.com/ru/post/313104/ | null | ru | null |

# Цифровые наличные на пальцах

*На изображении — логотип* [*цифровой Найры*](https://enaira.gov.ng/about)*, валюты* [*Нигерии*](https://ru.wikipedia.org/wiki/%D0%9D%D0%B8%D0%B3%D0%B5%D1%80%D0%B8%D1%8F)*. Это первая работающая CBDC в мире (после маленьких Багамских островов с их Send Dollar). Запущена в октябре 2021 го... | https://habr.com/ru/post/688384/ | null | ru | null |

# Вариант произвольного доступа к настройкам и записям автомобильного регистратора из любой точки интернета

Автомобильные видеорегистраторы уже достаточно давно стали одним из обязательных атрибутов для любого автомобилиста. Лично я без тени преувеличения могу заключить, что не могу чувствовать себя в безопасности за ... | https://habr.com/ru/post/416323/ | null | ru | null |

# Искусственный интеллект – на каждый ответ будет задан вопрос

Искусственный интеллект в речевых экспертных системах развивается в направлении чат-ботов. Бесспорно, это понятное всем направление развития. Проблем, при его формировании, безусловно, много, это видно из [презентаций разработчиков](https://habr.com/ru/com... | https://habr.com/ru/post/458164/ | null | ru | null |

# Хеш-функция Стрибог или в городе новый шериф

В 2012 году вся общественность, более или менее причастная к информационной безопасности, пристально следила за выборами нового стандарта хеширования данных SHA-... | https://habr.com/ru/post/188152/ | null | ru | null |

# Как нас било током на 1 апреля

На день дурака в этом году мы с коллегами решили сделать чуть больше, чем просто шутку. Мы придумали интерактивный формат с трансляцией из нашего офиса и дали возможность всем желающим пощекотать наших добровольцев небольшим электрическим разрядом буквально в прямом эфире.

Всем привет!

В данной статье описан мой опыт создания [sneakernet-сети](https://en.wikipedia.org/wiki/Sneakernet), мотивация, побудившая написать данное ПО, общее ... | https://habr.com/ru/post/682472/ | null | ru | null |

# Token, refresh token и создание асинхронной обертки для REST-запроса

В данном туториале мы кратко разберем, как реализовываются REST-запросы к API, требующие, чтобы пользователь был авторизован, и созда... | https://habr.com/ru/post/456188/ | null | ru | null |

# Сегментарный анализ на примере RFM-анализа средствами Power BI

Существует большое разнообразие методов сегментарного анализа в маркетинге. Во-первых, сегментация — это стратегия, используемая для концентрации ресурсов на целевом рынке/объекте и оптимизации их использования. Во-вторых, сегментация — это алгоритм анал... | https://habr.com/ru/post/665972/ | null | ru | null |

# О чём молчит developer.android.com про RecyclerView?

Вопрос о жизненном цикле (*life cycle*) активности (*activity*) или фрагмента (*fragment*) андроид-приложения чрезвычайно важен для практикующего андроидчика (андроид-разработчика). Почему? Потому что порядок выполнения обратных вызовов всех методов, связанных с с... | https://habr.com/ru/post/430402/ | null | ru | null |

# Библиотека «Room» для начинающего Android-разработчика

Здравствуй, дорогой читатель. Каждый Android-разработчик сталкивался (или столкнётся во время своей профессиональной карьеры) с задачей, в которой необходимо хранить большое количество изменяемых данных. В данной статье будет разобрана библиотека от Google - Roo... | https://habr.com/ru/post/713518/ | null | ru | null |

# Простой каркас Android приложения

Самым сложным этапом в любом деле, пожалуй, является поиск точки старта. При создании приложений для android эту задачу приходится делить на несколько и определять, напр... | https://habr.com/ru/post/182780/ | null | ru | null |

# 20 вопросов, которые задаются на интервью веб-разработчикам

*Недавно в **SEOmoz** состоялись собеседования с кандидатами на должность **веб-разработчика**. Готовясь к интервью, автор статьи составил **список техниче... | https://habr.com/ru/post/294492/ | null | ru | null |

# Нововведения CSS – Июль 2020 (Gap, Aspect ratio, Masonry, Subgrid)

*Приветствую. Представляю вашему вниманию перевод статьи [«CSS News July 2020»](https://www.smashingmagazine.com/2020/07/css-news-july-2020/), опубликованной 7 июля 2020 года автором Rachel Andrew*

```

Поэто... | https://habr.com/ru/post/575664/ | null | ru | null |

# Особенности AR в iOS и Android

Статья, скорее всего, не расскажет ничего нового тем, кто давно занимается разработкой приложений с фишкой Augmented Reality, но возможно будет полезна тем, кто интересуется этой темой ... | https://habr.com/ru/post/145398/ | null | ru | null |

# twitter2vk — из Твиттера во В Контакте

[twitter2vk](http://github.com/ai/twitter2vk) — скрипт для автоматической перепубликации статусов из Твиттера во В Контакте. Например, если у вас остались стар... | https://habr.com/ru/post/88386/ | null | ru | null |

# ARM Cortex M* — «сколько вешать в граммах»

Исходные предпосылки

--------------------

Критичный ко времени код на участке ]L1, L7[ регулярно выполняется за время T1.

Аппаратные прерывания T2, T3 и Т4 заме... | https://habr.com/ru/post/599727/ | null | ru | null |

# «Hello World!» на C массивом int main[]

Я хотел бы рассказать о том, как я писал реализацию «Hello, World!» на C. Для подогрева сразу покажу код. Кого интересует как до этого доходил я, добро пожаловать под кат.

```

#include

const void \*ptrprintf = printf;

#pragma section(".exre", execute, read)

\_\_declspec(al... | https://habr.com/ru/post/275861/ | null | ru | null |

# Создание огроооомных приложений на AngularJS

Документация по Ангуляру отлично подходит для начала работы и ковыряния в API. Однако, она не объясняет как организовать и управлять приложением, когда оно разрастется до десятков или сотен тысяч строк кода. Я собрал здесь некоторые из моих наблюдений и передового опыта п... | https://habr.com/ru/post/182556/ | null | ru | null |

# Система частиц на PHP в 3D

С детства есть у меня заветная программерская мечта — написать физический движок. Как и положено мечте, я к ней никогда близко не подходил. Но однажды выдалась пара ночей, когда я должен был дежурить в помещении, и у меня с собой был ноутбук.

В общем, взялся я моделировать движение и ст... | https://habr.com/ru/post/115791/ | null | ru | null |

# VHDL для начинающих. Brainfuck

Как известно, VHDL – высокоуровневый язык описания аппаратуры (если это вызывает сомнения, можно посмотреть [здесь](http://habrahabr.ru/blogs/controllers/112479/) и [здесь](http://habrahabr.ru/blogs/DIY/80056/)). Из всего разнообразия задач мне приглянулся именно **brainfuck** благода... | https://habr.com/ru/post/121797/ | null | ru | null |

# Торент на Dingoo A320, или зачем оно надо?

**В наличии:** роутер Dlink DSL2650u из [предыдущего топика](http://habrahabr.ru/blogs/linux/124744/), который имеет USB хост и прошит OpenWRT прошивкой, и приставка Dingoo A320, на котор... | https://habr.com/ru/post/124792/ | null | ru | null |

# Почему разработчики не любят Юнит Тесты

Может они просто не умеют их «готовить»?

Intro

-----

По долгу службы, я участвую в разработке приложений для микроконтроллеров. Но так сложилось, что различного рода тестированием (как своего так и чужого кода) я занимался больше, чем, собственно, разработкой. Далеко ни с ... | https://habr.com/ru/post/250053/ | null | ru | null |

# Flutter app architecture 101: Vanilla, Scoped Model, BLoC

(originally published on [Medium](https://link.medium.com/vxGf7jKtXT))

Flutter provides a modern react-style framework, rich widget collection and tooling, but there’s nothi... | https://habr.com/ru/post/438524/ | null | en | null |

# Как я сделал самый быстрый в мире файловый сервер

[](https://habr.com/ru/company/ruvds/blog/695808/)

Задача — среди множества файлов найти на диске конкретный и отдать его по HTTP с заголовками «content-encoding», «mime-type» и «co... | https://habr.com/ru/post/695808/ | null | ru | null |

# Производительность как восприятие: управление восприятием

Время можно анализировать с двух разных точек зрения: объективной и психологической (субъективной). Когда мы говорим о времени, которое измеряется при помощи часов, мы гово... | https://habr.com/ru/post/343922/ | null | ru | null |

# Ставим Gentoo x64 + xen на диски размером 3Tb в Hetzner

Для чего это нужно: Допустим вам нужно организовать пару тройку независимых удаленных рабочих столов. Не арендовать же под каждый rdp, отдельный сервер, можно арендовать один и сделать их там хоть 16 штук.

Арендовав пару серверов класса EX4 на hetzner.de я в... | https://habr.com/ru/post/131196/ | null | ru | null |

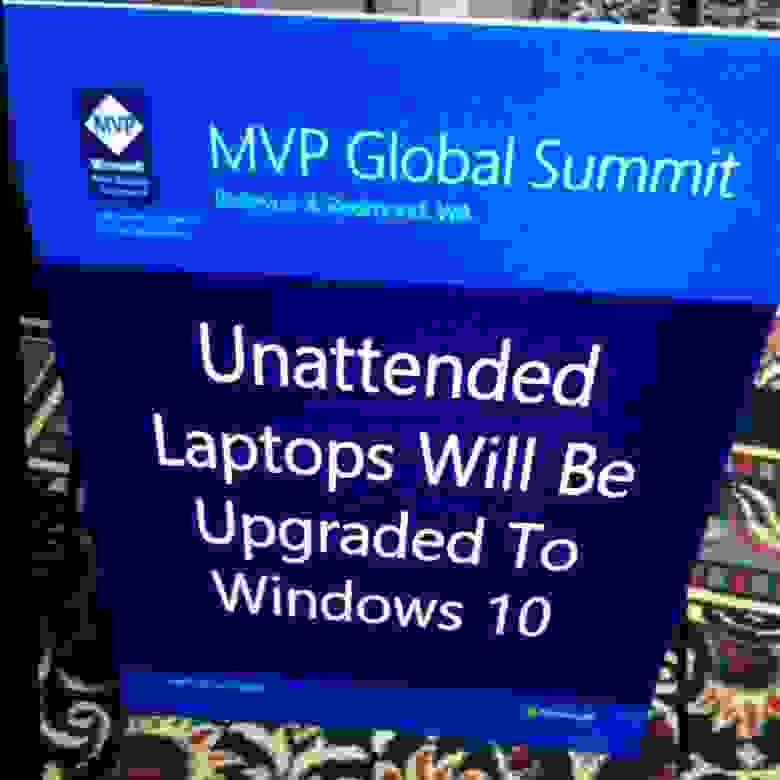

# Новый виток насаждения Windows 10: фоновый процесс следит за изменениями реестра

[](https://habrastorage.org/files/494/59d/216/49459d21659840d3892fd76b10c9e3e4.jpg)29 июля 2015 года компания Microsoft выпустила операционную ... | https://habr.com/ru/post/388999/ | null | ru | null |

# Архитектура кода

В этой статье я хочу поделиться своим личным опытом, связанным с правильной организацией кода (архитектурой). Правильная архитектура существенно упрощает долгосрочную поддержку.

Это очень философская тема, поэтому я не могу предложить ничего более, чем мой субъективный анализ и опыт.

Проблемы,... | https://habr.com/ru/post/353698/ | null | ru | null |

# Мониторинг торрентов и автоматическая скачка

Совсем недавно на Хабре было 2 статьи о том, как автоматизировать процесс скачивания новых серий с торрентов. Авторы обеих статей поделились своими приложениями. Вот уже год мы тоже разрабатываем подобное приложение и мне кажется, пришло время рассказать хабрасообществу о... | https://habr.com/ru/post/305574/ | null | ru | null |

# Дайджест новостей OpenStreetMap

Привет, Хабр! Представляю вашему вниманию перевод дайджеста "[weeklyOSM 400](http://www.weeklyosm.eu/archives/10142)".

### Картографирование

* Рассел Деффнер (Russel Deffner) [запустил](https://lists.openstreetmap.org/pipermail/tagging/2018-March/035442.html) повторный запрос на о... | https://habr.com/ru/post/352170/ | null | ru | null |

# cssHooks — расширяем множество CSS свойств

В этой статье я расскажу об объекте jQuery.cssHooks, который по умолчанию содержится в jQuery. Расширение этого объекта позволяет добавлять новые свойства или значения, прописываемые в ме... | https://habr.com/ru/post/123241/ | null | ru | null |

# Cohesion in Enterprise Applications

Введение

--------

Структура кода, структура проекта, дизайн проекта, архитектура проекта — эти понятия могут иметь различные значения, сложность или глубину для архитектора, разработчика, руководителя проекта или консультанта. Дальше должно идти долгое копание в терминологии, од... | https://habr.com/ru/post/241943/ | null | ru | null |

# Делаем визуальный web-редактор документов на основе LibreOffice, jodconverter и TinyMCE

С написания предыдущей [статьи](http://habrahabr.ru/post/183990/) про генерацию Exce... | https://habr.com/ru/post/224795/ | null | ru | null |

# XBRL: просто о сложном − Глава 6. Погружение в XBRL − Часть 4. Как облегчить жизнь

### 6.4. Как облегчить жизнь

До сих пор мы использовали только простые item-концепты. Каждый из nr\_employees-концептов мог быть интерпретирован независимо от остальных.

У такого подхода есть недостаток: если количество полов обычно... | https://habr.com/ru/post/336230/ | null | ru | null |

# Борьба с WordPress-червём GetMama

Привет!

Подлый вирус GetMama пожрал кучу сайтов на вордпрессе. В том числе несколько моих. И я вам расскажу, как это почистивать сущность в виде гномика.

Началось с того, что некоторые сайты начали открываться очень долго. Причём только те, что на вордпрессе.

Я долго не мог... | https://habr.com/ru/post/143375/ | null | ru | null |

# T-Rex-duino – клон игры про динозавра из браузера Chrome для Arduino

Имея такой девайс, пользователи Firefox тоже смогут поиграть в T-Rex’а при ошибке загрузки страницы.

Начну с того, что меня заинтересовали самодельные супер... | https://habr.com/ru/post/500540/ | null | ru | null |

# Зачем нужен static при объявлении анонимных функций?

Буквально на днях пришел вопрос от одного из подписчиков касательно [одного из постов моего telegram канала](https://t.me/beerphp/14). Его смутил вот такой кусок кода

```

php

usort($firstArray, static function($first, $second) {

return $first <= $second;

});... | https://habr.com/ru/post/561550/ | null | ru | null |

# Использование процедур и функций в Delphi

Рано или поздно любому программисту потребляется использовать процедуры и функции. Все мы помним еще с паскаля, что там ничего нет сложного, но некоторые вещи обычно в книжках не описываются, хотя для грамотного составления программы требуется знать.

#### Скобки

Добавлен... | https://habr.com/ru/post/122929/ | null | ru | null |

# Observable.Generate и перечисление списков

В библиотеке реактивных расширений (a.k.a. Rx – Reactive Extensions) существует вспомогательный метод **Observable****.****Generate**, который позволяет генерировать простые observable-последовательности.

```

IObservable xs = Observable.Generate(

initialState: 0, // нач... | https://habr.com/ru/post/132314/ | null | ru | null |

# Next.js: подробное руководство. Итерация первая

Привет, друзья!

Хочу поделиться с вами заметками о `Next.js` (надеюсь, кому-нибудь пригодится).

`Next.js` — это основанный на `React` фреймворк, предназначенный для разработки веб-... | https://habr.com/ru/post/588498/ | null | ru | null |

# Откуда растут ноги у hashCode

Опять на собеседованиях по Java спрашивают про `hashCode` и `equals`? А кто из собеседующих сам ответит на вопрос, как вычисляется `Object.hashCode()` и `System.identityHashCode()`? Насколько дорог вы... | https://habr.com/ru/post/165683/ | null | ru | null |

# Крадущийся тигр, затаившийся SQLAlchemy. Основы

Доброго дня.

Сегодня хочу рассказать про ORM SQLAlchemy. Поговорим о том, что это, про его возможности и гибкость, а также рассмотрим случаи, которые не всегда понятно описаны.

Дан... | https://habr.com/ru/post/470285/ | null | ru | null |

# Последние версии компиляторов D

Группа разработчиков LDC закрыла ушедший год [версией 1.19.0 компилятора D, использующего LLVM](https://github.com/ldc-developers/ldc/releases/tag/v1.19.0), а основная команда начала новый год [версией ... | https://habr.com/ru/post/483440/ | null | ru | null |

# Static code analysis of the PMDK library collection by Intel and errors that are not actual errors

We were asked to check a collection of open source PMDK libraries for developing and deb... | https://habr.com/ru/post/515730/ | null | en | null |

# Мини reverse engineering и модификация Windows Phone приложений

Здравствуйте!

Несколько дней назад мне попалась на глаза забавная [игра](http://www.windowsphone.com/en-US/apps/bb5f1317-735d-4e60-a100-9c3f1692ee7c), в которой необходимо на мотоцикле объезжать препятствия и за это получать очки, и мы с друзьями ~~н... | https://habr.com/ru/post/146538/ | null | ru | null |

# Проект arataga: реальный пример использования SObjectizer и RESTinio для работы с большим количеством HTTP-соединений

В последние 4.5 года я много рассказывал на Хабре про такие OpenSource проекты, как [SOb... | https://habr.com/ru/post/537616/ | null | ru | null |

# Проблема LotL-атак: старый и надежный метод нелегитимного использования легитимного ПО

В последние годы предприятия и корпорации находятся под атакой продвинутых злоумышленников, которые используют все более творческие подходы к компрометации систем безопасности. Одним из наиболее распространенных методов являются [... | https://habr.com/ru/post/696806/ | null | ru | null |

# Разработка кросс-браузерных расширений

В своей прошлой статье, я упомянул о [выпуске](http://habrahabr.ru/company/likeastore/blog/222515/) браузерного расширения для Google Chrome, который способен повысить эффективность поиска, за счет предоставления релевантной информации из статей понравившихся вам в социальных с... | https://habr.com/ru/post/227881/ | null | ru | null |

# Альтернатива электронной почте для 21 века

*Специализированный мини-компьютер [IMP](https://en.wikipedia.org/wiki/Interface_Message_Processor) соединял между собой участников сети ARPANET в 1969 году, прообраз современных маршру... | https://habr.com/ru/post/542712/ | null | ru | null |

# Lua API++

Здравствуйте, коллеги.

Хочу познакомить вас с моим небольшим проектом, который, надеюсь, сможет пригодиться и вам.

С [Lua](http://www.lua.org/) я познакомился несколько лет назад, когда подыскивал внедряемый скриптовой язык, отличающийся скромным размером и высокой производительностью. Lua не только ... | https://habr.com/ru/post/201860/ | null | ru | null |

# Что Java 8 нам готовит

Пройдемся по новинкам и покодируем по-новому.

##### Итак, начнем по списку.

Допустим, имеется список.

```

List numbers = Arrays.asList(1, 2, 3, 4, 5, 6);

```

Теперь вспомним, как мы итерировали в старые времена:

```

for (int i = 0; i < numbers.size(); i++){

System.out.println(num... | https://habr.com/ru/post/203026/ | null | ru | null |

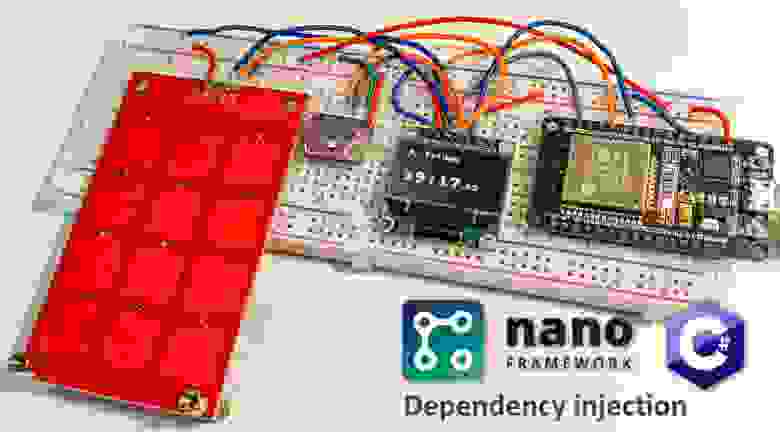

# Паттерн внедрение зависимостей в .NET nanoFramework для микроконтроллеров

[](https://habrastorage.org/webt/li/ct/6-/lict6-h8tm6ozcwmcyqocwn43uy.jpeg)

Сегодня сломаем привычный мир инженеров и разр... | https://habr.com/ru/post/688052/ | null | ru | null |

# Критическая уязвимость SambaCry: как защититься

[](https://habrahabr.ru/company/pt/blog/329558/)

В популярном пакете для создания сетевых дисков на различных ОС Samba обнаружена критическая уязвимость, позволяющая удаленно п... | https://habr.com/ru/post/329558/ | null | ru | null |

# Ещё чуть ближе к совершенству

Всем привет!

Ещё не остыла печь после выпекания вчерашней сборки, а мы уже подаём на стол новое, ещё более вкусное блюдо — тестовую сборку Vivaldi 2.0.1296.4. Собст... | https://habr.com/ru/post/422603/ | null | ru | null |

# Code review по-человечески (часть 2)

Это вторая часть статьи о том, как правильно общаться и избежать ошибок в процессе код-ревью. Здесь мы поговорим о том, как довести ревью до конца и избежать неприятных конфликтов.

Основы из... | https://habr.com/ru/post/342244/ | null | ru | null |

# CTFzone write-ups – Shall I reverse it?

Друзья, бурные выходные прошли, и мы готовы представить вам новую партию райтапов – на этот раз мы подробно разберем задания ветки **Reverse**. Надеемся, вы уже разобрались с дв... | https://habr.com/ru/post/316420/ | null | ru | null |

# Работа с непредвиденными данными в JavaScript

Одна из основных проблем в работе с динамически типизированными языками заключается в том, что невозможно всегда гарантировать правильность потока данных, так как невозможно принудител... | https://habr.com/ru/post/518020/ | null | ru | null |

# Изучаем Event Tracing for Windows: теория и практика

Добрый день. Недавно мне необходимо было разобраться со службой трассировки Windows. Эта служба появилась еще в Windows 2000, однако статей по этой службе в интернете оказалось крайне мало.Так появилась идея написания этой статьи. Итак, начнем!

Сегодня я попыта... | https://habr.com/ru/post/502362/ | null | ru | null |

# PSR-7 в примерах

Стандарт [PSR-7](https://github.com/php-fig/fig-standards/blob/master/proposed/http-message.md) успешно завершён. На этой неделе были добавлены последние штрихи. И теперь версия 0.6.0 пакета [http-message package](https://github.com/php-fig/http-message) готова к использованию. Попробуйте следовать ... | https://habr.com/ru/post/250343/ | null | ru | null |

# Хабр поздравляет всех с наступившим 2023 годом

Хабр поздравляет айтишников, программистов, разработчиков, системных администраторов, специалистов техподдержки, руководителей проектов, проектировщиков, инженеров, менеджеров, диза... | https://habr.com/ru/post/708734/ | null | ru | null |

# Многопользовательский чат на BAT

Был период, когда в универе задали сделать несколько чатов. В зависимости от вариантов, были заданы различные способы взаимодействия программ от сокетов до майлслотов (mailslot). Когда задания были прикончены, остались силы взяться за скрипты BAT. Вот что получилось…

Уход от привычной x86 архитектуры — это всегда интересно, и в задании [NeoQUEST-2015](http://neoquest.ru/timeline.php?year=2015) «Масон... | https://habr.com/ru/post/255079/ | null | ru | null |

# Настройка VPLS Multihoming на маршрутизаторах Juniper

Технология VPLS уже давно зарекомендовала себя как способ объединения географически разнесенных объектов в единую L2-сеть. Такое решение хорошо масштабируется по сравнению с классической L2-сетью и позволяет избавиться от проблем L2-петель в ядре сети. Однако, ча... | https://habr.com/ru/post/259645/ | null | ru | null |

# Предпочитайте Rust вместо C/C++ для нового кода

2019-02-07

* Когда использовать Rust

* Когда не использовать Rust

* Когда использовать C/C++

* Ложные причины использования C/C++

* Приложение: моя история с C/C++

* Приложение: хор

*Это документ с изложением моей позиции, который я первоначально распространил внутри... | https://habr.com/ru/post/520098/ | null | ru | null |

# Планковские единицы: существует ли фундаментальный предел пространства и времени?

[](https://habr.com/ru/company/ruvds/blog/648443/)

По поводу планковского масштаба в научно-популярных материалах творится большая путаница. Здесь ... | https://habr.com/ru/post/648443/ | null | ru | null |

# Страх и ненависть в RouterOS: что такое сетевое соединение в ядре Linux (часть 2 — практика)

[](https://habr.com/ru/company/ruvds/blog/590489/)

Ранее [в первой (теоретической) части статьи](https://habr.com/ru/company/ruvds/blog/5... | https://habr.com/ru/post/590489/ | null | ru | null |

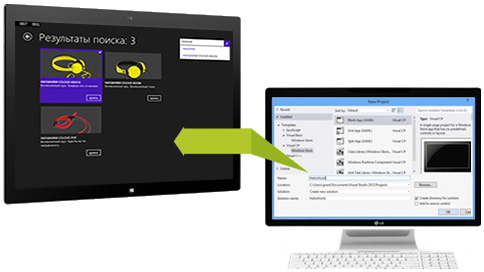

# Разработка Windows 8.1 приложений на XAML/С#. Часть 4. Поиск

Одной из важных и необходимых функциональных возможностей для приложения, работающего с контентом, является поиск информации.

Сегодня... | https://habr.com/ru/post/206702/ | null | ru | null |

Subsets and Splits

No community queries yet

The top public SQL queries from the community will appear here once available.