text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

values | source stringclasses 4

values |

|---|---|---|---|---|

# Точка доступа на основе wi-fi карточки D-link DWA-520 (ath5k)

Хотите получить wi-fi точку доступа из барахла которое завалялось в гараже? Тогда вам под кат т.к., сегодня мы будем собирать программную точку доступа (AP) на основе wi-fi карточки D-link DWA-520 на чипсете Atheros AR5001X+ (ath5k) и Ubuntu Server 9.04. ... | https://habr.com/ru/post/67717/ | null | ru | null |

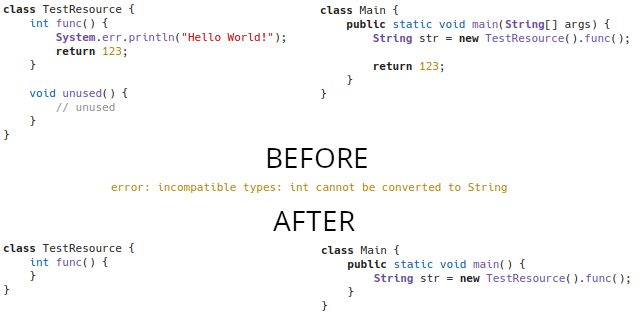

# А суть-то в чём, или Минимизация исходников — проще, чем кажется

В эти чудесные январские дни всех нас, конечно, волнует вопрос минимизации исходного кода с сохранением инварианта. В смысле, не волнует?!? Зря… Вот упал у вас компи... | https://habr.com/ru/post/482634/ | null | ru | null |

# Заметки гика. zsh shell

##### Дубль первый.

В какой то момент возникла острая необходимость заиметь англо-русский словарь в консоли,

в ходе 2 минутного поиска по пакетам счастья не было обнаружено.

Ну что же, придется делать свой словарь, вспомнив что в chromium стоит плагин для словаря было принято решение р... | https://habr.com/ru/post/117003/ | null | ru | null |

# Персонализация IMGUI и редактора Unity. Часть первая

С момента выхода новой системы Unity UI прошло больше года, поэтому Ричард Файн решил написать о ее предшественнице – IMGUI.

На первый взгляд, это совсем нелогично. Зачем писать об устаревшей системе UI, если уже давно вышла новая? Что ж, новая система действит... | https://habr.com/ru/post/278041/ | null | ru | null |

# Как важно писать код, который могут читать люди

Вам приходилось завершать проект одним махом, когда не было нужды снова смотреть в код? Вряд ли. Работая над старыми проектами, вам, вероятно, не хочется тратить время на выяснение, как работает этот код. Если код читабелен, то продукт легко сопровождать, а вы, ваши ко... | https://habr.com/ru/post/307380/ | null | ru | null |

# Cj — новый язык программирования

Давно уже в моей голове поселилась эта идея. Но я всё откладывал на потом — были более важные или интересные дела. А теперь я жалею, надо было всё бросить и сосредоточиться только на ней!

Все замерли в ожидании, что за идея? Идея — написать свой язык программирования!

Вздох раз... | https://habr.com/ru/post/340204/ | null | ru | null |

# BaasCMS – бэкенд не нужен

**BaasCMS** — это JavaScript CMS, использующая в качестве бэкенда популярных провайдеров [BaaS](http://en.wikipedia.org/wiki/Backend_as_a_service). На данный момент поддерживается только [Parse.... | https://habr.com/ru/post/234409/ | null | ru | null |

# [Перевод] Проблема конструкторов JavaScript и три способа её решения

#### Введение

Как известно, создать новый объект в JavaScript можно используя функцию-конструктор следующего вида:

```

function Fubar (foo, bar) {

this._foo = foo;

this._bar = bar;

}

var snafu = new Fubar("Situation Normal", "All Fsked Up"... | https://habr.com/ru/post/237959/ | null | ru | null |

# Traceroute: про умение читать вывод

* Почему в трейсроуте после узла X идут звездочки?

* Сервис не работает, а трейсроут обрывается на узле X — значит проблема в узле X?

* Почему одинаковые трейсроуты с Windows и Unix показывают разные результаты?

* Почему трейсроут показывает большие задержки на определенном узле?

... | https://habr.com/ru/post/129627/ | null | ru | null |

# Варим MVVM для Windows Store-приложений

Когда мы начали работать над приложениями под Windows 8, мы искали библиотеку поддержки шаблона Model-View-ViewModel (MVVM) для этой платформы. Некоторое время провели в интернете в поиске таковой, но в итоге приняли факт, что таких библиотек в природе пока не существует (возм... | https://habr.com/ru/post/172839/ | null | ru | null |

# Физическая симуляция сотен тысяч частиц на Unity + DOTS

В какой-то момент во время блужданий по просторам всемирной паутины на одном из сайтов я обнаружил интерактивный JS-элемент — картинку, составленную из частиц, разлетающихся при приближении курсора мыши. Возникло желание запрограммировать симуляцию подобного по... | https://habr.com/ru/post/498630/ | null | ru | null |

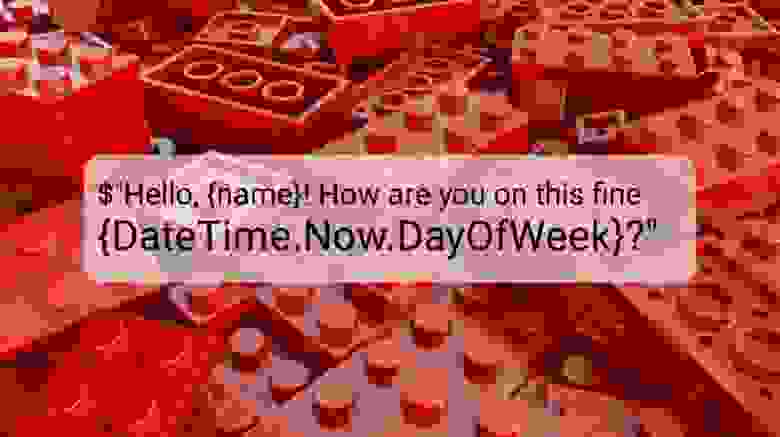

# Компилятор C# 10, .NET 6 и интерполяция строк

К старту [курса по разработке на C#](https://skillfactory.ru/c-sharp-razrabotchik?utm_source=habr&utm_medium=habr&utm_campaign=article&utm_content=coding_cdev_... | https://habr.com/ru/post/599341/ | null | ru | null |

# Как обойти каптчу в Яндекс.Диск

Итак, все мы знаем, что на яндексе можно хранить файлы до 5 гигабайт, но при загрузке он требует ввести каптчу или установить Яндекс.Бар. Так как Яндекс.Бар я не использую, то решил проверить, а собственно каким таким гениальным способом проверяет Яндекс этот самый пресловутый плагин?... | https://habr.com/ru/post/66949/ | null | ru | null |

# Что нового в HTML 5.0? Часть 3: Структура документа. Заключение.

В отличие от предыдущих версий HTML и XHTML, которые определяются браузерами их синтаксисом, HTML 5 определяется в зависимости от Document Object Model (DOM) — структура («дерево») документа считываемое браузером для отображения страницы. Например, рас... | https://habr.com/ru/post/31404/ | null | ru | null |

# Домашний интернет: маршрутизация двух (и боле) провайдеров на основе Bird Routing Daemon

Наверное, многие пользователи домашнего интернета сталкивались с тем, как распараллелить два и более интернет-канала в домашней сети.

Эта проблему можно решить и хардварно (используя любое дешевое либо дорогое оборудование) ... | https://habr.com/ru/post/160047/ | null | ru | null |

# Тесты или типы? — Rust version

Пару дней назад [0xd34df00d](https://habr.com/ru/users/0xd34df00d/) опубликовал здесь [перевод](https://habr.com/ru/post/467677/) статьи, описывающей, что можно узнать о функции в разных языках, если рассматривать её как "чёрный ящик", не используя информацию о её реализации (но, разум... | https://habr.com/ru/post/468145/ | null | ru | null |

# Переход на Boost-1.65.1 и баги, которые всплыли

В прошлом году(уже почти целый год прошел) мы все–таки перешли на новую версию Boost-1.65.1, и под капотом вы найдете тройку багов boost-а, с которыми мы столкнулись. Еще важно упомянуть, что до этого у нас в ПО использовался boost -1.62.1, поскольку какие-то баги появ... | https://habr.com/ru/post/436828/ | null | ru | null |

# JSON, который можно комментировать

[](http://spmbt.github.io/jsonComm/)Не все JSON нельзя комментировать (например, Хром[иум] вполне переносит комментарии в manifest.json), но в стандарте [не предусмотрены коммента... | https://habr.com/ru/post/247473/ | null | ru | null |

# Рекурсивный фильтр скользящего среднего

Да, дорогой читатель, такое тоже бывает, и может быть вкусно и полезно!

Как ты уже наверняка знаешь, дорогой читатель, существует два способа построения цифровых фильтров. Это р... | https://habr.com/ru/post/325590/ | null | ru | null |

# Первый байндинг для Exonum: почему мы выбрали Java

Ядро нашего фреймворка для разработки приватных блокчейнов Exonum написано на Rust, поскольку этот ЯП ориентирован на безопасность работы с памятью. Однако наряду со многими преимуществами, Rust имеет ряд особенностей, усложняющих «взаимодействие» с ним: его синтакс... | https://habr.com/ru/post/423441/ | null | ru | null |

# Как Shopify организовала совместную работу более 1000 разработчиков

Сложно организовать совместную работу большой команды, тем более над общей кодовой базой, такой как Shopify. Наш монолит меняется по 4... | https://habr.com/ru/post/478072/ | null | ru | null |

# Одна из возможных проблем при работе с RS232

В этом топике я хотел бы поделиться своим опытом «борьбы» с одним китайским девайсом. На работе поступил приказ и было принято поменять старые кардридеры на новые. Суть в том, что старые ридеры были активные, т.е. в бесконечном цикле пытались считать карту, а вот новые уж... | https://habr.com/ru/post/322422/ | null | ru | null |

# Будни DevOps: cобираем gcc 9.3.1 под CentOS 8

В «Северстали» внедрены большие корпоративные системы, такие как SAP или QMET, но есть и много разных задач, которые закрывает собственная разработка, и задачи у этой разработки редко бывают простыми. А значит, и требования к инструментам разработки бывают достаточно спе... | https://habr.com/ru/post/553612/ | null | ru | null |

# Как фронтенд-разработчику настроить базу данных

Недавно меня спросили, как **фронтенд-разработчику** проще всего сохранить пользовательские данные? Под катом — моя краткая инструкция для тех, кто с базами данных «на вы».

####... | https://habr.com/ru/post/343334/ | null | ru | null |

# Решение проблемы обеспечения доступности модального окна для людей с ограниченными возможностями

**Всем привет!**

В этой статье я бы хотел рассказать как реализовать **доступное** модальное окно, без использования атрибута [«aria-modal»](https://www.w3.org/TR/wai-aria/#aria-modal).

### Немного теории!

«aria... | https://habr.com/ru/post/526016/ | null | ru | null |

# Разработка мобильных приложений в Embarcadero FireMonkey (FMX 6)

Никому не нравится писать один и тот же код несколько раз, но именно это и приходится делать, если мобильное приложение должно быть реализовано для нескольких платформ сразу. Досадно, что программистам компании, в каждом случае, требуются применять раз... | https://habr.com/ru/post/222307/ | null | ru | null |

# Паттерн MFS для табличных представлений в iOS приложениях

Все преимущества `MFS` в полной мере раскрываются при работе с ячейками таблицы.

Цель `MFS`: рационально распределять обязанности между категориями ячейки, чтобы обеспечить максимальную контролируемость всех процессов и плавность в **60 FPS** при прокрутке т... | https://habr.com/ru/post/539590/ | null | ru | null |

# Комбинированная балансировка нагрузки интернет-каналов

#### Предистория

Рано или поздно системный администратор сталкивается с необходимостью распределить трафик по нескольким каналам, при этом естественно желание чтобы каждый канал использовался по максимуму. Столкнувшись с подобной необходимостью, и решив не изоб... | https://habr.com/ru/post/157401/ | null | ru | null |

# Как в Java выстрелить себе в ногу из лямбды и не промахнуться

Иногда можно услышать такие разговоры: никаких принципиальных изменений в Java 8 не произошло и лямбды это старые добрые анонимные классы щедро посыпанные синтаксическим сахаром. Как бы не так! Предлагаю сегодня поговорить, в чём отличие лямбд от анонимны... | https://habr.com/ru/post/312894/ | null | ru | null |

# Что каждый программист на C должен знать об Undefined Behavior. Часть 3/3

[Часть 1](https://habrahabr.ru/post/341048/)

[Часть 2](https://habrahabr.ru/post/341144/)

**Часть 3**

В первой части цикла мы рассмотрели неопределённое поведение в С и показали некоторые случаи, которые позволяют сделать С более быст... | https://habr.com/ru/post/341154/ | null | ru | null |

# Централизация логирования микросервисов с Graylog

**О чем статья:** трассировка и анализ ошибок в микросервисной архитектуре без средств централизации логирования обычно причиняет неудобства, поскольку для понимания "что и на каком микросервисе умерло" приходится обходить микросервисы по очереди, сверять и сопоставл... | https://habr.com/ru/post/703882/ | null | ru | null |

# Код, который невозможно поддерживать (часть 2)

*Продолжение [этого топика](http://habrahabr.ru/blogs/arbeit/99016/) — вторая и третья главы эссе «Unmaintainable Code». Несколько перекликается с первой, но описанные методы уже не так очевидны (а некоторые отличаются поистине дьявольской изобретательностью и не меньше... | https://habr.com/ru/post/99146/ | null | ru | null |

# Пилим веб-демку — Wavescroll

В этой статье я постараюсь доходчиво рассказать о процессе создания [демки Wavescroll](http://codepen.io/suez/full/wMOVXz).

#### О коде в статье

Цель этой статьи, попытаться научить людей реализовывать различные нетривиальные эффекты, не по... | https://habr.com/ru/post/278181/ | null | ru | null |

# Responsive design + Icon fonts = Adaptive icons

Привет, Хабр!

Сегодня поговорим об отзывчивых значках и парочке лайфхаков со шрифтовыми иконками.

##### **Предыстория. О трендах**

В последнее время все сильнее наби... | https://habr.com/ru/post/257505/ | null | ru | null |

# Разработка web-приложений на языке Common Lisp (часть вторая)

Данный обзор является небольшим путеводителем для тех, решился (или решается) доверить этому чудесному языку будущее своего стартапа. Несмотря на то, что основной акцент будет ставиться на web-разработке, я постараюсь осветить также и более общие темы, та... | https://habr.com/ru/post/105215/ | null | ru | null |

# Азбука NoSQL-инъекций

Бывают SQL-инъекции! А возможны ли NoSQL-инъекции? Да! Redis, MongoDB, memcached — все эти программные продукты относятся к классу нереляционных СУБД, противоположному популярным MySQL, Oracle Database и MSSQL. Так как интерес к перечисленным базам данных в последнее время значительно возрос, х... | https://habr.com/ru/post/143909/ | null | ru | null |

# Удаленная поддержка компьютера на Linux OS

#### Настройка IPv6-туннеля за симметричным NAT и удаленного управления через VNC

Не так давно я искал решение для удаленного администрирования системой на Linux. Основная проблема в том, что подключен к интернету через провайдеров, использующих симметричный NAT. То есть и... | https://habr.com/ru/post/127405/ | null | ru | null |

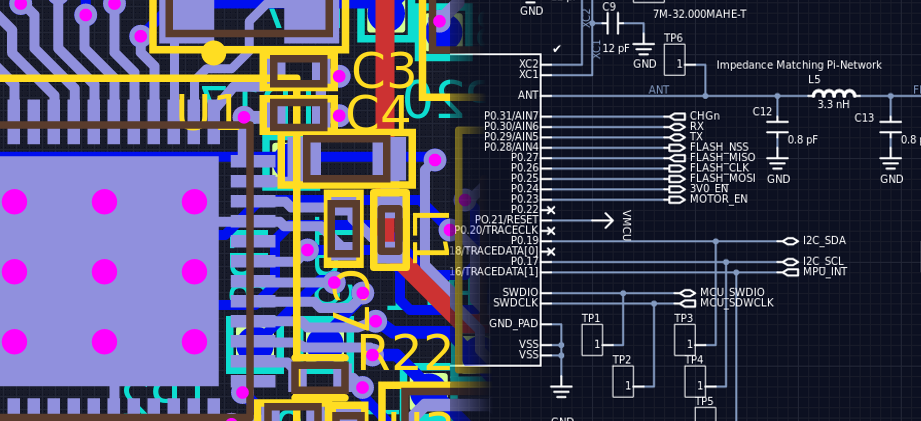

# Очередные умные часы своими руками

[](https://geektimes.ru/post/290357/)

Вдохновившись некоторое время назад статьей [«Умные часы своими руками за 1500р.»](https://geektimes.ru/post/258490/), я тоже решил попробовать сделать п... | https://habr.com/ru/post/404737/ | null | ru | null |

# Точные и быстрые вычисления для чисел с плавающей точкой на примере функции синуса. Часть 3: fixed-point

Продолжаем цикл лекций ([часть 1](https://habr.com/ru/post/526000/) и [часть 2](https://habr.com/ru/post/526518/)). В части 2 мы посмотрели, что внутри у библиотеки libm и в данной работе попробуем немного переде... | https://habr.com/ru/post/527226/ | null | ru | null |

# Лучшее из мира Angular за неделю — Дайджест №1 (18 января - 25 января)

Свежая подборка со ссылками на новости и материалы.

Приятного чтения!

Релизы

======

### Angular

[Angular 7.2.2](https://github.com/angular/angular/blo... | https://habr.com/ru/post/437536/ | null | ru | null |

# HTML5 и события сервера (обновлено)

Помимо уже [упомянутого мною двунаправленного коммуникационного канала известного как WebSocket](http://dsheiko.com/weblog/persistent-full-duplex-client-server-connection-via-web-socket/), HTML5 включаетв себя также сервер-push [технологию Server-Sent Events](http://dev.w3.org/htm... | https://habr.com/ru/post/96141/ | null | ru | null |

# Быстрое вычисление факториала — PrimeSwing

Наткнувшись недавно на [эту статью](https://habrahabr.ru/post/327544/), я понял, что редко упоминаются способы вычисления факториала, отличные от банального перемножения последовательных чисел. Нужно эту ситуацию исправить.

Предлагаю рассмотреть «асимптотически наиболее ... | https://habr.com/ru/post/323770/ | null | ru | null |

# Как я писал свою криптовалюту

3 года назад у меня появилась мысль создать свою криптовалюту. От биткоина решил взять идею с нодами и блокчеином.

Я решил сделать привязку каждой ноды к человеку. Кажд... | https://habr.com/ru/post/221827/ | null | ru | null |

# Автоматическое добавление, удаление постов и комментариев к ним на Facebook

Доброго времени суток всем.

Хочу поделиться опытом автоматического добавления и последующего удалением новостей, а также комментариев к ним на страницах пользователей, групп, событий и фан. страниц Facebook.com.

Для реализации нам необ... | https://habr.com/ru/post/129597/ | null | ru | null |

# web3 не будет: расходимся по домам

Никогда не было и вот опять

---------------------------

Я тут набрела на январскую [статью](https://moxie.org/2022/01/07/web3-first-impressions.html) [основателя](https://twitter.com/moxie) Signal app (мессенджер, конфиденциально, безопасно, open-source).

Если коротко, смысл стат... | https://habr.com/ru/post/673836/ | null | ru | null |

# Как писать и переиспользовать код на «чистом» Kotlin. Заметки Android-разработчика

*Как собрать в прямом эфире 17 000 зрителей? Значит, рецепт такой. Берем 15 актуальных IT-направлений, зовем зарубежных спикеров, дарим подарки за... | https://habr.com/ru/post/541722/ | null | ru | null |

# 9 лучших практик по обеспечению безопасности в Kubernetes

***Прим. перев.**: Это уже [не первая статья](https://habr.com/ru/company/flant/blog/417905/) с общими рекомендациями по безопасности в Kubernetes, что мы переводим в своём блоге. Однако её актуальность — по меньшей мере, как напоминание о простых и важных ве... | https://habr.com/ru/post/436300/ | null | ru | null |

# Исследуем .NET 6. Часть 2. WebApplicationBuilder

*В этой серии статей я собираюсь взглянуть на некоторые из новых функций, которые появились в .NET 6. Про .NET 6 уже написано много контента, в том числе множество постов непосредственно от команд .NET и ASP.NET. Я же собираюсь рассмотреть код некоторых из этих новых ... | https://habr.com/ru/post/594971/ | null | ru | null |

# Резервное копирование большого количества разнородных web-проектов

Казалось бы, тема избитая – про резервное копирование сказано и написано многое, поэтому нечего изобретать велосипед, просто бери и делай. Тем не менее, каждый раз, когда перед системным администратором web-проекта встает задача настроить бэкапы, для... | https://habr.com/ru/post/424717/ | null | ru | null |

# Прекратите использовать Else в ваших программах

Когда я только начинал программировать, хотел бы я, чтобы тогда нашёлся кто-то, кто мог бы рассказать об основных подводных камнях, с которыми я столкнусь при создании моего первого сайта.

Тогда одной из проблем было чрезмерное использование **else** при написании усл... | https://habr.com/ru/post/478158/ | null | ru | null |

# Как Mozilla упустила (не)очевидную уязвимость

Этот пост в блоге необычный. Обычно я пишу посты о скрытых видах атак или интересном и сложном классе уязвимостей. На этот раз речь пойдёт о совершенно иной уя... | https://habr.com/ru/post/598621/ | null | ru | null |

# WebRTC через Kurento: опыт тестирования и внедрения

В этой статье я поделюсь опытом работы с технологией WebRTC и медиасервером Kurento на этапе тестирования и внедрения. Расскажу с какими проблемами я столкнулся и как их решил. Я... | https://habr.com/ru/post/478536/ | null | ru | null |

# Котлин против Свифта: Android и iOS движутся к созданию универсального языка?

*Друзья, всем привет. На связи Дмитрий Кожевин — преподаватель базового курса [«Android-разработчик»](https://otus.pw/TbTg/) в OTUS. Специально для чита... | https://habr.com/ru/post/474224/ | null | ru | null |

# PG12: Дюжина патчей от Postgres Professional

*Приятно видеть знакомые фамилии в списке Acknowledgments официального релиза PostgreSQL 12. Мы решили свести вместе попавшие в релиз новшества и некоторые багфиксы, над которыми трудились наши разработчики.*

### 1. Поддержка JSONPath

(В [Release Notes](https://www.po... | https://habr.com/ru/post/472072/ | null | ru | null |

# How I discovered an easter egg in Android's security and didn't land a job at Google

Google loves easter eggs. It loves them so much, in fact, that you could find them in virtually every product of theirs. The tradition of Android ... | https://habr.com/ru/post/446790/ | null | en | null |

# Синхронный системный интерфейс взаимодействия с периферийными блоками в объёме кристалла СБИС или ПЛИС. STI 1.0

В статье предложена организация взаимодействия функциональных блоков в объёме кристалла СБИС, а именно: процессорных ядер, контроллеров DMA и мостов системных шин с периферийными блоками, такими как: контр... | https://habr.com/ru/post/354818/ | null | ru | null |

# История игры Триплекс, или сколько нужно квадратиков чтобы сломать голову

Чтобы освоить азы Web программирования, я решил написать HTML5 игру — головоломку под названием Triplex ([www.quadpuzzle.ru](http://... | https://habr.com/ru/post/141085/ | null | ru | null |

# «Запах» кода: автоматические свойства

Это третий пост из серии о [Poka-yoke проектировании](http://habrahabr.ru/post/205086/) – также известном, как инкапсуляция.

[Автоматические свойства](http://msdn.microsoft.com/en-us/library/bb384054.aspx) – одна из наиболее излишних возможностей в C#. Я знаю, что многие люди... | https://habr.com/ru/post/205096/ | null | ru | null |

# Покорим Ruby вместе! Капля седьмая

В этой капле мы еще раз пробежимся по всем рассмотренным нами темам и углубимся в них в поисках упущенного и интересного.

**Внимание!** Это последняя капля, опубликованная в блоге Ruby! Все прошлые ([1](http://habrahabr.ru/blogs/starting_programming/48559/), [2](http://habrahabr... | https://habr.com/ru/post/49013/ | null | ru | null |

# Добавление своего функционала в UMI.CMS при помощи обработчиков событий

В системе управления сайтами UMI.CMS изначально заложено разделение на основной движок сайта, который не трогается вэб-разработчиком (и который перезаписывается при обновлении системы), и дополнительный (кастомный) функционал, который уже разраб... | https://habr.com/ru/post/166647/ | null | ru | null |

# Получаем тип и размеры изображения без скачивания его целиком, используя Python

Возникла задача профильтровать базу данных ссылок на изображения и удалить большие. В результате было найдено решение на Python, которым я поделюсь под хабракатом:

, но нет под рукой [статистических таблиц](https://www.medcalc.org/manual/statistical_tables.php). Например, нужны таблицы критических точек [распределения Стьюдента](https://ru.wikipedia.org/wiki/... | https://habr.com/ru/post/515350/ | null | ru | null |

# Супер-выразительный код с привлечением уровней абстракций

Предлагаю вашему вниманию перевод статьи [Super expressive code by Raising Levels of Abstraction](https://www.fluentcpp.com/2017/01/03/super-expressive-code-by-raising-levels-of-abstraction/)

Этим постом я хочу предложить технику трансформации неясного кода... | https://habr.com/ru/post/341006/ | null | ru | null |

# Определение доступности GPS в Android

Приветствую, хабрасообщество!

Эта статья, надеюсь, станет хорошим подспорьем начинающим в области программирования под Android. А может даже и матерые профи что-нибудь почерпнут.

Итак, понадобилось мне как-то определять, доступен ли в настоящее время GPS-фикс. Казалось бы,... | https://habr.com/ru/post/123397/ | null | ru | null |

# Как мы используем юнит-тестирование в СУБД Oracle

В некоторых технологиях и языках программирования юнит-тестирование — уже давно неотъемлемая часть написания кода. Оно интегрировано в разработку и доступно... | https://habr.com/ru/post/594113/ | null | ru | null |

# Слепая простота

В этой статье я расскажу о blind XSS — это довольно простая, но зачастую очень эффективная атака на веб-приложения. Эксплуатация таких векторов атак приводит к захвату админ-панелей различных сервисов, в том числе софтверны... | https://habr.com/ru/post/450780/ | null | ru | null |

# Вышел релиз GitLab 13.11 с агентом для Kubernetes и настройкой конвейера для проверки соответствия требованиям

В прошедший День Земли мы думали о росте. Наши клиенты масшт... | https://habr.com/ru/post/557168/ | null | ru | null |

# Связываем Active Directory, Asterisk и OpenFire

#### Дружим между собой Active Directory, сервер IP телефонии Asterisk и Jabber-сервер OpenFire.

Не буду касаться установки всего по отдельности – все неплохо описано и работает в индивидуальном порядке весьма замечательно. Напишу, как я объединял все это вместе, на ч... | https://habr.com/ru/post/137124/ | null | ru | null |

# Как отличить день от ночи, если ты Android

#### Привет, Хабр.

Сегодня мы поговорим о том, как здорово читать в темноте. В детстве нам всем мамы запрещали это делать, но теперь есть планшеты! В отличие от бумажных книг, на них не надо светить фонариком, они сами за вас все сделают. И именно мы их этому обучаем. Одна... | https://habr.com/ru/post/255961/ | null | ru | null |

# Пример использования standalone actions в Yii2

При разработке сайта неотъемлемую часть занимает получение коллекций данных. Выборка по определённым условиям, пагинация. Каждый раз писать реализацию в контроллерах весьма занудно. Когда как можно один раз сделать расширяемую реализацию часто используемого функционала.... | https://habr.com/ru/post/208556/ | null | ru | null |

# CLI на питоне. Пускаем пользователя на сервер

Я системный администратор по роду деятельности. Поддерживаю удаленно сервера разных клиентов. Нередко приходится слышать от клиента просьбу дать шелл-доступ на сервер. С одной... | https://habr.com/ru/post/175321/ | null | ru | null |

# Android Camera2 API от чайника, часть 2, пишем видео

Продолжаем разбираться с CAMERA2 API Android.

В предыдущей статье мы осваивали работу камеры, чтобы делать фоточки, используя новое API. Теперь же займёмся съемкой видео.... | https://habr.com/ru/post/471774/ | null | ru | null |

# Seccomp в Kubernetes: 7 вещей, о которых надо знать с самого начала

***Прим. перев.**: Представляем вниманию перевод статьи старшего инженера по безопасности приложений британской компании ASOS.com. С ней он начинает цикл публикаций, посвящённых повышению безопасности в Kubernetes благодаря использованию seccomp. Ес... | https://habr.com/ru/post/481114/ | null | ru | null |

# В очередной раз о НОД, алгоритме Евклида и немного об истории алгоритмов вообще. Конечно, с примерами на Swift

[Алгоритмы](https://en.wikipedia.org/wiki/Algorithm) – одна из центральных тем в [программировании](https://en.wikipedia.org/wiki/Computer_programming), они повсюду (особенно на собеседованиях, ха-ха).

!... | https://habr.com/ru/post/464949/ | null | ru | null |

# Мониторинг микросервисов Flask с помощью Prometheus

Пара строк кода и ваше приложение генерирует метрики, вау!

----------------------------------------------------------

Для того что бы понять как работает prometheus\_*flask\_*exporter достаточно минимального примера:

```

from flask import Flask

from prometheus_fl... | https://habr.com/ru/post/518122/ | null | ru | null |

# Создание модального компонента с помощью Vue.js

В этой статье вы узнаете, как с Vue.js создать переиспользуемый компонент модального окна с использованием анимированных переходов и слотов.

### Определение структуры шаблона

Начнем с определения нашего шаблона. Нам понадобится **div** для заднего плана (тени), **d... | https://habr.com/ru/post/349306/ | null | ru | null |

# [В закладки] Кунг-фу на клавиатуре. Искусство сочетать клавиши

> Сочетания клавиш для тех, кто хочет войти в IT и не только.

>

>

**Содержание**

* [Базовые сочетания](https://gist.github.com/kotano/ea9664eb0b97a1b1d87bef444b318176#%D0%B1%D0%B0%D0%B7%D0%BE%D0%B2%D1%8B%D0%B5-%D1%81%D0%BE%D1%87%D0%B5%D1%82%D0%B0%D0%... | https://habr.com/ru/post/551822/ | null | ru | null |

# I2P — Создание своего сайта

Снова всем доброго времени суток!

Сегодня я попытаюсь описать процесс создания своего сайта (англ. *eepsite*) в анонимной сети [I2P](http://habrahabr.ru/blogs/infosecurity/97827/).

средствами Python и Vk API

Здравствуйте.

Раньше часто слушал музыку средствами «Вконтакте» (далее ВК). После перехода на Ubuntu 14.10 возникли проблемы в виде полного зависания компьютера во время прослушивания аудиозаписей через браузер Google Chrome для linux ... | https://habr.com/ru/post/247987/ | null | ru | null |

# Создание patch’ей на Wix при помощи PatchWiz. Часть 2

Добрый день всем! В своей [прошлой статье](http://habrahabr.ru/post/190546/) я поставил задачу генерации патчей и начал обзор технологии их создания на Wix (с ... | https://habr.com/ru/post/190654/ | null | ru | null |

# GIMP Script-fu: быстрое изучение и написание простых скриптов на Scheme (+ пакетная обработка бесплатно)

#### **Вступление**

В статье будет рассказано о том, как в кратчайшие сроки познакомиться с основами скриптинга в GIMP на язы... | https://habr.com/ru/post/111387/ | null | ru | null |

# Unity3D + Google Services: мультиплеер для вашего проекта на Android и iOS

В этой статье я хочу рассказать об использовании игровых сервисов Google в вашем приложении на Unity. На написание данного матер... | https://habr.com/ru/post/230377/ | null | ru | null |

# Synchronous Request-Response using REST and Apache Kafka

On one of the Innotech’s projects, we received a task to convert asynchronous requests into synchronous ones. Basically, the purpose was to integrate REST and Apache Kafka into the same request.

In more detail, we have two services that communicate with each ... | https://habr.com/ru/post/694292/ | null | en | null |

# SwiftUI 2020. Что изменилось?

Приветствую вас, жители Хабра и все интересующиеся разработкой под IOS. На связи Анна Жаркова, Senior iOS/Android разработчик компании [Usetech](https://usetech.ru)

Сегодня мы поговорим о тех изменениях и новшествах, которые нам представляет Apple на WWDC 2020. А именно про доработан... | https://habr.com/ru/post/508002/ | null | ru | null |

# Улучшаем юзабилити Krusader

#### 0. Интро.

Несомненно, krusader является лидером среди графических файловых менеджеров. Внешне похож на знаменитый Total Commander, но функциональность слабее. Я сейчас покажу, как можно немного улучшить юзабилити для повседневного использования. А делать мы это будем через useractio... | https://habr.com/ru/post/76358/ | null | ru | null |

# Руководство по JavaScript, часть 2: стиль кода и структура программ

Сегодня мы публикуем перевод следующей части руководства по JavaScript. Здесь мы поговорим о стиле кода и о лексической структуре программ.

→ [Часть 1: первая программа, особенности языка, стандарты](https://habr.com/company/ruvds/blog/429552/) ... | https://habr.com/ru/post/429556/ | null | ru | null |

# Автообновление программы через MSSQL server

Дабы не бегать по своей работе к каждому человеку который использует мою программу разумно сделать автообновление, которое будет обновлять программу, если загрузить новую версию на сервер. Испробовав множество способов, нашел самый простой в использовании (хотя и не самый ... | https://habr.com/ru/post/152285/ | null | ru | null |

# (Перевод) Введение в разработку C++ в UE4

**Часть 1. Введение. Создание класса и добавление свойств. Расширение класса С++ с помощью Blueprint.**

[Часть 2. Классы геймплея. Структуры. Отражение (reflection) в Unreal. Object/Actor итераторы. Менеджер памяти и сборщик мусора.](http://habrahabr.ru/post/257827/)

Ч... | https://habr.com/ru/post/254931/ | null | ru | null |

# КОМПАС-3D под FreeBSD в среде Wine на видеокарте nVidia

Данный пост можно рассматривать как дополнение к ["КОМПАС-3D и Linux → Часть 1"](https://habr.com/en/company/ascon/blog/572196/)

Небольшое отступление.

К фрюхе я неравнодушен давно, года с 1996-го, но использовал её ранее только как серверную ОС. О том, что б... | https://habr.com/ru/post/578660/ | null | ru | null |

# Алгоритм нахождения 1000 ферзей на шахматной доске

Недавно разбирался в старых своих наработках/скриптах и наткнулся на скрипт где решалась задача о ферзях. Собственно это послужило написанию статьи о том как проходили этапы написания его алгоритма. Возможно пригодится начинающим программистам для решения похожих за... | https://habr.com/ru/post/557846/ | null | ru | null |

# Собственная игровая аналитика за $300 в месяц

[](https://habrahabr.ru/post/351... | https://habr.com/ru/post/351206/ | null | ru | null |

# jointSPACE: управляем телевизором Philips по сети

Удивившись практически полному отсутствию информации по данной теме, решил написать этот пост.

В двух словах jointSPACE — это OpenSource платформа, созданная для разработки польз... | https://habr.com/ru/post/126654/ | null | ru | null |

# Голосовое меню своими руками

Даже в 2021 году большая часть общения с клиентами происходит по телефону. Незаменимыми остаются виртуальная АТС и голосовое меню. Но настраивать его через веб интерфейсы часто недостаточно функционально, а делать через API или asterisk сложно.

Чтобы максимально упростить создание IV... | https://habr.com/ru/post/550362/ | null | ru | null |

# Теперь поддержка Mesh Shaders появится и в продуктах Intel Arc Alchemist

[](https://habr.com/ru/company/ruvds/news/t/649769/)

В стремлении соответствовать технологическому уровню конкурентов, компания Intel добавила пока что экспер... | https://habr.com/ru/post/649769/ | null | ru | null |

# Инверсия контроля на голом TypeScript без боли

Здравствуйте, меня зовут Дмитрий Карловский и (сколько себя помню) я борюсь со своим окружением. Ведь оно такое костное, дубовое, и никогда не понимает, что я от него хочу. Но в какой-то момент я понял, что хватит это терпеть и надо что-то менять. Поэтому теперь не окру... | https://habr.com/ru/post/541800/ | null | ru | null |

# PHP-Дайджест № 101 – интересные новости, материалы и инструменты (15 – 29 января 2017)

[](https://habrahabr.ru/company/zfort/blog/320756/)

Предлагаем вашему вниманию очередную подборку со ссылками на новости и материалы. ... | https://habr.com/ru/post/320756/ | null | ru | null |

# Иследование несложных crackme's (часть 3)

Здравствуйте, Хабралюди.

Представляю вам третью часть из моего цикла статей о исследовании крякмисов. В этом топике мы поговорим с вами о ручной распаковке некоторых пакеров и о преодолении не сложных антиотладочных методов.

#### 1. Ручная распаковка

Из инструментов м... | https://habr.com/ru/post/102126/ | null | ru | null |

# Разработка и тестирование Ansible-ролей с использованием Molecule и Podman

Одно из основных преимуществ Red Hat Ansible Automation Platform заключается в том, что ее язык описания автоматизаций читабелен не только для пары-тройки гуру, но и почти для всех, кто имеет отношение к ИТ. Поэтому вносить свой вклад в автом... | https://habr.com/ru/post/519452/ | null | ru | null |

# Что нового в Spring Data (Klara Dan von) Neumann

***Перевод статьи подготовлен в преддверии старта курса [«Разработчик на Spring Framework»](https://otus.pw/FFfZ/).***

*Подробнее о курсе можно узнать посмотрев [запись дня открытых дверей](https://otus.pw/FFfZ/).*

![](https://habrastorage.org/r/w1560/webt/vm/dz... | https://habr.com/ru/post/515972/ | null | ru | null |

# Youtube Player — создание собственного плеера на JavaScript

#### Вступление

Наверняка многие фронтэнд разработчики да и в целом многие пользователи хоть раз интересовались работой и функционированием Youtube Player. В этой статье я расскажу, как он работает, и как сделать свой плеер для воспроизведения Youtube виде... | https://habr.com/ru/post/306726/ | null | ru | null |

Subsets and Splits

No community queries yet

The top public SQL queries from the community will appear here once available.