text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

values | source stringclasses 4

values |

|---|---|---|---|---|

# Игры для MS-DOS с открытым исходным кодом

Игры под DOS с открытым исходным кодом — редкость. Вы, конечно, можете вспомнить GORILLA.BAS или DONKEY.BAS, написанные в соавторстве с самим Биллом Гейтсом, или культовые шутеры от первого лица Doom и Quake. Но это скорее исключения.

Однако спустя много лет некоторые разр... | https://habr.com/ru/post/657281/ | null | ru | null |

# Новый лидер Java EE? WildFly 8 в InfoboxCloud IaaS. Часть 2. Режим домена

[В первой части](http://habrahabr.ru/company/infobox/blog/210536/) мы развернули WildFly 8 в [Облачный конструктор InfoboxCloud](http://infobox.ru/cloudconstructor/) в режиме Standalone. Давайте посмотрим, как можно развернуть [WildFly](http:/... | https://habr.com/ru/post/212031/ | null | ru | null |

# Реализуем RESTful Web Service на Scala

На прошлой неделе на Хабре было целых две статьи о реализации RESTful web-сервисов на Java. Что ж, не будем отставать и напишем свой вариант на Scala, с монадами и аппликативными функторами. Матёрые разработчики на Scala вряд ли найдут в этой статье что-то новое, а любители Dja... | https://habr.com/ru/post/150199/ | null | ru | null |

# Простой Ripple эффект своими руками для Android

Любой Android разработчик работал с кнопками, поэтому видел **ripple** эффект и всю его красоту.

Иногда хочется реализовать что-нибудь кастомное нежели стандартные вещи, которые уже предоставляются компонентами **Material Design**.

Поэтому я решил написать наследник ... | https://habr.com/ru/post/577680/ | null | ru | null |

# Посмотри, что ты скачал в торрентах

«Здравствуй, пират! Твой IP-адрес есть в нашей базе данных. Любишь скачивать торренты, правда? По крайней мере, кто-то в твоём доме точно любит. Судя по нашим записям, ты скачал несколько файлов в последнее время. Внизу ты видишь табличку с некоторыми примерами», — такими словами ... | https://habr.com/ru/post/134374/ | null | ru | null |

# HTML5: Web Workers и AJAX

Все прочнее в среду разработчиков входит HTML5. Важным его достоинством является наличие такой технологии, как web workers, которая позволяет в некоторой степени обеспечить, если не мультипоточность, то ее подобие при выполнении скриптов.

Суть технологии проста — в отдельные файлы вынося... | https://habr.com/ru/post/132785/ | null | ru | null |

# Введение в PHP 7: Что добавлено, что убрано

Одним из самых значительных событий, произошедших в мире PHP в 2015 году, стал выпуск PHP 7. Целых 10 лет отделяют его от выпуска первого релиза PHP с номером 5. С увеличением первой цифры в номере версии, в PHP 7 появилась масса новшеств, увеличилась и скорость работы.

... | https://habr.com/ru/post/280071/ | null | ru | null |

# Рекурсия в регулярных выражениях

`str = "a * ((b-c)/(d-e) - f) * g"

reg = /(?

\(

(?:

(?>

\\[()]

|

[^()]

)

|

\g

)*

\)

)

\x

m=reg.match(str).to_a`

Что делает этот код под катом.

Данный код находит любое вложенное выражение с правильно раставленными скобкам... | https://habr.com/ru/post/50749/ | null | ru | null |

# Marvel: Infinity War или Как собрать данные под свой проект за пару минут

[](https://habrastorage.org/webt/mc/a-/ed/mca-edh2nvwsuq7hmvgzndeslum.jpeg)

У меня есть две сферы интересов. Первая: общество анонимных ~~ленивых~~ аналити... | https://habr.com/ru/post/412579/ | null | ru | null |

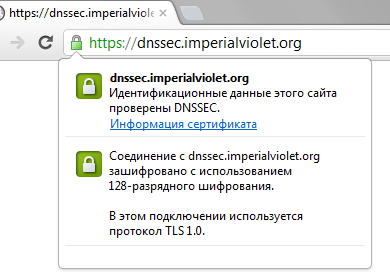

# Практическое применение DNSSEC

В статье описываются недостатки существующей структуры DNS, полный процесс внедрения DNSSEC на примере доменов .com и .org, процедура создания **валидного самоподписанного** SSL-сертифика... | https://habr.com/ru/post/138490/ | null | ru | null |

# Опыт использования контрактов при вызовах REST API

Существуют два непримиримых лагеря разработчиков программного обеспечения: первый — утверждает, что чем больше крешится приложение, тем лучше оно работает. Второй — что п... | https://habr.com/ru/post/283012/ | null | ru | null |

# Хранение и шифрование паролей Microsoft Windows

Про взлом паролей windows было написано немало статей, но все они сводились к использованию какого-либо софта, либо поверхностно описывали способы шифрования LM и NT, и совсем поверхностно описывали syskey. Я попытаюсь исправить этот неодостаток, описав все подробности... | https://habr.com/ru/post/114150/ | null | ru | null |

# Как сделать экспериментальный поиск Google поиском по умолчанию в Firefox

Прежде всего, если вы его еще не видели, вы можете посмотреть результаты его поиска [тут](http://www.google.ru/search?esrch=BetaShortcuts&hl=ru&newwindow=1&client=firefox-a&rls=org.mozilla%3Aen-US%3Aofficial&hs=Ja9&q=Habrahabr&btnG=%D0%9F%D0%B... | https://habr.com/ru/post/11388/ | null | ru | null |

# Вы можете обойтись без jQuery

jQuery — практически стандартная библиотека любого веб-разработчика. Если при разработке сайтов и веб-приложений почти никогда нет смысла отказываться от вылизанного до последне... | https://habr.com/ru/post/211961/ | null | ru | null |

# Docker, как показатель зрелости

Когда мы были детьми, мы многого не понимали, что на данный момент является абсолютно очевидным. "Почему я не могу есть одни конфеты? Почему бутерброды — не еда, я же это ем? Почему я не могу спать с хомяком? Зачем чистить зубы каждый день, да еще целых два раза?!" Действительно, заче... | https://habr.com/ru/post/343572/ | null | ru | null |

# Переход с ODAC 10 на ODAC 12

Всем доброго утра!

Понадобилось нам тут в оперативном порядке перейди на Oracle.DataAcess 12й версии в нашем .Net проекте. И все нормально шло ровно до того момента, как мы попытались запустить приложение. В *паре тысяч* мест внезапно вывалилась ошибка типа:

```

Unable to cast obje... | https://habr.com/ru/post/240427/ | null | ru | null |

# Fiber изнутри: Обновления состояния и пропсов в React

В этой статье используется базовая компоновка с родительским и дочерними компонентами для демонстрации внутренних процессов архитектуры Fiber, на которую опирается React для передачи пропсов в дочерние компоненты.

---

Предыдущая статья серии (ссылка на перевод)... | https://habr.com/ru/post/663792/ | null | ru | null |

# Двух-факторная аутентификация в Meteor.js

В течение какого-то времени мне довелось работать в стартапе. В качестве бэк-энда (и фронт-энда) мы использовали Meteor.js. В какой-то момент мы столкнулись с необходимостью реализации двух-факторной аутентификации. В этой статье я бы хотел рассказать т том, как реализовать ... | https://habr.com/ru/post/252593/ | null | ru | null |

# Мириады запущенных задач на C#

Недавно на ресурсе Medium были опубликованы [две](https://medium.com/@alexyakunin/async-recursion-and-some-weirdness-of-design-of-asynchronous-api-in-c-vs-f-a5760a00a26a) [статьи](https://medium.com/@alexyakunin/go-vs-c-part-1-goroutines-vs-async-await-ac909c651c11) от одного и того же... | https://habr.com/ru/post/336000/ | null | ru | null |

# Архитектура и дизайн Android приложения (мой опыт)

Хабр, привет!

Сегодня я хочу рассказать об архитектуре, которой я следую в своих Android приложениях. За основу я беру Clean Architecture, а в качестве инструментов использую Android Architecture Components (ViewModel, LiveData, LiveEvent) + Kotlin Coroutines. К ... | https://habr.com/ru/post/500128/ | null | ru | null |

# Земля круглая, вода мокрая, JPEG шакалит, небо голубое… Или нет?

Вы можете сказать, что один факт выбивается из этого ряда в заголовке, потому что он не так очевиден, как остальные. Еще лет 10-15 назад я бы никогда не подумал, что тут могут быть возражения, а сейчас уже и не удивляюсь, что приходится объяснять прост... | https://habr.com/ru/post/704750/ | null | ru | null |

# Миром всё ещё управляет язык С

Многие из проектов на языке С, существующих сегодня, начинали разрабатываться ещё десятилетия назад. Операционная система UNIX стартовала 1969 году (и писалась на ассемблере), но уже в 1972 была переписана на С. Точнее, это язык С был создан для того, чтобы появилось что-то, на что был... | https://habr.com/ru/post/347776/ | null | ru | null |

# Простой скрипт на Python для заучивания английских слов или почему я не использую карточки

На хабре уже не раз поднималась тема изучения английского языка ([пруф](http://www.google.ru/#newwindow=1&q=site:habrahabr.ru+%D0%B0%D0%BD%D0%B3%D0%BB%D0%B8%D0%B9%D1%81%D0%BA%D0%B8%D0%B9+%D1%8F%D0%B7%D1%8B%D0%BA)). Она рассмат... | https://habr.com/ru/post/211466/ | null | ru | null |

# Анонсирована превью-версия WinJS 4.0: универсальный UX, интеграция с AngularJS, обновленный ListView

Мы рады представить вам превью-версию Windows-библиотеки для JavaScript 4.0 (WinJS 4.0). В нашем предыдущем релизе (WinJS 3.0) мы фокусировались на том, чтобы обеспечить кросс-браузерную совместимость. С WinJS 4.0 мы... | https://habr.com/ru/post/255571/ | null | ru | null |

# PDO: сериализация, поздняя инициализация и PHPUnit

Здравствуйте. Как известно, [PDO не поддерживает сериализацию](http://www.google.ru/search?aq=f&sourceid=chrome&ie=UTF-8&q=You+cannot+serialize+or+unserialize+PDO). С этим связано несколько интересных вещей, в частности сюрпризы с [трейсами](http://fabien.potencier.... | https://habr.com/ru/post/120661/ | null | ru | null |

# Логирование в Kubernetes: EFK против PLG

Мониторинг стал весьма важным компонентом растущих облачных решений с ростом сложности распределенных систем. Он необходим для понимания их поведения. Нужны масштабируемые инструменты, которы... | https://habr.com/ru/post/510822/ | null | ru | null |

# Решение задания с pwnable.kr 06 — random и 09 — mistake

В данной статье узнаем как перехватить данные, передаваемые между библиотечной функцией и программой, вспомним про файловые дескрипторы и решим 6-е и 9-е задания c сайта... | https://habr.com/ru/post/460527/ | null | ru | null |

# Реализация «Onboarding Experience» в вашем приложении

Привет всем постояльцам хабра!

В этой статье хотел бы рассказать о внедрении «Onboarding Experience» в приложение, над которым вы работаете или собираетесь работать.

«Onboarding Experience» — это небольшая презентация внутри приложения, которая показывает о... | https://habr.com/ru/post/273893/ | null | ru | null |

# OpenCV. Вывод видео

Сегодня я вам покажу как вывести видео в нашем приложении при помощи OpenCV. Это так же легко, как и работа с изображением. Помимо прошлых действий нам потребуется сделать ц... | https://habr.com/ru/post/76723/ | null | ru | null |

# Создание и обновление списков рассылки в Zimbra Collaboration OSE на основе групп и пользователей Active Directory

### 1. Пара слов от автора

**Статья обновлена. Скрипты изменены. Добавлен скрипт для обновления одного списка... | https://habr.com/ru/post/443166/ | null | ru | null |

# Java конференция с английскими корнями. Обзор размера XXXL

Друзья, мы с [kent2171](https://habrahabr.ru/users/kent2171/), моим коллегой из CleverDATA, побывали на одной из крупнейших конференций Европы – Jax London 2017, посвященной экосистеме Java и всему, что ее окружает в современном мире, – микросервисной архите... | https://habr.com/ru/post/346706/ | null | ru | null |

# NDIS. NET_BUFFER architecture

Продолжаем [начатый](http://habrahabr.ru/blogs/windows/113233/) цикл статей о NDIS. В этом топике рассмотрим версии NDIS, и принципы передачи пакетов между драйверами «стека» и архитектуру NET\_BUFFER. ](https://picasaweb.google.com/lh/photo/UM2kfXW0gW44eA5IWzvavqSVARZjNKNEt3ROuFGU3eQ?feat=embedwebsite)

В этой статье я хочу рассказат... | https://habr.com/ru/post/149289/ | null | ru | null |

# Анализ Zebrocy, вредоносного ПО первого этапа группы Fancy Bear

Sednit, также известные как APT28, Fancy Bear, Sofacy или STRONTIUM – группа злоумышленников, работающих с 2004 года, а может и раньше, основной целью которых является кража конфиденциальной информации у избранных объектов.

](https://habrastorage.org/r/w1560/getpro/habr/upload_files/94b/4d3/7a0/94b4d37a0f5ddfb8960c4396be50b7eb.png "Офис allure :)")Офис allure :)Введение

--------

Приветствую тебя, мой виртуальный друг! Если ты читаешь эту статью, скорее всего тебе интересен Allure, ... | https://habr.com/ru/post/571476/ | null | ru | null |

# unit-тестирование здорового человека ч.1

### Вступление

Почему тесты не популярны в СНГ у клиентских разработчиков? В мобильной разработке программисты их часто обвиняют в усложнении и удорожании разработки. Примером хорошего продукта без тестов чаще выставляют Телеграм. Но любой, кто лез в его исходники или участв... | https://habr.com/ru/post/709228/ | null | ru | null |

# Три коротких истории о реестре Windows

Добрый день, уважаемые читатели.

Реестр — это одна из самых заметных и значительных систем Windows. Вряд ли найдется человек, который не слышал о нем. Занимаясь программированием под Windows уже около 20 лет, я думал, что знаю о нем все. Но время от времени появляется что-т... | https://habr.com/ru/post/415699/ | null | ru | null |

# Пример использования API поиска Algolia на примере телеграм бота

В данном примере разберем, как пользоваться API поиска в известном поисковом сервисе Algolia.

Идея

----

Идея была предельно проста, необход... | https://habr.com/ru/post/700724/ | null | ru | null |

# Автоматизируем генерацию @font-face kit'ов из консоли

Если вы когда либо задумывались, можно ли как то автоматизировать генерацию шрифтов для вэба или вам надоело заходить на Font Squirrel каждый раз, то, как говорится, добро пожаловать под кат.

На днях я написал консольную утилиту, по сути дела клиент, для попул... | https://habr.com/ru/post/173957/ | null | ru | null |

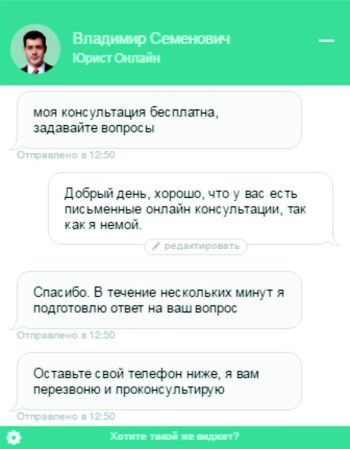

# Блокируем навязчивые виджеты обратного звонка на сайтах

По роду своей деятельности я не так часто сталкиваюсь с сайтами за пределами своей области (YouTube не в счет), поэтому всегда считал, что AdBlock, в принципе, справляется ... | https://habr.com/ru/post/519908/ | null | ru | null |

# Написание тестов API на JavaScript с Pactum

Я продолжаю повторять себе (как и некоторые участники тренировочных сессий), что как-то не ладится у меня с JavaScript. Может, дело во мне, а может, и в нем, но п... | https://habr.com/ru/post/669528/ | null | ru | null |

# Обзор Chrome DevTools. Решаем основные задачи веб-разработчика

Мы продолжаем цикл статей об инструментах разработчика — Chrome DevTools. В первых двух частях мы уже познакомились с вкладками [Elements](https://htmlacademy.ru/blog/boost/tools/chrome-devtools-1?utm_source=habr&utm_medium=special&utm_campaign=devtools1... | https://habr.com/ru/post/577524/ | null | ru | null |

# Эмуляция безопасности строк в PostgreSQL 9.4

В PostgreSQL 9.5 появится декларативная безопасность строк. Вы можете задать правила для таблиц и сделать их выполнение автоматическим, к примеру, позволяя пользователю joe видеть только строки, у которых в поле owner стоит значение joe.

Это отличный инструмент и он уж... | https://habr.com/ru/post/273149/ | null | ru | null |

# Автоматизация тестирования Windows-приложений с использованием .Net

#### Автоматизация тестирования.

Тестирование – деятельность, выполняемая для оценки и улучшения качества программного обеспечения. Эта деятельность, в общем случае, базируется на обнаружении дефектов и проблем в программных системах.

Тестирован... | https://habr.com/ru/post/100749/ | null | ru | null |

# Использование RabbitMQ вместе с MonsterMQ часть 2

*(Изображение взято с [официального сайта RabbitMQ](https://www.rabbitmq.com/))*

В [первой статье](https://habr.com/ru/post/488850/) мы написали... | https://habr.com/ru/post/489022/ | null | ru | null |

# Язык R в помощь хабра-статисту

На написание данной статьи меня сподвиг следующий топик: [В поисках идеального поста, или загадки хабра](http://habrahabr.ru/post/162209/). Дело в том, что после ознакомления с языком R я крайне искоса смотрю на любые попытки, что-то посчитать в экселе. Но надо признать, что и с R я по... | https://habr.com/ru/post/162583/ | null | ru | null |

# Как легко сделать Navigation Drawer и вкладки, используемые в популярных приложениях от Google

При использовании популярного приложения Play Маркет многие обратили внимание на вкладки для переключения контента. Такое применение вкладок можно найти и в других приложениях от Google, таких как Play Музыка, Play Пресса.... | https://habr.com/ru/post/236567/ | null | ru | null |

# Кроссбраузерные CSS

Добрый день Уважаемые!

В этом посте я хочу поделиться своими личными наблюдениями и выводами в области применения html5 & css3.

А именно использование таких нововведений как border-radius, box-shadow, opacity, linear-gradient. ... | https://habr.com/ru/post/139969/ | null | ru | null |

# Динамичность должна быть безопасной

*Евгений (Джим) Брикман является автором книги «Hello, Startup» («Привет, стартап») и основателем компании «Atomic Squirrel», которая специализируется на помощи стартапам. До этого он больше десяти лет работал в таких компаниях, как Linkedln, TripAdvisor, Cisco Systems, Thomson Fi... | https://habr.com/ru/post/300002/ | null | ru | null |

# Сборка недорогой домашней NAS-системы на Linux

[](https://habr.com/ru/company/ruvds/blog/523800/)

Я, как и многие другие пользователи MacBook Pro, столкнулся с проблемой недостачи внутренней памяти. Если говорить точнее, то испол... | https://habr.com/ru/post/523800/ | null | ru | null |

# Монтируем iOS под OSX с помощью ifuse

На днях столкнулся с задачей примонтировать в OSX 10.14 iPad в качестве внешнего диска, с возможностью осуществлять файловые операции из консоли. В интернете я нашел довольно много инструкций как это сделать с помощью файловой системы ifuse. К сожалению с iOS 12 ничего не вышло.... | https://habr.com/ru/post/459888/ | null | ru | null |

# Разворачиваем модель машинного обучения с Docker – Часть 1

*Перевод статьи подготовлен в преддверии старта базового и продвинутого курсов по машинному обучению.*

> Расширяем возможности для наших студентов. Теперь в OTUS есть ц... | https://habr.com/ru/post/513672/ | null | ru | null |

# “И все это из-за потеряшек!” или как ЦОД КРОК заинтересовался в нейронных сетях

Привет, Хабр! Меня зовут Денис, и я занимаюсь интеграциями систем ЦОД и учетом оборудования клиентов. Сегодня я хочу рассказать, как мы автоматизировали выдачу пропусков в наши ЦОДы с помощью нейронных сетей. Расскажу немного о самой сис... | https://habr.com/ru/post/691816/ | null | ru | null |

# Как создать 3d игру прямо в браузере

[Ссылка на обучающее видео](https://www.youtube.com/watch?v=iXd39ZBCveA)

Привет всем. Сегодня я вам расскажу как легко вы можете создать 3d игру прямо в вашем браузере и сделать вы сможете это очень быстро, примерно за минут 30.

Three.js

--------

Это библиотека которая позволя... | https://habr.com/ru/post/570666/ | null | ru | null |

# Preload в php 7.4: Composer и выбор файлов для предзагрузки

Мы в Badoo активно занимаемся переходом на PHP 7.4 и с большим энтузиазмом ждём возможности использовать новую функцию preload. Не так давно мы [рассказывали](https://habr.com/ru/company/badoo/blog/472528/) о наших экспериментах с ней.

Судя по всему, соо... | https://habr.com/ru/post/480746/ | null | ru | null |

# Модифицированный алгоритм Geometry Buffer Anti-Aliasing

Алиасинг представляет одну из фундаментальных проблем компьютерной графики, и для борьбы с ним придумано множество разнообразных алгоритмов антиалиасинга. Появление [MLAA](https://habrahabr.ru/post/124913) привлекло интерес к алгоритмам, работающим на этапе пос... | https://habr.com/ru/post/307366/ | null | ru | null |

# Обсуждение: проект OpenROAD намеревается решить задачу автоматизации проектирования процессоров

[](https://habr.com/ru/company/itglobalcom/blog/453200/)

*Фото — [Pexels](https://www.pexels.com/photo/empty-highway-overlooking-moun... | https://habr.com/ru/post/453200/ | null | ru | null |

# Презумпция виновности программиста или почему компилятор иногда «тупит»

Этот пост снова посвящается цикловым оптимизациям. Почему вообще речь зашла о цикловых перестановочных оптимизациях? Дело в том, что это одна... | https://habr.com/ru/post/162831/ | null | ru | null |

# Алгоритм Ляна-Кнута в реальном проекте, или как я делал читалку для iOS

Всем привет! В этот раз я хочу рассказать, как я реализовывал альтернативу iBooks. В своем предыдущем посте я писал об [алгоритме расстановки мягких переносов](http://habrahabr.ru/post/138088/) в тексте. Он как раз и пригодился при создании свое... | https://habr.com/ru/post/144942/ | null | ru | null |

# Настройка времени на коммутаторах по SNMP

Как все мы читали в новостях. с летним/зимним временем ожидается полный бардак.

Имея базу коммутаторов в количестве несколько тысяч, ручками не чень то и поменяешь им конфиги.

Потому был придумал вот такой велосипед.

Кстати, данный ввелосипед подходит не болько для ... | https://habr.com/ru/post/152931/ | null | ru | null |

# Дайджест новостей из мира PostgreSQL. Выпуск №12

*Мы продолжаем знакомить вас с самыми интересными новостями по PostgreSQL.*

Релизы

------

**PostgreSQL 11.1**

Вместе с этой версией вышли также 10.6, 9.6.11, 9.5.15, 9.4.20... | https://habr.com/ru/post/428275/ | null | ru | null |

# Создаём и настраиваем собственную CDN

[](https://habr.com/ru/company/ruvds/blog/709548/)

Задача этого репозитория — создать свод знаний о том, как работают CDN, написав одну из них «с нуля». CDN, которую мы будем проектировать, и... | https://habr.com/ru/post/709548/ | null | ru | null |

# Монады с точки зрения теории категорий

Введение

========

Кажется, монады в программировании стали загадкой века. И для этого есть две причины:

* недостаточное знание теории категорий;

* многие авторы стараюстся не упоминать категории вообще.

Это как говорить об электричестве не используя мат. анализ. Достаточно... | https://habr.com/ru/post/125782/ | null | ru | null |

# В официальном издании Age of Empires Collector's Edition на DVD используются крэки из сети

Первые части игры Age of Empires уже давно стали своего рода классикой. У этой игры до сих пор есть немало пок... | https://habr.com/ru/post/168269/ | null | ru | null |

# Разработка плагинов для Visual Paradigm

Visual paradigm ― мощный инструмент, идеология использования которого выходит за рамки простого рисования диаграмм. Главное назначение инструментов данного класса (Visual Paradigm, Enterprise Architect и др.) ― описание модели информационной системы и дальнейшая работа с ней. ... | https://habr.com/ru/post/685046/ | null | ru | null |

# Работа с cab-архивами через IStream

Некоторое время назад мне потребовалось сжимать данные прямо в памяти, причём не использовать для этого ничего стороннего — т.е. пользоваться встроенными в систему возможностями. Выбор пал на *Cabinet.dll* в качестве средства для сжатия данных и на интерфейс *IStream* для работы с... | https://habr.com/ru/post/314832/ | null | ru | null |

# Автоматизация сбора купонов для бесплатной литературы

Предыстория

===========

На ЛитРес есть система бонусов и купонов, которые появляются с завидной регулярностью. Чтобы сделать приятное жене, да и в целом может найти себе интересную книжку, начал мониторить сайт в котором появляются свежие купоны и скидывал их в ... | https://habr.com/ru/post/494460/ | null | ru | null |

# Продолжаем кромсать CLR: пул объектов .Net вне куч SOH/LOH

Добрый день, уважаемые разработчики (просто не знал, с чего начать пост). Предлагаю перед тем как начнется трудовая неделя немного подразмять мозги (совсем немного) и построить свой Small Objects Heap для .Net. Вернее даже не Small Objects Heap, а Custom Obj... | https://habr.com/ru/post/247433/ | null | ru | null |

# Создание языка программирования с использованием LLVM. Часть 10: Заключение и другие вкусности LLVM

Оглавление:

[Часть 1: Введение и лексический анализ](https://habrahabr.ru/post/119850/)

[Часть 2: Реализация парсера и AST](https://habrahabr.ru/post/120005/)

[Часть 3: Генерация кода LLVM IR](https://habraha... | https://habr.com/ru/post/337240/ | null | ru | null |

# Разбор перформансных задач с JBreak (часть 2)

Только поутихли страсти с [первой части](https://habrahabr.ru/post/350800/) разбора, вышедшей на прошлой неделе, как публикую продолжение: сегодня речь пойдёт о второй задаче.

Код второй задачи:

```

String format(String user, String grade, String company, Strin... | https://habr.com/ru/post/351300/ | null | ru | null |

# MikroTik основы настройки DNS

Если в магазине вас угораздило купить роутер MikroTik себе домой и вы не знаете зачем он вам, а отравление DNS кэша вашим провайдером не дает вам спать по ночам, то этот пост для вас.

Можно не мучаться и поставить DNS от Yandex, Google, Adquard и прочее, а можно пойти более сложным пут... | https://habr.com/ru/post/547774/ | null | ru | null |

# Как написать легко описываемый код

Привет, Хабр!

Часто ли у вас было, что вы или ваши коллеги не могли описать свой собственный код парочкой фраз?

Предлагаю вашему вниманию перевод статьи ["How to write easily describable code"](https://www.freecodecamp.org/news/writing-describable-code/) автора [Cedd Burge](https... | https://habr.com/ru/post/472830/ | null | ru | null |

# Веб-шрифты на распутье

*Перевод не претендует на 100%-ную точность, но я постарался максимально точно передать мысли и слог автора. Комментарии приветствуются.*

Начиная с Интернет Эксплорера 4 в 1998-ом, а затем с марта 2008-ого и до марта 2010-ого, один за другим, вся «большая пятерка» десктопных браузеров — Саф... | https://habr.com/ru/post/104196/ | null | ru | null |

# Обзор Kalm — веб-интерфейса для деплоя приложений и управления ими в Kubernetes

[Kalm](https://kalm.dev/) — бесплатное приложение с открытым исходным кодом. Представляет собой стандартный [контроллер Kubern... | https://habr.com/ru/post/575972/ | null | ru | null |

# 5 вещей, которые вы могли не знать о jQuery

jQuery очень мощная библиотека, но некоторые его богатые возможности неясны, если вы не изучали исходный код jQuery и не читали книгу jQuery Pocket Reference (автор пишет my new book), вы можете не знать о них. В этой статье представлены отрывки из этой книги — 5 полезных ... | https://habr.com/ru/post/111314/ | null | ru | null |

# Замена PEAR на Composer

Думаю, большинство разработчиков, использующих PHP, уже в знают, что популярные проекты начинают отказываться от распространения через PEAR в пользу Composer (например [PHPUnit](https://github.com/sebastianbergmann/phpunit/wiki/End-of-Life-for-PEAR-Installation-Method) и [Symfony](https://twi... | https://habr.com/ru/post/75570/ | null | ru | null |

# Организация единой папки для облачных сервисов

Недавно пришла идея хранить свои документы не на флешке или внешнем HDD, а на более удобных облачных хранилищах, таких как SkyDrive, Box, Google Drive. Единственной проблемой была невозможность «из коробки» заставить их все работать с одной лишь единой папкой. Собственн... | https://habr.com/ru/post/184410/ | null | ru | null |

# Бот волонтёра или как помочь инициативным группам по помощи нуждающимся

Дисклеймер: это не руководство по созданию бота - конечный продукт не завершён. Здесь описана проблематика и предложение поддержать разработку кодом. Я не разработчик и не стремлюсь им быть, поэтому в тексте вполне могут быть технические неточно... | https://habr.com/ru/post/674676/ | null | ru | null |

# Восстановление данных в MySQL из снимка EBS

Это короткое руководство, возможно, поможет кому-то, кто использует AWS (и, в частности, MySQL на инстансе EC2), восстановить данные в MySQL из снимка EBS (регулярное создание которых любой предусмотрительный системный администратор, конечно же, настраивает заблаговременно... | https://habr.com/ru/post/218821/ | null | ru | null |

# Как оптимизировать игру с помощью полигональных атласов

Как всем известно, жизнь разработчика мобильных игр непроста. Он должен найти свой путь на очень узкой дорожке. С одной ее стороны — требования гейм-дизайнеров, уверенно устремляющиеся к бесконечности. Больше функционала, больше красивой графики, больше эффекто... | https://habr.com/ru/post/306554/ | null | ru | null |

# Карты Yandex без использования Yandex Map Kit или карты из различных источников в приложении под Android

Здравствуйте!

В этом сообщении рассмотрим использование карт из различных источников (в том числе Yandex карты) в приложении под Android.

*«Вот что получится, если в факториале не умножать, а делить.»*

Когда я увидел его, мне пришлось бросить сво... | https://habr.com/ru/post/440512/ | null | ru | null |

# Разработка приложения на Flutter с нуля до релиза: Part 2

Привет! Это вторая статья из цикла о разработке приложения на Flutter. В этом "номере" я опишу создание сетевого слоя, работу с локализацией, удобный способ работы с ассетами, локальный поиск и создание UI для одного из двух экранов приложения. Также я выведу... | https://habr.com/ru/post/597605/ | null | ru | null |

# Получаем трафик и минимизируем его стоимость на примере браузерной MMO

Почему-то в наше время браузерные игры (Browser Based MMO) не считают стартапами, а людей которые ими занимаются и близко не с... | https://habr.com/ru/post/96917/ | null | ru | null |

# TextTest — кроссплатформенный фреймворк на python для тестирования GUI и не только. Часть 1

Предлагаю поговорить сегодня о замечательном фреймворке для тестирования TextTest. Это кроссплатформенный инструмент для функциональн... | https://habr.com/ru/post/165617/ | null | ru | null |

# Диспетчеризация в main thread с помощью MainActor

MainActor — это новый атрибут из Swift 5.5, который представляет из себя глобальный актор, выполняющий свои задачи в главном потоке (main thread). При созда... | https://habr.com/ru/post/571580/ | null | ru | null |

# Автомобильная спутниковая сигнализация на STM32F1

Теория создания самодельной автомобильной спутниковой сигнализации с web-интерфейсом и поддержкой eCall / ЭРА-ГЛОНАСС на базе микроконтроллеров STM32 как основа концепции «Умный автомобиль», и её использование в системах «Умный дом». Реализация аналога технологии Vol... | https://habr.com/ru/post/139760/ | null | ru | null |

# 12 странных вещей, которые могут произойти после установки npm пакета

Пару месяцев назад я начал заниматься проектом под названием [malicious-packages](https://github.com/malicious-packages) (ака "вредоносные пакеты"). Он следит за обновлениями в npm репозитории, скачивает все новые модули, а затем проверяет их на в... | https://habr.com/ru/post/436132/ | null | ru | null |

# Принудительно добавляем поддержку защищенных носителей (токенов и карт) в недоработанные порталы Республики Казахстан

В Казахстане многие информационные системы не корректно интегрированы с [NCALayer](https://pki.gov.kz/ncalayer/) и в результате поддерживают только файловые хранилища ключей ЭЦП (читателям, интересую... | https://habr.com/ru/post/682470/ | null | ru | null |

# Работа с форматом AVRO в python — библиотека fastavro

В статье описывается использование формата сериализации AVRO в языке python, дается краткое описание AVRO-схемы с пояснениями наиболее неочевидных моментов, приводятся конкретные... | https://habr.com/ru/post/346698/ | null | ru | null |

# Как мы искали и нашли ошибку в Visual Studio C++

Это был чудесный летний день. За окном сияли тучки, нежными голосами пели вороны, на автомойке весело пачкали шампунем чью-то машину, за стеной тихо скрёбся перфоратор — в общем, идиллия.

Ничего не предвещало беды ровно до того момента, как я запустил только что со... | https://habr.com/ru/post/333442/ | null | ru | null |

# Как создать приложение c 3D аналитикой для iPhone?

[](https://habrastorage.org/webt/sm/bw/gw/smbwgwttzf-9y5yaognbwnc-m80.jpeg)

Существует множество трендов и направлений в анализе данных, и все мы знакомы с популярными словами Bu... | https://habr.com/ru/post/351440/ | null | ru | null |

# Выбираем алгоритм, или Когда ждать уже невыносимо

При разработке бизнес-логики приложений нужно продумать действия с множествами – с пересечением, разностью массивов или двойной разностью. Недостатки в этом алгоритме могут привести к рискам. Например, если вам нужно в реальном времени обработать объем данных, превыш... | https://habr.com/ru/post/582316/ | null | ru | null |

# Устранение утечек памяти в приложении на Питоне

Недавно мне довелось разобраться и устранить несколько утечек памяти в популярном фреймворке Торнадо. Не беда, если вы никогда его не использовали, потом... | https://habr.com/ru/post/178637/ | null | ru | null |

# Вы еще не программируете микроконтроллеры? Тогда мы идем к вам!

Здравствуйте, уважаемые Хабражители!

В этой статье я хочу рассказать о том, как однажды решил начать программировать микроконтроллеры, что д... | https://habr.com/ru/post/205972/ | null | ru | null |

# Введение в проектирование сущностей, проблемы создания объектов

При моделировании такого понятия предметно-ориентированного проектирования как сущность могут возникнуть некоторые сложности, обусловленные бизнес-требованиями или технической частью. В частности, иногда возникает сложность с созданием объекта-сущности.... | https://habr.com/ru/post/321340/ | null | ru | null |

# История однострочных багов

Компания Apple недавно допустила [крупную ошибку](http://habrahabr.ru/post/213525/), забыв удалить лишнюю строчку с оператором безусловного перехода goto посередине функции SSLVerifySignedServerKeyExchange для проверки серверной подписи при установке SSL-соединения. В результате, функция у... | https://habr.com/ru/post/214557/ | null | ru | null |

# Как сделать маппинг полиморфных JSON-объектов с помощью JPA и Hibernate

**Введение**

В этой статье я собираюсь показать вам, как можно выполнять маппинг полиморфных объектов JSON используя JPA и Hibernate.... | https://habr.com/ru/post/593941/ | null | ru | null |

# Обновление JunOS на коммутаторах EX4500 в VirtualChassis — что может пойти не так? Часть 1

Поискав на Хабре, не нашел статью, освещающей данную тему в необходимом объеме, отсюда данный пост. Будет две части, так как для пробной статьи объема многовато.

Так как я здесь новичок, разрешите представиться: меня зовут ... | https://habr.com/ru/post/320266/ | null | ru | null |

Subsets and Splits

No community queries yet

The top public SQL queries from the community will appear here once available.