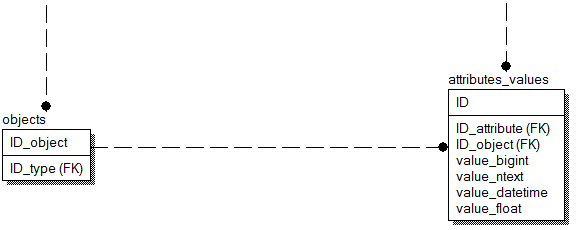

text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

values | source stringclasses 4

values |

|---|---|---|---|---|

# Блокнот на языке Vala

В этом посте я расскажу о простом блокноте на языке программирования Vala. Программа создавалась с использованием среды разработки GNOME Builder и редактора интерфейсов Glade.

Внешний вид

-----------

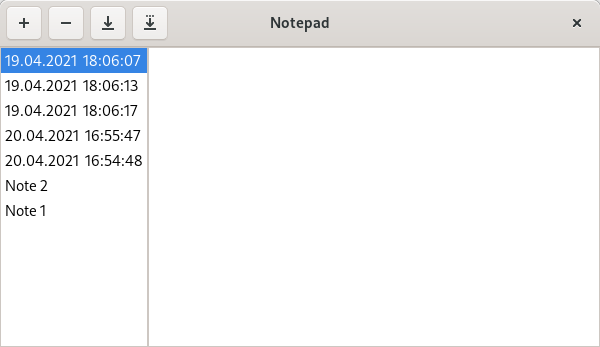

Вот так приложение выглядит:

Слева можно видеть список всех заметок, которые автоматически сохраняются в специальной папке. Имя по умолчанию для любой заметки имеет вид даты и времени ее создания. Нажав на последнюю кнопку в хидербаре, можно назначить другое имя. Исходный код приложения находится [здесь](https://github.com/alexkdeveloper/notepad).

Иерархия элементов интерфейса в редакторе Glade:

Создание заметки

----------------

Нажав на первую кнопку, пользователь сразу же создает заметку с именем по умолчанию. За это отвечает следующий метод:

```

private void on_add_clicked(){

GLib.File file = GLib.File.new_for_path(directory_path+"/"+date_time());

try {

FileUtils.set_contents (file.get_path(), "");//создаем пустой файл

} catch (Error e) {

stderr.printf ("Error: %s\n", e.message);

}

if(!is_empty(text_view.buffer.text)){

text_view.buffer.text = "";

}

show_notes();//показываем список заметок

}

```

Метод `date_time`, который дает имя заметке:

```

private string date_time(){

var now = new DateTime.now_local ();

return now.format("%d")+"."+now.format("%m")+"."+now.format("%Y")+" "+now.format("%H")+":"+now.format("%M")+":"+now.format("%S");

}

```

Идем дальше. Метод для показа списка:

```

private void show_notes () {

list_store.clear();

list = new GLib.List ();

try {

Dir dir = Dir.open (directory\_path, 0);

string? file\_name = null;

while ((file\_name = dir.read\_name ()) != null) {

list.append(file\_name);

}

} catch (FileError err) {

stderr.printf (err.message);

}

Gtk.TreeIter iter;

foreach (string item in list) {

list\_store.append(out iter);

list\_store.set(iter, Columns.TEXT, item);

}

}

```

Метод вызывается каждый раз, когда нужно обновить список.

Удаление заметки

----------------

За удаление заметок отвечает вот такой метод:

```

private void on_delete_clicked(){

var selection = tree_view.get_selection();

selection.set_mode(Gtk.SelectionMode.SINGLE);

Gtk.TreeModel model;

Gtk.TreeIter iter;

if (!selection.get_selected(out model, out iter)) {

alert("Choose a note");

return;

}

GLib.File file = GLib.File.new_for_path(directory_path+"/"+item);

var dialog_delete_file = new Gtk.MessageDialog(this, Gtk.DialogFlags.MODAL,Gtk.MessageType.QUESTION, Gtk.ButtonsType.OK_CANCEL, "Delete note "+file.get_basename()+" ?");

dialog_delete_file.set_title("Question");

Gtk.ResponseType result = (Gtk.ResponseType)dialog_delete_file.run ();

dialog_delete_file.destroy();

if(result==Gtk.ResponseType.OK){

FileUtils.remove (directory_path+"/"+item);//удаляем файл

if(file.query_exists()){

alert("Delete failed");//не получилось удалить

}else{

show_notes();

text_view.buffer.text = "";//очищаем текстовую область

}

}

}

```

Удаление происходит только после подтверждения этого действия пользователем.

Сохранение заметок

------------------

Для сохранение заметок существует следующий код:

```

private void on_save_clicked(){

var selection = tree_view.get_selection();

selection.set_mode(Gtk.SelectionMode.SINGLE);

Gtk.TreeModel model;

Gtk.TreeIter iter;

if (!selection.get_selected(out model, out iter)) {

alert("Choose a note");

return;

}

if(is_empty(text_view.buffer.text)){

alert("Nothing to save");

return;

}

GLib.File file = GLib.File.new_for_path(directory_path+"/"+item);

var dialog_save_file = new Gtk.MessageDialog(this, Gtk.DialogFlags.MODAL,Gtk.MessageType.QUESTION, Gtk.ButtonsType.OK_CANCEL, "Save note "+file.get_basename()+" ?");

dialog_save_file.set_title("Question");

Gtk.ResponseType result = (Gtk.ResponseType)dialog_save_file.run ();

if(result==Gtk.ResponseType.OK){

try {

FileUtils.set_contents (file.get_path(), text_view.buffer.text);//записываем в файл содержимое текстовой области

} catch (Error e) {

stderr.printf ("Error: %s\n", e.message);

}

show_notes();

}

dialog_save_file.destroy();

}

```

Здесь, при сохранении сначала идет проверка, а есть ли вообще, что сохранять. В случае, если текст не обнаружен, пользователь получает соответствующее сообщение.

Сохранение заметок под другим именем

------------------------------------

Для того чтобы поменять имя заметки используется такой метод:

```

private void on_save_as_clicked(){

var selection = tree_view.get_selection();

selection.set_mode(Gtk.SelectionMode.SINGLE);

Gtk.TreeModel model;

Gtk.TreeIter iter;

if (!selection.get_selected(out model, out iter)) {

alert("Choose a note");//нужно выбрать заметку из списка

return;

}

if(is_empty(text_view.buffer.text)){

alert("Nothing to save");//нечего сохранять

return;

}

var dialog_save_note = new Gtk.Dialog.with_buttons ("Save note", this, Gtk.DialogFlags.MODAL);

var content_area = dialog_save_note.get_content_area ();

entry_name = new Gtk.Entry();

var label_name = new Gtk.Label.with_mnemonic ("_Name:");

var hbox = new Gtk.Box (Gtk.Orientation.HORIZONTAL, 20);

hbox.set_border_width(15);

hbox.pack_start (label_name, false, true, 0);

hbox.pack_start (entry_name, true, true, 0);

content_area.add (hbox);

dialog_save_note.add_button ("OK", Gtk.ResponseType.OK);

dialog_save_note.add_button ("CLOSE", Gtk.ResponseType.CLOSE);

dialog_save_note.response.connect (on_save_response);

dialog_save_note.show_all ();

}

```

В вышеприведенном коде создается простенькое диалоговое окно для ввода нового имени заметки:

Для обработки нажатий на кнопки OK и CLOSE понадобится метод `on_save_response`:

```

private void on_save_response (Gtk.Dialog dialog, int response_id) {

switch (response_id) {

case Gtk.ResponseType.OK:

if(is_empty(entry_name.get_text())){

alert("Enter the name");//нужно ввести имя

entry_name.grab_focus();

return;

}

GLib.File select_file = GLib.File.new_for_path(directory_path+"/"+item);

GLib.File edit_file = GLib.File.new_for_path(directory_path+"/"+entry_name.get_text().strip());

if (select_file.get_basename() != edit_file.get_basename() && !edit_file.query_exists()){

FileUtils.rename(select_file.get_path(), edit_file.get_path());//переименовываем файл

if(!edit_file.query_exists()){

alert("Rename failed");//не получилось переименовать

return;

}

try {

FileUtils.set_contents (edit_file.get_path(), text_view.buffer.text);

} catch (Error e) {

stderr.printf ("Error: %s\n", e.message);

}

}else{

if (select_file.get_basename() != edit_file.get_basename()) {

alert("A note with the same name already exists");//такое имя уже есть

entry_name.grab_focus();

return;

}

try {

FileUtils.set_contents (edit_file.get_path(), text_view.buffer.text);

} catch (Error e) {

stderr.printf ("Error: %s\n", e.message);

}

}

show_notes();

dialog.destroy();

break;

case Gtk.ResponseType.CLOSE:

dialog.destroy();

break;

case Gtk.ResponseType.DELETE_EVENT:

dialog.destroy();

break;

}

}

```

Обязательно нужно проверить существует ли заметка с таким же именем и если существует, то предложить пользователю ввести другое имя.

Отображение текста заметки

--------------------------

Чтобы показать содержимое заметки используется такой код:

```

private void on_select_item () {

var selection = tree_view.get_selection();

selection.set_mode(Gtk.SelectionMode.SINGLE);

Gtk.TreeModel model;

Gtk.TreeIter iter;

if (!selection.get_selected(out model, out iter)) {

return;

}

Gtk.TreePath path = model.get_path(iter);

var index = int.parse(path.to_string());

if (index >= 0) {

item = list.nth_data(index);

}

string text;

try {

FileUtils.get_contents (directory_path+"/"+item, out text);

} catch (Error e) {

stderr.printf ("Error: %s\n", e.message);

}

text_view.buffer.text = text;//показываем текст заметки

}

```

На этом все! До встречи в следующих постах!

---

Дата-центр ITSOFT — размещение и аренда серверов и стоек в двух дата-центрах в Москве. За последние годы UPTIME 100%. Размещение GPU-ферм и ASIC-майнеров, аренда GPU-серверов, лицензии связи, SSL-сертификаты, администрирование серверов и поддержка сайтов. | https://habr.com/ru/post/553488/ | null | ru | null |

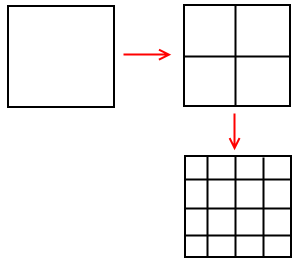

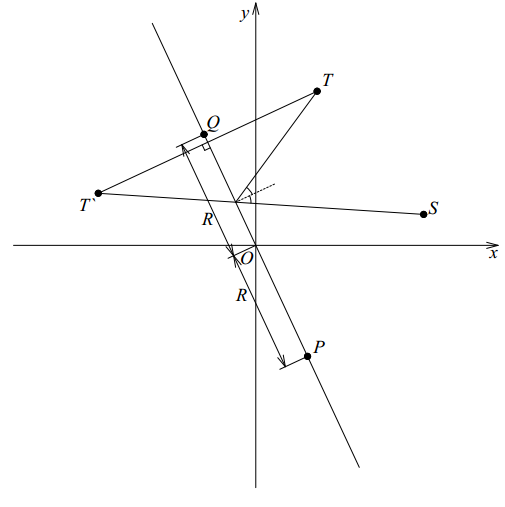

# Почему центр пикселя должен быть в (0,5; 0,5)

Сегодня, когда всё популярнее становится трассировка лучей (ray tracing) выполняемая из «глаза» камеры, этот урок нужно усвоить заново: код становится лучше, а жизнь — проще, если центр пикселя находится в координате (0,5; 0.5). Если вы уверены, что делаете всё правильно, то продолжайте в том же духе, для вас в статье нет ничего нового. Прочитайте лучше [вот это](https://twitter.com/pointinpolygon/status/1270695113967181827).

Смысл размещения центра пикселя в (0,5; 0,5) впервые объяснила (по крайней мере, мне) милая короткая статья Пола Хекберта «Что такое координаты пикселя?» из книги 1990 года *Graphics Gems*, стр. 246-248.

Сегодня эту статью найти трудновато, поэтому вкратце изложу её суть. Допустим, у нас есть экран с шириной и высотой 1000. Давайте рассмотрим только ось X. Может возникнуть искушение назначить 0,0 центром самого левого пикселя в строке, 1,0 — центром следующего, и так далее. Можно даже использовать округление, при котором координаты с плавающей запятой 73,6 и 74,4 переносятся в центр 74,0.

Однако над этим стоит поразмыслить. При таком сопоставлении левый край будет находиться в координате -0,5, а правый — в 999,5. С такой системой неудобно работать. Хуже того, если к значениям координат пикселей применяются различные операторы наподобие `abs()` или `mod()`, то такое сопоставление может привести к незначительным погрешностям на краях.

Проще работать с интервалом от 0,0 до 1000,0, в котором центр каждого пикселя имеет дробную часть 0,5. Например, тогда целочисленный пиксель 43 будет иметь красивый интервал значений значений входящих в него субпикселей от 43,0 до 43,99999. Вот чертёж из статьи Пола:

В [OpenGL](https://www.khronos.org/registry/OpenGL-Refpages/gl4/html/gl_FragCoord.xhtml) центр пикселя всегда имел дробную часть (0,5; 0,5). Поначалу DirectX этого не придерживался, но в версии DirectX 10 [взялся за ум](https://docs.microsoft.com/en-us/windows/win32/direct3d10/d3d10-graphics-programming-guide-resources-coordinates).

Операции для преобразования из целочисленных координат в координаты пикселя с плавающей запятой заключаются в прибавлении 0,5; для преобразования float в integer достаточно использовать `floor()`.

Но это уже давняя история. Ведь сегодня все делают так, правда? Я вернулся к этой теме, потому что начал встречать в примерах (псевдо)кода генерации направления перспективной камеры для трассировки лучей такое:

```

float3 ray_origin = camera->eye;

float2 d = 2.0 *

( float2(idx.x, idx.y) /

float2(width, height) ) - 1.0;

float3 ray_direction =

d.x*camera->U + d.y*camera->V + camera->W;

```

Вектор **idx** — это целочисленное местоположение пикселя, *width* и *height* — разрешение экрана. Вектор **d** вычисляется и используется для генерации вектора в мировом пространстве при помощи перемножения двух векторов, **U** и **V**. Затем прибавляется вектор **W** — направление камеры в мировом пространстве. **U** и **V** обозначают положительные направления осей **X** и **Y** плоскости отображения на расстоянии *W* от глаза. В представленном выше коде всё это выглядит красиво и симметрично; так оно по большей части и есть.

Вектор **d** должен обозначать пару значений от -1,0 до 1,0 в [нормализованных координатах устройства](https://learnopengl.com/Getting-started/Coordinate-Systems) (Normalized Device Coordinates, NDC) для точек на экране. Однако, здесь **код даёт сбой**. Продолжим наш пример: целочисленное местоположение пикселя (0; 0) переносится в (-1,0; -1,0). Кажется, это хорошо, правда? Но максимальное целочисленное местоположение пикселя равно (999; 999), что преобразуется в (0,998; 0,998). Суммарная разница 0,002 вызвана тем, что это неверное наложение сдвигает всю картинку на полпикселя. Эти центры пикселей должны находиться в 0,001 от каждого из краёв.

Вторая строка кода должна выглядеть так:

```

float2 d = 2.0 *

( ( float2(idx.x, idx.y) + float2(0.5,0.5) ) /

float2(width, height) ) - 1.0;

```

Тогда мы получим правильный интервал NDC для центров пикселей, от -0,999 до 0,999. Если мы вместо этого преобразуем угловые значения с плавающей запятой (0,0; 0,0) и (1000,0; 1000,0) этим способом (мы не прибавляем 0,5, потому что уже и так работаем с плавающей запятой), то получим полный интервал NDC, от -1,0 до 1,0, от края до края; это доказывает правильность кода.

Если 0,5 вас раздражает и вам не хватает симметрии, то для генерации случайных значений внутри пикселя, т.е. когда вы выполняете сглаживание испусканием случайных лучей через каждый пиксель, можно использовать такую изящную формулировку:

```

float2 d = 2.0 *

( ( float2(idx.x, idx.y) +

float2( rand(seed), rand(seed) ) ) /

float2(width, height) ) - 1.0;

```

Мы просто прибавляем к каждому целочисленному значению местоположения пикселя случайное число из интервала [0.0,1.0). Средним этого случайного значения будет 0,5, то есть центр пикселя.

Так что скажу кратко: будьте внимательны. Реализуйте полупиксель правильно. По моему опыту, такие ошибки полупикселей всплывают во множестве разных мест (камеры, сэмплирование текстур и т.п.) на протяжении долгих лет моей работы над кодом растеризатора в Autodesk. Далее по конвейеру они не приносят ничего, кроме боли. Если мы не будем внимательны, они могут появиться и в трассировщиках лучей.

> См. также:

>

>

>

> * «[Поля расстояний Raymarching-а: объяснение и реализация в Unity](https://habr.com/ru/post/503554/)»

> * «[Рендеринг в 3D-играх: введение](https://habr.com/ru/company/mailru/blog/500692/)»

> * «[Как работает рендеринг 3D-игр: текстурирование и фильтрация текстур](https://habr.com/ru/post/499540/)»

> | https://habr.com/ru/post/506742/ | null | ru | null |

# Работаем с текстами на Python: кодировки, нормализация, чистка

Зачем эта статья?

-----------------

Об обработке текстов на естественном языке сейчас знают все. Все хоть раз пробовали задавать вопрос Сири или Алисе, пользовались Grammarly (это не реклама), пробовали генераторы стихов, текстов... или просто вводили запрос в Google. Да, вот так просто. На самом деле Google понимает, что вы от него хотите, благодаря штукам, которые умеют обрабатывать и анализировать естественную речь в вашем запросе.

При анализе текста мы можем столкнуться с ситуациями, когда текст содержит специфические символы, которые необходимо проанализировать наравне с "простым текстом" (взять даже наши горячо любимые вставки на французском из "Война и мир") или формулы, например. В таком случае обработка текста может усложниться.

Вы можете заметить, что если ввести в поисковую строку запрос с символами с ударением (так называемый модифицирующий акут), к примеру "ó", поисковая система может показать результаты, содержащие слова из вашего запроса, символы с ударением уже выглядят как обычные символы.

Обратите внимание на следующий запрос:

Запрос содержит символ с модифицирующим акутом, однако во втором результате мы можем заметить, что выделено найденное слово из запроса, только вот оно не содержит вышеупомянутый символ, просто букву "о".

Конечно, уже есть много готовых инструментов, которые довольно неплохо справляются с обработкой текстов и могут делать разные крутые вещи, но я не об этом хочу вам поведать. Я не буду рассказывать про [nltk](https://www.nltk.org/), стемминг, лемматизацию и т.п. Я хочу опуститься на несколько ступенек ниже и обсудить некоторые тонкости кодировок, байтов, их обработки.

Откуда взялась статья?

----------------------

Одним из важных составляющих в области ИИ является обработка текстов на естественном языке. В процессе изучения данной тематики я начал задавать себе вопросы, которые в конечном итоге привели меня к изучению кодировок, представлению текстов в памяти, как они преобразуются, приводятся к нормальной форме. Я плохо понимал эту тему в начале, потребовалось немало времени и мозгового ресурса, чтобы понять, принять и запомнить некоторые вещи. Написанием данной статьи я хочу облегчить жизнь людям, которые столкнутся с необходимостью чтения и обработки текстов на Python и самому закрепить изученное. А некоторыми полезными поинтами своего изучения я постараюсь поделиться в данной статье.

**Важная ремарка: я не являюсь специалистом в области обработки текстов. Изложенный материал является результатом исключительно любительского изучения.**

Проблема чтения файлов

----------------------

Допустим, у нас есть файл с текстом. Нам нужно этот текст прочитать. Казалось бы, пиши себе такой вот скрипт для чтения из файла да и радуйся:

```

with open("some_text.txt", "r") as file:

content = file.read()

print(content)

```

В файле содержится вот такое вот изречение:

```

pitón

```

что переводится с испанского как питон. Однако консоль OC Windows 10 покажет нам немного другой результат:

```

C:\my\habr\TextsInPython> python .\script1.py

pitón

```

Сейчас мы разберёмся, что именно пошло не так и по какой причине.

Кодировка

---------

Думаю, это не будет сюрпризом, если я скажу, что любой символ, который заносится в память компьютера, хранится в виде числа, а не в виде литерала. Это число определяется как идентификатор или **кодовая позиция** символа. Кодировка определяет, какое именно число будет ассоциировано с символом.

Предположим, у нас есть некоторый файл с неизвестным содержимым, и нам нужно его прочитать, однако мы не знаем, какая у файла кодировка. Попробуем декодировать содержимое файла.

```

with open("simple_text.txt", "r") as file:

text = file.read()

print(text)

```

Посмотрим на результат:

```

C:\my\habr\TextsInPython> python .\script2.py

ÿþ<♦8♦@♦

```

Очень интересно, ничего непонятно. По умолчанию Python использует кодировку utf-8, но видимо запись в файл происходила не с её помощью. Здесь нам придёт на помощь дополнительный параметр функции open - параметр encoding, который позволяет указать конкретную кодировку, в которой следует прочитать файл (или записывать в него). Попробуем перебрать несколько кодировок и найти подходящую.

```

codecs = ["cp1252", "cp437", "utf-16be", "utf-16"]

for codec in codecs:

with open("simple_text.txt", "r", encoding=codec) as file:

text = file.read()

print(codec.rjust(12), "|", text)

```

Результат:

```

C:\my\habr\TextsInPython> python .\script3.py

cp1252 | ÿþ<8@

cp437 | ■<8@

utf-16be | 㰄㠄䀄

utf-16 | мир

```

Разные кодировки расшифровывают байты из файла по-разному, то есть разным кодовым позициям могут соотвествовать разные символы. Пример примитивный, несложно догадаться, что истинная кодировка файла - это utf-16.

**Важный поинт**: при записи и чтении из файлов следует указывать конкретную кодировку, это позволит избежать путаницы в дальнейшем.

Ошибки, связанные с кодировками

-------------------------------

При возникновении ошибки, связанной с кодировками, интерпретатор выдаст одно из следующих исключений:

* `UnicodeError`. Это общее исключение для ошибок кодировки.

* `UnicodeDecodeError`. Данное исключение возбуждается, если встречается кодовая позиция, которая отсутствует в кодировке.

* `UnicodeEncodeError`. А это исключение возбуждается, когда символ, который необходимо закодировать, незнаком для кодировки.

Попытка выполнения вот такого кода (в файле всё ещё содержится испанский питон):

```

with open("some_text.txt", "r", encoding="ascii") as file:

file.read()

```

даст нам следующий результат:

```

UnicodeDecodeError: 'ascii' codec can't decode byte 0xc3 in position 3: ordinal not in range(128)

```

Кодировка ASCII не поддерживает никакой алфавит, кроме английского. Поэтому декодирование символа "ó" вызывает у ASCII сложности. Однако Python всемогущ и есть механизм, который позволяет обработать ошибки кодировок. Это дополнительный параметр методов `encode` и `decode` - параметр `errors`. Он может принимать следующие значения:

Для обеих функций:

| | |

| --- | --- |

| **Обозначение** | **Суть** |

| `strict` | Значение по умолчанию. Несоотвествующие кодировке символы возбуждают исключения `UnicodeError` и наследуемые от него. |

| `ignore` | Несоответсвующие символы пропускаются без возбуждения исключений. |

Только для метода `encode`:

| Обозначение | Суть |

| --- | --- |

| `replace` | Несоотвествующие символы заменяются на символ `?` |

| `xmlcharrefreplace` | Несоответствующие символы заменяются на соответсвующие значения XML. |

| `backslashreplace` | Несоответствующие символы заменяются на определённые последовательности с обратным слэшем. |

| `namereplace` | Несоответствующие символы заменяются на имена этих символов, которые берутся из базы данных Unicode. |

Также отдельно выделены значения `surrogatepass` и `surrogateescape`.

Приведём пример использования таких обработчиков:

```

>>> text = "pitón"

>>> text.encode("ascii", errors="ignore")

b'pitn'

>>> text.encode("ascii", errors="replace")

b'pit?n'

>>> text.encode("ascii", errors="xmlcharrefreplace")

b'pitón'

>>> text.encode("ascii", errors="backslashreplace")

b'pit\\xf3n'

>>> text.encode("ascii", errors="namereplace")

b'pit\\N{LATIN SMALL LETTER O WITH ACUTE}n'

```

**Важный поинт**: если в текстах могут встретиться неожиданные для кодировки символы, во избежание возбуждения исключений можно использовать обработчики.

Cворачивание регистра

---------------------

Сворачивание регистра - это попытка унифицировать текст любого представления к канонической форме. Например, приведение всего текста в нижний регистр. Также над текстом производятся некоторые преобразования (например, немецкая «эсцет» - «ß» - преобразуется в «ss»). В Python 3.3 появился метод `str.casefold()`, который как раз выполняет сворачивание регистра. Если текст содержит только символы кодировки `latin1`, результат применения этого метода будет аналогичен методу `str.lower()`.

И по классике приведём пример:

```

>>> text = "Die größte Stadt der Welt liegt in China"

>>> text.casefold()

'die grösste stadt der welt liegt in china'

```

В результате применённый метод не только привёл весь текст к нижнему регистру, но и преобразовал специфический немецкий символ.

**Важный поинт**: привести текст можно не только методом `str.lower()`, но и методом `str.casefold()`, который может выполнить дополнительные преобразования текста.

Нормализация

------------

Нормализация - это полноценное приведение текста к единому представлению.

Чтобы обозначить важность нормализации, приведём простой пример:

```

letter1 = "µ"

letter2 = "μ"

```

Внешне два этих символа выглядят абсолютно одинаково. Однако если мы попытаемся вывести имена этих символов, как их видит интерпретатор Python'a, результат нас порядком удивит.

В Python есть отличный встроенный модуль, который содержит данные о символах Unicode, их имена, являются ли они цифрамии и т.п. (методы по типу `str.isdigit()` берут информацию из этих данных). Воспользуемся данным модулем, чтобы вывести имена символов, исходя из информации, которая содержится в базе данных Unicode.

```

import unicodedata

letter1 = "µ"

letter2 = "μ"

print(unicodedata.name(letter1))

print(unicodedata.name(letter2))

```

Результат выполнения данного кода:

```

C:\my\habr\TextsInPython> python .\script7.py

MICRO SIGN

GREEK SMALL LETTER MU

```

Итак, интерпретатор Python'a видит эти символы как два разных, но в стандарте Unicode они имеют одинаковое отображение.Такие символы называют **каноническими эквивалентами**. Приложения будут считать два этих символа одинаковыми, но не интерпретатор.

Посмотрим на ещё один пример:

```

>>> s1 = 'café'

>>> s2 = 'cafe\u0301'

>>> s1, s2

('café', 'café')

>>> s1 == s2

False

>>> len(s1), len(s2)

(4, 5)

```

Данные символы также будут являться каноническими эквивалентами. Из примера мы видим, что символ "é" в стандарте Unicodeможет быть представлен двумя способами, которые к тому же имеют разную длину. Символ "é" может быть представлен одним или двумя байтами.

Решением таких конфликтов занимается нормализация. Она реализована в Python в функции `unicodedata.normalize`.Первым аргумент является так называемая **форма нормализации** - нормализации строк Unicode, которые позволяют определить, эквивалентны ли какие-либо две строки Unicode друг другу. Всего предлагается четыре формы:

| Форма | Описание |

| --- | --- |

| Normalization Form D (NFD) | Canonical Decomposition |

| Normalization Form C (NFC) | Canonical Decomposition, следующая за Canonical Composition |

| Normalization Form KD (NFKD) | Compatibility Decomposition |

| Normalization Form KC (NFKC) | Compatibility Decomposition, следующая за Canonical Composition |

Разберём каждую форму немного подробнее.

* NFC

При указании данной формы нормализации происходит каноническая композиция (как, собственно, и гласит название) кодовых позиций с целью получения самой короткой эквивалентной строки.

```

>>> unicodedata.normalize("NFC", s1), unicodedata.normalize("NFC", s2)

('café', 'café')

>>> len(unicodedata.normalize("NFC", s1)), len(unicodedata.normalize("NFC", s2))

(4, 4)

>>> unicodedata.normalize("NFC", s1) == unicodedata.normalize("NFC", s2)

True

>>> len(unicodedata.normalize("NFC", s1)) == len(unicodedata.normalize("NFC", s2))

True

```

Итак, нормализация обеих строк внешне их не изменила, однако длина строки `s2` стала равной 4 (т.е. на один байт меньше). Была произведена композиция байтов `e\u0301`, которые являлись отображением "é". Данная последовательность была заменена на минимальное представление символа, т.е. теперь представление этого символа для интерпретатора выглядит как в строке `s1`. Как результат, мы видим, что длина нормализованных строк стала равной, и сами строки также стали равны.

* NFD

С этой формой ситуация аналогичная, только происходит декомпозиция байтов, т.е. разложение символа на несколько байт.

```

>>> unicodedata.normalize("NFD", s1), unicodedata.normalize("NFD", s2)

('café', 'café')

>>> len(unicodedata.normalize("NFD", s1)), len(unicodedata.normalize("NFD", s2))

(5, 5)

>>> unicodedata.normalize("NFD", s1) == unicodedata.normalize("NFD", s2)

True

>>> len(unicodedata.normalize("NFD", s1)) == len(unicodedata.normalize("NFD", s2))

True

```

Здесь мы видим, что длина строки `s1` увеличилась на один байт. Думаю, уже несложно догадаться, почему.

На данном этапе настал момент ввести понятие **символа совместимости**. Символы совместимости (compatibility characters) были введены в Unicode ради совместимости с другими стандартами, в частности, стандарты, которые предшествовали Unicode. Это означает, что некоторые символы могут встречаться в стандарте несколько раз. Мы уже могли наблюдать это явление в начале этого раздела на примере с символом "мю". Он считается символом совместимости.

* NFKC и NFKD

При данных формах нормализации символы совместимости заменяются на его более предпочтительное представление, что также называется совместимой декомпозицией. Однако при данных формах нормализации может быть потеряно форматирование.

Немного модифицируем наш пример из начала раздела. Выведем кодовые позиции символов до и после нормализации:

```

import unicodedata

letter1 = "µ"

letter2 = "μ"

print("Before normalizing:", ord(letter1), ord(letter2))

letter1 = unicodedata.normalize("NFKC", letter1)

letter2 = unicodedata.normalize("NFKC", letter2)

print("After normalizing:", ord(letter1), ord(letter2))

```

И результат выполнения кода:

```

Before normalizing: 181 956

After normalizing: 956 956

```

Итак, мы видим, что первый символ (который являлся знаком "микро") был заменён на греческую "мю", т.е. более предпочтительное представление символа. Таким образом, если необходимо, например, провести частотный анализ текста, формы нормализации, которые затрагивают символы совместимости, могут помочь с этим, приводя символы совместимости к единому представлению.

**Важный поинт**: нормализация может очень помочь для поиска валидных документов или индексирования текста. Если вы занимаетесь разработкой таких систем, не стоит сбрасывать алгоритмы нормализации со счетов.

### Дополнительные материалы: что использовалось в статье и что почитать по теме

**"Fluent Python", Лучано Ромальо**

В этой книге целая глава посвящена изучению строк, байтов и Unicode (**Глава 4. Тексты и байты**). Она есть на русском и английском языках, но в русском переводе допущено немало ошибок, так что открывайте русский вариант на свой страх и риск. Материал статьи в большей степени опирается на данную книгу. Некоторые примеры также взяты оттуда.

**Документация для Unicode на официальном сайте Python**

Куда ж без неё, родимой. Там тоже можно найти немало полезной информации, если вам понадобится работать с текстами и делать больше, чем просто считывание из файла. Хотя в некоторых случаях и на этом можно споткнуться.

**Unicode® Standard Annex**

Это части стандарта Unicode, которые выложены в открытый доступ в виде отдельных статей. Почитать их можно [вот здесь](https://unicode.org/reports/). | https://habr.com/ru/post/579868/ | null | ru | null |

# ChatGPT. Übermensch из мира A.I.?

Автор Канала "Теория Всего"December 17, 2022

--------------------------------------------

Когда запушил код и закоментил тестыВсем привет! Основной вопрос, который данная статья будет затрагивать является: "Стоит ли волноваться программистам за свои рабочие места в течений следующих лет из-за развития искусственного интеллекта?"

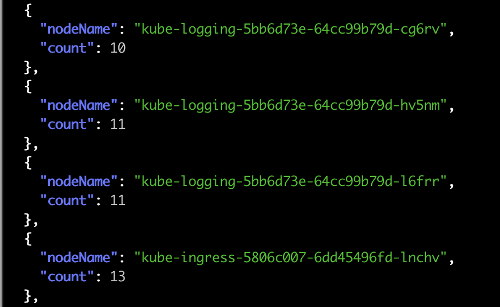

Думаю вы уже все наслышаны о всеми великом проекте под названием "ChatGPT". Для тех кто не в танке, **ChatGPT** - программа написанная компанией, которая принадлежит Илону Маску, основная особенность данного проекта заключается в довольно продвинутом искусственном интеллекте приложения. Самое интересно, что данный И.И. способен дать ответ практически на любой вопрос, который вы ему задаете, будь это "Что лучше PS5 или PC" или " В чем заключается смысл жизни?".

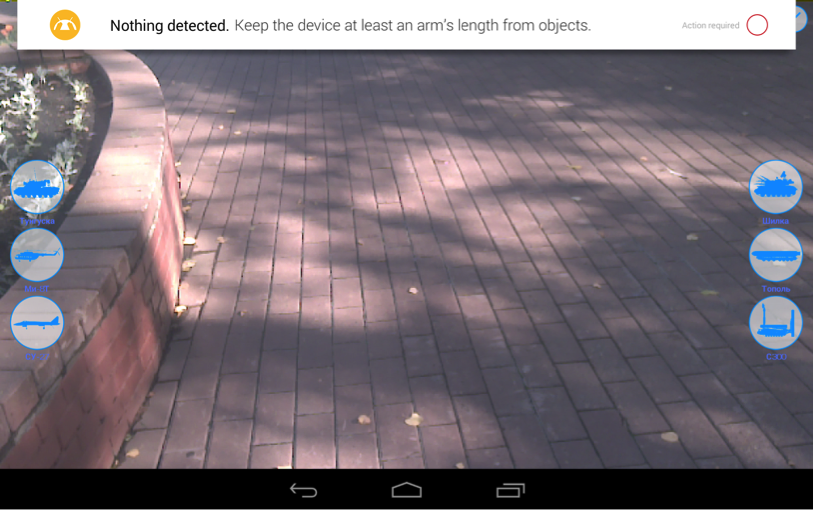

Для начала своего расследования, как истинный программист, я задал И.И. вопрос о лучшей парадигме программирования.

Джависты не в восторге, что ООП идет вторымВ принципе как и ожидалось, что скорее всего ChatGPT использует свою натренированную МЛку для NLP (<https://habr.com/ru/company/otus/blog/705482/>) и парсит открытие и главное индексируемые сайты для получения и обработки той или иной информации, которая будет задействована для дачи ответа собеседнику. Так же, ChatGPT не использует простую тактику copy+paste, а использует парафрейзинг для более понятного ответа.

Какой же вывод мы смогли вывести из самого первого и самого простого на мой взгляд вопроса нашему И.И.?

1. И.И. использует свою натренированную систему NLP

2. И.И. парсит и индексирует открытые источники

3. Пока что программист может не переживать за свою работу

Пойдемте дальше и начнем задавать более каверзные и сложные вопросы нашему новому другу/конкуренту ChatGPT. Все последующие вопросы у меня будут так или иначе взаимодейтсвовать с архитектурами приложении и имплементации тех или иных алгоритмов на языке Java.

#### Вопрос первый. Сделай простой "reverse" Линкед-Листа.

Опять таки, здесь все было крайне ожидаемо. Я сформулировал свой вопрос следующим образом:

1. Я старался писать вопрос максимально понятно и объективно, чтобы максимально сильно раскрыть потенциал И.И.

2. Я писал максимально сжатые вопросы, без лишних деталей

3. В конце всегда дописывал на каком языке я хочу получить имплементацию

На вопрос: "Reverse a linked list in Java" я получил следующий код:

```

public class LinkedList {

private static class Node {

int data;

Node next;

Node(int data) {

this.data = data;

}

}

private Node head;

public void addToFront(int data) {

Node newNode = new Node(data);

newNode.next = head;

head = newNode;

}

public void reverse() {

Node current = head;

Node previous = null;

Node next = null;

while (current != null) {

next = current.next;

current.next = previous;

previous = current;

current = next;

}

head = previous;

}

public void printList() {

Node current = head;

while (current != null) {

System.out.print(current.data + " ");

current = current.next;

}

System.out.println();

}

public static void main(String[] args) {

LinkedList list = new LinkedList();

list.addToFront(1);

list.addToFront(2);

list.addToFront(3);

list.addToFront(4);

list.printList(); // prints 4 3 2 1

list.reverse();

list.printList(); // prints 1 2 3 4

}

}

```

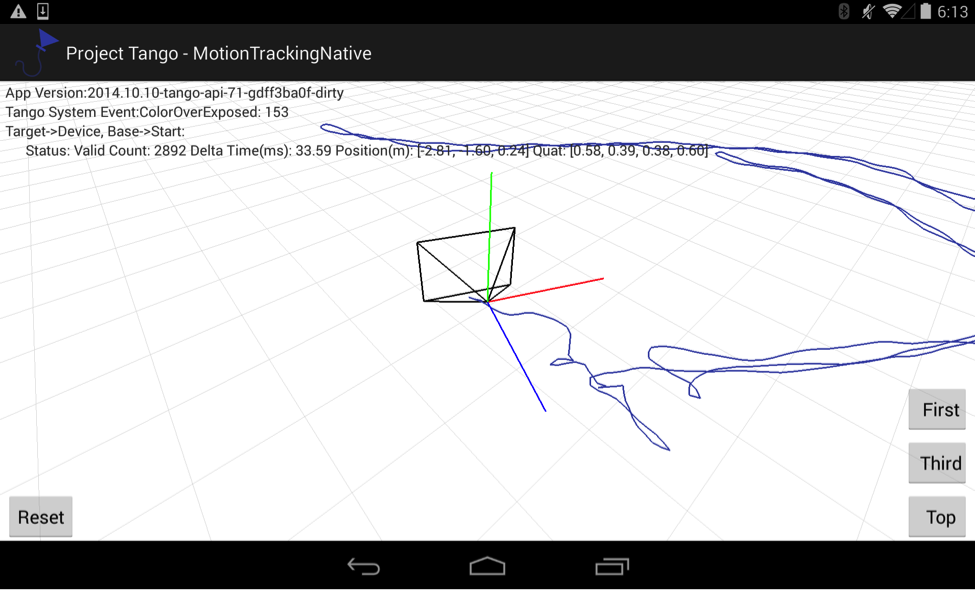

Честно говоря, опять таки ничего удивительного нет, И.И. просто парсит открытые источники и прошлые запросы от других пользователей и на базе данной инфы дает вам обобщенный ответ. На просторах индексируемых сайтов очень много похожей импленментации моего вопроса, что и вылилось в такой примитивный ответ, который является правильным! Помимо кода, ChatGPT очень грамотно расписывает функционал, что так же является большим плюсом и показателем хорошо натренированного И.И.

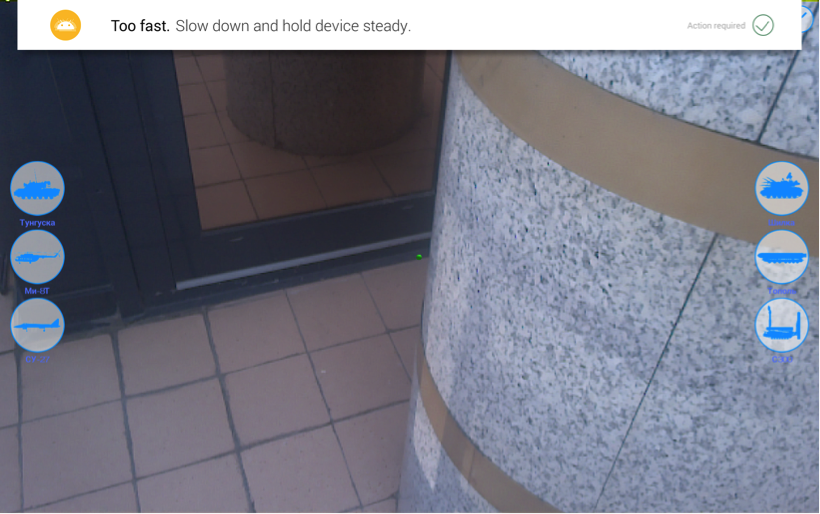

Идем дальше и начинаем мучать нашего друга еще сильнее. Теперь я задал, вопрос с подвохом: "Reverse a linked list in Java using only 1 function". На обработку данного запроса, программа потратила **27,12** секунд времени, так как запрос является крайне странным и информации о нем не так уж и много на просторах сети! Вот ответ, который я получил, я немного сжал его, не добавляя аналогичной импленментации классов из прошлого примера:

```

public Node reverse(Node current, Node previous) {

if (current == null) {

return previous;

}

Node next = current.next;

current.next = previous;

return reverse(next, current);

}

public void reverse() {

head = reverse(head, null);

}

```

Чисто технически, программа как бы реализовала мой запрос через 1 метод **void reverse()**, но это не совсем, что я имел ввиду! В первую очередь, я бы хотел увидеть имплементацию через Generic, но увидел типизацию до int, но это не является большой проблемой. Самое главное, я хотел увидеть только 1 метод, который будет отвечать за реверсивность связанного списка, чего я не получил, так же не забываем, что на обработку запроса ушло в районе 30 секунд, что довольно таки долго.

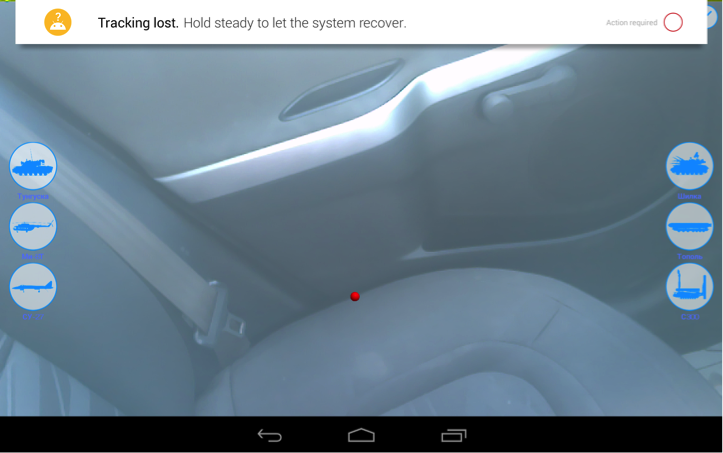

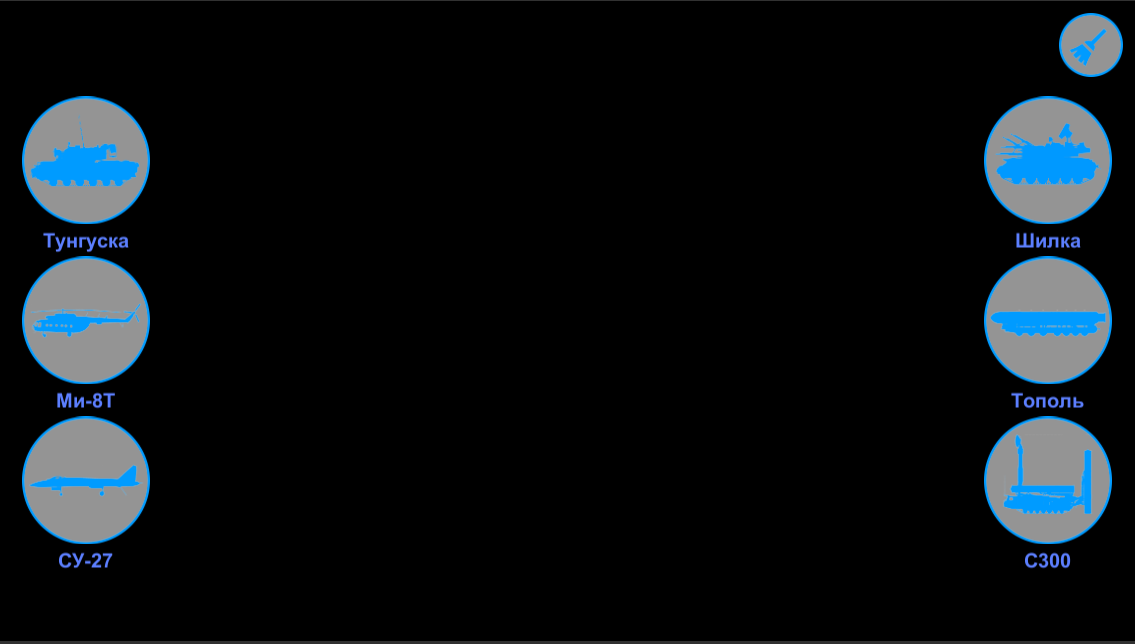

ChatGPT 3 век до н.э.Тут я уже начал, понимать, что весь страх, который нагоняют люди по поводу СhatGPT это просто абсурд и тупой инфо-повод! Чтобы доказать это я решил написать всего 1 запрос, который вам точно подтвердит, что вы не останетесь без работы еще как минимум лет 20-30, пока И.И. не смогут сами детально по расписанному запросу писать высоконагруженные системы.

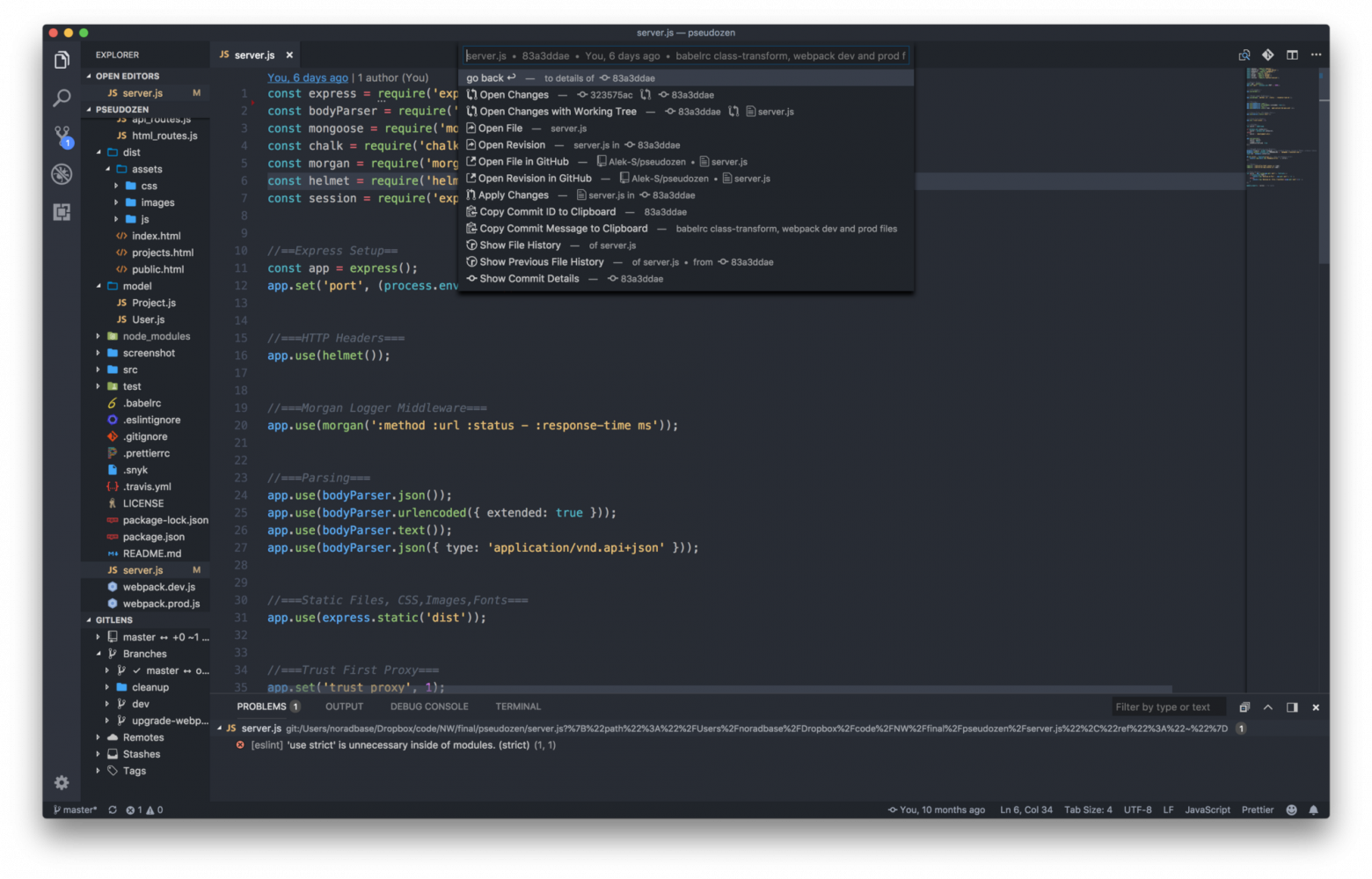

Вот он, убийца всех Solution ArchitectsКак мы видим, ChatGPT не может писать простые программы, которые имеют относительно сложную логику, которую нужно делегировать по разным файлам и средам. Самое интересное, что он попросту игнорирует все нужные Фреймворки. Ладно JavaScript, я могу принять использование простой HTML странички для получения файлов, но использование "Apache POI " для обработки запросов и чистого "JDBC" я понять не могу. Видимо вопрос абстрактно был слишком сложен для И.И., хоть я и указал, такое ключевое слово как: "Spring Boot Framework".

К какому выводу мы можем придти? Вы не потеряете работу из-за умного искусственного интеллекта. Пока что, данные МЛ-ки не умеют думать абстрактно и не могут так же хорошо использовать базу знаний, так же хорошо, как мы можем использовать наш рабочий опыт. Конечно, программа может описывать те или иные процессы используя общедоступную информацию из интернета, что вы можете сделать и сами, но менее быстро.

Всем спасибо за внимание и пользуйтесь оператором Kcell/Activ.

[Мой канал](https://t.me/the_binding_of_soul) | https://habr.com/ru/post/707502/ | null | ru | null |

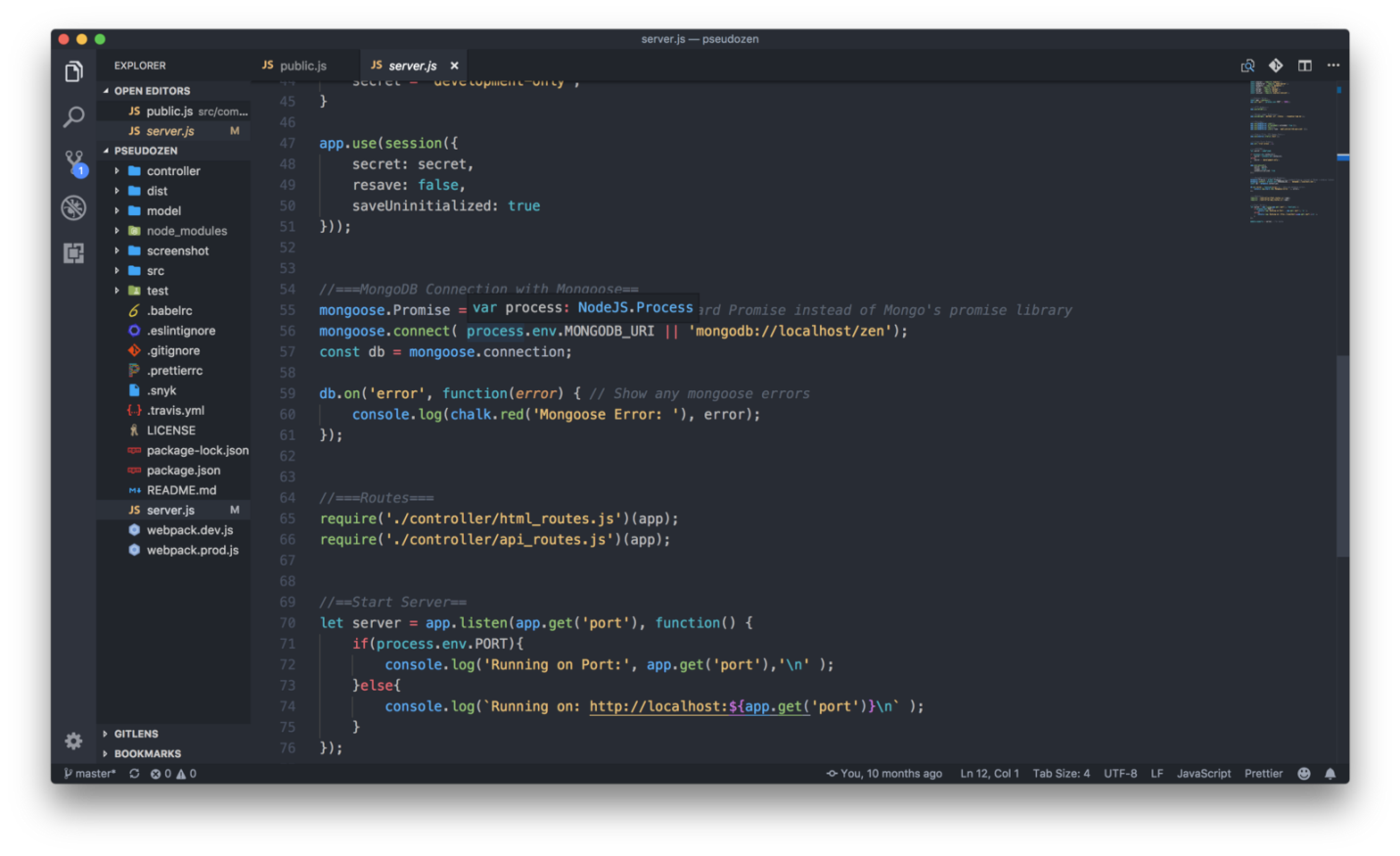

# Расширения для VS Code и программирование на JavaScript

Одно из важнейших условий для продуктивной работы веб-программиста — хорошо настроенный редактор кода. Один из них — [опенсорсный](https://github.com/Microsoft/vscode) универсальный редактор [Visual Studio Code](https://code.visualstudio.com/), который замечателен не только тем, что он бесплатен, но и тем, как много полезного он умеет сразу после установки и минимальной настройки. Если речь идёт о том, чтобы использовать VS Code в какой-то конкретной сфере, вроде разработки на JavaScript, обычно стоит дополнить его несколькими расширениями, которые повышают производительность труда и упрощают жизнь программиста. Вокруг VS Code сложилось активное сообщество разработчиков [расширений](https://marketplace.visualstudio.com/VSCode). Эти расширения легко искать и ещё легче устанавливать.

[](https://habr.com/company/ruvds/blog/354960/)

В материале, перевод которого мы сегодня публикуем, речь пойдёт о расширениях для VS Code, которые пригодятся тем, кто пишет на JS. Тут стоит отметить, что в деле выбора расширений для VS Code немалую роль играют личные предпочтения программиста. В результате можно сказать, что расширения, о которых пойдёт здесь речь, не являются абсолютно необходимыми. Не стоит рассматривать их как нечто, что обязательно нужно устанавливать и использовать. Обзавестись тем или иным расширением стоит лишь в том случае, если вам оно понравилось, и вы полагаете, что вам оно точно пригодится.

Расширения, которые обязательно стоит попробовать

-------------------------------------------------

В этом разделе мы поговорим о расширениях для VS Code, которые настолько хороши, что разработчикам редактора стоило бы встроить их в него.

### ▍ESLint — линтер

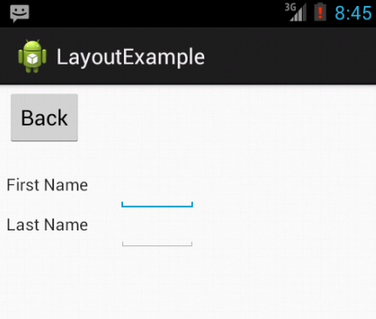

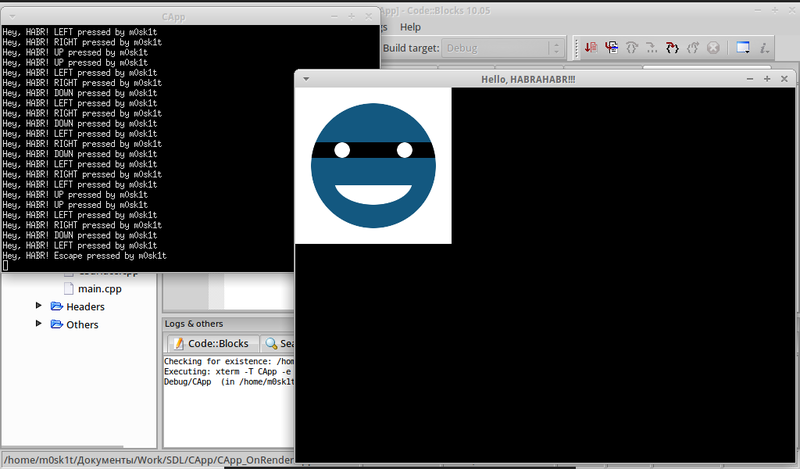

[ESLint](https://eslint.org/) — это JavaScript-линтер, который чрезвычайно широко используется и поддаётся тонкой настройке. В частности, его можно [сконфигурировать](https://eslint.org/docs/user-guide/configuring) для поддержки большинства широко используемых фреймворков и стилей программирования. Реализация ESLint для VS Code не требует ручного запуска проверок. Вместо этого сообщения об ошибках выводятся прямо в редакторе, там же предлагаются и средства, которые позволяют быстро исправлять ошибки.

*Применение ESLint в VS Code*

Возможно, сейчас вы подумаете о том, что ESLint в VS Code — это, возможно, излишество, так как там уже имеется встроенная система [IntelliSense](https://code.visualstudio.com/docs/editor/intellisense), которая выдаёт отличные подсказки в ходе работы. IntelliSense, и правда, замечательно делает своё дело, но как быть, если не все в вашем проекте используют VS Code? А что делать, если вам нужны разные настройки, скажем — для JSX, для некоей конкретной версии чистого JS, который планируется выполнять в браузере, для среды Node.js, которая используется на сервере? Во всех этих случаях можно воспользоваться ESLint. Кроме того, ESLint можно встроить в систему проверки кода для запуска его перед [отправкой материалов в репозиторий](https://github.com/okonet/lint-staged), для того, чтобы лишний раз убедиться в том, что все, кто коммитят в репозиторий, придерживаются единого стиля кодирования.

### ▍GitLens — работа с Git

VS Code, сразу после установки, содержит средства для работы с Git, поэтому расширение GitLens, о котором мы сейчас поговорим, относится больше к улучшению имеющихся возможностей редактора, чем к добавлению в него чего-то принципиально нового. На самом деле, существует множество подобных расширений, предназначенных для работы с Git.

*Использование GitLens в VS Code*

Однако, GitLens выгодно отличается от других похожих инструментов большим и активным сообществом, а также широчайшими возможностями [настройки](https://github.com/eamodio/vscode-gitlens/#gitlens-settings). Это, в частности, позволяет влиять на объём справочных данных, присутствующих редакторе. Скажем, фрагменты кода можно сравнивать, развернув пару панелей так, что они займут всё пространство окна, а, при необходимости, можно ограничиться небольшой подсказкой, выводимой в строке состояния.

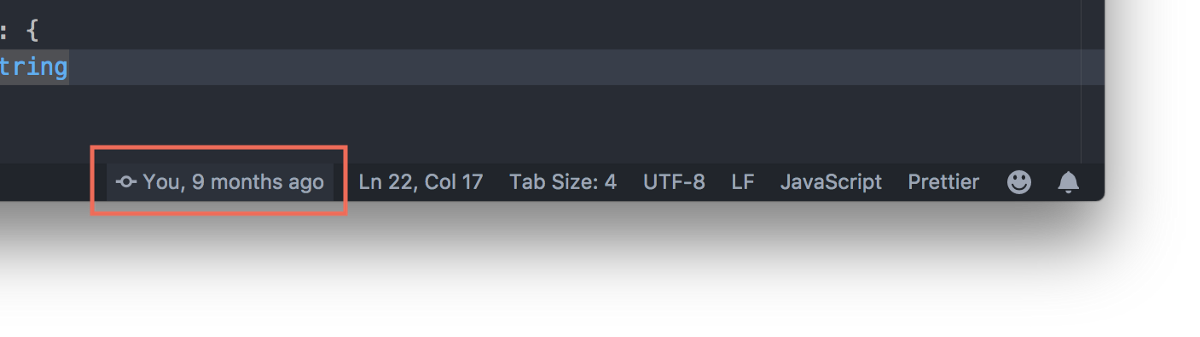

*Краткие сведения о коде, выводимые GitLens*

Расширение GitLens особенно полезно при работе над большими проектами, когда разработчик не может точно знать о том, кто именно написал тот или иной фрагмент кода. Благодаря GitLens сведения об авторе конкретной строки выводятся в строке состояния VS Code. В результате, если у программиста возникает вопрос о том, почему или как что-то сделано, он может обратиться непосредственно к тому, кто написал интересующий его код, что упрощает общение в команде.

Тут я хочу дать одну рекомендацию, которая заключается в добавлении следующей строки в настройки VS Code.

```

"gitlens.currentLine.enabled": false

```

Она позволяет убрать построчное аннотирование кода, которое может мешать работе, рассеивая внимание на излишние подробности.

### ▍TODO Highlight — подсветка важных комментариев

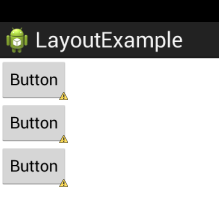

Комментарии к коду обычно не особенно бросаются в глаза, поэтому мы нередко не обращаем на них особого внимания. В целом — это хорошо, так как они не отвлекают от работы, однако, иногда комментарии весьма важны, поэтому их хорошо было бы сделать более заметными, чтобы гарантировать их прочтение, и то, что тот, для кого они предназначены, отреагирует на них. Такие комментарии, например, программист может писать сам для себя — чтобы напомнить себе, где он остановился. Пишут их и для других разработчиков.

*Расширение TODO Highlight в VS Code*

Благодаря расширению [TODO Highlight](https://marketplace.visualstudio.com/items?itemName=wayou.vscode-todo-highlight), если в комментарии содержится слово `TODO` или `FIXME`, оно будет автоматически выделено, что точно не даст такой комментарий пропустить. Это очень удобно.

### ▍Import Cost — сведения о размере импортируемых модулей

[Import Cost](https://marketplace.visualstudio.com/items?itemName=wix.vscode-import-cost) — отличный плагин, который подойдёт тем программистам, которые склонны к самоистязанию. Всякий раз, когда вы импортируете в свой проект очередной модуль, Import Cost сообщает вам о его размере.

*Использование расширения Import Cost в VS Code*

В результате вам постоянно приходится спрашивать себя о том, стоит ли та польза, которую вы собираетесь извлечь из модуля, увеличения размера проекта. В общем-то, такие вопросы, хотя и заставляют иногда помучиться, благотворно сказываются на результатах работы.

Полезные расширения, которые могут пригодиться

----------------------------------------------

В этом разделе мы поговорим о полезных расширениях, без которых вполне можно обойтись. Однако они облегчают жизнь программиста, поэтому, вполне возможно, что вам они пригодятся.

### ▍Prettier — средство для форматирования кода

Расширение Prettier родственно вышерассмотренному ESLint в том плане, что его целью является обеспечение применения стандартизированного стиля кодирования. Благодаря Prettier код можно форматировать прямо в редакторе. Фундаментальная разница между Prettier и ESLint заключается в том, что вместо того, чтобы выводить сведения об ошибках, как это делает ESLint (хотя в ESLint есть и [параметр](https://eslint.org/docs/user-guide/command-line-interface#options) `--fix`), Prettier даёт программисту переформатированный вариант кода, выглядящего так, как он должен выглядеть в соответствии с заданными правилами. Он отлично показывает себя и при подготовке кода к [отправке в репозиторий](https://github.com/okonet/lint-staged), так как способен автоматически переформатировать код и привести его к требуемому стилю перед каждым выполнением команды `git commit`.

Стоит отметить, что Prettier, в основном, нацелен на форматирование кода, поэтому его использование не делает ненужным применение [линтера](https://prettier.io/docs/en/comparison.html), ответственного за качество программы. В дополнение к этому, Prettier можно [интегрировать](https://prettier.io/docs/en/eslint.html) в ESLint, что позволяет, например, автоматически запускать Prettier средствами ESLint. Prettier поставляется со встроенным набором правил, однако, если ваше представление о стиле кода отличается от того, которое выражено в правилах Prettier, их вполне можно [настроить](https://prettier.io/docs/en/options.html).

### ▍Быстрое открытие страниц в браузере — расширение open in browser

Иногда, при работе над неким проектом, для просмотра страниц которого не требуется процесс сборки, может понадобиться открыть в браузере обычный HTML-файл. Раньше так делали постоянно, теперь всё иначе, но порой это может оказаться очень кстати.

*Работа с расширением open in browser в VS Code*

В подобных редких случаях вам пригодится расширение [open in browser](https://marketplace.visualstudio.com/items?itemName=techer.open-in-browser), благодаря которому, через контекстное меню, можно открыть страницу в браузере, заданном по умолчанию, или в каком-нибудь другом браузере, установленном в системе. В результате вам больше не придётся возиться с консолью для того, чтобы открыть единственный файл в браузере.

### ▍Расширение для React-разработчиков vscode-styled-components

Ранее мы рассматривали расширения, которые могут оказаться полезными для всех, кто пишет на JS. Теперь поговорим о [vscode-styled-components](https://marketplace.visualstudio.com/items?itemName=jpoissonnier.vscode-styled-components). Это расширение имеет достаточно узкую область применения, а именно, оно предназначено для тех, кто пользуется библиотекой [styled-components](https://www.styled-components.com/) в React.

*Работа с расширением vscode-styled-components в VS Code*

Так как при работе с библиотекой styled-components используются тегированные шаблонные строки, многие средства для подсветки синтаксиса будут воспринимать соответствующие блоки кода как единое целое. Благодаря рассматриваемому расширению код будет воспринят правильно, а внутри шаблона можно будет легко различать его составные части.

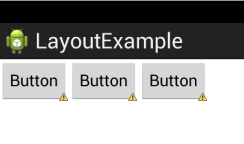

### ▍Расширение VSCode Great Icons — иконки для редактора

Пожалуй, говоря о расширении [VSCode Great Icons](https://marketplace.visualstudio.com/items?itemName=emmanuelbeziat.vscode-great-icons), достаточно сказать, что оно позволяет добавить в редактор более сотни отличных иконок для файлов.

*Расширение VSCode Great Icons*

### ▍Расширение Bookmarks — закладки

Код, в идеале, всегда является модульным, хорошо читаемым и достаточно кратким, что ведёт к тому, что проблем с просмотром файлов с текстами программ возникать не должно. Если же случится так, что некий файл окажется настолько большим, что в нём будет трудно ориентироваться, с помощью расширения [Bookmarks](https://marketplace.visualstudio.com/items?itemName=alefragnani.Bookmarks) его можно разбить на логические части, по которым удобно перемещаться.

*Работа с расширением Bookmarks*

### ▍Тема One Monokai

У меня есть рабочая теория, которая заключается в том, что непривлекательный внешний вид, скажем, окна редактора кода, ведёт к переутомлению глаз. Я дописываю научную работу, посвящённую этому вопросу.

*Тема One Monokai*

Стандартная тема оформления VS Code, на самом деле, не так уж и плоха. Однако, если код приложения, на который вы смотрите целый день, без особых трудностей можно сделать хотя бы немного симпатичнее, стоит этой возможностью воспользоваться. Конечно, существует огромное количество дополнительных тем для VS Code, но [One Monokai](https://marketplace.visualstudio.com/items?itemName=azemoh.one-monokai) — это как раз та, которая лично мне очень и очень понравилась. Безусловно, подобные вещи очень субъективны, нельзя говорить о том, что она понравится всем или хотя бы очень многим, но вы вполне можете поискать среди тем для VS Code ту, которая подойдёт именно вам.

Итоги

-----

В этом материале мы рассмотрели десять расширений для VS Code. Надеемся, вы найдёте среди них что-нибудь такое, что вам пригодится.

**Уважаемые читатели!** Пользуетесь ли вы VS Code? Если да — просим вас рассказать о том, какие расширения для этого редактора кажутся вам самыми полезными.

[](https://ruvds.com/ru-rub/#order) | https://habr.com/ru/post/354960/ | null | ru | null |

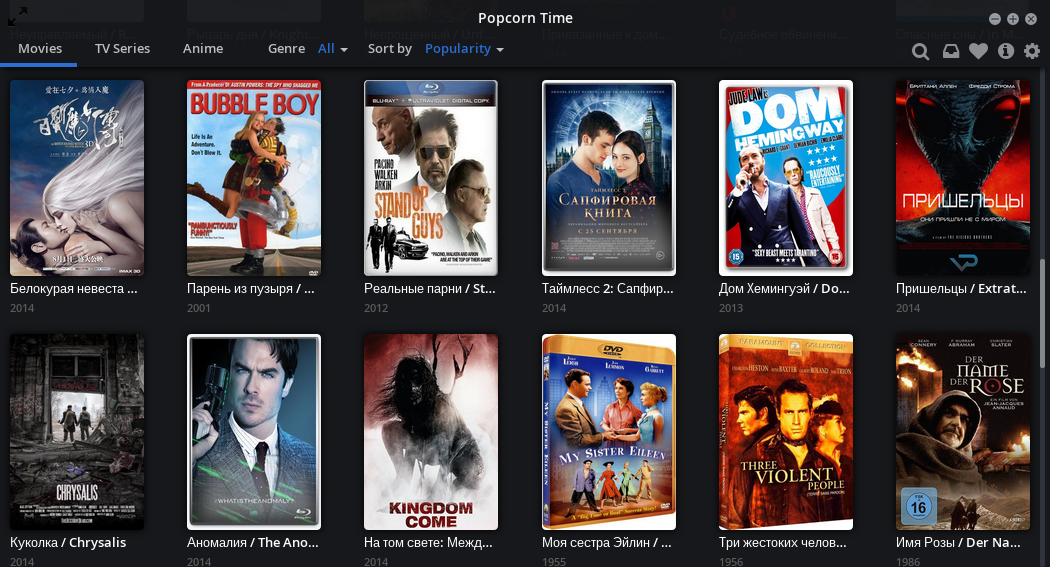

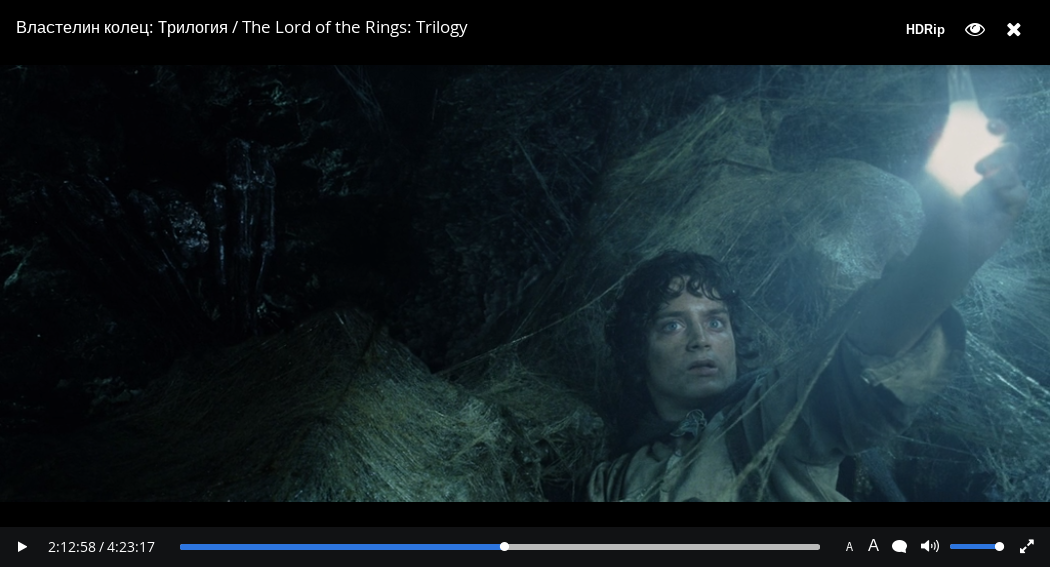

# Popcorn Time на русском

На Хабре не раз уже рассматривался Popcorn Time ([тут](http://habrahabr.ru/post/215429/), [тут](http://habrahabr.ru/post/220093/), [тут](http://habrahabr.ru/post/215927/) и [тут](http://habrahabr.ru/post/229677/)).

У этого проекта есть один небольшой недостаток. Фильмов в русской озвучке там нет. Я попробовал решить эту проблему.

На самом деле, всё это громко сказано, функционал реализован базово, прошу это воспринимать не более чем *proof of concept*. За пару вечеров накидал небольшой парсер одного достаточно популярного торрент трекера с выгрузкой данных в базу и далее выдачу в виде понятного для Popcorn Time [API](https://yts.re/api).

В техническом плане ничего интересного: nginx, Node.js, Express, MongoDB(Mongoose). Пожалуй, самое интересное, о чем можно рассказать, это преобразование торрент файла в [magnet ссылку](https://ru.wikipedia.org/wiki/Magnet-%D1%81%D1%81%D1%8B%D0%BB%D0%BA%D0%B0), но даже это при использовании пакета bencode становится очень простым:

```

var metadata = bencode.decode(body),

sha1 = crypto.createHash('sha1');

sha1.update(bencode.encode(metadata.info));

film['hash'] = sha1.digest('hex');

film['magnet'] = 'magnet:?xt=urn:btih:' + film['hash'] + '&dn=' + metadata.info.name;

```

Всё это запушено и работает. Опробовать можно 2-мя способами.

1. Скачать собранный мной Popcorn Time. К сожалению, только [Linux 64 bit](https://yadi.sk/d/9qpF0IezcRFyC), спасибо [koot](https://habrahabr.ru/users/koot/) [Mac](http://rghost.ru/58851139).

2. Скачать Popcorn Time с [git](https://git.popcorntime.io/stash/projects/PT/repos/popcorn-app/browse), в коде сделать изменения (под спойлером ниже) и собрать проект, как написано [тут](https://git.popcorntime.io/stash/projects/PT/repos/popcorn-app/browse).

**diff**

```

diff --git a/src/app/lib/models/movie_collection.js b/src/app/lib/models/movie_collection.js

index bb73eaa..58f40e1 100644

--- a/src/app/lib/models/movie_collection.js

+++ b/src/app/lib/models/movie_collection.js

@@ -11,7 +11,7 @@

return {

torrents: App.Config.getProvider('movie'),

subtitle: App.Config.getProvider('subtitle'),

- metadata: App.Trakt

+ metadata: null

};

}

});

diff --git a/src/app/settings.js b/src/app/settings.js

index 291c07c..06fd21e 100644

--- a/src/app/settings.js

+++ b/src/app/settings.js

@@ -66,8 +66,8 @@ Settings.deleteTmpOnClose = true;

Settings.updateApiEndpoint = 'http://popcorntime.io/';

/* TODO: Buy SSL for main domain + buy domain get-popcorn.re for fallback

Settings.updateApiEndpointMirror = 'https://popcorntime.cc/'; */

-Settings.yifyApiEndpoint = 'http://yts.re/api/';

-Settings.yifyApiEndpointMirror = 'http://yts.im/api/';

+Settings.yifyApiEndpoint = 'http://yts.lafin.me/api/';

+Settings.yifyApiEndpointMirror = 'http://yts.lafin.me/api/';

Settings.connectionCheckUrl = 'http://google.com/';

// App Settings

```

Исходники backend части <http://github.com/lafin/ru-yts>

На этом, пожалуй, всё. Хорошего просмотра.

P.S. Надеюсь, кто-нибудь продолжит идею.

Up. Добавил фильтр по жанрам и сортировку по году и алфавиту. | https://habr.com/ru/post/241551/ | null | ru | null |

# Методика определения режима шифрования Wi-Fi на iOS 5.*

Приветствую, коллеги!

Многие из Вас, кто разрабатывает приложения под мобильные платформы на iOS, сталкивались с проблемой недоступности многих ключевых данных.

Одним из таких параметров является текущий режим шифрования в Wi-Fi сети.

Так как этот параметр явно можно получить только «нелегальным» способом через Private Framework, считается что узнать его стандартными методами невозможно.

Это не так. Я хочу продемонстрировать вам workaround, работающий на **iOS 5** (*но закрытый, увы, на iOS6*).

Реальностью является то, что программно этот параметр действительно получить нельзя. Но он довольно просто получается по «вторичным половым признакам».

Конечно же, вы обращали внимание на то, что в логах вашего устройства протоколируется момент подключения к сети сообщениями подобного вида:

```

Oct 5 11:37:58 ISOX-iPhone kernel[0] : 023881.292007 wlan.N[2599] AppleBCMWLAN Joined BSS: @ 0x80eb1400, BSSID = some\_mac\_address, rssi = -30, rate = 54 (100%), channel = 3, encryption = 0x8, ap = 1, failures = 0, age = 0, ssid[ 6] = "pretty\_ssid"

```

Как вы можете видеть, это сообщение [ASL](https://developer.apple.com/library/mac/#documentation/Darwin/Reference/Manpages/man3/asl.3.html), отправленное «kernel» с уровнем «debug». В нем присутствует необходимый параметр «encryption», который определяет текущий режим шифрования.

Соответственно, нашей задачей является получение этого сообщения и обработка внутри программы легальными методами.

Для этого нам потребуется поработать с ASL системой iOS (не забудьте про **#import** ).

```

aslmsg asl, message;

aslresponse searchResult;

int i;

const char *key, *val;

NSMutableArray *result_dicts = [NSMutableArray array];

// Создаем подключение к ASL

asl = asl_new(ASL_TYPE_QUERY);

if (!asl)

{

NSLog(@"Failed creating ASL query");

}

// Задаем фильтр поиска по отправителю

asl_set_query(asl, "Sender", "kernel", ASL_QUERY_OP_EQUAL);

// Задаем фильтр поиска по подстроке

asl_set_query(asl, "Message", "AppleBCMWLAN Joined BSS:", ASL_QUERY_OP_PREFIX|ASL_QUERY_OP_EQUAL);

searchResult = asl_search(NULL, asl);

while (NULL != (message = aslresponse_next(searchResult)))

{

NSMutableDictionary *tmpDict = [NSMutableDictionary dictionary];

for (i = 0; (NULL != (key = asl_key(message, i))); i++)

{

NSString *keyString = [NSString stringWithUTF8String:(char *)key];

val = asl_get(message, key);

NSString *string = [NSString stringWithUTF8String:val];

[tmpDict setObject:string forKey:keyString];

}

// Собираем все результаты

[result_dicts addObject:tmpDict];

}

aslresponse_free(searchResult);

asl_free(asl);

```

В результаты вы получите массив словарей вида:

```

{

ASLMessageID = 723;

Facility = kern;

Level = 7;

Message = "AppleBCMWLAN Joined BSS: @ 0xc1985200, BSSID = some_mac_address, rssi = -42, rate = 54 (100%), channel = 3, encryption = 0x8, ap = 1, failures = 0, age = 1, ssid[ 6] = \"pretty_ssid\"";

PID = 0;

Sender = kernel;

Time = 1349423438;

}

```

Последнее сообщение, отсортированное по параметру «Time», будет являться верным.

Проблема решена: у вас есть значение текущего режима шифрования. Получить ее из строки Message не составит труда.

Следующий закономерный вопрос, — что оно означает?

Для этого потребовалось произвести небольшой поиск по исходным кодам драйверов Wi-Fi устройств.

Расшифровка значений следующая (при переводе значения в десятичную систему исчисления):

```

case 0: "None"

case 1: "WEP"

case 2: "WPA"

case 4: "WPA PSK"

case 6: "WPA2"

case 8: "WPA2 PSK"

case 10: "LEAP"

case 12: "80211X"

case 14: "WPS"

```

Задача решена, — получено значение шифования сети без использования Private Framework.

Конечно же, не обходится без минусов: время жизни сообщений довольно мало и требуется постоянное наблюдение над ASL.

К сожалению, Apple закрыла доступ к лог-сообщениям ядра на 6-й прошивке. Что же, — придется искать новый способ.

Спасибо за внимание. Надеюсь, я рассказал Вам что-то интересное. | https://habr.com/ru/post/153699/ | null | ru | null |

# Telegram бот с языковой моделью, обученной на 2ch

Если вам хочется разбавить общение в *telegram* чате нелепыми, но зачастую меткими и смешными комментариями, или вы ищете информацию по интеграции языковой модели в бота, или хотите сами обучить языковые модели на данных с *2ch*, то в этой статье описаны шаги, как это сделать.

Бот

---

Запустил [бота](https://t.me/toxic_ebanko_bot), которого можно добавлять в чаты, и он будет отвечать на сообщения, как на посты на ***2ch.hk/b/***.

Для этого:

* Был собран [датасет](https://huggingface.co/datasets/BlackSamorez/2ch_b_dialogues) постов с ***2ch***

* Была обучена [диалоговая модель](https://huggingface.co/BlackSamorez/rudialogpt3_medium_based_on_gpt2_2ch) на базе ***GPT-2***

* Был поднят [простой сервер](https://github.com/BlackSamorez/ebanko/tree/main/app) с **Python Telegram API**

Подробнее по порядку:

Обучение

--------

#### Hugging Face

Самый простой способ обучить языковую модель - воспользоваться библиотекой [transformers](https://huggingface.co). Она предоставляет инструменты для автоматизированного обучения и применения нейронных сетей (в том числе языковых моделей).

Также в их архивах можно найти множество предобученных моделей и датасетов, что заметно упрощает обучение, потому что обучать модель с нуля - затратно, а дообучать - намного проще.

#### Базовая модель

Возьмем диалоговую модель из [списка готовых моделей](https://huggingface.co/models). Модели делятся по языкам и задачам, и так уж вышло, что русскоязычных моделей есть ровно одна. Языковые модели, конечно, универсальные штуки, и сделать диалоговую модель можно и не из диалоговой, но чем ближе область предобученной модели к целевой, тем лучше.

Выбрана была модель [Grossmend/rudialogpt3\_medium\_based\_on\_gpt2](https://huggingface.co/Grossmend/rudialogpt3_medium_based_on_gpt2) из-за ее размера. **1.3B параметров** - размер, при котором модель может генерировать осмысленные тексты, но не слишком большая.

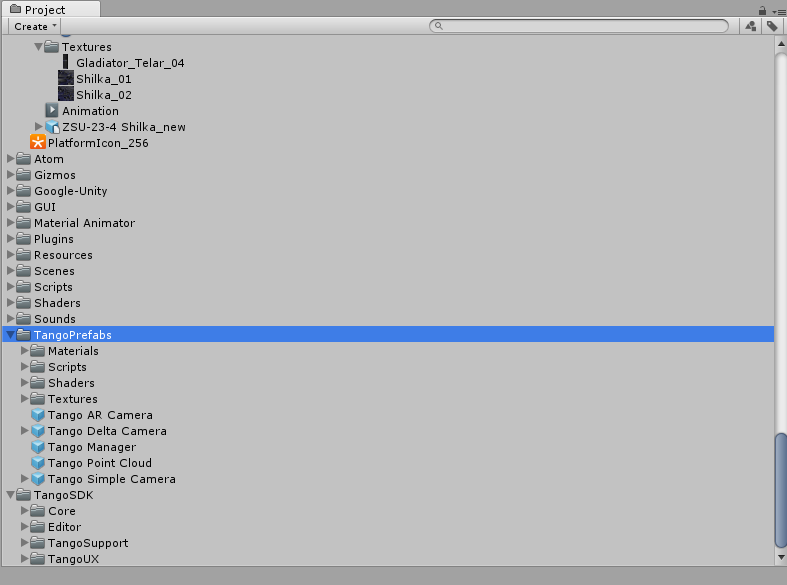

#### Данные

Для обучения модели были собраны данные с 2ch.hk/b/. Я долго искал готовый датасет, но не нашел ничего подходящего, и решил собрать данные сам. Для сбора данных использовалось [api2ch](https://pypi.org/project/api2ch/). Треды загружались, парсились, чистились и преобразовались к формату диалога.

Итоговый датасет насчитывал порядка **60к** **диалогов средней длины 3** - достаточно для дообучения модели среднего размера.

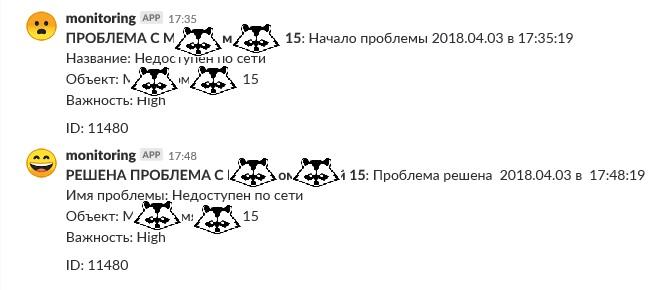

Пример диалога (сообщения от последнего к первому):

```

{

"dialogue": ["Рад слышать!", "Хорошо!", "Как дела?"]

}

```

Код для сбора и чистки данных можно найти на [GitHub](https://github.com/BlackSamorez/ebanko/blob/main/datamine/collect.py). Датасет можно найти на [HuggingFace](https://huggingface.co/datasets/BlackSamorez/2ch_b_dialogues).

#### Фильтрация данных

Для повышения токсичности данных данные были отфильтрованы с помощью модели классификатора [sismetanin/rubert-toxic-pikabu-2ch](https://huggingface.co/sismetanin/rubert-toxic-pikabu-2ch). Модель была создана для модерации токсичного контента, но никто не мешает использовать ее во зло.

Токсичность данных:

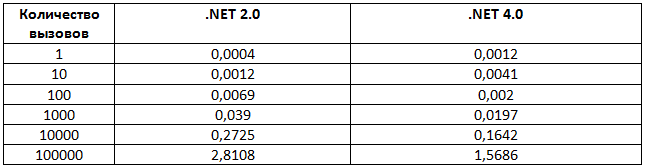

| | |

| --- | --- |

| count | 63187.000000 |

| mean | 0.675554 |

| 25% | 0.487243 |

| 50% | 0.721271 |

| 75% | 0.928254 |

Был взят 75% percentile токсичности, что соответствует **0.93/1.00** по шкале токсичности.

#### Процесс обучения и результат

***Jupiter Notebook***скодом обучения можно найти на [GitHub](https://github.com/BlackSamorez/ebanko/blob/main/experiments/2ch_training.ipynb).

**Готовую модель** можно найти на [HuggingFace](https://huggingface.co/BlackSamorez/rudialogpt3_medium_based_on_gpt2_2ch)

Пример ответа модели ***до дообучения***:

> Привет!

>

> Привет!

>

>

И **после**:

> Привет!

>

> >всё что ты можешь сделать - это не быть долбо...

>

>

Обучение прошло успешно.

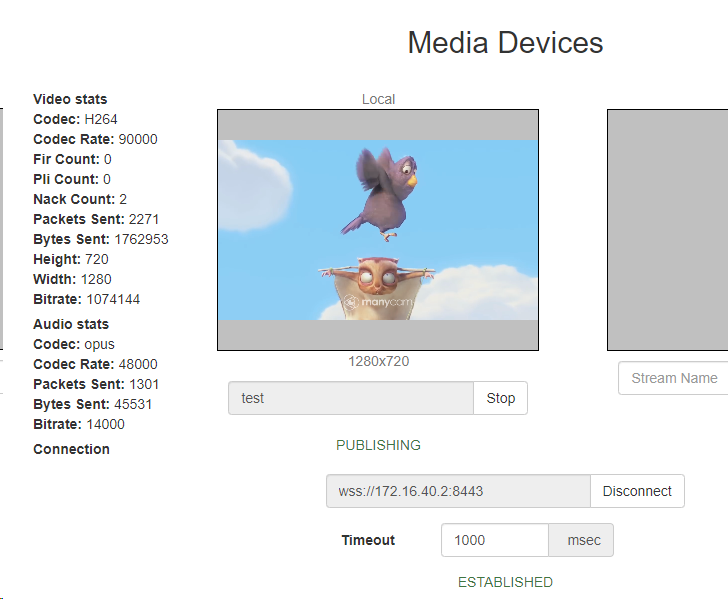

### Поднятие модели и подключение к боту

#### API

[Был написан](https://github.com/BlackSamorez/ebanko/blob/main/app/app/server.py) простейший сервер на ***Flask*** для работы с моделью.

```

POST request: {"text": "Привет!"}

Response: {"toxified": "Пока!"}

```

У *HuggingFace* отличная [документация](https://huggingface.co/docs), и подробности про запуск моделей стоит искать там.

Сама модель запускается на **CPU** с многопоточностью *PyTorch*. Так что я посчитал, что не будет целесообразным строить *API* с очередями и исполнителями. Модель запускается на **CPU** и можно было бы получить серьезное ускорение за счет [*скриптинга*](https://pytorch.org/docs/stable/jit.html) модели, но я не смог совместить *скриптинг* с [инструментами генерации](https://huggingface.co/docs/transformers/main/en/internal/generation_utils#generate-outputs) *HuggingFace*, так что от *скриптинга* пришлось отказаться.

#### Метрики

Для красоты настроен сбор метрик и [**grafana**](https://grafana.com)**.**

#### Python Telegram API

Про него уже написаны хорошие подробные посты ([например](https://habr.com/ru/post/543676/)).

Скажу лишь, что оно может работать [асинхронно](https://habr.com/ru/company/kts/blog/598575/), и во время ожидания ответа от модели программа может обрабатывать другие запросы.

### Код

Весь код сбора данных, обучения модели и бота выложен в открытый доступ на [GitHub](https://github.com/BlackSamorez/ebanko). Для простоты использования настроено поднятие бота с помощью **docker-compose**. | https://habr.com/ru/post/670970/ | null | ru | null |

# Delphi: самый быстрый DataSet (TJvMemoryData, TMemTableEh, TdxMemData, TkbmMemTable)

В этой статье я проведу сравнительный анализ DataSet'ов, которые держат данные в оперативной памяти.

Список DataSet'ов

-----------------

1. **TJvMemoryData**

Разработчик: сообщество JEDI Visual Component Library (JCL + JVCL)

JCL (версия 2.8)

JVCL (версия 3.50)

→ [Официальный сайт](http://jvcl.delphi-jedi.org)

2. **TMemTableEh**

Разработчик: EhLib

Версия: 9.0.040

→ [Официальный сайт](http://www.ehlib.com)

3. **TdxMemData**

Разработчик: DevExpress

Версия: 15.2.2

→ [Официальный сайт](https://www.devexpress.com)

4. **TkbmMemTable**

Разработчки: Components4Developers

Версия: 7.74.00 Professional Edition

→ [Официальный сайт](http://www.components4developers.com)

Параметры сравнения DataSet'ов

------------------------------

1. Вставка записей

2. Сортировка записей

Окружение

---------

| | |

| --- | --- |

| Delphi | 10.2 Tokyo Starter |

| Операционная система | Windows 7 SP1 Ultimate x64 |

| Процессор | Intel Core i5 |

| ОЗУ | 8 Гб |

Тестовые данные

---------------

DataSet'ы будут тестироваться на данных, полученных из базы данных Firebird. Для сравнительного анализа я создал в базе данных 100000 записей с различными типами данных:

• целые числа;

• вещественные числа;

• даты;

• строки;

• изображения.

Сравнение

---------

1. Загрузка данных

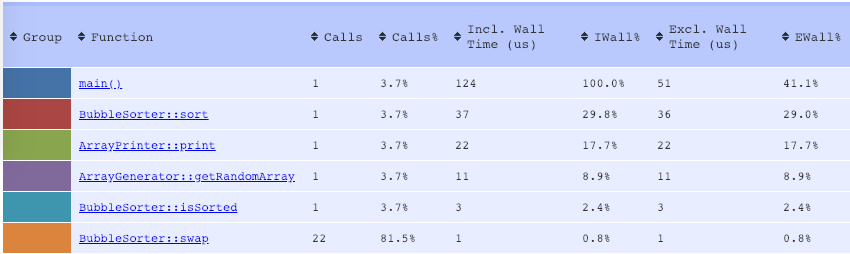

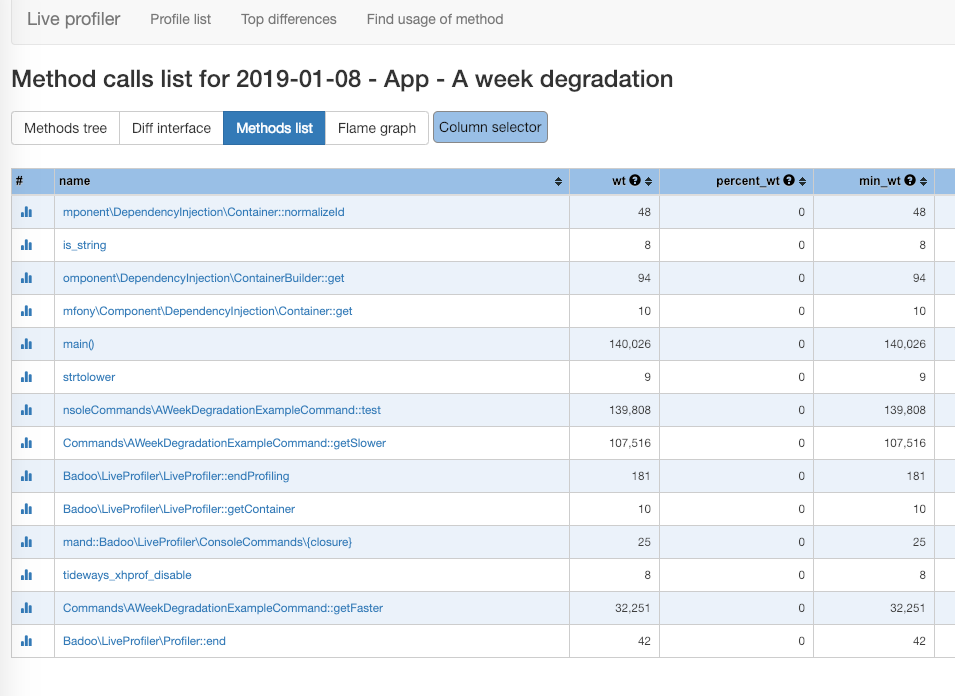

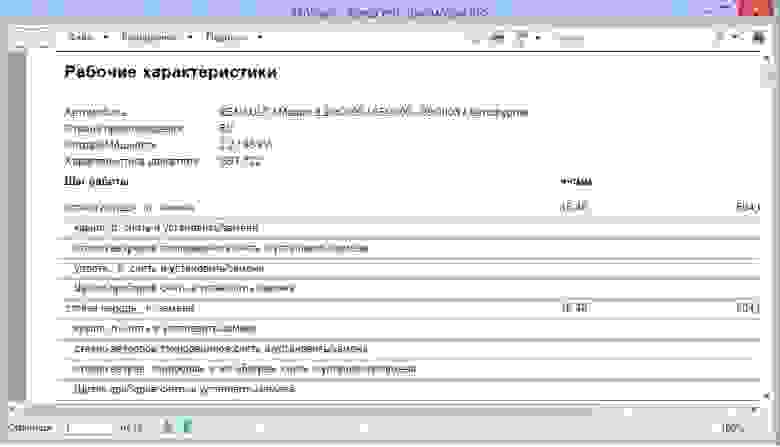

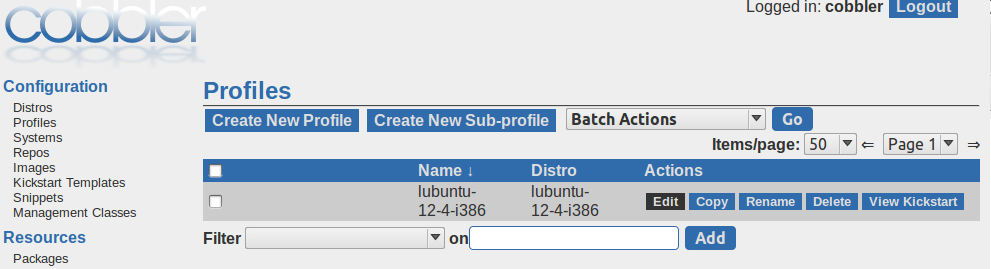

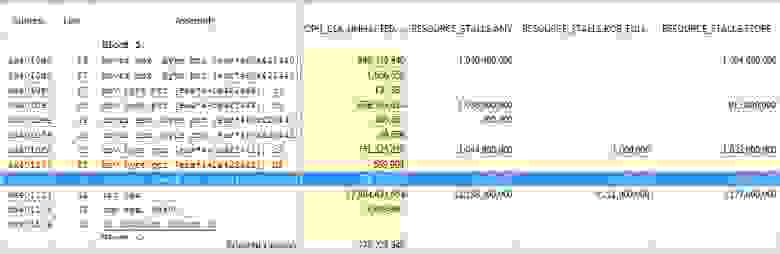

| DataSet | LoadFromDataSet | Ручная | Среднее |

| --- | --- | --- | --- |

| TJvMemoryData | 7,7846 сек | ***5,7500 сек*** | 6,7673 сек |

| TMemTableEh | ***4,5114 сек*** | 7,2978 сек | 5,9046 сек |

| TdxMemData | 6,3804 сек | 6,5082 сек | 6,4443 сек |

| TkbmMemTable | 5,4474 сек | 6,0562 сек | ***5,7518 сек*** |

Загрузки для каждого DataSet'a производились по 5 раз, из полученных значений подсчитвывалось среднее арифметическое. Среднее значение — это среднее арифметическое значения загрузки при помощи метода LoadFromDataSet и значения ручной загрузки.

Результаты:

**TMemTableEh** — самая быстрая загрузка данных при помощи метода LoadFromDataSet

**TJvMemoryData** — самая быстрая ручная загрузка данных

**TkbmMemTable** — самая быстрая средняя загрузка данных

**Исходный код замера времени**

```

var

start_time, end_time, total_time: double;

start_time := GetTickCount;

...

end_time := GetTickCount;

total_time := (end_time - start_time) / 1000;

```

**Исходный код загрузки данных LoadFromDataSet**

```

//TJvMemoryData

//function LoadFromDataSet(Source: TDataSet; RecordCount: Integer; Mode: TLoadMode; DisableAllControls: Boolean = True): Integer;

JvMemoryData.LoadFromDataSet(FIBDataSet, -1, lmCopy);

//TMemTableEh

//function LoadFromDataSet(Source: TDataSet; RecordCount: Integer; Mode: TLoadMode; UseCachedUpdates: Boolean): Integer;

MemTableEh.LoadFromDataSet(FIBDataSet, -1, lmCopy, true);

//TdxMemData

//procedure LoadFromDataSet(DataSet : TDataSet);

dxMemData.LoadFromDataSet(FIBDataSet);

//TkbmMemTable

//procedure TkbmCustomMemTable.LoadFromDataSet(Source:TDataSet; CopyOptions:TkbmMemTableCopyTableOptions; Mapping:string='');

kbmMemTable.LoadFromDataSet(FIBDataSet, [mtcpoAppend]);

```

**Исходный код ручной загрузки**

```

while not FIBDataSet.Eof do

begin

table.Append;

table.FieldByName('ID').AsInteger := FIBDataSet.FieldByName('ID').AsInteger;

table.FieldByName('SUMM').AsFloat := FIBDataSet.FieldByName('SUMM').AsFloat;

table.FieldByName('COMMENT').AsString := FIBDataSet.FieldByName('COMMENT').AsString;

...

table.Post;

FIBDataSet.Next;

end;

table.First;

```

TJvMemoryData — единственный DataSet, у которого ручная загрузка данных оказалось быстрее, чем загрузка при помощи метода LoadFromDataSet.

TdxMemData — единственный DataSet, который после загрузки данных при помощи метода LoadFromDataSet не возвращает позицию в DataSet на первую запись.

2. Сортировка

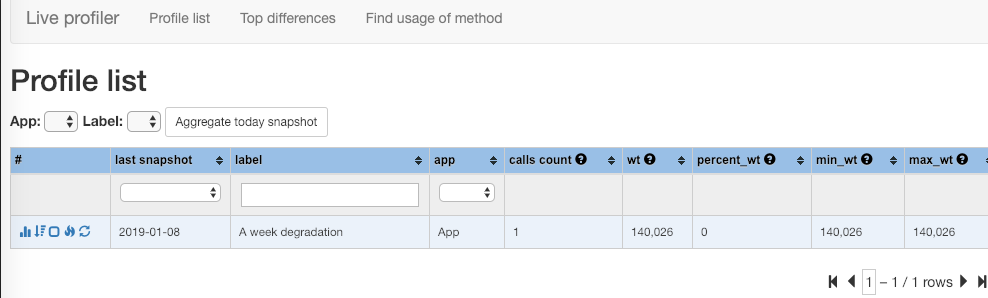

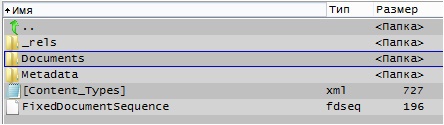

| DataSet | Целое число | Вещественное число | Строка | Среднее |

| --- | --- | --- | --- | --- |

| TJvMemoryData | 0,3492 сек | 0,8330 сек | 1,9938 сек | 1,0587 сек |

| TMemTableEh | 0,9014 сек | 0,8642 сек | 3,6876 сек | 1,8177 сек |

| TdxMemData | 0,3616 сек | 0,3650 сек | 0,9134 сек | 0,5467 сек |

| TkbmMemTable | ***0,1996 сек*** | ***0,2186 сек*** | ***0,7550 сек*** | ***0,3897 сек*** |

Сортировка для каждого DataSet'a производились по 5 раз, из полученных значений подсчитвывалось среднее арифметическое. Среднее значение — это среднее арифметическое значений сортировок.

Результаты:

**TkbmMemTable** — самая быстрая сортировка целых чисел

**TkbmMemTable** — самая быстрая сортировка вещественных чисел

**TkbmMemTable** — самая быстрая сортировка строк

**TkbmMemTable** — самая быстрая средняя сортировка

**Исходный код замера времени**

```

var

start_time, end_time, total_time: double;

start_time := GetTickCount;

...

end_time := GetTickCount;

total_time := (end_time - start_time) / 1000;

```

**Исходный код сортировки данных**

```

//TJvMemoryData

//procedure SortOnFields(const FieldNames: string = ''; CaseInsensitive: Boolean = True; Descending: Boolean = False);

JvMemoryData.SortOnFields(fields, false, false);

//TMemTableEh

//procedure SortByFields(const SortByStr: string);

MemTableEh.SortByFields(fields);

//TdxMemData

dxMemData.SortedField := fields;

//TkbmMemTable

//procedure SortOn(const FieldNames:string; Options:TkbmMemTableCompareOptions);

kbmMemTable.SortOn(fields, []);

```

Отмечу, что только для DataSet'а TMemTableEh при сортировке по нескольким полям можно задавать различное направление сортировки для каждого поля (по возрастанию/по убыванию).

Заключение

----------

Безоговорочным лидером оказался DataSet ***TkbmMemTable***, но и все другие DataSet'ы показали хорошие результаты. Но воспользоваться TkbmMemTable можно только с Delphi XE2.

Конечно, на реальных данных вряд ли понадобиться загружать 100000 записей для отображения пользователю. Так же при выборе DataSet'а нужно учитывать, что на другом наборе данных (например, при отсутствии загрузки изображений или для x64-приложения) результаты скорости работы могут оказаться другими. К тому же многие DataSet'ы имеют дополнительный функционал для работы с гридом из своей библиотеки.

Дополнительно о TMemTableEh

---------------------------

Компонент TMemTableEh появился в версии EhLib 4.0. Все компоненты библиотеки, включая TMemTableEh, работают начиная с Delphi 7.

Преимущества использования MemTableEh по сравнению с другими DataSet'ми следующие:

1. Поддерживает специальный интерфейс, позволяющий компоненту DBGridEh просматривать все данные, не перемещая активную запись.

2. Позволяет закачивать в себя данные из объекта TDataDriverEh (свойство DataDriver).

3. Позволяет выгружать изменения обратно в DataDriver, оперативно или отложено (в зависимости то свойства CachedUpdates).

4. Позволяет создавать мастер/дитэил отношения на клиенте (фильтруя записи) или на внешнем источнике (обновляя параметры [Params] и перезапрашивая данные c DetailDataDriver'а).

5. Позволяет сортировать данные, включая Calculated и Lookup поля.

6. Позволяет создавать и заполнять данные в design-time и сохранять данные в dfm-файле формы.

7. Позволяет хранить записи в виде дерева. Каждая запись может иметь записи узлы/ветви и сама являться узлом другой родительской записи. Компонент TDBGridEh поддерживает функциональность отображения древовидной структуры этих записей.

8. Позволяет подключиться к внутреннему массиву другого компонента TMemTableEh (свойство ExternalMemData) и работать с его данными: сортировать, фильтровать, редактировать.

9. Имеет интерфейс для получения списка всех значений столбца, игнорируя локальный фильтр DataSet'а. TDBGridEh использует это свойство для автоматического формирования списка в выпадающем DropDownBox'е фильтра.

О TRxMemoryData

---------------

Разработчки: RxLib

Компонент TRxMemoryData появился в версии RxLib 2.60.

DataSet TRxMemoryData не участвует в сравнении, потому что в 2002 году библиотека RxLib была официально включена в состав JVCL. В JVCL есть утилита для быстрой замены всех Rx компонентов, функций и юнитов на JVCL-версии.

Почему стоит перейти на JVCL:

В отличие от RxLib, JVCL развивается. Ошибки исправляются. Регулярно выходят версии с поддержкой новых версий Delphi. JVCL компоненты поддерживают новые версии Windows и Windows-стили.

Порядок использования DataSet'ов в моей практике

------------------------------------------------

1. TRxMemoryData

2. TMemTableEh

3. TRxMemoryData

4. TJvMemoryData

5. TkbmMemTable | https://habr.com/ru/post/357716/ | null | ru | null |

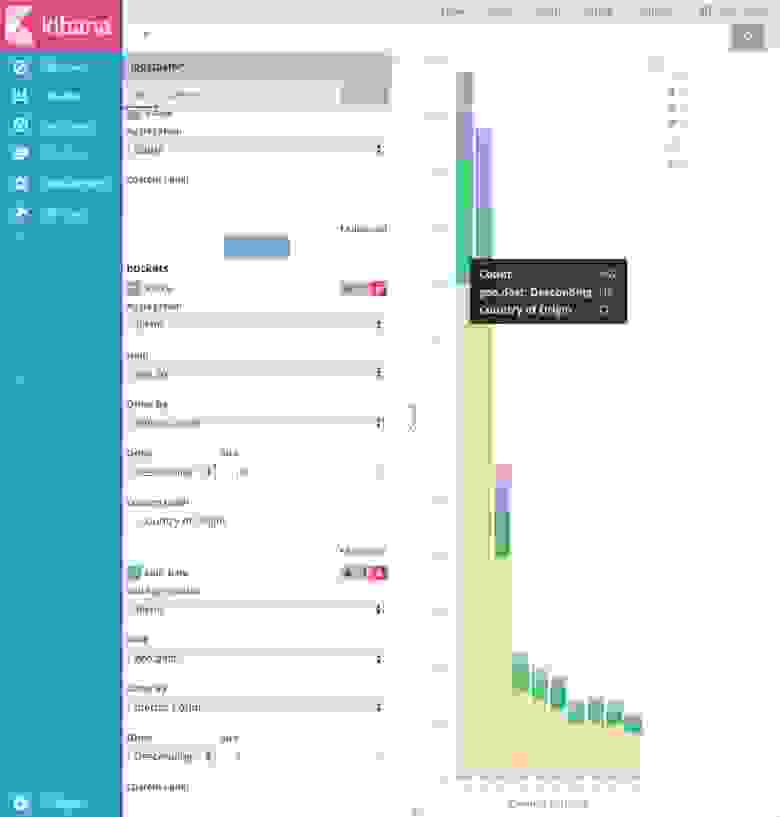

# Руководство пользователя Kibana. Визуализация. Часть 1

Доброго времени суток. Всем пользователям ElasticStack рано или поздно нужно визуализировать данные. Большинство использует Kibana. Под катом перевод официальной документации для версии 6.6.

Ссылка на оригинальный материал: [Kibana User Guide [6.6] » Visualize](https://www.elastic.co/guide/en/kibana/6.6/visualize.html)

Содержание:

1. Creating a Visualization

2. Line, Area, and Bar charts

Вкладка Visualize позволяет вам создавать визуализацию данных в ваших индексах Elasticsearch. Вы можете потом построить информационные панели (dashboards), что выводят связанные визуализации.

Визуализации Kibana базируются на запросах Elasticsearch. Используя серию агрегаций (выборок, прим. пер.) для извлечения и обработки ваших данных, вы можете создавать схемы, на которых отображаются тенденции, всплески и падения, нужные вам.

Вы можете создавать визуализации поиска, сохраненного во вкладке Discover или стартовать с новым поисковым запросом.

### Creating a Visualization

Чтобы создать визуализацию:

1. Кликните на вкладке **Visualize** на боковой панели навигации.

2. Кликните кнопку **Create new visualization** или кнопку **+**.

3. Выберите тип визуализации:

* **Базовые схемы**

**Line, Area and Bar charts**. (Графики, площади и гистограммы, прим. пер.) Сравнивайте разные комплекты данных в схемах X/Y.

**Heat maps**. (Карты температур, прим. пер.) Затемнение элементов в матрице.

**Pie chart**. (Диаграммы, прим. пер.) Показывает долю каждого источника от общей суммы.

* **Данные**

**Data table**. (Таблица данных, прим. пер.) Выводит необработанные данные составленной агрегации.

**Metric**. (Метрика, прим. пер.) Выводит одиночное число.

**Goal and Gauge**. (Цель и датчик, прим. пер.) Выводит шкалу датчика.

* **Карты**

**Coordinate map**. (Карта координат, прим. пер.) Сопоставляет данные агрегации и географическое месторасположение.

**Region map.** (Карта регионов, прим. пер.) Тематические карты, где интенсивность цвета формы соответствует метрическому значению.

* **Временные ряды**

**Timelion**. Вычисляет и объединяет данные из нескольких наборов данных временных рядов.

**Time Series Visual Builder.** (Визуальный конструктор временных рядов, прим. пер.) Визуализирует данные временных рядов, используя источник агрегаций.

* **Остальные**

**Controls**. (Управление, прим. пер.) Предоставляет возможность добавлять интерактивные формы ввода на информационные панели Kibana.

**Markdown widget**. (Виджет скидки, прим. пер.) Выводит произвольную информацию или инструкции.

**Tag cloud**. (Облако тегов, прим. пер.) Показывает слова в виде облака, в котором их размер соответствует важности.

**Vega graph**. (Граф Вега, прим. пер.) Поддерживает графы, определенные пользователем, внешних источников данных, изображений и интерактивности, определенной пользователем.

4. Укажите поисковый запрос, с которого будет идти получение данных для вашей визуализации:

* Что бы ввести новый критерий поиска, выберите шаблон индекса для индексов, что содержат данные, что вы хотите визуализировать. Это откроет конструктор визуализации с неопределенным запросом, что совпадает со всеми документами в выбранных индексах.

* Для построения визуализации на основе сохраненного поиска кликните на имени сохраненного поиска, который вам нужен. Это откроет конструктор визуализаций и загрузит выбранный запрос.

Примечание. Когда вы строите визуализацию на основе сохраненного поиска, любые последующие изменения в сохраненном поиске автоматически отображаются в визуализации. Чтобы отключить автоматическое обновление, вы можете разъединить визуализацию и сохраненный поиск.

5. В конструкторе визуализаций выберите метрику агрегации для оси Y визуализации:

* **Метрические агрегации:** подсчёт, среднее число, сумма, минимум, максимум, стандартное отклонение, подсчет уникальных значений, медиана (50 процентов), проценты, процентные ряды, топ значений, гео центр

* **Агрегации родительских источников информации:** производная, накопительная сумма, скользящее среднее, последовательный дифференциал

* **Агрегации родственного источника:** среднее по сегменту, сумма по сегменту, минимум по сегменту, максимум по сегменту

6. Для визуализации оси X выберите агрегацию по сегменту:

* Временная гистограмма, спектр, выражения, фильтры, знаковые выражения

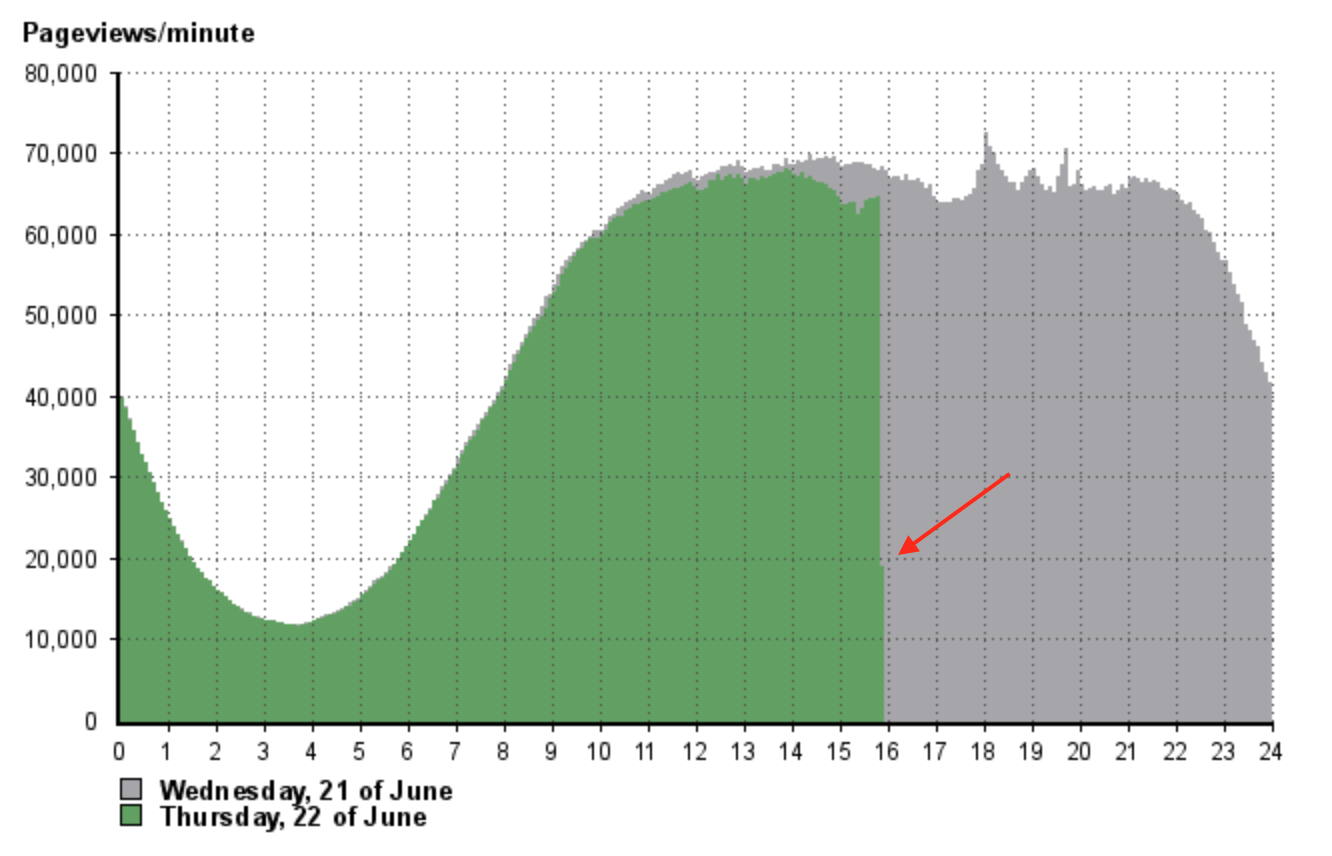

Для примера, если вы проиндексировали логи Apache сервера, вы можете построить гистограмму, что показывает распределение входящих запросов по географическому месторасположению, основываясь на спецификации выражений агрегации поля `geo.src`:

Ось Y показывает число запросов, что поступили из разных стран, а странами подписана ось X.

Визуализации гистограммы, графика или площади использует метрики для оси Y и сегменты для оси X. Сегменты аналогичны операторам SQL `GROUP BY`. Диаграммы используют метрики для размера доли и сегменты для числа долей.

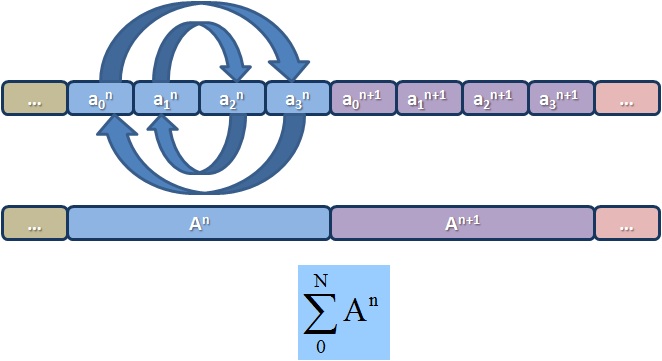

Вы можете дополнительно разбить данные, указав подгруппы. Первая агрегация устанавливает набор данных для любых последующих агрегаций. Подгруппы применяются по порядку — вы можете перетащить агрегации, что бы изменить порядок применения.

Например, вы можете добавить подгруппу выражений по полю `geo.dest` к гистограмме Страны источников запросов, чтобы увидеть месторасположения назначения запросов.

Для дополнительной информации по работе с подгруппами агрегаций смотри [Kibana, Aggregation Execution Order, and You](https://www.elastic.co/blog/kibana-aggregation-execution-order-and-you).

### Line, Area, and Bar charts

Грфик, площадь и гистограмма позволяют строить схемы данных по X/Y осях.

Сначала вам нужно выбрать метрики, что определяют значения осей.

Метрические агрегации:

**Count.** Агрегация подсчета возвращает чистый подсчет элементов в выбранном шаблоне индекса.

**Average.** Данная агрегация возвращает среднее значение по числовому полю. Выбирайте поле из выпадающего списка.

**Sum.** Возвращает общую сумму по числовому полю. Выбирайте поле из выпадающего списка.