text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

values | source stringclasses 4

values |

|---|---|---|---|---|

# Typescript: Объединение типов в глубину

Пошаговое руководство о том, как в TypeScript написать такой generic-тип, который объединяет произвольные вложенные key-value структуры.

*Примечание переводчика: я намерено не стал переводить некоторые слова (вроде generic, key-value), т.к., на мой взгляд, это только усложнит... | https://habr.com/ru/post/526998/ | null | ru | null |

# Один вариант использования аннотаций

Сразу хочу объявить, что здесь под аннотациями подразумеваются **НЕ** декораторы. И я не знаю по какой причине декораторы иногда именуют аннотациями.

Недавно я открыл для себя что в питоне есть фишка, которую я очень давно искал — [аннотации к функциям](http://legacy.python.or... | https://habr.com/ru/post/223041/ | null | ru | null |

# Spring: вопросы к собеседованию

Этот небольшой список вопросов даст вам понимание самых важных концепций Spring, а так же поможет подготовится к собеседованию

**1 Для чего нужен Component Scan?**Ес... | https://habr.com/ru/post/350682/ | null | ru | null |

# Советы по архитектуре кода для начинающих

#### Для кого статья

Вы уже написали свои первые 1000 строк кода и сейчас хотите сделать их понятнее, потому что внесение изменений занимает столько-же времени, сколько написать заново, но советы из ООП, SOLID, clean architecture и т.д. непонятны вам.

#### О чем статья

Эт... | https://habr.com/ru/post/709670/ | null | ru | null |

# Asyncio Tarantool Queue, вставай в очередь

В одной из своих статей я рассказывал об [асинхронной работе с Tarantool на Python](http://habrahabr.ru/company/mailru/blog/254727/). В данной статье продолжу эту тему, но внима... | https://habr.com/ru/post/271513/ | null | ru | null |

# Несколько интересностей и полезностей для веб-разработчика #32

Доброго времени суток, уважаемые хабравчане. За последнее время я увидел несколько интересных и полезных инструментов/библиотек/событий, которыми хочу поделиться с Хабром.

#### [ICEcoder](https://github.com/mattpass/ICEcoder)

[~~Как "раскатать" ось на кучу устройств?~~ Что делать если перед вами стоит задача устан... | https://habr.com/ru/post/651431/ | null | ru | null |

# Фамильный вики-движок Bonsai: итоги 2019 года

В начале прошлого года я рассказывал про проект [Bonsai](https://habr.com/ru/post/438622/) — движок для создания семейного вики и фотоальбома с открытым исходным кодом. С тех пор проект планомерно развивался. За год сделано несколько фич, благодаря которым движок теперь ... | https://habr.com/ru/post/481600/ | null | ru | null |

# Доступ к HID-устройствам из программы на Qt под Android

#### Введение

С выходом Qt 5 появилась удобная возможность расширить список поддерживаемых программой платформ и на мобильные ОС, в частности на Android.

Сам процесс портирования программы с десктопной версии Qt на мобильную свелся к банальной перекомпиляци... | https://habr.com/ru/post/238241/ | null | ru | null |

# Безопасный SOCKS5 прокси для Telegram за 1 Евро и 10 минут

Не все прокси одинаково полезны. На волне новостей о блокировке мессенджера Телеграмм стало актуально поднимать свой SOCKS5 прокси, так как чужой использовать не безопасно — неизвестно, кому принадлежат серверы, какое ПО на них используется, и какие в нем пр... | https://habr.com/ru/post/353738/ | null | ru | null |

# Настраиваем LAMP для работы в Windows через VirtualBox

Здравствуйте.

Статья из разряда – шоб для себя було, но, думаю, будет интересна многим.

Началось с того, что потребовалось мне в PHP работать с xlsx-файлом, что, по сути, переименованный zip. И вот как-то сложилось, что Денвер мне не понравился с самого на... | https://habr.com/ru/post/190010/ | null | ru | null |

# Иммутабельная архитектура

Эта статья является переводом материала [«Immutable architecture».](https://enterprisecraftsmanship.com/posts/immutable-architecture/)

В этом посте автор оригинала хотел бы показать общий подход к внедрению иммутабельности в кодовую базу на архитектурном уровне.

### Иммутабельность, состо... | https://habr.com/ru/post/571668/ | null | ru | null |

# Как мы делали сингл на Ubuntu Studio 14.04

От создателей [Как мы создавали сингл на *Ubuntu Studio 13.10*](http://habrahabr.ru/post/206204/). Второй сингл мы делали тоже на *Ubuntu Studio 13.10*, так не хотели новых прик... | https://habr.com/ru/post/250357/ | null | ru | null |

# Архитектурные решения для мобильной игры. Часть 3: View на реактивной тяге

В предыдущих статьях мы описали как должна быть устроена модель удобная и с широкими возможностями, какая к ней подойдёт система команд, выполняющая функ... | https://habr.com/ru/post/436060/ | null | ru | null |

# Ассоциативные связи

Что такое идеальный "квант информации" или "минимальная единица смысла" и зачем задаваться этим вопросом? С этим связано много боли, часто даже неосознаваемой. Мы предлагаем решение, но сначала нужно разобраться для чего это нужно. Рекомендуем ознакомиться с [первой статьёй](https://habr.com/ru/p... | https://habr.com/ru/post/576398/ | null | ru | null |

# 2.1 Обработка времени

*От переводчика: данная статья является шестой в цикле переводов официального руководства по библиотеке SFML. Прошлую статью можно найти [тут.](https://habrahabr.ru/post/279279/ "Предыдущая статья: К... | https://habr.com/ru/post/279347/ | null | ru | null |

# Квантовые вычисления и язык Q# для начинающих

Возможно, вы узнали о выпуске пакета средств квантовой разработки [Quantum Development Kit](http://www.microsoft.com/quantum) и подумали, что это звучит безумно круто… а потом вспомнили, что про квантовую механику почти ничего не знаете. Но ничего страшного. Через 30 мин... | https://habr.com/ru/post/351622/ | null | ru | null |

# Вышел PyPy 1.2 и ускорил Python в разы!

Вышел [PyPy](http://pypy.org/) 1.2. Основное отличие — наличие *JIT компилятора*.

Чтобы долго не объяснять что это и зачем — простой тест:

```

cnt = 10 * 1000 * 1000

for _ in xrange(cnt):

i = i + 1

```

**5.8млн... | https://habr.com/ru/post/87364/ | null | ru | null |

# Создать свой язык программирования, попасть в YCombinator с третьего раза и провести 250+ встреч с инвесторами

Последние полтора года мы с моим братом-близнецом работали над Wasp: новым языком прог... | https://habr.com/ru/post/594267/ | null | ru | null |

# Emacs для начинающих: Подготовка статей для Хабра в Emacs

##### Введение

Мы уже много говорили о мощи Emacs. Давайте решим какую-нибудь практическую задачу. Например научимся готовить тексты статей для Хабра с минимумом ручной работы.

Прикинем, что нам нужно:

* Преобразование текста в HTML

* Спеллчекер

* Подс... | https://habr.com/ru/post/60215/ | null | ru | null |

# Пример сегментации изображений средствами PHP

Добрый день,

довольно редко, но все же встает вопрос о необходимости в автоматическом режиме делить изображение на логические фрагменты. Если вы ограничены только средствами PHP, то задача становится немного трудней, но все же решаема.

В данной статье я рассмотрю ... | https://habr.com/ru/post/189068/ | null | ru | null |

# Пишем full stack монолит с помощью Angular Universal + NestJS + PostgreSQL

##### Привет, Хабр!

В этой статье мы создадим готовый шаблон-монолит, который можно брать за основу нового fullstack приложения как скелет для навешивания функционала.

#### Эта статья будет полезна, если вы:

* Начинающий fullstack-разрабо... | https://habr.com/ru/post/514380/ | null | ru | null |

# Exception-ы и мифы о них

Уже не первый раз сталкиваюсь с негибким отношением к поднятию исключений. Именно к поднятию, потому что к перехвату у большинства мнение совпадает: перехватывай только тогда, когда на самом деле можешь обработать. Поднятие же воспринимается, как нечто исключительное, из ряда вон. Когда видя... | https://habr.com/ru/post/119016/ | null | ru | null |

# Работа с утилитой mdadm. Изменение типа массива, chunk size, расширение

#### Введение

К написанию данной статьи меня побудило отсутствие внятной информации на русском языке по работе с утилитой mdadm, реализующей RAID различных типов в ОС linux. В принципе, основные положения работы данной утилиты освещаются достат... | https://habr.com/ru/post/200194/ | null | ru | null |

# PostgreSQL Antipatterns: ударим словарем по тяжелому JOIN

Продолжаем серию статей, посвященных исследованию малоизвестных способов улучшения производительности «вроде бы простых» запросов на PostgreSQL:

* [редкая запись долетит до середины JOIN](https://habr.com/post/484670/)

* [сизифов JOIN массивов](https://hab... | https://habr.com/ru/post/485398/ | null | ru | null |

# Машина времени в git

В последнее время мои коллеги начинают знакомство с git'ом. И один из интересующих их вопросов — как откатиться до определённой ревизии. В интернете можно найти набор команд, но хочется, чтобы было понимание каждой из них. Баловство с комадами git'а без понимания может привести к потере истории ... | https://habr.com/ru/post/157175/ | null | ru | null |

# Скриптинг в C# или динамическое выполнение в runtime

Привет, Хабр!

Думаю, немногие знают, что в C# есть штука наподобие eval из других языков. Благодаря Roslyn API, можно во время выполнения скомпилировать и выполнить код на C#. Пример использования Вы можете посмотреть в [моей реализации](https://github.com/Fantoo... | https://habr.com/ru/post/553310/ | null | ru | null |

# Knork: простейшая альтернатива ButterKnife в 160 строк кода

Хабрапривет!

Ниже речь пойдет о view injection, костылестроении, аннотациях, рефлексии, о жалкой попытке превзойти Джейка Уортона и о том, что свой велосипед ближе к телу.

Что же такое view injection? Это способ избежать вот такого рутинного кода:

... | https://habr.com/ru/post/230857/ | null | ru | null |

# Красота в консоли

Если верить статистике MacOS,то топовые приложения которые я использую для работы это Chrome, VS Code, iTerm и VK Teams. При этом в консоли я провожу от часа до трех ежедневно. На самом деле это время больше, потому что часть того что трекается как VS Code тоже является временем работы в консоли, т... | https://habr.com/ru/post/699998/ | null | ru | null |

# Вставить подпись в pdf или как спасти деревья

В век перехода к цифровому документообороту появляются курьёзные случаи когда цифровизация вроде есть, а вроде и нет. Одним из таких случаев оказалась ситуация, когда сотрудники распечатывали договор, присланный на электронную почту, ставили на распечатке факсимиле или п... | https://habr.com/ru/post/549116/ | null | ru | null |

# symfony — первое знакомство, рассуждения и впечатления.

Сегодня хочу рассказать Вам о своем недавно состоявшемся первом знакомстве с фреймворком [symfony](http://symfony-project.org/).

Так как до этого я в течение длительного срока (около полутора лет) разрабатывал свои приложения на Zend Framework'е — мне есть с... | https://habr.com/ru/post/44295/ | null | ru | null |

# Ужасный баг в Portland Group C++ компиляторе

Эта публикация для тех, кто вынужден по долгу службы пользоваться pgcpp компилятором или поддерживать совместимость кода с этим компилятором.

На днях я получил баг репорт, что мой код неправильно работает, если его скомпилировать при помощи pgcpp.

Начав разбираться... | https://habr.com/ru/post/249817/ | null | ru | null |

# Памятка по жизненному циклу Android — часть I. Отдельные Activity

Android спроектирован так, чтобы использование приложения пользователем было максимально интуитивным. Например, пользователи приложения могу... | https://habr.com/ru/post/569092/ | null | ru | null |

# Scala: Гексагональная архитектура и DDD на Free Monad в функциональном программировании

Привет Хабр! Пятничного тру ФП хардкора с Free Monad, Таглес Финал, Монад трансформерами, [Refined Types](https://hab... | https://habr.com/ru/post/655089/ | null | ru | null |

# Слухи о Nokia N900

В интернете появилась фотография и характеристики новой таблетки от Nokia

``

Размеры устройства не сообщаются, но экран размером 3,5" и имеет разрешение WVGA (800x480) даёт небольшое представление о габаритах устройства. Из средс... | https://habr.com/ru/post/60496/ | null | ru | null |

# Своя видео-платформа — ffmpeg и качество кодирования видео. Part 2

Lenna любит хорошо выглядеть — фотомодель в конце концов. Ходят легенды, что добавление её в заголовок статьи, связанной с обработкой визуальных данных даёт +5 к ш... | https://habr.com/ru/post/437936/ | null | ru | null |

# Автоматизация выдачи AdHoc сборки приложения из Xcode для установки на девайс заказчика

Поясню для начинающих, что при разработке под iOS для установки на девайс большую часть времени вы собираете приложение в development режиме, т.е. только для себя.

Но в какой-то момент требуется начинать выдавать заказчику ре... | https://habr.com/ru/post/190296/ | null | ru | null |

# Извлечение ссылки на объект из замыкания

```

var singleton = (function () {

var data, method_args;

data = [];

method_args = [];

function add (items) {

var i;

data.push(items);

method_args.push(arguments);

}

function remove () {

data.pop();

method_args.push(arguments);

}

return {

add : add,

... | https://habr.com/ru/post/143288/ | null | ru | null |

# Чем опасны уязвимые зависимости в проекте и как с этим помогает SCA?

Современные приложения почти всегда используют сторонние библиотеки. Если библиотека содержит уязвимость, то уязвимым может оказаться и использующее её приложение. Но как определить наличие таких проблемных зависимостей?

с помощью [плагина In-App Purchase](https://pub.dev/packages/in_app_purchase).

Сначала расскажу немного о самих предметах которые мы можем продавать ч... | https://habr.com/ru/post/709400/ | null | ru | null |

# MFA-protected SSH access to Ubuntu servers with LDAP or Azure AD Credentials and hardware or software tokens

SSH, the secure shell, is often used to access remote Linux systems. Because we often use it to connect with computers containing important data, it’s recommended to add another security layer, such as the se... | https://habr.com/ru/post/586902/ | null | en | null |

# Mito — быстрый старт на Python для тех, кто привык к Excel

Mito — это графический интерфейс для быстрой работы с наборами данных, который по вашим действиям создаёт код на Python. Даже если вы работаете с P... | https://habr.com/ru/post/595807/ | null | ru | null |

# Work in Progress: самодельный микро ЧПУ-робот для заточки фрез и свёрл

[](https://habr.com/ru/company/ruvds/blog/668414/)

В программировании достаточно много прикладных задач, которые напрямую связаны с разработкой физических устро... | https://habr.com/ru/post/668414/ | null | ru | null |

# Hack The Box. Прохождение Fuse. RPC, принтеры и опасная привилегия SeLoadDriverPrivilege

Продолжаю публикацию решений, отправленных на дорешивание машин с площадки [HackTheBox](https://www.hackthebox.eu).

В данной статье созда... | https://habr.com/ru/post/525580/ | null | ru | null |

# Быстрый курс Redux + websockets для бэкендера

> Всем привет из 2018! Оригинальный [react-redux-universal-hot-example](https://github.com/erikras/react-redux-universal-hot-example) прекратил развитие в 2017 году, но его можно собрать на версии 6.14.2, на 8 и выше версии будут ошибки. Но есть его форк

>

> <https://... | https://habr.com/ru/post/318148/ | null | ru | null |

# OpenTelemetry на практике

Совсем недавно два стандарта – OpenTracing и OpenCensus – окончательно объединились в один. Появился новый стандарт распределенного трейсинга и мониторинга – OpenTelemetry. Но несмотря на то, что разработка библиотек идет полным ходом, реального опыта его использования пока не слишком много... | https://habr.com/ru/post/537892/ | null | ru | null |

# Сжимаем 2Кб текста в 5 байт

Привет всем Хабровчанам.

На днях придумал довольно интересный способ шифрования/упаковки/архивирования (нужное подчеркнуть) текста.

Заглядываем под кат, кому интересно как анекдот:

`Разговаривают два программиста.

- Слушай, вчера написал новый архиватор. Любой файл сжимает в 5... | https://habr.com/ru/post/108666/ | null | ru | null |

# Анализ комуникации из Tor сети в инфраструктуру с помощью ELK стека

ElasticSeach достаточно гибкая платформа, и полученные в него данные можно обрабатывать многими способами, даже за пределами стека ELK. Для этого предоставлено более десятка различных API. Но для многих задач будет достаточно и возможностей Kibana. ... | https://habr.com/ru/post/327048/ | null | ru | null |

# Дзен изолированных компонентов в Android-архитектуре

Несколько лет назад мы в Badoo начали использовать MVI-подход к Android-разработке. Он был призван упростить сложную кодовую базу и избежать проблемы некорректных состояний: в... | https://habr.com/ru/post/463781/ | null | ru | null |

# Дешевые авиабилеты… Или сеть мошеннических сайтов, ворующих деньги с карт. Мое расследование

В этой публикации речь пойдет о целой сети мошеннических сайтов, которые на протяжении долгого времени работают с единственной целью — похитить данные банковских карт и увести все доступные денежные средства с этих карт. В э... | https://habr.com/ru/post/397759/ | null | ru | null |

# «Бегущая строка» — динамическая индикация на примере светодиодной матрицы RL-M2388 и Arduino Mega

Данная статья не претендует на толкование как единственно возможного метода отображения и прокрутки информации на светодиодной матрице. Я с удовольствием выслушаю ваши замечания и предложения по улучшению метода/функций... | https://habr.com/ru/post/129569/ | null | ru | null |

# Аннотация к «Effective Modern C++» Скотта Майерса

Пару месяцев назд Скотт Майерс ([Scott Meyers](http://www.aristeia.com/)) выпустил новую книгу [Effective Modern C++](http://shop.oreilly.com/product/0636920033707.do?cmp=af-code-boo... | https://habr.com/ru/post/248137/ | null | ru | null |

# Новое в Java 8

> [Java еще не умерла — и люди начинают это понимать.](https://twitter.com/mreinhold/status/429603588525281280)

Добро пожаловать в ведение по [Java 8](https://jdk8.java.net/). Этот материал шаг за шагом познакомит вас со всеми новыми фичами языка. Вы научитесь использовать методы интерфейсов по умолч... | https://habr.com/ru/post/216431/ | null | ru | null |

# Как я участвовал в конкурсе Сбербанка про предсказание оттока клиентов

В рамках [ICBDA 2015](http://icbda2015.org/) [Сбербанк проводил конкурс про предсказание оттока своих клиентов](http://icbda2015.org/apply.html). Я неслабо заморочился по этому поводу, ничего не выиграл и тем не менее хотел бы описать процесс реш... | https://habr.com/ru/post/267217/ | null | ru | null |

# 15 супер полезных примеров команды find в Linux

Практические примеры, которые приведены в этой статье, помогут вам освоить очень эффективную и крайне полезную команду find.

Она используется для поиска файлов и папок через коман... | https://habr.com/ru/post/593669/ | null | ru | null |

# Велосипедим Promise на TypeScript

Идея написать собственную реализацию Promise возникла в процессе подготовки к интервью, поскольку необходимость не просто разобраться в инструменте, а воссоздать его боле... | https://habr.com/ru/post/685996/ | null | ru | null |

# Универсальный код C# под .NET и JavaScript

### Введение

Приветствую вас, хабравчане. В данном топике я хотел бы осветить подробности разработки на C# под разнородные целевые платформы, в первую очередь такие как .NET и браузер (JavaScript). В качестве примера желающие могут изучить веб-сервис по обработке фотографи... | https://habr.com/ru/post/164439/ | null | ru | null |

# ИТ-аналитик, чем его работа ценна для бизнеса

“Аналитик, проанализируй мне эту задачу” - говорит бизнес-заказчик. Что он имеет в виду? Анализ - это всего лишь метод исследования, характеризующийся выделением и изучением отдельных частей объектов исследования (по википедии), но бизнес в своих словах подразумевает не... | https://habr.com/ru/post/529236/ | null | ru | null |

# Робот из LEGO и Arduino, обходящий препятствия

Мы обожаем LEGO и Crazy Circuits [LEGO-совместимая электроника / прим. перев.], поэтому решили скомбинировать их в простого и интересного робота, умеющего обходить препятствия. Мы покажем, как собрать такого робота и подробно опишем этот процесс. Ваша версия робота може... | https://habr.com/ru/post/511628/ | null | ru | null |

# Платформер под Android на Unity3D

Пожалуй, даже после выхода нового UI, создание интерфейса для Android’а осталось больной темой для многих.

Новая система “UI”, которая появилась в Unity 4.6 сильно упростила жизнь... | https://habr.com/ru/post/264611/ | null | ru | null |

# Сейф с доступом по отпечатку пальца

Этот проект основан на [предыдущем](https://habr.com/ru/company/ruvds/blog/657029/), в котором я заменил плату управления старого сейфа на ESP8266 D1 Mini, превратив его в современный сейф с одноразовым паролем. На этот раз я добавлю альтернативный способ открывания с помощью отпе... | https://habr.com/ru/post/656889/ | null | ru | null |

# Отправка и получение SMS с помощью Laravel и Nexmo

В этом кратком руководстве от Фила Леггеттера мы рассмотрим, как отправлять и получать SMS в приложении Laravel. Мы реализуем эту возможность, исп... | https://habr.com/ru/post/307278/ | null | ru | null |

# Разбираемся с библиотекой лексического анализа ANTLR4

У нас в SberDevices разрабатывается платформа по управлению рекомендациями, которая взаимодействует с разными ML-движками. Со временем их станет много, и, когда пользователь умных устройств Sber будет запрашивать контент – искать фильмы, музыку, спрашивать о чём-... | https://habr.com/ru/post/597553/ | null | ru | null |

# Я тут это… Трекалку для времени написал. За 628 минут

Привет, Друзья! Пару недель назад я подумал: «А можно ли использовать гугловые таблицы (Google Sheets), как простое и безопасное хранилище данных?». О, а еще мне давно хотелось написать трекалку времени.

И вот что получилось:

один из разработчиков языка Haskell, [проф. Филип Вадлер](http://homepages.inf.ed.ac.uk/wadler/), показал, как монады позволяют чистым функциональным языкам осуществлять императивные по сути операции, такие, как ввод-в... | https://habr.com/ru/post/445800/ | null | ru | null |

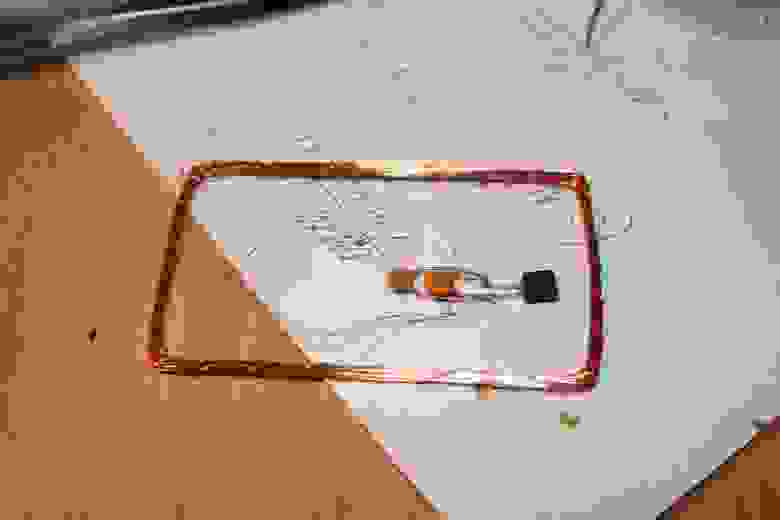

# Эмулятор RFID

Эмулятор карт EM Marine

-----------------------

[](https://habr.com/ru/company/ruvds/blog/515868/)

Наверняка каждому из нас, кто хоть раз бывал в обычных офисах, было интересно, как же функционируют эти бесконтактн... | https://habr.com/ru/post/515868/ | null | ru | null |

# Как изменить тему Wordpress неподготовленному человеку

**Update:>>>** Извините, пришлось добавить после начала дискуссии в комментариях. Не все дочитывают статью до конца, поэтому сразу скажу, что описываемый способ для тех, кто имеет лишь поверхностное, общее представление о том, что такое CSS и HTML. **<<<**

Ст... | https://habr.com/ru/post/49267/ | null | ru | null |

# Type-rich Programming

Посмотрев конференцию [GoingNative 2012](http://channel9.msdn.com/Events/GoingNative/GoingNative-2012) решил попытаться описать «best practice» для написания программ в стиле C++11. Планируется цикл статей, кому интересно,

Зачастую программисты описывают интерфейс, который понятен только им... | https://habr.com/ru/post/144334/ | null | ru | null |

# 10 рекомендаций по html-верстке электронных писем

Рекомендация первая: забудьте про блочную верстку. Весь лэйаут должен быть на таблицах. При этом, без крайней необходимости — их тоже лучше не использовать. Также следует выкинуть из головы представления о семантике, сокращенных css-правилах, валидации, плавающих бло... | https://habr.com/ru/post/60420/ | null | ru | null |

# SSP — Собственный алгоритм сжатия изображений без потерь

Наконец–то появилась возможность опубликовать разработанный мною когда-то алгоритм. Алгоритм был разработан для программы автоматического снятия скриншотов. Для удобства дальнейшего его описания буду называть его – SSP (sciner screenshot packer). SSP можно спр... | https://habr.com/ru/post/113668/ | null | ru | null |

# Как найти поддомены за считанные минуты?

Поиск поддоменов — неотъемлемая часть подготовки ко взлому, а благодаря некоторым инструментам противостояние этим действиям стало намного проще.

Незащищенные поддомены подвергают вашу деятельность серьезной опасности, а в последнее время произошел целый ряд инцидентов, пр... | https://habr.com/ru/post/312954/ | null | ru | null |

# Искусство аннотирования: пишем Java-friendly код на Kotlin

Привет, Хабр!

Сегодня мы затронем важнейшую тему: интероперабельность Java и [Kotlin](https://www.piter.com/collection/new/product/head-first-kotlin). Авторы предлагаемой публикации разумно предполагают, что переписать на Kotlin базу кода, сделанную на Ja... | https://habr.com/ru/post/473170/ | null | ru | null |

# В поисках «Годзиллы». Нейросети и прогнозирование котировок на основе биржевых и «внешних» данных

Эта работа вдохновлена статьей [«Мечтают ли нейросети об электроденьгах?»](https://habr.com/ru/post/488568/), где автор без преувеличе... | https://habr.com/ru/post/489582/ | null | ru | null |

# SIMD без SIMD, или ищем на С почти в два раза быстрее чем на С++

Прочитал статьи про комбинаторную кодогенерацию на С++ в контексте линейного поиска в базе данных: [Возможности оптимизации в языках C и C++](http://habrahabr.ru/post/182356/) и [Скорости разработки и исполнения не достижимые на С](http://habrahabr.ru/... | https://habr.com/ru/post/182588/ | null | ru | null |

# Настройка подключения Powershell по API к облаку Azure Pack Infrastructure

В этой статье мы рассмотрим как настроить подключение к облаку [Azure Pack Infrastructure](https://infoboxcloud.ru/services/azurepack/) через Powershell API.

, в 2018 году вернулась с [приквелом](https://en.wikipedia.org/wiki/Red_Dead_Redemption_2) для консолей. В 2019 году её выпустили для PC, и мне наконец удалось поиграть в неё; мен... | https://habr.com/ru/post/508934/ | null | ru | null |

# Уж+ёж: реактивные компоненты в сервлетном окружении (1/3)

Когда рассказывают о прелестях реактивного фреймворка [Spring WebFlux](https://docs.spring.io/spring-framework/docs/current/reference/html/web-reactive.html#webflux) и его подкапотном [Project Reactor](https://projectreactor.io/), для примера чаще всего показ... | https://habr.com/ru/post/647479/ | null | ru | null |

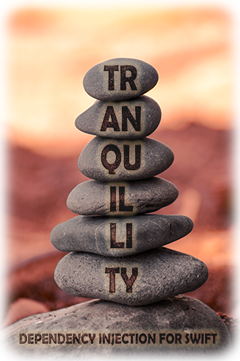

# Спокойствие спокойствию рознь

Три года назад, я написал [статью](https://habrahabr.ru/post/311334/) о DI библиотеке для языка Swift. С того момента библиотека сильно измененилась и стала ~~лучшей в своем род... | https://habr.com/ru/post/457188/ | null | ru | null |

# Экспериментальная версия PVS-Studio, поддерживающая C#

У нас появилась экспериментальная версия анализатора PVS-Studio, который умеет анализировать C#-проекты и который можно показ... | https://habr.com/ru/post/271993/ | null | ru | null |

# Недельный геймдев: #87 — 18 сентября, 2022

Из [новостей](https://suvitruf.ru/2022/09/19/12475/weekly-gamedev-87-18-september-2022/): Godot 4.0 наконец-то дополз до бетки, Autodesk запустили Maya Creative, релиз VCMI 1.0.0 — движка для Героев 3, Unity повысит стоимость корпоративных тарифов, W4 Games привлекла 8,5 мл... | https://habr.com/ru/post/689096/ | null | ru | null |

# 36 этапов процесса маршрутизации

Казалось бы, что может быть сложного в работе простой утилиты ping. Однако каждый раз, обнаружив,

что интернет по какой-то причине не работает, мы часто используем проверенный метод — пингуем какой-нибудь ресурс, например так:

`ping mit.edu`

Что же просходит в этот момент? В... | https://habr.com/ru/post/83047/ | null | ru | null |

# [DotNetBook] События об исключительных ситуациях и как на пустом месте получить StackOverflow и ExecutionEngineException

События об исключительных ситуациях

-----------------------------------

В общем случае мы не всегда знаем о... | https://habr.com/ru/post/419929/ | null | ru | null |

# Я не хочу знать дату своей смерти!

Сейчас довольно активно «раскручивается» сайт data-smerti.ru, всеми возможными и невозможными способами: начиная со спама на форумах и в аське, заканчивая скупкой копеечного трафика в сетях контекстной рекламы. На этом сайте (и его клонах на других доменах) предлагают пройти тест, ... | https://habr.com/ru/post/42407/ | null | ru | null |

# Это вопрос должен решать архитектор. Или нет?

У меня есть некоторый опыт в реализации систем на базе микросервисной архитектуры и я хотел бы поделится вопросами (и ответами), которые возникают при реализации подобных проектов. К сожалению, я не имею права распространяться о проектах в которых я участвовал, поэтому я... | https://habr.com/ru/post/331104/ | null | ru | null |

# Посмотрите, как Google отслеживает ваше местоположение. С Python, Jupyter, Pandas, Geopandas и Matplotlib

В отделе продаж можно услышать аббревиатуру *ABC:*[*Always Be Closing*](https://www.youtube.com/watch?v=GrhSLf0I-HM&t=3m21s)*, что* означает заключение сделки с покупателем. Последнее десятилетие породило еще од... | https://habr.com/ru/post/581062/ | null | ru | null |

# CDR. Сохранить и приумножить

Очень часто, созданию базы данных CDR отводится мало места в описаниях настройки. Как правило, все сводится к цитате SQL команд и обещанию, что если кинуть ее в консоль ... | https://habr.com/ru/post/318770/ | null | ru | null |

# Как на Three.Js сделать анимированный туннель из частиц

Один из организаторов митапов для креативных разработчиков в Бельгии Creative Front-end Belgium в двух постах на CodePen рассказывает и показывает, к... | https://habr.com/ru/post/570560/ | null | ru | null |

# ФЗ-152 надоел, простое решение c хранением персональных данных на nginx

Всем привет,

Я последние несколько лет очень часто сталкиваюсь с проектами по адаптации под 152-ФЗ и он мне, честно, порядком надоел... | https://habr.com/ru/post/552934/ | null | ru | null |

# Cloud Firestore + Android это просто

Не так давно Google зарелизил Cloud Firestore. Cloud Firestore — это облачная NoSQL база данных, которую Google позиционирует как замену Realtime Database. В этой статье я хочу рассказать как начат... | https://habr.com/ru/post/447640/ | null | ru | null |

# Python + vshadow + robocopy — синхронизация каталога с удаленной машиной

Не так давно у меня встала задача копировать базу данных из удаленного филиала для получения в нашем офисе ее полной копии на момент создания. По идее е... | https://habr.com/ru/post/241931/ | null | ru | null |

# Полнотекстовый поиск в InnoDB

Привет, Хабрачитатель!

Полнотекстовый поиск данных в InnoDB – это известная головная боль многих разработчиков под MySQL / InnoDB. Для тех, кто не в курсе дела я объясню. В типе таблиц MyISAM есть полноценный полнотекстовый поиск данных, однако сама таблица исторически имеет огранич... | https://habr.com/ru/post/114572/ | null | ru | null |

# Разделяй и властвуй. Изоляция процессов в Linux

Последнее десятилетие проходило под знаком контейнеризации, появлялись десятки и сотни инструментов для управления контейнерами, создания виртуальных сетей дл... | https://habr.com/ru/post/673960/ | null | ru | null |

# Закладка в OS X, продлевающая работу от батарейки для избранных приложений

Зачем 2 GPU?

-------------

Ноутбуки с двумя GPU появились уже очень давно. Первый MacBook Pro с такой технологией вышел еще в 2008 году.

Преимущество двух GPU в гибкости. Когда вам не нужна вся мощь видео системы, вы используете встроенно... | https://habr.com/ru/post/276787/ | null | ru | null |

# С11 исправит ошибки С99

В декабре 2011 года был утверждён стандарт [ISO/IEC 9899:2011](http://habrahabr.ru/post/135206/), он же C11 или C1X, новый стандарт для языка программирования C.

Дэнни Калев (Danny Kalev), бывший член комитета стандартизации C++, [вкратце объясняет](http://blog.smartbear.com/software-quali... | https://habr.com/ru/post/146596/ | null | ru | null |

# Книга «Секреты CSS. Идеальные решения ежедневных задач»

Привет, Хаброжители! Мы пополнили новинкой свою серию [O'Reilly](http://www.piter.com/collection/bestsellery-oreilly?page_size=&order=descending_age&q=&only_available=true):

;

size_t len3 = 0;

char *ptr3 = (char *)malloc(4096) + 4096;

size_t len4 = 0;

char ptr4[0];

size_t len5 = 0;

char ptr5[];

```

Во многих случаях все... | https://habr.com/ru/post/268989/ | null | ru | null |

# Мастерим задание на деплой в GKE без плагинов, смс и регистрации. Одним глазком заглядываем Jenkins'у под пиджак

Все началось с того, что тимлид одной из наших команд разработчиков попросил в тестовом режиме выставить наружу их новое приложение, которое накануне было подвергнуто контейнеризации. Я выставил. Примерно... | https://habr.com/ru/post/514548/ | null | ru | null |

# AUTO_CLOSE

Если бы *SQL Server* существовал во времена Инквизиции, то за включение некоторых опций на продакшен серверах нужно было бы наказывать калёным железом. Но если отбросить лирику, то далее на рассмотрим почему не нужно включать *AUTO\_CLOSE* и к чему может привести использование этой опции.

Собственно, к... | https://habr.com/ru/post/275873/ | null | ru | null |

# How to Implement Tinder Swipe Cards in SwiftUI

In June, we heard about [SwiftUI](https://www.iosapptemplates.com/blog/ios-development/swiftui-introduction) for the first time — a totally new way of creating and working with UI elements in iOS and macOS (also iPadOS) apps. It felt like Christmas in the summer. It's n... | https://habr.com/ru/post/476494/ | null | en | null |

Subsets and Splits

No community queries yet

The top public SQL queries from the community will appear here once available.