text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

values | source stringclasses 4

values |

|---|---|---|---|---|

# Hyperstack vs Hotwire (перевод)

Попробую приноровиться к хабру и залью сюда перевод статьи с [другого своего ресурса](https://blog.rnds.pro/012-hotwire).

---

Это весьма самоуверенное, но, надеюсь, честное и точное сравнение Hyperstack и Hotwire.

Прежде всего, что это за вещи?

**Оба решения помогают затащить совр... | https://habr.com/ru/post/550118/ | null | ru | null |

# Индикатор прогресса с помощью HTML5 Canvas

Привет, Хабр!

Всё больше статей появляется про Canvas, и это не может не радовать. [Основы](http://habrahabr.ru/blogs/html5/111308/), будем надеяться, уже изучены, а мне хотелось бы поделиться примером возможного практического использования canvas, а именно создать аними... | https://habr.com/ru/post/113782/ | null | ru | null |

# Как за 15 минут собрать базу стартапов в любой стране через AngelList

Если вы заняты однообразным процессом, то велики шансы, что его можно автоматизировать. AngelList — платформа, соединяющая инвесторов и стартапы. В России на AngelList зарегистрировано 1300+ стартапов, и работать с ними напрямую через сайт можно, ... | https://habr.com/ru/post/293648/ | null | ru | null |

# 1.5 Компиляция SFML с помощью CMake

*От переводчика: данная статья является пятой в цикле переводов официального руководства по библиотеке SFML. Прошлую статью можно найти [тут.](https://habrahabr.ru/post/279147/ "Предыду... | https://habr.com/ru/post/279279/ | null | ru | null |

# Symfony2. Универсальный инструмент для быстрого приготовления табличных списков в административной панели

Речь пойдет о бандле для Symfony2, первую версию которого я написал более двух лет назад. Всё это время я и мои коллеги активно его использовали, бандл периодически улучшался. Решил поделиться им с сообществом. ... | https://habr.com/ru/post/250039/ | null | ru | null |

# Еще один вариант среды для разработки WordPress (docker, wp-cli)

Есть официальные образы для развертывания WordPress и использования wp-cli. Но при их совместном использовании мне приходилось расшаривать всю папку WordPress и хотелось, чтобы было больше возможностей для кастомизации установки.

Очень хотелось после ... | https://habr.com/ru/post/461999/ | null | ru | null |

# Повышаем производительность C# кода с помощью Span<T> и Memory<T>

Эта статья познакомит вас с новыми типами, представленными в C# 7.2: Span и Memory. Я подробно разберу Span и Memory и покажу, как работать с ними в C#.

### Что вам понадобится

Если вы хотите сами протестировать примеры кода, приведенные в этой стат... | https://habr.com/ru/post/708210/ | null | ru | null |

# Криптографический АРМ на базе стандартов с открытым ключом. Выпуск SSL-сертификатов. Эпилог

Вот мы и [добрались](https://habr.com/ru/post/464017/) до создания самоподписанных сертификатов.

Где применяются самоподписанные сертифика... | https://habr.com/ru/post/468817/ | null | ru | null |

# msvcore – c++, кроссплатформенная библиотека, велосипед и 12 лет разработки

Привет Хабр, я хочу рассказать о творении, на которое потратил свою молодость~~, уж лучше бы пил и курил~~.

Msvcore – это кроссплатформенная библиотека для c++, написанная с нуля по принципам оптимальности, открытости и простоты. По крайн... | https://habr.com/ru/post/316220/ | null | ru | null |

# Объединяем Blazor и Razor Pages в одном ASP.NET Core 3 приложении

***Перевод статьи подготовлен в преддверии старта курса [«C# ASP.NET Core разработчик»](https://otus.pw/IFnr/).***

---

В этой статье я расскажу, как вы можете д... | https://habr.com/ru/post/516434/ | null | ru | null |

# Удивительно простой, но красивый CSS-эффект

Наткнулся на очень простой в реализации, но интересный rollover-эффект для кнопок на CSS. Автор — некий японец [ksk1015](https://twitter.com/ksk1015).

[Демонстрация эффект... | https://habr.com/ru/post/154139/ | null | ru | null |

# Последний отсчёт — Гугл развлекается

Некоторое время назад я писал о смешном методе-проверке [«А не козёл ли ты, пользователь?»](https://geektimes.ru/post/241122/). Сегодня обнаружил ещё один забавный метод для новенькой Android 8.0.

Чисто случайно перечитывал документацию по компоненту **Chronometer**. Обнаружил... | https://habr.com/ru/post/337340/ | null | ru | null |

# Директивы в AngularJS

Директивы — это ключевая особенность [AngularJS](http://angularjs.org/). С помощью директив можно добавлять новое поведение существующим HTML элементам, можно создавать новые компоненты. Примерами директив, добавляющих новое поведения для существующих HTML элементов, могут служить [input](http:... | https://habr.com/ru/post/164493/ | null | ru | null |

# Организуем ML-проект с помощью Ocean

Вступление

----------

За годы разработки ML- и DL-проектов у [студии Surf](https://surf.ru/) накопились и большая кодовая база, и много опыта, и интересные инсайты и выводы. При старте ново... | https://habr.com/ru/post/459340/ | null | ru | null |

# Монорепо: typescpript & workspaces npm. Настройка и публикация в npm

Существуют разные способы создания монорепозитория в node.js, есть разные библиотеки для этих целей: yarn workspaces, lerna и так далее. Но сегодня я хочу коротко рассказать о монорепозитории на typescript, используя только npm.

Монорепозиторий в ... | https://habr.com/ru/post/540114/ | null | ru | null |

# (Архив) Matreshka.js v0.2

**Статья устарела. См. [актуальную историю версий](http://ru.matreshka.io/#whats-new).**

* [Введение](http://habrahabr.ru/post/196146/)

* [Наследование](http://habrahabr.ru/post/200078/)

* [MK.Object](http://habrahabr.ru/post/196886/)

* [MK.Array](http://habrahabr.ru/post/198212/)

* [Mat... | https://habr.com/ru/post/231333/ | null | ru | null |

# Процедурная генерация планов помещений

Что делает крупный разработчик игр, когда ему нужно состряпать много помещений для игрового мира? Нанимает кучу художников. Что делает ленивый/бедный/одинокий разработчик игр в такой же с... | https://habr.com/ru/post/184818/ | null | ru | null |

# «Если уже слили»: как сделать документооборот чуточку безопаснее — базовые ИБ-рекомендации

Ранее мы обсуждали неочевидные моменты, связанные с [ротацией парольных фраз](https://1cloud.ru/blog/analitika-zashity-personalnyh-dannyh) и персональной ИБ. Сегодня продолжим тему, но поговорим о работе с файлами, а именно о ... | https://habr.com/ru/post/522914/ | null | ru | null |

# Xen networking: проблема выбора

### Preface

Жил-был на сервере Xen hypervisor, виртуальные машины крутил, по сети трафик гонял, ни о чём не думал.

Сеть жила через xenbr0, который обьединял eth0 и виртуальные интерфейсы.

Кроме eth0 был на сервере ещё один интерфейс — eth1. Который за ненадобностью не использов... | https://habr.com/ru/post/50560/ | null | ru | null |

# Как аккуратно залезть в кишки WebRTC при передаче голоса и видео

WebRTC — технология интересная, но чуток запутанная. В первую очередь тем, что это не одна технология, а комбайн. Захват видео с камеры и звука с микрофона. Уст... | https://habr.com/ru/post/316840/ | null | ru | null |

# Dynamic CDN for Low Latency WebRTC Streaming with Transcoding

In the [first part](https://habr.com/en/company/flashphoner/blog/477304/) we have deployed a simple dynamic CDN for broadcasting WebRTC streams to two continents and have... | https://habr.com/ru/post/477876/ | null | en | null |

# Пасьянсная сортировка

[](https://habr.com/post/431094/)

В комментариях к предыдущим статьям изредка раздаются упрёки — зачем вообще изучать какие-либо другие сортировки, если уже есть самая быстрая в мире Quick sort. Мол-де, вся... | https://habr.com/ru/post/431094/ | null | ru | null |

# WimaxYota для 2.6.31-14-generic (netbook Remix ubuntu 9.10, intel 5150)

Итак, я перепробовал множество мануалов для поднятия Йоты, и у меня ничего не получилось. Пришлось все равно додумывать за авторов и править ручками. И вот он, готовый ман для поднятия йоты без проблем.

**Все операции под тегом `Код` выполняе... | https://habr.com/ru/post/77385/ | null | ru | null |

# Коронавирус: мы все умрём?

*Что мы говорим Богу смерти? — Не сегодня.

Сирио Форель, сериал «Игра престолов».*

Насколько действительно опасен коронавирус COVID-19? Сколько людей умрёт от коронавируса в мире? А сколько – в России? Так ли необходимы жесткие меры, принимаемые для борьбы с коронавирусом в большинс... | https://habr.com/ru/post/496266/ | null | ru | null |

# Профилируем sort во FreeBSD

Программа sort во FreeBSD считывает строки из стандартного ввода или файла и возвращает те же строки в отсортированном порядке. В NetBSD есть аналогичная программа, есть такая же... | https://habr.com/ru/post/667286/ | null | ru | null |

# OpenGL на Apple M1

Apple ведёт активную борьбу с открытыми стандартами и некоторое время назад объявила OpenGL "устаревшим" на своей платформе macOS Mojave 10.14, двигая разработчиков в сторону проприетарного графического API Metal. Анонсы Mac mini на чипсете **Apple M1** (ARM) и **macOS 11 Big Sur** были восприняты... | https://habr.com/ru/post/533018/ | null | ru | null |

# Rust 1.5: Cargo с блэкджеком

Под новогодние праздники был выпущен Rust 1.5. Так как близится релиз 1.6, хочу наверстать упущенное, и рассказать о том, что появилось в последней стабильной версии. Существенные изменения затронули Cargo!

Основное изменение, которое вы получите — это команда **cargo install**. Её пр... | https://habr.com/ru/post/275157/ | null | ru | null |

# Кластерное хранилище для небольших web-кластеров на базе drbd+ocfs2

**О чем мы расскажем:**

Как быстро развернуть общее хранилище для двух серверов на базе решений drbd+ocfs2.

**Для кого это будет полезно:**

Туториал станет полезен системным администраторам и всем, кто выбирает способ реализации хранилища ... | https://habr.com/ru/post/445612/ | null | ru | null |

# WebSphere MQ для начинающих

#### Введение

В рамках одной из задач было необходимо интегрироваться с внешней системой. В проме и у всех разработчиков стоит IBM WebSphere поэтому WebSphere MQ отлично вписывался, учитывая также то, что с IBM WebSphere у них отличная интеграция «из коробки». Для начала установим и наст... | https://habr.com/ru/post/176209/ | null | ru | null |

# Пишем виджет рабочего стола под Maemo5 на Qt. Часть вторая и заключительная

Доброго времени суток, хабрапользователь. Продолжаю цикл статей о Nokia N900. И продолжаю начатую в прошлый раз [статью о написании виджета для N900 на Qt](http://habrahabr.ru/blogs/qt_software/98091/). И так, в прошлый раз мы сделали просто... | https://habr.com/ru/post/99182/ | null | ru | null |

# Runtime-генерирование .Net-кода для тех, кому некогда

Инфраструктура .Net содержит встроенные средства генерирования кода (On-the-Fly Code Generation). Это позволяет .Net-программе в момент своего исполнения самостоятельно (без участия программиста) скомпилировать текст, написанный на каком-либо языке программирован... | https://habr.com/ru/post/199266/ | null | ru | null |

# Загрузка музыки ВКонтакте

Доброго времени суток всем.

Захотелось мне скачать всю мою музыку со ВКонтакте на флешку, как в старые добрые времена. Немного погуглив и не найдя практически ничего более менее приемлемого, я решил действовать своими силами. Спустя пол часа получился вполне себе рабочий скрипт. Итак, нач... | https://habr.com/ru/post/468735/ | null | ru | null |

# Dropbox — простейший минихостинг сайтов

Как показали комментарии к моему [хабратопику](http://habrahabr.ru/blogs/japan/83387/), где я упомянул о способе хостинга сайта, используя только Dropbox, знают далеко не все. То есть все знают, что это один из самых неплохих продуктов для синхронизации файлов (более того, его... | https://habr.com/ru/post/83418/ | null | ru | null |

# Отладка Java-приложений из командной строки

Некоторые ошибки трудно воспроизвести на вашем персональном компьютере, но их легко воспроизвести на производственных или тестовых машинах. Это обычная ситуация, с которой часто сталкиваются профессиональные Java-разработчики. Для отладки таких проблем OpenJDK предоставляе... | https://habr.com/ru/post/564614/ | null | ru | null |

# Пока все дома: как защитить инфраструктуру IT-компании на удалёнке

Карантин заставил IT-отрасль перейти на удаленку. Оказалось, что инфраструктура многих компаний к такому не готова — удаленный доступ дается на скорую руку, а VPN-сервера конфигурируют за пару дней. А еще дистанционная работа обостряет человеческий ф... | https://habr.com/ru/post/498338/ | null | ru | null |

# Разработка цифровой аппаратуры на C++/SystemC глазами SystemVerilog программиста

SystemC это библиотека для C++ позволяющая моделировать всевозможные аппаратные системы на различном уровне абстракции. Поддерживается как т... | https://habr.com/ru/post/274137/ | null | ru | null |

# Методы разработки потока программного обеспечения датчиков движения, работающих с Arduino

Привет, Хабр! Хочу предложить реализацию двух подходов разработки программного обеспечения датчика движения, работающего совместно с платой Arduino. Ни датчик движения [1], ни Arduino [2]. в дополнительной рекламе не нуждаются.... | https://habr.com/ru/post/337982/ | null | ru | null |

# WebSocket ориентированое Api на Nest.js

В этой статье я расскажу как написал модуль под Nest.js позволяющий писать классическое RESTFull API со swagger'ом но клиент будет полностью на WebSocket'ах, звучит странно не так ли? Но зато очень быстро и удобно по итогу).

Идея состоит в том, что вы пишите классическое доку... | https://habr.com/ru/post/696252/ | null | ru | null |

# Как реализовать конвертацию из растра в черно-белый вектор на сайте

Все графические файлы делятся на два глобальных типа — растровые и векторные. Иногда нужно сделать конвертацию из растра в черно-белый вектор. Например, для трассировки черно-белых иконок, QR-кодов, штрих-кодов, картинок с растровыми надписями, чеко... | https://habr.com/ru/post/261673/ | null | ru | null |

# Ловушки языка С++

Было бы неплохо сделать серию статей, в которых описывались различные не очевидные «особенности» языков программирования. Во-первых, «предупреждён — значит, вооружён», во-вторых, знание их позволяет глубже понимать язык и объяснить, в случае чего, чем они опасны. Даже если в своём собственном коде ... | https://habr.com/ru/post/154033/ | null | ru | null |

# Что нового в PostgreSQL 11: улучшения в кастинге

Продолжая тему новый возможностей грядущего релиза PostgreSQL 11 (предыдущие посты: [раз](https://habr.com/company/postgrespro/blog/353126/), [два](https://habr.com/company/postgr... | https://habr.com/ru/post/358256/ | null | ru | null |

# Прикоснемся к магии или как я вступил в ряды MISTического общества

*Ниже предложен рецепт приготовления деликатеса, позволяющего Вам попробовать различные 8 и 16-битные приставки и компьютеры. Основное же блюдо для меня miniMIG ... | https://habr.com/ru/post/549236/ | null | ru | null |

# Наводим мосты между Flutter и нативными библиотеками

Все вы знаете, что Flutter реализует несколько абстракций для передачи данных между Dart-кодом и кодом, связанным с оболочкой Flutter Engine на языке пла... | https://habr.com/ru/post/692530/ | null | ru | null |

# Слать биткоины бесполезно: автору Petya заблокировали почтовый ящик

Немецкий почтовый провайдер Posteo [закрыл](https://posteo.de/blog/info-zur-ransomware-petrwrappetya-betroffenes-postfach-bereits-seit-mittag-gesperrt) почтовый ящик `wowsmith123456@posteo.net`... | https://habr.com/ru/post/357374/ | null | ru | null |

# Конечные автоматы на страже порядка

При разработке сложных систем часто сталкиваешься с проблемой прозрачности кода, точным описанием бизнес-логики и масштабирования решения. Однажды нам поставили задачу: реализовать функциональ... | https://habr.com/ru/post/529036/ | null | ru | null |

# Отдам в хорошие руки…

… LGPL проект:

* [html2ps/pdf](http://www.tufat.com/html2ps.php)

* он же [на sf.net](http://sourceforge.net/projects/html2ps/),

* он же [на freshmeat.net](http://freshmeat.net/projects/html2ps_php/),

* он же [на code.google.com](http://code.google.com/p/html2pdf/).

Разработчики

============... | https://habr.com/ru/post/38090/ | null | ru | null |

# VulnHub: Разбор DC416 Dick Dastardly

Команда VulnHub подготовила целую серию квестов, с конференции [DefCon Toronto's](https://dc416.com/), скачать и опробовать которые вы можете по [ссылке](https://www.vulnhub.com/entry/... | https://habr.com/ru/post/318372/ | null | ru | null |

# Делим на страницы

Практически в любом сайте есть нужда разбить вывод информации на страницы. В джанге уже есть некоторые вещи которые помогут в написании своего пагинатора, но вот что бы взять и в две строчки сделать пагинацию для любой вьюшки — такого пока не встречал.

Я решил написать такой, благо идея как его... | https://habr.com/ru/post/76961/ | null | ru | null |

# Мобильное приложение HTML5: ошибка или успех. Попытка №0

За несколько лет, читая новости и события в мире Web разработки, у меня нарисовалась розовая мечта: написал один раз — работает везде и всегда. При этом очень часто встречаю негативные отзывы о разработке мобильных приложений на HTML5 ( [тут](http://habrahabr.... | https://habr.com/ru/post/185316/ | null | ru | null |

# Go contribution workshop в России

Давно планировали отправить патч в Go, но постоянно откладывали? Сталкивались с трудностями, не знали, с чего начать? В данной статье я опишу как мы проводили Go contribution workshop в Казани, о ... | https://habr.com/ru/post/413815/ | null | ru | null |

# Профилируем события Sysmon при внедрении в инфраструктуру

Если Вы опытный инженер SOC и настраивали уже несколько раз мониторинг инфраструктуры с нуля, то врядли найдете для себя что-то новенькое. Всех остальных приветствую в своей первой статье).

Одним прекрасным утром прилетела задача внедрить [Sysmon](https://do... | https://habr.com/ru/post/664916/ | null | ru | null |

# Деплой Elasticsearch на AWS с помощью Kubernetes за 10 шагов

[Kubernetes](https://kubernetes.io) aka `k8s` — это система с открытым исходным кодом для автоматизации развертывания, масштабирования и управления контейнерными приложе... | https://habr.com/ru/post/416643/ | null | ru | null |

# Сортировка вставкой в хэш-таблицу

Предлагаю вашему вниманию новый (как я думаю) алгоритм сортировки. Пытался искать похожее, но аналогов не увидел. Дайте знать, если видели что-то подобное.

Суть сортировки в том, что хэш-функция и разрешение коллизий построены таким образом, что в хэш-таблице данные оказываются у... | https://habr.com/ru/post/203032/ | null | ru | null |

# Сколько заработает ваша мобильная игра?

*Разработка мобильных игр — отрасль с очень высокой конкуренцией. Миллионы игр в Google Play и Apple Store, позабытые пользователями сразу после запуска, и редкие истории успеха тому свидетельство. В очередном посте блога [«Менеджмент игровых интернет-проектов»](http://hsbi.hs... | https://habr.com/ru/post/322552/ | null | ru | null |

# Пишем игру-клон Super Mario Brothers (часть 1)

Для многих из нас Super Mario Brothers была первой игрой, которая по-настоящему завораживала своим игровым процессом.

Интуитивное управление SMB и великолепный дизайн уровней от Nintendo заставляли проводить ча... | https://habr.com/ru/post/162747/ | null | ru | null |

# Стековый язык программирования на JavaScript в 34 строки

##### Информация для тех кто не знает что такое стековый язык:

Следующая строка подло скопирована с [Wikipedia](http://ru.wikipedia.org/wiki/%D0%A1%D1%82%D0%B5%D0%BA%D0%BE%D0%B2%D1%8B%D0%B9_%D1%8F%D0%B7%D1%8B%D0%BA) ... | https://habr.com/ru/post/111151/ | null | ru | null |

# Уроки от начинающего основателя и генерального директора GawkBox

#### После 3-х лет, 4.4-х миллионов долларов инвестиций, 500 000 пользователей и более 1 миллиона долларов дохода, мы просто закрылись. Уроки от начинающего основателя и генерального директора.

Прошло несколько недель с тех пор, как я объявил, что мы ... | https://habr.com/ru/post/507990/ | null | ru | null |

# PHP Фреймворк CodeIgniter — скоро для пользователей CUBRID

Заголовок уже говорит обо всем. Но я расскажу более подробно о начале разработки и взаимодействии CUBRID с CodeIgniter. Также здесь Вы узнаете об отличиях между CUBRID и MySQL с точки зрения разработки и адаптирования приложений.

В начале этого месяца я [... | https://habr.com/ru/post/127354/ | null | ru | null |

# Так ли быстр ваш любимый С или нативная реализация линейной алгебры на D

Тем, кто занимается системами машинного обучения и компьютерным зрением, хорошо знакома такая библиотека как OpenBLAS (Basic Linear Algebra Subprograms). OpenBLAS написан на C и используется повсеместно там где нужна работа с матрицами. Так же ... | https://habr.com/ru/post/311568/ | null | ru | null |

# VPS на Linux с графическим интерфейсом: запускаем сервер X2Go на Ubuntu 18.04

[](https://habr.com/ru/company/ruvds/blog/514894/)

Настройку [VNC](https://habr.com/ru/company/ruvds/blog/510860/) и [RDP](https://habr.com/ru/company/... | https://habr.com/ru/post/514894/ | null | ru | null |

# print или echo, что быстрее?

Под катом перевод довольно старого поста Фабиена (Fabien Potencier) на тему print vs echo, примечательного, на мой взгляд, методом установления «истины». В отличии от подавляющего большинства подобных исследований, в этом вы не найдете запуска скриптов с echo и print миллионы раз.

*Ди... | https://habr.com/ru/post/211156/ | null | ru | null |

# Пересылка больших файлов. Автоматическое получение ссылки для скачивания на почту

Пользователям достаточно часто приходится заниматься пересылкой больших файлов как внутри локальной сети, так и за её пределы. К примеру, Пьеро нужно выслать Мальвине документацию объёмом 10 гигабайт. Тут на помощь не придет корпоратив... | https://habr.com/ru/post/276575/ | null | ru | null |

# Иван Тулуп: асинхронщина в JS под капотом

А вы знакомы с Иваном Тулупом? Скорее всего да, просто вы еще не знаете, что это за человек, и что о состоянии его сердечно-сосудистой системы нужно очень заботиться.

Об этом и о том, как работает асинхронщина в JS под капотом, как Event Loop работает в браузерах и в Node... | https://habr.com/ru/post/417461/ | null | ru | null |

# Как можно установить «опасный» российский сертификат в Windows

Это и не статья, а всего лишь заметка, которая появилась в связи с грядущим окончанием действия TLS сертификатов у Сбербанка и некоторым бурлением, связанным с этим событием. В комментах к другой статье по этой же теме я предложил возможное решение, и мн... | https://habr.com/ru/post/692268/ | null | ru | null |

# Поиск по файлопомойкам

Иногда приходится искать файлы на всяких файлопомойках типа rapidshare. Так как единого поискового механизма не предлагается, слепил левою рукою такую штуковину–искалку. Её можно вставлять в страницы, при нажатии на линк «искать» выкидывается промпт, куда задаётся искомое понятие, по нажатию «... | https://habr.com/ru/post/44655/ | null | ru | null |

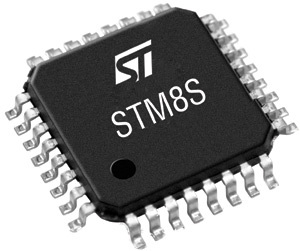

# Переходим с STM32 на российский микроконтроллер К1986ВЕ92QI. Опрашиваем клавиши, генерируем ШИМ. Часть вторая

#### Вступление.

В [предыдущей статье](http://habrahabr.ru/post/267051/) мы с вами повторили общую структуру таймера и детально рассмотрели ручной способ настройки ШИМ канала с использованием CMSIS. Но мног... | https://habr.com/ru/post/270863/ | null | ru | null |

# Как сделать красивую документацию для Web API, за которую будет не стыдно

Я хотел бы рассказать вам об утилите, с которой вы сможете забыть о боли создания документации для Web API. О том как это сделать прошу всех под кат.

. Там я упомянул, что загрузчик можно реализовать и с помощью html5 File API. Несколько вечеров... | https://habr.com/ru/post/133351/ | null | ru | null |

# Многопоточность в .NET: когда не хватает производительности

Платформа .NET предоставляет множество готовых примитивов синхронизации и потокобезопасных коллекций. Если при разработке приложения нужно реализовать, например, потоко... | https://habr.com/ru/post/468611/ | null | ru | null |

# Дамп прошивки беспроводной Logitech K360 с помощью GreatFET

[](https://habr.com/ru/company/ruvds/blog/561178/)

Недавно чисто ради спортивного интереса я решил хакнуть клавиатуру, и в качестве первой подопытной выбрал самую дешеву... | https://habr.com/ru/post/561178/ | null | ru | null |

# Защитное программирование

Один из моих читателей, Барри Гайлз, недавно написал мне и задал достаточно интересный вопрос, который, по моему мнению, достоен обсуждения:

> «Недавно я столкнулся с одной интересной ситуацией на работе: я производил ревью кода и вставил защитные проверки – одну для проверки аргумента к... | https://habr.com/ru/post/191548/ | null | ru | null |

# Compile-time проверка в C/C++

C/C++ позволяют выполнить проверки константных выражений ещё на этапе компиляции программы. Это дешёвый способ избежать проблем при модификации кода в будущем.

Я рассмотрю работу с:

* перечислениями (enum),

* массивами (их синхронизацию с enum),

* switch-конструкциями,

* а так же ... | https://habr.com/ru/post/138813/ | null | ru | null |

# Как мы делали тариф для Windows VPS за 99 рублей

Если вы являетесь клиентом VDS-хостинга, задумывались ли вы о том, что идет в комплекте со стандартным образом операционной системы?

Мы решили поделиться, как мы готовим стандартные клиентские виртуальные машины и покажем на примере нашего нового тарифа [Ultralight... | https://habr.com/ru/post/469549/ | null | ru | null |

# Tesseract OCR tips — создание своего словаря для повышения эффективности OCR

Это мой первый пост об оптическом распознавании текста (OCR) с использованием Tesseract. Tesserast это очень популярная open source библиотека для OCR поддерживаемая Google, которая дает высокие результаты точности и поддерживает более 100 ... | https://habr.com/ru/post/466571/ | null | ru | null |

# АЦП в качестве генератора случайных чисел

Доброго времени суток! Решил рассказать о простом и интересном способе получения честных случайных чисел на микроконтроллерах, не имеющих на борту аппаратного генератора случайны... | https://habr.com/ru/post/259623/ | null | ru | null |

# Хватит злоупотреблять *args и **kwargs в Python

Photo by Matthew Henry on UnsplashДа будет холивар! Использовать args/kwargs или не и... | https://habr.com/ru/post/534672/ | null | ru | null |

# ZFS on Linux — не все так просто

Прочитав статью [«ZFS on Linux — легко и просто»](http://habrahabr.ru/post/152853/), решил поделиться своим скромным опытом использования этой ФС на паре Linux-серверов.

Вначале — лирическое отступление. ZFS — это круто. Это настолько круто, что перекрывает все недостатки ФС, порт... | https://habr.com/ru/post/153461/ | null | ru | null |

# Chorda. Пробуем сделать это декларативно

Каждый раз, когда мне нужно сесть за создание нового приложения, я впадаю в легкий ступор. Голова идет кругом от необходимости выбрать, какую же библиотеку или фреймворк взять на этот раз. Вот в прошлый раз я писал на библиотеке X, но теперь уже подрос и хайпанулся фреймворк ... | https://habr.com/ru/post/480856/ | null | ru | null |

# МиниSCADA своими руками

Однажды, мне позвонили и спросили – могу ли я сделать маленькую автоматизацию для канализационной насосной станции (КНС)? Толком ничего не выспросив и положив трубку я стал раздумывать что и как сделать.

Являясь специалистом по SCADA более 10-ти лет, в основном по продуктам томской компан... | https://habr.com/ru/post/153619/ | null | ru | null |

# Swift: решето Эратосфена

Это будет совсем небольшая публикация, на которую меня вдохновила [эта статья.](https://habr.com/ru/post/450604/) Нет, я не собираюсь соревноваться с предложенным там решением (разве что в краткости), но, может быть, как демонстрация возможностей Swift, она будет интересна хабрасообществу. ... | https://habr.com/ru/post/450888/ | null | ru | null |

# Все, что вы хотели знать про Qwik — новый фреймворк от создателя Angular

В начале мая, [Misko Hevery](https://twitter.com/mhevery), создатель фреймворка [Angular](https://angular.io/), [объявил](https://twitter.com/mhevery/status/1389649693630631936) о своем уходе из Google и команды Angular - в компанию [builder.io... | https://habr.com/ru/post/564990/ | null | ru | null |

# Asterisk Managment Interface (AMI), Часть 1

AMI — мощный и удобный программный интерфейс (API) Asterisk для управления системой из внешних программ. В дополнение к AMI, часто используется AGI — это интерфейс для запуска внешних приложений, управляющих каналом Астериска в рамках конкретного вызова. Благодаря AMI внеш... | https://habr.com/ru/post/64105/ | null | ru | null |

# Автоматизированная сборка Delphi-приложения

Я довольно часто сталкивался с тем, что разработчики на Delphi (можно сказать традиционно) компилируют свои приложения "ручками", что далеко не production-решение, а со стороны выглядит кустарщиной и *"делаем на-коленке"*, хотя продукты бывают весьма серьёзными и продаваем... | https://habr.com/ru/post/489960/ | null | ru | null |

# Intel Software Guard Extensions, учебное руководство. Часть 3, проектирование для Intel SGX

В третьей части серии учебных материалов, посвященных расширениям Intel Software Guard Extensions (Intel SGX), мы поговорим о проектировании приложений, использующих Intel SGX. Мы используем принципы, изученные в [первой част... | https://habr.com/ru/post/318012/ | null | ru | null |

# Пишем адаптивный шаблон для Emlog CMS

Сегодня хотелось бы рассказать о Emlog CMS, о данной системе мало кто слышал, но она является хорошим вариантом для ведения личного сайта. Emlog работает быстро и стабильно, но уступает по функционалу Wordpress, например, и у этого скрипта меньше плагинов и шаблонов. Скрипт кита... | https://habr.com/ru/post/305330/ | null | ru | null |

# Тестирование параллельных процессов

Вы встречались с ошибками, которые возникают время от времени в продакшне, но никак не воспроизводятся локально? Бывает, изучаешь такой баг и вдруг понимаешь, чт... | https://habr.com/ru/post/327292/ | null | ru | null |

# GPS Tracker на ардуино своими руками

После нескольких экспериментов с ардуиной решил сделать простенький и не очень дорогой GPS-tracker с отправкой координат по GPRS на сервер.

Используется Arduino Mega 2560 (Arduino Uno), SIM900 — GSM/GPRS модуль (для отправки информации на сервер), GPS приёмник SKM53 GPS.

... | https://habr.com/ru/post/196150/ | null | ru | null |

# IoT за копейки: делаем устройство с веб-интерфейсом

*Автор: Николай Хабаров, Senior Embedded Developer, DataArt*

В этой статье мы расскажем, как создать собственное устройство с веб-интерфейсом в домашней сети, использ... | https://habr.com/ru/post/398813/ | null | ru | null |

# Открытие телескопа Kepler: горячие планеты

Эта новость прошла мимо Хабра, тем не менее в своей отрасли она очень важна.

[Недавно запущеный](http://habrahabr.ru/blogs/popular_scien... | https://habr.com/ru/post/82027/ | null | ru | null |

# Рецепты PostgreSQL: получение типов колонок за один запрос

Для приготовления получения типов колонок за один запрос нам понадобится [postgres](https://www.postgresql.org). Можно также воспользоваться [готовым образом](https://hub.docker.com/r/rekgrpth/repmgr).

Сразу спешу огорчить: реализация будет не на SQL! Хот... | https://habr.com/ru/post/502680/ | null | ru | null |

# Как выглядит zip-архив и что мы с этим можем сделать

Доброго времени суток, уважаемый Хабр!

За последние пол года кривая дорожка моих пет-проектов завела меня в такие дебри, откуда до сих пор выбраться не представляется возможным. И начиналось-то все безобидно — сайт с картинками, но чувство перфекционизма, погон... | https://habr.com/ru/post/471066/ | null | ru | null |

# Документирование форматов информационного обмена — легко и просто

1. Вступление

-------------

В далеком 2001 году, консорциум W3C выработал рекомендации языка определения схем XML (XSD), объединив наиболее популярные языки описания схем в один стандарт. Основная цель, которая при этом преследовалась – получение пла... | https://habr.com/ru/post/418345/ | null | ru | null |

# JavaFX -- безыдейный HelloWorld

Описание запуска HelloWorld из примера, предложенного Oracle в «Getting Started with JavaFX», но безыдейно, то есть, без IntelliJ IDEA и вообще какой-либо IDE. Реали... | https://habr.com/ru/post/197494/ | null | ru | null |

# Манускрипт Войнича. Маньчжурский кандидат

[Манускрипт Войнича](http://ru.wikipedia.org/wiki/%D0%A0%D1%83%D0%BA%D0%BE%D0%BF%D0%B8%D1%81%D1%8C_%D0%92%D0%BE%D0%B9%D0%BD%D0%B8%D1%87%D0%B0) (МВ или VMS) называют чашей Грааля криптографии. За несколько сотен лет тысячи человеко-дней были потрачены и продолжают тратиться в... | https://habr.com/ru/post/186952/ | null | ru | null |

# Цикл уроков по SDL 2.0: урок 6 — Загружаем шрифты с помощью SDL_ttf

*От переводчика:

Это продолжение серии переводов туториалов от Twinklebear, в оригинале доступных [тут](https://www.willusher.i... | https://habr.com/ru/post/494554/ | null | ru | null |

# Как узнать принцессу среди 500 амурских тигров с помощью vision transformers

*Рассказываем, как мы, ML princesses [Napoleon IT] стали победителями кейса от Минприроды «Защита редких животных», и решили зада... | https://habr.com/ru/post/663730/ | null | ru | null |

# C++ vtables. Часть 2 (Virtual Inheritance + Compiler-Generated Code)

*Перевод статьи подготовлен специально для студентов курса [«Разработчик С++»](https://otus.pw/HhBg/). Интересно развиваться в данном направлении? Смотрите запись мастер-класса [«Практика использования Google Test Framework»](https://otus.pw/B2p1/)... | https://habr.com/ru/post/480610/ | null | ru | null |

# Пара иногда востребованных хитростей при работе с git

Хочу поделиться рецептами решения пары задач, которые иногда возникают при работе с git, и которые при этом не "прямо совсем очевидны".

Сперва я думал накопить подобных рецептов побольше, однако всему своё время. Думаю, если есть польза, то можно и понемногу...

... | https://habr.com/ru/post/424045/ | null | ru | null |

# Метафизика Dependency Injection

Dependency Injection — это часто используемая техника в объектно-ориентированном программировании, предназначенная для уменьшения связанности компонентов. При правильном применении, помимо дост... | https://habr.com/ru/post/480364/ | null | ru | null |

# Google Suggest – взгляд изнутри…

Разные люди немного разбирались в принципе работы Google Suggest, но я переписал сжатый javascript код так, чтобы каждый обычный разработчик мог подробно узнать, как эта система работает. Моя финальная переписанная версия скрипта доступна [здесь](http://www.fastbugtrack.com/misc/goog... | https://habr.com/ru/post/31672/ | null | ru | null |

Subsets and Splits

No community queries yet

The top public SQL queries from the community will appear here once available.