text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

values | source stringclasses 4

values |

|---|---|---|---|---|

# TensorRT 6.x.x.x — высокопроизводительный инференс для моделей глубокого обучения (Object Detection и Segmentation)

*Больно только в первый раз!*

Всем привет! Дорогие друзья, в этой статье я хочу поделиться своим опытом ис... | https://habr.com/ru/post/483074/ | null | ru | null |

# Синхронизация пользователей Zimbra Collaboration OSE на основе Active Directory

1. Предпосылки

--------------

Настраивая сервер zimbra столкнулся с проблемой синхронизации пользователей по группе в Active Directory (AD). Если мы создаем нового пользователя в AD, то он нормально добавлялся, но если мы делаем доступ ... | https://habr.com/ru/post/495688/ | null | ru | null |

# Звук в Java

Часто в приложениях желательно использовать какие-то вспомогательные звуковые эффекты, например пикнуть динамиком при ошибке или проиграть мелодию на новое письмо.

Не все знают что в любом компьютере имеющем звуковую карту встроена большая библиотека звуков. Все звуковые платы поддерживают **воспроизв... | https://habr.com/ru/post/127840/ | null | ru | null |

# Использование V8

V8 — это движок JavaScript от Google, который используется в браузере Chrome. Он быстрый и доступен в исходных кодах (С++) для Linux (точнее для gcc) и под Windows.

В свете роста популярности использования V8 я решил поделиться своим (годичным) опытом его использования на платформе Windows в каче... | https://habr.com/ru/post/72474/ | null | ru | null |

# Go: Как использовать nil-значения без использования ссылочных типов

*Создано на базе изображений gopherize.me*

Довольно часто из Go кода нам приходится работать с различными HTTP API или самим выполнять роль HTTP сервиса.

Один и... | https://habr.com/ru/post/513216/ | null | ru | null |

# MAMP своими руками — собираем Apache под Mac OS X

Этот хабратопик будет из серии о том, как своими руками организовать MAMP (Mac OS X + Apache + MySQL + PHP) под Mac OS X.

Начнем с обновления Apache 2.

Думаю пользователям Mac OS X Leopard известно, что Apache (версии 2, начиная с 10.5.2) и так поставляется в к... | https://habr.com/ru/post/26012/ | null | ru | null |

# Что нового нас ожидает в Django 1.7

В данном посте представлен обзор новшеств и особенностей популярного среди Python разработчиков фреймворка Django 1.7. Релиз позиционируется как сообществом, так и основными разработчиками — как наиболее значимый релиз, с момента выхода в свет Django 1.0.

Компания Google наконец-то выпустила приложение [Google Maps for iOS](https://itunes.apple.com/us/app/google-maps/id585027354?mt=8), сегодня утром оно появилось в App Store.

Удивительно, но прог... | https://habr.com/ru/post/162445/ | null | ru | null |

# Переписываем Require.js с использованием Promise. Часть 2

В [прошлой части](http://habrahabr.ru/post/252783/) мы написали небольшую библиотеку, пожожую на require.js и позволяющую загружать AMD-модули. Настало время расширить ее возможности и сделать из нее полноценную замену оригинального require.js. Поэтому сегодн... | https://habr.com/ru/post/252849/ | null | ru | null |

# Как написать проект для продакшена командой из одного человека (или небольшой командой)

Соло-разработка проекта ПО — непростая задача. Никто не будет подталкивать тебя, проверять код и обеспечивать руководство, ты сам по себе пу... | https://habr.com/ru/post/552260/ | null | ru | null |

# Распознавание образов в R с использованием сверточных нейронных сетей из пакета MXNet

Это подробная инструкция по распознаванию образов в R с использованием глубокой сверточной нейронной сети, предоставляемой пакетом [MXNet](https://github.com/dmlc/mxnet). В этой статье приведен воспроизводимый пример, как получить ... | https://habr.com/ru/post/307242/ | null | ru | null |

# Почему иногда React/Redux в текущем состоянии give me creeps

React существует достаточно давно, чтобы мажорные изменения в этой библиотеке, не ощущались температурой подогрева кресел разработчиков в холод... | https://habr.com/ru/post/565904/ | null | ru | null |

# Краткий обзор отличий LESS от SASS

Вчера пол дня потратил на подробное изучение [LESS](http://lesscss.org/) и его отличие от используемых нами [SASS/SCSS](http://sass-lang.com/).

Синтаксис SASS мне импонирует больше чем SCSS за его краткость. Но большая вложенность стилей в SASS может быстро ликвидировать все пре... | https://habr.com/ru/post/130886/ | null | ru | null |

# Обмен информацией между рабочими нитям без боли? CSP-шные каналы нам в помощь

Разработка многопоточного кода — это сложное занятие. Действительно сложное. К счастью для упрощения жизни разработчиков давным-давно придуманы высокоуровневые абстракции, например, task-based parallelism, map-reduce/fork-join, CSP, actors... | https://habr.com/ru/post/358120/ | null | ru | null |

# Understanding node.js

[Node.js](http://nodejs.org/) обычно вызывал у людей, которым я о нём рассказывал, две различные реакции. В основном они воспринимали его «как есть», однако многие были сбиты с толку.

Если вы относитесь ко второй группе, я попробую объяснить, что же такое Node.js:

* Это инструмент командн... | https://habr.com/ru/post/104171/ | null | ru | null |

# Загрузка картинок в фоне. Модуль на JavaScript

Некоторое время назад я начал писать большой проект с высокой нагрузкой, в котором широко использовались возможности JavaScript. За это время пришлось переосмыслить многие вещи и столкнуться с необычными проблемами и различными уловками для их решения. Об одной из таких... | https://habr.com/ru/post/156589/ | null | ru | null |

# GSM Modem M95 от QUECTEL — опыт освоения

#### GSM Modem M95 от QUECTEL — опыт освоения

##### В начале

В первых строках своего поста хочу честно признаться что ранее опыта работы с GSM-модемами у меня не было, однако волею судьбы и служебной необходимостью набрел на сайт питерской конторы [«Сатрон»](http://satron.r... | https://habr.com/ru/post/180023/ | null | ru | null |

# Бот, играющий в Castlevania

Что это

=======

CastlevaniaBot — это плагин для [эмулятора NES Nintaco](https://nintaco.com/), который играет в Castlevania. Если запустить его на экране заставки, то плагин пройдёт всю игру от начала до конца. Или же можно запустить его в любом месте игры, чтобы он прошёл её часть.

В... | https://habr.com/ru/post/432784/ | null | ru | null |

# Пишем REST API на Vert.x. Часть 1: настройка окружения

Привет, харбаюзер. В этой серии статей мы напишем REST API с использованием Vert.x. Начнём с простого: установки самого vert.x-а и настройки запуска простого приложения в IDE.

##### Немного общей информации о фреймворке

Vert.x — этакий node.js из мира Java. ... | https://habr.com/ru/post/218733/ | null | ru | null |

# Каскадная инвалидация кэша. Часть 1

Вот уже несколько лет, как почти каждая статья о передовых подходах к кэшированию рекомендует пользоваться в продакшне следующими методиками:

* Добавление в имена файлов информации о версии содержащихся в них данных (обычно — в виде хэша данных, находящихся в файлах).

* Установ... | https://habr.com/ru/post/472860/ | null | ru | null |

# Лучшие публикации социальных сетей

Мой телеграм канал: <https://t.me/winc0de>.

Здравствуйте. В свободное от работы время я занимаюсь социальными проектами. У меня и моих друзей есть достаточное количество «пабликов» в разных социальных сетях, что позволяет нам проводить различные эксперименты. Остро стоит вопрос ... | https://habr.com/ru/post/238765/ | null | ru | null |

# Подключение и работа с MySQL в VB.NET

#### Предыстория. Выбор БД

Возникла необходимость подружить программу, написанную на VB, с сервером баз данных. Конечно, многочисленные сотоварищи — разработчики ПО могут поставить под сомнение мой выбор базы данных (и будут правы), назвав MSSQL самым простым и очевидным выбор... | https://habr.com/ru/post/162329/ | null | ru | null |

# PHP-Дайджест № 192 (2 – 16 ноября 2020)

[](https://habr.com/ru/post/528256/)

Свежая подборка со ссылками на новости и материалы. В выпуске: Последний релиз-кандидат PHP 8.0 перед финальным релизом и свежие материалы по PHP ... | https://habr.com/ru/post/528256/ | null | ru | null |

# XenApp: Опыт установки и настройки

Доброго времени суток, Хабровчане.

##### Преамбула

XenApp (читается «ЗенАп») придуман компанией Citrix для виртуализации и доставки приложений через тонкий клиент, посредством своего собственного протокола CIA. Надо сказать, что идея сама по себе хороша, потому что в теории изб... | https://habr.com/ru/post/134334/ | null | ru | null |

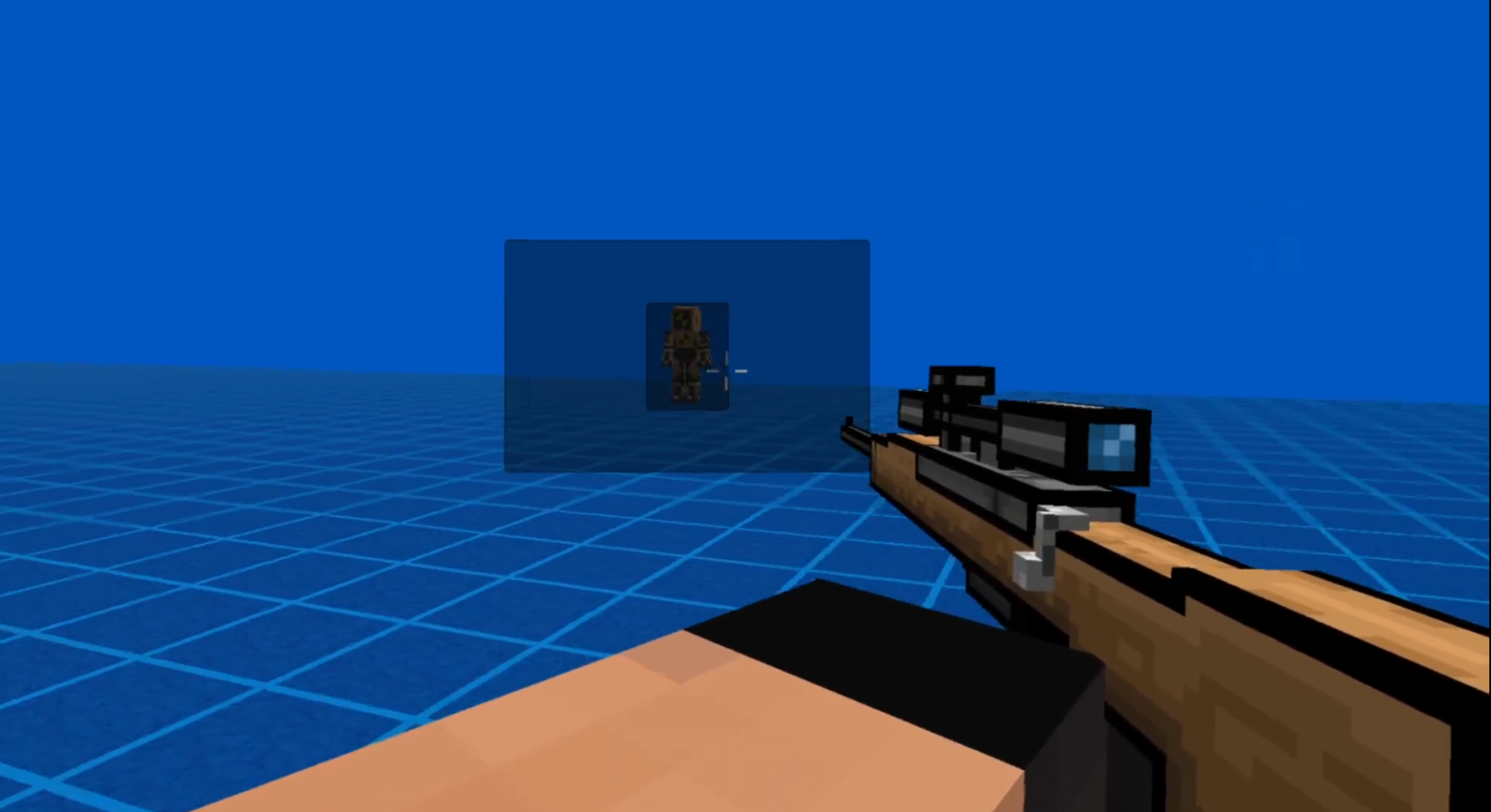

# Аим-ассист в мультиплеерном шутере — как сделать правильно

Аим-ассист — вечная тема для споров среди игроков. Для одних это узаконенный чит, для других — инструмент комфортной игры. Этическую сторону вопрос... | https://habr.com/ru/post/576812/ | null | ru | null |

# Виджет для Хабралюдей

Наверное кто-то обратил внимание, что вместо бокового баннера на главной Хабра появилось второе облако тегов. Тегов там конечно меньше, чем мы привыкли видеть, но зато обл... | https://habr.com/ru/post/19306/ | null | ru | null |

# Народный мониторинг ESP8266 MQTT Micropython

Как быстро, без особых вложений, начать выкладывать метеоданные на народный мониторинг?

Опишу одно из решений на базе ESP8266.

Алгоритм работы простой: контроллер раз в пять минут подключается к wi-fi, соединяется с брокером, замеряет температуру и шлет её брокеру. ... | https://habr.com/ru/post/341716/ | null | ru | null |

# Работа с сокетами в Qt

#### Введение

Как-то несколько лет назад, на одном из форумов, я нашел такую замечательную фразу — «Каждый уважающий себя программист в жизни должен написать свой чат-клиент». Тогда мои знания не позволяли сд... | https://habr.com/ru/post/111239/ | null | ru | null |

# Как перестать бояться и полюбить регулярные выражения

В работе и повседневной жизни мы буквально окружены текстами: книги и статьи, письма и чаты, веб-страницы и программный код. Да что там — сама биологическая жизнь основана на ДНК. И для эффективной работы по поиску или модификации текста уже давно был придуман мо... | https://habr.com/ru/post/536912/ | null | ru | null |

# Как в PHP улучшить читаемость регулярных выражений

Регулярные выражения — очень мощный инструмент, однако согласно общепринятому мнению, после того как они написаны, их очень трудно понять, поэтому их поддержка — не самое приятное занятие. Здесь собраны советы, которые помогут сделать из более читаемыми.

PHP исполь... | https://habr.com/ru/post/560460/ | null | ru | null |

# Проверяем уровень защищённости Linux с помощью утилиты Lynis

Разбираемся, как использовать одну из самых мощных свободно распространяемых утилит для аудита Linux-систем.

Вы когда-нибудь задумывались о том, насколько безопасна в... | https://habr.com/ru/post/503148/ | null | ru | null |

# 9 интересных новшеств в Laravel 9

иллюстрация © GOLTSЯ сразу, как только вышла новость о релизе, решил, что нужно посмотреть, пощупать и разобраться, чего же измени... | https://habr.com/ru/post/651553/ | null | ru | null |

# Локализация расширений Google Chrome — необходимо и просто

Разнообразие и легкая доступность расширений сыграли значительную роль в популярности браузера Google Chrome. Вероятно, многие из вас имеют опыт их написания. Возможно, еще не опыт, но уже желание попробовать или даже конкретную идею. Осталось лишь начать. ... | https://habr.com/ru/post/267501/ | null | ru | null |

# Опыт использования jQuery/AJAX/Telerik Extensions for MVC

Недавно занимался портированием проекта с “обычного” ASP.NET на ASP.NET MVC. Решил в силу развития технологий попробовать сделать красиво и асинхронно. Этот пост о том, что и как я писал, и что из этого получилось.

### Выбор технологий

Сейчас почему-то вс... | https://habr.com/ru/post/79175/ | null | ru | null |

# Генерация версии android приложения из ревизии subversion и git

Когда пользователи сталкиваются с проблемами — всегда хочется точно знать какой именно версией ПО они пользуются. При использовании системы контроля версий и автоматической нумерации версий ПО, такую информацию можно предоставить пользователям, а в случ... | https://habr.com/ru/post/132017/ | null | ru | null |

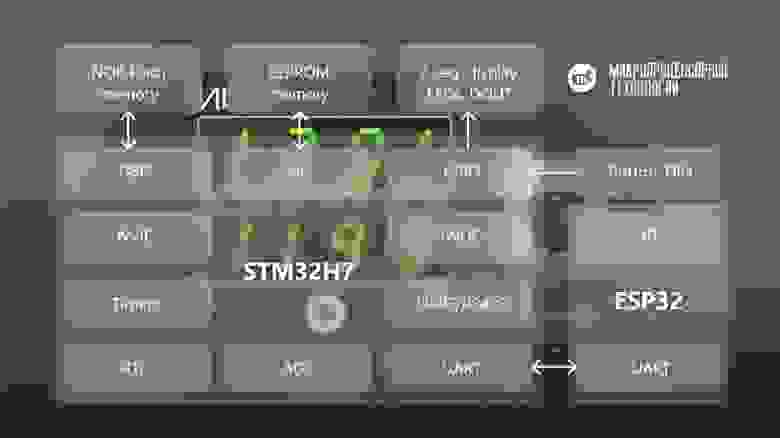

# Разработка измерительного прибора ИРИС

Приветствую, сообщество Хабра. Недавно наша компания выпустила на рынок контрольно-измерительный прибор ИРИС. Являясь главным программистом этого проекта, хочу рассказать вам про разра... | https://habr.com/ru/post/521572/ | null | ru | null |

# Сравнение анимации GIF, WebP, APNG, BPG

Чтобы создать эффект движения нужно повторить слегка измененную картинку с достаточно высокой скоростью. Например в кино эта скорость составляет 24 кадра в секунду. Чем она выше, тем движение выглядит плавнее.

[ с методиками оптимизац... | https://habr.com/ru/post/338870/ | null | ru | null |

# Четыре паттерна вызова функций в JavaScript

Язык JavaScript был представлен как язык функционального программирования. Причина заключается в том, что функции в JS не просто разделяют логику на операционные блоки, функции являются [объектами первого класса](http://ru.wikipedia.org/wiki/%D0%9E%D0%B1%D1%8A%D0%B5%D0%BA%... | https://habr.com/ru/post/155815/ | null | ru | null |

# прикручиваем плагины от Idea к WebIde

Сегодня успешно закончив написание одного маленького, но очень полезного лично для меня плагина к IDEA, расстроился из-за невозможности прикрутить его к WebIDE, хотя в Idea 7/8/9 полет нормальный.

И вот, взрустнув и занявшись сравнительным анализом «старых» и «новых/кошерных»... | https://habr.com/ru/post/76622/ | null | ru | null |

# Другие острова. Проект Ломбок для Java

Это статья является этаким вольным переводом-пересказом.

Оказывается, Ява — это не единственный остров, который как-то связан с разработками на Java. Вот вам ещё один, который называется "[Ломбок](http://ru.wikipedia.org/wiki/%D0%9B%D0%BE%D0%BC%D0%B1%D0%BE%D0%BA)". Именем эт... | https://habr.com/ru/post/72555/ | null | ru | null |

# Подборка @pythonetc, январь 2020

Новая подборка советов про Python и программирование из моего авторского канала @pythonetc.

← [Предыдущие публикации](https://habr.com/ru/search/?q=pythonetc#h)

)?"

Все примеры кода протестированные на MXNet v0.10.0 и могут не работать (или работать по-другому) в других версиях, однако полагаю, что общ... | https://habr.com/ru/post/334968/ | null | ru | null |

# Как настроить Apollo для работы с GraphQL в Android

### Зачем статья

Недавно у меня появилась необходимость реализовать работу с бэком на GraphQL. Туториалов по настройке на Android, в отличие от REST не так много и большинство из них уже не совсем актуальны.

### Что такое GraphQL

GraphQL — модная альтернатива ... | https://habr.com/ru/post/501184/ | null | ru | null |

# Установка Midnight Commander на Mac OS X Catalina (2020)

Государственный флаг СССРПричем здесь флаг СССР? Статья затрагивает программы из далеких 80-х го... | https://habr.com/ru/post/528138/ | null | ru | null |

# Манифест об отмене 146 УК и бойкоте Сбербанка и правообладателей-паразитов. За опенсорс и Nginx

`#nginxживи`

`#ЯМыNginx`

`#ЯМыСысоевКоновалов`

| | |

| --- | --- |

| | *Астрологи объявили неделю жадных юристов в IT.

Количество правообладятлов увеличилось вдвое.* |

Когда они вводили реестр запрещенных сайтов, ... | https://habr.com/ru/post/480644/ | null | ru | null |

# Настройка SBCL и среды разработки SLIME под Windows. Пошаговое руководство

В данной статье я подробно опишу как установить и настроить SBCL и окружение для продуктивной разработки под Windows.

Вообще, изначально это была небольшая заметка для коллеги по планируемому мной проекту по анализу и визуализации кода и т... | https://habr.com/ru/post/131418/ | null | ru | null |

# Учебный курс по React, часть 28: современные возможности React, идеи проектов, заключение

Сегодня, в заключительной части перевода курса по React, мы поговорим о современных возможностях React и обсудим идеи React-приложений, создавая которые, вы можете повторить то, чему научились, проходя этот курс, и узнать много... | https://habr.com/ru/post/447134/ | null | ru | null |

# Дурим DPI двумя скриптами

Данная статья является лиш исследованием на тему и не должна использоваться как инструкция к действию.

В связи с разгулом банхамера по интернет просторам участились советы по использованию различных прокси, vpn, tor и анонимайзеров. Эти все способы отправляют трафик третей стороне котора... | https://habr.com/ru/post/276141/ | null | ru | null |

# Быстрый поиск касательных и пересечений у выпуклых многоугольников

Я недавно сделал маленькую [библиотеку](https://github.com/ilyanikolaevsky/navmesh) для решения задачи поиска кратчайшего пути на 2D карте с выпуклыми препятствиям... | https://habr.com/ru/post/527714/ | null | ru | null |

# Безопасность в мобильных приложениях

Информационная безопасность это всегда гонка вооружений. Из чего следует одна простая мысль, что полная безопасность невозможна, особенно в случае с клиентскими приложе... | https://habr.com/ru/post/567370/ | null | ru | null |

# Инструментарий для анализа и отладки .NET приложений

Заглянуть «под капот» кода или посмотреть на внутреннее устройство CLR можно с помощью множества инструментов. Этот пост родился из [твита](https://twitter.com/matthewwarren/status/973940550473797633), и я должен поблагодарить всех, кто помог составить список подх... | https://habr.com/ru/post/463305/ | null | ru | null |

# Использование нейронных сетей для поиска ответов в таблицах

Большая часть информации в мире хранится в виде таблиц, которые можно найти в Интернете или в базах данных и документах. В таблицах может находиться всё что угодно, от технических характеристик потребительских товаров до финансовой статистики и данных эко... | https://habr.com/ru/post/582248/ | null | ru | null |

# Разграничение информационных систем при защите персональных данных

Предмет данной статьи — разграничение информационных систем при защите персональных данных с помощью программы Киберсейф Межсетевой экран. В статье будет показан пример развертывания программы и разграничения доступа групп ПК в реальной компании.

... | https://habr.com/ru/post/250127/ | null | ru | null |

# Swagger в Magento 2

Тенденция перехода от сборки HTML-страниц на стороне сервера к их сборке на стороне клиента уже даже не тенденция, а тренд. Magento 2, шагая в ногу со временем в меру своих возможностей, также пытается [быть в тренде](https://www.google.lv/webhp?sourceid=chrome-instant&ion=1&espv=2&ie=UTF-8#q=hea... | https://habr.com/ru/post/317770/ | null | ru | null |

# Запускаем AssemblyScript в Go

Пока одни обсуждают [что не так с WebAssembly](https://habr.com/ru/company/ruvds/blog/539100/), я думаю как его можно использовать вне браузера. Например написание [wasm фильтров](https://www.envoyproxy.io/docs/envoy/v1.17.0/configuration/http/http_filters/wasm_filter#config-http-filter... | https://habr.com/ru/post/540472/ | null | ru | null |

# Объяснение легковесных потоков в 200 строк на Rust

Объяснение легковесных потоков в 200 строк на Rust

==================================================

Легковесные потоки (ligthweight threads, coroutines, корутины, green threads) являются очень мощным механизмом в современных языках программирования. В этой статье... | https://habr.com/ru/post/543158/ | null | ru | null |

# Разметка медицинских данных (DICOM) в Computer Vision Annotation Tool

Второе десятилетие 21 века отлично показало, как многие трудно формализуемые в рамках классических методов задачи могут быть решены с использованием искусственных нейронных сетей. Важно и то, что для таких решений уже давно было найдено свое приме... | https://habr.com/ru/post/562994/ | null | ru | null |

# Ищем значение числа Пи, используя генератор случайных значений

> **Представьте, что у вас есть функция random(), которая генерируют случайным образом значения в промежутке ![[0;1]](https://habrastorage.org/getpro/habr/upload_files/eff/a38/faa/effa38faa5436724d67f327abc985718.svg)**

>

> **Вычислите значение числа , реализованную по [БЭМ-методологии](https://ru.bem.info/method). ... | https://habr.com/ru/post/267875/ | null | ru | null |

# Что происходит в Kubernetes при запуске kubectl run? Часть 1

***Прим. перев.**: Этот материал, озаглавленный в оригинале как «What happens when… Kubernetes edition!» и написанный Jamie Hannaford из компании Rackspace, является отличной иллюстрацией работы многих механизмов Kubernetes, которые зачастую скрыты от наше... | https://habr.com/ru/post/342658/ | null | ru | null |

# Пишем «Hello, World» Telegram бота на Си

Привет всем, не знаю зачем это надо, но может кому пригодится…

**Дисклеймер:** Я ни в коем случае не являюсь профессиональным Си программистом.

Что нам понадобится:

**1.** Любой компьютер на Linux, Ubuntu, Centos, MacOS… с доступом к порту 443 или 8443 из интернета. ... | https://habr.com/ru/post/325846/ | null | ru | null |

# Лучшие практики для контейнеров Kubernetes: проверки работоспособности

**TL;DR**

* Чтобы добиться высокой наблюдаемости контейнеров и микросервисов, журналов и первичных метрик мало.

* Для более быстрого восстановления и повышени... | https://habr.com/ru/post/467155/ | null | ru | null |

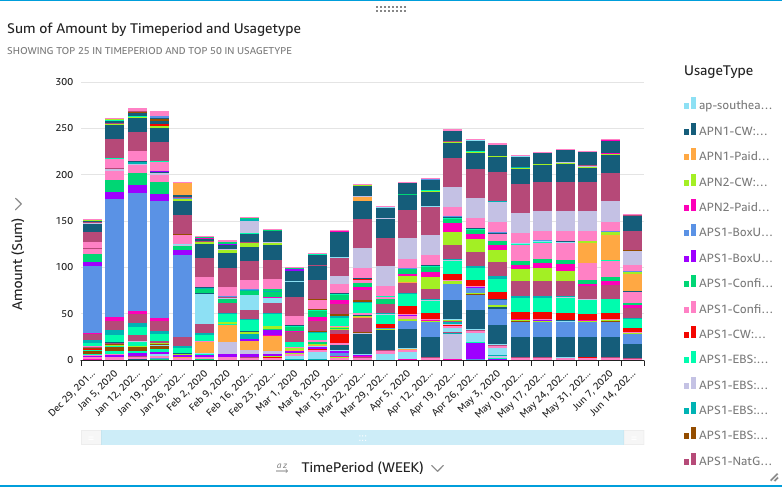

# Оптимизируем затраты с помощью AWS Cost Explorer

У Amazon Web Services отличный бесплатный пакет: хороший набор сервисов и щедрая раздача кредитов для разработчиков. Я был уверен: проблем с оплатой моего ок... | https://habr.com/ru/post/552462/ | null | ru | null |

# Задачи и решения для бойца PostgreSQL

[](https://habr.com/post/423097)

Приветствую всех любителей SQL!

В интернете я редко встречал статьи, которые охватывают разные рабочие моменты и тонкости, связанные с **обработкой данных ... | https://habr.com/ru/post/423097/ | null | ru | null |

# Haxe и PHP: статическая типизация, стрелочные функции, метапрограммирование и многое другое

Привет, Хабр! Предлагаю вашему вниманию перевод [доклада Александра Кузьменко](https://www.youtube.com/watch?v=IeXgTkh9NAs) с прошедшей недавно (14-15 июня) конференции Hong Kong Open Source Conference 2019.

В материале, переводом которого мы решили поделиться к старту курса о [машинном и глубоком обучении](https://skillfactory.ru/ml-and-dl?utm_... | https://habr.com/ru/post/566414/ | null | ru | null |

# Человеческим языком про метрики 3: перцентили для чайников

Это третья статья из цикла. В [прошлой части](https://habr.com/ru/company/tochka/blog/685636/) мы разбирали типы метрик, и уже там начали встречать... | https://habr.com/ru/post/690814/ | null | ru | null |

# Разработка простой игры в Code::blocks с использованием Direct3D 9

Хочу рассказать о своем первом опыте в геймдеве. Сразу стоит оговориться, что статья будет чисто технической, поскольку моей целью было всего лишь получение навыков разработки графических приложений, использующих Direct3D, без привлечения высокоуровн... | https://habr.com/ru/post/251081/ | null | ru | null |

# Как заставить Vue.js и Electron работать вместе

Введение

--------

На волне популярности (надеюсь, что они популярны) [Vue.js](https://vuejs.org) и [Electron](https://electronjs.org), возникает резонный вопрос, а как заставить их ... | https://habr.com/ru/post/358432/ | null | ru | null |

# Всё вы врёте! О рекламе CRM

«На заборе тоже написано, а за ним дрова лежат», — пожалуй, лучшая поговорка, которой можно описать рекламу в Интернете. Читаешь одно, а потом узнаёшь, что неправильно прочитал, не так понял и в правом верхнем углу были две звёздочки. Это и есть та самая «голимая» реклама, из-за которой п... | https://habr.com/ru/post/473394/ | null | ru | null |

# PrestaShop. О глюке в многоуровневой навигации

Привет Хабр! Я понимаю, что история, о которой я хочу рассказать совсем обычная. У каждого программиста, работающего с Open Source, таких случаев до д... | https://habr.com/ru/post/321398/ | null | ru | null |

# Сохраните в закладках эту статью, если вы новичок в Python (особенно если изучаете Python сами)

Привет, Хабр! Представляю вашему вниманию перевод статьи "Bookmark this if you are new to Python (especially if you self-learn Python)" в двух частях ([1](https://towardsdatascience.com/bookmark-this-if-you-are-new-to-pyt... | https://habr.com/ru/post/498074/ | null | ru | null |

# Упаковка в контейнеры (bin packing) при помощи генетического алгоритма

Доброго времени суток, коллеги.

Этой статьей я продолжаю цикл посвященный [EvoJ](http://evoj-frmw.appspot.com/) — Java фреймворку для решения задач генетическим алгоритмом.

В своей [предыдущей заметке](http://habrahabr.ru/blogs/algorithm/13... | https://habr.com/ru/post/139646/ | null | ru | null |

# Разбираемся с Custom Tooling в Argo CD

Спустя некоторое время после написания [первой статьи](https://habr.com/post/481662/), где я ловко управлялся с jsonnet и гитлабом, я понял что пайплайны это конечно хорошо, но излишне сложно и... | https://habr.com/ru/post/517966/ | null | ru | null |

# О параметре компилятора /SAFESEH

Введение

--------

В этой истории я расскажу вам об увлекательном приключении, которое привело меня к решению одной загадки, которую я сам себе загадал. Разгадка являет собой небольшую подробность в механизме загрузчика 32-х разрядных приложений в системе Windows 7 и выше, а процесс ... | https://habr.com/ru/post/563106/ | null | ru | null |

# Помочь компилятору в векторизации? — Лучше просто не мешать

Это — вольный перевод моего недавнего [поста](http://software.intel.com/en-us/blogs/2011/10/12/mr-compiler-may-i-help-you-with-the-loop-vectorization-not-a-disservice-please/) на английской версии Intel Software Network. Так что те, ~~кому Victoria Zhislin... | https://habr.com/ru/post/131159/ | null | ru | null |

# Создание расширений для Speed Dial

Вступление

----------

В 2007 году мы [представили](http://www.opera.com/docs/changelogs/windows/920/) миру Speed Dial. Сегодня вы можете найти реализации этого популярного концепта почти во всех ведущих браузерах. Но как бы мы этим не гордились, какими бы родителями мы были, если ... | https://habr.com/ru/post/118594/ | null | ru | null |

# How to Set Up Your Own VPN Server in 15 Minutes

If you use Habr, chances are, you’re conscious about privacy on the web. As governments and corporations tighten their grip on people’s online activities, the issue of keeping your browsing data to yourself becomes more and more relevant.

Numerous tech websites say VP... | https://habr.com/ru/post/448108/ | null | en | null |

# Сбор контекстной информации для логирования

Зачастую требуется записывать в логи дополнительную информацию, которая может прояснить ситуацию и в дальнейшем упростить отладку приложения. Например, если логируется информация об ошибке, неплохо было бы также сохранить в некоторой форме и входные данные, чтобы было прощ... | https://habr.com/ru/post/416751/ | null | ru | null |

# mysqlcheck и optimize таблиц InnoDB

Только что заметил, что если делать

`mysqlcheck -o --repair db_name`

и ваши таблицы в InnoDB, то не только **не** происходит repair (что и не должно, так как движок не поддерживает эту функцию), но и optimize не срабатывает.

То есть, база остается без optimize и вы этого... | https://habr.com/ru/post/138324/ | null | ru | null |

# Разработка чат-бота (laravel+botman)

Welcome! Я, как junior full stack разработчик, при попытке написать бота с использованием laravel и botman’а столкнулся с многими проблемами. Во-первых, я плохо знаю английский, а на русском статей очень мало на эту тему, а те, что есть не помогли мне решить мои проблемы. В стать... | https://habr.com/ru/post/456240/ | null | ru | null |

# Спойлер: Вставка SVG иконок одним единственным способом

В статье будет обсуждаться проблема вставки SVG иконок в веб — страницу.

Что мы имеем, и как мы используем это. Глобально есть три способа:

* Вставка исходног... | https://habr.com/ru/post/278825/ | null | ru | null |

# Пришло время переосмыслить безопасность OpenBSD

OpenBSD позиционируетcя как защищённая ОС. Однако за последние несколько месяцев в системе найден ряд уязвимостей. Конечно, в этом нет ничего экстраординарного. Хотя некоторые уязвимости довольно необычные. Можно даже сказать, критические. У разработчиков OpenBSD неско... | https://habr.com/ru/post/495120/ | null | ru | null |

# Cocos2d-x — Основные понятия

Предисловие

-----------

Начну с небольшой предыстории. Не так давно, мы с другом решили разработать свою двумерную игру, для дипломного проекта. После того как мы определились с ее жанром и получили примерное представление об игровом процессе, перед нами встал вопрос о выборе движка. Un... | https://habr.com/ru/post/339564/ | null | ru | null |

# Custom view на Compose

Всем привет, меня зовут Николай Широбоков, я — Android-разработчик в e-legion.

В июле Google выпустил стабильную версию Compose. Это вызвало большой интерес в сообществе. Все вокр... | https://habr.com/ru/post/588657/ | null | ru | null |

# Разработка мобильной 2D-игры «Составь слова из слова»

Как-то обычным летним вечером ехал домой с работы в метро и увидел у одного парня игру на планшете, где нужно составлять слова из букв. Скачал ее на свой планшет и начал играть. Поиграв какое-то время, понял, что некоторые особенности можно было бы реализовать по... | https://habr.com/ru/post/309800/ | null | ru | null |

# PHP-Дайджест № 169 (26 ноября – 9 декабря 2019)

[](https://habr.com/ru/post/479306/)

Свежая подборка со ссылками на новости и материалы. В выпуске: PHP 7.4, PhpStorm 2019.3, InfectionPHP и другие релизы,... | https://habr.com/ru/post/479306/ | null | ru | null |

# Скрипт для рекурсивного сравнения директорий

В этом посте хочу поделиться с вами простым, но весьма полезным скриптом на питоне, который я написал для сравнения директорий тестового и рабочего проектов Django.

#### Проблема

На работе для решения внутренних задач я использую Django. Как результат — написан софт,... | https://habr.com/ru/post/50152/ | null | ru | null |

# Цена регресса. Как мы организовали инфраструктуру для Е2Е-тестов

Мы, команда автоматизации Страхового Дома ВСК, подготовили небольшой рассказ о нашей инфраструктуре. Эта статья может быть входной точкой для специалистов, желающих внедрить автотестирование у себя в компании. Расскажем, какие системы, паттерны и фрейм... | https://habr.com/ru/post/572202/ | null | ru | null |

# Учебный курс по React, часть 4: родительские и дочерние компоненты

Публикуем очередную часть перевода учебного курса по React. Нашей сегодняшней темой будут взаимоотношения родительских и дочерних компонентов.

[](https://habr.... | https://habr.com/ru/post/434118/ | null | ru | null |

# UPD: Cisco и 2 провайдера

Проблема стара как мир и сегодня мы ее решим :)

Дано: 2 провайдера (ISP1 и ISP2), внутренняя сеть и между ними маршрутизатор.

Задача: настроить один основной (ISP1) и один резервный канал (ISP2), при падении первого переключится на второй, при поднятии первого переключится обратно.

... | https://habr.com/ru/post/70801/ | null | ru | null |

# Python v3.x: обработчик исключений для корутин и синхронных функций. Вобщем, для всего

В свободное время я работаю над своим [небольшим проектом](https://github.com/sergio-ivanuzzo/idewave-core). Написан на Python v3.x + SQLAlchemy. Возможно, я когда-нибудь напишу и о нем, но сегодня хочу рассказать о своем декорато... | https://habr.com/ru/post/473596/ | null | ru | null |

# Пишем игровую логику на C#. Часть 2/2

Это продолжение [предыдущей статьи](https://habrahabr.ru/post/322258/). Мы шаг за шагом создаем движок, на котором будет работать игровая логика нашей экономической стратегии. Если вы ви... | https://habr.com/ru/post/322268/ | null | ru | null |

# Катаем «смоляной шарик» или создание собственных правил сборки с помощью Qbs

[Qbs](https://doc.qt.io/qbs/index.html) (Qt Build System) — система сборки, позволяющая описывать процесс сборки проектов на простом языке QML (javascript-подобный декларативный язык), ускоряющий процесс сборки продуктов за счет построения ... | https://habr.com/ru/post/330218/ | null | ru | null |

# Работа с MySQL: как масштабировать хранилище данных в 20 раз за три недели

[](https://habrahabr.ru/company/latera/blog/282798/)

Ранее в блоге на Хабре мы рассказывали о развитии нашего продукта — [биллинга для операторов с... | https://habr.com/ru/post/282798/ | null | ru | null |

# Objects without reference cycles and cyclic GC

Each instance of a class in CPython created using the [class](https://docs.python.org/3/tutorial/classes.html#class-definition-syntax) syntax is involved in a [cyclic GC](https://pythoninternal.wordpress.com/2014/08/04/the-garbage-collector/) mechanism. This increases t... | https://habr.com/ru/post/475120/ | null | en | null |

Subsets and Splits

No community queries yet

The top public SQL queries from the community will appear here once available.