text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

values | source stringclasses 4

values |

|---|---|---|---|---|

# Почему результаты логистической регрессии в SAS и R не совпадают

Возможно, эта тема не станет открытием для опытных статистиков. Однако я уверен, что менее опытные статистики и R-программисты смогут открыть для себя новые аспекты логистической регрессии, поскольку найти подробности о причинах несовпадения результато... | https://habr.com/ru/post/348244/ | null | ru | null |

# Самодельный стратостат. Полётный план и ОрВД

Настало время поговорить про легализацию запусков самодельных стратостатов с целью обеспечения безопасности возду... | https://habr.com/ru/post/592383/ | null | ru | null |

# IPSec VPN для OS X и iOS. Без боли

> **VPN** (англ. Virtual Private Network — виртуальная частная сеть) — обобщённое название технологий, позволяющих обеспечить одно или несколько сетевых соединений (логическую сеть) поверх д... | https://habr.com/ru/post/301422/ | null | ru | null |

# Разграничение Google поиска для Росcии, Украины и Белоруссии

Этот пост обязан своим происхождением [моим вопросом](http://habrahabr.ru/qa/19098/), на который, я так и не получил ответа.

Но, [один человек](http://hab... | https://habr.com/ru/post/143407/ | null | ru | null |

# Content Indexing API: страницы, доступные в offline. Доклад с RamblerFront #9

Здравствуйте, меня зовут Антонина, я работаю frontend-разработчиком в Rambler&Co, в команде Lenta.ru.

Content Indexing API — но... | https://habr.com/ru/post/555084/ | null | ru | null |

# Практикум «Intel IoT». Edison — могучая «кроха»

[](http://habrahabr.ru/post/249845/) В [предыдущих частях](http://habrahabr.ru/company/intel/blog/249127/) «практикума» мы рассматривали Intel Galileo, который производителем п... | https://habr.com/ru/post/249845/ | null | ru | null |

# Перевод туториалов по libGDX — часть 2 (рисование изображений)

Представляю вашему вниманию перевод второго туториала по libGDX. Оригинал находится [здесь](http://code.google.com/p/libgdx/wiki/SpriteBatch). Первая часть находится [здесь](http://habrahabr.ru/post/142976/).

Этот туториал дает представление как рисов... | https://habr.com/ru/post/143405/ | null | ru | null |

# Отправляем SMS.ru с удобством

Было дело, проскакивала на хабре статься о сервисе sms.ru

Попробовал, работает. Понравилось. Тогда на этом дело и закончилось.

Но вот недавно потребовалось мне сделать отправку SMS подписавшимся клиентам. API на сайте сервиса хорошо документирован и приведены примеры, но не хватае... | https://habr.com/ru/post/100750/ | null | ru | null |

# Мультиплеер в Unreal Engine: Игровой процесс

Привет хабр!

В данной статье я хочу разобрать мультиплеер в Unreal Engine в контексте игрового процесса.

Опираться я буду на всеобщеизвестный unreal network compendium, приправленный моим собственным опытом.

---

Основная часть

--------------

### Репликация

Мультипле... | https://habr.com/ru/post/647521/ | null | ru | null |

# Использование BSP-деревьев для создания игровых карт

При заполнении области объектами (например, комнатами в подземелье) в случайном порядке вы рискуете тем, что всё будет *слишком* случайным. Резу... | https://habr.com/ru/post/332832/ | null | ru | null |

# Оптимизация механики и графики в игре жанра «симулятор» на iOS

Взлет игр-симуляторов как жанра несколько лет назад показал, что геймификации поддается любая рутина. Апофеозом стал хайп вокруг Goat Simulator, удостоившегося [упоминания](http://www.polygon.com/2015/6/8/8747203/bill-hader-apple-video-wwdc-angry-bird-go... | https://habr.com/ru/post/319990/ | null | ru | null |

# Синтезируем голос бабушки, дедушки и Ленина + новости нашего публичного синтеза

На Хабре часто висят в топе: политика и очередные запреты, трактор, ну и конечно сенсационные новости про "очередные достиже... | https://habr.com/ru/post/584750/ | null | ru | null |

# Что не так с GraphQL

В последнее время GraphQL набирает всё большую популярность. Изящный синтаксис запросов, типизация и подписки.

Кажется: *"вот оно — мы нашли идеальный язык обмена данными!"*...

Я разрабатываю с использованием этого языка уже больше года, и скажу вам: всё далеко не так гладко. В GraphQL есть к... | https://habr.com/ru/post/425041/ | null | ru | null |

# Контент-эксперименты в Google Analytics для всего сайта одновременно

У большинства из нас наступает время, когда нам необходимо запустить [эксперимент](https://support.google.com/analytics/answer/1745147?hl=ru) в Google Analytics чтобы понять, что работает самым лучшим образом для нашего сайта. Пожалуй, когда речь з... | https://habr.com/ru/post/313792/ | null | ru | null |

# Ломаем и чиним Kubernetes

**Kubernetes** отличная платформа как для оркестрации контейнеров так и для всего остального. За последнее время Kubernetes ушёл далеко вперёд как по части функциональности так и по вопросам безопасности и от... | https://habr.com/ru/post/541118/ | null | ru | null |

# Немного о symfony с doctrine под Linux

Начиная изучать symfony, первым делом посмотрел статьи на хабре. Есть переводы, в которых рассказано как сделать свой проект на symfony, где за основу взят sandbox. Мне интересно было разобраться, как установить и настроить symfony + doctrine имея только исходник фреймворка. Пр... | https://habr.com/ru/post/50642/ | null | ru | null |

# Fetch — библиотека для доступа к данным

**Fetch** — это библиотека Scala для организации доступа к данным из файловых систем, БД, веб-сервисов и любых других источников, данные из которых можно получить по уникальному идентификатору. Библиотека написана в функциональном стиле и основана на Cats и Cats Effect. Предна... | https://habr.com/ru/post/512168/ | null | ru | null |

# Изучаем Adversarial Tactics, Techniques & Common Knowledge (ATT@CK). Enterprise Tactics. Часть 6

[Получение учетных данных (Credential Access)](https://attack.mitre.org/tactics/TA0006/)

========================================================================================

**Ссылки на все части:**

[Часть 1. Пол... | https://habr.com/ru/post/433566/ | null | ru | null |

# Блокировки MySQL: виды, проблемы и способы обнаружения

Рано или поздно любой разработчик или администратор СУБД, имеющий дело с MySQL, сталкивается с проблемой блокировок. Всё дело в природе MySQL как систе... | https://habr.com/ru/post/595741/ | null | ru | null |

# Оформление документации в Doxygen

Данная статья входит в получившийся цикл статей о системе документирования Doxygen:

1. [Документируем код эффективно при помощи Doxygen](https://habrahabr.ru/post/252101/)

2. [Оформлен... | https://habr.com/ru/post/252443/ | null | ru | null |

# Погружение в Delta Lake: принудительное применение и эволюция схемы

***Привет, Хабр! Представляю вашему вниманию перевод статьи [«Diving Into Delta Lake: Schema Enforcement & Evolution»](https://databricks.com/blog/2019/09/24/diving-into-delta-lake-schema-enforcement-evolution.html) авторов Burak Yavuz, Brenner Hein... | https://habr.com/ru/post/502324/ | null | ru | null |

# Профилирование: измерение и анализ

Привет, я Тони Альбрехт (Tony Albrecht), инженер в Riot. Мне нравится профилировать и оптимизировать. В этой статье я расскажу об основах профилирования, а также проанализирую пример С++-кода в х... | https://habr.com/ru/post/351320/ | null | ru | null |

# Управление RC машинкой 27mhz с компьютера

Накопилось у меня некоторое количество радиоуправляемых игрушек, из тех, которые покупать своим двум детям нельзя: один пульт управляет всем в округе, никакого разделения ни по частотам, ни по кодам. Одновременно играть не получится. У меня эти игрушки работают на частоте 27... | https://habr.com/ru/post/582224/ | null | ru | null |

# Работа с MS SQL из Powershell на Linux

Эта статья чисто практическая и посвящена моей грустной истории

---------------------------------------------------------------

Готовясь к **Zero Touch PROD** для RDS (MS SQL), про который нам прожужжали все уши, я сделал презентацию (POC — Proof Of Concept) автоматизации: наб... | https://habr.com/ru/post/447100/ | null | ru | null |

# Dagaz: Пинки здравому смыслу (часть 7)

***— Знаешь свой главный грех?

— Какого черта? я обожаю все семь…

но сейчас… я готов дать волю гневу!

Малькольм Рейнольдс "[Миссия Серенити](... | https://habr.com/ru/post/258437/ | null | ru | null |

# Новые возможности сервера DNS в Windows Server Technical Preview 2

> Автор статьи — Андрей Каптелин, участник ИТ-сообщества

С выходом Windows Server Technical Preview 2 многие службы получили обновления. Не обошли обновления стороной и заслуженный сервер имен DNS. Помимо поддержки управления DNS-сервером из PowerSh... | https://habr.com/ru/post/262789/ | null | ru | null |

# Стать мэинтейнером — обновляем репозиторий

Данная статья, не направлена на решение каких-либо фундаментальных проблем, но помогает, прилагая минимум усилий, автоматизировать сборку пакетов для вашего публичного репозитория.

Допустим, вы собираете для ваших любимых пользователей десять пакетов, да каждый под два д... | https://habr.com/ru/post/61644/ | null | ru | null |

# Облегчаем поддержку iOS приложения. Часть 1 — не отрываясь от Xcode

Добрый день. Я хотел бы рассказать о том, как можно облегчить поддержку iOS приложений.

1. [Облегчаем поддержку iOS приложения. Часть 1 — не отрываясь от Xcode](http://habrahabr.ru/post/254563/)

2. [Облегчаем поддержку iOS приложения. Часть 2 — л... | https://habr.com/ru/post/254563/ | null | ru | null |

# Создаём одинаковое приложение 5 раз

На написание этой статьи меня вдохновил YouTube-канал Fireship, записывающий отличные видео о веб-разработке, крайне рекомендую их посмотреть, если вам интересна эта тема.

Вот видео с канал... | https://habr.com/ru/post/575416/ | null | ru | null |

# Как работать с датами в pandas

Библиотека Pandas — это весьма эффективный инструмент для обработки данных, представляющих собой временные ряды. На самом деле, эта библиотека была создана Уэсом МакКинни для работы с финансовыми данными, которые состоят, главным образом, из временных рядов.

При работе с временными ря... | https://habr.com/ru/post/677068/ | null | ru | null |

# 10 лучших генераторов статичных сайтов (Часть 1)

В последнее время в сфере веб-разработки мы заметили сильное смещение акцентов в пользу статичных сайтов. Такие сайты проще в обслуживании (никаких баз данных, никаких серверных сценариев) и более безопасные в целом, учитывая, что единственная вещь, которая передается... | https://habr.com/ru/post/289496/ | null | ru | null |

# Голосовой секретарь на вебхуках

Один из последних трендов — онлайн чат-боты. Но, что делать с теми клиентами, которые находятся оффлайн? Большой процент людей предпочитает звонить по телефону. Для них нужен или большой штат операт... | https://habr.com/ru/post/448178/ | null | ru | null |

# Структурируем вложения к элементам списка в Sharepoint 2010

Доброго всем дня!

В Sharepoint 2010 присутствует множество стандартных типов столбцов сайта, но как минимум два важных, на мой взгляд, отсутствуют. Возможно, разработчики оставили «поле» для расширений от сторонних компаний. Но мы «сами с усами» =)

От... | https://habr.com/ru/post/235493/ | null | ru | null |

# Отладочный вывод на микроконтроллерах: как Concepts и Ranges отправили мой printf на покой

Здравствуйте! Меня зовут Александр и я работаю программистом микроконтроллеров.

Начиная на работе новый проект, я привычно набрасывал в project tree исходники всяческих полезных утилит. И на хедере app\_debug.h несколько подз... | https://habr.com/ru/post/556144/ | null | ru | null |

# Холостые циклы в Java

Привет, сегодня поговорим о тонкостях реализации холостых циклов (холостого ожидания) в Java. Эта задача встречается нечасто: за девять с небольшим лет работы я столкнулся с ней лишь пару раз. Тем не менее, тема видится интересной и по ней есть что сказать, так что добро пожаловать! Исходный ко... | https://habr.com/ru/post/674116/ | null | ru | null |

# Mikrotik split-dns: они это сделали

Не прошло и 10 лет, как разработчики RoS (в stable 6.47) добавили функционал, который позволяет перенаправить DNS запросы в соответствии со специальными правилами. Если раньше надо было изворачиваться с Layer-7 правилами в firewall, то теперь это делается просто и изящно:

```

/... | https://habr.com/ru/post/505064/ | null | ru | null |

# Sktime: унифицированная библиотека Python для машинного обучения и работы с временными рядами

***Всем привет. В преддверии старта [базового](https://otus.pw/nN4U/) и [продвинутого](https://otus.pw/7OyZ/) курсов «Математика для Data Science», мы подготовили перевод еще одного интересного материала.***

---

задачи. К ним относятся:

* копирование передаваемых сообщений для расследования инцидентов безопасности, в будущем;

* устранение возможности оправки не толь... | https://habr.com/ru/post/275035/ | null | ru | null |

# Ядра процессора или что такое SMP и с чем его едят

Введение

--------

Доброго времени суток, сегодня хотелось бы затронуть достаточно простую тему, которая почти никем из обычных программистов неизвестна, но каждый из вас, скорее всего, ей пользовался.

Речь пойдет о симметричной мультипроцессорности(в народе — SM... | https://habr.com/ru/post/426497/ | null | ru | null |

# Голосовой дневник на python с распознаванием голоса и сохранением в Mongo DB

Зачем всё это?

--------------

Все больше растет популярность голосовых интерфейсов. Многие технологические компании-гиганты стре... | https://habr.com/ru/post/564924/ | null | ru | null |

# Представляем 3CX V15.5 Beta

На этой неделе мы снова порадуем вас приятной новостью – выпущена 3CX V15.5 Beta! Это значит, что финальная версия 3CX V15.5 уже совсем не за горами. Мы получили много хороших отзывов об альфа-версии 15.5, особенно о новом веб клиенте. В бете мы сосредоточились на улучшениях и исправления... | https://habr.com/ru/post/328544/ | null | ru | null |

# Оповещения из Zabbix телефонным звонком

Всем привет.

Я давно использую zabbix и давно читаю хабр.

Мысль научить заббикс разговаривать голосом посещала меня давно, и даже делал систему которая чудным голосом сообщала ночным саппортам что случилось.

Сегодня я прочитал пост [mxx](http://habrahabr.ru/users/mx... | https://habr.com/ru/post/126963/ | null | ru | null |

# Использование текстовых и извлеченных числовых признаков в задаче классификации комментариев

### Как выглядят данные?

Во-первых, посмотрим на имеющиеся тестовые и тренировочные данные (данные соревнования «Toxic comment classif... | https://habr.com/ru/post/528530/ | null | ru | null |

# Присматриваемся к одноплатникам на RISC-V, обзор модуля Sipeed Lichee RV на процессоре Allwinner D1

Одноплатные компьютеры на RISC-V процессоре сравнительно новое веяние. Поднебесная активно работает над снижение... | https://habr.com/ru/post/649327/ | null | ru | null |

# Новости Yii 2021, выпуск 1

Привет, сообщество!

Это первый выпуск новостей в 2021. Начало года вышло продуктивным. Мы начали активно релизить пакеты Yii 3, есть значительный прогресс с пока не релизнутыми пакетами. Улучшили инструментарий разработки, много всего исправили, убили лишние пакеты. И всё это параллельно ... | https://habr.com/ru/post/545616/ | null | ru | null |

# Django Channels – ответ современному вебу

В мире Django набирает популярность дополнение Django Channels. Эта библиотека должна принести в Django асинхронное сетевое программирование, которое мы так долго ждали. **Артём Малышев** на Moscow Python Conf 2017 объяснил, как это делает первая версия библиотеки (сейчас ав... | https://habr.com/ru/post/418445/ | null | ru | null |

# PHPUnit: Электронная таблица (spreadsheet) в качестве источника данных (data provider)

В документации PHPUnit есть небольшой [раздел](https://phpunit.de/manual/current/en/writing-tests-for-phpunit.html#writing-tests-for-phpunit.data-providers) посвященный источникам данных (data provider), которые позволяют скормить... | https://habr.com/ru/post/252489/ | null | ru | null |

# Теперь Google Analytics работает Асинхронно

Новый код выглядит вот так:

> `var \_gaq = \_gaq || [];

>

> \_gaq.push(['\_setAccount', 'UA-XXXXX-X']);

>

> \_gaq.push(['\_trackPageview']);

>

>

>

> (function() {

>

> var ga = document.createElement('script');

>

> ga.src = ('https:' == document... | https://habr.com/ru/post/77123/ | null | ru | null |

# Полная поддержка популярных реализаций Docker Registry в werf

Все популярные реализации реестров для образов контейнеров поддерживают [Docker Registry HTTP API](https://docs.docker.com/registry/spec/api/) и позволяют использова... | https://habr.com/ru/post/496992/ | null | ru | null |

# LÖVE + Android + AdMob = дружба

Однажды возникло желание изучить для своих скромных нужд [Lua](http://ru.wikipedia.org/wiki/Lua). Но просто прочесть спецификации и примеры не интересно, и давно была мысль написать свою логическую игру под Android, начались поиски подходящего фреймворка для комфортной работы.

Посл... | https://habr.com/ru/post/219255/ | null | ru | null |

# «Письмо турецкому султану» или линейная регрессия на C# с помощью Accord.NET для анализа открытых данных Москвы

Когда речь идет об освоении самых основ машинного обучения, чаще всего предлагается изучить соответствующие инструменты на [Python или R](https://habrahabr.ru/company/piter/blog/263457/). Мы не будем обсуж... | https://habr.com/ru/post/346222/ | null | ru | null |

# Тайные знания: библиотеки для С++

> *Рун не должен резать

> Тот, кто в них не смыслит.

> В непонятных знаках

> Всякий может сбиться.

> (Сага об Эгиле)*

>

>

Многие начинающие программисты, уже освоив синтаксис C++, обнаруживают, что нет простого способа как подключить библиотеку, так и собрать программу дл... | https://habr.com/ru/post/581228/ | null | ru | null |

# 3CX v15.5 Update 4 Beta — распознавание речи через Microsoft Speech и обновленный Call Flow Designer

На этой неделе произошли два приятных события. Во-первых, мы выпустили обновление 3CX v15.5 Update 4 BETA, и, во вторых, — очередное обновление среды разработки голосовых приложений 3CX Call Flow Designer.

Обновле... | https://habr.com/ru/post/352024/ | null | ru | null |

# In-line редактирование табличных данных в ASP.Net MVC 3

Представляю вашему вниманию ещё одну реализацию AjaxGrid на ASP.Net MVC 3.

В статье рассказывается как создать табличную форму с inline редактированием, ajax сортировкой и ajax пейджером.

Данная реализация — компиляция из нескольких доступных компонентов... | https://habr.com/ru/post/138580/ | null | ru | null |

# Что делать неизвестным в вашем git репозитории

Всем привет! Предлагаю взглянуть на проблему, связанную с появлением коммитов от «неизвестных» пользователей в вашем git репозитории. Такое может возникнуть, если один разработчик будет использовать несколько разных git конфигов. Расскажу, какие есть варианты избежать п... | https://habr.com/ru/post/673946/ | null | ru | null |

# Об эвристике: очевидное-невероятное

Привет всем!

Надеюсь, кому-то приведённые мной обзоры показались интересными. Продолжим! Сегодня я долго думал что бы написать. Идей не оказалось, кроме небольшой обиды на «Лабораторию Касперского», но это уже неважно и это уже почти лично-интимное.

Итак, сегодня я хочу под... | https://habr.com/ru/post/97052/ | null | ru | null |

# Как проверить и проанализировать использование памяти в системе Solaris

Очень часто господа системные администраторы сталкиваются с проблемой просмотра загрузки операционной системы, и если большинству в общем то знакомы системы мониторинга на стандартных операционных системах, то в системе Solaris — это часто вызыв... | https://habr.com/ru/post/124208/ | null | ru | null |

# Сравнение библиотек для работы с Memcached на Node.JS

Хочу поделиться проделанной работой по исследованию производительности различных библиотек для работы с memcached в Node.JS. Для исследования б... | https://habr.com/ru/post/200060/ | null | ru | null |

# Коды ошибок — это гораздо медленнее, чем исключения

На современных 64-битных PC-архитектурах использование C++-исключений означает всего лишь добавление к функциям недостижимого кода с вызовами деструктора и ухудшение производительность менее чем на 1%. Такие небольшие ухудшения производительности сложно даже измери... | https://habr.com/ru/post/533332/ | null | ru | null |

# Изменение размера изображения с учётом содержимого

Изменение размера изображения с учётом содержимого (Content Aware Image Resize), жидкое растяжение (liquid resizing), ретаргетинг (retargeting) или вырезание шва (seam carving) относятся к методу изменения размера изображения, где можно вставлять или удалять *швы*, ... | https://habr.com/ru/post/324284/ | null | ru | null |

# Шифрованная файловая система Keybase: первая альфа-версия

Разработчики файловой системы Keybase, наконец-то [выпустили первый релиз альфа-версии](https://keybase.io/introducing-the-keybase-filesystem), анонсированный ещё [в июле 2015 года](https://megamozg.ru/post/17526/). Keybase — это криптографически защищённое х... | https://habr.com/ru/post/390071/ | null | ru | null |

# Вышла Ubuntu 21.10

Canonical [выпустила](https://ubuntu.com/blog/ubuntu-21-10-has-landed) версию [дистрибутива Ubuntu 21.10](https://habr.com/ru/news/t/580140/). Это последний промежуточный выпуск перед следующей версией Ubuntu с долгосрочной поддержкой (LTS), которая должна выйти в апреле 2022 года. Она будет подде... | https://habr.com/ru/post/583626/ | null | ru | null |

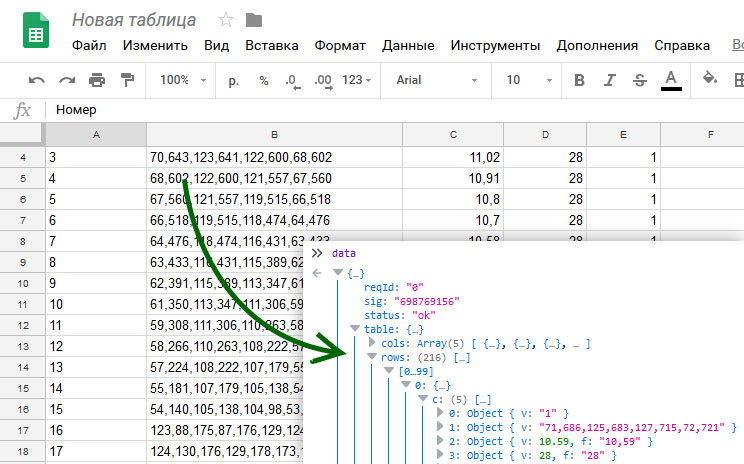

# «CMS» на базе Google Spreadsheets для статических сайтов

Все чаще для рассказа о мероприятии/товаре/услуге компании создают сайты на базе каких либо конструкторов. Либо своими силами, либо привлекая дизайнеров и без участия прог... | https://habr.com/ru/post/432740/ | null | ru | null |

# Когда программный код вызывает восхищение?

Тема идеального кода нередко вызывает полемику в среде матерых программистов. Тем интереснее было заполучить мнение директора по разработке Parallels RAS Игоря Марната. Под катом его авто... | https://habr.com/ru/post/426679/ | null | ru | null |

# Удалить то, что скрыто: оптимизация 3D-сцен в мобильной игре. Советы сотрудников Plarium Krasnodar

Уже на начальном этапе создания мобильных игр следует учитывать, что детализированные модели сильно нагружают портативное устройство, а это ведет к падению частоты кадров, особенно на слабых девайсах. Как экономно испо... | https://habr.com/ru/post/348494/ | null | ru | null |

# Тонкости использования селекторов аттрибутов в CSS

CSS может связываться с HTML элементами используя любые из его атрибутов. Вы наверняка знаете о классах и ID. Проверим это в HTML:

> `<h2 id="first-title" class="magical" rel="friend">David Walshh2>`

>

>

Этот один элемент имеет три аттрибута: ID, class и rel... | https://habr.com/ru/post/85920/ | null | ru | null |

# Компилятор выражений

Недавно у меня возникла необходимость в вычислении выражений. Выражение представлено в виде строки и может содержать имена переменных, целые числа, строковые константы и любые операции над ними.

Пример:

выражение: «x + 10 == 5 \* y / (1 + z\*2)»;

требуется уметь вычислять это вы... | https://habr.com/ru/post/50139/ | null | ru | null |

# Полезные фишки SpecFlow

Всем привет!

На Хабре есть отличные статьи по SpecFlow. Я хочу углубиться в данную тему и рассказать про параллельное выполнение тестов, передачу данных между шагами, assist helpers, transformations, hooks и про использование Json в качестве источника данных.

### Параллельное выполнени... | https://habr.com/ru/post/449574/ | null | ru | null |

# Пагинация списков в Android с RxJava. Часть II

Всем добрый день!

Приблизительно месяц назад я писал [статью](http://habrahabr.ru/post/268991/) об организации пагинации списков (RecyclerView) с помощью RxJava. Что есть пагинация по-простому? Это автоматическая подгрузка данных к списку при его прокрутке.

Решени... | https://habr.com/ru/post/271875/ | null | ru | null |

# Диалоговое окно Android с «иконифицированным» меню

Некоторое время назад меня увлекла идея разработки приложений под платформу Android. Дабы не заниматься изучением платформы на простых hello-world программках решил сделать что-то такое, что позволило бы освоиться с UI частью фреймворка, работой с БД, сетью и социал... | https://habr.com/ru/post/103347/ | null | ru | null |

# Разбор задач по CTF

*В начале декабря мы провели [командные соревнования](https://habr.com/ru/news/t/476892/) по информационной безопасности. Помимо [OTUS](https://otus.pw/q7Ro/), организаторами мероприятия для «белых хакеров» выступили [Volga CTF](https://volgactf.ru/) и [CTF.Moscow](https://ctf.moscow/). Пожалуй, ... | https://habr.com/ru/post/482538/ | null | ru | null |

# Формула подсчёта количества дней в месяце

***Примечание**: данный пост является переводом статьи [cmcenroe.me/2014/12/05/days-in-month-formula.html](https://cmcenroe.me/2014/12/05/days-in-month-formula.html) (**Часть I**), а также авторским к нему дополнением (**Часть II**). Не следует относиться к материалу серьёзн... | https://habr.com/ru/post/261773/ | null | ru | null |

# 5 интересных JavaScript-находок, сделанных в исходном коде Vue

Чтение исходного кода известных фреймворков может хорошо помочь программисту в улучшении его профессиональных навыков. Автор статьи, перевод которой мы сегодня публикуем, недавно анализировал код vue2.x. Он нашёл в этом коде некоторые интересные JavaScri... | https://habr.com/ru/post/503634/ | null | ru | null |

# Расширение тома в Windows 2003 с помощью Diskpart

Возникла недавно задача по расширению системного диска Windows 2003. Поскольку сервер работал на виртуальной платформе (ESX), проще всего сделать это, увеличив размер виртуального диска и затем подключить диск к другой виртуальной машине (Windows 2003 штатными средст... | https://habr.com/ru/post/117408/ | null | ru | null |

# Processing 1.0 и почти закон всемирного тяготения

О [Processing](http://processing.org/) я слышал давно, но посмотреть что это из себя представляет никак не доходили руки. И вот у меня появилась идея сдела... | https://habr.com/ru/post/69617/ | null | ru | null |

# Расширенный HTML

В этой статье хотел бы рассказать немного про библиотеку, первую версию которой я создал еще в конце прошлого года. Суть очень простая — расширить возможности языка HTML, чтобы можно было без JavaScript'а писать простые и рутинные вещи: отправка формы в json формате, загрузка HTML тимплейтов на опре... | https://habr.com/ru/post/499106/ | null | ru | null |

# ОС с нуля: Глава 2, Часть 1 — Да зачем нам этот Legacy

Введение

--------

Пару месяцев назад я решил начать серию статей про написание своей ОС с нуля. Описал написание Legacy MBR загрузчика и переход в защищенный режим (без прерываний) и ещё пару мелочей. Сегодня я решил, что попытаюсь "перезапустить" эту серию (со... | https://habr.com/ru/post/680270/ | null | ru | null |

# Ядро macOS, есть ли червячки в этом яблоке?

В самом начале этого года Apple выложили в открытый доступ исходный код системных компонентов macOS 11.0 – Big Sur, включая XN... | https://habr.com/ru/post/549460/ | null | ru | null |

# Опыт перевода Maven-проекта на Multi-Release Jar: уже можно, но ещё сложно

У меня есть маленькая библиотека [StreamEx](https://github.com/amaembo/streamex), которая расширяет возможности Java 8 Stream API. Библиотеку я традиционно собираю через Maven, и по большей части меня всё устраивает. Однако вот захотелось экс... | https://habr.com/ru/post/472312/ | null | ru | null |

# Как правильно вставлять SVG

> Как правильно вставлять SVG?

SVG — это [формат векторной графики](https://htmlacademy.ru/courses/130), дословно: масштабируемая векторная графика. МВГ? SVG! В векторных форматах хранится не сам... | https://habr.com/ru/post/337284/ | null | ru | null |

# Как подружить Юлу и ВКонтакте

Осенью прошлого года перед нами стояла задача объединить крупнейшую социальную сеть и многомиллионный сервис объявлений в одну площадку для продажи — Объявления ВКонтакте. Похо... | https://habr.com/ru/post/567956/ | null | ru | null |

# Google Apps Script: переносим расписание из таблицы в календарь

Для кого предназначена данная статья

------------------------------------

* Для людей, кто активно пользуется сервисом Google Calendar

* Для людей, у которых есть файлы таблиц с расписаниями, и которые хотели бы работать с ними более продуктивно — всег... | https://habr.com/ru/post/529332/ | null | ru | null |

# VPS на Linux с графическим интерфейсом: запускаем сервер RDP на Ubuntu 18.04

[](https://habr.com/ru/company/ruvds/blog/512878/)

В [предыдущей статье](https://habr.com/ru/company/ruvds/blog/510860/) мы разобрали запуск сервера VNC... | https://habr.com/ru/post/512878/ | null | ru | null |

# HTML5. Для профессионалов. 2-е изд

Все привет. У нас вышло 2-е издание книги [Гоше](http://www.jdgauchat.com/) «HTML5. Для профессионалов».

Прототип: [HTML5 for Masterminds, 2nd Edition: How to take advantage of ... | https://habr.com/ru/post/251319/ | null | ru | null |

# MongoDb for developers. Неделя 2

Доброе время суток, хабр. Этот топик — продолжение цикла статей, основанных на материалах онлайн курса M101 от 10gen. Поскольку вторая неделя является одной из самых насыщенных, она будет разбита на две статьи.

Сразу уточню — описанное в статье справедливо для mongo версии 2.6. ... | https://habr.com/ru/post/157617/ | null | ru | null |

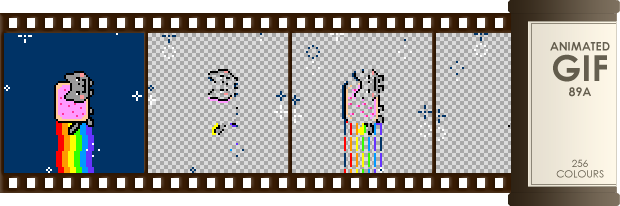

# Изображения: форматы и сжатие (2/3)

И снова здравствуйте! После перерыва в месяц [продолжаем](http://habrahabr.ru/company/tradingview/blog/180381/) экскурсию по форматам изображений и алгоритмам сжатия. Где мы останови... | https://habr.com/ru/post/184660/ | null | ru | null |

# Запрос номера из реестра «Россвязи»

Доброго времени суток!

Давно искал инструмент, чтобы быстро можно было узнать принадлежность того или иного телефонного номера к тому или иному оператору связи и/или региону.

Всегда использовал для этих задач [МТТ](http://www.mtt.ru/mtt/def), чего, в принципе всегда хватало.... | https://habr.com/ru/post/142069/ | null | ru | null |

# Руководство хакера по нейронным сетям. Схемы реальных значений. Схемы с несколькими логическими элементами

Содержание:

**Глава 1: Схемы реальных значений**[Часть 1:](http://habrahabr.ru/company/paysto/blog/244723/)

```

Введение

Базовый сценарий: Простой логический элемент в схеме

Цель

... | https://habr.com/ru/post/245403/ | null | ru | null |

# Простейшая кластеризация изображени методом к-средних (k-means)

Зачастую при поиске движущихся объектов на видео будь то методом вычитания фона, временной разности, оптического потока, в итоге мы получаем множество точек, которые после действия вышеупомянутых алгоритмов помечены как изменившие свое положение относит... | https://habr.com/ru/post/165087/ | null | ru | null |

# К чему могут привести уязвимости в роутерах TP-LINK

На самом деле речь в данной статье пойдет не только об уязвимостях в роутерах TP-LINK, но и о том, как можно удаленно сделать из таких роутеров хак-станцию и чего можно при помощи этого достичь. А так же немного о том, как это было применено для получения доступа к... | https://habr.com/ru/post/381573/ | null | ru | null |

# Что делать, если протухли сертификаты и кластер превратился в тыкву?

Если в ответ на команду `kubectl get pod` вы получаете:

```

Unable to connect to the server: x509: certificate has expired or is not yet valid

```

то, скорее всего, прошел год, у сертификатов вашего kubernetes закончился срок действия, компоне... | https://habr.com/ru/post/465733/ | null | ru | null |

# Как подружить Canvas и ItemsSource в WPF и AvaloniaUI

Предпосылки: понимая, что контейнеры компоновки в WPF не позволяют сделать привязки (Binding) к своим дочерним элементам, решил поэкспериментировать, а как же всё-таки подсунуть данные из View Model для формирования содержимого в эти самые контейнеры компоновки. ... | https://habr.com/ru/post/686438/ | null | ru | null |

# Ускорение процесса разработки под Embedded Linux

Любой программист, решивший заняться разработкой под Embedded Linux, придя будь то из высокоуровневых языков программирования, либо из программирования микроконтроллеров на С/С++, неизбежно оказывается удивлен крайней недружелюбностью embedded linux. Текстовый блокнот... | https://habr.com/ru/post/574118/ | null | ru | null |

# Автономные транзакции в PostgreSQL

Начнем с определения того, что такое автономные транзакции в принципе:

*Автономные транзакции позволяют создавать новые подтранзакции (subtransaction), которые могут сохранять или отменять изменения вне зависимости от родительской транзакции.* [Подробнее тут](http://ru.wikipedia... | https://habr.com/ru/post/99645/ | null | ru | null |

# В разрезе: новостной агрегатор на Android с бэкендом. Система контроля конфигураций (Puppet)

[Вводная часть (со ссылками на все статьи)](https://habrahabr.ru/post/334510/)

В ITIL (v3) среди описанных процессов есть 2 особенно интересных: «Процесс управления конфигурациями» и «Процесс управления изменениями», пред... | https://habr.com/ru/post/335608/ | null | ru | null |

# «O tempora, o mores!»

Для протокола: заголовок я позаимствовал у Цицерона, в *Oratio in Catilinam Prima in Senatu Habita*.

---

В реальной жизни мы часто имеем дело с ... | https://habr.com/ru/post/517926/ | null | ru | null |

# Монетизация Android-приложения с помощью рекламы от AdMob с возможностью платного отключения. Часть первая

Всем привет! На Хабрахабре уже была [статья](http://habrahabr.ru/blogs/android_development/124098/) о том, как сделать платное отключение рекламы в Android-приложении, где предлагалось использовать open-source ... | https://habr.com/ru/post/133858/ | null | ru | null |

# Изменение кода системных сборок или «утечка» .Net Framework 5.0

Здесь я продемонстрирую возможность, которая по своей сути — самый настоящий хак. Вопрос, зачем это может понадобиться? На самом деле целей для этого может быть огромное множество. Итак наша задача — изменить код библиотеки **mscorlib** таким образом, ч... | https://habr.com/ru/post/239005/ | null | ru | null |

# Кластеризация палитры изображения и сжатие в формате PNG

#### Аннотация

В данной статье читателю предлагается опыт разработки алгоритма сжатия изображения, хранящегося в формате PNG. Сжатие осуществляется за счет квантования палитры с использованием классификатора К–внутригрупповых средних. Приводится исходный код ... | https://habr.com/ru/post/113393/ | null | ru | null |

Subsets and Splits

No community queries yet

The top public SQL queries from the community will appear here once available.