text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

values | source stringclasses 4

values |

|---|---|---|---|---|

# Динамическая маршрутизация на основе FRRouting

Меня зовут Евгений, я занимаюсь развитием сетевой инфраструктуры в Домклик. Сегодняшняя статья будет охватывать только применение динамической маршрутизации на... | https://habr.com/ru/post/690058/ | null | ru | null |

# Принцип подстановки Лисков

Всем привет, меня зовут Константин. Я занимаюсь разработкой на Java в Tinkoff.ru и люблю SOLID. В этой статье мы сформулируем принцип подстановки Лисков, покажем его связь с принципом Открытости-Закрытости, узнаем, как правильно формировать иерархию наследования и ответим на философский во... | https://habr.com/ru/post/490738/ | null | ru | null |

# Миграция с Symfony 2.0 до 2.6

В этой статье я хотел бы рассказать о некоторых нюансах, через которые пришлось пройти для миграции проекта с устаревшей Symfony 2.0 до актуальной Symfony 2.6.

##### Менеджер зависимостей

В каждом проекте Symfony есть свои зависимости (бандлы). В версии 2.0 зависимости указывались в... | https://habr.com/ru/post/258403/ | null | ru | null |

# Тестируем веб-API ASP.NET Core

> Привет, Хабровчане! Для будущих учащихся на курсе ["C# ASP.NET Core разработчик"](https://otus.pw/04Oe/) публикуем перевод полезной статьи.

>

>

---

При проектировании и разработке... | https://habr.com/ru/post/529576/ | null | ru | null |

# Фуршет ноября

Без предварительных ласк, продолжим наш фуршет? :) В этом месяце решил сделать его в будний день, чтобы было время пообщаться сегодня-завтра, а не один день перед выходными.

**Правила те же:** в комментариях первого уровня одни пользователи пишут, в какой теме они разбираются и готовы поотвечать на ... | https://habr.com/ru/post/702066/ | null | ru | null |

# Запись данных в формате JSON

#### Запись данных в формате JSON

В одной из моих программ понадобилась запись данных в формате [JSON](http://json.org/json-ru.html). Вкратце — XML-подобный формат, вполне подходит на замену Windows INI-файлам или тому же XML. Удобен тем, что поддерживает массивы и вложенность собственн... | https://habr.com/ru/post/230079/ | null | ru | null |

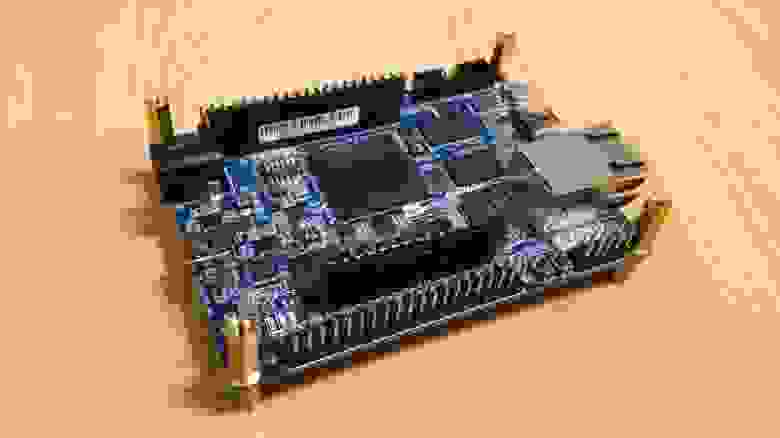

# Обновление Linux в устройстве на базе чипа Altera SoC FPGA и получение доступа к расшаренным ресурсам Windows-сервера

[](http://habrahabr.ru/post/264515/)

Недавно компания **Terasic** начала продажи весьма интересной плат... | https://habr.com/ru/post/264515/ | null | ru | null |

# Мой первый Linux-вирус?

*Перевод заметки [My first Linux virus?](http://systemcall.org/2007/09/07/my-first-linux-virus/) для [Линукс в digg на русском](http://linux-digg.ru/)*.

Блуждая по файловой системе Linux на своем компьютере, я обнаружил странную директорию в /home …

`drwxr-xr-x 2 root root 4096 2007-08-... | https://habr.com/ru/post/31249/ | null | ru | null |

# Как бесплатно перенести свои любимые треки в Spotify, используя Javascript

Все любители музыки в России с нетерпением ждали выхода Spotify на наш рынок. Когда наконец это случилось, перед пользователями встала проблема переноса музыки из других сервисов. Лично у меня за годы накопилась огромная коллекция музыки на р... | https://habr.com/ru/post/515640/ | null | ru | null |

# Интерфейс программирования презентаций на impress.js

[impress.js](https://github.com/bartaz/impress.js) – популярный фреймворк предназначенный для создания впечатляющих презентация просто в браузере... | https://habr.com/ru/post/237531/ | null | ru | null |

# Предсказание горимости территорий методами машинного обучения на основе географических данных

> **Автор статьи:** Ярослав Найчук, выпускник OTUS.

>

> Статья написанна Ярославом на основе выпускного проек... | https://habr.com/ru/post/675954/ | null | ru | null |

# Пишем проигрыватель lossless аудио на JavaScript

Добрый день, %username%. Сегодня я хотел бы поделится своим опытом разработки прототипа онлайн lossless аудио плеера.

На сегодняшний день, вряд ли можно кого-то удивить аудио или видео плеером, встроенного непосредственно в веб-страницу. Существующие технологии, би... | https://habr.com/ru/post/235741/ | null | ru | null |

# Понимание областей видимости или Scope в AngularJS

В Ангуляре, дочерняя область видимости обычно прототипически наследуется от родительской. Единственным исключением является директива, в которой используется `scope: { ... }`, создающая «изолированную» область видимости, не наследуемую прототипически. Такая конструк... | https://habr.com/ru/post/182670/ | null | ru | null |

# Уязвимость в BMC-контроллере Supermicro позволяет получить доступ к паролям управляющего интерфейса

В BMC (Baseboard Management Сontroller) чипе, используемом в материнских платах Supermicro, выявле... | https://habr.com/ru/post/227041/ | null | ru | null |

# Алгоритм оценки стойкости пароля от Microsoft (Часть 2)

Продолжение [предыдущего топика](http://habrahabr.ru/blogs/infosecurity/116331/) по алгоритму проверки стойкости пароля. Теперь возьмемся за более сложный алгоритм, который почему то считается «старым» и в основном тексте закомментирован.

Для анализа стойкос... | https://habr.com/ru/post/116425/ | null | ru | null |

# В поисках аналога функций первого порядка в СУБД Caché

Пост написан в дополнение к статье [Декларативная разработка на Caché](http://habrahabr.ru/company/intersystems/blog/212671/).

```

[2, 3, 5, 7, 11, 13, 17].forEach(function(i) {

console.log(i);

});

```

Как делать такое в Caché с помощью [COS](http://docs.... | https://habr.com/ru/post/264983/ | null | ru | null |

# Пишем Hello World для HoloLens

> *Спешим поделиться уникальным материалом подготовленным специально для нашего блога [Глебом Захаровым](https://habrahabr.ru/users/zakbelg/), HoloLens Lead компании [Zengalt](http://zengalt.com/) – пошаговая инструкция по разработке приложения для Microsoft HoloLens и его запуска в эм... | https://habr.com/ru/post/310446/ | null | ru | null |

# Как я взломал мошенников, или просто внутренности фишинг-панелей

### INTRO

Недавно столкнулся с обычной для интернета ситуацией — классической просьбой от родственника отдать свой голос за него в каком-то голосовании. Оказалось, человека "взломали" мошенники, а ссылки на голосование вели на фишинговые ресурсы.

Я у... | https://habr.com/ru/post/491150/ | null | ru | null |

# Установка node.js на Linux, FreeBSD, Windows

[node.js](http://nodejs.org/) — серверный асинхронный Javascript, превосходный инструмент для создания серверной части COMET приложений, в частности, для игрушек, чатов, и других высоконагруженных проектов, использующий синтаксис Javascript, прекомпилируемый в машинный ко... | https://habr.com/ru/post/95960/ | null | ru | null |

# X Neural Switcher — Поваренная книга

Приветствую.

Я являюсь автором программы для автоматического переключения раскладки клавиатуры, работающей под Linux. Эта программа xneur или **X Neural Switcher**.

Когда я начинал занима... | https://habr.com/ru/post/132635/ | null | ru | null |

# Magento 2: минимальная инсталляция и зависимости — исследование

Привет. Я занимаюсь back-end / full-stack разработкой на Magento 2 уже 3.5 года. Все эти годы у меня никак не хватает сил и времени перетащить один свой старый (но всё еще довольно популярный) проект с убогого Web-CMS uWeb на что-то более-менее толковое... | https://habr.com/ru/post/571632/ | null | ru | null |

# Docker, GitLab, бесплатные SSL-сертификаты и другие плюшки современной веб-разработки

И снова здравствуйте! Почти пять лет уже не писал здесь новых статей, хотя, если честно, всегда знал, что рано или поздно начну это делать снова. Не знаю как вам, а мне все таки это дело всегда казалось довольно увлекательным.

На... | https://habr.com/ru/post/317636/ | null | ru | null |

# Обход предупреждений браузера с помощью псевдопарольных полей

Кажется, человеческой изобретательности нет предела, если нужно обойти какое-то ограничение. Например, нужно подключить устройство к розетке в центре надувного бассейна — ничего не получится, правильно? Неправильно!

. Я посмотрел эту и другие библиотеки, реализующие паттерн Service Locator, и даже сделал свою собственную — [typedin](https://www.npmjs.com/... | https://habr.com/ru/post/350398/ | null | ru | null |

# Веб-типографика: создаем таблицы для чтения, а не для красоты

*Наталия Шергина, фрилансер-редактор и студентка [Нетологии](https://netology.ru/?utm_source=blog&utm_medium=747&utm_campaign=habr), специально для блога перевела [лонгрид](https://alistapart.com/article/web-typography-tables) Richard Rutter о типографике... | https://habr.com/ru/post/348390/ | null | ru | null |

# «Нежданчики» языка Фортран

Многие из нас, обучаясь программированию ещё в университетах или дома, делали это на языках С/С++. Конечно, всё зависит от времени, в которое начиналось наше знакомство с языками программирован... | https://habr.com/ru/post/254235/ | null | ru | null |

# Что такое MagicString и настолько ли эти строки волшебные?

MagicString — это малоизвестная библиотека. Не смотря на это она решает одну из насущных проблем — изменение исходного кода с использованием его структуры (AST — abstract syntax tree).

В этой статье мы узнаем, что такое MagicString и такие ли уж эти строк... | https://habr.com/ru/post/502760/ | null | ru | null |

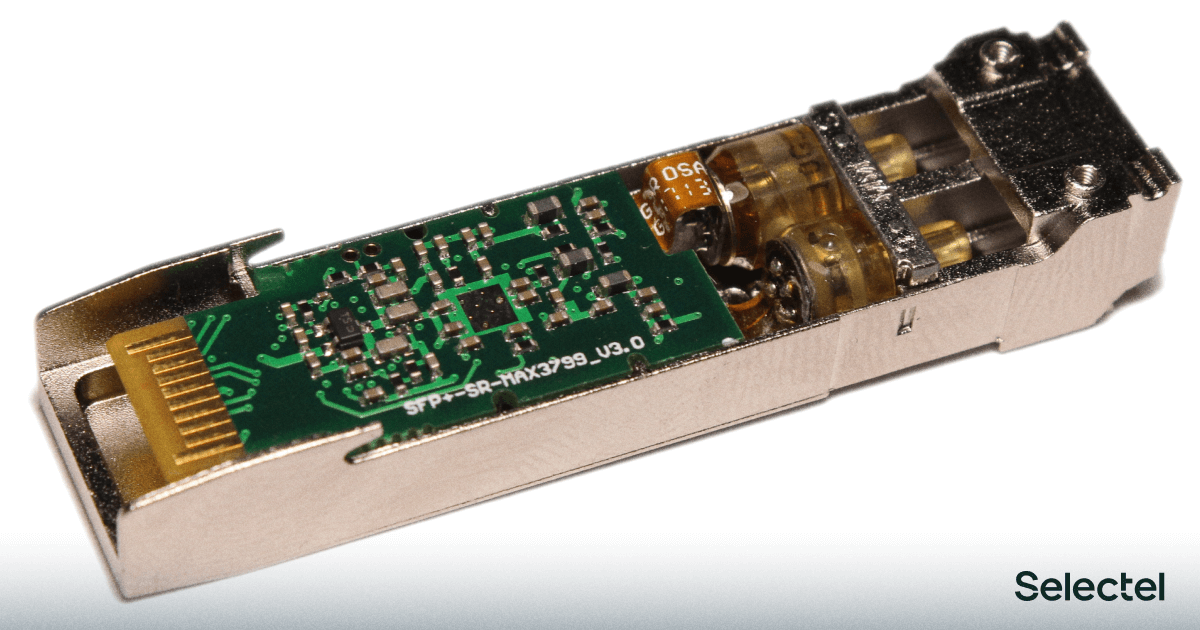

# Диагностика и перепрошивка оптических трансиверов

Серверное сетевое оборудование всегда проектируется с расчетом на длительную и бесперебойную работу. Трансиверы, позволяющие передавать данные с высокими скоростями по оптическому ... | https://habr.com/ru/post/574418/ | null | ru | null |

# Добавляем интернационализацию в приложение на Next.js

Интернационализированная маршрутизация и локализация на фреймворке Next.js.

Интернационализация (сокращенно «i18n») — это процесс подготовки веб-сайта ... | https://habr.com/ru/post/578024/ | null | ru | null |

# OTRS 4.0.10. Ставим на Ubuntu + AD + Kerberos + SSO (Часть вторая)

Продолжаю повествование о том, как собственно установить сего зверя на Ubuntu и настроить прозрачную доменную авторизацию, плюс о том, как прикрутить некоторые приятные плюшки, доступные в бесплатной версии OTRS.

[Часть первая: подготовка системы]... | https://habr.com/ru/post/265537/ | null | ru | null |

# Как мы получали доступ к базе реестра запрещенных ресурсов

Приветствуем тебя, хабрасообщество.

Самой обсуждаемой новостью текущей недели в рунете, безусловно, является принятие закона №139-ФЗ и его последствий. В силу того, что [наша компания](http://www.netangels.ru/) предоставляет услуги хостинга, нам понадобил... | https://habr.com/ru/post/158891/ | null | ru | null |

# Тест – это вещь! F#, тестирование на базе Expecto. Часть первая

[Expecto](https://github.com/haf/expecto) — фреймворк для тестирования, написанный на F# и для F#. Он довольно хорошо известен в рамках F#-со... | https://habr.com/ru/post/706576/ | null | ru | null |

# Dap — еще один реактивный движок для веба. Совсем другой

Хочу рассказать про dap — интересный и необычный язык реактивных правил для написания, в частности, веб-фронтендов.

Для затравки простая задачка: взять список неких пользователей (воспользуемся тестовыми данными, любезно предоставляемыми сервисом [jsonplace... | https://habr.com/ru/post/478330/ | null | ru | null |

# output в PHP

Хочу узнать, как можно ускорить 'вывод' страницы, написанной на php?

Код такой:

> `$start=microtime(true);

>

>

>

> echo $html;

>

>

>

> echo microtime(true)-$start;`

Страница загружается через сеть, посредством http запроса.

Результат работы скрипта:

0.023 — то есть потеря 0... | https://habr.com/ru/post/56376/ | null | ru | null |

# Совместная игра в Factorio — лучшее собеседование для программистов, что мы проводили

В последнее время много копий сломано вокруг технических собеседований. Очевидно, что инвертирование двоичного дерева на доске практически никак не связано ... | https://habr.com/ru/post/551622/ | null | ru | null |

# Как я провел лето с C# 8

В недавнем выпуске подкаста [DotNet & More](https://dotnetmore.ru/) [Blazor, NetCore 3.0 Preview, C#8 и не только](https://dotnetmore.ru/podcast/21-blazor/) мы лишь вскользь упомянули такую животрепещущую тему, как C#8. Рассказ об опыте работы с C# 8 был недостаточно большим, что-бы посвящат... | https://habr.com/ru/post/467655/ | null | ru | null |

# Как быстро обновить много серверов 1С

В основном проблема обновления платформы 1С стоит для клиентской части. Клиентских компьютеров может быть десятки и сотни, в то время как серверов на порядки меньше. У... | https://habr.com/ru/post/583678/ | null | ru | null |

# Тестовый клиент TON (Telegram Open Network) и новый язык Fift для смарт-контрактов

Больше года назад стало известно о планах мессенджера Telegram выпустить собственную децентрализованную сеть **Telegram Open Network**. Тогда стал доступен объемный технический документ, который, предположительно, был написан Николаем... | https://habr.com/ru/post/453714/ | null | ru | null |

# [Перевод] Анемичная модель предметной области — не анти-шаблон, а архитектура по принципам SOLID

*От переводчика: На проекте, где я работаю, сейчас идет активное переписывание логики, ранее реализованной в виде богатой модели предметной области (с использованием Active Record и Unit of Work). Новый подход включает в... | https://habr.com/ru/post/346016/ | null | ru | null |

# Как за одну минуту восстановить текст после неудачной отправки веб-формы

Бывало ли когда-нибудь так, что вы набирали в браузере длинный и интересный текст, внимательно вычитывали его, и тут, буквально через мгновение, понимали, что при обращении к сайту произошла ошибка, а ваш текст в форме был стёрт?

В основном ... | https://habr.com/ru/post/169193/ | null | ru | null |

# Отладка бага, который не воспроизводится

10 октября 2018 года наша команда выпустила новую версию приложения на React Native. Мы рады и гордимся этим.

Но ужас-то какой: через несколько часов внезапно увеличивается количество сбоев под Android.

Если говорить кратко, то в начале года у компании зародилась отличная мысль повысить компете... | https://habr.com/ru/post/675974/ | null | ru | null |

# Программируем BitTorrent-клиент. Чистый Delphi

Прошло 8 лет после написания статьи [Игорем Антоновым (Spider\_NET)](http://iantonov.me) про [создание торрент-клиента на C#](http://iantonov.me/page/programmir... | https://habr.com/ru/post/260339/ | null | ru | null |

# Конкурентность: Параллелизм

В этой статье мне хотелось бы задокументировать всё, что я знаю о том, какие средства можно использовать для эффективного использования вычислительных ресурсов систем и/или удобства разработки.

И, надеюсь, кому-нибудь это может оказаться полезно, ибо кто-нибудь может чего-нибудь не знать... | https://habr.com/ru/post/318374/ | null | ru | null |

# Статически типизированные продолжения

Намедни на RSDN был задан такой вопрос:

Пусть у нас есть функция, возвращающая полиморфный тип

```

class Base { virtual int foo() const = 0; };

class A : public Base { int foo() const { return 1; } };

class B : public Base { int foo() const { return 2; } };

class C : publi... | https://habr.com/ru/post/232979/ | null | ru | null |

# Как я боролся с кодировками в консоли

В очередной раз запустив в Windows свой скрипт-информер для [СамИздат-а](http://zhurnal.lib.ru) и увидев в консоли [«загадочные символы»](http://ru.wikipedia.org/wiki/%D0%9A%D1%80%D0%B0%D0%BA%D0%BE%D0%B7%D1%8F%D0%B1%D1%80%D1%8B) я сказал себе: «Да уже сделай, наконец, себе норма... | https://habr.com/ru/post/117236/ | null | ru | null |

# Библиотека react-svg-worlmap, ошибка в типах данных

### Введение

В одном переданном проекте на NextJs и typescript, попалась “интересная” ошибка при использовании библиотеки react-svg-worldmap. Для решения ошибки, пришлось обращаться к разработчику библиотеки.

### О библиотеке react-svg-worldmap

Данная библиотека... | https://habr.com/ru/post/649733/ | null | ru | null |

# О QR-кодах и социальной инженерии

> Новости из будущего:

> Группа анонимных хакеров придумала QR-код о вакцинации, которая вешает программу для его сканирования.

>

>

© Башорг

> — Рабинович, вы уклонялись от уплаты налогов так, как рассказывал прокурор?

> — Совсем нет. Но его схема таки тоже заслуживает внима... | https://habr.com/ru/post/667068/ | null | ru | null |

# Запускаем Golang на Jupyter Notebook

Если вы знакомы с Python, то уже сталкивались с Jupyter Notebook или работали в нём по крайней мере один раз. Jupyter Notebook — это удобный инструмент, позволяющий пи... | https://habr.com/ru/post/556938/ | null | ru | null |

# 24-ядерный CPU, а я не могу набрать электронное письмо

Я не искал неприятностей. Не запускал процесс сборки Chrome [тысячу раз за выходные](https://randomascii.wordpress.com/2017/07/09/24-core-cpu-and-i-cant-move-my-mouse/), а только занимался самыми обычными задачами 21-го века — просто писал электронное письмо в 1... | https://habr.com/ru/post/420579/ | null | ru | null |

# Frida-node или немножко странного кода

Приветствую всех, кто читает эту статью.

Как-то так сложилось, что на хабре практически нет упоминаний про замечательную штуку под названием Frida. Самое толковое из них заключается в паре строк кода и общем описании([HabraFrida](http://habrahabr.ru/company/dsec/blog/253309/... | https://habr.com/ru/post/268997/ | null | ru | null |

# PostgreSQL. Тестируй то, тестируй это, тестируй не боясь

### Вступление

Я всех категорически приветствую. Долгое время я с нетерпением ждал появления на хабре статей об одном замечательном проекте - Databa... | https://habr.com/ru/post/700368/ | null | ru | null |

# FusionPBX, или снова-здорово, FreeSWITCH

#### В ту же реку

Относительно недавно я написал себе [шпаргалку](https://habrahabr.ru/post/348458/) по настройке FreeSWITCH. Описанный там процесс настройки привел к работоспособной в тестовых условиях конфигурации. Тест был необходим для составления предварительного предст... | https://habr.com/ru/post/353156/ | null | ru | null |

# Библиотека быстрого поиска путей на графе

Привет, Друзья!

Я написал библиотеку поисков путей на произвольных графах, и хотел бы [поделиться ей с вами](http://github.com/anvaka/ngraph.path).

Пример использования на огромном графе:

Поиграться с демо можно [здесь](https://anvaka.github.io/ngraph.path.demo/)

В библи... | https://habr.com/ru/post/338440/ | null | ru | null |

# Хочу поиск как у MDN

Привет, друзья!

Недавно (где-то в конце августа) у MDN появился новый (крутой, по заявлению разработчиков) поиск.

Речь идет об этом виджете на главной странице:

Введение

--------

Недавно я затеял одиссею по изучению защит гибких дисков

В своих предыдущих постах я уже рассказывал (напрямую или косвенно) о примерах интересных ... | https://habr.com/ru/post/533610/ | null | ru | null |

# 5 приемов в помощь разработке на vue.js + vuex

Недавно решил разобраться с [vue.js](https://vuejs.org/). Лучший способ изучить технологию — что-нибудь на ней написать. С этой целью был переписан мой [старый планировщик маршрутов](https://github.com/Kasheftin/RoutePlanner), и получился [**вот такой проект**](https://... | https://habr.com/ru/post/332628/ | null | ru | null |

# Первый взгляд на CSS свойство object-view-box

Эта статья — перевод оригинальной статьи Ahmad Shadeed "[First Look At The CSS object-view-box Property](https://ishadeed.com/article/css-object-view-box/)"

Также я веду телеграм канал “[Frontend по-флотски](https://t.me/frontend_pasta)”, где рассказываю про интересные ... | https://habr.com/ru/post/667386/ | null | ru | null |

# Бюджетный мониторинг температуры: Arduino + Zabbix

У нас в организации развёрнут сервер Zabbix для мониторинга работоспособности серверов и АРМов. Из-за особенностей техпроцесса оборудование «размазано» по нескольким помещениям и разнесено по территории предприятия. Естественно, вместе с основными параметрами компью... | https://habr.com/ru/post/405077/ | null | ru | null |

# Программирование сетевых приложений на языке C++

Доброго времени суток! Я хочу поделиться с вами опытом, накопленным за несколько месяцев работы над данной темой.

Сейчас сетевые игры и приложения продолжают набирать популярность, а вместе с тем возрастает число желающих написать свою собственную программу, работа... | https://habr.com/ru/post/119055/ | null | ru | null |

# Упрощаем разработку под WP7 с библиотекой WPExtensions

На днях удалось выпустить релиз библиотеки WPExtensions. Старое рабочее название библиотеки было не очень вразумительное ShWP и в основном в библиотеке собраны расширения и обертки над стандартными элементами управления.

Добавил поддержку пакетного менеджера... | https://habr.com/ru/post/140678/ | null | ru | null |

# Selenium и Node.js: пишем надёжные браузерные тесты

Есть много хороших статей о том, как начать писать автоматизированные браузерные тесты, используя версию Selenium, предназначенную для Node.js.

[](https://habrahabr.ru/company/ruvds/... | https://habr.com/ru/post/338984/ | null | ru | null |

# О проблемах информационной безопасности и IT образования на примере HTML Academy

Меня всегда очень интересовала довольно грустная ситуация с языком РНР. Из неказистого шаблонного движка для веб-страничек, к середине 2010-х он... | https://habr.com/ru/post/672800/ | null | ru | null |

# Meta Gameplay Framework, или бэкенд без серверных разработчиков

Привет! Меня зовут Кирилл, я руководитель отдела серверной разработки в Pixonic. Здесь я работаю уже более 5 лет. Долгое время Pixonic была компанией одной игры — War... | https://habr.com/ru/post/527566/ | null | ru | null |

# CLion 1.2: еще больше возможностей и преимуществ

Сегодня мы хотим рассказать про новый релиз нашей кросс-платформенной IDE для C и C++ — CLion 1.2. Этот релиз вышел буквально на днях, в рамках [апдейта всех десктопных продуктов JetBrains и запуска новой лицензионной модели](http://habrahabr.ru/company/JetBrains/blog... | https://habr.com/ru/post/270185/ | null | ru | null |

# Как отслеживать использование памяти CPU и загруженность диска в Java

В этой статье, мы обсудим некоторые начальные команды, инструменты и методы, которые помогут отслеживать использование памяти CPU и загруженность диска в Java.

Java инструменты наблюдают за конструкциями и процессами байткода Java. Профайлеры Jav... | https://habr.com/ru/post/560984/ | null | ru | null |

# Опыт использования ZGC и Shenandoah GC в продакшене

Как любой адекватный поставщик информационных услуг, мы понимаем, что время отклика системы является очень важным фактором для создания у пользователей положительных впечатлений. Помимо этого, высокая скорость работы позволяет более плотно использовать серверные мо... | https://habr.com/ru/post/477692/ | null | ru | null |

# API сервера унифицированных коммуникаций CommuniGate Pro

Каждый кто устанавливал новые сложные системы в организациях сталкивался с тем, что разработчики программного обеспечения не предусмотрели их специфическо... | https://habr.com/ru/post/197720/ | null | ru | null |

# Делаем один проект плагина с компиляцией под разные версии Revit/AutoCAD

При разработке плагинов для САПР приложений ([в моем случае](https://modplus.org/ru/) это AutoCAD, Revit и Renga) со временем появляется одна проблема – выхо... | https://habr.com/ru/post/482308/ | null | ru | null |

# Расширение, изменение и создание элементов управления на платформе UWP. Часть 2

Итак, мы снова рассказываем об элементах управления на платформе UWP.

В [предыдущей части](https://habrahabr.ru/company/mobile_dimension/bl... | https://habr.com/ru/post/332630/ | null | ru | null |

# Голая правда

*Нудные технические подробности, без которых никак не обойтись, выделены знаком параграфа: ¶. Надеюсь, их можно пропускать без потери смысла изложения.*

Часть первая. Высадка

---------------------

Как это случается часто, в последнее время, новые вирусы приходят прямиком в почту, — быстро, удобно и ... | https://habr.com/ru/post/26847/ | null | ru | null |

# Лучшие плагины для Sublime Text

#### [WebInspector](https://github.com/sokolovstas/SublimeWebInspector)

Мощный инструмент для дебаггинга JavaScript, полноценный инспектор кода для Sublime. Фичи: установка брейкпоинтов прямо в редакторе, показ интерактивной консоли с кликабельными объектами, остановка с показом стек... | https://habr.com/ru/post/235901/ | null | ru | null |

# ActiveResource, prefix и вложенные ресурсы

Предыстория

-----------

Я программист с очень небольшим стажем (недавно накопилось около года в трудовой).

Около полугода назад я начал работать с Ruby (вне Rails) и сразу же познакомился с Active Resource и Redmine.

Это был очень интересный опыт, сейчас мне кажется,... | https://habr.com/ru/post/279727/ | null | ru | null |

# Умный print для C

Пример использования:

```

#include "print.h"

int main() {

print("number:", 25,

"fractional number:", 1.2345,

"expression:", (2.0 + 5) / 3

);

}

```

```

number: 25 fractional number: 1.2345 expression: 2.33333

```

Дженерик вызов не только проще набирать, чем стандартный `printf()`, но ... | https://habr.com/ru/post/544038/ | null | ru | null |

# Пять задач, которые приходится решать при трудоустройстве начинающим Java-разработчикам в 2022 году

Хабр, привет! Меня зовут Даниил Пилипенко, я программный директор [факультета backend-разработки](https://skillbox.ru/faculty/backend-development/) направления «Программирование» Skillbox, директор центра подбора IT-с... | https://habr.com/ru/post/689226/ | null | ru | null |

# QuickBlox: Авторизация и аутентификация

Привет Хабровцы!

Сегодня я расскажу о методах аутентификации в [**QuickBlox**](http://quickblox.com). А так же затрону авторизацию и её аспекты.

Итак, любой запрос к API ... | https://habr.com/ru/post/144038/ | null | ru | null |

# Разработка приложения для старого КПК (Cybiko Xtreme) в 2019 году

### Введение

Привет Хабр! Я хотел бы поделиться своим опытом написания приложения для очень старого карманного компьютера, который серьезно опередил свое время, ... | https://habr.com/ru/post/445686/ | null | ru | null |

# Разработка класса для работы с цепями Маркова

Сегодня я хотел бы поведать вам о написании класса для упрощения работы с цепями Маркова.

Прошу под кат.

Начальные знания:

Представление графов в форме матрицы смежности, знание основных понятий о графах. Знание C++ для практической части.

#### Теория

> Це́п... | https://habr.com/ru/post/302392/ | null | ru | null |

# Кроссплатформенный https сервер с неблокирующими сокетами. Часть 2

Эта статья является продолжением статей:

[Простейший кросcплатформенный сервер с поддержкой ssl](http://habrahabr.ru/post/211474/)

[Кроссплатформенный https сервер с неблокирующими сокетами](http://habrahabr.ru/post/211661/)

В этих статьях ... | https://habr.com/ru/post/211853/ | null | ru | null |

# 4 слова

```

#пятничное

```

В нашей компании на данный момент есть три вакансии:

— [Frontend-разработчик](https://moikrug.ru/vacancies/1000037138)

— [QA Инженер](https://moikrug.ru/vacancies/1000034636)

— [Младший UX/UI-дизайнер](https://moikrug.ru/vacancies/1000037911)

И почти всю эту неделю мы проводим... | https://habr.com/ru/post/342110/ | null | ru | null |

# Как Windows 11 уменьшила размер кумулятивных обновлений на 40%

Раз в месяц Microsoft выпускает кумулятивное обновление Windows, которое включают в себя все предыдущие. То есть для приведения системы в актуальное состояние требуетс... | https://habr.com/ru/post/587714/ | null | ru | null |

# Переписываем с java на C++ на платформе Android

Хочу с вами поделиться опытом переписывания с java на C++ на платформе Android и тем, что в результате получилось.

Для своего маленького домашнего проекта был использован алгоритм поиска лиц Виола-Джонса, java-исходники с моделью были взяты отсюда [code.google.com/p... | https://habr.com/ru/post/268653/ | null | ru | null |

# Как настроить удобную синхронизацию между Notion и календарем через ICS на JS без сервера

Уже почти 2 года я активно использую Notion в своей жизни. Я регулярно пополняю его своими личными автоматизациями, которые облегчают жизнь мне и моей команде. Иногда я публикую [в своем блоге](https://amorev.ru/tag/notion/) ра... | https://habr.com/ru/post/692422/ | null | ru | null |

# Building Modern Cloud Applications using Pulumi and .NET Core

We are excited to announce .NET Core support for Pulumi! This announcement means you can declare cloud infrastructure — including all of Azure, such as Kubernetes, Functions, AppService, Virtual Machines, CosmosDB, and more — using your favorite .NET lang... | https://habr.com/ru/post/475990/ | null | en | null |

# Микроядро vs. монолит и «торжество» MINIX

Недавно Эндрю Таненбаум, профессор Амстердамского свободного университета, автор учебной и миниатюрной Unix системы Minix, вновь оказался в центре событий благодаря эпистолярному жанру. В своем [письме](http://www.opennet.ru/opennews/art.shtml?num=47539) Интел он поблагодари... | https://habr.com/ru/post/344826/ | null | ru | null |

# Скучно, просто и ограниченно — все это изотоническая регрессия

Вкратце о маленьком пакете cir.

Минутка теории

--------------

Изотоническая регрессия - это крайне специфический вид регрессии, который применяется при жестком требовании неубывания значения зависимой переменной при возрастании значения независимой пер... | https://habr.com/ru/post/577942/ | null | ru | null |

# Способы передачи финансовых данных #2: протокол FAST

[](http://habrahabr.ru/company/itinvest/blog/243657/)

В одном из прошлых топиков мы рассмотрели [протокол FIX](http://habrahabr.ru/company/itinve... | https://habr.com/ru/post/243657/ | null | ru | null |

# Мировые корпорации. Есть ли свет в конце туннеля?

Предисловие

-----------

Глобальные корпорации уже давно и прочно вошли в нашу повседневную жизнь своими продуктами, зачастую не оставляя пользователям аль... | https://habr.com/ru/post/586680/ | null | ru | null |

# Как я структурирую CSS

*Приветствую. Представляю вашему вниманию перевод статьи* [*«How I St*](https://matthiasott.com/notes/how-i-structure-my-css?ref=heydesigner)[*r*](https://matthiasott.com/notes/how-i-structure-my-css)[*ucture My CSS (for Now)»*](https://matthiasott.com/notes/how-i-structure-my-css?ref=heydesig... | https://habr.com/ru/post/523884/ | null | ru | null |

# Общие спринты в Atlassian Jira Software

Всем привет!

В этой статье я хотел бы поговорить об Общих Спринтах (Shared Sprints) в Atlassian Jira Software.

Если почитать официальную документацию, например, вот [тут](https://bitbucket.org/atlassian/jira_docs/downloads/), то там не будет такого понятия как общий спри... | https://habr.com/ru/post/430966/ | null | ru | null |

# Как создать образ диска в Linux с несколькими разделами, не имея физического образца

Здравствуй дорогой читатель данного руководства. Меня зовут Андрей, и нет, я не алкоголик, а разработчик встраиваемых систем на базе Linux.

Данная статья является кратким руководством по созданию образа диска с несколькими разделам... | https://habr.com/ru/post/653153/ | null | ru | null |

# Как я писал библиотеку под МЭК 870-5-104 на Arduino при помощи Wireshark

В этой статье я хотел бы рассказать о своем знакомстве с протоком передачи данных МЭК 870-5-104 со стороны контролируемого (slave) устройства путем написания простой библиотеки на Arduino.

Что такое МЭК 870-5-104 это и где применяется?

-----... | https://habr.com/ru/post/280818/ | null | ru | null |

# Телефония на Cisco (Call Manager Express) — Часть 1

Начав изучать CVoice (642-436) я решил выкладывать некоторые лабы в виде статей. Первая часть — такой себе «Hello World», звонок с одного телефона на другой.

*Перевод замечательного туториала по интегрированию мультиплеера с использованием Game Center в iOS-игру. На [... | https://habr.com/ru/post/173449/ | null | ru | null |

# Centos 7.x USB Install Media (Добавляем Centos в Multiboot)

Как бывало здорово, берешь образ CentOS 6.x, выдергиваешь из него куски, и пихаешь все это на USB флешку, по соседству с другими системами.

Но, начиная с Centos 7, сделать это стало немного сложнее, и единственным официальным способом стала запись образа... | https://habr.com/ru/post/275751/ | null | ru | null |

# Цифровая рыбалка в GitHub Copilot

Эта небольшая заметка посвящена одной особенности GitHub Copilot. Про неё можно найти вопросы на [stackoverflow](https://stackoverflow.com/questions/70559637/github-copilot-giving-away-api-keys-how-can-i-protect-my-keys), статьи и видео в интернете, но на хабре я не видел материалов... | https://habr.com/ru/post/668446/ | null | ru | null |

# Вы всё ещё ловите исключения? Тогда мы к вам

Как знают многие разработчики, обработка ошибочных ситуаций - архиважная составляющая любого полноценного кода, претендующего на использование в реальной жизни.

И как следствие, писать обработку ошибок - прямая обязанность любого ответственного программиста. Некоторые сч... | https://habr.com/ru/post/540102/ | null | ru | null |

# J2CL — Лучше поздно, чем никогда

*Ещё никому не удалось опоздать на свои похороны.

Валентин Домиль*

На прошлой неделе команда из Google [наконец-то выложила исходники фреймворка J2CL](https://github.com/google/j2cl), о котором говорили с 2015 года. Идея трансляции Java в JavaScript далеко не нова, и все уже давн... | https://habr.com/ru/post/430378/ | null | ru | null |

# 5 главных причин того, что JS-разработчики будут использовать Deno вместо Node

Создатель Node.js Райан Даль выпустил новую платформу, которая рассчитана на решение многих проблем Node.js. Возможно, вашей первой реакцией на эту новость будет: «О, отлично, очередной JS-фреймворк? Его мне только и не хватало…». Я отреа... | https://habr.com/ru/post/504584/ | null | ru | null |

Subsets and Splits

No community queries yet

The top public SQL queries from the community will appear here once available.