text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

values | source stringclasses 4

values |

|---|---|---|---|---|

# Dark code-style academy: line breaks, spacing, and indentation

Hey guys! Let me walk you through the next part of our dark-style code academy. In this post, we will discover some other ways how to slow down... | https://habr.com/ru/post/517690/ | null | en | null |

# Особенности проектирования модели данных для NoSQL

Введение

--------

*«Нужно бежать со всех ног, чтобы только оставаться на месте,

а чтобы куда-то попасть, надо бежать как минимум вдвое быстрее!»

(с) Алиса в стране чудес*

Нек... | https://habr.com/ru/post/504166/ | null | ru | null |

# GitLab Flow

*Это перевод достаточно важной статьи про GitLab Flow, альтернативе Git flow и GitHub flow. Статья была написана в 2014, так что скриншоты успели устареть. Тем не менее сама статья более чем актуальна:*

---

Ветвление и слияние веток в git устроено гораздо проще, чем в более ранних системах контроля вер... | https://habr.com/ru/post/316686/ | null | ru | null |

# Отладка многопоточных программ на базе FreeRTOS

Отладка многозадачных программ дело не простое, особенно если ты сталкиваешься с этим впервые. После того, как прошла радость от запуска первой задачи или первой демо программ... | https://habr.com/ru/post/352782/ | null | ru | null |

# 16 тонн. Как я спасал гибнущий под нагрузкой сайт на WordPress, имея весьма поверхностные знания в области этой CMS

Статья будет короткой и сумбурной — я пишу ее с целью скоротать пару часов перед тем как начать откатывать сайт к предыдущему «нормальному» состоянию.

Эта история началась пять часов назад. Ко мне о... | https://habr.com/ru/post/347134/ | null | ru | null |

# Раздражающее поведение менеджера обновлений в Ubuntu 9.04 и как это вылечить

Не знаю из каких соображений, но способ уведомлений о доступных обновлениях системы в 9.04 был изменён. По-умолчанию, раз в неделю проверяются обновления, и если такие есть, то внезапно появляется окно со списком этих пакетов.

На мой взгляд, директивы являются основной изюминкой декларативного стиля Angularjs. Однако, если открыть комментарии пользователей в разделе официальной документации Angularjs... | https://habr.com/ru/post/180365/ | null | ru | null |

# Визуализация статических и динамических сетей на R, часть 5

В [первой части](http://habrahabr.ru/company/infopulse/blog/262079/):

* визуализация сетей: зачем? каким образом?

* параметры визуализации

* best practices — эстетика и производительность

* форматы данных и подготовка

* описание наборов данных, которые и... | https://habr.com/ru/post/266285/ | null | ru | null |

# 1С,.Net Core. Динамическая компиляция класса обертки для получения событий .Net объекта в 1С

Это практическое применение из предыдущей статьи [.Net Core, 1C, динамическая компиляция, Scripting API.](https://habrahabr.ru/post/309340/)

По сути это продолжение [.NET(C#) для 1С. Динамическая компиляция класса обертки... | https://habr.com/ru/post/309850/ | null | ru | null |

# Анатомия запросов GraphQL

Джентльменский набор терминов

-----------------------------

Новый стандарт получения данных GraphQL стал популярен совсем недавно. Сейчас активно обсуждается развитие этой технологии, появляются все новые инструменты. Одно из достоинств GraphQL – он дает команде разработчиков универсальный... | https://habr.com/ru/post/335050/ | null | ru | null |

# Создание Minimum Viable Product в сфере энергетики за 1,5 года командой инженеров без навыков программирования

Кожухотрубчатый теплообменник0. Ч... | https://habr.com/ru/post/651207/ | null | ru | null |

# Visual PHP для Windows

На сегодняшний день язык PHP широко распространён, он прост в освоении и понимании, и наверное поэтому он так популярен у начинающих программистов. Без знаний PHP не поправить блок голосования на сайте, не отредактировать PHP шаблон, не вставить рекламный баннер. Многие идут дальше и изучают я... | https://habr.com/ru/post/120975/ | null | ru | null |

# Mikrotik — Дополнительные настройки для Yota

Не так давно подключили дополнительного провайдера в виде беспроводной йоты, простого «свистка». Имеем Mikrotik CCR1009-8G-1S-1S+, на котором есть usb. Но возникла проблема, йота периодически зависает и пока не перезагрузишь — ничего не работает. Обращался в техническую п... | https://habr.com/ru/post/277435/ | null | ru | null |

# Установка Cisco Nexus 1000v в VMware vSphere 5.x

Статья является переводом двух статей AJ Cruz:

[Nexus 1000v Part 1 of 2 (Theory)](http://nexusfu.blogspot.ru/2013/09/nexus-1000v-part-1-of-2-theory.html)

[Nexus 1000v Part 2 of 2 (Installation & Operation)](http://nexusfu.blogspot.ru/2013_10_01_archive.html)

... | https://habr.com/ru/post/363233/ | null | ru | null |

# Руководство по стилю Kotlin для Android разработчиков (Часть II)

В принципе, я согласен с комментариями, что данная тема излишняя, так как существуют автоматические инструменты форматирования кода

И к тому... | https://habr.com/ru/post/538534/ | null | ru | null |

# Загубить производительность

Эта заметка является писанной версией моего доклада "Как загубить производительность с помощью неэффективного кода" с конференции JPoint 2018. Посмотреть видео и слайды можно на [странице конференции](http://2018.jpoint.ru/talks/1smez2ivjmiw0wskqimew0/). В расписании доклад отмечен обидны... | https://habr.com/ru/post/423305/ | null | ru | null |

# Агрегация каналов и балансировка трафика по IP для СХД

Для небольших компаний нередко применение всего двух-четырех серверов с виртуализацией, два Ethernet свитча порой даже с возможностью стекирования и Multi-chassis EtherChannel плюс СХД младшей серии — это вполне стандартная конфигурация инфраструктуры среднего б... | https://habr.com/ru/post/215351/ | null | ru | null |

# Примеры фишинговых сообщений электронной почты

Я не случайно поставил в заглавие поста картинку с котиком. Это один из примеров манипулирования человеческим сознанием, апеллирование к жалости. Методы воздействия злоумышле... | https://habr.com/ru/post/271123/ | null | ru | null |

# Введение в Maven Toolchain

Java развивается гораздо быстрее, чем раньше. Но не все проекты, над которыми мы работаем, поспевают за этим темпом.

У меня есть проекты на Java 8, 11 и 17, и иногда я хочу поиграть с имеющимися сборками более новых версий.

Как обеспечить их создание без необходимости постоянно переключа... | https://habr.com/ru/post/647831/ | null | ru | null |

# Go Quiz

In this series, we will be discussing interesting aspects and corner cases of Golang. Some questions will be obvious, and some will require a closer look even from an experienced Go developer. These question will help to deeper the understanding of the programming language, and its underlying philosophy. Wit... | https://habr.com/ru/post/550786/ | null | en | null |

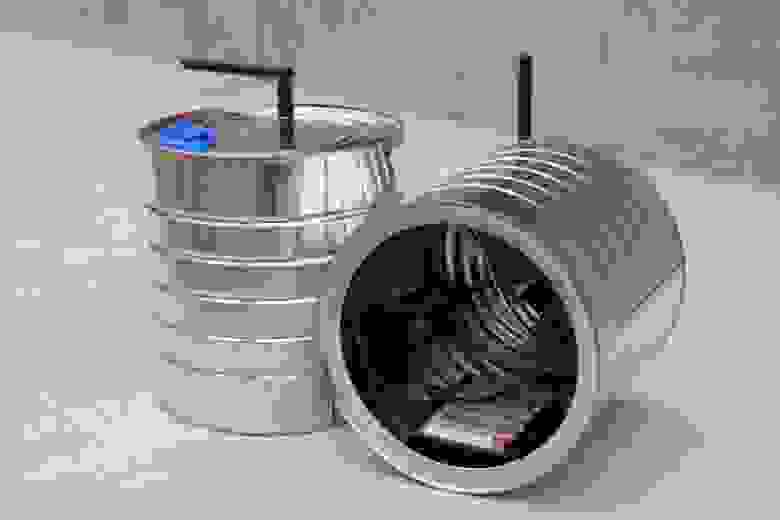

# Беспроводной телефон из консервных банок

### Новый подход к старой игрушке — беспроводной телефон из консервных банок берёт прошлогоднюю технологию и впихивает её в современность!

Буквально вчера ... | https://habr.com/ru/post/507410/ | null | ru | null |

# Bitcoin: история развития, от CPU до FPGA

[(источник фото)](http://smeagle123.deviantart.com/art/I-dont-care-who-you-are-thats-funny-353282169)

[Ранее](http://habrahabr.ru/company/intel/blog/205524/)... | https://habr.com/ru/post/205530/ | null | ru | null |

# Раскрытие памяти (Memory Disclosure) ядра в современных ОС

Под катом расположен перевод **вступительной части** документа [Detecting Kernel Memory Disclosure with x86 Emulation and Taint Tracking](https://j00ru.vexillium.org/papers/2018/bochspwn_reloaded.pdf) ([Статья Project Zero](https://googleprojectzero.blogspot... | https://habr.com/ru/post/415685/ | null | ru | null |

# Juniper: composite-next-hop

В статье о EVPN я упомянул о необходимости во включении composite-next-hop для работы EVPN, после чего как минимум 10 человек задали мне один и тот же вопрос — что же такое composite-... | https://habr.com/ru/post/324268/ | null | ru | null |

# Квайн на Brainfuck, тьюториал

На Хабре уже есть множество статей о квайнах и технологиях их написания. Любителям квайнов может стать скучно — есть шаблон, следуешь ему, получаешь квайн. Мультиязыковой квайн, даже с участием эзотерических языков тоже написать несложно и об этом тоже есть по меньшей мере три статьи. В... | https://habr.com/ru/post/193764/ | null | ru | null |

# PHP + Twitter

[Twitter](http://twitter.com) сейчас бурно развивается и на то были причины, есть в нем хорошие функции, которые можно использовать и в своих проектах.

На Хабре есть фишка связанная с ним, если в профиле ввести свой Twit-аккаунт, то последнее сообщение будет стоять у вас в статусе — мелочь, а приятн... | https://habr.com/ru/post/50216/ | null | ru | null |

# Linux и бесплатные облачные хранилища, семь лет спустя

В 2015 году я писал [небольшой обзор](https://habr.com/ru/post/266293/) облачных хранилищ, которые давали максимальный бесплатный объём и при этом была возможность их использовать в линуксе, примонтировав в папку. Набрёл на свой пост и решил посмотреть, как сказ... | https://habr.com/ru/post/651609/ | null | ru | null |

# Hibernate для самых маленьких и не только

Доброго всем времени суток! При написании программы, которая так или иначе будет взаимодействовать с базой данных, пользуются разными средствами. Это и старый добрый [jdbc](http://ru.wikipedia.org/wiki/Java_Database_Connectivity), также применяют: [EclipseLink](http://ru.wik... | https://habr.com/ru/post/132385/ | null | ru | null |

# Сравнение стратегий игры 2048

2048 — игра появившаяся в 2014ом году и быстро ставшая популярной убивалкой времени. Простые правила игры только подталкивают игроков к созданию клонов, ботов и выигрышных стратегий. В том числе и на Хабре. ([Клон](https://habrahabr.ru/post/249371/), [бот](https://habrahabr.ru/sandbox/8... | https://habr.com/ru/post/317370/ | null | ru | null |

# Избыточная сложность

Слышал такое выражение, что для того чтобы стать программистом, нужно быть ленивым. Но иногда лень в программировании приводит к возникновению ужасного технического долга. В своей заметке об SRP я упоминал, что нарушение этого принципа может привести к увеличению сложности или даже к умножению е... | https://habr.com/ru/post/457018/ | null | ru | null |

# Знакомство со статическим анализатором PVS-Studio для Java

На протяжении многих лет команда PVS-Studio развивает одноименный статический анализатор. На данный момент анализатор представляет собой сложное программное решение и предоставляет возможность анализа таких языков программирования, как C, C++, C# и Java на п... | https://habr.com/ru/post/462275/ | null | ru | null |

# Импорт ЕГРЮЛ ФНС средствами Apache NiFi. Шаг 1 — загрузка файлов по HTTPS

В одном из проектов возникла необходимость перевести процессы импорта данных сторонних систем на микросервисную архитектуру. В качестве инструмента выбран Apache NiFi. В качестве первого подопытного выбран импорт ЕГРЮЛ ФНС.

Данные ЕГРЮЛ публи... | https://habr.com/ru/post/496900/ | null | ru | null |

# Создаём простое UI5-приложение в Web-среде разработки

Привет Хабр!

В начале мая я упомянул, что покажу процесс создания простого UI5 приложения в Web-среде разработки, которую предоставляет SAP Hana Cloud Platform... | https://habr.com/ru/post/261023/ | null | ru | null |

# Высокопроизводительный код на платформе .NET

Здравствуйте, дорогие читатели!

Не так давно мы занялись проработкой книги "[Writing High-Performance .NET code](http://www.amazon.com/Writing-High-Performance-NET-Code-Watson/dp/0990583430/)", которая до сих пор не переведена на русский язык, хотя ей и скоро год.

!... | https://habr.com/ru/post/260623/ | null | ru | null |

# В чём различие между папками Windows и System?

*(Windows была выпущена 20 ноября 1985. Сегодня ей исполняется 25. С днём рождения!)*

В Windows API с самого начала есть две отдельные функции `GetWindowsDirectory` и `GetSystemDirectory`. Почему недостаточно было одной? Обе эти системные папки защищены от записи, об... | https://habr.com/ru/post/108490/ | null | ru | null |

# Jetpack Compose Layouts

Иногда для вёрстки сложных экранов не хватает Row, Column, Box и других встроенных контейнеров, тогда нам приходится писать свои собственные. В этой статье мы напишем Row, который переносит дочерние элементы на следующую строку в случае недостатка места.

Эта статья поделена на 2 части: базо... | https://habr.com/ru/post/691954/ | null | ru | null |

# Маленький код для больших данных или Apache Spark за 3 дня

*Пусть Жираф был не прав,

Но виновен не Жираф,

А тот, кто крикнул из ветвей:

«Жираф большой — ему видней!» (с)*

Потребовалось оперативно разобраться с технологией [Apache Spark](http://spark.apache.org) заточенную для использования Big Data. В п... | https://habr.com/ru/post/316088/ | null | ru | null |

# Web-приложение на C/C++ с помощью FastCGI — это просто

Добрый день.

В этой статье я бы хотел рассказать про протокол FastCGI и способы работы с ним. Не смотря на то, что сам протокол и его реализация появились ещё в 1996 году, подробных руководств по этому протоколу просто нет — разработчики так и не написали спр... | https://habr.com/ru/post/154187/ | null | ru | null |

# Как использовать именованные конструкторы в PHP

*tl; dr — Не ограничивай себя одним конструктором в классе. Используй статические фабричные методы.*

PHP позволяет использовать только один конструктор в классе, что довольно раздражительно. Вероятно, мы никогда не получим нормальную возможность перегрузки конструкт... | https://habr.com/ru/post/279919/ | null | ru | null |

# 6 причин установить Linux Mint вместо Ubuntu: первый взгляд на Mint 21 “Vanessa”

Linux Mint основан на пакетной базе версий Ubuntu с долгосрочной поддержкой (LTS — от англ. long term support) и выходит раз в два года через несколько месяцев после релиза родительского дистрибутива.

**Зачем нужен Mint, если есть Ubun... | https://habr.com/ru/post/682722/ | null | ru | null |

# Рисование эллипса под произвольным углом в canvas на JavaScript

В процессе разработки одного приложения столкнулся с необходимостью рисования эллипсов под произвольным углом в canvas на JavaScript. Пользоваться какими-либо фреймворками в столь простом проекте не хотелось, так что я отправился на поиски статьи-мануал... | https://habr.com/ru/post/255485/ | null | ru | null |

# Обзор площадки для тестирования веб-уязвимостей OWASP Top-10 на примере bWAPP

Привет, Хабр!

В этой статье предлагаю читателю ознакомится с уязвимостями веб-приложений (и не только), по классификации OWASP Top-10, и их эксплуатацией на примере bWAPP.

.***

---

*Вычисляемые столбцы могут стать причиной сложнодиагн... | https://habr.com/ru/post/519848/ | null | ru | null |

# Совершенствуем Redux

Привет, Хабр! Представляю вашему вниманию перевод статьи "[Redesigning Redux](https://hackernoon.com/redesigning-redux-b2baee8b8a38)" автора Shawn McKay.

Должно ли управление состоянием вызывать проблемы на сегодняшний день? Интуитивно, разработчики видят скрытую правду: управление состоянием... | https://habr.com/ru/post/353554/ | null | ru | null |

# Построение графов с помощью библиотеки PyViz на основе текстового анализа ESG стратегий отдельных компаний

В настоящее время многие страны мира сконцентрировались на таком важном направлении как экологическое, социальное и корпоративное управление организациями (ESG). Под этим сложным понятием чаще всего подразумева... | https://habr.com/ru/post/567688/ | null | ru | null |

# Формула Даламбера в действии

Добрый день!

Сегодня я бы хотел Вам представить небольшую программку, которая использует формулу Даламбера:

На мой взгляд, здесь происходит смещение функции одной относительно другой... | https://habr.com/ru/post/545426/ | null | ru | null |

# Проведены масштабные испытания по использованию спутника в качестве сотовой вышки для обычных телефонов

Компания **Lynk Global** [сообщает](https://www.satellitetoday.com/telecom/2022/02/08/lynk-tests-connect-satellite-to-thousands-of-cell-phones-and-iot-devices/), что успешно завершены испытания по подключению ее с... | https://habr.com/ru/post/651461/ | null | ru | null |

# Как написать скрипт HelloWorld для Kodi на Python 2.x

### 1. Введение

Напишите ваш первый скрипт для Kodi/XBMC с помощью этого урока! Если вам нужна помощь с написанием плагина, [открывайте урок](http://kodi.wiki/view/Audio-video_add-on_tutorial) .

### 2. Инструменты

Для вашего первого скрипта выбирайте текстов... | https://habr.com/ru/post/555386/ | null | ru | null |

# Ruby Digest 2020·07·1

Ruby Digest 2020 с 1 по 15 июля: релизы, статьи, мультимедиа, обучение. Разбираемся,

что происходило в первой половине июля вокруг языка Ruby.

Релизы

------

#### Новинки

[AnyCable 1.0.0](https:/... | https://habr.com/ru/post/512540/ | null | ru | null |

# 7 правил написания технической документации мирового класса

#### Введение

Написание технического документа — трудное дело. Чтение плохо написанного технического документа является более трудным и, вероятно, более болезненным делом, чем его написание. Требуется большая работа, чтобы создать ясное, точное, интересное... | https://habr.com/ru/post/303760/ | null | ru | null |

# C#. Сортировка членов типа с помощью ReSharper

Существуют некоторые соглашения касаемые структуры класса, и того, в каком порядке должны располагаться его члены.

Вот, например, [правила](http://www.st... | https://habr.com/ru/post/208464/ | null | ru | null |

# Генератор музыки на базе кодогенератора

Привет, хабраюзер! В этом топике я расскажу о своей идее генерации музыкальных композиций. Создадим язык описания ритма музыки на базе python, напишем компилятор этого языка в wave файлы и получим довольно нехилую электронную композицию.

Добро пожаловать под кат.

Кому не... | https://habr.com/ru/post/304496/ | null | ru | null |

# Как управлять вашими секретами с git-crypt

Большинство программных проектов используют секреты – обычно, как ключи к удаленному API или данные для доступа к внешнему ресурсу, например к базе данных. Вашему приложению необходимы эти ключи во время работы, поэтому вам нужно предоставить их при развертывании приложения... | https://habr.com/ru/post/570306/ | null | ru | null |

# Раздуваем таблицы и пожираем tablespaces

~~Картинка для придания нужного настроения~~

#### Доброго времени суток!

В интернете вообще и на Хабре в частности немало публикаций о ремонте битых блоков. ... | https://habr.com/ru/post/198606/ | null | ru | null |

# Создание Google пользователей из PowerShell через API

Привет!

В этой статье будет описана реализация взаимодействия PowerShell с Google API для проведения манипуляций с пользователями G Suite.

В организации мы используем несколько внутренних и облачных сервисов. По большей части авторизация в них сводится к Go... | https://habr.com/ru/post/468969/ | null | ru | null |

# Маленький и быстрый BERT для русского языка

[BERT](https://arxiv.org/abs/1810.04805) – нейросеть, способная неплохо понимать смысл текстов на человеческом языке. Впервые появившись в 2018 году, эта модель совершила переворот в компьютерной лингвистике. Базовая версия модели долго *предобучается,* читая миллионы текс... | https://habr.com/ru/post/562064/ | null | ru | null |

# Энергосберегающий background location + отправка данных на сервер из фона

##### Постановка задачи

В приложении необходимо отслеживать местоположение пользователя, когда приложение работает в фоновом режиме (с относительно приемлимой точностью), а также когда приложение активно (с высокой точностью).

##### Решени... | https://habr.com/ru/post/149836/ | null | ru | null |

# Еще один способ поставить tails на флешку (и вернуть свои гигабайты)

Добрый день, читатель!

[TAILS](https://tails.boum.org/) — это замечательный live дистрибутив, которым можно проверить ноут перед покупкой и через котор... | https://habr.com/ru/post/332032/ | null | ru | null |

# JSR 335 или lambda-выражения в JAVA 8

#### Введение

Посетил вчера [семинар](http://jug.ru/) по lambda-выражениям в JAVA 8. Рассказали много интересного.

Из интересностей:

#### lambda-выражения

```

Comparator cmp = (x, y) -> (x < y) ? -1 : (x > y) ? 1 : 0;

```

Слева обязательный интерфейс, определяющий lamb... | https://habr.com/ru/post/155191/ | null | ru | null |

# Разработка компонента для создания коллажей

Популярность приложений для обработки фотографий постоянно растет. Недавно мы предлагали вниманию наших читателей [гайд для новичков](https://habrahabr.ru/company/everydaytools/blog/325352/) по написанию собственного фоторедактора. Сегодня мы хотели бы поделиться с хабровч... | https://habr.com/ru/post/326940/ | null | ru | null |

# Запуск SQL запросов в SAP

При внедрении информационных решений на базе SAP ERP, как правило, разворачиваются три системы:

1. Система разработки.

2. Система тестирования.

3. Система продуктивной эксплуатации.

В п... | https://habr.com/ru/post/251665/ | null | ru | null |

# MarkitUp! — Легкий редактор на jQuery

#### Введение

Всех приветствую!

Совсем недавно мне пришлось немного расширить функционал редактора одного проекта. Но как оказалось в моем случае я наткнулся на некие трудности. В этой статье я поделюсь с читателями как я вышел из сложившийся ситуации.

#### Как все было

... | https://habr.com/ru/post/128352/ | null | ru | null |

# SSH-туннель домой без необходимости оставлять включённым домашний ПК

> **Disclaimer**

>

> Этот пост появился здесь по нескольким причинам:

>

> 1) Меня попросил сам [Boomburum](https://habrahabr.ru/users/boomburum/)

>

> 2... | https://habr.com/ru/post/116214/ | null | ru | null |

# JAVA+Swing в 2013. Стоит ли?

На Хабре Swing не любят. [Поиск](http://habrahabr.ru/search/?target_type=posts&q=swing&order_by=date) по «Swing» дает либо нейтральные, либо негативные упоминания. Вот некоторые из них:

* «Java-апплеты (доразвивались до смертельной болезни под названием Swing)»

* «Swing — мягко говор... | https://habr.com/ru/post/179459/ | null | ru | null |

# Использование дискретной математики в тестировании

Прежде всего хотелось бы сказать, что математика помогает привести наши мысли в порядок и эффективно развивает логическое мышление, а это одни из самых необходимых качеств участников разработки программного обеспечения. Говоря о тестировании, то оно в основном касае... | https://habr.com/ru/post/451886/ | null | ru | null |

# Назад к микросервисам вместе с Istio. Часть 3

***Прим. перев.**: [Первая часть](https://habr.com/ru/company/flant/blog/438426/) этого цикла была посвящена знакомству с возможностями Istio и их демонстрации в действии, [вторая](htt... | https://habr.com/ru/post/443668/ | null | ru | null |

# Код живой и мёртвый. Часть первая. Объекты

Код — это мысль. Появляется задача, и разработчик думает, как её решить, как выразить требования в функциях и классах, как сдружить их, как добиться строгости и корректности и как подмастить бизнес. Практики, методики, принципы, шаблоны и подходы — всё нужно учесть и всё ну... | https://habr.com/ru/post/447404/ | null | ru | null |

# Храним SSH-ключи безопасно

Хочу рассказать как безопасно хранить SSH-ключи на локальной машине, не боясь того, что какое-то приложение может украсть или расшифровать их.

Статья будет полезна тем, кто так и не нашел элегантного реше... | https://habr.com/ru/post/435270/ | null | ru | null |

# Идентификация коинтегрированных пар акций на фондовых рынках

Цель данной статьи — поделиться результатами исследования по выявлению коинтегрированных пар акций, которые представлены на Московской и Нью-Йоркской биржах, с помощью теста Энгла-Грэнджера.

Если мы возьмём две акции [со стационарными приращениями](http... | https://habr.com/ru/post/332558/ | null | ru | null |

# Terraform за 15 дней (AWS/Yandex cloud). День 3: data source и outputs

### Оглавление

1. [День 1: Введение](https://habr.com/ru/post/684964/)

2. [День 2: Поднимаем сервера](https://habr.com/ru/post/685062... | https://habr.com/ru/post/685520/ | null | ru | null |

# Централизованное обновление сертификатов Let's Encrypt

Всем привет!

В этой статье я опишу как мы решали проблему централизованного обновления сертификатов Let's Encrypt и управления инфраструктурой с помощью ansible.

В нашем решении мы буде... | https://habr.com/ru/post/352720/ | null | ru | null |

# HOCON — конфигурируем гибко

Хранение параметров программ в текстовых конфигах — задача довольно частая и на первый взгляд тривиальная. Многие тут же хмыкнут: а в чем проблема-то? Есть куча форматов (и библиотек для работ... | https://habr.com/ru/post/306848/ | null | ru | null |

# Машинное обучение на C#: введение в ML.NET

ML.NET претендует на звание самой мощной библиотеки для машинного обучения на платформе .NET. Так ли это на самом деле? На вопрос отвечает Джефф Просайз.

Джефф Просайз — один из созд... | https://habr.com/ru/post/495208/ | null | ru | null |

# Блог на Wordpress с семантической разметкой

Прошло более года с тех пор, как Google, Bing и Yahoo предложили стандарт семантической разметки **Schema.org**. Но вебмастера не спешат внедрять рекомендации поисковиков на своих сайтах. А зря. Например, представители Яндекса на вопрос о влиянии семантической разметки на ... | https://habr.com/ru/post/152937/ | null | ru | null |

# Предвзятый и субъективный взгляд на резюме разработчика

Привет! Недавно мои коллеги из hh.ru провели [вебинар](https://habr.com/ru/company/hh/blog/502802/), где разбирали резюме разработчика. Я решил поделиться своей точкой зрения на этот счет.

Однажды в своем PvP-шутере мы за один день потеряли 30% от 60 тысяч одновременного онлайна. Это был 2018-й, в тот день на iOS вышел Fortnit... | https://habr.com/ru/post/563976/ | null | ru | null |

# Уменьшение размера docker образа с spring boot приложением

Добрый день.

Недавно передо мной встала задача запуска spring boot 2 приложения в kubernetes кластере используя docker образ. Эта проблема не является новой, достаточно быстро я нашел примеры в гугле и запаковал свое приложение. Я был очень удивлен не найдя... | https://habr.com/ru/post/457476/ | null | ru | null |

# Меня попросили взломать программу на собеседовании. Часть 2

*Это перевод второй части публикации [«Меня попросили взломать программу на собеседовании»](http://habrahabr.ru/post/237469). Оригинальный текст можно найти [здесь](http://erenyagdiran.github.io/I-was-just-asked-to-crack-a-program-Part-2/).*

#### Предисл... | https://habr.com/ru/post/238009/ | null | ru | null |

# Программирование игры для embedded-устройства на ESP32: накопитель, аккумулятор, звук

[Начало: система сборки, ввод, дисплей](https://habr.com/ru/post/502528/).

Часть 4: накопитель

=============... | https://habr.com/ru/post/503876/ | null | ru | null |

# Новый-старый pdf exploit

*p.s.2: В этом топике вируса нет, хотя „Авасту“ может казаться иначе (спасибо [edio](https://habrahabr.ru/users/edio/))*

Всё началось с невинного сообщения в icq от моей хорошей знакомой:

> 31.07.2009 18:45:11 *xyz*: смотри hxxp://watnhome.com/images/car.gif :)

Вроде ничего подозрител... | https://habr.com/ru/post/65927/ | null | ru | null |

# Клиент для SOAP API Почты России на Python

В процессе работы над текущими проектами возникла ситуация когда «вдруг» перестал парситься сайт трекингов Почты России. В интернетах даже немного побурлили по поводу «ужасной» новой защиты и т.п. В тех же интернетах всплыла тогда информация, что у Почты России имеется-таки... | https://habr.com/ru/post/151152/ | null | ru | null |

# Гибкая система управления доступом на уровне объектов-записей

Привет всем!

В проектах, основанных на Джанго, часто хочется использовать гибкое управление доступом на уровне записей (объектов), когда разные пользователи имеют, или наоборот, не имеют доступ к отдельным объектам в рамках одной и той же модели.

Я хочу... | https://habr.com/ru/post/341496/ | null | ru | null |

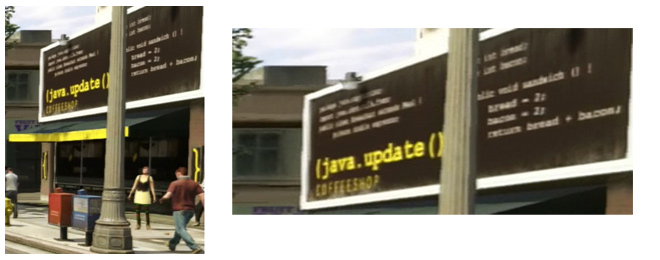

# Кофейня Java Update в GTA V

Разработчики серии Grand Theft Auto всегда славились двумя качествами: своеобразным юмором и вниманием к деталям своего мира-песочницы. На фоне [новостей про установлени... | https://habr.com/ru/post/195484/ | null | ru | null |

# Меченые указатели, или как уместить объект в одном инте

Если вы когда-нибудь писали приложение на Objective-C, вы должны быть знакомы с классом **NSNumber** — оберткой, превращающей число в объект. Классический пример использования — это создание числового массива, заполненного объектами вида **[NSNumber numberWithI... | https://habr.com/ru/post/149012/ | null | ru | null |

# YouTrack теперь с просмотром пул-реквестов в задачах

Привет, Хабр!

С вами команда YouTrack из JetBrains. У нас отличные новости — начиная с YouTrack 2020.3 в задачах отображаются не только коммиты, связанные с задачами, но и пул-реквесты. В сегодняшнем посте мы расскажем, что это, зачем это, и как это поможет сд... | https://habr.com/ru/post/512880/ | null | ru | null |

# Работаем с куки как с классом javascript

Всем привет! Сегодня я хочу рассмотреть очень популярный вопрос: как работать с куки? Везде предлагаются очень разные методы, но вот какой лучше? Определенного ответа на этот вопрос нет, но я хочу предложить очень удобный способ, и если ты заинтересовался — добро пожаловать п... | https://habr.com/ru/post/472972/ | null | ru | null |

# Создание аудиоплагинов, часть 12

Все посты серии:

[Часть 1. Введение и настройка](http://habrahabr.ru/post/224911/)

[Часть 2. Изучение кода](http://habrahabr.ru/post/225019/)

[Часть 3. VST и AU](http://habrahabr.ru/post/225457/)

[Часть 4. Цифровой дисторшн](http://habrahabr.ru/post/225751/)

[Часть 5. ... | https://habr.com/ru/post/227827/ | null | ru | null |

# Практическая биоинформатика ч. 2

Эта статья расскажет о том, как обработать данные, полученные после pipeline, выходом которого будет sam/bam файл[1], создать несложный bed graph файл (http://genome.ucsc.edu/FAQ/FAQformat.html) и просмотреть его с помощью UCSC genome browser[2]. Очень сложно решиться, на чем писать ... | https://habr.com/ru/post/137082/ | null | ru | null |

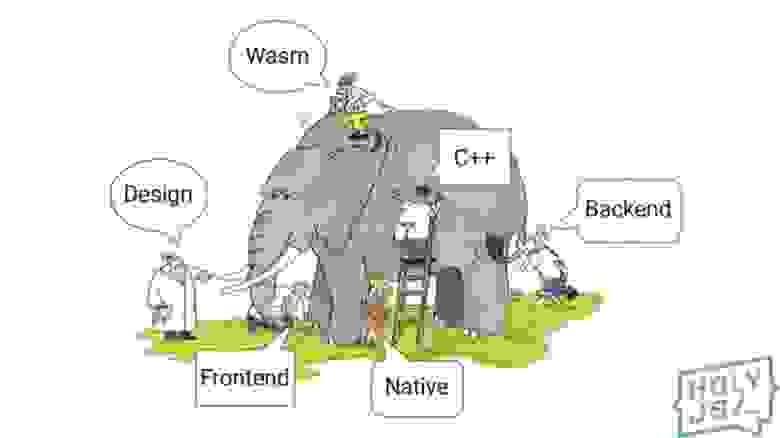

# Разработка под WebAssembly: реальные грабли и примеры

Анонс WebAssembly состоялся в 2015-м — но сейчас, спустя годы, всё ещё немногие могут похвастаться им в продакшне. Тем ценнее материалы о подобном опыте: информация из первых... | https://habr.com/ru/post/441140/ | null | ru | null |

# Code style для миграций Laravel

Всем привет.

Первые пять лет своей карьеры программиста, я работал над in-house проектом, следующие семь лет я работал в разных стартапах, с командой максимум из пяти разработчиков.

Сейчас я пару месяцев работаю над проектом где 20+ разработчиков, работа одновременно ведётся в приме... | https://habr.com/ru/post/543190/ | null | ru | null |

# Мелкая питонячая радость #3: Poetry

Управление зависимостями? Шо, опять?

------------------------------------

Экосистема Python породила целую пачку способов управления зависимостями в проектах.

Прямо сейчас можно выбирать меж... | https://habr.com/ru/post/455335/ | null | ru | null |

# Появился клиент Dropbox под Linux

Про этот замечательный [сервис](http://getdropbox.com/) на Хабре уже несколько раз [писали](http://habrahabr.ru/tag/dropbox/).

Сегодня с радостью для себя заметил, что на форуме проекта появилась [тема](http://forums.getdropbox.com/topic.php?id=2449&replies=115) про клиент для Li... | https://habr.com/ru/post/39204/ | null | ru | null |

# rholang — язык программирования для распределенных систем

[RChain](https://developer.rchain.coop/) — распределенная вычислительная блокчейн-платформа. Как ethereum, только на порядок шустрее. В теории, ее можно масштабировать до бесконечности, первые реализации на практике позволяют обрабатывать до 40 тысяч транзакц... | https://habr.com/ru/post/354398/ | null | ru | null |

# C++ vtables. Часть 1 (basics + multiple Inheritance)

*Всем привет! Перевод статьи подготовлен специально для студентов курса [«Разработчик С++»](https://otus.pw/d2qJ/). Интересно развиваться в данном направлении? Приходите онлайн 13 декабря в 20:00 по мск. на мастер-класс [«Практика использования Google Test Framewo... | https://habr.com/ru/post/479802/ | null | ru | null |

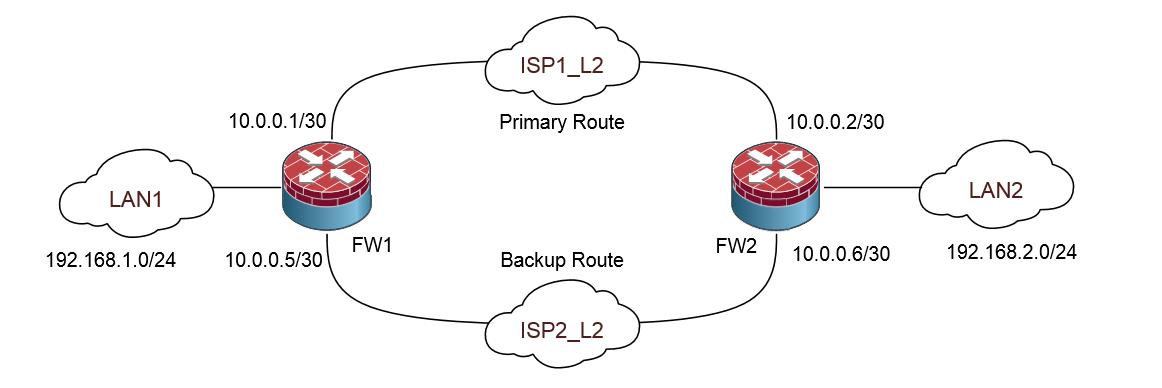

# Автоматическое переключение маршрута в Juniper SRX

Небольшая инструкция про то, как автоматизировать переключение сетевого маршрута в случае проблем с одним из линков. Дальше прошу под кат

Легенда — есть две площадки, связанных... | https://habr.com/ru/post/348936/ | null | ru | null |

# Облако selectel — не помеха для запуска Gentoo

Сегодня ночью попробовал установить Gentoo в виртуальной машине selectel.ru.

Для начала надо зарегистрироваться и создать виртуалку с какой-нибудь осью.

Для тестов выбрал Debian mini.

После создания, подключаю еще один жесткий диск, размером как минимум 2Gb.

... | https://habr.com/ru/post/110978/ | null | ru | null |

# Raspberry Pi в роли роутера с единственным сетевым интерфейсом

Сразу скажу, что эта статья предназначена для обычных пользователей и для тех, для кого сетевые технологии — это хобби.

[](https://habr.com/ru/company/ruvds/blog/5824... | https://habr.com/ru/post/582486/ | null | ru | null |

# Свидетели DevOps: мифы и байки про девопсов и тех, кто их нанимает

Те, кто решил стать девопсом, видят в этой профессии заманчивые перспективы. Это новый уровень мышления, это творчество и возможность созд... | https://habr.com/ru/post/544028/ | null | ru | null |

Subsets and Splits

No community queries yet

The top public SQL queries from the community will appear here once available.