text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

values | source stringclasses 4

values |

|---|---|---|---|---|

# AWS Athena: GEOIP lookups

*PS. Это перевод моей статьи на английском. Давно я не писал на Хабре. Сразу прощу прощения, много на русском не пишу. Не скажу что у меня и английский шикарный. Но к сожалению проживание за рубежом ухудшает мой русский и медленно развивает английский.*

Если вы пользуетесь AWS Athena для ... | https://habr.com/ru/post/538034/ | null | ru | null |

# Как качать с Rapidshare.com premium используя wget

Недавно я, отчаявшись набрать рейтинг на torrents.ru, приобрел Premium аккаунт на известном файлообменнике rapidshare.com. Покупка эта, выполненная с помощью Visa, прошла не без фокусов, впервые в жизни мне звонили из двух банков, проверяя действительно ли я ~~сошел... | https://habr.com/ru/post/28400/ | null | ru | null |

# JavaScript: 7 полезных мелочей

Автор заметки, перевод которой мы сегодня публикуем, говорит, что в JavaScript, как и в любом другом языке программирования, можно обнаружить множество маленьких хитростей, предназначенных для решения самых разных задач, как простых, так и довольно сложных. Некоторые из подобных приёмо... | https://habr.com/ru/post/449948/ | null | ru | null |

# Ускорение WordPress. Тотальный разбор плагинов для кэширования. Личный опыт (часть 2)

В этой части я подробно рассмотрю принцип работы каждого плагина, о которых говорил в [первой части](https://habr.com/ru/post/573698/), а также приведу код с доработками для закрытия проблем плагинов. Кратко все преимущества и недо... | https://habr.com/ru/post/573750/ | null | ru | null |

# Reservation link error в icq

Сегодня у многих пользователей icq, у кого-то раньше, у кого-то позже, произошло отключение от сети и последующая ошибка при реконнекте «Reservation link error». Проблема затрагивает большинство популярных клиентов. В качестве решения предлагают использовать альтернативные адреса icq сер... | https://habr.com/ru/post/62686/ | null | ru | null |

# AngularJS: как я отказался от ng-include и связал состояния двух контроллеров

В [прошлой статье](http://habrahabr.ru/post/182348/) я рассказывал про свое первое знакомство с AngularJS. С тех пор прошел уже год, сейчас у меня новые проекты и другие, часто менее тривиальные задачи. Здесь я опишу несколько нюансов, с к... | https://habr.com/ru/post/229225/ | null | ru | null |

# Командный паттерн вызова удаленных процедур (RPC) в Android

### Предисловие

Недавно я начал свое знакомство с платформой Android. На определенном этапе необходимо было проверить, как тут обстоят дела с удаленным вызовом процедур или, проще говоря, клиент-серверным взаимодействием.

Поначалу была надежда, что плат... | https://habr.com/ru/post/148436/ | null | ru | null |

# Спамерам сделалось неприятно

[Вот такой комментарий](http://blog.parasite-eliminator.ru/development/kak-byt-esli-zaxotyat-podstavit/#comment-325) пришел недавно в блог Parasite Eliminator:

`Привет, Новиков.

Ничего не имею против твоей приблуды - каждый дро как он хо.

Но меня напрягло слишком частое упоминан... | https://habr.com/ru/post/44398/ | null | ru | null |

# Как запустить Java-приложение с несколькими версиями одной библиотеки в 2017 году

Как запустить Java-приложение с несколькими версиями одной библиотеки в 2017 году

=================================================================================

в его нынешнем виде меня больше не устраивает.

Хотелось чего-нибудь более Event Driven, с поня... | https://habr.com/ru/post/188778/ | null | ru | null |

# Архитектура как кот VS Архитектура как кол

Предпосылки

-----------

Ограничения бывают разные. Например, компания со своими процессами. Вы генерируете идею, и она тонет в бюрократии. Идея рассматривается до... | https://habr.com/ru/post/578340/ | null | ru | null |

# Импорт отчета по звонкам из CoMagic в BigQuery по расписанию с помощью Google Cloud Functions

Для чего

--------

При сложной структуре рекламных кампаний и большого количества звонков становятся необходимы дополнительные инструменты хранения, обработки и анализа информации о поступающих обращениях. Часто нужен быстр... | https://habr.com/ru/post/475804/ | null | ru | null |

# Nagios + SMS используя мобильный телефон

Несколькими постами раньше уже были темы об использовании SMS уведомлений в Nagios. Сегодня я расскажу ещё об одном способе уведомлений. Нижеописанный способ несколько надёжнее описанных ранее, но и требует некоторых денежных вложений. Он полезен в том случае, когда какие-то ... | https://habr.com/ru/post/96610/ | null | ru | null |

# Cохранение состояний в android приложениях

Сегодня я хотел поделиться с вами еще одним подходом сохранения состояния при разработке android приложений. Не для кого не секрет, что наше приложение в фоне может быть убито в любой момент и эта проблема становится все актуальнее с вводом агрессивного энергосбережения – п... | https://habr.com/ru/post/420023/ | null | ru | null |

# Краткая история о том, как развернуть веб-сервер Flask в docker контейнере

> **Для чего вообще нужен docker контейнер?** Обычно, во время разработки, для каждого проекта вы настраиваете своё окружение. Но вот произошла такая ситуация: что-то случилось с вашим компьютером и приходится переустанавливать операционную с... | https://habr.com/ru/post/541826/ | null | ru | null |

# Screen Space Ambient Occlusion

Далее будет рассказано о том, как реализовать метод расчета рассеянного освещения Screen Space Ambient Occlusion на языке программирования С++ с использованем API DirectX11.

Рассмотрим формулу расчета цвета пикселя на экране при использовании, например, параллельного источника освещ... | https://habr.com/ru/post/310360/ | null | ru | null |

# PHP-Дайджест № 84 – интересные новости, материалы и инструменты (10 – 24 апреля 2016)

Предлагаем вашему вниманию очередную подборку со ссылками на новости и материалы.

Приятного чтения!

### Новости и релизы

* [Выс... | https://habr.com/ru/post/282331/ | null | ru | null |

# Магия Ctrl-C Ctrl-V, или как перестать сохранять картинки и начать жить

Одна из немногих стандартных утилит Windows, которой я пользуюсь практически каждый день — это [snippingtool](https://en.wikip... | https://habr.com/ru/post/263175/ | null | ru | null |

# Jenkins Pipeline. Что это и как использовать в тестировании

Меня зовут Александр Михайлов, я работаю в команде интеграционного тестирования компании ЮMoney.

Наша команда занимается приемочным тестированием. Оно включает в себя прогон и разбор автотестов на критичные бизнес-процессы в тестовой среде, приближенной по... | https://habr.com/ru/post/538664/ | null | ru | null |

# Простое Slack приложение для публикации контента из Google Sheets

Мы любим пробовать новое, и поэтому часто делимся ссылками на интересную информацию из мира IT и программирования со своими коллегами. Мы являемся давними пользователями slack и для таких ссылок у нас есть отдельный образовательный канал, где каждый м... | https://habr.com/ru/post/489468/ | null | ru | null |

# Django-orm в поисках LEFT JOIN

Давно уже перестало быть секретом, что Django-ORM в целом глупое как палка и не способно решать более менее серьезные задачи, и особо глупа в тех случаях, когда необходимо влиять извне на формирование разумных SQL запросов. Об одном из таких случаев и как я пытался с этим бороться — по... | https://habr.com/ru/post/230507/ | null | ru | null |

# Стивен Вольфрам: кажется, мы близки к пониманию фундаментальной теории физики, и она прекрасна

*В продолжение моего [поста](https://habr.com/ru/post/517888/) про вычислимую Вселенную я хочу представить вам свой перевод статьи Стивена Вольфрама, созданной в рамках его проекта The Wolfram Physics Project*.

[*Источник*](https://www.artrabbit.com/events/live-coding-music-party-curated-by-algorave)

Разработчики будущего пишут не просто код — они создают алгоритмический рейв. Алгорейв... | https://habr.com/ru/post/464713/ | null | ru | null |

# Параллелим непараллельное или поиск простых чисел на GPU

Одним замечательным летним вечером, я в пылу спора имел глупость заметить, что можно написать быстро работающее решето Эратосфена на CUDA. N = 1000000000 (девять нулей) как цель. And the legend has begun…

Не буду опускаться в подробности алгоритма, о нем мо... | https://habr.com/ru/post/230357/ | null | ru | null |

# Наивный Байесовский классификатор в 25 строк кода

Наивный Байесовский классификатор один из самых простых из алгоритмов классификации. Тем не менее, очень часто он работает не хуже, а то и лучше более сложных алгоритмов. Здесь я хочу поделиться кодом и описанием того, как это все работает.

И так, для примера воз... | https://habr.com/ru/post/120194/ | null | ru | null |

# Простой туториал React Router v4

[Автор @pshrmn](https://medium.com/@pshrmn) ⬝ [Оригинальная статья](https://medium.com/@pshrmn/a-simple-react-router-v4-tutorial-7f23ff27adf) ⬝ Время чтения: **10 м... | https://habr.com/ru/post/329996/ | null | ru | null |

# Security Week 10: удаленное управление по DNS, как Google капчу свою обманул, дыра в плагине к Wordpress

Не перевелись еще виртуозы на темной стороне. Какие-то ушлые ребята нашли очередное вредоносное применение многострадал... | https://habr.com/ru/post/323652/ | null | ru | null |

# Перестаньте использовать DateTime

*Специально для студентов курса [«Backend разработчик на PHP»](https://otus.pw/M3aF/) подготовили перевод интересной статьи о сайд-эффекте популярного инструмента.*

---

Работа с датами и вр... | https://habr.com/ru/post/464253/ | null | ru | null |

# Bash-скрипт для искрографиков

[Искрографик](http://ru.wikipedia.org/wiki/Искрографик) (англ. sparkline) — это термин, который придумал Эдвард Тафти для обозначения миниатюрных (word-sized), но информационно-плотных графиков. Они показывают общую картину там, где нет места для размещения нормальных графиков с осями к... | https://habr.com/ru/post/132779/ | null | ru | null |

# Cassandra. Как не умереть, если знаешь только Oracle

Привет, Хабр.

Меня зовут Миша Бутримов, я хотел бы хотел немного рассказать про Cassandra. Мой рассказ будет полезен тем, кто никогда не сталкивался с NoSQL-базами, — у нее есть очень много особенностей реализации и подводных камней, про которые нужно знать. И ... | https://habr.com/ru/post/486800/ | null | ru | null |

# К вопросу о быстродействии и измерении его в Ардуино

Данная задачка возникла при исследовании быстродействия работы Ардуино при выполнении различных команд (об этом в отдельном посте). В процессе исследования возникли сомнения о... | https://habr.com/ru/post/426941/ | null | ru | null |

# HOWTO: Одна из возможных реализация Модели (MVC) в Zend Framework

Написание статьи навеяно [habrahabr.ru/qa/34735](http://habrahabr.ru/qa/34735/) и [habrahabr.ru/qa/32135](http://habrahabr.ru/qa/32135/) вопросами, в качестве ответов на которые не смог найти полной и подробной информации, чего очень не хватало. Я над... | https://habr.com/ru/post/169537/ | null | ru | null |

# Улучшенный benchstat для оптимизирующих гоферов

Привет!

Если вы писали бенчмарки и пытались понять, что там ускорилось и на сколько, то наверняка вы пользовались утилитами вроде [benchstat](https://pkg.go.dev/golang.org/x/perf/cmd/benchstat).

Мне очень нравится эта утилита, но временами я понимаю, что некоторые её... | https://habr.com/ru/post/703294/ | null | ru | null |

# Быстрое прототипирование веб-сервиса на платформе 1C:Enterprise 8

Доброго времени суток, уважаемые хабралюди!

Некоторые из вас наверное знают, что на платформе **1C:Enterprise 8** (**1С: Предприятие 8**) некоторые ~~безумцы~~ умельцы, помимо приложений для бухгалтеров, делают, например еще и игры. Но речь пойдет ... | https://habr.com/ru/post/127998/ | null | ru | null |

# Пишем первую программу по машинному обучению до 50 строк с помощью Scikit-Learn

Если вдруг кому интересно то я веду [телеграм канал](https://t.me/devsp) где выкладываю интересные статьи на темы DS или ML которые могут быть вам интересны.

---

### Сегодня мы воспользуемся возможностями машинного обучения для анализа... | https://habr.com/ru/post/677274/ | null | ru | null |

# Ирина, голосовой помощник. Продолжение

— Слушай, она меня на кухне не слышит.

— Ну да, далековато. Давай дополнительный микрофон протянем.

<покупается 5 метров кабеля>

— О, классно!

— ...

— Теперь в комнате не работает.

Это продолжение статьи [Ирина — опенсорс русский голосовой помощник. Offline-ready](https... | https://habr.com/ru/post/660715/ | null | ru | null |

# Соединение Arduino программы на Intel Edison c телефоном Android по Bluetooth профилю SPP (Serial Port Profile)

В среде Arduino удобно иметь доступ к Bluetooth с профилем серийного порта BT SPP (Bluetooth Serial port profile), чтобы реагировать на команды, посылаемые через последовательный Bluetooth порт. Во многих ... | https://habr.com/ru/post/383533/ | null | ru | null |

# Тысяча и одна gif

Всем привет!

Хотелось бы рассказать вам историю создания одного простенького развлекательного сервиса по записи gif’ок с веб-камеры при помощи HTML5 и JS. О том как решение на коленке на базе опенсорсных решений в одночасье произвело пусть хоть и маленький, но всплеск популярности волны от котор... | https://habr.com/ru/post/218113/ | null | ru | null |

# Еще немного о Zabbix’е – настраиваем ICQ уведомления

На хабре уже довольно много писали про эту замечательную систему — [раз](http://habrahabr.ru/post/139165/), [два](http://habrahabr.ru/post/137641/), [три](http://hab... | https://habr.com/ru/post/164415/ | null | ru | null |

# SQL vs ORM

*Друзья, вновь пришло время авторской колонки корпоративного блога [**PG Day’17**](https://pgday.ru/ru/2017/request/registration?utm_source=habrahabr&utm_medium=blog&utm_campaign=varanio3). Предлагаем вашему вниманию сравнительный анализ работы с PostgreSQL из популярных ORM от [varanio](https://habrahabr... | https://habr.com/ru/post/328690/ | null | ru | null |

# Организация одновременного доступа к данным в облачном хранилище Microsoft Azure Storage

В современных веб-приложениях часто возникают ситуации, когда несколько пользователей одновременно работают с одними и теми же данны... | https://habr.com/ru/post/243629/ | null | ru | null |

# .sort'ировка в Perl 6

Сортировка списков – очень распространённая задача в программировании, и в Perl 6 есть несколько улучшений функции sort, помогающих вам решить такую задачу.

В языке есть обыкновенный типичный sort:

```

# сортировка по умолчанию с учётом типа

my @sorted = @unsorted.sort; # или sort... | https://habr.com/ru/post/267887/ | null | ru | null |

# Attack-defence для бизнеса: разбираем задания корпоративного тренинга Cyber Polygon

Типичный парадокс из жизни безопасника:

* инцидентов быть не должно (потому что инциденты = потери для бизнеса);

* но инцидентов должно быть много (потому что без опыта реагирования будет трудно сохранять квалификацию и оперативно о... | https://habr.com/ru/post/525406/ | null | ru | null |

# Простите, я сломал ваш recovery.conf

В PostgreSQL начиная с очень давних времён [аж версии 8.0](https://www.postgresql.org/docs/8.0/release-8-0.html) вышедшей в далёком 2005 году для восстановления в определённую... | https://habr.com/ru/post/432918/ | null | ru | null |

# Проверка репликации MySQL master-master через Zabbix

После настройки MySQL репликации master-master, следующий логический шаг это настройка проверки этой системы. Читая туториалы по интернету стало ясно, что подобная репликация — дело популярное, а слетает оно на раз два три. Поэтому решил вставить проверку — а рабо... | https://habr.com/ru/post/136353/ | null | ru | null |

# Посторонним вход воспрещен

Тебе никогда не приходила в голову мысль о том, что идея использовать логин и пароль для входа в систему несколько устарела? Почему, имея в одном кармане флешку, в другом — телефон, а на компе установленный SSH с настроенной авторизацией при помощи ключей, мы продолжаем вводить эти запутан... | https://habr.com/ru/post/127384/ | null | ru | null |

# Как писать код на Go? Подход Google. Часть первая

Рекомендации по стилю для проектов из Google с открытым исходным кодом

======================================================================

Руководство по стилю Go

-----------------------

Принципы стиля

--------------

Есть несколько охватывающих всё принципов, к... | https://habr.com/ru/post/708830/ | null | ru | null |

# Про Shadow DOM

Всем привет!

Продолжаю свой цикл публикаций о группе стандартов [Web Components](https://developer.mozilla.org/en-US/docs/Web/Web_Components). Моя цель - сформировать реалистичные ожидания... | https://habr.com/ru/post/518016/ | null | ru | null |

# Monitoring as Code на базе VictoriaMetrics и Grafana

Приветствую всех любителей Infrastructure as Code.

Как я уже писал в предыдущей [статье](https://habr.com/ru/post/548968/), я люблю заниматься автоматизацией инфраструктуры. Сегодня представляю вашему вниманию вариант построения GitOps для реализации подхода Moni... | https://habr.com/ru/post/568090/ | null | ru | null |

# В .NET 7 Preview 3 доступны обновления ASP.NET Core

Среди улучшений ASP.NET Core поддержка фильтров обработчиков маршрутов Minimal API, повышение тестируемости обработчиков маршрутов Minimal API, биндинг в ... | https://habr.com/ru/post/661081/ | null | ru | null |

# Релиз Apache Ignite 2.4 — Distributed Database and Caching Platform

12 марта 2018 г., спустя 4 месяца после прошлой версии, вышел Apache Ignite 2.4. Этот релиз примечателен целым рядом нововведений: поддержка Java 9, множественные оптимизации и улучшения SQL, поддержка платформой нейронных сетей, новый подход к пост... | https://habr.com/ru/post/351098/ | null | ru | null |

# Как нужно и не нужно писать чат ботов на примере моего бота для игры в «Тайный Санта»

Предыстория

-----------

Год назад решил я создать телеграм бот для того, чтобы поиграть в достаточно популярную новогоднюю игру «Тайный Са... | https://habr.com/ru/post/476144/ | null | ru | null |

# Создание CloudFoundry/IBM Bluemix buildpack или веб сервис на Awk (gawk)

*gawk — глазеть разинув рот, таращить глаза*

[](http://habrahabr.ru/post/262701/)

Дальше никаких шуток, я действительно опишу как запустить Awk (... | https://habr.com/ru/post/262701/ | null | ru | null |

# Удивительная производительность параллельных алгоритмов C++17. Миф или Реальность?

Добрый вечер!

От нашего курса [«Разработчик C++»](https://otus.pw/NmIA/) предлагаем вам небольшое и интересное исследование про параллельные алгоритмы.

Поехали.

С появлением параллельных алгоритмов в C++17, вы с легкостью мо... | https://habr.com/ru/post/433588/ | null | ru | null |

# Простая система оптического распознавания символов для .NET

Все началось с необходимости в одном из приложений получать снимок произвольного окна и 3-4 раза в секунду распознавать несколько областей изображения с заранее известными символами. Сделать скриншот окна с помощью WinAPI проблем не составило, а вот над рас... | https://habr.com/ru/post/116602/ | null | ru | null |

# FIFO для самых маленьких (вместе с вопросами на интервью)

"Напишите на доске код на верилоге для FIFO" - это популярный вопрос во время интервью в компании типа Apple и AMD, причем у него есть вариации для... | https://habr.com/ru/post/646685/ | null | ru | null |

# Задача о браках и режим возвратов

Бектрекинг – механизм решения переборных задач. Позволяет выбрать либо 1 приемлемую альтернативу, либо наилучшую.

Суть режима возвратов состоит в следующим. В программе встречаются точки «развилки» — точки в которых необходимо выбрать один из вариантов поведения («альтернатив»). ... | https://habr.com/ru/post/126438/ | null | ru | null |

# STM32F1xx — Инструменты разработчика и FreeRTOS

Добрый день, уважаемые хабровчане. В своих прошлых статьях ([STM32F1xx — лечимся от ардуинозависимости вместе](http://habrahabr.ru/blogs/controllers/123791/), [STM32F1хх — продолжаем лечение от ардуинозависимости при помощи LCD](http://habrahabr.ru/blogs/controllers/13... | https://habr.com/ru/post/139601/ | null | ru | null |

# Выполняем кластеризацию на примере BitrixVM: просто и понятно

Обеспечение отказоустойчивости – залог непрерывной работы и вообще полного удовлетворения как пользователей, так и админов. В нашем сегодняшнем материале речь пойдет о том, как можно выполнить кластеризацию BitrixVM с помощью простых и доступных средств, ... | https://habr.com/ru/post/317094/ | null | ru | null |

# В приложении AirDroid была найдена критическая уязвимость, которая позволяет проводить MitM-атаки

Специалисты по информационной безопасности из компании Zimperium провели анализ популярного приложения AirDroid и обнаружил... | https://habr.com/ru/post/317152/ | null | ru | null |

# Разработка приложений на основе DSL и генерации кода

О чем вообще речь

-----------------

В этом посте я хочу порассуждать отвлеченно на тему разработки приложений. Сначала я задумал написать просто про генерацию кода, но по мере обдумывания темы у меня родилось много мыслей, которыми тоже хочу поделиться. Поэтому п... | https://habr.com/ru/post/239361/ | null | ru | null |

# Обновляем счётчик сообщений Вконтакте без перезагрузки страницы

Я пользуюсь той-самой-социальной-сетью по нескольким причинам, одна из которых — возможность обмена текстовыми сообщениями (некоторые мои знакомые принципиально не пользуются мессенжерами, приходится подстраиваться). Раньше приходилось постоянно обновля... | https://habr.com/ru/post/111092/ | null | ru | null |

# В каждом .net приложении резервируется память для трех исключений

На выходных заходил я к своему другу [new\_s](https://habrahabr.ru/users/new_s/) в гости и он показал мне интересную вещь. Ему по работе нужно было анализировать дамп памяти .net приложения, где он искал утечки памяти и другое аномальное поведение и п... | https://habr.com/ru/post/132656/ | null | ru | null |

# JUST — JavaScript шаблонизатор

Во время разработки своего [экспериментального WEB-проекта](http://chtodelat.com) на Node.JS, о котором я рассказал в двух [предыдущих](http://habrahabr.ru/blogs/nodejs/138071/) [статьях](http://habrahabr.ru/blogs/nodejs/138629/), я столкнулся с проблемой выбора шаблонизатора. Несмотря... | https://habr.com/ru/post/138939/ | null | ru | null |

# How to Write a Smart Contract with Python on Ontology? Part 5: Native API

In the previous Python tutorial posts, I have introduced the Ontology Smart Contract in

[Part 1: Blockchain & Block API](... | https://habr.com/ru/post/474970/ | null | en | null |

# Reveal для всех!

Здравствуйте, **Хабровчане** !

Я расскажу как я реализовал Circual Reveal анимацию из Lollipop, опустив порог до Gingerbread.

В Lollipop появились нативные классы HardwareCanvas, RenderNodeAnimat... | https://habr.com/ru/post/243541/ | null | ru | null |

# Учим Google Analytics считать лайки из Вконтакте

Всем привет!

В этой статье я расскажу, как с помощью Google Analytics отслеживать лайки на вашем сайте и покажу, как это делать с кнопкой “Мне нравится” из Вконтакте.

7 июля этого года Google [добавил](http://analytics.blogspot.com/2011/07/social-plugin-tracking... | https://habr.com/ru/post/129333/ | null | ru | null |

# Jetpack Compose: реализация меню Apple Watch

Мне очень нравится меню Apple watch: плавность анимации, поведение иконок при перемещении, расположение элементов по необычной сетке. Я захотел повторить это меню на Android. Но делать это на старом подходе с помощью ViewGroup или кастомного Layout Manager для RecyclerVie... | https://habr.com/ru/post/683264/ | null | ru | null |

# Эволюция программного проекта и ООП

Осваивая рецепты эффективного развития программного проекта, постарался для себя найти причины, делающие полезным использование принципов развития архитектуры SOLID (статья [Как не понимать принципы развития архитектуры SOLID](https://habr.com/ru/post/444932/)).

Анализ этих прин... | https://habr.com/ru/post/448026/ | null | ru | null |

# Новые (и старые) единицы измерения в CSS, о которых вы вряд ли слышали

В последнее время JavaScript развивается очень *быстро*, но и языки-помощники веб-разработчика не стоят на месте.

CSS тоже развивается, и хотя Houdini в скором времени, возможно, сделает прорыв в CSS-разработке, до широкого применения, к сожал... | https://habr.com/ru/post/421709/ | null | ru | null |

# Чего нам стоит репутация или пользовательский фикс для CVE-2018-18472 от NAS WD

О нашумевшей истории с стиранием данных с NAS от Western Digital можно почитать в посте [@ZlodeiBaal](/users/zlodeibaal): [Western Digital стер данные с большинства пользовательских NAS](https://habr.com/ru/post/564660/)

Здесь же будет ... | https://habr.com/ru/post/564956/ | null | ru | null |

# Педалируем Vim

В этом посте пойдёт речь о широко известной в узких кругах педали для переключения Vim из **Normal mode** в **Insert mode** и обратно. Вдохновившись примерами подобных поделок на просторах сети, я решил сделать свой вариант, с преферансом и поэтессами.

#### Задача

Сделать педаль, представляющую со... | https://habr.com/ru/post/232177/ | null | ru | null |

# Сражаясь с БЭМ: 10 основных ошибок и как их избежать

*Не важно, узнали ли вы о БЭМ только сейчас, или следите за ним с самого начала, вы, возможно, уже оценили столь полезную методологию. Если вы не знаете, что такое БЭМ, я рекомендую прочитать вам об этом на [сайте БЭМ](https://ru.bem.info) перед тем, как продолжит... | https://habr.com/ru/post/305548/ | null | ru | null |

# Используйте ссылки и кнопки правильно. Пожалуйста

При вёрстке макета не всегда понятно, что перед нами — кнопка или ссылка. Внешне эти элементы могут быть очень похожи, но их функции различаются и браузер реагирует на них по-разному. Поэтому неправильный выбор может привести к ошибкам в работе сайта.

!

Если еще не успели, то прочитайте [первую часть](http://habrahabr.ru/post/194592/), в которой я рассказываю о важности минимизации передачи данных... | https://habr.com/ru/post/194632/ | null | ru | null |

# Game Maker AI — С чего начать?

**Game Maker** — платформа разработки (в начальной концепции 2D) игр. На данный момент наиболее популярны Game Maker 8.0\8.1 и Game Maker Studio. Последний, к слову, поддерживает кросс-платформенную разработку (что, наверное, и является почти единственным фактором выживания движка в це... | https://habr.com/ru/post/196140/ | null | ru | null |

# Автоматическое определение часового пояса пользователя

*Мужик сидит, слушает радио.

— В Москве полночь, в Благовещенске 6 утра, во Владивостоке, Хабаровске, Южно-Сахалинске 7, в Магадане 8, в Петропавловске-Камчатском 9 часов.

Мужик сидит, сидит, потом встаёт, и с некоторым сожалением произносит:

— Эх, ну и... | https://habr.com/ru/post/102506/ | null | ru | null |

# В конфиге Aliens: Colonial Marines нашли опечатку, из-за которой четыре года глючил игровой ИИ

Вышедшую в 2013 году игру *Aliens: Colonial Marines* для персональных компьютеров [не очень хорошо встретил... | https://habr.com/ru/post/417435/ | null | ru | null |

# Закрываем зеркало сайта от индексации правильно

Здравствуй, %habrauser%.

Сегодня я покажу как не надо закрывать от индексации зеркало сайта, и как закрыть его правильно.

##### Предыстория

Я работаю web-мастером в одной крупной для нашего города компании.

Мы сделали клиенту сайт, для рекламирования и продаж... | https://habr.com/ru/post/135921/ | null | ru | null |

# Selenium за 60 секунд

Представляю вам перевод моей [статьи](https://medium.com/@aandryashin/selenium-done-in-60-seconds-176796f8bdc7) на Medium.com.

[Selenium](http://seleniumhq.org/) сегодня является стандартом де-факто для автоматизации выполнения тестов в браузерах. Все популярные браузеры поддерживаются из коро... | https://habr.com/ru/post/327184/ | null | ru | null |

# Слайдинг в двух — нет, в четырех направлениях

На Хабре не раз встречались статьи про слайдинг экранов под Android [ViewPager](http://habrahabr.ru/blogs/android_development/131889/), [ViewPagerIndicator](http://habrahabr.ru/blogs/android_development/137021/). Я хочу предложить вариант слайдинга в четырех направлениях... | https://habr.com/ru/post/137339/ | null | ru | null |

# Модуль универсального контроллера для интернета вещей. Основы программирования

Открытый проект модуля **IoT** K66BLEZv1 продолжает развиваться.

Здесь рассмотрим следующие вопросы важные на перво... | https://habr.com/ru/post/394407/ | null | ru | null |

# LCH-цвета в CSS

Меня всегда интересовала наука о цвете. В 2014 году я [выступала](https://www.youtube.com/results?search_query=the+chroma+zone+lea+verou&page=&utm_source=opensearch) на разных конференциях, рассказывая о спецификации CSS Color 4. А до этого, в 2009 году, я написала программу для выбора цвета. Она исп... | https://habr.com/ru/post/496966/ | null | ru | null |

# Компилируем Kotlin: JetBrains VS ANTLR VS JavaCC

Насколько быстро парсится Kotlin и какое это имеет значение? JavaCC или ANTLR? Годятся ли исходники от JetBrains?

Сравниваем, фантазируем и удивляемся.

tl;dr

=====

*JetBrai... | https://habr.com/ru/post/433000/ | null | ru | null |

# О формировании последовательностей в гипотезе Коллатца ( 3n+1 )

Меня привлекают такие задачи, как проблема Коллатца. Они просты в формулировке и отлично тренируют голову, в особенности алгоритмического мышления, что очень полезно программисту.

Формулируется задача довольно просто:

> Берём любое натуральное чис... | https://habr.com/ru/post/419075/ | null | ru | null |

# Расчет максимально возможных скидок в проектах, выполняемых на заказ на основе текущей загрузки

Для кого статья

---------------

Если вы что-то производите на заказ, то вы наверняка сталкивались с простоями из-за отсутствия достаточного количества проектов.

Если у вас высока доля переменных затрат, то все ок — вы с... | https://habr.com/ru/post/482520/ | null | ru | null |

# Быстрое создание phar файлов используя Box

`Phar` — это аналог `jar` из мира Java, но только применительно к PHP. `Phar` упаковывает файлы проекта в специальный архив и позволяет легко переносить и устанавливать приложен... | https://habr.com/ru/post/274745/ | null | ru | null |

# Node.js на узле Фидонета: автоматизация периодических публикаций

Некоторые фидошники сталкиваются с необходимостью периодически публиковать в той или иной фидонетовской эхоконференции одно и то же сообщение (один и ... | https://habr.com/ru/post/152873/ | null | ru | null |

# Masking Bitmaps на Android

Введение

========

При разработке под Android довольно часто возникает задача наложить маску на изображение. Чаще всего требуется закруглить углы у фотографий или сделать изображение полностью круглым. Но и... | https://habr.com/ru/post/310618/ | null | ru | null |

# Как конвертировать файловую систему из ext3 в ext4

Теперь у всех есть новая Убунту с поддержкой ext4, и в моём [прошлом посте](http://habrahabr.ru/blogs/ubuntu/58060/) о его релизе было несколько комментариев с вопросами о том, как переделать файловую систему в этот самый ext4. По этому отличному поводу я решил пере... | https://habr.com/ru/post/58121/ | null | ru | null |

# Layout Protocol: новые возможности SwiftUI

WWDC 2022 привнесла много изменений и улучшений в SwiftUI, и обновленный протокол Layout — одно из самых значимых. Об особенностях работы с новыми инструментами компоновки элементов, анонсированными в iOS 16.0, рассказывает iOS-разработчик студии [CleverPumpkin](https://cle... | https://habr.com/ru/post/685374/ | null | ru | null |

# Pythonista. Пишем на Python для iOS

Планшет iPad от компании Apple — всем известное и не нуждающееся в рекламе устройство. Но очень часто хочется использовать всю мощь этого устройства не только для игр и развлечения, а для серьёзной работы. Например для написания программ. Несмотря на 4-x летнею историю развития эт... | https://habr.com/ru/post/241229/ | null | ru | null |

# Абсолютная загадка наследования в Java

Почему эта загадка абсолютная? По двум причинам:

• Она касается основ языка Java, а не какого-то малоизвестного нюанса API.

• Она расплавила мой мозг, когда я на нее наткнулся.

Если вы хотите проверить себя перед дальнейшим чтением, пройдите [этот тест](http://www.clas... | https://habr.com/ru/post/62602/ | null | ru | null |

# Тёплый ламповый «кликер»

Предисловие

===========

Путешествуя по просторам интернета я набрел на одну малоинтересную категорию игрушек — «кликеры». Особенно меня «порадовал» [Office Clicker](http://flashok.ru/igrat-onlin... | https://habr.com/ru/post/394859/ | null | ru | null |

# pChart — строим графики и диаграммы на PHP. Практика

Всем привет!

По наводке из статьи «[pChart — строим графики и диаграммы на PHP](http://habrahabr.ru/post/30202/)» реализовал у себя построение графиков. Вот так выглядит:

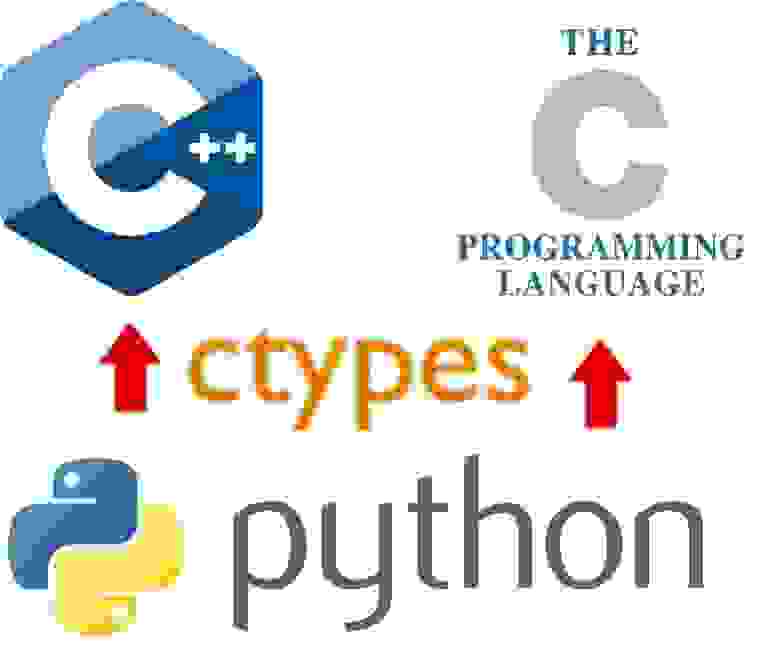

Про то как вызывать [Python из C](https://habr.com/ru/post/466181/) написал в прошлой статье, теперь поговорим как делать наоборот и вызывать **C/C++** из **Python3**. Раз начал писать об этом, то ра... | https://habr.com/ru/post/466499/ | null | ru | null |

# Inferno Shell

**FAQ:** [Что такое OS Inferno и зачем она нужна?](http://habrahabr.ru/post/145993/)

Оболочка ОС Инферно много лет вызывала у меня исключительно отрицательные эмоции. И я никогда не понимал, что в [Inferno sh вызывает восторг](http://debu.gs/entries/inferno-part-1-shell) у некоторых людей. Но, как г... | https://habr.com/ru/post/161859/ | null | ru | null |

# 5 советов для прокачки своих навыков в Angular

Этим летом мы с [Ромой](https://habr.com/ru/users/MarsiBarsi/) запустили серию твитов с полезными советами и приемами по Angular. Сообщество тепло встретило эту инициативу, и я решил написать обобщающую статью.

Вот мои 5 рекомендаций, которыми хочется поделиться с разр... | https://habr.com/ru/post/519052/ | null | ru | null |

# «Почему ещё не изобрели искусственный интеллект?» или проверка инструментария CNTK от Microsoft Research

Microsoft выложила в открытый доступ исходный код инструментов, которые используются в компании для ус... | https://habr.com/ru/post/276427/ | null | ru | null |

Subsets and Splits

No community queries yet

The top public SQL queries from the community will appear here once available.