text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

values | source stringclasses 4

values |

|---|---|---|---|---|

# Отдаем корректный код 404 в связке VUE SPA + SSR

Есть у меня один сайт, как сейчас говорят, пет-проект. Был написан в далеком 2013 году, что называется "на коленке" без использования каких-то фреймворков. Только php, только хардкор. Но тем не менее, функции свои выполнял, даже обрел некую популярность в узких кругах... | https://habr.com/ru/post/523078/ | null | ru | null |

# Особенности работы и настройки DHCP на маршрутизаторах Cisco

В статье я хочу рассмотреть использование DHCP-сервера на базе маршрутизатора Cisco в корпоративной сети…

1. Теория

---------

Как следует из названия, протокол DHCP (Dynamic Host Configuration Protocol) используется для динамической конфигурации параме... | https://habr.com/ru/post/87920/ | null | ru | null |

# Играй, но проверяй: как движок обсчитывает дизайнера

При дизайне многопользовательской игры чуть ли не самой важной составляющей является баланс. Работа игрового дизайнера в этом плане похожа на работу аналитика спецслужб: если он... | https://habr.com/ru/post/414853/ | null | ru | null |

# Как портировать libcURL под Android

Статья предназначена для разработчиков под Android NDK, которые собираются работать с замечательной библиотекой libcURL и иметь в своем распоряжении ее исходники для пересборки в статическую библиотеку. Автор не претендует на абсолютно правильное решение проблемы портирования данн... | https://habr.com/ru/post/158743/ | null | ru | null |

# Открытая замена ati-drivers

Новость [«AMD прекращает поддержку R300-R500 чипов»](http://www.oslinux.ru/node/330) и политика ati-drivers заставили меня задуматься о переходе к свободному драйверу.

Поэтому я хочу рассказать как я это сделал в gentoo, поскольку на gentoo-wiki не нашел подобных how-to, а в разделе d... | https://habr.com/ru/post/54874/ | null | ru | null |

# Site to Zone Assignment list и Internet Explorer с включенной Enhanced Security Configuration

Столкнулся недавно с проблемой что IE не хотел правильно принимать настройки локальной групповой политики Site to Zone Assignment list. Проблема проявлялась следующим образом:

При несконфигурированной политике список до... | https://habr.com/ru/post/312820/ | null | ru | null |

# Очередная статья про wc

Всем добрый день.

Недавно на Хабре появилась статья [Побеждая C двадцатью строками Haskell: пишем свой wc](https://habr.com/ru/post/489136) от [@0xd34df00d](https://habr.com/ru/users/0xd34df00d/). Автор, известный своей симпатией к функциональному программированию, реализовал на Хаскеле анал... | https://habr.com/ru/post/489898/ | null | ru | null |

# Автоматизация для самозанятых: как интегрировать налог с IT проектом

С 1 января 2019 года для четырёх субъектов Российской Федерации (Москвы, Московской и Калужской областей, а также республики Татарстан) был принят закон, внедряющий пилотным проектом новый Налог на Профессиональную Деятельность (НПД). Если вкратце,... | https://habr.com/ru/post/436656/ | null | ru | null |

# Стандарты использования сообщений пользователю в 1С

**Введение**

Всем доброго времени! В данном небольшом мануале рассмотрим базовый функционал подсистемы (БСП) модулей "**Шаблоны сообщений**", которые используются в типовых конфигурациях. Функционал будет полезен пользователям для общего понимания встроенных возмо... | https://habr.com/ru/post/708350/ | null | ru | null |

# Анализ и визуализация реальных табличных данных в R

Материал будет полезен тем, кто осваивает язык R в качестве инструмента анализа табличных данных и хочет увидеть сквозной пример реализации основных шагов обработки.

Ниже демонстрируется загрузка данных из csv-файлов, разбор текстовых строк с элементами очистки ... | https://habr.com/ru/post/217963/ | null | ru | null |

# Веб-скрейпинг на PHP

Термин *web scraping* означает извлечение информации из веб-страниц в интернете. Его ещё называют *web crawling* или *web data extraction*.

PHP широко используется в качестве серверного скриптового языка ... | https://habr.com/ru/post/565028/ | null | ru | null |

# Фронтенд на Go с использованием библиотеки RUI

Изначально [библиотека RUI](https://github.com/anoshenko/rui) разработана для создания клиент-серверных веб приложений на языке go, где вся обработка осуществляется на сервере, а браузер используется только как тонкий клиент.

Однако в последней версии библиотеки (0.10.... | https://habr.com/ru/post/698818/ | null | ru | null |

# Изменение исходников ( DDL ) на лету

При сопровождении ERP систем иногда возникает необходимость массового изменения кода процедур, функций, триггеров или пакетов. Например для замены вызова одной процедуры на вызов другой.

Если надо поменять пару процедур, то можно сделать это в ручную, но когда надо изменить не... | https://habr.com/ru/post/280648/ | null | ru | null |

# We're in UltraHD Morty! How to watch any movie in 4K

You’ve probably heard about [Yandex’s DeepHD technology](https://habr.com/ru/company/yandex/blog/422561/) they once used to improve the quality of old Soviet cartoons. Unfortunately, it’s not public yet, and we, regular programmers, don’t have the dedication to wr... | https://habr.com/ru/post/441918/ | null | en | null |

# Темы и стили в Android-приложениях

Каждому Android-разработчику так или иначе приходилось работать со стилями. Кто-то чувствует себя с ними уверенно, у кого-то есть только поверхностные знания, которые зачастую не позволяют самостоя... | https://habr.com/ru/post/461201/ | null | ru | null |

# Bashstyle-NG. Пример локализации приложения

Намедни зашел на [gnomefiles.org](http://gnomefiles.org) посмотреть, не появилось ли какого-нибудь нового интересного софта, или просто обновлений для того, что у меня уже установлено. Мое внимание привлекло обновление [bashstyle-ng](http://www.gnomefiles.org/app.php/BashS... | https://habr.com/ru/post/56977/ | null | ru | null |

# ADB vs Spy Cam & Mic

Как проверить, ведет ли какое-нибудь приложение на *Android*-смартфоне фото- или видеорепортаж, хотя ему это ни разу ни к чему? Нижепредлагаемый вариант совсем не идеален, но не требует «рута» или кастомной прошивки.

*P.S. Я добавил в статью описание мониторинга доступа приложений к микрофону... | https://habr.com/ru/post/435098/ | null | ru | null |

# Slate – «серебряная пуля» для расположения окон на экранах OS X

Привет, Хабр! Хочу поделиться очень интересным инструментом для «приручения» положения окон в OS X. Если кратко, то вот [ссылка](https://github.com/jigish/slate) на репозиторий с замечательным приложением Slate. За подробностями, добро пожаловать под ка... | https://habr.com/ru/post/313578/ | null | ru | null |

# Не забудьте повысить шанс ответа клиенту, используя повторный запрос в L7 балансировке

Используя nginx для балансировки HTTP трафика на уровне L7 есть возможность направить запрос клиента на следующий сервер приложений, если целевой не возвращает положительный ответ. Проба механизма пассивной проверки состояния рабо... | https://habr.com/ru/post/458594/ | null | ru | null |

# Исправляем ACPI на Samsung N250

В этой статье я хотел бы описать типичные ошибки проектирования, найденные в BIOS современного нетбука, и методы их обнаружения, изучения и исправления.

Вступление

----------

Итак, [ACPI](http://ru.wikipedia.org/wiki/ACPI) — это универсальный интерфейс к некоторым функциям аппарат... | https://habr.com/ru/post/128449/ | null | ru | null |

# Добавление эффекта окна Aero Glass

Наверно все, кто работал с Windows Vista (есть ведь ещё к примеру заядлые XPшники которые и Aero в глаза не видели :)), видели так называемый Aero Glass эффект — один из отличительных эффектов Windows Vista в режиме Aero. По умолчанию этот эффект распространяется на заголовки не ра... | https://habr.com/ru/post/59899/ | null | ru | null |

# Мой друг интересуется, как ИИ мог бы уничтожить планету Зимля?

30 ноября в сети появился ChatGPT - чат-бот от наиболее совершенной на данный момент публичной текстовой нейросети. Мало того, что он умеет вести более-менее осмысленные беседы, так еще и умудряется давать относительно дельные советы и выдавать работоспо... | https://habr.com/ru/post/706754/ | null | ru | null |

# SQL Server Integration Services (SSIS) для начинающих – часть 3

→ [Часть 1](https://habrahabr.ru/post/330618/)

→ [Часть 2](https://habrahabr.ru/post/330702/)

В этой части я расскажу о работе с параметрами и переменным... | https://habr.com/ru/post/330840/ | null | ru | null |

# Делаем очередь входящих звонков с функцией callback

При звонках в колл-центр компаний часто приходится сталкиваться с большим временем ожидания на линии, многие из нас слушали надоедливую мелодию в течение десятков минут хо... | https://habr.com/ru/post/249647/ | null | ru | null |

# CRUD для NMAP’а: решение для мониторинга открытых портов на хостах

Привет, Хабр! Меня зовут Рудаков Александр, я занимаюсь информационной безопасностью в компании "[ЛАНИТ-Интеграция](https://itlanit.ru/)". Однажды, в рамках работы над проектом, мне понадобилось организовать небольшой непрерывный мониторинг (с хранен... | https://habr.com/ru/post/535514/ | null | ru | null |

# Расстановка дефисов, минусов, тире и кавычек

Вопросы правильной расстановки дефисов, длинного и короткого тире, знака минуса, кавычек-елочек и кавычек-лапок уже неоднократно поднимались в интернете и на Хабре в частности (см. ссылки ниже). Однако по-прежнему, студенты и аспиранты в своих курсовых и дипломных, диссер... | https://habr.com/ru/post/75662/ | null | ru | null |

# «Резиновый хозяин искать на Алибаба облако»: размещаем Elasticsearch на мощностях Alibaba Cloud

Некоторое время назад я рассказывал о нашем опыте решения сложных задач с помощью Elasticsearch. Это была [история про колбасу](http... | https://habr.com/ru/post/420927/ | null | ru | null |

# «Тайна третьей планеты» с улучшенной нейросетями графикой

Заметил, что у Хабра есть интерес [к теме улучшения графики](https://habr.com/ru/company/madrobots/blog/448922/) в старых играх.

Я как раз сделал [мод графики для первой готики](https://www.reddit.com/r/GameUpscale/comments/a9ssit/gothic_1_esrgan_project/)... | https://habr.com/ru/post/449024/ | null | ru | null |

# Добавление в Unreal Engine поддержки dxf формата

Здравствуйте меня зовут Дмитрий. Я занимаюсь созданием компьютерных игр на Unreal Engine в качестве хобби. Сегодня расскажу как добавить поддержку dxf файлов в Unreal ... | https://habr.com/ru/post/283554/ | null | ru | null |

# Asterisk chan_ss7 «12 потоков»

#### Задача:

Подключение к Городской Телефонной Станций «ГТС» используя систему сигнализации N7 (Общеканальная сигнализация № 7(ОКС7 или SS7)

#### Решение по этапам:

* Сервер

* Система и софт

* Настройка подключения

* Проблемы и их решения

* Тестирование

##### Сервер:

Про сервер... | https://habr.com/ru/post/124325/ | null | ru | null |

# Nodebox

На хабре поднималась [тема](http://habrahabr.ru/blogs/apple/24970/) об этой программе, но раскрыта тема была скудно. Я попытаюсь показать внутреннее устройство программы, а также в кон... | https://habr.com/ru/post/88951/ | null | ru | null |

# По-настоящему адаптивные письма. Часть… снова первая

[Первый пост](http://habrahabr.ru/post/261455/) был написан скорей на эмоциях. Метод Николь мне показался местами несостоятельным и громоздким, но стоит признать, что о... | https://habr.com/ru/post/262427/ | null | ru | null |

# Hack The Box. Прохождение SneakyMailer. Фишинговая рассылка, LPE через PyPI и GTFOBins pip3

Продолжаю публикацию решений, отправленных на дорешивание машин с площадки [HackTheBox](https://www.hackthebox.eu).

В данной статье мы... | https://habr.com/ru/post/530132/ | null | ru | null |

# Где в ZX Spectrum системный монитор? Загадка ПЭВМ Дуэт

[ПЭВМ Дуэт](http://speccy.info/%D0%94%D1%83%D1%8D%D1%82) — это российский клон ZX Spectrum 48k, производился Лианозовским электромеханическим заводом (ЛЭМЗ). Это мой самый... | https://habr.com/ru/post/264913/ | null | ru | null |

# DIY тепловизор на Raspberry PI или «Кажется теперь я знаю, чем займусь этим летом»

Всем привет!

Пришла зима, а с ней и задача проверить теплоизолирующие свойства ~~построек загородной резиденции~~ дачи. А тут ещё оказало... | https://habr.com/ru/post/435946/ | null | ru | null |

# Вышла Hanami v1.0.0.beta1

Про [Hanami](http://hanamirb.org) уже [писали на Хабре](https://habrahabr.ru/post/301532/), и у команды есть, чем нас обрадовать:

Заморозка фич, логгер уровня проекта, автоматическое логгир... | https://habr.com/ru/post/321938/ | null | ru | null |

# Деревья принятия решений на JavaScript

В качестве практического приложения к [предыдущей статье](http://habrahabr.ru/post/171759/), хочу предоставить крошечную JavaScript библиотеку для построения деревьев и леса принятия решений.

я разобрал, что из себя представляет новая система задач **Job system**, как она работает, как создавать задачи, наполнять их данными и выполнять многопоточные вычисления и лишь в двух словах объяснил где можно использовать эту с... | https://habr.com/ru/post/423601/ | null | ru | null |

# Готовая сборка интернет-магазина на MODX Revolution

Часто, когда разработчик выбирает движок для очередного магазина, он обычно оценивает этот вопрос по нескольким критериям:

* Платный/бесплатный (если платный, то сколько).

* Какой функционал есть «из коробки».

* Насколько легко докрутить какой-то свой функционал... | https://habr.com/ru/post/195090/ | null | ru | null |

# Как я реализовал мультиязычность на сайте и в проекте

Создав и поддерживая проект с открытыми исходными текстами хочется сразу решить все возможные проблемы по мультиязычной поддержке как проекта, так и сайта. С поддержкой мультиязычности в различных проектах я сталкиваюсь очень давно, начиная ещё с десктопных прогр... | https://habr.com/ru/post/249039/ | null | ru | null |

# Определение города и региона России по IP

И так, 13 Марта, 2009 16:07 появилась следующая новость на данном ресурсе "[Долгожданный XML-сервис!!!](http://blog.ipgeobase.ru/?p=37)".

Это событие необычайно меня обрадовало, ещё бы такой сервис на таком ресурсе и сразу ручки шаловливые зачесались!

Буквально через ... | https://habr.com/ru/post/54728/ | null | ru | null |

# Оптимизация запросов. Основы EXPLAIN в PostgreSQL (часть 3)

Подолжаю публиковать авторскую переработку [Understanding EXPLAIN](http://www.dalibo.org/_media/understanding_explain.pdf) от Guillaume Lelarg... | https://habr.com/ru/post/203484/ | null | ru | null |

# Нетрадиционный обзор React

Привет, Хабр!

Мы в [Хекслете](https://hexlet.io/?utm_source=habr&utm_medium=blog&utm_campaign=react_review) любим свой стек технологий :) Когда рассказываем другим — многие завидуют: Rails, Docker, AWS, React JS. Реакт мы используем в первую очередь для создания веб-среды для разработки... | https://habr.com/ru/post/249579/ | null | ru | null |

# GlitchTip вместо Sentry. Как мы бесплатно настроили мониторинг ошибок

Привет, хабр! Меня зовут Алексей, я — системный инженер в компании Constanta. Мы с командой занимаемся практиками DevOps, развиваем процессы ci/cd и мониторинга.

Представьте, что у вас есть 10 серверов и 20 микросервисов на них, а релизы проходят... | https://habr.com/ru/post/706386/ | null | ru | null |

# Генераторы vs классы

Очень маленький пост о том, что выбрать: генератор или класс, когда реализация возможна обоими способами.

#### Не сложный выбор

Простая задача: рассчитывать скользящее среднее. Первоначальная реализация была в виде класса, но не давало покоя наличие генераторов, которые как-то очень подходил... | https://habr.com/ru/post/150798/ | null | ru | null |

# [кейс Locomizer] Какие знания можно на самом деле извлечь из анонимизированного датасета с координатами пользователей

> Данная статья является частью серии «Кейс Locomizer», см. также

>

> * [Как за два с половиной года ускорить расчёт тепловой карты в 20 000 раз](https://habr.com/ru/post/485988/)

> * [Открываем O... | https://habr.com/ru/post/485484/ | null | ru | null |

# Shopkeeper — модуль интернет-магазина для MODx

Приветствую, хабралюди!

Хочу рассказать вам и всем читателям Хабра о своем проекте. Ваша оценка мне будет очень полезна. Суть этого проекта — бесплатный движок для создания интернет-мага... | https://habr.com/ru/post/104303/ | null | ru | null |

# Сервис распознавания котов

Проблемой распознавания котов на изображениях нельзя пренебрегать. Как вариант, для её решения можно создать и обучить свой собственный классификатор, для чего потребуются десятки тысяч пушистых фотографий и несколько месяцев работы по подготовке набора данных и, собственно, само обучение.... | https://habr.com/ru/post/262911/ | null | ru | null |

# Как держать 20 тысяч VPN клиентов на серверах за $5

Месяц назад мы с друзьями сделали бесплатный сервис для обхода блокировок сайтов в Украине [Zaborona.Help](https://zaborona.help). За это время сервис стал довольно популярным, аудитория выросла до 20 000 пользователей. Число одновременных подключений в пиковые час... | https://habr.com/ru/post/331178/ | null | ru | null |

# Как Мегафон спалился на мобильных подписках

Обсуждение операторов сотовой связи в Телеграм [t.me/opsosru](https://t.me/opsosru)

Уже давно как не смешные анекдоты ходят истории о платных мобильных подписках на IoT устройствах.

... | https://habr.com/ru/post/448530/ | null | ru | null |

# 1С: Предприятие 8.2 в Ubuntu 11.10 с локальным ключом HASP

**upd.** [vdovin\_ds](https://habrahabr.ru/users/vdovin_ds/) [пишет](http://habrahabr.ru/post/133880/#comment_5230275):

`недавно вышла 1С 8.3, и у неё есть клиент под linux. Работает лучше чем через wine`

Так что возможно содержание статьи устарело. ... | https://habr.com/ru/post/133880/ | null | ru | null |

# Быстрая манипуляция с System.Drawing.Bitmap

Этот топик меня побудило написать статья о работе с System.Drawing.Bitmap <http://habrahabr.ru/blogs/net/60085/>. Мне часто приходилось сталкиваться в коде с попиксельной обработкой изображений для типовых операций, в то время как в .NET есть классы ColorMatrix, ColorMap, ... | https://habr.com/ru/post/60175/ | null | ru | null |

# Реализация одновременного скролинга по всем направлениям

### Введение

Доброго времени суток! Сразу скажу, что программировать я начал недавно и большого опыта у меня нет, поэтому не судите строго, тем более, что материалов на данную тему очень мало. В статье я хочу поделиться своим решением проблемы, которая у меня... | https://habr.com/ru/post/328450/ | null | ru | null |

# Обновление React компонентов с сохранением состояния в режиме реального времени для Browserify

Всем доброго времени суток!

Давайте немного поговорим о DX (Developer Experience) или «Опыте разработки», а если конкретне... | https://habr.com/ru/post/264175/ | null | ru | null |

# Настройка Eclipse для работы с Arduino Uno

Преамбула

=========

У меня дома стоит масляное отопление. Для измерения уровня масла в баке используется допотопный датчик со стрелкой и поплавком на веревке. Принцип работы датчика поражает свой неточностью. Но так как мы с вами живем в далеком будущем, по отношению к мое... | https://habr.com/ru/post/111908/ | null | ru | null |

# Игровые локации, или как сюжет раскрывается через окружение в современных играх

**Ребята, всем привет!!!**

Сегодня поговорим о локациях, а именно какими они бывают, на что должны обратить внимание игрока и какой посыл они несут. Как они подразделяются на различные виды и что характерно для каждой из них. Обо всем э... | https://habr.com/ru/post/548034/ | null | ru | null |

# Балансирующий робот на Arduino Nano и шаговых моторах

### Предыстория

Некоторое время назад я сделал [обратный маятник](https://habr.com/ru/post/472588/). После нескольких итераций с шаговыми моторами равновесия достичь не удалось. Тогда у меня было мало опыта и понимания проблемы, поэтому я переделал его с мотором... | https://habr.com/ru/post/575662/ | null | ru | null |

# Способы организации CSS-кода

Разработчик Бен Фрейн (Ben Frain) однажды заметил: «Писать CSS-код легко. Масшабировать и поддерживать его — нет».

К счастью, на просторах интернета можно найти множество решений этой проблемы. В данной статье рассмотрены основные киты структуры CSS-кода, а также интересные рыбы/млеко... | https://habr.com/ru/post/256109/ | null | ru | null |

# Книга «Знакомство с Python»

[](https://habr.com/ru/company/piter/blog/698112/)Здравствуйте, Хаброжители!

Пора пополнять библиотеку программиста.

Пытаетесь найти что-нибудь для начинающих о языке Python в интернете? Не мож... | https://habr.com/ru/post/698112/ | null | ru | null |

# Компиляция. 5 и 1/2: llvm как back-end

В серии статей от [tyomitch](https://habrahabr.ru/users/tyomitch/) «Компиляция» ([тут](http://habrahabr.ru/blogs/programming/99162/), [тут](http://habrahabr.ru/blogs/programming/99298/), [тут](http://habrahabr.ru/blogs/programming/99366/), [тут](http://habrahabr.ru/blogs/progra... | https://habr.com/ru/post/102597/ | null | ru | null |

# Как я исходники собственного сайта скачал

В сентябре 2009 года была опубликована [статья](https://habrahabr.ru/post/70330/) об уязвимости, связанной с системой контроля версий subversion, позволяющей скачать исходники сайтов, использующих SVN. Периодически от нечего делать мой мозг хотел, что бы я написал граббер и ... | https://habr.com/ru/post/334864/ | null | ru | null |

# Подвешиваем CD-диск, или практический пример моделирования на базе OpenSCAD для 3д печати

В данной статье я бы хотел поделиться опытом использования бесплатной программы OpenSCAD, для 3д моделирования п... | https://habr.com/ru/post/219601/ | null | ru | null |

# Kali Linux для начинающих

14 декабря будет запущена новая «Test lab» — лаборатория тестирования на проникновение, имитирующая работу реальной корпоративной сети, в которой каждый желающий сможет проверить свои навыки тестировани... | https://habr.com/ru/post/432014/ | null | ru | null |

# Упаковка jvm приложения в docker образ

Все плюсы docker для приложения, уже много раз описывали на Хабре, как и его архитектуру.

Мы же решим практическую задачу по упаковке jvm приложения и получим контейнер с миниатю... | https://habr.com/ru/post/310530/ | null | ru | null |

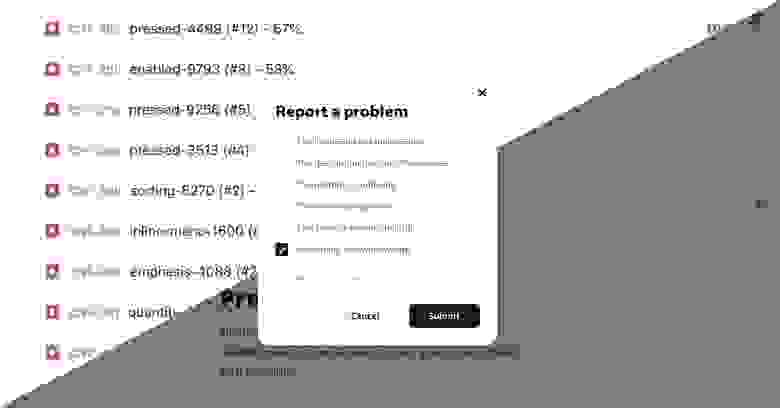

# Как мы обрабатываем жалобы пользователей с помощью JIRA (REST API)

В наше время мало какой веб-сервис или приложение обходится без функционала, где пользователи могут пожаловаться *(уведомить, зарепортить)* на различные виды конте... | https://habr.com/ru/post/510228/ | null | ru | null |

# PostgreSQL Antipatterns: вредные JOIN и OR

Бойтесь операций, buffers приносящих…

На примере небольшого запроса рассмотрим некоторые универсальные подходы к оптимизации запросов на PostgreSQL. Пользоваться ими или нет — выбирать вам, но знать о них стоит.

В каких-то последующих версиях PG ситуация может изменит... | https://habr.com/ru/post/479508/ | null | ru | null |

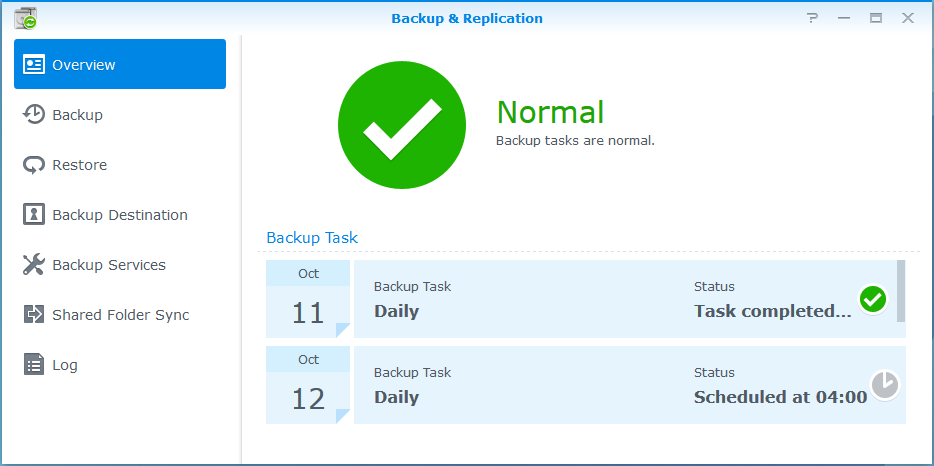

# Использование хардлинков (hardlink) для инкрементального бекапа Synology DSM

Система DSM достаточно удобна и по умолчению в системе установлены модули, которые закрывают 95% потребностей рядового (и не очень) пользователя... | https://habr.com/ru/post/268613/ | null | ru | null |

# Карта города в терминалах оплаты

Статья от 24.05.09

Сегодня будут известны результаты конкурса DevGeneration 2009, в котором я участвовал и, скорее всего, ничего дельного не занял. Поэтому выкладываю сюда свою идею, которую я отсылал на этот конкурс. Идея моя, помог мне с ОСМ Евгений Усвицкий (СГУ), за что ему ог... | https://habr.com/ru/post/61540/ | null | ru | null |

# Книга «Прикладной анализ текстовых данных на Python»

[](https://habr.com/ru/company/piter/blog/444384/) Технологии анализа текстовой информации стремительно меняются под влиянием машинного обучения. Нейронные сети из теоретичес... | https://habr.com/ru/post/444384/ | null | ru | null |

# Модульность во Vue.js и Vuex

При написании больших фронтенд-приложений управление состоянием может стать довольно сложной и утомительной задачей.

Дети подросли и оборвали провода на тренажере. Вело-табло приказало долго жить и крутить педали стало не интересно. Я решил починить табло по-нашенски, по ios-овск... | https://habr.com/ru/post/230101/ | null | ru | null |

# Электронная цифровая подпись (ЭЦП) документов в 1С за пару кликов с использованием утилиты КРИПТО-ПРО PDF

На одном из крупных проектов возникла не совсем обычная для 1С задача. Нужно было организовать массовую отправку и подписание документов контрагентов с помощью электронной цифровой подписи. Поиск информации в сп... | https://habr.com/ru/post/253681/ | null | ru | null |

# История одного шаблона или бэкдор от myopencart.net

#### Предисловие

Однажды попросил меня друг посмотреть почему у него не получается установить шаблон на CMS **Opencart**.

Присылает ссылку на сайт, доступы к административной части и хостингу. Захожу, вижу шаблон в директории с темами (*/catalog/view/theme/*). ... | https://habr.com/ru/post/193910/ | null | ru | null |

# Как раскрыть мощь HTML5 Canvas для игр

Браузеры, поддерживающие HTML5, и платформа HTML5 для Windows 8 Metro сегодня становятся серьезными кандидатами для разработки современных игр.

Благодаря canvas,... | https://habr.com/ru/post/141482/ | null | ru | null |

# Баг с GPU и Canvas в Google Chrome под Windows

На днях работал над необычной и от того интересной задачей. Выяснилось, что у наших менеджеров на определенной странице постоянно возникает сообщение “Опаньки” в Google Chrome. Скажу сразу, страница эта весьма насыщенная, и содержит в себе достаточно тяжеловесные компон... | https://habr.com/ru/post/272239/ | null | ru | null |

# Антирекламный щит рядового пользователя: Яндекс без дзена, YouTube без рекламы, Хабр без баннера

Контроль над содержимым web должен принадлежать в т.ч. рядовому пользователю, а не только маркетологам. Web... | https://habr.com/ru/post/562070/ | null | ru | null |

# Post-mortem отладка на Cortex-M

Post-mortem отладка на Cortex-M

===============================

Предыстория:

------------

Участвовал я недавно в разработке нетипичного для меня девайса из класса потребительской электроники. Вроде ... | https://habr.com/ru/post/452704/ | null | ru | null |

# Поиск изображений

Пытаясь реализовать обратный поиск изображений для своего сайта, я столкнулся с огромным миром поиска изображений. Ниже приведены краткие описания и варианты применения некоторых подходов обратного поиска/поиска похожих изображений.

*Автомобиль Tesla Model 3 взломали с мультикоптера (для зрелищности), [источник](https://electrek.co/2021/05/13/tesla-car-hacked-using-drone-patch/)*

Автомо... | https://habr.com/ru/post/559054/ | null | ru | null |

# Match/case vs If/else. Сравниванием скорость работы операторов в Python 3.10

Прошло уже достаточно времени с момента релиза Python версии 3.10. Самым главным и самым ожидаемым было введение оператора match/case (он же pattern matching).

Однако далеко не всем разработчикам из нашего комьюнити зашел данный оператор.... | https://habr.com/ru/post/592089/ | null | ru | null |

# PostgreSQL 14: Часть 5 или «весенние заморозки» (Коммитфест 2021-03)

8 апреля 2021 г. в 15:00 по московскому времени закончился мартовский коммитфест, а вместе с ним и прием изменений в PostgreSQL 14.

Напомню, что всё самое интересное о первых четырех коммитфестах можно найти в предыдущих статьях серии: [июльски... | https://habr.com/ru/post/550632/ | null | ru | null |

# Настройка SSL для TomCat

Пару недель назад столкнулся с проблемой — стоит TomCat на сервере(windows 2008), ставлен не мной, мало того, я даже не видел как его ставили. Нужно сделать авторизацию по SSL протоколу. Раньше никогда не настраивал веб-сервера ни на винде ни на никсах, а решать нужно в кратчайшие сроки — 3 ... | https://habr.com/ru/post/134453/ | null | ru | null |

# Автоматический подбор синаптических весов. Самое начало. Циклический перебор

В одной из предыдущих статей ([Синаптические веса в нейронных сетях – просто и доступно](https://habr.com/ru/post/589893/)) мы разбирались со смыслом синаптических весов на примере определения цифры на 13-ти сегментном индикаторе и подбирал... | https://habr.com/ru/post/686218/ | null | ru | null |

# Подводные камни при работе с php-handlersocket

HandlerSocket — это noSQL-плагин для mySQL, позволяющий обращаться к базам данных в обход уровня SQL.

Данная статья предназначена для тех, кто успешно поставил HandlerSocket и php-handlersocket, а также столкнулся со скудным мануалом и странным поведением этого плаги... | https://habr.com/ru/post/123452/ | null | ru | null |

# Основы Bash-скриптинга для непрограммистов. Часть 3

Во [второй части статьи](https://habr.com/ru/post/540076/) мы обсудили файлы скриптов, их параметры и права доступа. Также поговорили про операторы условного выполнения, выбора и циклы. В этой, заключительной части мы рассмотрим функции и планировщик заданий cron. ... | https://habr.com/ru/post/542744/ | null | ru | null |

# Готовим ASP.NET5, выпуск №3 — внедрение зависимостей по-новому

> *Мы продолжаем нашу колонку по теме ASP.NET5 публикацией от Виктора Коцюбана ( [Gbdrm](https://habrahabr.ru/users/gbdrm/)) — Technical Leader из SoftServe. В этой статье Виктор поделится с вами подробностями нового встроенного функционала внедрений зав... | https://habr.com/ru/post/264467/ | null | ru | null |

# Беззнаковая арифметика в Java

Как известно, в Java нет беззнаковых типов. Если в Си вы могли написать `unsigned int` (`char`, `long`), то в Java так не получится. Однако нередко возникает необходимость в выполнении арифметических операций именно с числами без знака. На первый взгляд кажется, что беззнаковые типы в п... | https://habr.com/ru/post/225901/ | null | ru | null |

# ruleguard: динамические проверки для Go

В этой статье я расскажу о новой библиотеке (и утилите) статического анализа [`go-ruleguard`](https://github.com/quasilyte/go-ruleguard), которая адаптирует [`gogrep`](https://github.com/mvdan... | https://habr.com/ru/post/481696/ | null | ru | null |

# Серьёзный баг со снайперской стрельбой в Team Fortress 2 исправили спустя десять лет

*При переключении между разными классами персонажей параметры представления персонажа некорректно обновляются. Более того, после переключения в режим зрителя и обратно начинается рассинхрон между параметрами представления и анимации... | https://habr.com/ru/post/373181/ | null | ru | null |

# Самый маленький Docker-образ — меньше 1000 байт

***Прим. перев.**: Автор этого материала — архитектор в Barclays и Open Source-энтузиаст из Великобритании Ian Miell. Он задаётся целью сделать удобный образ Docker (со «спящим» бинарником), который не нужно скачивать, а достаточно просто копировать через copy & paste.... | https://habr.com/ru/post/413959/ | null | ru | null |

# Наш рецепт отказоустойчивого VPN-сервера на базе tinc, OpenVPN, Linux

Один из наших клиентов попросил разработать отказоустойчивое решение для организации защищенного доступа к его корпоративному сервису. Решение должно был... | https://habr.com/ru/post/338628/ | null | ru | null |

# Выжать все соки или используем Raspberry pi на всю катушку

Всем привет!

Долой унылые речи о том, что это мой первый пост и все такое. Пожалуй лучше я расскажу о том, как выжать все соки из маленькой малютки под названием Raspberry PI (далее RPI), ценой $ 35. Я уверен на 146,6% что здесь уже были посты подобного р... | https://habr.com/ru/post/222447/ | null | ru | null |

# Как сэкономить на покупке ноутбука: Docker Remote API via TLS

Совсем недавно я решился на покупку личного ноутбука. Разработка open-source проекта ([приложение для Flipper](https://github.com/Flipper-Zero/Flipper-Android-App)) и смена места работы вынудили меня больше не использовать рабочий ноутбук для личных целей... | https://habr.com/ru/post/524424/ | null | ru | null |

# Готовлю CentOS 6.8 к работе

С Linux мы пересеклись в 2005 году, это был **Debian**. Потом последовал долгий роман с **Ubuntu**, ради которого в марте 2009 приобрел нетбук Asus EeePC 1000. В 2010 начал сотрудничать с **ALT Linux**, участвовал в «[Школьном проекте](http://freeschool.altlinux.ru/)» ([продвигали Linux в... | https://habr.com/ru/post/323246/ | null | ru | null |

# Управление ЖК-матрицей F-51543NFU-LW-ADN / PWB51543C-2-V0 (от ленточной библиотеки)

И снова привет, Хабр! Сделав [перевод](https://habr.com/ru/post/444762/) статьи об управлении ЖК-модулем с драйвером, но без собственного видео-... | https://habr.com/ru/post/444912/ | null | ru | null |

# Тест пропускной способности ASP.NET Core 5.0 в Kestrel, IIS, Nginx и Caddy

Начиная с версии 2.2. ASP.NET Core поддерживает режим внутрипроцессного размещения приложения (InProcess) в IIS, направленный на улучшение производительности кода. Рик Страл написал [статью](https://weblog.west-wind.com/posts/2019/Mar/16/ASPN... | https://habr.com/ru/post/557670/ | null | ru | null |

# Разбор таска Dirty logs с M*CTF 2022 или как желание пихнуть кавычку помогает решать CTF

Прошел почти год с того момента, как я написал свою первую [сатью](https://habr.com/ru/post/589433/) на Хабр. Начал этот путь именно с разбора задания MCTF 2021. Решил продолжить традицию в этом году и написать writeup на интере... | https://habr.com/ru/post/696586/ | null | ru | null |

# Полноценная замена Denwer или разворачиваем Ubuntu-server на VMware (часть 2)

В [первой части](http://habrahabr.ru/blogs/webdev/127090/) мы с вами создали виртуальную машину, установили Ubuntu, настроили сеть и SSH доступ к гостевой ОС (Ubuntu). Теперь, самое время разобраться с синхронизацией наших файлов. Можно ко... | https://habr.com/ru/post/127971/ | null | ru | null |

Subsets and Splits

No community queries yet

The top public SQL queries from the community will appear here once available.