text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

values | source stringclasses 4

values |

|---|---|---|---|---|

# Сертификат COVID-19 не найден: Почему на самом деле перестали работать QR-коды о вакцинации

25 января 2022 года на сайте RaidForums было опубликовано [предложение о продаже базы данных 48 миллионов вакцинированных россиян](https://raidforums.com/Thread-GOSUSLUGI-STOPCORONAVIRUS-COVID-QR-code-database-48M-records). Б... | https://habr.com/ru/post/650589/ | null | ru | null |

# PHP Microservice Framework: Swoft v2.0.7 Release on schedule

What is Swoft?

--------------

Swoft is a PHP high performance microservice coroutine framework. It has been published for many years and has become the best choice for ... | https://habr.com/ru/post/476508/ | null | en | null |

# Насколько R быстр для продуктива?

Есть такой популярный класс задач, в которых требуется проводить достаточно глубокий анализ всего объема цепочек работ, регистрируемых какой-либо информационной системой (ИС). В качестве ИС может быть документооборот, сервис деск, багтрекер, электронный журнал, складской учет и пр. ... | https://habr.com/ru/post/429938/ | null | ru | null |

# Сервис управления заявками на отпуска для SharePoint 2013 в интеграции с БОСС-Кадровик

Полгода назад мы рассказывали о том, [как реализовали сервис бронирования переговорных комнат](http://habrahabr.ru/company/eastbanctech/blog/195110/) у крупного заказчика с территориально разнесенными офисами и штатом несколько ты... | https://habr.com/ru/post/213125/ | null | ru | null |

# Ethereum Solidity + Vue.js Tutorial Simple Auction Dapp за 10 минут

Привет хабр! Недавно заметил, что на рускоязычную аудиторию очень мало туториялов чтобы войти в мир блокчейна и разрабатывать там. Решил поделиться статьей про смарт-контракты на Ethereum. Эта статья очень помогла мне когда-то, вникнуть в мир блокче... | https://habr.com/ru/post/535974/ | null | ru | null |

# Простой робот на МК esp8266 c micropython

Привет, Хабр!

Эта статья описывает процесс апгрейда [самоходной платформы](https://habr.com/ru/post/495576/) на базе МК esp8266 с [micropython](https://docs.micropython.org/en/latest/), до простейшего робота, оснащённого сканирующим ультразвуковым датчиком препятствий, ми... | https://habr.com/ru/post/497062/ | null | ru | null |

# Математическая библиотека Numbers.js

Numbers.js добавляет к стандартным математическим возможностям JavaScript немного продвинутой математики — интегралы, операции над матрицами и комплексными числами, статистические функции, факторизацию и некоторые другие функции. Кроме того, библиотека определяет базовые арифмети... | https://habr.com/ru/post/164169/ | null | ru | null |

# Заповеди начинающего DS

Привет! Меня зовут Mashkka Тихонова. Я - Senior Data Scientist, а еще я активно преподаю все, что связано с ML, DS и DL - помогаю людям начать свой путь в Data Science!

За годы пре... | https://habr.com/ru/post/712592/ | null | ru | null |

# Мега-Учебник Flask, Часть 8: Подписчики, контакты и друзья

Это восьмая статья в серии, где я описываю свой опыт написания веб-приложения на Python с использованием микрофреймворка Flask.

Цель данного руководства — разработать довольно функциональное приложение-микроблог, которое я за полным отсутствием оригинальн... | https://habr.com/ru/post/230643/ | null | ru | null |

# Блокировка учетных записей Active Directory: руководство по инструментам и диагностике

Блокировка учетных записей доставляет системным администраторам много хлопот, в Active Directory (AD) это частое явление. Согласно [рeзультатам... | https://habr.com/ru/post/531722/ | null | ru | null |

# Elixir

Здравствуйте, сегодня я Вам расскажу о современном языке программирования под BeamVM (или ErlangVM).

Первая часть является неполным введением в основы, а вторая часть статьи показывает на простых примерах главные особенности языка, новые для erlang-разработчика.

Два года назад вышла 0.1 версия elixir, к... | https://habr.com/ru/post/184222/ | null | ru | null |

# Автономный ftp-client с докачкой файлов

Хочу поделиться своим опытом в разработке автономного ftp клиента.

В наличии имеется ftp-сервер, на котором периодически появляются данные в виде графических изображений и текстовых файлов, их размер варьируется от десятков килобайт до пары гигабайт. Доступ в интернет может... | https://habr.com/ru/post/282600/ | null | ru | null |

# Применение D-Bus в веб-системах

В процессе разработки нескольких Интернет-сервисов мы заметили, что значительная часть их функционала является общей, и руководствуясь принципом [DRY](http://habrahabr.ru/post/144611/) (Don't Repeat Yourself — не повторяйся), приняли решение вынести общий функционал в отдельный модуль... | https://habr.com/ru/post/165959/ | null | ru | null |

# Четыре факта о memcached-амплификации

*Это перевод оригинальной публикации Артема [ximaera](https://habr.com/ru/users/ximaera/) Гавриченкова «Understanding the facts of memcached amplification attacks», опубликованной [в блоге](ht... | https://habr.com/ru/post/352306/ | null | ru | null |

# Yota-роутер или wimax2wifi за 15 минут

Часто возникает необходимость быстро или недорого подключить офис к интернету. Для этих целей отлично подходит новый Московско-Питерский провайдер беспроводного интернета, Yota, публичное тестирование которого некоторые и нас успешно провалили :)

Благодаря двум людям, Олегу... | https://habr.com/ru/post/53790/ | null | ru | null |

# React Apollo, Gqlgen – авторизация. Часть 1

Это базовое руководство описывающее схему работы "отложенной" авторизации. При которой права пользователю выдаются с задержкой по времени. Здесь мы разберем тольк... | https://habr.com/ru/post/598359/ | null | ru | null |

# Animator — что это? Зачем он нужен? Почему его стоит использовать вместо Animation?

Привет! Меня зовут Данил Перевалов, я работаю Android-разработчиком в компании «Лайв Тайпинг», и сегодня мне выпала честь открыть наш блог на Хабре. Дебютный материал посвящён типу классов Animator. Статья будет полезна и тем, кто то... | https://habr.com/ru/post/274135/ | null | ru | null |

# Мониторинг динамических XML-документов

На работе в рамках проектирования новой системы интеграции устройств для мониторинга аудио/видео потоков возникла задача отслеживания, накопления и последующего анализа изменений их... | https://habr.com/ru/post/274131/ | null | ru | null |

# Auto Layout настройка кодом

В iOS-разработке выравнивание контента и интервалы — это то, на что может уйти много времени. Давайте рассмотрим, как устанавливать ограничения с помощью UIKit, обновлять их и разрешать конфликты ограничений.

Ограничение(constraint) - это правило, позволяющее операционной системе размеща... | https://habr.com/ru/post/690940/ | null | ru | null |

# Deploy SonarQube Server

Привет, хаброжители!

====================

В данном руководстве хочу изложить пошаговую настройку по развёртыванию платформы для непрерывного анализа и измерения качества кода. Подобных статей в сети достаточно много, но я хочу выделить лишь главное, чтобы все новички с первого раза смогли с ... | https://habr.com/ru/post/474140/ | null | ru | null |

# Предновогодний релиз API и портала Scorocode

Здравствуй, Хабр. С наступающим тебя! Как и обещали, к концу года обновили API и портал Scorocode.

Ключевые нововведения:

* (по многочисленным просьбам трудящихся) Открыл... | https://habr.com/ru/post/317450/ | null | ru | null |

# Руководство по CMake для разработчиков C++ библиотек

В этой статье я расскажу о том, как правильно писать современные `CMakeLists.txt` файлы для C++ библиотек. Идеи, используемые в ней, основаны на [докладе](https://www.youtube.com/watch?v=m0DwB4OvDXk) Крейга Скотта (разработчик CMake) и [докладе](https://www.youtub... | https://habr.com/ru/post/683204/ | null | ru | null |

# Code Completion. Часть 2: зачем тут машинное обучение?

> ***«Почему нельзя просто сделать логично? Я не понимаю».***

> Из сообщения об ошибке

>

>

В [первой части](https://habr.com/ru/company/JetBrai... | https://habr.com/ru/post/572864/ | null | ru | null |

# ViyaDB: аналитическая база данных для несортированных данных

Примерно год назад, мне довелось работать в одной компании, где я натолкнулся на интересную проблему. Представим себе массивный поток данных об использовании мобильных приложений (десятки миллиардов событий в день), который содержит в себе такую интересную... | https://habr.com/ru/post/350154/ | null | ru | null |

# Единая система мониторинга и оповещений BI: правда или вымысел?

Привет, Хабр! Мы, Юлия Лузганова [HiJulia](https://habr.com/ru/users/hijulia/) и Наталия Прудникова [balzaant](https://habr.com/ru/users/balzaant/), аналитики в ком... | https://habr.com/ru/post/574384/ | null | ru | null |

# Quasar, Sobaken и Vermin: раскрываем детали действующей кибершпионской кампании

С помощью инструментов удаленного доступа Quasar, Sobaken и Vermin киберпреступники следят за украинскими правительственными учреждениями и крадут данные из их систем. Эта кибергруппа была впервые упомянута в отчете в январе 2018 года, п... | https://habr.com/ru/post/418165/ | null | ru | null |

# Защищаем систему. Или как настроить и использовать port knocking

Салам-папалам всем!

Тут озадачился как же можно сделать свой сервер более безопаснее. Использование напрямую iptables с блокировкой по IP не решало проблемы, т.к. я могу к серверу подсоединяться не только с рабочего ПК, но и издому, или с другого го... | https://habr.com/ru/post/194412/ | null | ru | null |

# Революция PHP7: Типы возвращаемых значений и удаление артефактов

Планируемая дата выпуска PHP7 стремительно приближается, внутренняя группа усиленно работает, пытаясь исправить наш любимый язык, сделать его как можно лучше, будут удалены артефакты прошлых версий и добавлено несколько столь желанных фич. Есть много R... | https://habr.com/ru/post/248721/ | null | ru | null |

# Как отображать потоковое видео с помощью HTML5

В этой статье я объясню и покажу как сделать видео трансляцию на вашем сайте. Недавно меня наняли с целью реализовать данный функционал для клиента. Я посоветовал реализовать это с помощью HTML5 для mp4 видео форматов и flash для его .flv файлов.

Основы

------

Тем к... | https://habr.com/ru/post/307446/ | null | ru | null |

# Непостмортем игры «Roads of Rome» («Дороги Рима»)

В данной статье я хочу **кратко** рассказать о разработке казуальной игры «Roads of Rome» («Дороги Рима»).

Возможно это будет интересно тем, кто только собирается заняться разра... | https://habr.com/ru/post/105011/ | null | ru | null |

# Миграция БД на Windows Azure SQL VM. BLOB Storage + REST

Теперь, когда мы имеем созданную в Облаке с установленным на нее SQL Server и умеем со стороны клиента с ним соединяться, как с локальным SQL Server, остается наполнить его данными. Предположим, в рамках гибридного сценария часть БД планируется перенести на Az... | https://habr.com/ru/post/156939/ | null | ru | null |

# Новые подходы к валидации в Rails 3

#### Введение

Как вы уже знаете из поста тов. Yehuda Katz об [ActiveModel абстракции](http://yehudakatz.com/2010/01/10/activemodel-make-any-ruby-object-feel-like-activerecord/), в Rails 3.0, ActiveRecord отныне содержит в себе некоторые аспекты ActiveModel, среди которых модули в... | https://habr.com/ru/post/82841/ | null | ru | null |

# Необычный способ использования встроенных команд оболочки для выяснения того, какие директории существуют в системе

В давние времена [многоархитектурных Unix-окружений](https://utcc.utoronto.ca/~cks/space/blog/unix/FadingMultiArchUnixSetups) разработчики дистрибутивов не могли прийти к единому мнению о том, что долж... | https://habr.com/ru/post/554298/ | null | ru | null |

# Как быстро начать и эффективно продолжить писать расширение для лисы

### Обычно цикл разработки таков:

1) вносим изменение в исходники,

2) перепаковываем исходники в \*.xpi ([скриптами](http://kb.mozillazine.org/Windows_build_script)),

3) переключаемся на лису,

4) Ctrl+O, выбираем полученный выше \*.xpi, ... | https://habr.com/ru/post/48498/ | null | ru | null |

# Как мы среду Arduino на 8051 натягивали, или ОС на один процесс

Летом 2016 мы выпустили в широкую продажу нашу новую плату для разработки Z-Wave устройств — Z-Uno. Это абсолютно новаторское устройство, аналогов которому в... | https://habr.com/ru/post/313898/ | null | ru | null |

# Qwt и Qt Creator. Быстро и просто. Часть 2: элементы отображения и управления

В примерах использованы Qt Creator 3.0.0 (MinGW) и Qwt-6.1.0.

Для понимания этой статьи читателю желательно:

* иметь на... | https://habr.com/ru/post/211867/ | null | ru | null |

# Virtualpatching в Nemesida WAF: патчим уязвимости «на лету»

Основное предназначение WAF — выявлять атаки на веб-приложение. Мы пошли дальше и реализовали систему виртуального патчинга, позволяющую накладывать заплатки «на лету», не дож... | https://habr.com/ru/post/346044/ | null | ru | null |

# Миграция схемы базы данных без даунтайма для postgresql на примере django

Введение

========

Привет, Хабр!

Хочу поделиться опытом написания миграций для postgres и django. Речь в основном пойдёт про postgres, django же здесь хорошо дополняет, так как из коробки имеет автоматическую миграцию схемы данных по изменени... | https://habr.com/ru/post/425063/ | null | ru | null |

# Микроформаты в профиле хабрапользователя

Сделал [тестовую страницу](http://webmascon.com/max/futurico/microformatted-habraprofile/). Под катом описание моих действий.

**ВНИМАНИЕ!** Я дописываю и дополняю описание вот прямо сейчас, когда вы это читаете, так что не удивляйтесь появлению новых абзацев.

С новой ст... | https://habr.com/ru/post/10601/ | null | ru | null |

# Копируем исходный код без нумерации строк

Бывает при выводе информации требуется ее декорировать для лучшего восприятия, нередко оформление сопровождается в том числе и текстом. При выделении и копировании этой информации, оформление к... | https://habr.com/ru/post/114322/ | null | ru | null |

# Модульная система YM

Еще одна? Зачем? Есть же CommonJS и AMD? Страждующие могут пройти под кат.

Я не буду вдаваться в то, зачем вообще нужны модули и модульные системы, про это есть статья [Путь JavaScript модуля](http://habrahabr.ru/post/181536/) от [azproduction](https://habrahabr.ru/users/azproduction/), перей... | https://habr.com/ru/post/213627/ | null | ru | null |

# Что новые версии UEFI-стандартов нам готовят, часть первая, PI 1.4

После полугода разработки организация [UEFI Forum](http://uefi.org/) выложила наконец в открытый доступ [документацию](http://uefi.org/specifications) по новы... | https://habr.com/ru/post/259051/ | null | ru | null |

# Как протестировать наследство без боли и страха

Вы получили или пришли на проект, которому *d+*дцать лет? PHP код был написан в перерывах между охотой на мамонтов и поэтому слегка не читаем? Вам пр... | https://habr.com/ru/post/316140/ | null | ru | null |

# Как мы делали сквозную аналитику из 1C в Power BI

В странах СНГ принято создавать отчеты о деятельности компании в сводных таблицах Excel. Сказать, что это не юзабельно и не юзерфрендли для сложных отчётов – ничего не сказать.

Many of our articles are focused on anything, but not the PVS-Studio tool itself. Whereas we do a lot to make its usage convenient for developers. Nevertheless, our efforts ... | https://habr.com/ru/post/458068/ | null | en | null |

# Сохранение изображения с помощью libpng

Развлекаясь на досуге с OpenGL, решил научиться делать скриншоты средствами программы, а не системы. Довольно быстро нагуглил функцию glReadPixels, но вот с сохранением картинки ... | https://habr.com/ru/post/176163/ | null | ru | null |

# Концепция: Faultable types

Предлагаю концепцию Faultable type — модификацию типов по аналогии с nullable. Суть — в том, что этот тип может принимать особое значение если при выполнении программы что-то пошло не так: не найден нужный файл, произошло деление на 0 и т.д. Этот тип предназначен для работы с ошибками как ... | https://habr.com/ru/post/549294/ | null | ru | null |

# Пишем телеграм-бота на Rust, предварительно спаяв сетевую карту

Всем привет. В прошлом году я писал про то, как я сделал компьютер на дискретных логических микросхемах. После того, как были сделаны процессор, видеокарта, интерфейсы клавиатуры и SD-карты, оставалось два классических модуля, которые есть в обычных ком... | https://habr.com/ru/post/706178/ | null | ru | null |

# MS-DOS, который мы никогда не видели

Порой встречаются такие артефакты природы, что начинаешь невольно задумывать о разных конспирологических теориях и альтернативной истории. Сегодня я хотел бы поговорить ... | https://habr.com/ru/post/207848/ | null | ru | null |

# Как найти ближайшее кафе, достопримечательность, свободное такси глазами программиста

Сервисы, решающие какие-либо задачи в контексте нашего местоположения достаточно прочно вошли в нашу жизнь. Большинство смартфонов может при наличии доступа в интернет вызвать нам такси, рассчитать, через сколько приедет автобус, п... | https://habr.com/ru/post/301460/ | null | ru | null |

# Археология программиста

В прошедшую субботу решил провести «субботник» и наконец-то навести порядок на полках и в шкафах.

В старых коробках, среди всякого разного оборудования, разных плат, девелопер китов и пачек ста... | https://habr.com/ru/post/314756/ | null | ru | null |

# Автоматизируем работу с контейнерами через Makefile: сборка, тестирование и развёртывание за один вызов make

Утилита make позволяет просто управлять контейнерами, объединив команды для сборки, тестирования и развёртывания в одном конфигурационном файле.

**Лесли Лэмпорт** — автор основополагающих работ в распределённых вычислениях, а ещё вы его можете знать по буквам La в слове **La**TeX — «Lamport TeX». Это он впервы... | https://habr.com/ru/post/455467/ | null | ru | null |

# Вскрываем ProLock: анализ действий операторов нового вымогателя по матрице MITRE ATT&CK

Успех атак вирусов-шифровальщиков на организации по всему миру побуждает все больше новых злоумышленников «вступить в игру». Один из таких нов... | https://habr.com/ru/post/502770/ | null | ru | null |

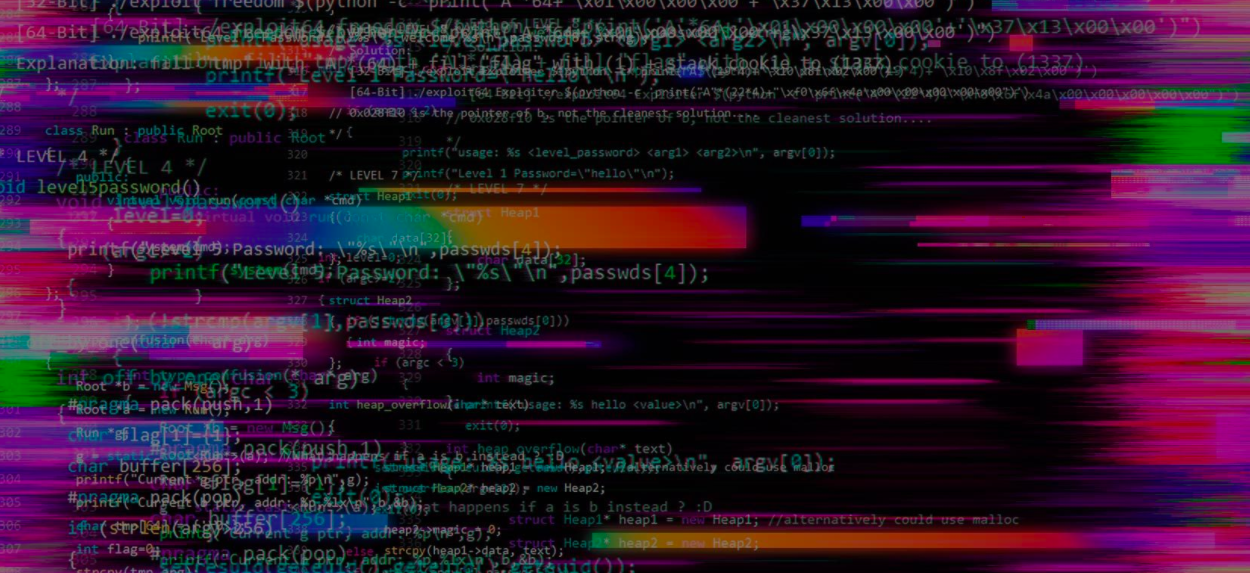

# Exploit Exercises: Введение в эксплуатацию бинарных уязвимостей на примере Protostar

Всем доброго времени суток. Продолжаем разбор заданий с сайта [Exploit Exercises](https://exploit-exercises.com), и сегодня будут рассмо... | https://habr.com/ru/post/320460/ | null | ru | null |

# Python Tools для Visual Studio, о новинках из первых рук

*Эта статья написана Павлом Минаевым [int19h](https://habrahabr.ru/users/int19h/) — разработчиком из команды PTVS специально для публикации в нашем корпоративном блоге на Хабрахабре. Делитесь вашими впечатлениями в комментариях. Все отзывы будут переданы коман... | https://habr.com/ru/post/185412/ | null | ru | null |

# Фейс-контроль для лимонов и марсианская клубника: как я попал на стажировку в Россельхозбанк после участия в DS-конкурсе

Думаю, осталось не так много людей, которые не слышали о хакатонах и соревнованиях по Data Science. О них полгода назад услышал и я. Участвуя во всём, что видел (и что-то даже выигрывая), я не смо... | https://habr.com/ru/post/551478/ | null | ru | null |

# Развертывание Nodejs приложения на DotCloud

Интро

=====

[Dotcloud](https://www.dotcloud.com/) — это это облачная платформа для развертывания приложений. Стек на DotCloud включает в себя более 10 различных сервисов среди которых есть и **Node.JS**.

Мои первые впечатления от **DotCloud** были весьма положительные.... | https://habr.com/ru/post/125375/ | null | ru | null |

# Организация мониторинга работы сотрудников в малом офисе

Заместитель директора по безопасности вызывает к себе в кабинет. Ставится задача: безопасник хочет видеть, чем занимался каждый сотрудник в течение дня. Желательно, с архивом в несколько дней. В ходе беседы выясняется, что «ввод с клавиатуры» сотрудника его аб... | https://habr.com/ru/post/266419/ | null | ru | null |

# HAQuDA: новый взгляд на мониторы качества воздуха

HAQuDA – это настольная лампа, которая отображает данные о параметрах окружающей среды: качестве воздуха, температуре и влажности, при помощи цвета освещен... | https://habr.com/ru/post/647117/ | null | ru | null |

# Красивые подсказки для jQuery Validation с помощью qtip

Привет Хабр!

Хочу поделиться способом организации красивых подсказок для плагина [валидации](http://bassistance.de/jquery-plugins/jquery-plugin-validation/) на jQuery. Для этих целей будем использовать еще один плагин создания красивых информационных сообщен... | https://habr.com/ru/post/139364/ | null | ru | null |

# SQL Server 2016 RC0

На глаза попалась уже вторая новость на Хабре о том, что скоро *Microsoft* «подружит» *SQL Server* и *Linux*. Но ни слова не сказано про *SQL Server 2016 Release Candidate*, который стал доступен для [... | https://habr.com/ru/post/259729/ | null | ru | null |

# Написание ОС с нуля: Глава 2, Часть 3 — Терминал

Ссылки:

-------

* [предыдущая часть](https://habr.com/ru/post/680270/)

* [глава 1, часть 1](https://habr.com/ru/post/670030/)

* [гитхаб](https://github.com/vanosoft/HexOS)

Вступление

----------

В предыдущей статье мы написали простейший *загрузчик*, печатающий на э... | https://habr.com/ru/post/681374/ | null | ru | null |

# Массовое добавление/удаление хостов в Zabbix при помощи API

На одном из проектов часто разворачивались/удалялись новые ноды в облаке, соответственно, появилась задача добавления/удаления новых хостов в Zabbix для мониторинга доступности и снятия статистики. Для саморазвития было решено использовать библиотеку [zabbi... | https://habr.com/ru/post/146455/ | null | ru | null |

# Библиотека Reamp: обезболивающее для ваших Android-приложений

Однажды мы в компании EastBanc Technologies устали бороться с теми архитектурными проблемами, которые возникают в Android-разработке и решили все исправить:). Мы хотели найти решение, которое удовлетворит всем нашим требованиям.

И, как это часто бывает, ... | https://habr.com/ru/post/338744/ | null | ru | null |

# Ловля жуков в чемодане

[](https://habr.com/ru/company/ruvds/blog/652151/)

Эпопею с [чемоданом](https://habr.com/ru/company/ruvds/blog/598697/) хотелось завершить красивой демкой, с бегущей строкой и всякими графическими эффектами... | https://habr.com/ru/post/652151/ | null | ru | null |

# Динамическая CDN для WebRTC стриминга с низкой задержкой и контролем доступа к потокам

В [первой части](https://habr.com/en/company/flashphoner/blog/477310/) мы развернули простую динамическую CDN для трансляции WebRTC потоков на дв... | https://habr.com/ru/post/478302/ | null | ru | null |

# Dagger2 и архитектурный компонент «ViewModel»

ViewModel — это компонент из набора библиотек под названием [Android Architecture Components](https://developer.android.com/topic/libraries/architecture/index.html), которые были представлены на Google I/O 2017. ViewModel — предназначена для хранения и управления данными... | https://habr.com/ru/post/337320/ | null | ru | null |

# У пустого пакета npm «-» обнаружили 700 тысяч загрузок

Эксперты Bleeping Computer [обнаружили](https://www.bleepingcomputer.com/news/software/empty-npm-package-has-over-700-000-downloads-heres-why/), что у пустого пакета [npm «-»]... | https://habr.com/ru/post/571060/ | null | ru | null |

# Настройка основных параметров у коммутаторов Huawei CloudEngine (на примере 6865)

Мы уже длительное время используем оборудование Huawei в [продуктиве публичного облака](https://mclouds.ru/pricing/iaas/). Н... | https://habr.com/ru/post/522510/ | null | ru | null |

# Нейрокурятник: часть 1. Установка Raspberry Pi и камеры в курятник и их настройка

*Большой брат следит за тобой, птица!*

**Статьи про нейрокурятник**

**Заголовок спойлера**1. **[Вступление](h... | https://habr.com/ru/post/327978/ | null | ru | null |

# Детская сказка программисту на ночь

Есть интересная тема, на первый взгляд мало относящаяся к алгоритмам. Она "сказочная" с одной стороны, а со стороны другой в ней есть созвучие с насущными проблемами начинающего свой профессиональный путь программиста.

Java developers have access to a number of useful tools that help to write high-quality code such as the powerful IDE IntelliJ IDEA, free analyzers Sp... | https://habr.com/ru/post/449020/ | null | en | null |

# Архивация баз данных Microsoft SQL Server

По долгу службы сталкиваюсь с серверами баз данных MSSQL. Часто необходимо быстро настроить архивацию БД, на тестовых серверах, да и в продакшене. При этом в сети можно найти много разрозненных односложных источников, как надо или не надо архивировать, но нигде нет каких то ... | https://habr.com/ru/post/316658/ | null | ru | null |

# Имитационная модель логистического центра

Предлагаю вниманию хабрапользователей небольшую статью, описывающую практическую сторону применения такой области, как имитационное моделирование.

#### Постановка задачи (описание процесса)

В логистический центр по согласованному с поставщиком календарю поставок прибывае... | https://habr.com/ru/post/254067/ | null | ru | null |

# PowerShell: машина vs человек

Некоторое время назад мне досталась по наследству ферма терминальных серверов. И руководство поставило мне задачу — искоренить skype, chrome, firefox и mail.ru агентов на всех терминальных серверах. Исторически сложилось так, что в компании используются тонкие клиенты и лишь у привилеги... | https://habr.com/ru/post/120434/ | null | ru | null |

# Переход с AngularJS на Angular: цели, планы и правила переноса элементов (1/3)

В январе мы в Skyeng закончили перевод нашей платформы Vimbox с AngularJS на Angular 4. За время подготовки и перехода у нас накопилось много записей, ... | https://habr.com/ru/post/348356/ | null | ru | null |

# Replication slots в PostgreSQL

До девятой версии в PostgreSQL для создания «теплого» резервного сервера использовался WAL archiving. В версии 9.0 появилась потоковая репликация с возможностью создания «горячего» read-only сервера. В следующей версии PostgreSQL 9.4 появится новый функционал для создания потоковой реп... | https://habr.com/ru/post/245847/ | null | ru | null |

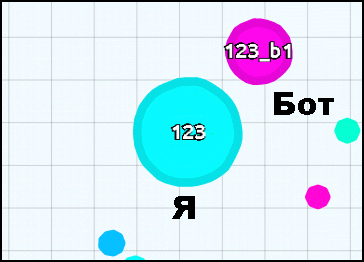

# Пишем бота для браузерной игры agar.io

Все уже наверно в курсе о такой замечательной веб-игре, как [agar.io](http://agar.io).

В очередной раз проиграв в ней более везучему сопернику, я тихо выругался про себя и решил к... | https://habr.com/ru/post/257619/ | null | ru | null |

# Что нового в Laravel 5?

Несколько месяцев назад в студии, где я работаю, было принято решение всей командой перебраться на Laravel. Последние пару лет популярность этого фреймворка неустанно росла, и, как оказалось, не н... | https://habr.com/ru/post/238017/ | null | ru | null |

# Как работать с деньгами, или денежные суммы в бэкенд-разработке

Наша команда периодически пополняется новыми людьми, которые «приносят с собой» новые ошибки. Поэтому мы регулярно проводим семинары с их разбором. Это хороший повод напомнить всем о правилах работы с суммами, объяснить новичкам зачем они нужны и, возмо... | https://habr.com/ru/post/659675/ | null | ru | null |

# Делим Laravel на компоненты

Привет, Хабр. Недавно получил в руки интересный проект, который, несмотря на свою простоту требовал не использовать какой-либо фреймворк. О пакетах речи не шло, поэтому было принято решение использовать привычные компоненты Laravel. Если есть необходимость в использовании очередей, Eloque... | https://habr.com/ru/post/475144/ | null | ru | null |

# Создание плагина для Intellij IDEA. Заметки и мелкие советы

Полгода назад или около того я загорелся-таки идей написать свой плагин для Intellij IDEA. Согласно задумке, он должен был считать, сколько времени разработчик потратил на проект (всего, за день, за сеанс) и отображать результат на диаграмме. Никакой магии,... | https://habr.com/ru/post/270309/ | null | ru | null |

# Методы распознавания текста

Буквально вчера прошла 61-я студенческая научная конференция в Южном Федеральном Университете в городе Таганроге, на которой я представлял доклад по методам распознавания текста на графических изображениях. И хотелось бы поделиться этим с еще большим количеством слушателей и читателей. Ко... | https://habr.com/ru/post/220077/ | null | ru | null |

# Mikrotik. QoS для дома

Сегодня я хотел бы немного рассказать о приоритетах.

Статья не претендует на охват всей информации по QoS на Mikrotik. Это демонстрация набора правил, позволяющих настроит... | https://habr.com/ru/post/330362/ | null | ru | null |

# Cтарший разработчик Google Ads: Почему я занимаюсь рекламой

> «Я работаю в Google над рекламой»

>

> «Почему? Я искренне не понимаю, что кто-то может этим заниматься.»

Кто-то недавно [спросил меня... | https://habr.com/ru/post/556776/ | null | ru | null |

# Виртуальный Джинн на 8 марта — или как удивить своих сотрудниц в самый весенний день

Завтра по всему миру мы будем отмечать самый женский день в году. И это прекрасно! Но это значит, что **сегодня — день, когда мы поздравляем на... | https://habr.com/ru/post/442750/ | null | ru | null |

# Пишем под ТСД. Подключение сканера штрихкода, как компонент формы

Ни для кого не секрет, что промышленное ПО для терминалов сбора данных (ТСД) пишется для автоматизации бизнес процессов, в особенности — складских. Большая часть задач, которые необходимо решить с помощью ТСД, связана со штрихкодированием, благо скане... | https://habr.com/ru/post/235869/ | null | ru | null |

# Как устроен поиск Яндекс.Маркета и что будет, если упадёт один из серверов

Привет, меня зовут Евгений. Я работаю в инфраструктуре поиска Яндекс.Маркета. Хочу рассказать сообществу Хабра о внутренней кухне Маркета – а рассказать есть что. Прежде всего, как устроен поиск Маркета, процессы и архитектура. Как мы справля... | https://habr.com/ru/post/475848/ | null | ru | null |

# Используем template + constexpr для создания масок регистров периферии микроконтроллера на этапе компиляции (C++14)

Введение

--------

Эта небольшая заметка содержит не очевидное решение поставленной ниже задачи, до которого мне пришлось доходить несколько бессонных ночей.

Задача: на основе заданных пользователем... | https://habr.com/ru/post/331468/ | null | ru | null |

# Использование XPath для указания ссылок на объекты

Данный топик рассказывает о возможности использования XPath для выбора объектов из базы данных в случаях, когда использование SQL нежелательно.

#### Постановка задачи

Во многих системах для тех или иных целей часто требуется выбирать объекты из базы данных в кач... | https://habr.com/ru/post/95067/ | null | ru | null |

# WPF и Box2D. Как я делал физику c WPF

Доброго времени Хабр. Я большой фанат физики в играх, работал с некоторыми интересными физическими движками но сегодня я расскажу о Box2D. Он максимально прост... | https://habr.com/ru/post/333040/ | null | ru | null |

# Как настроить SSH-Jump Server

Для работы с [облачной инфраструктурой](https://tinyurl.com/yxv72n2n) рекомендуется создавать SSH Jumpstation. Это позволяет повысить безопасность и удобство администрировани... | https://habr.com/ru/post/530516/ | null | ru | null |

# Корутины, компиляторы, кодогенерация и другие «ко...» грядущей C++ Russia

Как известно, в мире C++ много способов причинить себе боль, но также много высокой производительности, нетипичных амбициозных зад... | https://habr.com/ru/post/668132/ | null | ru | null |

# Ускорение печати из терминальной сессии Windows Server или доработка EasyPrint напильником

И вот он настал, этот день, когда в очередной раз, ожидая распечатки от томно подмигивающего принтера, я, наконец, решил, что мое терпение не безгранично. Посвящается тем, кого тоже достала медленная печать на перенаправленных... | https://habr.com/ru/post/308648/ | null | ru | null |

# К AGI через самоорганизацию и структурную адаптацию

Статья перед вами - это длинное введение, в котором я утверждаю, что нейросети - это тупик, что мир вокруг - это такой самоорганизующийся фрактал; возвращ... | https://habr.com/ru/post/692274/ | null | ru | null |

# Развертывание приложения Symfony в AWS Lambda

Сначала давайте разберемся, что такое бессерверная архитектура и когда она нужна.

Бессерверная архитектура позволяет выполнять фрагменты кода без мороки с инфр... | https://habr.com/ru/post/562392/ | null | ru | null |

# Практическое применение Dictionary Services в OS X 10.5

Я хочу рассказать о сервисе справочников и словарей, идущего в комплекте с OS X. О существовании этого сервиса можно убедиться через пунк «Loop up in dictionary» практически в любом всплывающем меню. Достаточно выделить интересующее слово, вызвать меню и выбрав... | https://habr.com/ru/post/30542/ | null | ru | null |

# Установка Kubernetes на Hetzner Cloud

*Обновлено 21/08/2020. С момента написания статьи прошло чуть больше года и ряд примеров перестали работать — технологии развиваются, поэтому немного дополнил и переделал примеры.*

В данной статье я хотел бы рассказать об установке Kubernetes на Hetzner Cloud.

На моем раб... | https://habr.com/ru/post/419323/ | null | ru | null |

# PHP Toolkit для ADO.NET Data Services — устраняем грани технологий: PHP + .NET

[](http://blogs.gotdotnet.ru/personal/sergun/content/binary/WindowsLiveWriter/PHPToolkitADO.NETDataServices_... | https://habr.com/ru/post/67781/ | null | ru | null |

Subsets and Splits

No community queries yet

The top public SQL queries from the community will appear here once available.