text stringlengths 20 1.01M | url stringlengths 14 1.25k | dump stringlengths 9 15 ⌀ | lang stringclasses 4

values | source stringclasses 4

values |

|---|---|---|---|---|

# Микрофронтенды: микросервисы для фронтенда

*Можно ли использовать принципы микросервисной архитектуры применительно к фронтенду?*

Популярность микросервисной архитектуры во многом связана с тем, что она по... | https://habr.com/ru/post/697994/ | null | ru | null |

# Кеширование в Yii с помощью тегов

Yii позволяет кешировать данные в виде массива возвращаемые прямиком из базы данных.

А у системы кеширования есть разные зависимости. Вот только ни одна из этих зависимостей не позволяет автоматически отслеживать изменения в таблице без обращения к ней же (имею ввиду CDbCacheDepe... | https://habr.com/ru/post/140414/ | null | ru | null |

# Программирование в PHP для командной строки

##### Предисловие

Ubuntu предоставляет в комплекте с пакетом apache2 утилиты для включения\выключения виртуальных хостов и модулей. Однако, создание конфигов для виртуальных хостов отнимают дополнительное время. Поэтому, мне захотелось исправить этот недостаток. Можно был... | https://habr.com/ru/post/112146/ | null | ru | null |

# Tor Browser без Tor

Tor Browser — сборка из Tor, Firefox и других полезных утилит, заточенная под анонимный серфинг. Трафик пользователя проходит через анонимную сеть Tor, а браузер настроен так, чтобы оставлять на сайтах... | https://habr.com/ru/post/356698/ | null | ru | null |

# Производительность 40G Ethernet с коммутатором на основе Intel ONS

Сегодня доступно приличное количество интерфейсов, каждый из которых претендует на полезность и необходимость. Традиционный Ethernet с 1... | https://habr.com/ru/post/213911/ | null | ru | null |

# Ещё один способ получить нестандартные данные в iOS

Привет!

Я хочу показать, как, не используя приватных API ( = не используя приватных фреймворков/классов/функций) можно собирать разнообразные данные о использовании устройства.

#### Предыстория

Радость от появления пакета OpenVPN для сетевого хранилища Synology быстро прошла. Попытка настроить сеть для малого офиса, закончилась практически не начавшись. В интерфейсе для настройки пакета отсутствовали в... | https://habr.com/ru/post/230517/ | null | ru | null |

# React on λambda

Без особых церемоний начнем раздавать лещей и кричать о функциональщине, да кстати, всем привет!

С развитием реакт плавно избавляется от ООП-шной примеси и всё больше приближается к функциональному программированию.... | https://habr.com/ru/post/449114/ | null | ru | null |

# Как убить Lenovo G580 одним ударом

Помните недавний [баг EFI на Samsung 530U3C](https://bugs.launchpad.net/ubuntu-cdimage/+bug/1040557), который приводил к тому, что ноутбук больше не работал после единоразовой загрузки ubuntu?

**Встречайте EFI на Lenovo G580!**

Итак, в канун нового года и праздничных распрода... | https://habr.com/ru/post/169985/ | null | ru | null |

# CLD — Open source проект для ИТ компаний и SRE/DevOps инженеров

CLD это система для обеспечения комплексной информационной безопасности и организации разграничения доступа к серверам и скриптам с возможностью оперативно внедрять пользовательские модули и инструменты автоматизации.

Мы высоко ценим автоматизацию проц... | https://habr.com/ru/post/659023/ | null | ru | null |

# Пять Docker-утилит, о которых вам стоит узнать

*[Источник](http://www.mrwallpaper.com/wallpapers/diving-with-whales.jpg) изображения*

На просторах сети Интернет можно найти немало полезных утилит для [Docker](https://xebi... | https://habr.com/ru/post/330326/ | null | ru | null |

# Третий глаз для незрячих

В этом посте мы расскажем про «Третий глаз» для незрячих – новшество, которое помогает незрячим людям ориентироваться со скоростью и уверенностью, находя близлежащие препятствия с ... | https://habr.com/ru/post/547112/ | null | ru | null |

# Четыре способа извлечения значений из скрытых полей в C#

Добрый день. Не так давно на хабре проскакивала статья, в которой показывалась возможность обращения к закрытым полям объекта из другого экземпляра того же класса.

```

public class Example

{

private int JustInt;

// Some code here

public void DoSomet... | https://habr.com/ru/post/304520/ | null | ru | null |

# Статистика появления правил IDS/IPS Suricata для новых угроз

Обязательный атрибут защиты для большой компании — IDS/IPS (система обнаружения и предотвращения вторжений). На рынке большое количество коммерческих и open-source решений, и каждое из них имеет свои достоинства и недостатки. Но общее во всех решениях — не... | https://habr.com/ru/post/282029/ | null | ru | null |

# Под прессом. Ломаем и защищаем Wordpress своими руками

WordPress — это удобная блог-платформа для публикации статей и управления ими, на которой базируется огромное число различных сайтов. Из-за своей распространенности ... | https://habr.com/ru/post/259843/ | null | ru | null |

# Чему я научился, пока писал свой агрегатор цен на игры

Этот пост не реклама моего проекта, а пример того, что дает человеку pet-project.

Я попробую рассказать, как, будучи тридцатипятилетним java-разработчиком, имеющим обязательства перед женой, маленьким ребенком и работодателем, сумел выделить время на самообразо... | https://habr.com/ru/post/522994/ | null | ru | null |

# Ускоряем код на Android'е

Продолжу начатую в моей предыдущей [статье](http://habrahabr.ru/post/268653/) работу по оптимизации алгоритма. Вкратце расскажу, что было сделано. Были взяты готовые [java исходники и каскадная модель](https://code.google.com/p/jviolajones/) одной из реализаций алгоритма [Виола-Джонса](http... | https://habr.com/ru/post/268987/ | null | ru | null |

# Маршрутизация в Linux: VRF Lite

Обычно VRF (Virtual Routing and Forwarding, VPN Routing and Forwarding) используется совместно с MPLS, но без оной в терминологии Cisco называется VRF-Lite. Суть этой технологии в том, что маршрутная информация, принадлежащая различным классам (например, маршруты одного клиента) изоли... | https://habr.com/ru/post/138698/ | null | ru | null |

# Упрощаем автоматизацию API-тестов с помощью Cucumber и Spock

Привет! Я Владимир Пасюга, QA Engineer в NIX. Общий опыт в IT у меня составляет 7 лет, из них 2,5 года я был мануальным тестировщиком в биомедици... | https://habr.com/ru/post/588400/ | null | ru | null |

# Функции для решения квадратичных сравнений. Реализация в MATLAB

#### Введение

Для решения криптографических задач необходимо уметь решать квадратичные сравнения по заданному модулю. Алгоритм решения квадратичного сравнения достаточно прост и не вызывает сложностей в решении при небольших значениях модуля и свободн... | https://habr.com/ru/post/247683/ | null | ru | null |

# Windows + Lighttpd + Python краткая инструкция по запуску

Под катом краткая инструкция по установке и настройке вышеуказанной связки. Через поиск не нашел, когда ставил для себя пришлось порыться по инету.

##### Шаг первый.

[Качаем](http://en.wlmp-project.net/downloads.php?cat=lighty) и ставим Lighttpd для Windo... | https://habr.com/ru/post/113190/ | null | ru | null |

# Переход с jQuery на Vue.js

Автор статьи, перевод которой мы публикуем сегодня, полагает, что в мире существует ещё много программистов, которые, когда им нужно разработать простое веб-приложение, обращаются к [jQuery](https://jquery.com/). Обычно это случается тогда, когда некую страницу нужно оснастить простыми инт... | https://habr.com/ru/post/414073/ | null | ru | null |

# STM32, C++ и FreeRTOS. Разработка с нуля. Часть 4 (Прерывания, UART и недоHART)

#### Ведение

Попав в отпуске в город на Неве и посетив множество красивых мест, я все таки, вечерами за чашкой пива, разбирался с UARTом. Тем более, что я купил неплохие наушники Fisher FA011, к которым пришлось прикупить USB SOUND BLAS... | https://habr.com/ru/post/367843/ | null | ru | null |

# Docker: заметки веб-разработчика. Итерация третья

Привет, друзья! Продолжаю делиться с вами заметками о [`Docker`](https://www.docker.com/).

Заметки состоят из 4 частей: 2 теоретических и 2 практических. Если быть более конкрет... | https://habr.com/ru/post/650969/ | null | ru | null |

# Защита gmail от спама.

Прошу заранее прощения, но мне хочется немного разбавить поток прилизанных пресс-релизов, и хвалебных обзоров гугла, в этом блоге, небольшим user experience.

До недавнего времени я к гуглу относился исключительно положительно (не скажу «любил» т.к. не имею привычки влюбляться в сервисы). Но... | https://habr.com/ru/post/14305/ | null | ru | null |

# Компилируем FFmpeg в WebAssembly (=ffmpeg.js): Часть 1 — Приготовления

Список переведённых частей серии:

1. [Приготовления](https://habr.com/ru/post/473098/) (вы тут)

2. [Компиляция с Emscripten](https:... | https://habr.com/ru/post/473098/ | null | ru | null |

# Производительность сетевых приложений Linux. Введение

Веб-приложения ныне используются повсеместно, а среди всех транспортных протоколов львиную долю занимает HTTP. Изучая нюансы разработки веб-приложений, большинство уделяет очень мало внимания операционной системе, где эти приложения реально запускаются. Разделени... | https://habr.com/ru/post/455212/ | null | ru | null |

# Пишем простой интерпретатор на C++ с помощью TDD, часть 1

#### Введение

Многие C++ программисты слышали про разработку через тестирование. Но почти все материалы по данной теме касаются более высокоуровневых языков и со... | https://habr.com/ru/post/231657/ | null | ru | null |

# Кортеж здорового человека

Эта статья — об одном из лучших изобретений Python: именованном кортеже (namedtuple). Мы рассмотрим его приятные особенности, от известных до неочевидных. Уровень погружения в тему будет... | https://habr.com/ru/post/438162/ | null | ru | null |

# Альтернативный терминал для Windows

Часто путают терминал и шелл. В тех же \*nix есть шеллы (bash, csh, zsh, …) и терминалы (konsole/guake/yaquake/tilda и т.д. и т.п.) Для мира Windows общеизвестный терминал только один – стандартное консольное окошко, которое часто ошибочно называют «cmd.exe». И мало кто знает о су... | https://habr.com/ru/post/164687/ | null | ru | null |

# Погружение в технологию блокчейн: Быстрые и безопасные транзакции

Представляем вам серию статей о первых в России проектах, разработанных на основе технологии блокчейн. Мы спросили у команд-участниц хакатона InspiRussia о технологической составляющей их решений.

В этом материале речь пойдет о победителях хакатона... | https://habr.com/ru/post/312308/ | null | ru | null |

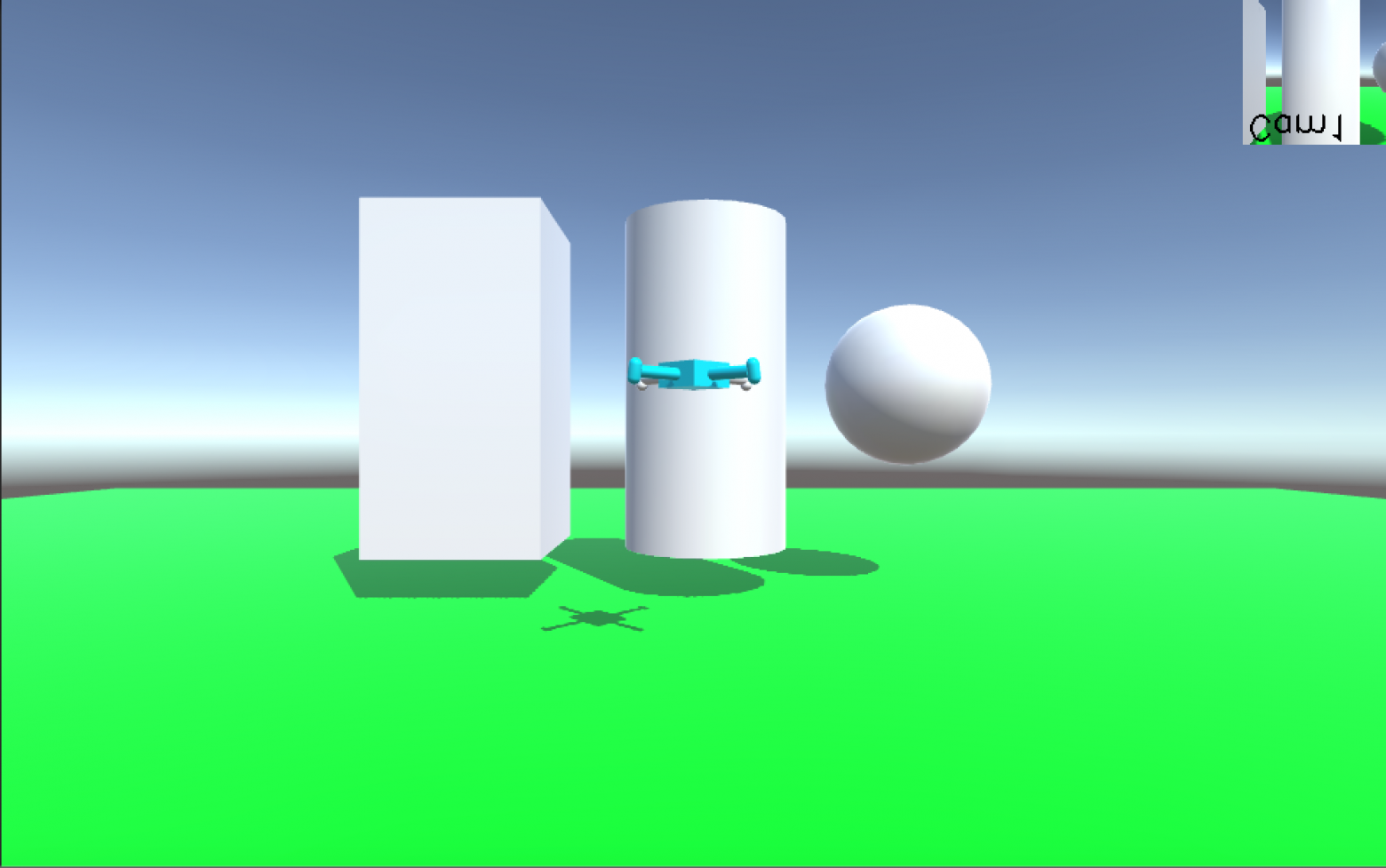

# Виртуальный квадрокоптер на Unity + OpenCV (Часть 2)

Доброго времени суток, дорогие хабравчане!

Этой статьей я хотел бы продолжить серию о том, как подружить Unity, C++ и OpenCV. А также, как получить виртуальную с... | https://habr.com/ru/post/269007/ | null | ru | null |

# Самопальная ORM для Битрикс

Не смотря на то, что модуль с поддержкой ORM разработчики битрикса анонсировали ещё в конце прошлого года, и того, что этот модуль заявлен в списке доступных в практически всех редакциях, реально его пока что нет в комплекте, как нет по нему и документации. Оставим за кадром неэтичность в... | https://habr.com/ru/post/175705/ | null | ru | null |

# Создание шейдера дыма на GLSL

*[Дым на КДПВ несколько сложнее получаемого в туториале.]*

Дым всегда был окружён ореолом таинственности. На него приятно смотреть, но сложно моделировать. Как и многие другие физические явления, дым — это... | https://habr.com/ru/post/333718/ | null | ru | null |

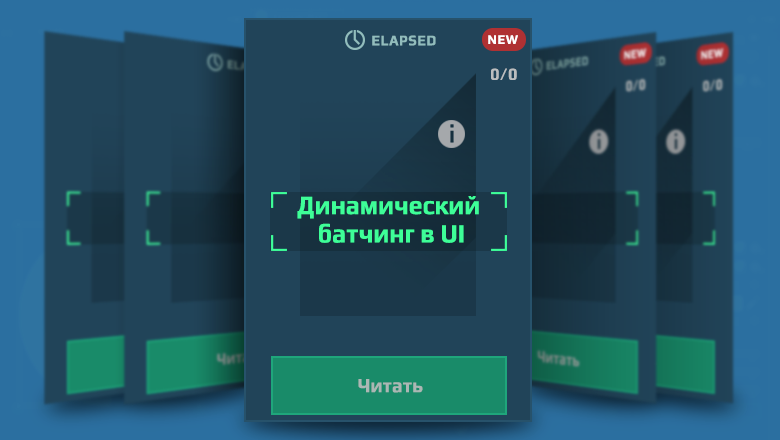

# Укрощение батчинга за счет оптимизации масок UI

Часто мы сталкиваемся с задачей оптимизации интерфейсов, и приходится отлаживать то, что давно работает, но периодически усложняется. На таких экранах проблем... | https://habr.com/ru/post/596863/ | null | ru | null |

# Как использовать новейшие функции JavaScript в любом браузере

JavaScript — это язык, который развивается очень быстро, и иногда мы хотим использовать его новейшие функции, но, если наш браузер или ... | https://habr.com/ru/post/517134/ | null | ru | null |

# Олимпиады по программированию, взгляд из НГУ. Статья 5 — как играет команда

Во время своих предыдущих статей я уже более-менее описал то, как проходит типичный тур обычной олимпиады по программированию изнутри. Кого-то заинтересовала эта внутренняя механика, а кто-то хотел услышать больше о непосредственно кодинге. ... | https://habr.com/ru/post/64144/ | null | ru | null |

# Ввод данных в STM32F4xx с параллельного АЦП через DCMI

Известно, что семейство микроконтроллеров STM32F4xx, имея на борту достаточно производительные ядра, вполне подходящие для «не мясорубочных» задач ЦОС не имеют полноценного интерфейса ввода данных с простейшей параллельной шины в режиме «pipe-line» (clk-data). «... | https://habr.com/ru/post/482506/ | null | ru | null |

# Немного SQL алхимии

О популярной библиотеке SQLAlchemy для работы с разными СУБД из Python было написано довольно много статей. Предлагаю вашему вниманию обзор и сравнение запросов с использованием ORM и SQL подходов. Данное руководство будет интересно прежде всего начинающим разработчикам, поскольку позволяет быстр... | https://habr.com/ru/post/531472/ | null | ru | null |

# Как генерировать стихи с помощью силлабо-тонической трансформенной языковой модели (часть первая)

Всем привет! Меня зовут Илья Козиев, я работаю в Управлении экспериментальных систем машинного обучения SberDevices над вопросами генерации текстового контента. В этой статье я хочу представить эффективный способ решени... | https://habr.com/ru/post/660717/ | null | ru | null |

# Еще раз о регекспах, бэктрекинге и том, как можно положить на лопатки JVM двумя строками «безобидного» кода

Раннее утро, десятая чашка кофе, безуспешные попытки понять почему ваше клиентское (или еще хуже – серверное) java-приложение намертво зависло при вычислении простого регекспа на небольшой строке… Если подобна... | https://habr.com/ru/post/544688/ | null | ru | null |

# Малоизвестные функции Python

В этой статье будут описаны малоизвестные, но полезные, функции Python. Многие функции из этого списка могут сильно уменьшить ваш код, оптимизировать его и сделать более читаемым.

Функция filter

--------------

Функция filter предназначена для "фильтрации" массива и может заменить цикл.... | https://habr.com/ru/post/595081/ | null | ru | null |

# Kotlin Best Practices

Kotlin, созданный всего 5 лет назад, с 2019 года считается приоритетным языком программирования под Android. И все же этот язык достаточно молод и продолжает развиваться, поэтому иногда бывает непонятно, каким образом лучше написать код. У нас в команде часто бывают обсуждения на тему чистого K... | https://habr.com/ru/post/546452/ | null | ru | null |

# Книга «Java для всех»

[](https://habr.com/ru/company/piter/blog/472076/) Привет, Хаброжители! Данная книга предназначена для начинающих.

Вот уже многие годы язык Java входит в число самых популярных и востребованных. Он краси... | https://habr.com/ru/post/472076/ | null | ru | null |

# Генерируем заголовки фейковых новостей в стиле Ленты.ру

*Сравниваем 2 подхода к генерации текста c помощью нейронных сетей: Char-RNN vs Word Embeddings + забавные примеры в конце.*

Когда становится совсем нечего читать, открывать книгу не хочется, все статьи на Хабре прочитаны, все нотификации на телефоне обработ... | https://habr.com/ru/post/345190/ | null | ru | null |

# По колено в PDF. PHP парсер с плюшками

Так получилось, что с месяц назад передо мной выросла совершенно неожиданная задача: сконвертировать PDF в html по имеющемуся шаблону. В том числе необходимо было разбивать все на страницы и выделять в них параграфы. Да и много еще чего. И все бы ничего, и обошелся бы я какой-н... | https://habr.com/ru/post/140847/ | null | ru | null |

# План алгоритмического собеседования: как впечатлить интервьюера и получить работу мечты

При поиске работы программистам часто приходится сталкиваться с алгоритмическим интервью. Вам предлагают лист бумаги или доску, ручку, фломастер... | https://habr.com/ru/post/713404/ | null | ru | null |

# Понимание джойнов сломано. Это точно не пересечение кругов, честно

Так получилось, что я провожу довольно много собеседований на должность веб-программиста. Один из обязательных вопросов, который я задаю — это чем отличается INNER JOIN от LEFT JOIN.

Чаще всего ответ примерно такой: "inner join — это как бы пересече... | https://habr.com/ru/post/448072/ | null | ru | null |

# Обзор Kali Linux 2021.2

[](https://habr.com/ru/company/ruvds/blog/566164/)

В начале июня состоялся релиз дистрибутива для цифровой криминалистики и тестирования систем безопасности [Kali Linux 2021.2](https://www.kali.org/get-kali/... | https://habr.com/ru/post/566164/ | null | ru | null |

# Оптимизация dotMemory с использованием dotMemory (и не только...)

dotMemory — это профилировщик памяти для .NET от компании JetBrains. А меня зовут Илья, и я из команды разработки этого инструмента.

Хочу п... | https://habr.com/ru/post/574722/ | null | ru | null |

# Варианты использования Java ML библиотек совместно с Spring, Docker, Spark, Rapids, CUDA

Введение

--------

В данной статье рассматривается способ использования GPU nVidia с технологией CUDA в Docker-контейнерах для распределенной тренировки моделей машинного обучения на нескольких машинах. Цель статьи - показать ва... | https://habr.com/ru/post/679248/ | null | ru | null |

# Марсоход, Посадка

[](https://habrahabr.ru/post/314958/)

В этой серии статей мы строим программное обеспечение марсохода в [соответствии со следующими спецификациями](https://habrahabr.ru/post/314536/). Это позволит применить... | https://habr.com/ru/post/314958/ | null | ru | null |

# Хак для поддержки кнопок Android-гарнитуры под Windows

Я почти каждый день слушаю музыку на смартфоне и использую кнопки управления на гарнитуре. Но мне всегда не нравилась одна вещь. Я прихожу домой, продолжая прослушивание, гарнитура подключается к домашнему ПК — и внезапно кнопки перестают работать.

Конечно, я... | https://habr.com/ru/post/417303/ | null | ru | null |

# Подделка писем. Как защищаться

Привет habr! В данной заметке решил затронуть тему защиты от поддельных писем (Email spoofing, Forged email). Речь пойдёт о письмах, в которых так или иначе подделывается информация об отпр... | https://habr.com/ru/post/314738/ | null | ru | null |

# Cмарт розетка REDMOND SkyPort 100S

Это продолжение [моей первой статьи на смарт цоколь Redmond](https://habr.com/ru/post/450740/). В этой статье речь пойдет о другом девайсе компании Redmond — Cмарт розетка REDMOND SkyPort 100S. Данное устройство тоже базируется [на чипе nRF51822](https://www.nordicsemi.com/?sc_item... | https://habr.com/ru/post/450860/ | null | ru | null |

# Генерация музыки из изображений с помощью Python

[](https://habr.com/ru/company/ruvds/blog/708890/)

Сказать, что музыка является частью моей жизни, будет серьёзным преуменьшением. Я более 20 лет играю на гитаре, и каждый день слуша... | https://habr.com/ru/post/708890/ | null | ru | null |

# Способ связать разные компьютеры в одну сеть

##### Задача

Есть несколько компьютеров, которые необходимо соединить в одну сеть, в не зависимости от операционной системы, аппаратной платформы, способа передачи данных и сетевого расположения. Создаваемая сеть позволит передавать данные от промышленного компьютера, уп... | https://habr.com/ru/post/127892/ | null | ru | null |

# Как я программирую под ExtJS и Zend Framework

Как известно последня версия Zend Framework включает в себя js библиотеки dojo. но, не смотря на это, для работы я выбрал связку Zend Framework + Ext JS.

Почему Zend Framework — в нем отлично реализован принцип MVC, он хорошо документирован, имеет много полезных библ... | https://habr.com/ru/post/54849/ | null | ru | null |

# Дайджест интересных новостей и материалов из мира PHP за последние две недели №22 (15.07.2013 — 28.07.2013)

Предлагаем вашему вниманию очередную подборку с ссылками на новости и материалы.

Приятного чтения!

### ... | https://habr.com/ru/post/188156/ | null | ru | null |

# Мой опыт перевода typescript проекта на ESM

Доколе

------

Все любят, чтобы инструменты просто работали. Не works simple, но just works.

А ES6 модули где-то рядом. Нодовские релиз ноуты рапортуют что их поддержка всё стабильней и стабильней, Андрей Мелихов пишет [чат](https://www.youtube.com/watch?v=uAMt7cDV7lU) на... | https://habr.com/ru/post/570734/ | null | ru | null |

# Вращающееся облако тегов на javascripte

Недавно на хабре был топик, в котром было рассказано об [облаке на флеше](http://habrahabr.ru/blogs/wordpress/38114/). Посмотрел, понравилось, решил повторить на javascript-e. Вот что получилось: [demo](http://nacmnogo.ru/cloud.html) [зеркало](http://kron0s.com/cloud.html) [ар... | https://habr.com/ru/post/38264/ | null | ru | null |

# Android IDE Template Format

В процессе создания новых приложений очень часто приходится писать однотипный код и воспроизводить уже проверенные временем структуры классов. IDE (в частности Android Studio) облегчает во мног... | https://habr.com/ru/post/274959/ | null | ru | null |

# Обзор и установка The Game Closure DevKit в Ubuntu

Неосвещённым событием на Хабрахабре стал выход The Game Closure DevKit. Это игровой движок, использующий Javascript и технологии HTML5 для создания Web, iOS и Android приложений.

GC Devkit обладает интерфейсом для наблюдения объектов в запущенном приложении, при ... | https://habr.com/ru/post/171999/ | null | ru | null |

# Учим старую собаку новым трюкам или как я научился любить str.format и отказался от %

Предлагаю вниманию читателей хабры и поклонникам python перевод довольно объемной статьи о форматировании строк. Сказка будет правдивой и ... | https://habr.com/ru/post/236633/ | null | ru | null |

# Memcached и метки. Реализация для фреймворка Kohana

Приветствую всех.

Уже довольно давно разрабатываем проект на кохане и встала необходимость эффективного кэширования данных. Не то, чтобы вопрос производительности стоит очень остро в данный момент, но, хотелось бы подготовится заранее, а не писать систему кэширо... | https://habr.com/ru/post/73423/ | null | ru | null |

# Классическое наследование в JavaScript. Разбор реализации в Babel, BackboneJS и Ember

В этой статье мы поговорим о классическом наследовании в JavaScript, распространённых шаблонах его использования, особенностях и частых ошибках применения. Рассмотрим примеры наследования в Babel, Backbone JS и Ember JS и попытаемс... | https://habr.com/ru/post/353778/ | null | ru | null |

# Линукс не для айтишника или Линукс для неайтишника? Часть 2

Привет, Хабр!

В [первой части](https://habr.com/ru/post/698708/) я рассказал о своём опыте с Simply Linux, пришла очередь поделиться впечатлениями от Astra Linux CE Orel. В этот раз картинки будут.

Почему Astra? Во‑первых, отечественная, во‑вторых, стоит ... | https://habr.com/ru/post/715522/ | null | ru | null |

# .NET 6 и провайдеры баз данных

Все материалы, которые будут показываться в ходе данной статьи будут доступны [по данной ссылке](https://github.com/vliashko/CommunicationWithDB). Вполне возможно, что со временем данный репозиторий будет обновляться, или, некоторые захотят сами принять участие в его развитии.

**Можно... | https://habr.com/ru/post/669198/ | null | ru | null |

# Руководство по разработке Web-приложений на React Native

Вы проснулись. Сияет солнце, щебечут птички. В мире никто ни с кем не воюет, никто не голодает, а один и тот же код можно использовать и в веб-проектах, и в нативных приложениях. Как бы было хорошо! К сожалению, на горизонте можно разглядеть лишь универсальный... | https://habr.com/ru/post/428568/ | null | ru | null |

# Оптимизация портфеля ценных бумаг средствами Python

### Введение

На финансовом рынке обращается, как правило, несколько типов ценных бумаг: государственные ценные бумаги, муниципальные облигации, корпоративные акции и т.п.

Если у участника рынка есть свободные деньги, то их можно отнести в банк и получать процен... | https://habr.com/ru/post/341992/ | null | ru | null |

# От сортировки пузырьком к генетическим алгоритмам

Данная статья является кратким обзором того, что представляют собой генетические алгоритмы. Будучи новичком в биоинформатике, начну с вещей, близких и понят... | https://habr.com/ru/post/212893/ | null | ru | null |

# Удаляем старые ненужные DHCP-резервации IP-адресов

Иногда в крупных организациях нужно провести ревизию свободных IP-адресов. Пользователи приезжают на место/уезжают/увольняются, IP адреса остаются зарезервированны хотя за ними уже никого нет. Поиском таких «мертвых душ» и займемся.

Рассмотрим пример, как получаю... | https://habr.com/ru/post/161583/ | null | ru | null |

# 5 современных альтернатив старым инструментам командной строки Linux

Используя более современные альтернативы наряду со старыми инструментами командной строки, можно получить больше удовольствия и даже повысить производительность труда.

для получения стати... | https://habr.com/ru/post/487208/ | null | ru | null |

# [ libGDX ] Пишем полноценную игру под Android. Часть 2

Здравствуйте! Не прошло и суток с момента публикации [первой части](http://habrahabr.ru/post/224175/) статьи, а я не могу спать, так как есть незаконченное дело и нужно дописать статью. Приступим.

Оговорюсь еще раз. Я шибкий не знаток Java и поэтому следующий... | https://habr.com/ru/post/224223/ | null | ru | null |

# «Истина в последней инстанции» или зачем нужен Database First Design

В этой весьма запоздалой статье я объясню почему, по моему мнению, в большинстве случаев при разработке модели данных приложения необходимо придерживаться подхода "database first". Вместо "Java[любой другой язык] first" подхода, который выведет вас... | https://habr.com/ru/post/413597/ | null | ru | null |

# Асинхронная (и не очень) загрузка данных в Unreal Engine 4

### Содержание:

* [Шаг 1. Использование специальных указателей на ассеты](#2)

* [Шаг 2. Загрузка ресурсов в память по требованию](#3)

* [Примеры](#4)

+ [Пр... | https://habr.com/ru/post/309228/ | null | ru | null |

# Магия JavaScript: arguments

`arguments` — очень специфическая штука, о которой новички и даже любители знают только то, что это «вроде массив, но какой-то неправильный». На самом деле, у него есть ряд интересных особенностей. Предлагаю в топике пофантазировать на тему TypeHinting, аргументов по-умолчанию и всякого д... | https://habr.com/ru/post/117868/ | null | ru | null |

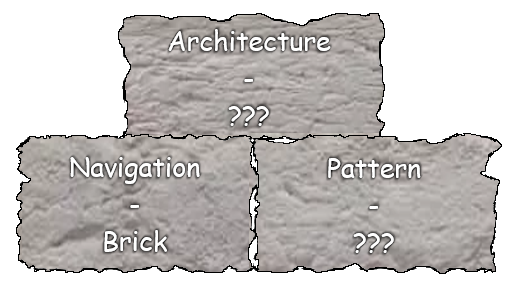

# Очередная навигация для Android Jetpack Compose? Brick

Я до последнего верил в [Navigation component](https://developer.android.google.cn/jetpack/compose/navigation?hl=en) от google. Но, к сожалению, ряд за... | https://habr.com/ru/post/594383/ | null | ru | null |

# Учебник Thymeleaf: Глава 2. Хорошая виртуальная бакалейная лавка Thymes

[Оглавление](https://habrahabr.ru/post/350862/)

2 Хорошая виртуальная бакалейная лавка Thymes

---------------------------------------------

Исходный код примеров, показанных в этом и будущих главах руководства, можно найти в репозитории Good... | https://habr.com/ru/post/350866/ | null | ru | null |

# Radarr, Jackett и бот в телеге. Качаем торренты по-новому

В итоге, конечно, стриминг таки добьёт торренты. И если в 720/1080p мире это, по сути, уже свершилось, то Blue-ray/4k/8k контент пока ещё держится за счёт торрентов ... | https://habr.com/ru/post/505814/ | null | ru | null |

# С 4 часов до 1 минуты. Как найти одну строчку, которая ускорит сервис на Ruby

Как-то раз у нас перестал работать один сервис. Никто давно его не трогал, никто не помнил, кто его написал. Работает - и ладно. Генерировал CSV отчеты для бизнеса в Sidekiq воркере (асинхронно). Проблема стала очевидной то ли от того, что... | https://habr.com/ru/post/561258/ | null | ru | null |

# Crosswalk Project — замена Android WebView. Проблемы интеграции

В этой статье я закончу свой рассказ о проекте Crosswalk Project (первую часть вы можете найти [здесь](http://habrahabr.ru/post/263649/)). Ра... | https://habr.com/ru/post/263655/ | null | ru | null |

# Процесс компиляции программ на C++

Цель данной статьи:

-------------------

В данной статье я хочу рассказать о том, как происходит компиляция программ, написанных на языке **C++**, и описать каждый этап компиляции. Я не преследую цель рассказать обо всем подробно в деталях, а только дать общее видение. Также данная... | https://habr.com/ru/post/478124/ | null | ru | null |

# Перевод Django Documentation: Models. Part 1

Доброго времени суток!

Данный топик представляет собой первую часть перевода [документации Django](http://docs.djangoproject.com/en/dev/), а именно раздела о [моделях](http://docs.djangoproject.com/en/de... | https://habr.com/ru/post/74856/ | null | ru | null |

# Много анонимности не бывает — скрываем User-Agent

Очередной приступ паранойи был вполне обоснован — он наступил после прочтения [статьи о методах анонимности в сети](http://habrahabr.ru/post/203680/), где автор на примере браузера FireFox рассказывал о потенциальных утечках идентификационной информации. И стало инте... | https://habr.com/ru/post/231107/ | null | ru | null |

# Критический путь рендеринга веб-страниц

В среде веб-разработчиков все больше распространяется знание о том, что скорость важна. Многие стараются ускориться: используют сжатие gzip, минификацию, кеширующие заголовки, сокращение запросов, оптимизацию картинок и другие.

После выполнения этих рекомендаций возникает в... | https://habr.com/ru/post/262239/ | null | ru | null |

# Уведомления об истечении срока действия пароля в Active Directory средствами PowerShell

#### Предыстория

Началась вся история с того, что подошло время очередного IT аудита. Пришли серьезные дяденьки из Price Waterhouse Coopers, дали нам массу указаний и пару скриптов, которые надо было запустить на контроллере дом... | https://habr.com/ru/post/160599/ | null | ru | null |

# Автоматизация публикации приложения в Google Play

Если у вас есть андроид приложение, которые вы собираетесь опубликовать в Google Play или оно уже опубликовано, а так же если вы его только разрабатываете, и оно находится в закрытом бета тестировании, а заказчику\тестерам периодически нужно собирать и передавать сбо... | https://habr.com/ru/post/281557/ | null | ru | null |

# Перевод Redmine-плагинов с TelegramCLI на Webogram

Ранее мы уже писали о наших плагинах [redmine\_chat\_telegram](https://habrahabr.ru/company/southbridge/blog/281044/) и [redmine\_intouch](https://habrahabr.ru/company/sout... | https://habr.com/ru/post/332292/ | null | ru | null |

# Nomad: проблемы и решения

Первый сервис в [Nomad](https://www.nomadproject.io/) я запустил в сентябре 2016 года. На данный момент пользуюсь как программист и занимаюсь поддержкой как администратор двух Nomad кластеров — один "домашний" для своих личных проектов (6 микро-виртуалок в Hetzner Cloud и ArubaCloud в 5 раз... | https://habr.com/ru/post/435132/ | null | ru | null |

# Как я собрал первый аналоговый клиент для твиттера

Однажды у нас с друзьями появилась идея, почему бы не сделать так, чтобы на старом дисковом телефоне можно было набрать какое-то сообщение и отправить его. А и правда, подумал я, тем более мне давно хотелось сделать что-нибудь на базе Arduino, ведь платформа доступн... | https://habr.com/ru/post/131065/ | null | ru | null |

# Знакомство с GStreamer: Источники данных

Здравствуй, хабраюзер, интересующийся фреймворком GStreamer! Сегодня мы поговорим о источниках медиа-данных (sources), и тем самым продолжим курс статей посвященный GStreamer.

Предыдущая статья: [Знакомство с GStreamer: Введение](http://habrahabr.ru/post/178813/).

#### ... | https://habr.com/ru/post/179167/ | null | ru | null |

# Уменьшаем кол-во запросов requestAction-ов с помощью Cache

[В документации](http://book.cakephp.org/view/434/requestAction) Cakephp 1.2 говорится о том что если requestAction используется без кеширования, то это может уменьшить производительность.

*If used without caching requestAction can lead to poor performanc... | https://habr.com/ru/post/69401/ | null | ru | null |

# Chaos engineering: Начало

Всем привет! Это моя первая статья в пространстве хабра, и на написание данной статьи меня сподвигли недавние проблемы в гигантах it индустрии. Пересказывать произошедшее я не буду, но вот кое-какие выводы из это сделать можно.

Как показала практика от сбоев в IT системах никто не застрахо... | https://habr.com/ru/post/583806/ | null | ru | null |

# Переиспользуемый компонент Svelte: чтобы никому не было больно

Компонентные фреймворки независимо от названия никогда не покинут область только нишевого использования, ес... | https://habr.com/ru/post/541834/ | null | ru | null |

Subsets and Splits

No community queries yet

The top public SQL queries from the community will appear here once available.